What I want to tell you about today is how I see robots invading our lives at multiple levels, over multiple timescales. And when I look out in the future, I can't imagine a world, 500 years from now, where we don't have robots everywhere. Assuming -- despite all the dire predictions from many people about our future -- assuming we're still around, I can't imagine the world not being populated with robots. And then the question is, well, if they're going to be here in 500 years, are they going to be everywhere sooner than that? Are they going to be around in 50 years? Yeah, I think that's pretty likely -- there's going to be lots of robots everywhere. And in fact I think that's going to be a lot sooner than that. I think we're sort of on the cusp of robots becoming common, and I think we're sort of around 1978 or 1980 in personal computer years, where the first few robots are starting to appear.

Vreau să vă povestesc astăzi este despre cum văd eu că roboții ne invadează viața la niveluri multiple, la diverse intervale de timp. Și când mă uit în viitor, îmi imaginez o lume, 500 de ani de acum înainte, unde nu avem roboți peste tot, asumând că - în ciuda tuturor previziunilor sumbre a multor oameni asupra viitorului - asumând că încă existăm, nu îmi pot imagina lumea fără a fi populată de roboți. Iar întrebarea este, defapt, dacă vor mai fi aici și peste 500 de ani, nu vor fi peste tot mai repede de atât? Vor fi deja peste tot în aproximativ 50 de ani? Da, eu cred că este destul de posibil -- vor fi mulți roboți peste tot. Și defapt eu cred că asta se va întâmpla și mai repede. Cred că suntem pe punctul de a avea roboții peste tot, și cred că suntem undeva prin 1978 sau 1980 în anii computerului personal, când primii roboți încep să apară.

Computers sort of came around through games and toys. And you know, the first computer most people had in the house may have been a computer to play Pong, a little microprocessor embedded, and then other games that came after that. And we're starting to see that same sort of thing with robots: LEGO Mindstorms, Furbies -- who here -- did anyone here have a Furby? Yeah, there's 38 million of them sold worldwide. They are pretty common. And they're a little tiny robot, a simple robot with some sensors, a little bit of processing actuation.

Computerele au cam apărut prin jocuri și jucării. Și știți voi, primul computer pe care oamenii l-au avut în casă s-ar putea să fi fost un computer cu care să te joci Pong, und mic microprocesor integrat, și toate celelalte jocuri care au apărut după aceea. Și începem să vedem același lucru și cu roboții: LEGO Mindstorms, Furbies -- cine de aici -- a avut un Furby? Da, s-au vândut 38 de milioane în lumea întreagă. Sunt destul de des întâlniţi, și sunt un roboțel mic, un simplu robot cu senzori. Este doar un proces de punere în mișcare.

On the right there is another robot doll, who you could get a couple of years ago. And just as in the early days, when there was a lot of sort of amateur interaction over computers, you can now get various hacking kits, how-to-hack books. And on the left there is a platform from Evolution Robotics, where you put a PC on, and you program this thing with a GUI to wander around your house and do various stuff. And then there's a higher price point sort of robot toys -- the Sony Aibo. And on the right there, is one that the NEC developed, the PaPeRo, which I don't think they're going to release. But nevertheless, those sorts of things are out there.

În dreapta acolo este o altă păpușă robot, pe care o puteai cumpăra acum câțiva ani. Și la fel ca și în vremurile de demult, când exista un fel de interacțiune de amator cu computerele, poţi obţine diferite kit-uri de hacking, cărţi despre hacking. Și în stânga este o platformă de la Evoluția Roboticii, unde folosești un PC, și programezi acest lucru cu un GUI pentru a se plimba prin casa ta și a face diverse lucruri. Și după care mai sunt cele la preț mare, un fel de roboți jucărie... Sony Aibo. Și în partea dreaptă acolo, este cel pe care l-a dezvoltat NEC , PaPeRo, pe care nu cred că îl vor lansa. Dar cu toate acestea, astfel de lucruri există.

And we've seen, over the last two or three years, lawn-mowing robots, Husqvarna on the bottom, Friendly Robotics on top there, an Israeli company. And then in the last 12 months or so we've started to see a bunch of home-cleaning robots appear. The top left one is a very nice home-cleaning robot from a company called Dyson, in the U.K. Except it was so expensive -- 3,500 dollars -- they didn't release it.

Și am văzut, în ultimii doi sau trei ani, roboți care ară. Husqvarna se află jos, Friendly Robotics sus acolo, o companie israeliană. Iar în ultimele 12 luni sau așa am observat apariția unei mulțimi de roboți care curăță. În stânga sus este un robot foarte frumos care curăță de la o companie pe nume Dyson, din Marea Britanie. Cu excepția că a fost atât de scump... 3,500 dolari -- încât nu l-au lansat.

But at the bottom left, you see Electrolux, which is on sale. Another one from Karcher. At the bottom right is one that I built in my lab about 10 years ago, and we finally turned that into a product. And let me just show you that. We're going to give this away I think, Chris said, after the talk. This is a robot that you can go out and buy, and that will clean up your floor. And it starts off sort of just going around in ever-increasing circles. If it hits something -- you people see that? Now it's doing wall-following, it's following around my feet to clean up around me. Let's see, let's -- oh, who stole my Rice Krispies? They stole my Rice Krispies! (Laughter) Don't worry, relax, no, relax, it's a robot, it's smart! (Laughter) See, the three-year-old kids, they don't worry about it. It's grown-ups that get really upset. (Laughter) We'll just put some crap here. (Laughter) Okay. (Laughter) I don't know if you see -- so, I put a bunch of Rice Krispies there, I put some pennies, let's just shoot it at that, see if it cleans up. Yeah, OK. So -- we'll leave that for later. (Applause)

Dar în stânga jos vedeți de la Electrolux, care este de vânzare. Încă unul de la Karcher. În dreapta jos este acela care l-am construit în laboratorul meu acum 10 ani, și într-un final l-am transformat în produs. Și stați să vă arăt. Îl vom da pe acesta, cred că Chris a spus asta, după discuție. Acesta este un robot pe care poți să te duci să îl cumperi, care îți va curăța podeaua. Și când începe să funcționeze, merge în cercuri tot mai mari. Dacă cumva se lovește de ceva -- ați văzut? Acum merge de-alungul peretelui, merge în jurul picioarelor mele să curețe ce e în jurul meu. Hai să vedem, hai să... oh, cine mi-a furat Rice Krispies-urile mele? Mi-au furat Rice Krispies-urile mele. (Râsete) Nu vă faceți griji, relaxați-vă, serios, relaxați-vă, e un robot, e inteligent. (Râsete) Vedeți, copiii de 3 ani, lor nu le pasă. Adulții sunt cei care chiar se supără. (Râsete) Vom pune aici niște gunoi. (Râsete) Ok. (Râsete) Nu știu dacă vedeți - deci, am pus niște Rice Krispies aici, am pus niște monezi, să vedem dacă va curăța totul. Da. Ok, deci... O să lăsăm asta pentru mai târziu. (Aplauze)

Part of the trick was building a better cleaning mechanism, actually; the intelligence on board was fairly simple. And that's true with a lot of robots. We've all, I think, become, sort of computational chauvinists, and think that computation is everything, but the mechanics still matter. Here's another robot, the PackBot, that we've been building for a bunch of years. It's a military surveillance robot, to go in ahead of troops -- looking at caves, for instance. But we had to make it fairly robust, much more robust than the robots we build in our labs. (Laughter) On board that robot is a PC running Linux. It can withstand a 400G shock. The robot has local intelligence: it can flip itself over, can get itself into communication range, can go upstairs by itself, et cetera. Okay, so it's doing local navigation there. A soldier gives it a command to go upstairs, and it does. That was not a controlled descent. (Laughter) Now it's going to head off. And the big breakthrough for these robots, really, was September 11th. We had the robots down at the World Trade Center late that evening. Couldn't do a lot in the main rubble pile, things were just too -- there was nothing left to do. But we did go into all the surrounding buildings that had been evacuated, and searched for possible survivors in the buildings that were too dangerous to go into. Let's run this video. Reporter: ...battlefield companions are helping to reduce the combat risks. Nick Robertson has that story. Rodney Brooks: Can we have another one of these? Okay, good. So, this is a corporal who had seen a robot two weeks previously. He's sending robots into caves, looking at what's going on. The robot's being totally autonomous. The worst thing that's happened in the cave so far was one of the robots fell down ten meters.

O parte din truc a fost să fie construit un mecanism care să curețe mai bine, defapt; inteligența de pe bord a fost destul de simplă. Și asta este adevărat legat de mulți roboți. Eu cred că toți am devenit un fel de șoviniști computaționali, și credem că totul este în computație, dar mecanica își are totuși rostul. Aici este un alt robot, PackBot, pe care l-am construit în vreo câțiva ani. Este un robot de supraveghere militară, care merge înaintea trupelor, care se uită la peșteri, de exemplu. Dar a trebuit să îl facem destul de robust, mult mai robust decât roboții pe care i-am construit în laboratoarele noastre. (Râsete) În sistemul acelui robot rulează un PC Linux. Poate face față la un șoc de 400G. Robotul are inteligență locală: se poate da peste cap, poate determina raza de comunicare, poate urca singur scările, etc. Ok, acolo face navigație locală. Un soldat îi dă o comandă să meargă sus pe scări, și chiar face asta. Aceea nu a fost o coborâre controlată. (Râsete) Acum va merge mai departe. Și marea lansare a acestor roboți a fost, defapt, pe 11 Septembrie. Am avut acești roboți jos la World Trade Center târziu în acea seară. Nu au putut face prea mult în grămezile mari de moloz, lucrurile au fost prea... nu prea a rămas nimic de făcut. Dar am mers în clădirile din apropiere care au fost evacuate, și am căutat posibili supraviețuitori în clădiri în care era prea periculos să intrăm. Să rulăm acest video. Reporter: ... trupele de apărare ajută la reducererea riscurilor de atac. Nick Robertson are povestea aceea. Rodney Brooks: Mai putem avea încă unul din aceștia? Ok, bine. Acesta este un caporal care văzuse un robot cu două săptămâni înainte. El trimite roboți în peșteri, să observe ce se întâmplă. Robotul este în totalitate autonom. Cel mai groaznic lucru care s-a petrecut până acum în peșteră este că unul dintre roboți a căzut zece metri.

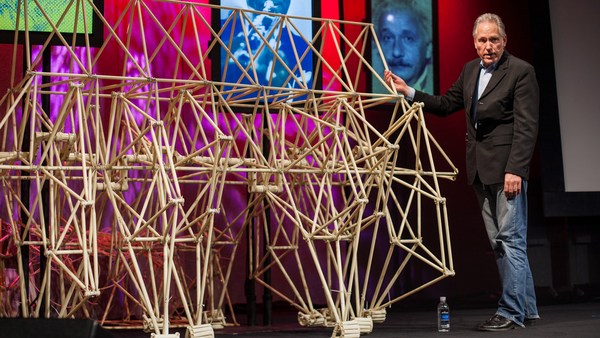

So one year ago, the US military didn't have these robots. Now they're on active duty in Afghanistan every day. And that's one of the reasons they say a robot invasion is happening. There's a sea change happening in how -- where technology's going. Thanks. And over the next couple of months, we're going to be sending robots in production down producing oil wells to get that last few years of oil out of the ground. Very hostile environments, 150˚ C, 10,000 PSI. Autonomous robots going down, doing this sort of work. But robots like this, they're a little hard to program. How, in the future, are we going to program our robots and make them easier to use? And I want to actually use a robot here -- a robot named Chris -- stand up. Yeah. Okay. Come over here. Now notice, he thinks robots have to be a bit stiff. He sort of does that. But I'm going to -- Chris Anderson: I'm just British. RB: Oh. (Laughter) (Applause) I'm going to show this robot a task. It's a very complex task. Now notice, he nodded there, he was giving me some indication he was understanding the flow of communication. And if I'd said something completely bizarre he would have looked askance at me, and regulated the conversation. So now I brought this up in front of him. I'd looked at his eyes, and I saw his eyes looked at this bottle top. And I'm doing this task here, and he's checking up. His eyes are going back and forth up to me, to see what I'm looking at -- so we've got shared attention. And so I do this task, and he looks, and he looks to me to see what's happening next. And now I'll give him the bottle, and we'll see if he can do the task. Can you do that? (Laughter) Okay. He's pretty good. Yeah. Good, good, good. I didn't show you how to do that. Now see if you can put it back together. (Laughter) And he thinks a robot has to be really slow. Good robot, that's good.

Așa că în urmă cu un an, trupele militare americane nu aveau acești roboți. Acum sunt activi la datorie în Afghanistan în fiecare zi. Și acela este unul dintre motivele pentru care ei spun că o invazie de roboți se întâmplă. Acum are loc o schimbare... direcția în care merge tehnologia. Mulțumesc. În următoarele luni, vom trimite roboți în producție să producă sonde de petrol, pentru a extrage acei ultimi ani de petrol din pământ. Medii foarte ostile, 150 centigrade, 10.000 PSI. Roboții autonomi merg în adâncuri, efectuând astfel de lucruri. Dar roboți ca aceștia, sunt puțin mai greu de programat. Cum vom programa în viitor roboții și îi vom face mai ușor de utilizat? Și chiar vreau aici să folosesc un robot... un robot pe nume Chris - ridica-te. Da. Ok. Vin-o aici. Acum observați, roboții trebuie să fie puțin rigizi. El este oarecum asa. Dar voi... Chris Anderson: Sunt britanic doar. RB: Oh. (Râsete) (Aplauze) Îi voi arăta acestui robot un lucru. Un lucru foarte complex. Acum observați, a dat din cap, mi-a dat niște indicații el a înțeles cursul comunicării. Și dacă aș fi spus ceva complet bizar s-ar fi uitat la mine bănuitor, și ar fi condus discuția. Așa că i-am adus asta în fața sa. M-am uitat în ochii lui, și am observat că ochii lui s-au îndreptat către această gură de sticlă. Și voi face lucrul următor, și el mă urmărește. Ochii săi se rotesc, la mine să vadă la ce mă uit, așadar avem o atenție împărțită. Și în timp ce fac lucrul acesta, și el privește, și se uită la mine să vadă ce se va întâmpla după aceea. Acum îi voi da sticla, și vom vedea dacă va putea face lucrul acela. Poți face asta? (Râsete) Ok. Se pricepe. Da. Bine, bine, bine. Nu ți-am arătat cum se face lucrul acela. Acum vezi dacă poți să le pui toate laolaltă. (Râsete) Și el crede că un robot trebuie să fie foarte încet. Bun robot, este bine.

So we saw a bunch of things there. We saw when we're interacting, we're trying to show someone how to do something, we direct their visual attention. The other thing communicates their internal state to us, whether he's understanding or not, regulates a social interaction. There was shared attention looking at the same sort of thing, and recognizing socially communicated reinforcement at the end. And we've been trying to put that into our lab robots because we think this is how you're going to want to interact with robots in the future. I just want to show you one technical diagram here. The most important thing for building a robot that you can interact with socially is its visual attention system. Because what it pays attention to is what it's seeing and interacting with, and what you're understanding what it's doing. So in the videos I'm about to show you, you're going to see a visual attention system on a robot which has -- it looks for skin tone in HSV space, so it works across all human colorings. It looks for highly saturated colors, from toys. And it looks for things that move around. And it weights those together into an attention window, and it looks for the highest-scoring place -- the stuff where the most interesting stuff is happening -- and that is what its eyes then segue to. And it looks right at that. At the same time, some top-down sort of stuff: might decide that it's lonely and look for skin tone, or might decide that it's bored and look for a toy to play with. And so these weights change.

Așadar putem face o gramadă de lucruri. Observăm că atunci când interacționăm, încercăm să arătăm cuiva cum să facă un lucru, direcționăm atenția lor vizuală. Celălalt lucru ne comunică starea sa interioară, dacă înțelege sau nu, coordonează o interacțiune socială. A fost atenție împărțită către același gen de lucru, iar la sfârșit recunoaşterea comunicării sociale aprofundate. Și încercăm să implementăm aceasta în laboratoarele noastre deoarece credem că așa vom vrea să interacționăm cu roboții în viitor. Vreau doar să vă arăt o diagramă tehnică aici. Cel mai important lucru în a construi un robot cu care poți interacționa social este sistemul său vizual de atenție. Deoarece la ce acordă atenție este către ce se uită și cu care interacționează, și ce înțelegi tu că face. Așadar în filmulețele pe care vi le voi prezenta, veți vedea un sistem de atenție vizuală de la un robot care are... se uită după nuanța pielii în spațiul HSV, și deci are de-aface cu, știți voi, toate culorile omenești. Se uită după culori intens saturate, de la jucării. Și se uită după lucruri care se mișcă. Și le cântărește pe acelea într-o fereastră de atenție, și se uită după punctul cu cele mai multe scoruri... lucrurile unde se întâmplă cele mai interesante lucruri. Și astea sunt după ce se uită ochii săi. Și se uită direct la acel lucru. În același timp, un fel de mișcare de jos în sus: poate decide că se simte singur și se uită după nuanța pielii, sau poate decide că este plictisit și se va uita după o jucărie cu care să se joace. Așa asta cântărește o schimbare.

And over here on the right, this is what we call the Steven Spielberg memorial module. Did people see the movie "AI"? (Audience: Yes.)

Și aici în partea dreaptă, este ceea ce numim modului memorial Steven Spielberg. Au văzut cumva oamenii filmul AI? Publicul: Da.

RB: Yeah, it was really bad, but --

RB: Mda, a fost chiar rău, dar...

remember, especially when Haley Joel Osment, the little robot, looked at the blue fairy for 2,000 years without taking his eyes off it? Well, this gets rid of that, because this is a habituation Gaussian that gets negative, and more and more intense as it looks at one thing. And it gets bored, so it will then look away at something else. So, once you've got that -- and here's a robot, here's Kismet, looking around for a toy. You can tell what it's looking at. You can estimate its gaze direction from those eyeballs covering its camera, and you can tell when it's actually seeing the toy. And it's got a little bit of an emotional response here. (Laughter) But it's still going to pay attention if something more significant comes into its field of view -- such as Cynthia Breazeal, the builder of this robot, from the right. It sees her, pays attention to her. Kismet has an underlying, three-dimensional emotional space, a vector space, of where it is emotionally. And at different places in that space, it expresses -- can we have the volume on here? Can you hear that now, out there? (Audience: Yeah.)

tineți minte, chiar când Haley Joel Osment, robotul cel mic, s-a uitat pentru 2.000 de ani la zâna cea albastră fără ca să își ia ochii de pe ea? Păi, acest lucru se debarasează de acesta, deoarece este un obișnuiță gaussiană care devine negativă, și din ce în ce mai intensă deoarece privește la un singur lucru. Și se plictisește, și se va uita după aceea la altceva. Așa că, odată ce ai acel lucru... și aici e un robot, aici e Kismet, uitându-se după o jucărie. Poți spune după ce se uită. Poți estima direcția privirii din acei ochi care acoperă obiectivul său, și poți spune când anume privește la jucărie. Și are și un pic de reacție emoțională aici. (Râsete) Dar va fi atent în continuare dacă cumva ceva mai important intră în câmpul său vizual cum ar fi Cynthia Breazeal, constructorul acestui robot... din dreapta. O vede, îi atent la ea. Kismet are un spațiu emoțional tridimensional implementat, un spațiu vectorial,care arată unde se situează emoțional. Și în locuri diferite din acel spațiu exprimă... putem avea volumul aici? Mă auziți acum, acolo? Public: Da.

Kismet: Do you really think so? Do you really think so? Do you really think so?

Kismet: Chiar credeți? Chiar credeți? Chiar credeți?

RB: So it's expressing its emotion through its face and the prosody in its voice. And when I was dealing with my robot over here, Chris, the robot, was measuring the prosody in my voice, and so we have the robot measure prosody for four basic messages that mothers give their children pre-linguistically. Here we've got naive subjects praising the robot:

RB: Își exprimă emoția prin figura sa și prozodia în vocea sa. Și când aveam de-aface cu robotul meu aici, Chris, robotul, îmi măsura prozodia din vocea mea, și așa avem măsurătoarea prozodiei de către robot pentru patru mesaje de bază pe care mamele le dau copiilor lor pre-linguistic. Aici avem niște subiecți naivi lăudând robotul,

Voice: Nice robot. You're such a cute little robot. (Laughter) RB: And the robot's reacting appropriately.

Voce: Bun robot. Ești așa un robot mic și scump. (Râsete) Și robotul reacționează aproximativ.

Voice: ...very good, Kismet. (Laughter)

Voce: ...foarte bine, Kismet. (Râsete)

Voice: Look at my smile.

Voce: Uite-te la zâmbetul meu.

RB: It smiles. She imitates the smile. This happens a lot. These are naive subjects. Here we asked them to get the robot's attention and indicate when they have the robot's attention.

RB: Zâmbește. Ea imită zămbetul. Asta se întâmplă des. Aceștia sunt subiecți nativi. Aici i-am rugat să atragă atenția robotului și să indice când au captat atenția robotului.

Voice: Hey, Kismet, ah, there it is.

Voce: Hei, Kismet, a, uite-o.

RB: So she realizes she has the robot's attention. Voice: Kismet, do you like the toy? Oh.

RB: Ea realizează că a captat atenția robotului. Voce: Kismet, chiar îți place jucăria? Oh.

RB: Now, here they're asked to prohibit the robot, and this first woman really pushes the robot into an emotional corner.

RB: Acum, sunt rugați să îi interzică robotului ceva, și prima femeie chiar îl pune pe robot într-o situație emoționantă.

Voice: No. No. You're not to do that. No. (Laughter)

Voce: Nu. Nu. Nu ai voie. Nu. (Râsete)

Not appropriate. No. No. (Laughter)

Voce: Nu e frumos. Nu. Nu. (Râsete)

RB: I'm going to leave it at that.

RB: O voi lăsa aici.

We put that together. Then we put in turn taking. When we talk to someone, we talk. Then we sort of raise our eyebrows, move our eyes, give the other person the idea it's their turn to talk. And then they talk, and then we pass the baton back and forth between each other. So we put this in the robot. We got a bunch of naive subjects in, we didn't tell them anything about the robot, sat them down in front of the robot and said, talk to the robot. Now what they didn't know was, the robot wasn't understanding a word they said, and that the robot wasn't speaking English. It was just saying random English phonemes. And I want you to watch carefully, at the beginning of this, where this person, Ritchie, who happened to talk to the robot for 25 minutes -- (Laughter) -- says, "I want to show you something. I want to show you my watch." And he brings the watch center, into the robot's field of vision, points to it, gives it a motion cue, and the robot looks at the watch quite successfully. We don't know whether he understood or not that the robot -- Notice the turn-taking. Ritchie: OK, I want to show you something. OK, this is a watch that my girlfriend gave me. Robot: Oh, cool. Ritchie: Yeah, look, it's got a little blue light in it too. I almost lost it this week. (Laughter) RB: So it's making eye contact with him, following his eyes. Ritchie: Can you do the same thing? Robot: Yeah, sure. RB: And they successfully have that sort of communication.

Am pus asta laolaltă. Și după aceea l-am făcut să vorbească. Când discutăm cu cineva, vorbim. După care ne ridicăm cumva sprâncenele, ne mișcăm ochii, dăm impresia celeilalte persoane că este rândul lor să vorbească. După care ei vorbesc, și după care pasăm mingea unul la altul. Și așa am implementat asta și în robot. Avem câțiva subiecți naivi aici, nu le-am spus nimic despre robot, i-am așezat în fața robotului și le-am spus să discute cu robotul. Și ce nu au știut este că, robotul nu înțelegea un cuvânt din ce spuneau ei, și că robotul nu vorbea engleza. Doar rostea niște foneme aleatorii în engleză. Și vreau ca voi să vă uitați atenți, la început, unde această persoană, Ritchie, care a vorbit cu robotul pentru 25 de minute... (Râsete) spune, "Vreau să îți arăt ceva vreau să îți arăt ceasul meu." Și aduce ceasul în zona de vedere a robotului, arată către el, îi dă un ton de emoție, iar robotul se uită la ceas chiar cu succes. Nu știm dacă el a înteles sau nu că robotul... Observați schimbul de roluri. Ritchie: Ok, vreau să îți arăt ceva. Ok, acesta este un ceas pe care mi l-a dat prietena mea. Robot: Oh, super. Ritchie: Da, uite-te, are o lumină mică albastră înăuntru. Aproape că l-am pierdut săptămâna asta. (Râsete) RB: Deci are un contact vizual cu el, urmărindu-i ochii. Ritchie: Poți face același lucru? Robot: Da, cum să nu. RB: Și au acest mod de comunicare cu succes.

And here's another aspect of the sorts of things that Chris and I were doing. This is another robot, Cog. They first make eye contact, and then, when Christie looks over at this toy, the robot estimates her gaze direction and looks at the same thing that she's looking at. (Laughter) So we're going to see more and more of this sort of robot over the next few years in labs. But then the big questions, two big questions that people ask me are: if we make these robots more and more human-like, will we accept them, will we -- will they need rights eventually? And the other question people ask me is, will they want to take over? (Laughter) And on the first -- you know, this has been a very Hollywood theme with lots of movies. You probably recognize these characters here -- where in each of these cases, the robots want more respect. Well, do you ever need to give robots respect? They're just machines, after all. But I think, you know, we have to accept that we are just machines. After all, that's certainly what modern molecular biology says about us. You don't see a description of how, you know, Molecule A, you know, comes up and docks with this other molecule. And it's moving forward, you know, propelled by various charges, and then the soul steps in and tweaks those molecules so that they connect. It's all mechanistic. We are mechanism. If we are machines, then in principle at least, we should be able to build machines out of other stuff, which are just as alive as we are. But I think for us to admit that, we have to give up on our special-ness, in a certain way. And we've had the retreat from special-ness under the barrage of science and technology many times over the last few hundred years, at least. 500 years ago we had to give up the idea that we are the center of the universe when the earth started to go around the sun; 150 years ago, with Darwin, we had to give up the idea we were different from animals. And to imagine -- you know, it's always hard for us. Recently we've been battered with the idea that maybe we didn't even have our own creation event, here on earth, which people didn't like much. And then the human genome said, maybe we only have 35,000 genes. And that was really -- people didn't like that, we've got more genes than that. We don't like to give up our special-ness, so, you know, having the idea that robots could really have emotions, or that robots could be living creatures -- I think is going to be hard for us to accept. But we're going to come to accept it over the next 50 years or so.

Și mai există un aspect legat de genul de lucruri pe care eu și Chris le făceam. Acesta este un alt robot, Cog. Prima dată se privesc, după care, în timp ce Christie se uită la jucăria lui, robotul estimează direcția în care se uită și se uită la același lucrul la care se uită și ea. (Râsete) Deci urmează să vedem tot mai mult acest gen de robot în următorii ani în laboratoare. Dar după aceea marile întrebări, cele două mari întrebări pe care oamenii mi le pun: dacă facem acești roboți tot mai mult asemănători cu oamenii, îi vom accepta cumva, oare... nu vor avea nevoie eventual de drepturi? Iar cealaltă întrebare pe care mi-o pun oamenii este - vor vrea să fie la putere? (Râsete) Iar la prima -- știți voi, asta a fost o temă la Hollywood în multe filme. Probabil recunoașteți aceste personaje aici... unde în fiecare din aceste cazuri, roboții vor mai mult respect. Păi, a fost cazul să respectaţi roboți vreodată? Până la urmă sunt niște mașini. Dar cred că, știți voi, trebuie să acceptăm că noi suntem doar mașini. Cu toate acestea, acesta este cu siguranță lucrul pe care ni-l spune biologia moleculară despre noi. Nu poți vedea o descriere despre, știți voi, Molecula A, vine și se unește cu cealaltă moleculă. Și se mișcă înainte coordonată de diverse energii după care sufletul* vine în scenă și adaptează acele molecule pentru ca ele să se conecteze. Totul este mecanic, noi suntem un mecanism. Dacă suntem mașini, atunci măcar în principiu, ar trebui să putem construi mașini din alte lucruri, care sunt la fel de în viață cum suntem și noi. Dar cred că pentru ca noi să recunoaștem asta, trebuie să renunțăm la felul nostru special, într-un anume fel. Și ne-am complăcut în statutul nostru special sub acoperirea științei și tehnologiei de multe ori în ultimele secole, cel puțin. Acum 500 de ani a trebuit să renunțăm la ideea că suntem centrul universului atunci când soarele a început să se rotească în jurul pământului; acum 150 de ani, cu Darwin, a trebuit să renunțăm la ideea că suntem diferiți de animale. Și ca să ne imaginăm... este întotdeauna greu pentru noi. Știți voi, am fost recent copleșiți de ideea că poate nici măcar nu am fi avut momenul nostru de creație, aici pe pământ, pe care oamenii nu l-au prea plăcut. Iar atunci genomul uman a spus, poate avem doar 35.000 de gene. Iar asta a fost chiar... oamenilor chiar nu le-a plăcut, avem mai multe gene de atâta. Nu ne place să renunțăm la felul nostru de a fi speciali, deci, știți voi, ideea că roboții ar putea într-adevăr să aibă emoții, sau că roboții ar putea fi creaturi în viață... Cred că va fi greu să acceptăm asta. Dar vom ajunge să acceptăm asta în următorii 50 de ani.

And the second question is, will the machines want to take over? And here the standard scenario is that we create these things, they grow, we nurture them, they learn a lot from us, and then they start to decide that we're pretty boring, slow. They want to take over from us. And for those of you that have teenagers, you know what that's like. (Laughter) But Hollywood extends it to the robots. And the question is, you know, will someone accidentally build a robot that takes over from us? And that's sort of like this lone guy in the backyard, you know -- "I accidentally built a 747." I don't think that's going to happen. And I don't think -- (Laughter) -- I don't think we're going to deliberately build robots that we're uncomfortable with. We'll -- you know, they're not going to have a super bad robot. Before that has to come to be a mildly bad robot, and before that a not so bad robot. (Laughter) And we're just not going to let it go that way. (Laughter) So, I think I'm going to leave it at that: the robots are coming, we don't have too much to worry about, it's going to be a lot of fun, and I hope you all enjoy the journey over the next 50 years. (Applause)

Iar cea de-a doua întrebare este, vor veni la putere mașinile? Iar aici este scenariul standard cum că noi creăm lucrurile, ele cresc, noi le alimentăm, ele învață mult de la noi, după care ele încep să decidă că suntem destul de plictisitori, înceți. Vor să vină peste noi la putere. Și pentru aceia dintre voi care aveți copii tineri, știți cum e să fie așa. (Râsete) Dar Hollywood extinde ideea cu roboții. Iar întrebarea este, știți voi, va construi cumva cineva accidental un robot care va veni peste noi la putere? Iar acela este ca acest tip singuratic din curtea din spate, și, știți voi, "Am construit accidental un 747." Știți voi, eu nu știam ce se va întâmpla defapt. Și nu cred... (Râsete) ...nu cred că vom construi deliberat roboți cu care nu suntem de acord. Păi, știți voi, ei nu vor avea un robot foarte rău. Înaintea lui trebuie să existe un robot rău mediu, iar înainte de acela un robot nu chiar așa de rău. (Râsete) Și chiar nu o vom lăsa lucrurile să meargă în direcţia aia. (Râsete) Deci,cred că voi încheia aici: roboții vin, nu trebuie să ne facem prea multe griji, va fi mare distracție , și sper că și voi vă veți bucura de călătoria din următorii 50 de ani. (Aplauze)