In my lab, we build autonomous aerial robots like the one you see flying here. Unlike the commercially available drones that you can buy today, this robot doesn't have any GPS on board. So without GPS, it's hard for robots like this to determine their position. This robot uses onboard sensors, cameras and laser scanners, to scan the environment. It detects features from the environment, and it determines where it is relative to those features, using a method of triangulation. And then it can assemble all these features into a map, like you see behind me. And this map then allows the robot to understand where the obstacles are and navigate in a collision-free manner.

Laboratuvarımda otonom hava robotları geliştiriyoruz, burada uçarken gördüğünüz gibi. Bugün ticari olarak satılan mevcut dronların aksine, bu robotun üzerinde GPS (Küresel konumlandırma sistemi) yok. GPS olmadan, bunun gibi robotların yönlerini saptamaları zordur. Bu robot çevreyi taramak için yerleşik sensörler, kameralar ve lazer tarayıcılar kullanır. Çevredeki özellikleri saptamak suretiyle, nirengi metodunu kullanarak bu özelliklere göreli olarak nerede olduğunu saptar. Sonra bütün bu özellikleri bir harita olarak bir araya getirir, arkamda görmüş olduğunuz gibi. Ardından bu harita robotun engellerin nerede olduğunu anlamasını ve çarpmayacak şekilde gitmesini sağlar.

What I want to show you next is a set of experiments we did inside our laboratory, where this robot was able to go for longer distances. So here you'll see, on the top right, what the robot sees with the camera. And on the main screen -- and of course this is sped up by a factor of four -- on the main screen you'll see the map that it's building. So this is a high-resolution map of the corridor around our laboratory. And in a minute you'll see it enter our lab, which is recognizable by the clutter that you see.

Size bundan sonra göstermek istediğim şey, laboratuvarımızda yaptığımız bir dizi deney, bunlarla bu robotun daha uzun mesafeler boyunca gitmesini sağladık. Burada sağ üstte robotun kamerayla ne gördüğüne bakabilirsiniz. Ana ekranda ise -- ve elbette bu dört katına hızlandırılmış hâli -- ana ekranda oluşturduğu haritayı göreceksiniz. Bu laboratuvarımızın çevresindeki koridorun yüksek çözünürlüklü haritası. Bir dakika içinde laboratuvarımıza girdiğini göreceksiniz, ki göreceğiniz karışıklıktan bu anlaşılıyor.

(Laughter)

(Gülüşmeler)

But the main point I want to convey to you is that these robots are capable of building high-resolution maps at five centimeters resolution, allowing somebody who is outside the lab, or outside the building to deploy these without actually going inside, and trying to infer what happens inside the building.

Ancak size aktarmak istediğim ana nokta şu ki, bu robotlar beş santimetre çözünürlükle yüksek çözünürlüklü haritalar yapma yeteneğine sahipler, bu durum da laboratuvar dışındaki veya bina dışındaki birinin aslında içeri girmeden ve binanın içinde olanları anlamaya çalışmadan bunları görevlendirmesini sağlıyor.

Now there's one problem with robots like this. The first problem is it's pretty big. Because it's big, it's heavy. And these robots consume about 100 watts per pound. And this makes for a very short mission life. The second problem is that these robots have onboard sensors that end up being very expensive -- a laser scanner, a camera and the processors. That drives up the cost of this robot.

Ancak bunun gibi robotlarla ilgili bir sorun var. İlk sorun, oldukça büyükler. Büyük oldukları için ağırlar. Bu robotlar libre (453,6 gr) başına 100 vat harcıyorlar. Bu da çok kısa bir uçuş süresi anlamına geliyor. İkinci sorun, bu robotların üzerinde çok pahalıya mal olan sensörler var -- bir lazer tarayıcı, bir kamera ve işlemciler. Bunlar da bu robotun fiyatını yükseltiyor.

So we asked ourselves a question: what consumer product can you buy in an electronics store that is inexpensive, that's lightweight, that has sensing onboard and computation? And we invented the flying phone.

O yüzden kendimize bir soru sorduk: Bir elektronik mağazasından ucuz, hafif olup üzerinde algılayıcı ve ölçümleyici olan hangi tüketici ürününü alabilirsiniz? Biz de uçan telefonu icat ettk.

(Laughter)

(Gülüşmeler)

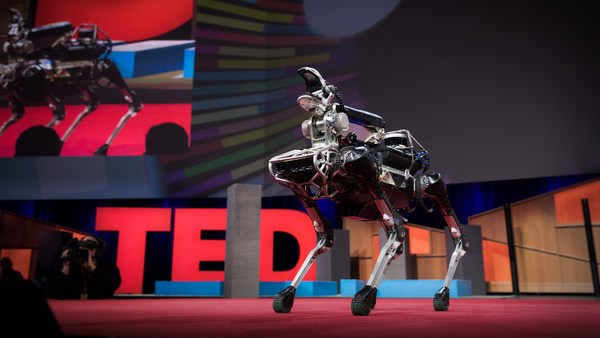

So this robot uses a Samsung Galaxy smartphone that you can buy off the shelf, and all you need is an app that you can download from our app store. And you can see this robot reading the letters, "TED" in this case, looking at the corners of the "T" and the "E" and then triangulating off of that, flying autonomously. That joystick is just there to make sure if the robot goes crazy, Giuseppe can kill it.

Bu robot, mağazadan alabileceğiniz Samsung Galaxy akıllı telefonu kullanıyor ve tek ihtiyacınız olan şey uygulama mağazamızdan indirilebilen bir uygulama. Bu robotun bu durumda "TED" harflerini okuduğunu görüyorsunuz, "T" ve "E"nin köşelerine bakıp ondan üçgenleme yaparak otonom olarak uçuyor. Kumanda kolu orada, çünkü robot çılgın şeyler yaparsa, Giuseppe işini bitirebilir.

(Laughter)

(Gülüşmeler)

In addition to building these small robots, we also experiment with aggressive behaviors, like you see here. So this robot is now traveling at two to three meters per second, pitching and rolling aggressively as it changes direction. The main point is we can have smaller robots that can go faster and then travel in these very unstructured environments.

Bu küçük robotları geliştirme yanında, burada gördüğünüz gibi agresif davranışlarla ilgili de deneyler yaptık. İşte bu robot saniyede iki ila üç metre hızla seyahat ediyor, yön değiştirdikçe agresifçe savrulup dönüyor. Ana nokta, daha hızlı giden ve bu yapılandırılmamış çevrelerde yol alan daha küçük robotlarımızın olabileceği.

And in this next video, just like you see this bird, an eagle, gracefully coordinating its wings, its eyes and feet to grab prey out of the water, our robot can go fishing, too.

Bir sonraki videoda gördüğünüz gibi, aynı bu kuşun, kartalın zerafetle sudan avını kapmak için kanatlarını, gözlerini ve ayaklarını koordine etmesi gibi, robotumuz da balığa gidebilir.

(Laughter)

(Gülüşmeler)

In this case, this is a Philly cheesesteak hoagie that it's grabbing out of thin air.

Burada birdenbire bir bonfile sandviçi kapıyor.

(Laughter)

(Gülüşmeler)

So you can see this robot going at about three meters per second, which is faster than walking speed, coordinating its arms, its claws and its flight with split-second timing to achieve this maneuver. In another experiment, I want to show you how the robot adapts its flight to control its suspended payload, whose length is actually larger than the width of the window. So in order to accomplish this, it actually has to pitch and adjust the altitude and swing the payload through. But of course we want to make these even smaller, and we're inspired in particular by honeybees. So if you look at honeybees, and this is a slowed down video, they're so small, the inertia is so lightweight --

Bu robotun saniyede yaklaşık üç metre hızla gittiğini görüyorsunuz, ki bu yürüyüş hızından fazla; kollarını, pençelerini ve uçuşunu yarım saniye zamanlamayla bu manevraya ulaşmak için koordine ediyor. Başka bir deneyde, uzunluğu esasen bu pencerenin genişliğinden büyük olan askıdaki yükünü kontrol etmek için uçuşunu nasıl ayarladığını size göstermek istiyorum. Bunu başarmak için aslında irtifayı düşürüp ayarlaması ve yükü içeriye doğru sallaması gerekiyor. Ama elbette ki bunları daha da küçük yapmak istiyoruz ve özellikle bal arılarından esinlendik. Eğer bal arılarına bakarsanız ve bu yavaşlatılmış bir video, çok küçükler, ataleti öylesine önemsiz ki --

(Laughter)

(Gülüşmeler)

that they don't care -- they bounce off my hand, for example. This is a little robot that mimics the honeybee behavior. And smaller is better, because along with the small size you get lower inertia. Along with lower inertia --

umursamıyorlar -- elimden sekiyorlar, örnek olarak. Bu bal arısı davranışını taklit eden küçük bir robot. Küçüldükçe daha iyi, çünkü boyutunun küçüklüğüyle beraber daha az atalet elde ediyorsunuz. Düşük ataletle --

(Robot buzzing, laughter)

(Robot vızıldıyor, gülüşmeler)

along with lower inertia, you're resistant to collisions. And that makes you more robust. So just like these honeybees, we build small robots. And this particular one is only 25 grams in weight. It consumes only six watts of power. And it can travel up to six meters per second. So if I normalize that to its size, it's like a Boeing 787 traveling ten times the speed of sound.

düşük ataletle, çarpışmalara dirençlisiniz. Bu da sizi daha güçlü yapıyor. Yani aynı bal arıları gibi küçük robotlar yapıyoruz. Bu ise sadece 25 gram ağırlığında. Yalnızca altı vat güç harcıyor. Saniyede altı metreye kadar yol alabiliyor. Eğer büyüklüğüne göre normalize edersem, bu Boeing 787'nin ses hızının on katında yol alması gibi.

(Laughter)

(Gülüşmeler)

And I want to show you an example. This is probably the first planned mid-air collision, at one-twentieth normal speed. These are going at a relative speed of two meters per second, and this illustrates the basic principle. The two-gram carbon fiber cage around it prevents the propellers from entangling, but essentially the collision is absorbed and the robot responds to the collisions. And so small also means safe. In my lab, as we developed these robots, we start off with these big robots and then now we're down to these small robots. And if you plot a histogram of the number of Band-Aids we've ordered in the past, that sort of tailed off now. Because these robots are really safe.

Size bir örnek göstermek istiyorum. Bu muhtemelen ilk planlanan havada çarpışma, normal hızın yirmide biri. Bunlar saniyede iki metre relatif hızla gidiyor ve bu temel prensibi gösteriyor. Etrafındaki iki gramlık karbon fiber kafes pervanelerin dolaşmasını engelliyor; ancak aslında çarpışma absorbe ediliyor ve robot çarpışmaya cevap veriyor. Bu kadar küçük olması güvenli olması anlamına da geliyor. Laboratuvarımda bu robotları geliştirirken, büyük robotlarla başlıyoruz ve sonra bu küçük robotlara kadar geliyoruz. Geçmişte sipariş ettiğimiz bantların sayısına dair bir histogram çizerseniz, artık biraz azaldı. Çünkü bu robotlar gerçekten güvenli.

The small size has some disadvantages, and nature has found a number of ways to compensate for these disadvantages. The basic idea is they aggregate to form large groups, or swarms. So, similarly, in our lab, we try to create artificial robot swarms. And this is quite challenging because now you have to think about networks of robots. And within each robot, you have to think about the interplay of sensing, communication, computation -- and this network then becomes quite difficult to control and manage. So from nature we take away three organizing principles that essentially allow us to develop our algorithms. The first idea is that robots need to be aware of their neighbors. They need to be able to sense and communicate with their neighbors.

Küçük boyutun bazı dezavantajları var ve bu dezavantajları telafi etmek için doğa bir sürü yol bulmuş. Ana fikir, büyük grupları veya sürüleri oluşturmak için bir araya gelmeleri. Benzer şekilde biz de laboratuvarımızda yapay robot sürüleri yaratmaya çalışıyoruz. Bu oldukça zor, çünkü artık robot ağlarını düşünmek zorundasınız. Her robot için de algılama, iletişim, hesaplama etkileşimini düşünmek zorundasınız -- sonrasında bu ağı kontrol etmek ve yönetmek oldukça zor hâle geliyor. Bundan dolayı, doğadan aslında algoritmalarımızı geliştirmemizi sağlayacak üç düzenleyici prensip alıyoruz. İlk fikir, robotların komşularının farkında olmak zorunda olması. Komşularını algılamak ve iletişim kurmak durumundalar.

So this video illustrates the basic idea. You have four robots -- one of the robots has actually been hijacked by a human operator, literally. But because the robots interact with each other, they sense their neighbors, they essentially follow. And here there's a single person able to lead this network of followers. So again, it's not because all the robots know where they're supposed to go. It's because they're just reacting to the positions of their neighbors.

Bu video, temel fikri açıklıyor. Dört robotunuz var -- robotlardan biri insan operatör tarafından tam anlamıyla gasp edilmiş durumda. Ancak robotlar birbirleriyle etkileştiği için, yanındakileri algılayarak esasen takip ediyorlar. İşte burada takipçi ağını yönlendiren tek bir kişi var. Aslında bunun nedeni robotların nereye gideceklerini bilmeleri değil, yanındakilere tepki vermelerinden dolayı böyle oluyor.

(Laughter)

(Gülüşmeler)

So the next experiment illustrates the second organizing principle. And this principle has to do with the principle of anonymity. Here the key idea is that the robots are agnostic to the identities of their neighbors. They're asked to form a circular shape, and no matter how many robots you introduce into the formation, or how many robots you pull out, each robot is simply reacting to its neighbor. It's aware of the fact that it needs to form the circular shape, but collaborating with its neighbors it forms the shape without central coordination. Now if you put these ideas together, the third idea is that we essentially give these robots mathematical descriptions of the shape they need to execute. And these shapes can be varying as a function of time, and you'll see these robots start from a circular formation, change into a rectangular formation, stretch into a straight line, back into an ellipse. And they do this with the same kind of split-second coordination that you see in natural swarms, in nature.

Bir sonraki deney, ikinci düzenleyici prensibi göstermektedir. Bu prensip anonimlik prensibiyle ilgili. Burada ana fikir, robotların yakınındakilerin kimliklerini bilmemesi. Dairesel bir şekil oluşturmaları istendi ve grubun içine kaç tane robot katarsanız katın ya da kaç robot çıkarırsanız çıkarın, her robot sadece yanındakine tepki veriyor. Dairesel bir şekil oluşturması gerektiğinin farkında; ancak yanındakilerle işbirliği yaparak merkezî bir eşgüdüm olmadan şekli oluşturuyor. Bu fikirleri bir araya koyunca üçüncü fikir, robotlara esasen oluşturmaları gereken şeklin matematiksel tanımlarını vermek. Bu şekiller zamanın fonksiyonu olarak çeşitlilik gösterebilir ve bu robotların dairesel bir biçimle başladığını, dikdörtgen biçime dönüştüğünü, düz bir çizgi olarak uzadığını, tekrar elips hâline geldiğini göreceksiniz. Bunu doğal sürülerde, doğada gördüğünüz türden yarım saniyelik eşgüdümle yapıyorlar.

So why work with swarms? Let me tell you about two applications that we are very interested in. The first one has to do with agriculture, which is probably the biggest problem that we're facing worldwide. As you well know, one in every seven persons in this earth is malnourished. Most of the land that we can cultivate has already been cultivated. And the efficiency of most systems in the world is improving, but our production system efficiency is actually declining. And that's mostly because of water shortage, crop diseases, climate change and a couple of other things.

Peki neden sürülerle çalışılıyor? Size çok ilgimizi çeken iki uygulamadan bahsedeyim. İlki tarımla ilgili, ki bu muhtemelen dünyada karşılaştığımız en önemli sorun. Bildiğiniz gibi, dünyada her yedi kişiden biri yetersiz besleniyor. Ekilebilecek toprakların çoğu zaten ekili. Dünyadaki sistemlerin çoğunun verimi artıyor, ancak üretim sistemlerinin verimi aslında giderek düşüyor. Bunun en büyük nedenleri, su kıtlığı, ekinlerdeki hastalıklar, iklim değişimi ve başka birkaç şey daha.

So what can robots do? Well, we adopt an approach that's called Precision Farming in the community. And the basic idea is that we fly aerial robots through orchards, and then we build precision models of individual plants. So just like personalized medicine, while you might imagine wanting to treat every patient individually, what we'd like to do is build models of individual plants and then tell the farmer what kind of inputs every plant needs -- the inputs in this case being water, fertilizer and pesticide. Here you'll see robots traveling through an apple orchard, and in a minute you'll see two of its companions doing the same thing on the left side. And what they're doing is essentially building a map of the orchard. Within the map is a map of every plant in this orchard.

O zaman robotlar ne yapabilirler? Toplumda Hassas Tarım olarak adlandırılan bir yaklaşımı benimsiyoruz. Ana fikir şu; hava robotlarını bahçelerde uçurup sonra bitkilerin tek tek hassas modellerini geliştiriyoruz. Her hastaya özel tedavi uygulanmasının istendiği, kişiselleştirilen ilaçlarla olduğu gibi, bizim yapmak istediğimiz şey de tek tek bitkilerin modellerini geliştirmek ve sonra çiftçiye her bitkinin ne tür bir girdiye ihtiyacı olduğunu söylemek -- bu durumda girdiler, su, gübre ve tarım ilaçlarıdır. Burada elma bahçesinde dolaşan robotları görüyorsunuz ve bir dakika içinde sol tarafta aynı şeyi yapan iki üyeyi daha göreceksiniz. Aslında yaptıkları şey bahçenin bir haritasını çizmek. Harita içinde, bu bahçedeki her bitkinin bir haritası var.

(Robot buzzing)

(Robot vızıldıyor)

Let's see what those maps look like. In the next video, you'll see the cameras that are being used on this robot. On the top-left is essentially a standard color camera. On the left-center is an infrared camera. And on the bottom-left is a thermal camera. And on the main panel, you're seeing a three-dimensional reconstruction of every tree in the orchard as the sensors fly right past the trees. Armed with information like this, we can do several things. The first and possibly the most important thing we can do is very simple: count the number of fruits on every tree. By doing this, you tell the farmer how many fruits she has in every tree and allow her to estimate the yield in the orchard, optimizing the production chain downstream.

Bu haritaların neye benzediğini görelim. Bir sonraki videoda, bu robotta kullanılan kameraları göreceksiniz. Sol üstte esasen standart renkli bir kamera var. Solda ortada kızılötesi bir kamera var. Sol altta ise termal bir kamera var. Ana panelde, sensörler ağaçların yanından geçtikçe bahçedeki her ağacın yeniden üç boyutlu olarak oluşturulmasını görüyorsunuz. Böyle bir bilgiyle donanınca birçok şey yapabiliriz. Yapabileceğimiz ilk ve muhtemelen en önemli şey çok basit: Her ağaçtaki meyve adetini saymak. Böyle yaparak çiftçiye her ağaçtaki meyve sayısını söylersiniz ve bahçedeki hâsılatı tahmin etmesini sağlarsınız, bununla üretim zinciri boyunca optimizasyon sağlarsınız.

The second thing we can do is take models of plants, construct three-dimensional reconstructions, and from that estimate the canopy size, and then correlate the canopy size to the amount of leaf area on every plant. And this is called the leaf area index. So if you know this leaf area index, you essentially have a measure of how much photosynthesis is possible in every plant, which again tells you how healthy each plant is. By combining visual and infrared information, we can also compute indices such as NDVI. And in this particular case, you can essentially see there are some crops that are not doing as well as other crops. This is easily discernible from imagery, not just visual imagery but combining both visual imagery and infrared imagery.

Yapabileceğimiz ikinci şey, bitkilerin modellerini almak, üç boyutlu olarak yeniden oluşturmak ve böylece bitki örtüsünün büyüklüğünü tahmin etmek, sonra örtünün büyüklüğünü her bitkideki yaprak alanın miktarı ile ilintilemek. Buna yaprak alan indeksi denir. Eğer yaprak alanı indeksini biliyorsanız, aslında her bitkide ne kadar fotosentez mümkün olduğuna dair ölçünüz olur, bu da size her bitkinin ne kadar sağlıklı olduğunu söyler. Görsel ve kızılötesi bilgiyi birleştirerek, NDVI (normalize edilmiş fark bitki örtüsü indeksi) gibi indisleri de hesaplayabiliriz. Buradaki durumda, aslında bazı ürünlerin diğer ürünler kadar iyi durumda olmadığını görüyorsunuz. Bu durum, görüntüde rahatlıkla ayırt edilebiliyor; sadece görsel imgeyle değil, görsel imgeyi, kızılötesi imgeyle birleştirerek.

And then lastly, one thing we're interested in doing is detecting the early onset of chlorosis -- and this is an orange tree -- which is essentially seen by yellowing of leaves. But robots flying overhead can easily spot this autonomously and then report to the farmer that he or she has a problem in this section of the orchard.

Son olarak, yapmak istediğimiz bir şey de kloroz başlangıcını erkenden tespit etmek -- ve bu bir portakal ağacı -- bu aslında yaprakların sararmasından anlaşılabilir. Ancak tepede uçan robotlar bunu kolaylıkla kendileri fark edebilir ve sonra çiftçiye bahçenin bu kısmında bir sorun olduğunu raporlayabilirler.

Systems like this can really help, and we're projecting yields that can improve by about ten percent and, more importantly, decrease the amount of inputs such as water by 25 percent by using aerial robot swarms.

Bunun gibi sistemler gerçekten yardımcı olabilir ve hava robotu sürüleri kullanarak hâsılatın yaklaşık yüzde 10 artabileceğini ve daha da önemlisi su gibi girdilerin miktarının yüzde 25 oranında azalabileceğini öngörüyoruz.

Lastly, I want you to applaud the people who actually create the future, Yash Mulgaonkar, Sikang Liu and Giuseppe Loianno, who are responsible for the three demonstrations that you saw.

Son olarak, aslında geleceği yaratan insanları alkışlamanızı istiyorum, Yash Mulgaonkar, Sikang Liu ve Giuseppe Loianno, kendileri gördüğünüz üç demodan sorumlular.

Thank you.

Teşekkürler.

(Applause)

(Alkış)