In my lab, we build autonomous aerial robots like the one you see flying here. Unlike the commercially available drones that you can buy today, this robot doesn't have any GPS on board. So without GPS, it's hard for robots like this to determine their position. This robot uses onboard sensors, cameras and laser scanners, to scan the environment. It detects features from the environment, and it determines where it is relative to those features, using a method of triangulation. And then it can assemble all these features into a map, like you see behind me. And this map then allows the robot to understand where the obstacles are and navigate in a collision-free manner.

제 연구실은 여기 날아다니는 것처럼 자동 비행 로봇을 만듭니다. 오늘날 구매할 수 있는 상업용 드론과는 달리 이 로봇은 GPS를 탑재하고 있지 않습니다. GPS없이는 이런 로봇이 자신의 위치를 파악하기 힘듭니다. 이 로봇은 자체 센서와 카메라, 레이저 스캐너를 가지고 주변 환경을 탐색합니다. 환경의 특이사항들을 탐지하고 그 사항들이 관련있는 곳에서 삼각측량법을 이용해서 결정합니다. 그러고 나서 이 특징들을 뒤에 보시는 것 같은 지도로 조합할 수 있습니다. 이 지도는 로봇이 장애물의 위치를 알아서 충돌없이 날아다닐 수 있게 합니다.

What I want to show you next is a set of experiments we did inside our laboratory, where this robot was able to go for longer distances. So here you'll see, on the top right, what the robot sees with the camera. And on the main screen -- and of course this is sped up by a factor of four -- on the main screen you'll see the map that it's building. So this is a high-resolution map of the corridor around our laboratory. And in a minute you'll see it enter our lab, which is recognizable by the clutter that you see.

다음에 보여 드리고 싶은 것은 연구실에서 진행했던 몇 가지 실험인데 이 로봇이 장거리 비행을 할 수 있는 겁니다. 보시면 오른쪽 맨 위에 로봇이 카메라로 보는 것입니다. 주 화면에는 이건 4배속으로 돌린 겁니다. 주 화면에 지도를 만드는 것이 보입니다. 이것은 저희 연구실 복도의 고화질 지도입니다. 이것이 곧 연구실로 들어오는게 보일 겁니다. 어지럽게 널린 물건들을 보고 알 수 있으시죠.

(Laughter)

(웃음)

But the main point I want to convey to you is that these robots are capable of building high-resolution maps at five centimeters resolution, allowing somebody who is outside the lab, or outside the building to deploy these without actually going inside, and trying to infer what happens inside the building.

여러분께 알려드릴 중요한 점은 이 로봇들이 5cm 해상도의 고화질 지도를 만들어서 연구실이나 건물 밖에 있는 사람이 안에 들어가지도 않고 로봇을 보내고 건물 안에서 벌어지는 일을 알아내게 해 줍니다.

Now there's one problem with robots like this. The first problem is it's pretty big. Because it's big, it's heavy. And these robots consume about 100 watts per pound. And this makes for a very short mission life. The second problem is that these robots have onboard sensors that end up being very expensive -- a laser scanner, a camera and the processors. That drives up the cost of this robot.

이런 로봇에 한 가지 문제가 있습니다. 첫 번째 문제는 이것이 매우 큽니다. 크다보니 무겁습니다. 이 로봇들은 1파운드 당 100와트를 소모합니다. 그래서 임무수행 시간이 매우 짧습니다. 두 번째 문제는 이 로봇들이 매우 비싼 데 내장 센서, 레이저 스캐너, 카메라와 처리장치가 있습니다. 그것 때문에 이 로봇가격이 치솟습니다.

So we asked ourselves a question: what consumer product can you buy in an electronics store that is inexpensive, that's lightweight, that has sensing onboard and computation? And we invented the flying phone.

그래서 이런 질문을 해 봤습니다. 전자제품 매장의 어떤 소비재가 저렴하고, 가벼우며 내장 센서와 처리장치가 있을까요? 그래서 저희가 날아다니는 전화를 발명했습니다.

(Laughter)

(웃음)

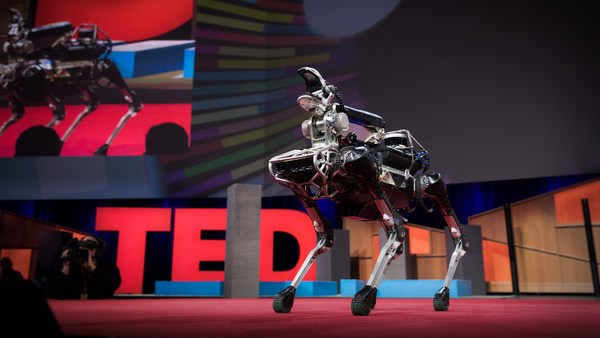

So this robot uses a Samsung Galaxy smartphone that you can buy off the shelf, and all you need is an app that you can download from our app store. And you can see this robot reading the letters, "TED" in this case, looking at the corners of the "T" and the "E" and then triangulating off of that, flying autonomously. That joystick is just there to make sure if the robot goes crazy, Giuseppe can kill it.

이 로봇은 매장에서 구입할 수 있는 삼성 갤럭시 스마트폰을 썼고 앱스토어에서 앱을 다운로드 하기만 하면 됩니다. 로봇이 글자도 인식합니다. 여기서는 "TED"를 읽죠. T와 E의 가장자리를 보며 자동비행을 하며 삼각측량을 합니다. 조이스틱이 로봇이 마구 움직이지 않게 조정합니다. 쥬세페가 로봇을 끌 수 있죠.

(Laughter)

(웃음)

In addition to building these small robots, we also experiment with aggressive behaviors, like you see here. So this robot is now traveling at two to three meters per second, pitching and rolling aggressively as it changes direction. The main point is we can have smaller robots that can go faster and then travel in these very unstructured environments.

이러한 작은 로봇을 제작함과 더불어 여기서 보시는 이런 역동적인 행동도 실험합니다. 이 로봇은 초당 2-3m로 움직이며 방향을 바꿀 때 공격적으로 올라가거나 돕니다. 요점은 더 빨리 갈 수 있고 비구조화된 환경에서 움직일 수 있는 더 작은 로봇을 가질 수 있다는 겁니다.

And in this next video, just like you see this bird, an eagle, gracefully coordinating its wings, its eyes and feet to grab prey out of the water, our robot can go fishing, too.

다음 영상에서는 새나 독수리가 우아하게 날개와 눈, 다리를 조정해서 물 밖으로 먹이를 잡아 채는 걸 보시듯이 우리 로봇도 낚시를 할 수 있습니다.

(Laughter)

(웃음)

In this case, this is a Philly cheesesteak hoagie that it's grabbing out of thin air.

이 경우에는 갑자기 필리 치즈스테이크를 낚아 챕니다.

(Laughter)

(웃음)

So you can see this robot going at about three meters per second, which is faster than walking speed, coordinating its arms, its claws and its flight with split-second timing to achieve this maneuver. In another experiment, I want to show you how the robot adapts its flight to control its suspended payload, whose length is actually larger than the width of the window. So in order to accomplish this, it actually has to pitch and adjust the altitude and swing the payload through. But of course we want to make these even smaller, and we're inspired in particular by honeybees. So if you look at honeybees, and this is a slowed down video, they're so small, the inertia is so lightweight --

이 로봇이 초당 3m로 움직이는 걸 보시는데 걷는 속도보다 빠르며 팔, 발톱과 비행을 눈 깜짝할 사이에 조정해서 이렇게 하는 겁니다. 다른 실험에서는 로봇이 비행을 어떻게 조절하여 부유 하중을 통제하는 지 보여드리겠습니다. 창 넓이보다 실제로 더 큰 길이입니다. 이렇게 하기 위해서 고도를 높이고 조절하여 적재 하중을 흔들어 통과합니다. 물론 이것을 더욱 작게 하고 싶어서 특히 꿀벌에서 영감을 받았습니다. 이것은 느린 영상인데, 꿀벌을 보시면 아주 작은데 관성이 매우 가벼워서

(Laughter)

(웃음)

that they don't care -- they bounce off my hand, for example. This is a little robot that mimics the honeybee behavior. And smaller is better, because along with the small size you get lower inertia. Along with lower inertia --

가령 제 손에 튕겨도 신경도 안 씁니다. 이것은 꿀벌의 행동을 흉내내는 소형 로봇입니다. 작을수록 더 좋은 것이 이렇게 소규모로 하면 관성이 더 낮아집니다. 관성이 낮아지면 --

(Robot buzzing, laughter)

(윙윙거리는 로봇) (웃음)

along with lower inertia, you're resistant to collisions. And that makes you more robust. So just like these honeybees, we build small robots. And this particular one is only 25 grams in weight. It consumes only six watts of power. And it can travel up to six meters per second. So if I normalize that to its size, it's like a Boeing 787 traveling ten times the speed of sound.

관성이 낮아지면, 충돌에 저항력이 있습니다. 그것이 더욱 튼튼하게 해 줍니다. 저희는 꿀벌같은 소형 로봇을 만듭니다. 특히 이것은 25g밖에 안 됩니다. 전력도 6와트만 소모하지요. 초당 6m까지 움직일 수 있습니다. 제가 이것을 이 크기에 표준화시키면 보잉787이 음속의 10배로 나는 것과 같습니다.

(Laughter)

(웃음)

And I want to show you an example. This is probably the first planned mid-air collision, at one-twentieth normal speed. These are going at a relative speed of two meters per second, and this illustrates the basic principle. The two-gram carbon fiber cage around it prevents the propellers from entangling, but essentially the collision is absorbed and the robot responds to the collisions. And so small also means safe. In my lab, as we developed these robots, we start off with these big robots and then now we're down to these small robots. And if you plot a histogram of the number of Band-Aids we've ordered in the past, that sort of tailed off now. Because these robots are really safe.

제가 예시를 보여드리겠습니다. 이것이 최초의 계획된 공중 충돌일텐데요, 1/20 표준속입니다. 초당 2m의 상대속으로 갑니다. 이것이 기본 원리를 잘 설명해 줍니다. 2g짜리 탄소섬유로 두르면 프로펠러가 엉키는 걸 방지하지만 기본적으로 충돌이 흡수되고 로봇이 충돌에 반응합니다. 매우 작다는 건 또한 안전하다는 뜻입니다. 제 연구실에서 이 로봇을 개발했을 때 이런 대형 로봇도 시작했고 지금은 이런 소형 로봇에 매진합니다. 저희가 과거에 주문한 반창고 수를 그래프로 그리면 지금은 그래프가 차차 감소했을 겁니다. 이 로봇이 매우 안전하기 때문입니다.

The small size has some disadvantages, and nature has found a number of ways to compensate for these disadvantages. The basic idea is they aggregate to form large groups, or swarms. So, similarly, in our lab, we try to create artificial robot swarms. And this is quite challenging because now you have to think about networks of robots. And within each robot, you have to think about the interplay of sensing, communication, computation -- and this network then becomes quite difficult to control and manage. So from nature we take away three organizing principles that essentially allow us to develop our algorithms. The first idea is that robots need to be aware of their neighbors. They need to be able to sense and communicate with their neighbors.

소형 크기는 단점이 있습니다. 자연은 이런 단점들을 여러가지 방법으로 보상할 방법을 찾았죠. 기본적인 원리는 큰 집단, 또는 떼를 짓는 겁니다. 연구실에서 비슷하게 인공적인 로봇 떼를 만들어 봤습니다. 이건 매우 힘들었는데 로봇의 연결망을 생각해야 했기 때문입니다. 각각의 로봇 안에서 감지, 의사소통, 신호처리의 상호작용을 생각해야 하는데 이 연결망은 통제 관리가 매우 어렵게 됩니다. 그래서 자연에서 필수적으로 알고리즘을 짜게 한 세 가지 조직 원리를 뽑았습니다. 첫 번째 원리는 로봇이 근접한 로봇을 인지해야 하는 겁니다. 다른 로봇들을 인식하고 소통할 수 있어야 합니다.

So this video illustrates the basic idea. You have four robots -- one of the robots has actually been hijacked by a human operator, literally. But because the robots interact with each other, they sense their neighbors, they essentially follow. And here there's a single person able to lead this network of followers. So again, it's not because all the robots know where they're supposed to go. It's because they're just reacting to the positions of their neighbors.

이 영상은 그 기본 원리를 보여줍니다. 로봇이 네 대가 있습니다. 한 로봇이 인간 조종사에게 그야 말로 납치되었습니다. 그러나 로봇이 서로 상호작용하기 때문에 다른 로봇을 감지하고 기본적으로 따라갑니다. 여기 한 명이 이 추종로봇의 연결망을 주도합니다. 다시 말하면 모든 로봇이 어디로 갈지 알기 때문이 아니라 근접 로봇들의 위치에 그저 반응하기 때문인 겁니다.

(Laughter)

(웃음)

So the next experiment illustrates the second organizing principle. And this principle has to do with the principle of anonymity. Here the key idea is that the robots are agnostic to the identities of their neighbors. They're asked to form a circular shape, and no matter how many robots you introduce into the formation, or how many robots you pull out, each robot is simply reacting to its neighbor. It's aware of the fact that it needs to form the circular shape, but collaborating with its neighbors it forms the shape without central coordination. Now if you put these ideas together, the third idea is that we essentially give these robots mathematical descriptions of the shape they need to execute. And these shapes can be varying as a function of time, and you'll see these robots start from a circular formation, change into a rectangular formation, stretch into a straight line, back into an ellipse. And they do this with the same kind of split-second coordination that you see in natural swarms, in nature.

다음 실험은 두 번째 조직 원리를 보여줍니다. 이 원리는 익명의 원리와 관계가 있습니다. 중심 생각은 로봇들이 다른 로봇의 정체를 모른다는 것이죠. 이들이 원형을 만들도록 명령 받으면 이 과정에 몇 개의 로봇을 투입하거나 몇 개를 빼든지 각 로봇은 단지 다른 로봇에 반응합니다. 원형을 만들어야 하는 사실을 인지하지만 다른 로봇과 협력하여 중앙 통제가 없이 모양을 형성합니다. 이 생각들을 한데 모으면 세 번째 생각이 기본적으로 저희는 이 로봇들에게 실행해야 할 모양의 수학적 설명을 주는 겁니다. 이런 모양은 시간의 함수에 따라 다를 수 있는데 이 로봇들이 원형으로 움직이기 시작하고 직사각형 모양으로 바뀌고 직선으로 쭉 뻗어 타원형으로 다시 돌아가는 게 보이실 겁니다. 로봇들이 순간적인 조정으로 하는 것인데 자연에서 보는 벌떼와 같은 것이죠.

So why work with swarms? Let me tell you about two applications that we are very interested in. The first one has to do with agriculture, which is probably the biggest problem that we're facing worldwide. As you well know, one in every seven persons in this earth is malnourished. Most of the land that we can cultivate has already been cultivated. And the efficiency of most systems in the world is improving, but our production system efficiency is actually declining. And that's mostly because of water shortage, crop diseases, climate change and a couple of other things.

왜 떼로 작업하느냐고요? 저희가 매우 흥미를 갖고 있는 두 가지 응용방법을 말씀드리겠습니다. 첫 번째는 농업과 관련되어 있는데 전 세계적으로 우리가 당면한 최대의 문제일 겁니다. 여러분이 잘 아시듯이 지구상에 7명 중 한 명이 영양실조입니다. 경작할 수 있는 땅은 다 농사짓고 있습니다. 세계의 대부분 시스템의 효율성이 향상되고 있지만 생산 시스템의 효율성은 실제로 감소하고 있습니다. 대부분 물 부족, 작물 병, 기후 변화와 다른 몇 가지들 때문입니다.

So what can robots do? Well, we adopt an approach that's called Precision Farming in the community. And the basic idea is that we fly aerial robots through orchards, and then we build precision models of individual plants. So just like personalized medicine, while you might imagine wanting to treat every patient individually, what we'd like to do is build models of individual plants and then tell the farmer what kind of inputs every plant needs -- the inputs in this case being water, fertilizer and pesticide. Here you'll see robots traveling through an apple orchard, and in a minute you'll see two of its companions doing the same thing on the left side. And what they're doing is essentially building a map of the orchard. Within the map is a map of every plant in this orchard.

로봇이 무엇을 할 수 있을까요? 농업계에는 정밀 농법이라고 하는 방법을 채택합니다. 기본 원리는 과수원에 로봇을 비행시켜서 각 작물의 정밀한 모형을 구축하는 겁니다. 마치 개인별 맞춤 의학처럼 개별 환자들을 모두 다르게 치료하는 것을 상상하시는 것 처럼 저희가 하고 싶은 것이 개별 작물의 모형을 만들어서 농부에게 각 작물이 필요한 사항을 알려주는 겁니다. 이 경우에는 물, 비료, 농약을 주는 것이죠. 여기 보시면 사과 농장을 비행하는 로봇이 보이는데 잠시 후에 두 대의 동료 로봇이 왼쪽에서 같은 일을 하고 있는게 보일 겁니다. 이 로봇이 하는 일은 기본적으로 과수원의 지도를 제작하는 겁니다. 지도 안에는 과수원의 모든 작불이 들어 갑니다.

(Robot buzzing)

(윙윙거리는 로봇)

Let's see what those maps look like. In the next video, you'll see the cameras that are being used on this robot. On the top-left is essentially a standard color camera. On the left-center is an infrared camera. And on the bottom-left is a thermal camera. And on the main panel, you're seeing a three-dimensional reconstruction of every tree in the orchard as the sensors fly right past the trees. Armed with information like this, we can do several things. The first and possibly the most important thing we can do is very simple: count the number of fruits on every tree. By doing this, you tell the farmer how many fruits she has in every tree and allow her to estimate the yield in the orchard, optimizing the production chain downstream.

그 지도가 어떻게 생겼는지 보겠습니다. 다음 영상에서 이 로봇에 쓰이는 카메라가 보입니다. 맨 위 왼쪽에 뛰어난 컬러 카메라가 있습니다. 왼쪽 중앙에는 적외선 카메라가 있습니다. 아래 왼쪽에는 온도감지 카메라가 있죠. 주 패널에는 3차원으로 과수원의 모든 나무가 재구성된 것을 보고 계십니다. 센서가 나무 사이를 비행하면서 생긴 것이죠. 이런 정보를 갖추고 있으면 몇 가지를 할 수 있습니다. 가장 중요한 첫 번째는 매우 단순합니다. 모든 나무의 열매를 세는 겁니다. 이렇게 하면 농부에게 모든 나무의 열매 수를 알려주고 과수원의 수확량을 추정하게 해 줘서 생산과정을 최적화 하게 해 줍니다.

The second thing we can do is take models of plants, construct three-dimensional reconstructions, and from that estimate the canopy size, and then correlate the canopy size to the amount of leaf area on every plant. And this is called the leaf area index. So if you know this leaf area index, you essentially have a measure of how much photosynthesis is possible in every plant, which again tells you how healthy each plant is. By combining visual and infrared information, we can also compute indices such as NDVI. And in this particular case, you can essentially see there are some crops that are not doing as well as other crops. This is easily discernible from imagery, not just visual imagery but combining both visual imagery and infrared imagery.

두 번째로 할 수 있는 일은 작물의 모형을 따서 3차원으로 재구성하고 덮개 크기 추정치로 모든 작물의 잎 개수와 덮개 크기의 상관관계를 알아 보는 겁니다. 이것은 잎사귀 지표라고 합니다. 이런 잎사귀 지표를 아신다면 모든 작물의 가능한 광합성 수치를 측정하는 것이고 그럼 각 나무의 건강정도를 알 수 있는 겁니다. 시각 정보와 적외선 정보를 결합하면 NDVI같은 지표를 계산해 낼 수 있습니다. 특히 이 경우에는 실제로 다른 작물만큼 좋지 않은 작물이 있음을 알 수 있죠. 이미지를 통해 쉽게 구별할 수 있습니다. 그저 시각 이미지가 아니라 시각과 적외선 이미지를 결합하는 것이죠.

And then lastly, one thing we're interested in doing is detecting the early onset of chlorosis -- and this is an orange tree -- which is essentially seen by yellowing of leaves. But robots flying overhead can easily spot this autonomously and then report to the farmer that he or she has a problem in this section of the orchard.

마지막으로 저희가 흥미를 갖고 있는 것이 백화 초기상태를 탐지하는 겁니다. 이것은 오렌지 나무인데 잎이 황색으로 보이시죠. 하지만 로봇이 위에서 비행하면 쉽게 발견하고 농부에게 과수원의 어느 부분에 문제가 있는지 보고합니다.

Systems like this can really help, and we're projecting yields that can improve by about ten percent and, more importantly, decrease the amount of inputs such as water by 25 percent by using aerial robot swarms.

이런 시스템은 정말 도움이 되는데 약 10% 정도 수확량을 향상시킬 것으로 전망하고 있습니다. 더욱 중요한 것은 물을 주는 것을 로봇 떼를 이용하면 25%정도 절감할 수 있습니다.

Lastly, I want you to applaud the people who actually create the future, Yash Mulgaonkar, Sikang Liu and Giuseppe Loianno, who are responsible for the three demonstrations that you saw.

마지막으로 실제로 미래를 만들고 있는 분들에게 박수를 보내셨으면 좋겠습니다. 야쉬 물가온카, 시캉 리유와 쥬세페 로이아노가 보셨던 세 가지 시범을 담당해 주셨습니다.

Thank you.

감사합니다.

(Applause)

(박수)