(Laughter)

(웃음)

(Laughter)

(웃음)

That's SpotMini. He'll be back in a little while.

이건 스팟미니입니다. 조금 후에 다시 보여드리겠습니다.

I --

저는

(Applause)

(박수)

I love building robots. And my long-term goal is to build robots that can do what people and animals do. And there's three things in particular that we're interested in. One is balance and dynamic mobility, the second one is mobile manipulation, and the third one is mobile perception.

저는 로봇 만드는 것을 좋아합니다. 제 장기적 목표는 사람과 동물이 하는 일을 할 수 있는 로봇을 만드는 것입니다. 우리가 관심을 갖는 세 가지 사항이 있는데요. 첫 번째는 균형과 역동적인 움직임이고 두 번째는 이동 조작 작업 그리고 세 번째는 이동 인식 작업입니다.

So, dynamic mobility and balance -- I'm going to do a demo for you. I'm standing here, balancing. I can see you're not very impressed. OK, how about now?

역동적인 움직임과 균형은 시범으로 보여드리겠습니다. 저는 여기 서있습니다, 균형을 잡고요. 별로 인상적이지 않으신 것 같네요. 이제 어떤가요?

(Laughter)

(웃음)

How about now?

지금은요?

(Applause)

(박수)

Those simple capabilities mean that people can go almost anywhere on earth, on any kind of terrain. We want to capture that for robots.

이런 능력들 덕분에 사람들은 지구상의 거의 모든 곳 어떤 지형에든 갈 수 있습니다. 우리는 로봇이 이런 능력을 갖기 원합니다.

What about manipulation? I'm holding this clicker in my hand; I'm not even looking at it, and I can manipulate it without any problem. But even more important, I can move my body while I hold the manipulator, the clicker, and stabilize and coordinate my body, and I can even walk around. And that means I can move around in the world and expand the range of my arms and my hands and really be able to handle almost anything. So that's mobile manipulation. And all of you can do this.

조작 능력은 어떨까요? 저는 지금 리모콘을 들고 있습니다. 저는 이것을 보지 않고서도 조작하는데 아무런 문제도 없습니다. 더욱 중요한 것은 저는 이 리모컨을 들고 움직일 수도 있고 제 몸을 고정시키고, 두 가지를 동시에 할 수 있습니다. 저는 심지어 걸어다닐 수도 있습니다. 이것은 제가 전 세계를 돌아다닐 수 있으며 저의 팔과 손의 범위를 확장하여 거의 모든 것들을 조작할 수 있음을 의미합니다. 이것이 이동 조작입니다. 여러분 모두 하실 수 있는 것이죠.

Third is perception. I'm looking at a room with over 1,000 people in it, and my amazing visual system can see every one of you -- you're all stable in space, even when I move my head, even when I move around. That kind of mobile perception is really important for robots that are going to move and act out in the world.

세 번째는 인식 작업입니다. 저는 천 명이 있는 곳을 보고 있습니다. 저의 놀라운 시각계는 한 명 한 명도 볼 수 있습니다. 여러분 모두 가만히 계십니다. 심지어 제가 머리를 움직여도 심지어 제가 돌아다녀도요. 이러한 이동 인식 작업은 세계로 나가서 돌아다니며 활동하는 로봇에게 매우 중요합니다.

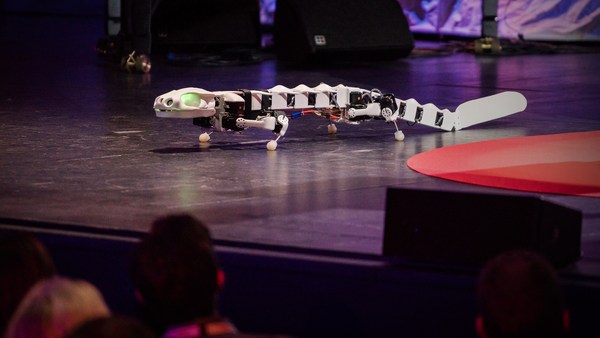

I'm going to give you a little status report on where we are in developing robots toward these ends. The first three robots are all dynamically stabilized robots. This one goes back a little over 10 years ago -- "BigDog." It's got a gyroscope that helps stabilize it. It's got sensors and a control computer.

여러분께 작업 진행 보고서 하나를 보여드리겠습니다. 저희가 작업하고 있는 로봇들은 여기까지 왔습니다. 첫 번째 세 로봇들은 모두 안정적으로 움직이는 로봇들입니다. 10년 전으로 돌아가보면 "빅독"이 있었죠. 빅독은 균형을 잡기 위한 회전축을 가지고 있었는데 센서와 제어 컴퓨터가 내장되어 있었습니다.

Here's a Cheetah robot that's running with a galloping gait, where it recycles its energy, it bounces on the ground, and it's computing all the time in order to keep itself stabilized and propelled.

여기 전속력으로 질주하는 치타 로봇은 에너지를 재활용합니다. 땅에서 튀어오르며 스스로 균형을 잡고 앞으로 나아가기 위해 항상 컴퓨터를 사용합니다.

And here's a bigger robot that's got such good locomotion using its legs, that it can go in deep snow. This is about 10 inches deep, and it doesn't really have any trouble.

그리고 여기 더 큰 로봇은 다리를 활용한 훌륭한 운동 능력을 보여줍니다. 25cm의 깊은 눈 속에서도 어떤 어려움도 없이 이동할 수 있습니다.

This is Spot, a new generation of robot -- just slightly older than the one that came out onstage. And we've been asking the question -- you've all heard about drone delivery: Can we deliver packages to your houses with drones? Well, what about plain old legged-robot delivery?

이건 스팟이라는 새로운 세대의 로봇입니다. 무대에 오른 로봇보다 살짝 구형인 버전입니다. 그리고 저희는 이 질문을 항상 해왔습니다. 여러분 모두 드론 택배에 대해 들어보셨을 겁니다. 과연 드론으로 여러분 집에 택배를 배달할 수 있을까요? 글쎄요, 평범한 구식 보행 로봇 배달은 어떠신가요?

(Laughter)

(웃음)

So we've been taking our robot to our employees' homes to see whether we could get in --

그래서 저희는 우리 로봇을 우리 직원의 집에 보내 보았습니다. 로봇이 다양한 입구에

(Laughter)

(웃음)

the various access ways. And believe me, in the Boston area, there's every manner of stairway twists and turns. So it's a real challenge. But we're doing very well, about 70 percent of the way.

들어갈 수 있는지 보기 위해서요. 그리고 보스턴 지역에는 온갖 종류의 꼬이고 굽어진 계단들이 있습니다. 그래서 이 시도는 진정한 모험이었습니다. 하지만 약 70%의 계단에서 매우 잘 이동하였습니다.

And here's mobile manipulation, where we've put an arm on the robot, and it's finding its way through the door. Now, one of the important things about making autonomous robots is to make them not do just exactly what you say, but make them deal with the uncertainty of what happens in the real world. So we have Steve there, one of the engineers, giving the robot a hard time.

그리고 이건 이동 조작 작업인데요. 로봇에 팔을 장착하면 로봇이 문을 향한 길을 찾아냅니다. 이제, 자율 로봇 제작에 있어 중요한 사항 중 하나는 로봇이 단지 우리가 말하는 것만 실행하도록 하는 것이 아니라, 실생활에서 일어나는 불확실성에 대처하도록 만드는 것입니다. 여기 스티브가 있죠, 우리 기술자중 한 명인데요. 로봇에게 시련을 줍니다.

(Laughter)

(웃음)

And the fact that the programming still tolerates all that disturbance -- it does what it's supposed to.

그리고 프로그램은 모든 제약들을 견뎌냅니다. 그렇게 하도록 제작된 것이죠.

Here's another example, where Eric is tugging on the robot as it goes up the stairs. And believe me, getting it to do what it's supposed to do in those circumstances is a real challenge, but the result is something that's going to generalize and make robots much more autonomous than they would be otherwise.

여기 다른 예가 있는데요. 에릭이 로봇을 잡아당겨도 로봇은 위로 올라갑니다. 여러분 저런 환경 속에서 명령을 수행하는 것은 정말 도전적인 일이지만 이 결과는 앞으로 일반화 될 것이며 다른 어떤 훈련보다도 로봇을 훨씬 더 자율적으로 만듭니다.

This is Atlas, a humanoid robot. It's a third-generation humanoid that we've been building. I'll tell you a little bit about the hardware design later. And we've been saying: How close to human levels of performance and speed could we get in an ordinary task, like moving boxes around on a conveyor? We're getting up to about two-thirds of the speed that a human operates on average. And this robot is using both hands, it's using its body, it's stepping, so it's really an example of dynamic stability, mobile manipulation and mobile perception. Here --

이것은 아틀라스, 인간형 로봇입니다. 이것은 저희가 제작한 3세대 인간형 로봇입니다. 외형 디자인에 대해서는 후에 조금 이야기 해드리겠습니다. 저희가 이야기했던 것은 인간 수준의 수행과 속도에 얼마나 가까이 도달할 수 있는가는 일반적인 과제이고 컨베이어 주변의 상자를 옮기는 것 같은 일 말이죠. 저희는 평균적으로 인간의 수행 속도의 약 3분의 2 수준에 도달했습니다. 그리고 이 로봇은 양손을 사용하면서, 몸을 움직이고 걷습니다. 이 로봇은 역동적인 안정성을 보여주는 좋은 예입니다. 이동 조작 작업 그리고 이동 인식 작업입니다, 여기

(Laughter)

(웃음)

We actually have two Atlases.

사실 저희는 아틀라스가 2개 있습니다.

(Laughter)

(웃음)

Now, everything doesn't go exactly the way it's supposed to.

모든 일이 우리가 의도한 그대로 진행되지는 않습니다.

(Laughter)

(웃음)

(Laughter)

(웃음)

(Laughter)

(웃음)

And here's our latest robot, called "Handle." Handle is interesting, because it's sort of half like an animal, and it's half something else with these leg-like things and wheels. It's got its arms on in kind of a funny way, but it really does some remarkable things. It can carry 100 pounds. It's probably going to lift more than that, but so far we've done 100. It's got some pretty good rough-terrain capability, even though it has wheels. And Handle loves to put on a show.

이것은 최신형 로봇, 핸들입니다. 핸들이 흥미로운 이유는, 반은 동물에 가깝고 반은 다른 어떤 것에 가까운데 다리 부분에 바퀴가 달려있습니다. 이 로봇은 팔을 다소 우스꽝스럽게 쓰긴 하지만 정말 주목할만한 일을 해 냅니다. 45kg을 들어 올립니다. 앞으로 그보다 더 많이 들어올리게 되겠지만 지금까지는 45kg을 들어올렸습니다. 핸들은 꽤 훌륭한 거친 지형 이동 능력을 갖췄고 심지어는 바퀴인데도요. 그리고 핸들은 뽐내기도 좋아합니다.

(Laughter)

(웃음)

(Applause)

(박수)

I'm going to give you a little bit of robot religion. A lot of people think that a robot is a machine where there's a computer that's telling it what to do, and the computer is listening through its sensors. But that's really only half of the story. The real story is that the computer is on one side, making suggestions to the robot, and on the other side are the physics of the world. And that physics involves gravity, friction, bouncing into things. In order to have a successful robot, my religion is that you have to do a holistic design, where you're designing the software, the hardware and the behavior all at one time, and all these parts really intermesh and cooperate with each other. And when you get the perfect design, you get a real harmony between all those parts interacting with each other. So it's half software and half hardware, plus the behavior.

이제 로봇의 원칙에 대해 조금 말씀드리겠습니다. 많은 분들이 로봇을 명령을 내리는 컴퓨터를 내장한 기계이며 컴퓨터는 센서를 통해 입력을 받는다고 생각하지만 그것은 절반만을 이해하고 있는 것입니다. 실제로는 컴퓨터는 한편에서 로봇에게 제안을 하고 있고 다른 한편에는 세상의 물리적 요소들이 있습니다. 그리고 물리적 요소는 중력, 마찰, 반작용을 포함합니다. 성공적인 로봇을 만들어내기 위한 저의 원칙은, 전체를 아우르는 디자인을 해야 한다는 것입니다. 소프트웨어와 함께, 하드웨어와 동작들을 동시에 설계해야 하죠. 모든 부분들이 완벽히 딱 들어맞아 서로 협응해야 합니다. 당신이 완벽한 디자인을 했다면 상호작용하는 부분들 사이의 완전한 조화를 얻게 될 겁니다 소프트웨어 반, 하드웨어 반 여기에 동작 수행이 더해집니다.

We've done some work lately on the hardware, where we tried to go -- the picture on the left is a conventional design, where you have parts that are all bolted together, conductors, tubes, connectors. And on the right is a more integrated thing; it's supposed to look like an anatomy drawing. Using the miracle of 3-D printing, we're starting to build parts of robots that look a lot more like the anatomy of an animal. So that's an upper-leg part that has hydraulic pathways -- actuators, filters -- all embedded, all printed as one piece, and the whole structure is developed with a knowledge of what the loads and behavior are going to be, which is available from data recorded from robots and simulations and things like that.

저희는 최근에 하드웨어 작업을 조금 했는데 왼쪽 그림은 전통적인 디자인이고 부품들이 볼트로 조립어 있죠, 도체, 튜브, 커넥터 오른쪽은 좀 더 통합된 디자인인 해부학 구조와 비슷하게 설계된 것입니다. 3-D 프린터의 기적을 이용하여 동물의 해부학적 구조와 훨씬 더 닯은 로봇 부품을 제작하기 시작였습니다. 이것이 유압 통로를 가진 다리 상부 부분입니다. 작동기, 필터 모두 내장되어, 하나의 부품으로 프린트되어 나오게 됩니다. 로봇들에게서 기록된 데이터들과 시뮬레이션 등을 통하여 하중과 동작들이 어떻게 될지 지식을 이용하여 전체 형태를 개선하였습니다.

So it's a data-driven hardware design. And using processes like that, not only the upper leg but some other things, we've gotten our robots to go from big, behemoth, bulky, slow, bad robots -- that one on the right, weighing almost 400 pounds -- down to the one in the middle which was just in the video, weighs about 190 pounds, just a little bit more than me, and we have a new one, which is working but I'm not going to show it to you yet, on the left, which weighs just 165 pounds, with all the same strength and capabilities. So these things are really getting better very quickly.

이것은 데이터 중심 하드웨어 디자인입니다. 그리고 이러한 절차를 이용하여 다리 상부 뿐만 아니라 다른 부분들도 거대하고, *베헤모스 같은, 덩치 큰, 느린, 나쁜 로봇에서(성경에 언급된 짐슴) 오른쪽에 있는 것은 거의 180kg에 이르는데요. 가운데에 있는 로봇은 비디오에 나온 것인데 약 85kg으로 저보다 약간 무거운 정도로 줄였고 최신형 로봇은 동작은 하지만, 여기에 가져오지는 않았습니다. 왼쪽에 있는 75kg밖에 안되는 로봇은 똑같은 힘과 능력을 가지고 있습니다. 이런 것들은 매우 빠르게 개선되고 있습니다.

So it's time for Spot to come back out, and we're going to demonstrate a little bit of mobility, dexterity and perception. This is Seth Davis, who's my robot wrangler today, and he's giving Spot some general direction by steering it around, but all the coordination of the legs and the sensors is done by the robot's computers on board. The robot can walk with a number of different gaits; it's got a gyro, or a solid-state gyro, an IMU on board. Obviously, it's got a battery, and things like that. One of the cool things about a legged robot is, it's omnidirectional. In addition to going forward, it can go sideways, it can turn in place. And this robot is a little bit of a show-off. It loves to use its dynamic gaits, like running --

이제 스팟을 다시 불러 보겠습니다, 이동 능력, 작업능력, 지각 능력을 시연해 보겠습니다. 세스 데이비스, 오늘 저의 로봇 조종사가 되어 줄 분입니다. 그가 조종을 해서 스팟에게 일반적인 명령을 내리더라도 다리와 센서의 협응은 내장된 컴퓨터에 의해 이뤄지는 것입니다. 이 로봇은 몇가지 다른 길들을 걸을 수 있는데 정지 상태의 바퀴를 가지고 있으며 관성측정장치가 내장되어 있습니다. 분명히, 스팟에는 배터리 등이 내장되어 있습니다. 보행 로봇의 멋진 점은 전방향적이라는 겁니다. 앞으로 가는 것에 더하여 옆으로 갈 수도 있고 제자리에서 돌 수도 있습니다. 그리고 이 로봇은 뽐내기를 좋아하는데요. 역동적으로 걷기를 좋아하고요. 뛰듯이요.

(Laughter)

(웃음)

And it's got one more.

한 가지 더 있습니다.

(Laughter)

(웃음)

Now if it were really a show-off, it would be hopping on one foot, but, you know.

정말 뽐내고 싶다면 한 발로 뛰어야 겠죠, 하지만, 아시잖아요.

Now, Spot has a set of cameras here, stereo cameras, and we have a feed up in the center. It's kind of dark out in the audience, but it's going to use those cameras in order to look at the terrain right in front of it, while it goes over these obstacles back here. For this demo, Seth is steering, but the robot's doing all its own terrain planning. This is a terrain map, where the data from the cameras is being developed in real time, showing the red spots, which are where it doesn't want to step, and the green spots are the good places. And here it's treating them like stepping-stones. So it's trying to stay up on the blocks, and it adjusts its stride, and there's a ton of planning that has to go into an operation like that, and it does all that planning in real time, where it adjusts the steps a little bit longer or a little bit shorter.

스팟에는 입체 카메라 세트가 장착되어 있는데요. 위 중앙에 입력을 하면 청중들이 어둡게 보이네요. 이제 저 카메라들로 지형을 인식하도록 하면 바로 이 앞이요, 이 뒤에 있는 방해물을 지나게 됩니다. 이 시연을 위해 세스가 조종을 하고 있지만 로봇은 자신의 지형 계획을 세우고 있습니다. 이것이 지형 지도인데요. 카메라로부터 실시간 데이터가 들어와 빨간 점들을 표시해주는데, 걸음을 딛기 힘든 곳들이죠. 그리고 초록 점들은 좋은 곳들입니다. 그리고 이 부분들을 디딤돌로 인식합니다. 스팟을 블록 위에만 서있도록 하면 스팟은 자신의 걸음을 조정하고 이러한 조작을 수행하기 위한 수많은 계획들이 수립하며 걸음을 약간 길게 또는 약간 짧게 조정하는 과정에서 이 모든 계획을 실시간으로 세웁니다.

Now we're going to change it into a different mode, where it's just going to treat the blocks like terrain and decide whether to step up or down as it goes. So this is using dynamic balance and mobile perception, because it has to coordinate what it sees along with how it's moving.

이제 다른 방식으로 바꾸어 볼 건데요. 블록들을 단지 지형의 일부로 인식하도록 하고 올라갈지 또는 내려갈지 결정하면서 이동하게 합니다. 이것은 역동적인 균형 능력과 이동 인식 능력을 이용하는데요. 자신이 본 것과 어떻게 움직일지를 결합해야 하기 때문이지요.

The other thing Spot has is a robot arm. Some of you may see that as a head and a neck, but believe me, it's an arm. Seth is driving it around. He's actually driving the hand and the body is following. So the two are coordinated in the way I was talking about before -- in the way people can do that. In fact, one of the cool things Spot can do we call, "chicken-head mode," and it keeps its head in one place in space, and it moves its body all around. There's a variation of this that's called "twerking" --

스팟이 가지고 있는 다른 한 가지는 로봇 팔입니다. 몇분은 이것을 머리나 목이라고 생각하셨을 텐데요. 여러분, 이건 팔입니다. 세스가 주위로 움직이고 있습니다. 사실 그는 손을 움직이고 있고 몸은 따라가고 있는 겁니다. 이 둘은 앞서 말씀드린 방식으로 사람들이 하는 방식처럼 협응하고 있습니다. 사실, 멋진 점 중 하나는 스팟이 "치킨 헤드 모드"로 작동하는 것인데 이것은 머리를 한 장소에 고정하고 몸을 모든 곳으로 움직이는 것입니다. 이것의 변주는"*트워킹"이라 불리는데 (엉덩이를 흔드는 춤)

(Laughter)

(웃음)

but we're not going to use that today.

오늘은 사용하지 않을 겁니다.

(Laughter)

(웃음)

So, Spot: I'm feeling a little thirsty. Could you get me a soda? For this demo, Seth is not doing any driving. We have a LIDAR on the back of the robot, and it's using these props we've put on the stage to localize itself. It's gone over to that location. Now it's using a camera that's in its hand to find the cup, picks it up -- and again, Seth's not driving. We've planned out a path for it to go -- it looked like it was going off the path -- and now Seth's going to take over control again, because I'm a little bit chicken about having it do this by itself. Thank you, Spot.

스팟, 목이 좀 마른데, 소다를 가져다 주겠니? 이 시연에, 세스는 어떤 조종도 하지 않을 겁니다. 로봇의 등에 광선 레이더가 있어서 무대에 설치해 놓은 이 기둥들을 이용하여 자신의 위치를 파악합니다. 저 장소에 가 있네요. 이제 손에 있는 카메라를 이용해 컵을 찾고 들어 올려서 다시 말씀드리지만, 세스는 조종하고 있지 않습니다. 스팟이 갈 길을 저희가 계획해 놓았습니다. 방금 길을 좀 벗어난 것 같은데요. 그리고 이제 세스가 다시 조종 할 겁니다. 스팟 스스로 해낼 수 있을지 조금 걱정이 되어서요. 고마워, 스팟.

(Applause)

(박수)

So, Spot: How do you feel about having just finished your TED performance?

스팟 TED 공연을 끝마친 소감이 어때?

(Laughter)

(웃음)

Me, too!

나도!

(Laughter)

(웃음)

Thank you all, and thanks to the team at Boston Dynamics, who did all the hard work behind this.

감사합니다, 보이지 않는 곳에서 수고해 준 보스턴 다이나믹스 팀에게도 감사합니다.

(Applause)

(박수)

Helen Walters: Marc, come back in the middle. Thank you so much. Come over here, I have questions.

헬렌 월터스: 마크, 가운데로 와주시겠어요? 정말 감사합니다. 이쪽으로 와 주세요, 질문이 있습니다.

So, you mentioned the UPS and the package delivery. What are the other applications that you see for your robots?

네, 미국 소포 시스템(UPS)과 택배에 대해 언급하셨는데요. 그 외에 로봇이 할 수 있는 일은 어떤 것들이 있을까요?

Marc Raibert: You know, I think that robots that have the capabilities I've been talking about are going to be incredibly useful. About a year ago, I went to Fukushima to see what the situation was there, and there's just a huge need for machines that can go into some of the dirty places and help remediate that.

마크 레이버트: 제가 지금까지 말했던 능력들을 가진 이 로봇들은 엄청나게 유용하게 사용될 겁니다. 대략 일 년 전에, 후쿠시마 상황을 파악하기 위해 다녀왔는데요. 그곳에는, 오염된 장소에 투입하여 보수하는 것을 도울 기계들이 절실히 필요했습니다.

I think it won't be too long until we have robots like this in our homes, and one of the big needs is to take care of the aging and invalids. I think that it won't be too long till we're using robots to help take care of our parents, or probably more likely, have our children help take care of us. And there's a bunch of other things. I think the sky's the limit. Many of the ideas we haven't thought of yet, and people like you will help us think of new applications.

이런 로봇들을 집에서 사용하기까지 많은 시간이 걸리지 않을 거라고 생각하고 가장 수요가 큰 분야는 노인들과 환자를 간병하는 일입니다. 우리의 부모님을 간병하는데 로봇을 이용할 날이 멀지 않았습니다. 또는, 가능성이 더 높은 것은 아이들이 우리를 간병하는데 로봇의 도움을 받을 수 있을 겁니다. 그리고 수많은 다른 일들이 있습니다. 제 생각엔 항공 분야에는 한계가 있는 것 같습니다. 저희가 아직 생각하지 못한 많은 아이디어들 새로운 적용방법을 생각해 내는데 여러분께서 도움을 주실 수 있을 겁니다.

HW: So what about the dark side? What about the military? Are they interested?

헬렌 월터스: 어두운 측면은 어떤가요? 군사용 로봇은요? 관심 있으신가요?

MR: Sure, the military has been a big funder of robotics. I don't think the military is the dark side myself, but I think, as with all advanced technology, it can be used for all kinds of things.

마크 레이번트: 물론이죠, 군대에서 막대한 자금을 제공해 왔습니다. 군사용 로봇이 어두운 측면이라고 생각하지 않습니다. 이것 또한 기술의 발전 중 한 가지로 모든 종류의 일에 사용 될 수 있는 것이죠.

HW: Awesome. Thank you so much.

헬렌 월터스: 멋지네요. 감사합니다.

MR: OK, you're welcome.

마크 레이번트: 별말씀을요.

Thank you.

감사합니다.

(Applause)

(박수)