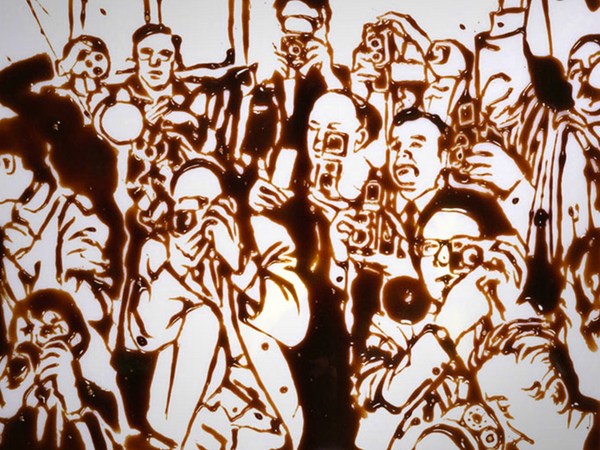

Hello! My name is Golan Levin. I'm an artist and an engineer, which is, increasingly, a more common kind of hybrid. But I still fall into this weird crack where people don't seem to understand me. And I was looking around and I found this wonderful picture. It's a letter from "Artforum" in 1967 saying "We can't imagine ever doing a special issue on electronics or computers in art." And they still haven't. And lest you think that you all, as the digerati, are more enlightened, I went to the Apple iPhone app store the other day. Where's art? I got productivity. I got sports. And somehow the idea that one would want to make art for the iPhone, which my friends and I are doing now, is still not reflected in our understanding of what computers are for.

안녕하세요. 저는 Golan Levin입니다. 저는 예술가이자 공학자입니다. 저처럼 이 두 분야를 넘나드는 사람들이 점차 많아지고 있습니다. 하지만 저는 여전히 묘한 거리감을 느낍니다. 사람들이 저를 이해하지 못하는 부분이 있는 것 같거든요. 이 멋진 사진은 제가 어쩌다 찾아낸 건데요, 1967년 아트포럼에서 보낸 편지입니다. '예술에서의 전자기기나 컴퓨터에 대한 특집 기사를 쓴다는 건 상상도 할 수 없다'고 적혀 있군요. 아직까지도 뭐 실린적은 없죠. 여러분 디지털에 익숙하신 분들이라 이 사람들보단 낫다고 생각하실 것 같아 얼마전에 애플 아이폰 앱스토어에 한번 가봤습니다. 예술은 어딨죠? 생산성도 있고 스포츠도 있는데요. 그런데 어째선지, 누군가는 아이폰을 위한 예술을 만들고 싶어할 꺼라는 생각은 저같은 경우는 친구들과 현재 실제로 하고 있지만, 그런 생각은 아직까지 우리가 생각하는 컴퓨터의 용도로 여겨지지 않고 있습니다.

So, from both directions, there is kind of, I think, a lack of understanding about what it could mean to be an artist who uses the materials of his own day, or her own day, which I think artists are obliged to do, is to really explore the expressive potential of the new tools that we have. In my own case, I'm an artist, and I'm really interested in expanding the vocabulary of human action, and basically empowering people through interactivity. I want people to discover themselves as actors, as creative actors, by having interactive experiences.

그러니까, 양 쪽에서 모두 이해가 부족한 것이 아닐까 싶습니다. 자기 고유의 재료를 사용해 작품을 만드는 예술가가 된다는 것이 갖는 의미를 이해하지 못하는 것 같다는 겁니다. 제 생각에 예술가의 의무는 현재 가지고 있는 새로운 도구의 표현적 잠재력을 적극 탐색하는 것입니다. 제 경우를 말씀드리면, 저는 예술가로서 제가 정말 관심이 많은 분야는 인간의 행동의 언어를 확장하는 것과 기본적으로 사람들에게 상호작용을 통해 권한을 부여하는 것입니다. 저는 사람들이 행동하는 자신의 모습을 깨닫기 바랍니다. 상호적 경험을 통해 창조적 행동을 하는 주체로서의 모습 말입니다.

A lot of my work is about trying to get away from this. This a photograph of the desktop of a student of mine. And when I say desktop, I don't just mean the actual desk where his mouse has worn away the surface of the desk. If you look carefully, you can even see a hint of the Apple menu, up here in the upper left, where the virtual world has literally punched through to the physical. So this is, as Joy Mountford once said, "The mouse is probably the narrowest straw you could try to suck all of human expression through."

제 일은 대부분 이와는 거리가 먼 것입니다. 이 사진은 제 학생의 데스크탑(desktop) 사진입니다. 여기서 데스크탑이라 함은 단지 마우스를 올려놓고 움직이는 바로 그 '데스크 위' 가 아니라 자세히 들여다 보시면 여기 왼쪽상단에 보일듯 말듯한 애플 메뉴가 보이실 겁니다. 가상공간이 말그대로 현실 공간으로 뚫고 나온 모습이죠. 그러니까 이게, Joy Mountford가 말한 것처럼 '마우스는, 모든 인간의 표현을 빨아들일 수 있는 가장 가는 빨대" 일 것입니다.

(Laughter)

(웃음)

And the thing I'm really trying to do is enabling people to have more rich kinds of interactive experiences. How can we get away from the mouse and use our full bodies as a way of exploring aesthetic experiences, not necessarily utilitarian ones. So I write software. And that's how I do it. And a lot of my experiences resemble mirrors in some way. Because this is, in some sense, the first way, that people discover their own potential as actors, and discover their own agency. By saying "Who is that person in the mirror? Oh it's actually me."

그리고 제가 정말 하고 싶은 것은 사람들이 보다 풍부한 상호교류의 경험을 하도록 하는 것입니다. 어떻게 하면 사람들이 마우스에서 손을 떼고 온 몸을 사용해 심미적 경험을 찾아나설 수 있을까요? 꼭 실용적인 경험일 필요는 없습니다. 그래서 저는 소프트웨어를 만들었습니다. 그게 제 방식이었죠. 제 경험의 상당 부분은 어떤 면에서 거울을 닮았습니다. 어떤 의미에서 이를 통해 사람들이 처음 행동의 주체로서의 자신의 잠재력을 처음 발견하기 때문입니다. 또 자신의 주체적 힘을 깨닫기 때문입니다. '거울 속 저게 누구지? 앗, 나네'라고 말하면서 말이죠.

And so, to give an example, this is a project from last year, which is called the Interstitial Fragment Processor. And it allows people to explore the negative shapes that they create when they're just going about their everyday business. So as people make shapes with their hands or their heads and so forth, or with each other, these shapes literally produce sounds and drop out of thin air -- basically taking what's often this, kind of, unseen space, or this undetected space, and making it something real, that people then can appreciate and become creative with. So again, people discover their creative agency in this way. And their own personalities come out in totally unique ways.

예를 하나 들겠습니다. 작년에 했던 한 프로젝트인데요, 단편 조각 프로세서'라는 것입니다. 사람들이 일상생활 속에 자신이 만든 부정적인 모습을 볼 수 있게 한 것입니다. 사람들이 자기 손이나 머리를 사용해서, 또는 두 명이 함께 어떤 형태를 만들 때 이러한 각각의 형태가 말 그대로 소리를 만들어내며 허공속에서 생겨납니다. 기본적으로 어떤 보이지 않는 공간, 또는 인식하지 못하고 있던 이러한 공간을 현실로 만들어내 사람들은 비로소 그것을 인식하고 창조력을 발휘하게 되는겁니다. 즉, 사람들은 이런 방식을 통해 자신의 창조적 힘을 발견하게 됩니다. 그리고 각자의 개성이 드러나는 것이죠. 자신만의 독특한 방식으로 말입니다.

So in addition to using full-body input, something that I've explored now, for a while, has been the use of the voice, which is an immensely expressive system for us, vocalizing. Song is one of our oldest ways of making ourselves heard and understood. And I came across this fantastic research by Wolfgang Köhler, the so-called father of gestalt psychology, from 1927, who submitted to an audience like yourselves the following two shapes. And he said one of them is called Maluma. And one of them is called Taketa. Which is which? Anyone want to hazard a guess? Maluma is on top. Yeah. So. As he says here, most people answer without any hesitation.

이렇게 온 몸을 사용한 표현법 외에 요즘 제가 한동안 연구중인 것인 게 또 있는데요, 목소리를 사용하는 것입니다. 이 목소리 기법은 표현력이 매우 뛰어난 시스템입니다. 노래는 인간이 자신을 표현하고 공감을 얻는 가장 오래된 방법 중 하나입니다. 이와 관련한 매우 뛰어난 연구에 대해 알게 되었는데요, 형태심리학의 아버지인 볼프강 쾰러의 연구입니다. 그는 1927년이래 여러분과 같은 관객들에게 지금 보여드릴 두 가지 형태를 보여주면서 이 둘 중 하나의 이름은 '말루마'이고 다른 하나는 '타케타'라고 알려주었습니다. 어떤 게 어떤걸까요? 혹시 과감히 찍어보실 분? 위가 '말루마'입니다. 네. 이처럼, 그가 이렇게 질문을 하면 대부분은 망설임없이 대답합니다.

So what we're really seeing here is a phenomenon called phonaesthesia, which is a kind of synesthesia that all of you have. And so, whereas Dr. Oliver Sacks has talked about how perhaps one person in a million actually has true synesthesia, where they hear colors or taste shapes, and things like this, phonaesthesia is something we can all experience to some extent. It's about mappings between different perceptual domains, like hardness, sharpness, brightness and darkness, and the phonemes that we're able to speak with.

그러니까 우리가 여기서 보게 되는 현상은 '음성 상징법'이라고 하는 것으로, 이것은 여러분 모두가 갖고 있는 공감각의 일종입니다. 그리고 따라서 올리버 삭스 박사가 아마도 백만명 중 한명이 진정한 공감각을 갖고 있다고 할 수 있다고 주장해온 것처럼 색을 듣거나 형태를 맛보고 하는 그런 것들이 이루어지는 것을 말합니다. 음성상징은 우리 모두 어느 정도까지는 경험할 수 있는 겁니다. 상이한 개념들 간의 관계도를 만드는 것이라 할 수 있죠. 말하자면 단단함, 날카로움, 밝음, 어두움 같은 것들 말입니다. 인간이 말할 때 사용하는 음운도 있겠죠

So 70 years on, there's been some research where cognitive psychologists have actually sussed out the extent to which, you know, L, M and B are more associated with shapes that look like this, and P, T and K are perhaps more associated with shapes like this. And here we suddenly begin to have a mapping between curvature that we can exploit numerically, a relative mapping between curvature and shape.

그래서 70년간 진행되어온 한 연구에서 인지심리학자들은 실제로 조사를 해오고 있습니다. 어느 정도까지 L, M, B 소리가 이런 모양과 더 관련이 있고 P, T, K는 아마도 이런 형태와 더 연관이 있나 하는 것이죠. 여기서 우리는 굴곡, 즉 숫자를 통해 변형할 수 있는 굴곡과 형태 사이의 상대적인 관계도를 얻어내기 시작합니다.

So it occurred to me, what happens if we could run these backwards? And thus was born the project called Remark, which is a collaboration with Zachary Lieberman and the Ars Electronica Futurelab. And this is an interactive installation which presents the fiction that speech casts visible shadows. So the idea is you step into a kind of a magic light. And as you do, you see the shadows of your own speech. And they sort of fly away, out of your head. If a computer speech recognition system is able to recognize what you're saying, then it spells it out. And if it isn't then it produces a shape which is very phonaesthetically tightly coupled to the sounds you made. So let's bring up a video of that.

자, 이러한 일이 발생했는데, 그렇다면 이 과정을 거꾸로 한다면? 그래서 '리마크'라는 프로젝트를 시작한 것입니다. 자차리 리버만과 아르스 일렉트로니카 퓨처랩의 공동작업이었습니다. 이것은 상호적 전시로, 발화가 시각적 그림자를 만들어내는 창작적 세계를 보여줍니다. 관객이 일종의 마법의 불빛 안으로 들어가면 그 순간 자신의 목소리의 그림자를 보게 되는 겁니다. 그 그림자들은 자신의 머릿속에서 날아가버리는 것과 같죠. 컴퓨터의 발화 인지 시스템이 관객이 말하는 바를 인식할 수 있으면 그걸 글자로 나타내는 겁니다. 인식할 수 없으면, 매우 발성심미적인 모양을 만들어내는데, 이 모양은 관객이 만들어내는 소리에 긴밀히 연결된 것입니다. 자, 자료화면 보시죠.

(Applause)

(박수)

Thanks. So. And this project here, I was working with the great abstract vocalist, Jaap Blonk. And he is a world expert in performing "The Ursonate," which is a half-an-hour nonsense poem by Kurt Schwitters, written in the 1920s, which is half an hour of very highly patterned nonsense. And it's almost impossible to perform. But Jaap is one of the world experts in performing it. And in this project we've developed a form of intelligent real-time subtitles. So these are our live subtitles, that are being produced by a computer that knows the text of "The Ursonate" -- fortunately Jaap does too, very well -- and it is delivering that text at the same time as Jaap is. So all the text you're going to see is real-time generated by the computer, visualizing what he's doing with his voice. Here you can see the set-up where there is a screen with the subtitles behind him. Okay. So ... (Applause) The full videos are online if you are interested.

감사합니다. 이 프로젝트에서 저는 추상 보컬리스트 자프 블롱크씨와 작업을 했는데요, '어소네이트(The Ursonate)'라는 행위예술을 선보이신 세계적 전문가입니다. 이 작품은 30분 분량의 무의미한 시인데요, 1920년대에 쓰여진 커트 슈비터스의 작품입니다. 즉, 매우 정형화된 의미없는 소리들의 나열로 된 30분짜리 작품입니다. 낭독자체가 거의 불가능합니다. 그러나 자프는 이 작품 낭독의 세계적 전문가 중 한 명입니다. 그래서 이 프로젝트에서 저희는 지능형 실시간 자막 같은걸 개발했습니다. 자 이게 그 실시간 자막입니다. 이 시의 텍스트가 인식된 컴퓨터에서 만들어내고 있는 건데요, 자프 씨도 다행히 매우 잘 하십니다. 야프 씨가 소리를 냄과 동시에 글자를 내보냅니다. 그래서 이제 보실 글자들은 실시간으로 컴퓨터가 야프씨가 목소리로 내는 소리를 시각화 하는 겁니다. 여기 뒤 쪽으로 자막이 스크린에 뜨도록 해놓은 걸 보실 수 있습니다. 네... (박수) 관심있으시면 온라인으로 전체 동영상을 보셔도 좋겠습니다.

I got a split reaction to that during the live performance, because there is some people who understand live subtitles are a kind of an oxymoron, because usually there is someone making them afterwards. And then a bunch of people who were like, "What's the big deal? I see subtitles all the time on television." You know? They don't imagine the person in the booth, typing it all.

이 퍼포먼스를 하는 동안 상반된 반응을 받았는데요, 왜냐하면 어떤 사람들은 실시간 자막이 어떤 면에서는 사실 모순이라는 걸 알거든요. 왜냐하면 보통은 자막은 나중에 만드는 것이기 때문이죠. 그러면 많은 이들은 "그게 뭐?" "TV에서도 항상 자막이 나오는구만." 하고 생각하죠. 그렇잖아요? 부스에 앉아서 열심히 받아적는 사람이 있다는 생각은 못하는거죠.

So in addition to the full body, and in addition to the voice, another thing that I've been really interested in, most recently, is the use of the eyes, or the gaze, in terms of how people relate to each other. It's a really profound amount of nonverbal information that's communicated with the eyes. And it's one of the most interesting technical challenges that's very currently active in the computer sciences: being able to have a camera that can understand, from a fairly big distance away, how these little tiny balls are actually pointing in one way or another to reveal what you're interested in, and where your attention is directed. So there is a lot of emotional communication that happens there.

자, 이제 몸과 목소리 외에 제가 가장 최근들어 관심갖고 있는 것은 눈을 사용한 작업입니다. 혹은 시선을 사용하는 것이죠. 사람들이 어떻게 서로 관계하는가 하는 측면에서요. 사람은 실로 엄청난 양의 비언어적인 정보를 눈을 통해 주고 받습니다. 인간의 눈은 현재 컴퓨터과학 분야에서 최근에 활발하게 다뤄지고 있는 흥미로운 기술적 이슈 중 하납니다. 카메라를 통해 상당히 먼 곳에서도 이 작은 안구가 어느 쪽을 향하고 있는지를 그 사람이 무엇에 관심이 있는 건지를 밝혀내고 어디에 주목하고 있는 건지를 알아낼 수 있죠. 그렇게 해서 수 많은 감정의 전달이 이루어지고 있는겁니다.

And so I've been beginning, with a variety of different projects, to understand how people can relate to machines with their eyes. And basically to ask the questions: What if art was aware that we were looking at it? How could it respond, in a way, to acknowledge or subvert the fact that we're looking at it? And what could it do if it could look back at us? And so those are the questions that are happening in the next projects.

그래서 저는 다양한 프로젝트를 통해서 사람들이 눈을 통해 어떻게 기계와 소통하는지 알 수 있게 되었습니다. 또, 기본적으로 어떤 질문들을 던지고자 함이었습니다. 예술작품이 우리가 자기를 보고 있다는 걸 안다면 어떨까? 과연 어떻게 반응할까? 자기를 보고 있다는 사실을 받아들일까, 아니면 용납하지 못할까? 그리고 그 자신도 관객에게 시선을 되보낼 수 있다면 어떻게 할까? 이러한 질문들을 이제 보여드릴 프로젝트에서 해봤습니다.

In the first one which I'm going to show you, called Eyecode, it's a piece of interactive software in which, if we read this little circle, "the trace left by the looking of the previous observer looks at the trace left by the looking of previous observer." The idea is that it's an image wholly constructed from its own history of being viewed by different people in an installation. So let me just switch over so we can do the live demo. So let's run this and see if it works.

첫번째 작품은 '아이코드'라는 작품인데요, 상호적 소프트웨어의 일부로서 관객이 눈으로 이 작은 원을 읽으면 그 관찰자의 시선의 자취를 그대로 다시 따라가는 것입니다. 이 작품은 온전히 그 작품이 관객에게 관찰되는 그 기록으로부터 만들어진 이미지인 것입니다. 설치작품에서 다른 관객들에 의해 말입니다. 이제 바꿔봐서 여기서 한 번 해볼까요. 되는지 한번 작동해보겠습니다.

Okay. Ah, there is lots of nice bright video. There is just a little test screen that shows that it's working. And what I'm just going to do is -- I'm going to hide that. And you can see here that what it's doing is it's recording my eyes every time I blink. Hello? And I can ... hello ... okay. And no matter where I am, what's really going on here is that it's an eye-tracking system that tries to locate my eyes. And if I get really far away I'm blurry. You know, you're going to have these kind of blurry spots like this that maybe only resemble eyes in a very very abstract way. But if I come up really close and stare directly at the camera on this laptop then you'll see these nice crisp eyes.

되네요. 아, 괜찮은 비디오들이 많네요. 여기 이 시험 스크린을 보시면 작동한다는 게 보이실 겁니다. 이제 제가 이걸 숨겨보겠습니다. 그럼 이제 여기서 그게 무엇을 하고 있는지 보실 수 있을 겁니다. 바로 제가 눈을 깜빡일 때마다 그걸 기록하고 있는거죠. 여보세요? 음..그리고 제가..안녕하세요. 좋습니다. 제가 어디있든 여기서 일어나고 있는 일이 뭐냐하면 제 눈의 위치를 파악하는 눈 추적 시스템인 것입니다. 제가 멀리 떨어지면 흐릿해지죠. 자, 이렇게 흐릿한 점 같은 걸 보실텐데요 아주 아주 추상적으로 보면 눈을 좀 닮은 것도 같죠. 반대로 확 가까이 다가가서 카메라를 똑바로 쳐다보면 아주 또렷하게 눈의 모양을 보시게 됩니다.

You can think of it as a way of, sort of, typing, with your eyes. And what you're typing are recordings of your eyes as you're looking at other peoples' eyes. So each person is looking at the looking of everyone else before them. And this exists in larger installations where there are thousands and thousands of eyes that people could be staring at, as you see who's looking at the people looking at the people looking before them. So I'll just add a couple more. Blink. Blink. And you can see, just once again, how it's sort of finding my eyes and doing its best to estimate when it's blinking. Alright. Let's leave that. So that's this kind of recursive observation system. (Applause) Thank you.

말하자면 눈으로 타자를 치는 거라고 생각하셔도 좋겠습니다. 자신의 눈의 녹화된 이미지를 타자치듯 기록하는 겁니다. 다른 사람의 눈을 바라보는 자신의 눈을 말입니다. 이런 식으로 각각의 사람이 자신 앞의 모든 다른 사람들의 시선을 바라보고 있는거죠. 이걸 보다 큰 규모의 작품으로 만들어서 수십만개의 눈이 있는거고 그 눈들을 관객들이 볼 수 있어서 누가 그 사람들이 자기 앞의 사람들을 바라보고 있는지를 볼 수 있는거죠. 자 이제 몇 개만 더 만들어보겠습니다. 깜빡 깜빡 자, 보시면 이제 다시 이 장치가 제 눈을 찾고 제 눈이 언제 깜빡이는 지를 계산하려고 하는 지 보이시죠. 자, 이제 이건 이쯤 하겠습니다. 이런 식의 반복 관찰 시스템인 것입니다. (박수) 감사합니다.

The last couple pieces I'm going to show are basically in the new realm of robotics -- for me, new for me. It's called Opto-Isolator. And I'm going to show a video of the older version of it, which is just a minute long. Okay. In this case, the Opto-Isolator is blinking in response to one's own blinks. So it blinks one second after you do. This is a device which is intended to reduce the phenomenon of gaze down to the simplest possible materials. Just one eye, looking at you, and eliminating everything else about a face, but just to consider gaze in an isolated way as a kind of, as an element. And at the same time, it attempts to engage in what you might call familiar psycho-social gaze behaviors. Like looking away if you look at it too long because it gets shy, or things like that.

이제 마지막으로 보여드릴 것들은 기본적으로 적어도 저한테는 신생분야인 로봇공학인데요. 광학절연체라고 합니다. 이 장치의 이전 버전을 담은 동영상을 보시겠습니다. 1분 정도로 짧습니다. 여기서 광학절연체는 관찰자가 깜빡이는 것에 반응해 깜빡입니다. 그러니까, 제가 깜빡이고 1초뒤에 깜빡이는 거죠. 이 장치를 통해서 응시라는 행위를 가능한한 가장 단순한 도구로 줄여보려고 했습니다. 눈 한개만이 여러분을 바라보고 있고 얼굴의 다른 부분은 모두 지워버렸습니다. 대신 시선을 주변으로부터 분리시켜 말하자면 하나의 요소로서 인식하려한 겁니다. 그와 동시에, 연결지어 보려고 한 개념이 소위 익숙한 정신사회학적 응시 행동이라는 건데요. 어떤 거냐면, 이걸 너무 오래 쳐다보고 있으면 시선을 피하죠. 부끄러워지니까요. 뭐 그런 것들 말입니다.

Okay. So the last project I'm going to show is this new one called Snout. (Laughter) It's an eight-foot snout, with a googly eye. (Laughter) And inside it's got an 800-pound robot arm that I borrowed, (Laughter) from a friend. (Laughter) It helps to have good friends. I'm at Carnegie Mellon; we've got a great Robotics Institute there. I'd like to show you thing called Snout, which is -- The idea behind this project is to make a robot that appears as if it's continually surprised to see you. (Laughter) The idea is that basically -- if it's constantly like "Huh? ... Huh?" That's why its other name is Doubletaker, Taker of Doubles. It's always kind of doing a double take: "What?" And the idea is basically, can it look at you and make you feel as if like, "What? Is it my shoes?" "Got something on my hair?" Here we go. Alright.

자, 이제 마지막 프로젝트입니다. '코' 라는 새로운 작품입니다. (웃음) 8피트 정도되는 코인데요, 퉁방울눈이 달려있습니다. (웃음) 이 안에 있는 건 800파운드 정도되는 로봇팔인데요 뭐 빌린 겁니다만 (웃음) 친구한테요 (웃음) 친구 잘 두니 좋긴 좋더군요. 제가 있는 카네기 멜론의 로봇 공학 연구소가 좋거든요. 이 '코'라는 작품을 보여드릴텐데요, 이 프로젝트의 의도는 로봇이 당신을 보고 놀란 것 같은 반응을 계속 보이게 한 겁니다. (웃음) 기본적으로 어떤거냐면, 계속 이 로봇이 "엥?...엥?"하면 어떨까, 하는 겁니다. 그래서 부제가 '한번 더 보기' 인데요, 항상 한 번 다시 돌아보거든요. "뭐야?" 하듯 말이죠. 기본적인 컨셉은 이렇게 이 로봇이 당신을 보면 당신은 마치 "뭐지? 내 신발이 이상한가?" "머리에 뭐가 묻었나?" 이런 생각을 하게 된다는 거죠. 자 보시죠.

Checking him out ... For you nerds, here's a little behind-the-scenes. It's got a computer vision system, and it tries to look at the people who are moving around the most. Those are its targets. Up there is the skeleton, which is actually what it's trying to do. It's really about trying to create a novel body language for a new creature. Hollywood does this all the time, of course. But also have the body language communicate something to the person who is looking at it. This language is communicating that it is surprised to see you, and it's interested in looking at you.

이 남자 좀 보세요. 궁금해 못참겠는 분들을 위해 카메라 뒤를 보여드리죠. 컴퓨터 시각 시스템을 탑재하고 있습니다. 제일 많이 돌아다니는 사람을 쳐다봅니다. 이 사람들이 목표물인거죠. 저 위는 해골입니다. 이게 바로 실제로 이 로봇이 하려고 하는 겁니다. 창조물에 기발한 몸언어를 만들어내려고 하는 겁니다. 물론 헐리우드에서는 항상 하는 거죠. 그렇지만 이같은 몸짓언어를 통해서 바라보고 있는 상대에게 무언가를 전달하는 겁니다. 이 언어는 당신을 봐서 놀랍다, 당신을 보고 있는 게 재밌다는 메시지를 전달하고 있는 겁니다.

(Laughter)

(웃음)

(Applause)

(박수)

Thank you very much. That's all I've got for today. And I'm really happy to be here. Thank you so much.

대단히 감사합니다. 오늘 이것으로 마치겠습니다. 이 자리에 서게 되어 정말 기쁩니다. 감사합니다.

(Applause)

(박수)