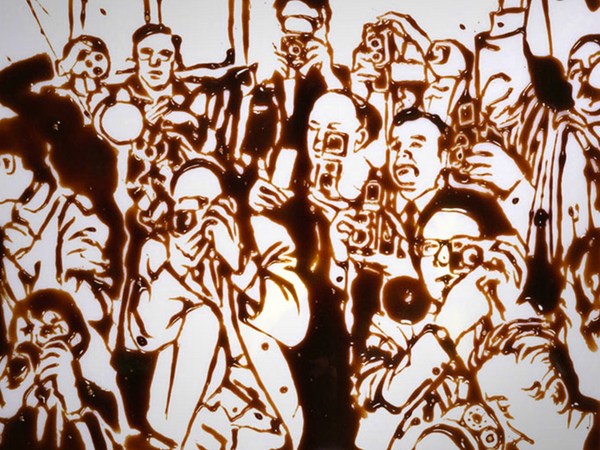

Hello! My name is Golan Levin. I'm an artist and an engineer, which is, increasingly, a more common kind of hybrid. But I still fall into this weird crack where people don't seem to understand me. And I was looking around and I found this wonderful picture. It's a letter from "Artforum" in 1967 saying "We can't imagine ever doing a special issue on electronics or computers in art." And they still haven't. And lest you think that you all, as the digerati, are more enlightened, I went to the Apple iPhone app store the other day. Where's art? I got productivity. I got sports. And somehow the idea that one would want to make art for the iPhone, which my friends and I are doing now, is still not reflected in our understanding of what computers are for.

¡Hola! Mi nombre es Golan Levin Soy artista e ingeniero lo cual está siendo una especie de híbrido cada vez más común Pero todavía caigo en este rompimiento extraño donde la gente no parece entenderme. Y estaba mirando y encontré esta foto maravillosa. Es una carta de “Artforum” de 1967 que dice “No podemos imaginar incluso en hacer un número especial sobre electrónica o computadores en arte”. Y todavía no lo han hecho. y no sea que piensen que todos, como los digerati, son más iluminados. El otro día fui a la tienda de aplicaciones para iPhone de Apple. ¿Dónde está el arte? Hay productividad. Hay deportes. Y de algún modo la idea de que uno quiera hacer arte para el iPhone, que es lo que mis amigos y yo estamos haciendo ahora, aún no se refleja en nuestro entendimiento de para qué son los computadores.

So, from both directions, there is kind of, I think, a lack of understanding about what it could mean to be an artist who uses the materials of his own day, or her own day, which I think artists are obliged to do, is to really explore the expressive potential of the new tools that we have. In my own case, I'm an artist, and I'm really interested in expanding the vocabulary of human action, and basically empowering people through interactivity. I want people to discover themselves as actors, as creative actors, by having interactive experiences.

Así que, desde los dos puntos, existe algo así como, creo, una falta de comprensión acerca de lo que podría significar ser un artista o una artista que utiliza los materiales de su propio día, Lo que creo que los artistas están obligados a hacer, es explorar realmente el potencial expresivo de las nuevas herramientas que tenemos. En mi caso propio, soy un artista, y estoy realmente interesado en expandir el vocabulario de la acción humana, y básicamente dar poder a la gente a través de la interactividad. Quiero que las personas se descubran a sí mismas como actores, como actores creativos, mediante experiencias interactivas.

A lot of my work is about trying to get away from this. This a photograph of the desktop of a student of mine. And when I say desktop, I don't just mean the actual desk where his mouse has worn away the surface of the desk. If you look carefully, you can even see a hint of the Apple menu, up here in the upper left, where the virtual world has literally punched through to the physical. So this is, as Joy Mountford once said, "The mouse is probably the narrowest straw you could try to suck all of human expression through."

Mucho de mi trabajo se trata de salir de esto. Ésta es una fotografía del escritorio de uno de mis estudiantes. Y cuando digo escritorio, no sólo significa la mesa desde donde su ratón ha desgastado la superficie del escritorio. Si mira cuidadosamente, incluso puede ver una pista del menú de Apple, arriba en la parte superior izquierda, en donde el mundo virtual literalmente ha traspasado al físico. Entonces esto es, como dijo una vez Jon Mountford “el ratón es probablemente el pitillo más estrecho a través del cual puedes succionar toda la expresión humana”.

(Laughter)

(Risas)

And the thing I'm really trying to do is enabling people to have more rich kinds of interactive experiences. How can we get away from the mouse and use our full bodies as a way of exploring aesthetic experiences, not necessarily utilitarian ones. So I write software. And that's how I do it. And a lot of my experiences resemble mirrors in some way. Because this is, in some sense, the first way, that people discover their own potential as actors, and discover their own agency. By saying "Who is that person in the mirror? Oh it's actually me."

Y lo que estoy tratando de hacer realmente, es permitir que la gente tenga más tipos de experiencias interactivas ricas. Cómo podemos alejarnos del ratón y utilizar todo nuestro cuerpo como una forma de explorar experiencias estéticas no necesariamente utilitarias. Entonces escribo software. Y así es cómo lo hago. Y muchas de mis experiencias se asemejan a espejos de algún modo. Porque esto es, de alguna forma, el primer modo, en el que las personas descubren su propio potencial como actores y descubren su propia capacidad. Diciendo: "¿quién es esa persona en el espejo? oh, en realidad soy yo".

And so, to give an example, this is a project from last year, which is called the Interstitial Fragment Processor. And it allows people to explore the negative shapes that they create when they're just going about their everyday business. So as people make shapes with their hands or their heads and so forth, or with each other, these shapes literally produce sounds and drop out of thin air -- basically taking what's often this, kind of, unseen space, or this undetected space, and making it something real, that people then can appreciate and become creative with. So again, people discover their creative agency in this way. And their own personalities come out in totally unique ways.

Y así, para dar un ejemplo, este es un proyecto del año pasado. Que se llama Procesador de Fragmentos Intersticiales. Y permite que las personas exploren las formas negativas que crean cuando realizan simplemente sus asuntos cotidianos. Así como la gente hace formas con sus manos o con sus cabezas y sucesivamente, o con otros, estas formas literalmente producen sonidos y una salida de aire ligero. Básicamente tomando, lo que es frecuentemente, este tipo de espacio invisible o no detectado, y haciéndolo real, las personas lo pueden notar y se pueden volver creativas con él. Así que, nuevamente, las personas descubren su capacidad creativa de esta manera. Y sus propias personalidades salen a flote de formas totalmente únicas.

So in addition to using full-body input, something that I've explored now, for a while, has been the use of the voice, which is an immensely expressive system for us, vocalizing. Song is one of our oldest ways of making ourselves heard and understood. And I came across this fantastic research by Wolfgang Köhler, the so-called father of gestalt psychology, from 1927, who submitted to an audience like yourselves the following two shapes. And he said one of them is called Maluma. And one of them is called Taketa. Which is which? Anyone want to hazard a guess? Maluma is on top. Yeah. So. As he says here, most people answer without any hesitation.

Entonces además de utilizar todo el cuerpo como entrada, algo que he explorado desde hace un tiempo ha sido el uso de la voz. Lo que es un sistema inmensamente expresivo para nosotros, vocalizar. La canción es una de las formas más viejas de hacernos escuchar y entender. Y entonces me crucé con esta fantástica investigación de Wolfgang Köhler, el llamado padre de la psicología gestalt, desde 1927, que envió a una audiencia como ustedes las siguientes dos formas. Y dijo que una de ellas se llama Maluma. y la otra se llama Taketa. ¿Cuál es cuál? ¿Alguien se arriesga a responder? Maluma está arriba. Sí. Entonces. Como el dice aquí, la mayoría de la gente responde sin vacilar.

So what we're really seeing here is a phenomenon called phonaesthesia, which is a kind of synesthesia that all of you have. And so, whereas Dr. Oliver Sacks has talked about how perhaps one person in a million actually has true synesthesia, where they hear colors or taste shapes, and things like this, phonaesthesia is something we can all experience to some extent. It's about mappings between different perceptual domains, like hardness, sharpness, brightness and darkness, and the phonemes that we're able to speak with.

Así que lo que estamos viendo aquí en realidad es un fenómeno llamado fonestesia que es un tipo de sinestesia que todos ustedes tienen. Y entonces, mientras que el Dr. Oliver Sacks ha hablado acerca de cómo, quizás una persona en un millón realmente tiene sinestesia, y escuchan colores o prueban formas, y cosas como éstas la fonestesia es algo que todos podemos experimentar hasta cierto punto. Se trata de mapeos entre ciertos dominios perceptuales, como dureza, nitidez, brillo y oscuridad, y los fonemas con lo que podemos hablar.

So 70 years on, there's been some research where cognitive psychologists have actually sussed out the extent to which, you know, L, M and B are more associated with shapes that look like this, and P, T and K are perhaps more associated with shapes like this. And here we suddenly begin to have a mapping between curvature that we can exploit numerically, a relative mapping between curvature and shape.

Así que en 70 años, ha habido alguna investigación en la que los psicólogos cognitivos han dilucidado en realidad el punto al cual, uno sabe que L, M y B están asociados con formas que lucen así, y P, T y K están quizá más asociadas con formas que lucen así. y aquí de repente empezamos a tener un mapeo entre la curvatura que podemos explotar numéricamente, un mapeo relativo entre curvatura y [discurso].

So it occurred to me, what happens if we could run these backwards? And thus was born the project called Remark, which is a collaboration with Zachary Lieberman and the Ars Electronica Futurelab. And this is an interactive installation which presents the fiction that speech casts visible shadows. So the idea is you step into a kind of a magic light. And as you do, you see the shadows of your own speech. And they sort of fly away, out of your head. If a computer speech recognition system is able to recognize what you're saying, then it spells it out. And if it isn't then it produces a shape which is very phonaesthetically tightly coupled to the sounds you made. So let's bring up a video of that.

Entonces se me ocurrió, ¿qué pasaría si pudiéramos hacerlo al revés? y entonces nació el proyecto llamado Remark. que es una colaboración con Zachary Lieberman y Ars Electronica Futurelab. y ésta es una instalación interactiva que presenta la ficción de que el discurso arroja sombras invisibles. Así que la idea es que usted entre en una especie de luz mágica y mientras lo hace, vea las sombras de su propio discurso. y como que vuelan, fuera de su cabeza. Si un sistema de reconocimiento computarizado puede reconocer lo que está diciendo, entonces lo pronuncia. Y si no, produce una forma que es muy fonestésica muy acoplada a los sonidos que usted hace. Entonces veamos un video de eso.

(Applause)

(Aplausos)

Thanks. So. And this project here, I was working with the great abstract vocalist, Jaap Blonk. And he is a world expert in performing "The Ursonate," which is a half-an-hour nonsense poem by Kurt Schwitters, written in the 1920s, which is half an hour of very highly patterned nonsense. And it's almost impossible to perform. But Jaap is one of the world experts in performing it. And in this project we've developed a form of intelligent real-time subtitles. So these are our live subtitles, that are being produced by a computer that knows the text of "The Ursonate" -- fortunately Jaap does too, very well -- and it is delivering that text at the same time as Jaap is. So all the text you're going to see is real-time generated by the computer, visualizing what he's doing with his voice. Here you can see the set-up where there is a screen with the subtitles behind him. Okay. So ... (Applause) The full videos are online if you are interested.

Gracias. Entonces, en este proyecto estaba trabajando con el gran vocalista abstracto, Jaap Blonk. Y él es un experto mundial interpretando "La Ursonata" que es un poema sin sentido de media hora de Kurt Schwitters, escrito en los años 20. Que es media hora de un sinsentido con un patrón. y es casi imposible de interpretar. Pero Japp es uno de los expertos mundiales en interpretarlo. y en este proyecto desarrollamos una forma de subtítulos inteligentes en tiempo real. Entonces esos son nuestros subtítulos en vivo, que están siendo producidos por un computador que sabe el texto de "La Ursonata", afortunadamente Japp también, muy bien. Y está llevando el texto al mismo tiempo que Jaap. Así que todo el texto que van a ver está generado en tiempo real por la computadora. visualizando lo que él hace con su voz. Aquí uno puede ver el montaje en donde hay una pantalla con subtítulos detrás de él. Ok, entonces... (Aplausos) Todos los videos están en línea si están interesados.

I got a split reaction to that during the live performance, because there is some people who understand live subtitles are a kind of an oxymoron, because usually there is someone making them afterwards. And then a bunch of people who were like, "What's the big deal? I see subtitles all the time on television." You know? They don't imagine the person in the booth, typing it all.

Tengo una reacción dividida a eso durante la interpretación en vivo. Porque hay algunas personas que entenderían los subtítulos en vivo como una especie de oxímoron. Porque usualmente hay alguien haciéndolos después. Y luego un grupo de gente que estaba como "¿cuál es el punto? Veo subtítulos todo el tiempo en televisión". ¿Saben? Ellos no se imaginan la persona en la cabina, escribiendo todo.

So in addition to the full body, and in addition to the voice, another thing that I've been really interested in, most recently, is the use of the eyes, or the gaze, in terms of how people relate to each other. It's a really profound amount of nonverbal information that's communicated with the eyes. And it's one of the most interesting technical challenges that's very currently active in the computer sciences: being able to have a camera that can understand, from a fairly big distance away, how these little tiny balls are actually pointing in one way or another to reveal what you're interested in, and where your attention is directed. So there is a lot of emotional communication that happens there.

Entonces, adicional a todo el cuerpo, y adicional a la voz, otra cosa en la que me he interesado mucho, más recientemente, es el uso de ojos, o la mirada fija, en términos de cómo la gente se relaciona entre sí. Es una cantidad realmente profunda de información no verbal que se comunica con los ojos. Y es uno de los restos técnicos más interesantes que está recientemente muy activa en la ciencia de computadores. Ser capaz de tener una cámara que puede entender desde una distancia bastante lejana, cómo esas pequeñas bolas están actualmente dirigiéndose de uno u otro modo, para revelar en que está interesado, y hacia dónde se dirige su atención. Entonces está ocurriendo allí mucha comunicación emocional.

And so I've been beginning, with a variety of different projects, to understand how people can relate to machines with their eyes. And basically to ask the questions: What if art was aware that we were looking at it? How could it respond, in a way, to acknowledge or subvert the fact that we're looking at it? And what could it do if it could look back at us? And so those are the questions that are happening in the next projects.

Y he empezado una variedad de proyectos diferentes para entender cómo la gente se puede relacionar con las máquinas con los ojos. Y básicamente para hacer las preguntas, ¿Qué tal si el arte supiera que lo estamos observando? ¿Cómo respondería, de algún modo, reconocer o revertir el hecho de que lo estamos mirando? ¿Y qué tal si nos pudiera observar de vuelta? Esas son las preguntas que están surgiendo en los próximos proyectos.

In the first one which I'm going to show you, called Eyecode, it's a piece of interactive software in which, if we read this little circle, "the trace left by the looking of the previous observer looks at the trace left by the looking of previous observer." The idea is that it's an image wholly constructed from its own history of being viewed by different people in an installation. So let me just switch over so we can do the live demo. So let's run this and see if it works.

El primero, que les voy a mostrar, llamado "Eyecode", es una pieza de software interactivo en la que, si leemos este pequeño círculo, "la señal que deja al mirar al observador previo mira a la señal que deja mirar al observador previo". La idea es que es una imagen completamente construida de su propia historia de ser vista por diferentes personas en una instalación. Déjenme cambiar para que podamos ver la demostración en vivo. Corramos esto y veamos si funciona.

Okay. Ah, there is lots of nice bright video. There is just a little test screen that shows that it's working. And what I'm just going to do is -- I'm going to hide that. And you can see here that what it's doing is it's recording my eyes every time I blink. Hello? And I can ... hello ... okay. And no matter where I am, what's really going on here is that it's an eye-tracking system that tries to locate my eyes. And if I get really far away I'm blurry. You know, you're going to have these kind of blurry spots like this that maybe only resemble eyes in a very very abstract way. But if I come up really close and stare directly at the camera on this laptop then you'll see these nice crisp eyes.

Ok, Ah, hay mucho de buen video. Hay tan sólo una pruebita a la pantalla que muestra que está funcionando. Y lo que voy a hacer ahora es esconder eso. Y pueden ver aquí lo que está haciendo Está grabando mis ojos cada vez que parpadeo. Hola? Y puedo... hola...ok. Y no importa dónde esté, lo que está ocurriendo aquí en verdad es que es un sistema rastreador de ojos que trata de localizar mis ojos. Y si estoy muy lejos, soy borroso Saben, van a tener este tipo de manchas borrosas que quizá sólo se parecen a ojos de una forma muy, muy abstracta Pero si me acerco mucho y miro directamente a la cámara en este portátil, entonces verán estos dulces ojos frescos.

You can think of it as a way of, sort of, typing, with your eyes. And what you're typing are recordings of your eyes as you're looking at other peoples' eyes. So each person is looking at the looking of everyone else before them. And this exists in larger installations where there are thousands and thousands of eyes that people could be staring at, as you see who's looking at the people looking at the people looking before them. So I'll just add a couple more. Blink. Blink. And you can see, just once again, how it's sort of finding my eyes and doing its best to estimate when it's blinking. Alright. Let's leave that. So that's this kind of recursive observation system. (Applause) Thank you.

Pueden pensar en esto como una forma de, como, escribir, con los ojos. Y lo que están escribiendo son registros de sus ojos mientras ven a los ojos de otros. Así cada persona está mirando la mirada de alguien más antes de ellos. y existe en instalaciones más grandes en donde hay miles y miles de ojos a los que la gente puede estar mirando. mientras ven quién está mirando a la gente mirando a la gente mirando antes de ellos. Agregaré un par más. Parpadeo. Parpadeo. Y pueden ver, una vez más, cómo está como tratando de encontrar mis ojos y haciendo lo mejor para estimar cuando están parpadeando. Bueno. Dejémoslo ahí. Es como un tipo de observación recursiva. (Aplausos) Gracias.

The last couple pieces I'm going to show are basically in the new realm of robotics -- for me, new for me. It's called Opto-Isolator. And I'm going to show a video of the older version of it, which is just a minute long. Okay. In this case, the Opto-Isolator is blinking in response to one's own blinks. So it blinks one second after you do. This is a device which is intended to reduce the phenomenon of gaze down to the simplest possible materials. Just one eye, looking at you, and eliminating everything else about a face, but just to consider gaze in an isolated way as a kind of, as an element. And at the same time, it attempts to engage in what you might call familiar psycho-social gaze behaviors. Like looking away if you look at it too long because it gets shy, or things like that.

El último par de piezas que voy a mostrar está básicamente en el nuevo reino de la robótica, para mí, nuevo para mí. Se llama el opto-aislante. Y voy a mostrar un video de la versión más antigua. que sólo es de un minuto. Ok. En este caso, el opto-aislante está parpadeando en respuesta a los parpadeos de uno mismo. Entonces parpadea un segundo después de que uno lo hace. Es un dispositivo que busca reducir el fenómeno de mirar profundo a los materiales más sencillos posibles. Sólo un ojo, mirándolo, y eliminando todo lo demás de una cara. Pero para considerar la mirada fija de forma aislada como una especie de elemento. Y al mismo tiempo, intenta involucrarse en lo que podrían llamar comportamientos familiares de mirada psicosocial. Como mirar a lo lejos si lo miran mucho porque se pone tímido. O cosas así.

Okay. So the last project I'm going to show is this new one called Snout. (Laughter) It's an eight-foot snout, with a googly eye. (Laughter) And inside it's got an 800-pound robot arm that I borrowed, (Laughter) from a friend. (Laughter) It helps to have good friends. I'm at Carnegie Mellon; we've got a great Robotics Institute there. I'd like to show you thing called Snout, which is -- The idea behind this project is to make a robot that appears as if it's continually surprised to see you. (Laughter) The idea is that basically -- if it's constantly like "Huh? ... Huh?" That's why its other name is Doubletaker, Taker of Doubles. It's always kind of doing a double take: "What?" And the idea is basically, can it look at you and make you feel as if like, "What? Is it my shoes?" "Got something on my hair?" Here we go. Alright.

Ok. El último proyecto que voy a mostrar es este nuevo llamado Hocico. (Risas) Es un hocico de 2,5 metros, con un ojo falso. (Risas) Y dentro tiene un robot de 360 kilos que conseguí prestado, (Risas) de un amigo. (Risas) Ayuda tener buenos amigos. Estoy en Carnegie Mellon. Tenemos un gran Instituto de Robótica allí. Me gustaría mostrarles la cosa llamada Hocico, que es... La idea detrás del proyecto es hacer un robot que parezca continuamente sorprendido de verlos. (Risas) La idea es que básicamente... si está constantemente como "¿Ehh? ... ¿Ehh?" Por eso el otro nombre es "Doubletaker", tomador de dobles. Siempre está haciendo una toma doble: "¿Qué?" Y la idea es básicamente, los puede mirar y hacerlos sentir como si, "¿Qué? ¿son mis zapatos? "¿tengo algo en el pelo?" Aquí vamos. Bien.

Checking him out ... For you nerds, here's a little behind-the-scenes. It's got a computer vision system, and it tries to look at the people who are moving around the most. Those are its targets. Up there is the skeleton, which is actually what it's trying to do. It's really about trying to create a novel body language for a new creature. Hollywood does this all the time, of course. But also have the body language communicate something to the person who is looking at it. This language is communicating that it is surprised to see you, and it's interested in looking at you.

Mirándolo... Para ustedes nerds, aquí un poco detrás de escenas, Tiene un sistema de visión computarizada y trata de mirar a la gente que se mueve más. Ésos son sus blancos. Arriba está el esqueleto, que es en realidad lo que está tratando de hacer. Se trata en verdad de crear un nuevo lenguaje corporal para una nueva criatura. Hollywood lo hace todo el tiempo, por supuesto. Pero también el lenguaje corporal comunica algo a la persona que lo está mirando. Este lenguaje está comunicando que está sorprendido de verlos, y está interesado en verlos.

(Laughter)

(Risas)

(Applause)

(Aplausos)

Thank you very much. That's all I've got for today. And I'm really happy to be here. Thank you so much.

Muchas gracias. Eso es todo lo que tengo para hoy. Y estoy muy feliz de estar aquí. Muchas gracias.

(Applause)

(Aplausos)