Ever since I was a little girl seeing "Star Wars" for the first time, I've been fascinated by this idea of personal robots. And as a little girl, I loved the idea of a robot that interacted with us much more like a helpful, trusted sidekick -- something that would delight us, enrich our lives and help us save a galaxy or two. I knew robots like that didn't really exist, but I knew I wanted to build them.

어릴적 "스타워즈"를 처음 봤던 이후로 계속 저는 개인용 로봇의 아이디어에 매료되었습니다. 그리고 어린 소녀로서, 우리와 소통하고, 매우 유용하며 믿을 수 있는 친구 같은 로봇의 아이디어를 너무 좋아했습니다. 그런 것이 우리를 즐겁게 만들고, 우리 삶을 풍요롭게 하며, 우리가 은하계 한두개를 구할 수 있도록 도와줍니다. 그런 로봇이 실제로 존재하지 않는다는건 알았지만, 제가 그것을 만들어 보고 싶어 한다는 걸 깨달았습니다.

So 20 years pass -- I am now a graduate student at MIT studying artificial intelligence, the year is 1997, and NASA has just landed the first robot on Mars. But robots are still not in our home, ironically. And I remember thinking about all the reasons why that was the case. But one really struck me. Robotics had really been about interacting with things, not with people -- certainly not in a social way that would be natural for us and would really help people accept robots into our daily lives. For me, that was the white space; that's what robots could not do yet. And so that year, I started to build this robot, Kismet, the world's first social robot. Three years later -- a lot of programming, working with other graduate students in the lab -- Kismet was ready to start interacting with people.

20년이 지났습니다. 저는 이제 인공지능을 연구하고 있는 MIT 대학원생입니다. 1997년은 나사가 화성에 첫 로봇을 착륙시킨 해였습니다. 하지만 아이러니하게도 로봇은 아직 우리들의 집에는 없습니다. 그리고 왜 그것이 문제인가의 모든 이유들에 대해서 생각한 것을 기억합니다. 그러다 갑자기 떠오른 생각이 있었습니다. 로봇공학은 사물들과의 상호작용에 대한 것이지, 인간과의 상호작용에 관한게 아니었습니다. 우리에게 자연스럽고, 사람들이 로봇을 우리의 일상에 로봇을 받아들이도록 하는 사회적 방법은 확실히 아니었습니다. 제게 그것은 빈칸이었고, 로봇이 아직까지 할 수 없는 것이었습니다. 그래서 그 해, 저는 세계 최초의 사회적 로봇인 이 키즈맷을 만들기 시작했습니다. 3년 후에, 수 많은 프로그래밍과 연구실에 있는 다른 대학원생들과의 협업을 통해 키즈맷은 사람들과 상호소통을 시작할 준비가 되었습니다.

(Video) Scientist: I want to show you something.

(영상) 과학자: 뭔가 보여줄게.

Kismet: (Nonsense)

키즈맷: (아무 의미 없는 말)

Scientist: This is a watch that my girlfriend gave me.

과학자: 내 여자친구가 준 시계야.

Kismet: (Nonsense)

키즈맷: (아무 의미 없는 말)

Scientist: Yeah, look, it's got a little blue light in it too. I almost lost it this week.

과학자: 그래, 봐봐, 파란 불빛도 나온다. 이번 주에 잃어버릴뻔 했어.

Cynthia Breazeal: So Kismet interacted with people like kind of a non-verbal child or pre-verbal child, which I assume was fitting because it was really the first of its kind. It didn't speak language, but it didn't matter. This little robot was somehow able to tap into something deeply social within us -- and with that, the promise of an entirely new way we could interact with robots.

신시아 브리질: 자, 키즈맷은 정말 최초의 형태였기 때문에 말을 시작하기 전의 아이처럼 사람과 상호소통하는 것이 어울린다고 생각했습니다. 언어를 말하지 못했지만 문제되지 않았습니다. 이 작은 로봇은 어떻게든 우리 내부의 깊이 사회적인 것에 다가설 수 있었습니다. 그리고 그것이 우리가 로봇과 상호소통할 수 있다는 완전히 새로운 방식의 가능성입니다.

So over the past several years I've been continuing to explore this interpersonal dimension of robots, now at the media lab with my own team of incredibly talented students. And one of my favorite robots is Leonardo. We developed Leonardo in collaboration with Stan Winston Studio. And so I want to show you a special moment for me of Leo. This is Matt Berlin interacting with Leo, introducing Leo to a new object. And because it's new, Leo doesn't really know what to make of it. But sort of like us, he can actually learn about it from watching Matt's reaction.

그래서 지난 몇 년 동안, 미디어 랩에서, 매우 재능있는 학생들로 이루어진 제 팀과 함께 로봇의 이런 대인관계적 측면을 계속해서 탐구해왔습니다. 제가 제일 좋아하는 로봇은 레오나르도입니다. 우리는 스탠 윈스톤 스튜디오와 협력하여 레오나르도를 개발했습니다. 여러분께 레오나르도와 관련해 제게 특별했던 순간을 보여드리고 싶습니다. 이 사람은 레오와 상호소통하고 레오에게 새로운 것을 소개하는 맷 베를린입니다. 새로운 걸 소개했기 때문에, 레오는 무엇을 해야할지 전혀 모릅니다. 하지만 우리와 유사하게, 레오는 맷의 반응을 관찰하여 학습할 수 있습니다.

(Video) Matt Berlin: Hello, Leo. Leo, this is Cookie Monster. Can you find Cookie Monster? Leo, Cookie Monster is very bad. He's very bad, Leo. Cookie Monster is very, very bad. He's a scary monster. He wants to get your cookies.

(영상) 맷 베를린: 안녕, 레오. 레오, 이것은 쿠키 몬스터야. 쿠키 몬스터를 찾을 수 있겠어? 레오, 쿠키 몬스터는 매우 나빠. 아주 나쁘지, 레오. 쿠키 몬스터는 아주 아주 나빠. 무시무시한 괴물이지. 그건 네 쿠키를 뺏어가고 싶어해.

(Laughter)

(웃음)

CB: All right, so Leo and Cookie might have gotten off to a little bit of a rough start, but they get along great now.

CB: 좋습니다. 그래서 레오와 쿠키는 첫 만남이 조금은 힘들게 시작한 것 같지만, 지금은 아주 잘 지내고 있습니다.

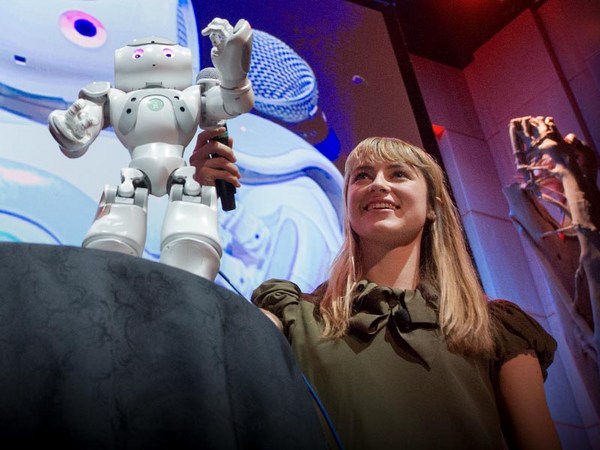

So what I've learned through building these systems is that robots are actually a really intriguing social technology, where it's actually their ability to push our social buttons and to interact with us like a partner that is a core part of their functionality. And with that shift in thinking, we can now start to imagine new questions, new possibilities for robots that we might not have thought about otherwise. But what do I mean when I say "push our social buttons?" Well, one of the things that we've learned is that, if we design these robots to communicate with us using the same body language, the same sort of non-verbal cues that people use -- like Nexi, our humanoid robot, is doing here -- what we find is that people respond to robots a lot like they respond to people. People use these cues to determine things like how persuasive someone is, how likable, how engaging, how trustworthy. It turns out it's the same for robots.

자, 제가 이 시스템을 개발하면서 배운 것은, 로봇이 실제로 매우 흥미로운 사회적 기술이라는 것입니다. 실제로 우리의 사회적 버튼을 누르고 우리와 파트너처럼 상호소통 하는 로봇의 능력은 로봇 기능의 핵심 부분입니다. 그리고 그 생각의 변화로, 우리는 이제 달리 생각 못해 봤었을지도 모를 로봇에 대한 새로운 문제와 새로운 가능성을 상상할 수 있습니다. 제가 "사회적 버튼을 누른다"고 했을 때 무엇을 의미하는 것일까요? 자, 우리가 배워온 것들 중 하나는 우리가 동일한 바디 랭귀지와 사람들이 사용하는 동일한 비언어적 신호를 사용하여 우리와 의사소통하도록 이 로봇들을 디자인 한다면, -- 여기 작동하고 있는 휴머노이드 로봇 넥시 같이 말입니다. -- 우리가 발견한 것은 사람들이 사람들에게 반응하는 것과 매우 유사하게 로봇에게 반응한다는 것입니다. 사람들은 누군가가 얼마나 설득력 있고, 얼마나 호감이 가는지, 얼마나 매력적인가, 얼마나 신뢰할 수 있을지를 결정하기 위해서 이 신호를 이용합니다. 로봇에게도 동일하다는 것이 나타나고 있습니다.

It's turning out now that robots are actually becoming a really interesting new scientific tool to understand human behavior. To answer questions like, how is it that, from a brief encounter, we're able to make an estimate of how trustworthy another person is? Mimicry's believed to play a role, but how? Is it the mimicking of particular gestures that matters? It turns out it's really hard to learn this or understand this from watching people because when we interact we do all of these cues automatically. We can't carefully control them because they're subconscious for us. But with the robot, you can.

로봇이 인간의 행위를 이해하는데 사실 정말 흥미로운 새 과학적 도구가 되고 있음이 지금 나타나고 있습니다. 그런 질문에 답을 하기 위해서, 짧은 만남에서 다른 사람을 얼마나 신뢰할 수 있을지 어떻게 평가할 수 있을까요? 흉내는 것을 통해서라고 여겨집니다. 하지만 어떻게요? 중요한 특정 동작을 흉내내는 것일까요? 사람들을 관찰하는 것에서 이를 학습하거나 이해하는 것은 정말 어려운 일입니다. 우리가 상호소통할 때, 신호들을 무의식적으로 실행하기 때문입니다. 잠재의식적인 것이기 때문에, 우리는 그것들을 세심하게 통제할 수 없습니다. 하지만 로봇으로는 가능합니다.

And so in this video here -- this is a video taken from David DeSteno's lab at Northeastern University. He's a psychologist we've been collaborating with. There's actually a scientist carefully controlling Nexi's cues to be able to study this question. And the bottom line is -- the reason why this works is because it turns out people just behave like people even when interacting with a robot. So given that key insight, we can now start to imagine new kinds of applications for robots. For instance, if robots do respond to our non-verbal cues, maybe they would be a cool, new communication technology. So imagine this: What about a robot accessory for your cellphone? You call your friend, she puts her handset in a robot, and, bam! You're a MeBot -- you can make eye contact, you can talk with your friends, you can move around, you can gesture -- maybe the next best thing to really being there, or is it?

여기 보시는 영상에서, 이 영상은 노스이스턴 대학, 데이비드 데스테노의 연구실에서 찍은 영상입니다. 그는 우리가 함께 일했던 심리학자입니다. 이 질문을 연구할 수 있도록 넥시의 신호를 주의 깊게 조절했던 과학자가 실제로 있습니다. 그리고 결국, 이런 일을 하는 이유는 사람들이 로봇과 상호소통할 때도 사람인 것처럼 행동한다는 것을 밝혀내기 때문입니다. 그래서 핵심 견해를 고려해볼 때, 우리는 이제 새로운 방식의 로봇 활용을 상상할 수 있습니다. 예를 들어, 로봇이 우리의 비언어적 신호에 반응한다면, 멋지고 새로운 의사소통 기술이 될 것입니다. 자, 이것을 상상해보세요. 여러분 휴대폰을 위한 로봇 악세사리는 어떤가요? 여러분은 친구에게 전화를 합니다. 그녀는 송수화기를 로봇에 올려 놓습니다. 그리고 짠! 여러분은 이제 '미봇'입니다. 여러분은 시선을 맞출 수도 있고, 친구들과 대화를 나눌 수도 있습니다. 돌아다니고, 몸짓을 할 수도 있습니다. 아마도 실제 그 자리에 같이 있는 것 다음으로 좋은 것이 아닐까요?

To explore this question, my student, Siggy Adalgeirsson, did a study where we brought human participants, people, into our lab to do a collaborative task with a remote collaborator. The task involved things like looking at a set of objects on the table, discussing them in terms of their importance and relevance to performing a certain task -- this ended up being a survival task -- and then rating them in terms of how valuable and important they thought they were. The remote collaborator was an experimenter from our group who used one of three different technologies to interact with the participants. The first was just the screen. This is just like video conferencing today. The next was to add mobility -- so, have the screen on a mobile base. This is like, if you're familiar with any of the telepresence robots today -- this is mirroring that situation. And then the fully expressive MeBot.

이 질문을 탐구하기 위해서 제 학생인 '시기 아댈기어슨'은 원격의 협력자와 협업을 할 수 있도록 연구실로 데려온 참여자들을 연구했습니다. 그 과제는 탁자 위에 놓인 일련의 물체들을 바라보고, 그것의 중요성과 특정 작업 수행과의 관련성에 대해 토론하며, -- 이것은 서바이벌 과제가 되었습니다. -- 그들이 그 물체들이 얼마나 가치있고 중요하다고 생각하는지에 대한 등급을 매기는 것을 포함합니다. 원격 협력자는 참가자들과 상호작용하기 위해 세 가지의 다른 기술 중 하나를 사용하는 저희 그룹의 실험자들이었습니다. 첫 번째 기술은 그냥 화면입니다. 이것은 오늘날의 비디오 화상회의와 유사합니다. 다음 기술은 이동성을 더하는 것입니다. 화면을 모바일 기반으로 만듭니다. 여러분이 오늘날의 텔레프레전스 로봇 같은 것에 익숙하다면, 이것은 그 환경을 반영하고 있습니다. 그리고 나서 아주 표현적인 미봇이 있습니다.

So after the interaction, we asked people to rate their quality of interaction with the technology, with a remote collaborator through this technology, in a number of different ways. We looked at psychological involvement -- how much empathy did you feel for the other person? We looked at overall engagement. We looked at their desire to cooperate. And this is what we see when they use just the screen. It turns out, when you add mobility -- the ability to roll around the table -- you get a little more of a boost. And you get even more of a boost when you add the full expression. So it seems like this physical, social embodiment actually really makes a difference.

그래서 상호작용 후에, 우리는 사람들에게 기술과, 원격 협력자와의 상호작용 품질을 평가하도록 요청합니다. 다른 사람에게 얼마나 공감을 느꼈는지 심리적 관여를 살펴봅니다. 우리는 전반적인 참여를 살펴봅니다. 그들이 협력하고자 하는 욕구를 살펴봅니다. 이것이 화면만을 사용할 때 확인한 것입니다. 이동성을 더했을 때, --테이블 이리저리로 이동할 수 있는 능력이죠.-- 조금 더 증가하는 것을 볼 수 있습니다. 그리고 충분한 표현력을 더했을 때, 더 증가하게 되죠. 그래서 물리적인 사회적 체현이 실제로 차이를 만드는 것 같습니다.

Now let's try to put this into a little bit of context. Today we know that families are living further and further apart, and that definitely takes a toll on family relationships and family bonds over distance. For me, I have three young boys, and I want them to have a really good relationship with their grandparents. But my parents live thousands of miles away, so they just don't get to see each other that often. We try Skype, we try phone calls, but my boys are little -- they don't really want to talk; they want to play. So I love the idea of thinking about robots as a new kind of distance-play technology. I imagine a time not too far from now -- my mom can go to her computer, open up a browser and jack into a little robot. And as grandma-bot, she can now play, really play, with my sons, with her grandsons, in the real world with his real toys. I could imagine grandmothers being able to do social-plays with their granddaughters, with their friends, and to be able to share all kinds of other activities around the house, like sharing a bedtime story. And through this technology, being able to be an active participant in their grandchildren's lives in a way that's not possible today.

이제, 이것을 약간의 맥략에 대입해보기로 하죠. 오늘날 가족들이 서로 멀리 떨어져 살고 있고, 그것이 가족 관계에 큰 타격을 주고 있으며, 가족의 결속은 멀어지고 있다는 것을 알고 있습니다. 저는 아들 셋이 있습니다. 그리고 저는 아이들이 할아버지, 할머니와 정말 좋은 관계를 가지기 원합니다. 하지만 우리 부모님은 수 천 마일을 떨어져 살고 계시고, 그래서 서로 자주 보지 못하게 되죠. 우리는 스카이프나 전화를 이용하지만, 제 아이들은 어려서 대화를 하기 보다는 그냥 놀기를 바라죠. 아이들은 새로운 종류의 원거리 놀이 기술로서 로봇에 대해 생각하는 아이디어를 좋아합니다. 자, 저는 멀지 않을 미래를 상상합니다. 저희 어머니는 컴퓨터로 가서 브라우저를 열고, 작은 로봇에 접속할 수 있습니다. 그리고 할머니-봇으로서 그녀는 손자들과 함께 손자의 실제 장난감을 가지고 실제 세상에서 같이 놀 수 있습니다. 저는 손녀딸이나 친구들과 함께 사회적 놀이를 할 수 있고, 잠 잘 때의 동화를 나누는 것 같이 온갖 집에서의 다른 활동들을 나눌 수 있는 할머니들을 상상할 수 있습니다. 그리고 이 기술을 통해서, 오늘날에는 가능하지 않은 방식으로 그들 손자들의 삶에 적극적인 참여자가 될 수 있습니다.

Let's think about some other domains, like maybe health. So in the United States today, over 65 percent of people are either overweight or obese, and now it's a big problem with our children as well. And we know that as you get older in life, if you're obese when you're younger, that can lead to chronic diseases that not only reduce your quality of life, but are a tremendous economic burden on our health care system. But if robots can be engaging, if we like to cooperate with robots, if robots are persuasive, maybe a robot can help you maintain a diet and exercise program, maybe they can help you manage your weight. Sort of like a digital Jiminy -- as in the well-known fairy tale -- a kind of friendly, supportive presence that's always there to be able to help you make the right decision in the right way at the right time to help you form healthy habits. So we actually explored this idea in our lab.

건강과 같은 다른 영역들에 대해서도 생각해보도록 하죠. 오늘날 미국에서는, 65% 이상의 사람들이 과체중이거나 비만이고, 이제 우리 아이들에게도 큰 문제입니다. 그리고 여러분이 어릴 때 비만이었다면, 어릴 때 비만이었다면, 우리 삶의 질을 감소시킬 뿐만 아니라 우리의 건강관리 시스템에 엄청난 경제적 부담이 되는 만성 질병으로 이어질 수 있다는 것을 알고 있습니다. 하지만 로봇이 매력적이라면, 우리가 로봇과 협력하기는걸 좋아한다면, 로봇이 설득력을 발휘할 수 있다면, 아마도 로봇은 여러분이 다이어트와 운동을 유지하도록, 체중을 관리하도록 도울 수 있을 것입니다. 일종의 디지털 지미니 같이, -- 유명한 동화에서 처럼 말이죠. -- 옳은 방법, 적절한 시간에 옳은 결정을 내리도록, 여러분이 건강한 습관을 만들도록 도와줄 수 있게 언제나 그곳에 있는 우호적으로 도와주는 존재입니다. 우리는 실제로 우리 실험실에서 이 아이디어를 탐구했습니다.

This is a robot, Autom. Cory Kidd developed this robot for his doctoral work. And it was designed to be a robot diet-and-exercise coach. It had a couple of simple non-verbal skills it could do. It could make eye contact with you. It could share information looking down at a screen. You'd use a screen interface to enter information, like how many calories you ate that day, how much exercise you got. And then it could help track that for you. And the robot spoke with a synthetic voice to engage you in a coaching dialogue modeled after trainers and patients and so forth. And it would build a working alliance with you through that dialogue. It could help you set goals and track your progress, and it would help motivate you.

이 로봇은 오톰입니다. 코리 키드가 박사학위 작품으로 이 로봇을 개발했습니다. 이 로봇은 다이어트와 운동 코치로 디자인 되었습니다. 그것은 몇 가지 단순한 비언어적 기능을 가지고 있습니다. 여러분과 눈을 맞출 수도 있고, 화면에 내려다 보는 정보를 공유할 수도 있습니다. 여러분은 그 날 섭취한 칼로리가 얼마인지, 운동량은 얼마나 되는지 같은 정보를 입력하는 화면 인터페이스를 사용할 것입니다. 그리고 나서 여러분을 위해 그 정보를 추척하도록 해줍니다. 그리고 로봇은 여러분이 트레이너와 환자 등을 모델로 삼아 구성된 코칭 문답에 참여하도록 합성된 음성으로 말합니다. 그리고 그 문답을 통해 여러분과 기본적인 협조를 이룰 것입니다. 목표를 설정하고, 그 과정을 추적하도록 도울 수 있으며, 여러분에게 동기를 부여할 것입니다.

So an interesting question is, does the social embodiment really matter? Does it matter that it's a robot? Is it really just the quality of advice and information that matters? To explore that question, we did a study in the Boston area where we put one of three interventions in people's homes for a period of several weeks. One case was the robot you saw there, Autom. Another was a computer that ran the same touch-screen interface, ran exactly the same dialogues. The quality of advice was identical. And the third was just a pen and paper log, because that's the standard intervention you typically get when you start a diet-and-exercise program.

흥미로운 질문은 다음과 같습니다. 사회적 체현이 정말 중요할까요? 로봇이라는 것이 중요할까요? 권고와 정보의 질이 정말 중요할까요? 그 문제를 풀기 위해서, 몇 주 동안 보스턴 지역에서 여러 가정에 세 가지 중 하나의 개입 방법을 적용해봤습니다. 하나의 경우가 여러분이 봤던 로봇, 오톰입니다. 또 다른 하나는 동일한 터치 스크린 인터페이스를 갖추고, 동일한 문답이 나타나는 컴퓨터였습니다. 권고의 질은 동일했습니다. 세 번째는 그냥 펜과 종이 기록이었습니다. 여러분이 다이어트와 운동 프로그램을 시작할 때, 그것이 전형적으로 얻게 되는 표준 간섭이기 때문입니다.

So one of the things we really wanted to look at was not how much weight people lost, but really how long they interacted with the robot. Because the challenge is not losing weight, it's actually keeping it off. And the longer you could interact with one of these interventions, well that's indicative, potentially, of longer-term success. So the first thing I want to look at is how long, how long did people interact with these systems. It turns out that people interacted with the robot significantly more, even though the quality of the advice was identical to the computer. When it asked people to rate it on terms of the quality of the working alliance, people rated the robot higher and they trusted the robot more. (Laughter) And when you look at emotional engagement, it was completely different. People would name the robots. They would dress the robots. (Laughter) And even when we would come up to pick up the robots at the end of the study, they would come out to the car and say good-bye to the robots. They didn't do this with a computer.

우리가 진짜 살펴보기 원했던 것 중 하나는 사람들이 얼마나 체중을 줄였는가가 아니라, 얼마나 오랫동안 로봇과 상호작용 하는가였습니다. 과제는 체중을 줄이는 것이 아니라 비만을 방지하는 것입니다. 그리고 이 조정 중 하나와 오랫동안 상호작용하면 할 수록, 더 긴 기간의 성공이 잠재적으로 나타납니다. 그래서 제가 살펴보기 원한 첫 번째 것은 사람들이 얼마나 오랫동안 이 시스템과 상호작용 하는가입니다. 권고의 질이 컴퓨터와 동일했음에도 불구하고 사람들은 로봇과 더 많이 상호작용 했음이 밝혀졌습니다. 기본적인 협조의 질에 대해서 평가하도록 요청받았을 때, 사람들은 로봇에 더 높은 점수를 줬고, 로봇을 더 신뢰했습니다. (웃음) 그리고 여러분이 감정적 참여를 살펴볼 때, 그것은 완전히 다릅니다. 사람들은 로봇에 이름을 붙일 것입니다. 로봇에 옷도 입힐 것이구요. (웃음) 심지어 연구가 종류되고, 로봇 수거를 위해 사람들을 방문할 때, 그들은 자동차까지 나와서 로봇에서 작별 인사를 할 것입니다. 컴퓨터에게는 그렇게 하지 않았죠.

The last thing I want to talk about today is the future of children's media. We know that kids spend a lot of time behind screens today, whether it's television or computer games or whatnot. My sons, they love the screen. They love the screen. But I want them to play; as a mom, I want them to play, like, real-world play. And so I have a new project in my group I wanted to present to you today called Playtime Computing that's really trying to think about how we can take what's so engaging about digital media and literally bring it off the screen into the real world of the child, where it can take on many of the properties of real-world play. So here's the first exploration of this idea, where characters can be physical or virtual, and where the digital content can literally come off the screen into the world and back. I like to think of this as the Atari Pong of this blended-reality play.

오늘 마지막으로 말씀드리고 싶은 것은 아이들이 사용하는 매체의 미래입니다. 오늘날 아이들은 그것이 텔레비전이던 컴퓨터 게임이던 뭐든간에 수 많은 시간을 화면 뒤에서 보내고 있다는 것을 우리는 알고 있습니다. 제 아들들은 화면을 좋아합니다. 화면을 정말 좋아하죠. 하지만 엄마로서 저는 아이들이 현실 세계의 놀이와 같이 놀기를 바랍니다. 그래서 저는 오늘 여러분께 보여드리고 싶은, '플레이타임 컴퓨팅'이라는 새로운 프로젝트가 있습니다. 그것은 디지털 미디어에 대해 무엇이 매력적인가와 그것을 문자 그대로 화면에서 꺼내 아이들의 현실 세계로 가져오는 것을 생각하려는 것입니다. 그것은 현실 세계 놀이의 많은 특성들을 적용할 수 있습니다. 여기 이 아이디어의 첫 번째 탐구가 있습니다. 캐릭터가 물리적 또는 가상적으로 존재할 수 있고, 디지털 콘텐츠가 문자 그대로 화면에서 현실로 빠져나왔다 다시 들어갈 수 있습니다. 저는 이 혼합된 현실 게임을 '아타리 퐁'으로 생각하고 싶습니다.

But we can push this idea further. What if -- (Game) Nathan: Here it comes. Yay! CB: -- the character itself could come into your world? It turns out that kids love it when the character becomes real and enters into their world. And when it's in their world, they can relate to it and play with it in a way that's fundamentally different from how they play with it on the screen. Another important idea is this notion of persistence of character across realities. So changes that children make in the real world need to translate to the virtual world. So here, Nathan has changed the letter A to the number 2. You can imagine maybe these symbols give the characters special powers when it goes into the virtual world. So they are now sending the character back into that world. And now it's got number power.

하지만 우리는 이 아이디어를 좀더 진행해볼 수 있습니다. 만일 (게임) 네이슨: 여기 간다. 야호! CB: 캐릭터 자체가 여러분의 실제 세상으로 나온다면 어떨까요? 캐릭터가 현실이 되고 그들의 세상으로 나올 때, 아이들이 너무 좋아한다는 것입니다. 그리고 그것이 그들의 세상에 있을 때, 아이들은 그것과 관계를 형성하고, 함께 놉니다. 그것은 화면으로 노는 것과는 근본적으로 다릅니다. 또 다른 중요한 아이디어는 현실을 가로질러 캐릭터가 지속하는 개념입니다. 그래서 현실 세상에서 아이들이 만들어 내는 변화는 가상 세계로 옮겨져야할 필요가 있습니다. 자 여기서, 네이슨은 문자 A를 숫자 2로 바꿨습니다. 이런 심볼들이 가상 세계로 갈 때, 캐릭터들에게 특별한 능력을 부여한다고 상상할 수 있을 것입니다. 자, 아이들은 이제 캐릭터를 가상 세계로 돌려보냅니다. 그리고 그것은 숫자의 능력을 얻었습니다.

And then finally, what I've been trying to do here is create a really immersive experience for kids, where they really feel like they are part of that story, a part of that experience. And I really want to spark their imaginations the way mine was sparked as a little girl watching "Star Wars." But I want to do more than that. I actually want them to create those experiences. I want them to be able to literally build their imagination into these experiences and make them their own. So we've been exploring a lot of ideas in telepresence and mixed reality to literally allow kids to project their ideas into this space where other kids can interact with them and build upon them. I really want to come up with new ways of children's media that foster creativity and learning and innovation. I think that's very, very important.

그리고 나서 마지막으로, 여기서 시도한 것은 아이들이 그 이야기, 그 경험의 일부분이 된 것처럼 느끼는, 둘러 싸는 듯한 경험을 창조하는 것입니다. "스타워즈"를 보는 작은 소녀로 제 상상력이 일깨워졌던 것처럼, 아이들의 상상력을 정말 일깨우고 싶습니다. 하지만 저는 그것보다 더 나아가고 싶습니다. 저는 사실 그들이 그 경험들을 창조하기 원합니다. 저는 그들이 문자 그대로 그들의 상상력을 이 경험들로 만들어낼 수 있고, 그들만의 것으로 만들 수 있기를 원합니다. 자, 저는 아이들이 그들의 생각을 다른 아이들과 상호작용하며 구축할 수 있는 공간에 투영할 수 있도록 만드는 텔레프레전스와 혼합된 현실에서의 수 많은 아이디어를 탐구해왔습니다. 저는 창조성, 학습, 혁신을 기를 수 있는 어린이 매체의 새로운 방식을 제시하고 싶습니다. 저는 그것이 아주 아주 중요하다고 생각합니다.

So this is a new project. We've invited a lot of kids into this space, and they think it's pretty cool. But I can tell you, the thing that they love the most is the robot. What they care about is the robot. Robots touch something deeply human within us. And so whether they're helping us to become creative and innovative, or whether they're helping us to feel more deeply connected despite distance, or whether they are our trusted sidekick who's helping us attain our personal goals in becoming our highest and best selves, for me, robots are all about people.

자, 이것은 새로운 프로젝트입니다. 우리는 수 많은 아이들을 여기로 초대했고, 아이들은 그게 아주 멋지다고 생각하죠. 하지만 저는 그들이 제일 좋아하는 것이 로봇이라고 말할 수 있습니다. 그들이 관심을 가지는 것은 로봇입니다. 로봇은 우리 안에 깊이 존재하는 인간적인 것을 어루만집니다. 그리고 로봇이 우리가 창조적이고 혁신적이 되도록 하던지 우리가 거리에도 불구하고 보다 깊이 연결되었다고 느끼도록 하던지, 우리가 최고와 최선의 자아가 되는데 있어 우리의 개인적 목표들을 성취할 수 있도록 돕는 신뢰할 수 있는 친구가 되던지 간에, 제게는 로봇이 사람들에게 최고입니다.

Thank you.

감사합니다.

(Applause)

(박수)