Algorithms are everywhere. They sort and separate the winners from the losers. The winners get the job or a good credit card offer. The losers don't even get an interview or they pay more for insurance. We're being scored with secret formulas that we don't understand that often don't have systems of appeal. That begs the question: What if the algorithms are wrong?

Algoritmer finns överallt. De sorterar ut vinnarna från förlorarna. Vinnarna får jobbet eller ett bra kreditkortserbjudande. Förlorarna får inte ens en intervju eller så får de en dyrare försäkring. Vi poängsätts av hemliga formler som vi inte förstår och som oftast inte går att överklaga. Det väcker frågan: Tänk om algoritmerna har fel?

To build an algorithm you need two things: you need data, what happened in the past, and a definition of success, the thing you're looking for and often hoping for. You train an algorithm by looking, figuring out. The algorithm figures out what is associated with success. What situation leads to success?

För att bygga en algoritm krävs två saker: man behöver data, vad har hänt tidigare, och en definition av framgång, det man letar efter och ofta hoppas på. Man lär en algoritm genom att titta och fundera. Algoritmen räknar ut vad som associeras med framgång. Vilken situation leder till framgång?

Actually, everyone uses algorithms. They just don't formalize them in written code. Let me give you an example. I use an algorithm every day to make a meal for my family. The data I use is the ingredients in my kitchen, the time I have, the ambition I have, and I curate that data. I don't count those little packages of ramen noodles as food.

Faktum är att alla använder algoritmer. De formulerar dem bara inte i skriftlig kod. Låt mig ge ett exempel. Jag använder en algoritm varje dag för att laga mat. Datan jag använder är ingredienserna jag har hemma, den tid jag har på mig, min ambitionsnivå, och jag granskar den datan. Jag räknar inte småpåsarna med nudlar som mat.

(Laughter)

(Skratt)

My definition of success is: a meal is successful if my kids eat vegetables. It's very different from if my youngest son were in charge. He'd say success is if he gets to eat lots of Nutella. But I get to choose success. I am in charge. My opinion matters. That's the first rule of algorithms.

Min definition av framgång är: En måltid är lyckad om barnen äter grönsakerna. Den skiljer sig ifrån min yngste sons definition. Han skulle säga att framgång är om han får äta mycket Nutella. Men jag definierar vad framgången är. Jag bestämmer. Mina åsikter har betydelse. Det här är den första regeln för en algoritm.

Algorithms are opinions embedded in code. It's really different from what you think most people think of algorithms. They think algorithms are objective and true and scientific. That's a marketing trick. It's also a marketing trick to intimidate you with algorithms, to make you trust and fear algorithms because you trust and fear mathematics. A lot can go wrong when we put blind faith in big data.

Algoritmer är åsikter inbäddade i kod. Det är stor skillnad mot vad man tror att folk tror om algoritmer. Folk tror att algoritmer är objektiva, sanna och vetenskapligt underbyggda. Det är ett marknadsföringstrick. Det är också ett marknadsföringstrick för att skrämma dig med algoritmer, få dig att lita på och frukta algoritmerna eftersom du litar på och fruktar matematik. Mycket kan gå fel när vi tror blint på big data.

This is Kiri Soares. She's a high school principal in Brooklyn. In 2011, she told me her teachers were being scored with a complex, secret algorithm called the "value-added model." I told her, "Well, figure out what the formula is, show it to me. I'm going to explain it to you." She said, "Well, I tried to get the formula, but my Department of Education contact told me it was math and I wouldn't understand it."

Det här är Kiri Soares. Hon är gymnasierektor i Brooklyn. 2011 berättade hon att hennes lärare poängsattes med en komplicerad, hemlig algoritm som kallades "mervärdesmodellen." Jag sade, "Fundera ut vilken formeln är, och visa mig den. Jag ska förklara den för dig." Hon svarade,"Jag försökte få fram formeln, men min kontakt på skolmyndigheten sade att det var matte och att jag inte skulle förstå."

It gets worse. The New York Post filed a Freedom of Information Act request, got all the teachers' names and all their scores and they published them as an act of teacher-shaming. When I tried to get the formulas, the source code, through the same means, I was told I couldn't. I was denied. I later found out that nobody in New York City had access to that formula. No one understood it. Then someone really smart got involved, Gary Rubinstein. He found 665 teachers from that New York Post data that actually had two scores. That could happen if they were teaching seventh grade math and eighth grade math. He decided to plot them. Each dot represents a teacher.

Det blir värre. New York Post krävde ut resultatet med stöd av lagen om informationsfrihet, fick alla lärares namn och poäng och publicerade det för att skämma ut lärarna. När jag försökte få tag i formlerna, källkoden, på samma vis, fick jag höra att det inte gick. Jag nekades. Senare upptäckte jag att ingen i New York hade tillgång till formeln. Ingen förstod den. Sedan blev någon som var riktigt smart inblandad, Gary Rubenstein. Han upptäckte att 665 lärare i New York Posts reportage egentligen hade två resultat. Det kunde hända om de undervisade både sjunde- och åttondeklassare i matematik. Han gjorde ett diagram. Varje prick representerar en lärare.

(Laughter)

(Skratt)

What is that?

Vad är det här?

(Laughter)

(Skratt)

That should never have been used for individual assessment. It's almost a random number generator.

Det här skulle aldrig ha använts för individuella bedömningar. Det är nästan som en slumpgenerator.

(Applause)

(Applåder)

But it was. This is Sarah Wysocki. She got fired, along with 205 other teachers, from the Washington, DC school district, even though she had great recommendations from her principal and the parents of her kids.

Men det gjordes. Detta är Sarah Wysocki. Hon och 205 andra lärare fick sparken, från Washington DCs skoldistrikt, trots att hon hade strålande omdömen från sin rektor och elevernas föräldrar.

I know what a lot of you guys are thinking, especially the data scientists, the AI experts here. You're thinking, "Well, I would never make an algorithm that inconsistent." But algorithms can go wrong, even have deeply destructive effects with good intentions. And whereas an airplane that's designed badly crashes to the earth and everyone sees it, an algorithm designed badly can go on for a long time, silently wreaking havoc.

Jag vet vad många av er tänker nu, särskilt dataanalytikerna, AI-experterna här inne. Ni tänker, "Jag skulle aldrig skriva en sådan inkonsekvent algoritm." Men algoritmer kan bli fel, till och med ha djupt destruktiva effekter även om intentionerna är goda. Medan ett illa konstruerat flygplan kraschar och alla kan se det, kan en illa skriven algoritm användas under lång tid, och i tysthet skapa kaos.

This is Roger Ailes.

Det här är Roger Ailes.

(Laughter)

(Skratt)

He founded Fox News in 1996. More than 20 women complained about sexual harassment. They said they weren't allowed to succeed at Fox News. He was ousted last year, but we've seen recently that the problems have persisted. That begs the question: What should Fox News do to turn over another leaf?

Han grundade Fox News 1996. Fler än tjugo kvinnor anmälde sexuella trakasserier. De menade att de inte tilläts att lyckas på Fox News. Han fick sparken förra året, men nyligen såg vi att problemen har fortsatt. Det leder oss in på frågan: Vad ska Fox News göra för att vända blad?

Well, what if they replaced their hiring process with a machine-learning algorithm? That sounds good, right? Think about it. The data, what would the data be? A reasonable choice would be the last 21 years of applications to Fox News. Reasonable. What about the definition of success? Reasonable choice would be, well, who is successful at Fox News? I guess someone who, say, stayed there for four years and was promoted at least once. Sounds reasonable. And then the algorithm would be trained. It would be trained to look for people to learn what led to success, what kind of applications historically led to success by that definition. Now think about what would happen if we applied that to a current pool of applicants. It would filter out women because they do not look like people who were successful in the past.

Tänk om de bytte ut sin anställningsprocess med en maskininlärningsalgoritm? Det låter väl bra? Fundera på det. Data, vilken data skulle användas? Ett rimligt val skulle vara de senaste 21 årens ansökningar till Fox News. Det låter rimligt. Hur skulle framgång definieras? Ett rimligt val vore, ja, vem är framgångsrik på Fox News? Jag gissar på någon som, låt säga, stannat där i fyra år och befordrats minst en gång. Det låter rimligt. Därefter skulle algoritmen tränas. Den skulle tränas i att hitta personer för att lära sig vad som lett till framgång, vilken typ av ansökningar som historiskt lett till framgång utifrån den definitionen. Fundera nu på vad som skulle hända om vi applicerade det här på jobbsökare idag. Den skulle välja bort kvinnor för de liknar inte personer som varit framgångsrika historiskt.

Algorithms don't make things fair if you just blithely, blindly apply algorithms. They don't make things fair. They repeat our past practices, our patterns. They automate the status quo. That would be great if we had a perfect world, but we don't. And I'll add that most companies don't have embarrassing lawsuits, but the data scientists in those companies are told to follow the data, to focus on accuracy. Think about what that means. Because we all have bias, it means they could be codifying sexism or any other kind of bigotry.

Algoritmer gör inte saker rättvisa om man tillämpar dem tanklöst och blint. De skapar inte rättvisa. De repeterar det vi gjort tidigare, våra mönster. De automatiserar rådande läge. Det skulle vara toppen om världen vore perfekt, men det är den inte. Och jag kan tillägga att de flesta företag inte har blivit stämda, men dataanalytikerna i de här företagen är ålagda att använda datan, för att få tillförlitliga resultat. Fundera på vad det betyder. Eftersom vi alla har fördomar, betyder det att de skulle kunna koda in sexism eller något annat trångsynt.

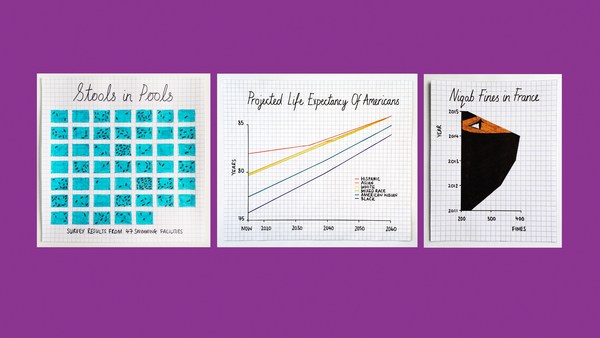

Thought experiment, because I like them: an entirely segregated society -- racially segregated, all towns, all neighborhoods and where we send the police only to the minority neighborhoods to look for crime. The arrest data would be very biased. What if, on top of that, we found the data scientists and paid the data scientists to predict where the next crime would occur? Minority neighborhood. Or to predict who the next criminal would be? A minority. The data scientists would brag about how great and how accurate their model would be, and they'd be right.

Ett tankeexperiment, eftersom jag gillar såna: Tänk er ett helt segregerat samhälle - rassegregerat, i alla städer, i alla områden och där vi bara skickar polisen till minoritetsområdena för brottsbekämpning. Arresteringarna skulle vara väldigt fördomsfulla. Tänk om, till råga på allt, vi fann dataanalytikerna och betalade dem för att tala om var nästa brott skulle ske? I minoritetsområdena. Eller förutspå vem nästa brottsling är? Någon från en minoritet. Dataanalytikerna skulle skryta om hur bra och tillförlitlig deras modell skulle vara, och de skulle ha rätt.

Now, reality isn't that drastic, but we do have severe segregations in many cities and towns, and we have plenty of evidence of biased policing and justice system data. And we actually do predict hotspots, places where crimes will occur. And we do predict, in fact, the individual criminality, the criminality of individuals. The news organization ProPublica recently looked into one of those "recidivism risk" algorithms, as they're called, being used in Florida during sentencing by judges. Bernard, on the left, the black man, was scored a 10 out of 10. Dylan, on the right, 3 out of 10. 10 out of 10, high risk. 3 out of 10, low risk. They were both brought in for drug possession. They both had records, but Dylan had a felony but Bernard didn't. This matters, because the higher score you are, the more likely you're being given a longer sentence.

Nu är verkligheten inte så drastisk, men vi har allvarlig segregation i många städer och områden, och vi har gott om bevis om fördomsfullt polisarbete och skev straffrättslig data. Vi förutspår faktiskt hotspots, platser där brott kan ske. Faktum är, att vi förutspår individers kriminalitet, individers brottsbenägenhet. Nyhetsorganisationen ProPublica undersökte för en tid sedan en av algoritmerna för "återfallsrisk", som de kallas, och som används i Florida när domar ska avkunnas. Bernard, mannen till vänster, fick 10 poäng av 10 möjliga. Dylan, till höger, 3 poäng av 10 möjliga. 10 av 10, hög risk. 3 av 10, låg risk. Båda anhölls för droginnehav. Båda var dömda tidigare, men Dylan hade begått ett grovt brott vilket Bernard inte hade. Det här har betydelse, för ju högre poäng man har, desto troligare är det att man får ett längre straff.

What's going on? Data laundering. It's a process by which technologists hide ugly truths inside black box algorithms and call them objective; call them meritocratic. When they're secret, important and destructive, I've coined a term for these algorithms: "weapons of math destruction."

Vad är det som händer? Datatvätt. Det är en process där tekniker gömmer fula sanningar inuti automatiska algoritmer som de kallar objektiva; kallar meritokratiska. När de är hemliga, viktiga och destruktiva, myntade jag ett begrepp för dem: "matte-förstörelsevapen."

(Laughter)

(Skratt)

(Applause)

(Applåder)

They're everywhere, and it's not a mistake. These are private companies building private algorithms for private ends. Even the ones I talked about for teachers and the public police, those were built by private companies and sold to the government institutions. They call it their "secret sauce" -- that's why they can't tell us about it. It's also private power. They are profiting for wielding the authority of the inscrutable. Now you might think, since all this stuff is private and there's competition, maybe the free market will solve this problem. It won't. There's a lot of money to be made in unfairness.

De finns överallt, och det är inte ett misstag. Det här är privata företag som skapar privata algoritmer för privata syften. Även de för lärare och poliser som jag pratat om, byggdes av privata företag och såldes till statliga myndigheter. De kallar dem "hemliga recept" - det är därför de inte kan berätta om dem. Det är också privat makt. De skor sig genom att utöva sin ogenomträngliga makt. Nu kanske du tänker att eftersom allt det här är privat och fri konkurrens råder, kommer marknaden kanske lösa problemen. Det gör den inte. Det finns mycket pengar att tjäna på orättvisa.

Also, we're not economic rational agents. We all are biased. We're all racist and bigoted in ways that we wish we weren't, in ways that we don't even know. We know this, though, in aggregate, because sociologists have consistently demonstrated this with these experiments they build, where they send a bunch of applications to jobs out, equally qualified but some have white-sounding names and some have black-sounding names, and it's always disappointing, the results -- always.

Dessutom, är vi inte ekonomiskt rationella varelser. Alla har vi fördomar. Alla är vi rasister och bigotta på sätt som vi önskar att vi inte var, på sätt vi inte ens vet att vi är. Det här vet vi dock, eftersom sociologer konsekvent visat det genom olika expriment, där de skickar jobbansökningar, alla lika kvalificerade men några har "vita" namn och några har "svarta" namn, och resultaten är alltid en besvikelse - alltid.

So we are the ones that are biased, and we are injecting those biases into the algorithms by choosing what data to collect, like I chose not to think about ramen noodles -- I decided it was irrelevant. But by trusting the data that's actually picking up on past practices and by choosing the definition of success, how can we expect the algorithms to emerge unscathed? We can't. We have to check them. We have to check them for fairness.

Vi är alltså de som är fördomsfulla, och vi lägger in fördomarna i algoritmerna genom att välja datan vi samlar in, så som jag valde att inte ta med japanska nudlar. Jag bestämde att de var oviktiga. Men genom att lita på data som bygger på tidigare erfarenheter och välja definitionen av framgång, hur kan vi då förvänta oss att algoritmerna är harmlösa? Det kan vi inte. Vi måste kontrollera dem. Vi måste kolla att de är rättvisa.

The good news is, we can check them for fairness. Algorithms can be interrogated, and they will tell us the truth every time. And we can fix them. We can make them better. I call this an algorithmic audit, and I'll walk you through it.

Den goda nyheten är att vi kan kolla rättvisan i dem. Algoritmer kan ifrågasättas, och de talar om sanningen varenda gång. Vi kan rätta till dem. Vi kan förbättra dem. Jag kallar det för revision av algoritmer, och jag ska förklara.

First, data integrity check. For the recidivism risk algorithm I talked about, a data integrity check would mean we'd have to come to terms with the fact that in the US, whites and blacks smoke pot at the same rate but blacks are far more likely to be arrested -- four or five times more likely, depending on the area. What is that bias looking like in other crime categories, and how do we account for it?

Först, integritetskontroll av datat. För algoritmen för återfallsrisk som jag pratade om, skulle en integritetstest betyda att vi behöver ta tag i det faktum att i USA, röker vita och svarta maruijana i samma utsträckning men svarta löper större risk att arresteras - fyra till fem gånger högre risk beroende på område. Hur ser den fördomen ut i andra brottskategorier och hur hanterar vi det?

Second, we should think about the definition of success, audit that. Remember -- with the hiring algorithm? We talked about it. Someone who stays for four years and is promoted once? Well, that is a successful employee, but it's also an employee that is supported by their culture. That said, also it can be quite biased. We need to separate those two things. We should look to the blind orchestra audition as an example. That's where the people auditioning are behind a sheet. What I want to think about there is the people who are listening have decided what's important and they've decided what's not important, and they're not getting distracted by that. When the blind orchestra auditions started, the number of women in orchestras went up by a factor of five.

Två, vi borde tänka över hur vi definierar framgång, granska det. Kommer ni ihåg - anställningsalgoritmen vi pratade om? Någon som stannar fyra år och befordras en gång? Ja, det är en framgångsrik person, men det är också någon som stöttas av företagskulturen. Som sagt, även det kan vara partiskt. Vi måste skilja på de här två sakerna. Vi bör titta på blindrekrytering till orkestrar som ett exempel. I en sådan är den sökande bakom en skärm. Det jag vill framhålla är att de som lyssnar har bestämt vad som är viktigt och vad som är oviktigt och de distraheras inte av det. När den här typen av rekryteringar startade, steg andelen kvinnor i orkestrarna femfalt.

Next, we have to consider accuracy. This is where the value-added model for teachers would fail immediately. No algorithm is perfect, of course, so we have to consider the errors of every algorithm. How often are there errors, and for whom does this model fail? What is the cost of that failure?

Sen måste vi överväga tillförlitligheten. Det är här mervärdesmodellen för lärare skulle misslyckas omedelbart. Självklart är ingen algoritm perfekt, så vi måste överväga felen i varje algoritm. Hur ofta förekommer fel och för vem misslyckas modellen? Vad är kostnaden för de felen?

And finally, we have to consider the long-term effects of algorithms, the feedback loops that are engendering. That sounds abstract, but imagine if Facebook engineers had considered that before they decided to show us only things that our friends had posted.

Slutligen, måste vi överväga de långsiktiga effekterna av algoritmerna, och feedbacken som de medför. Det låter abstrakt, men tänk om Facebooks ingenjörer övervägt det här innan de bestämde sig för att bara visa oss det våra vänner lagt upp.

I have two more messages, one for the data scientists out there. Data scientists: we should not be the arbiters of truth. We should be translators of ethical discussions that happen in larger society.

Jag har ytterligare två budskap, ett för dataanalytikerna där ute. Dataanalytiker: Vi bör inte vara sanningens skiljedomare. Vi bör vara översättare av de etiska diskussioner som sker i samhället i stort.

(Applause)

(Applåder)

And the rest of you, the non-data scientists: this is not a math test. This is a political fight. We need to demand accountability for our algorithmic overlords.

Och ni andra, som inte är dataanalytiker: Det här är inte ett matteprov. Det här är en politisk kamp. Vi måste kräva ansvarsskyldighet från våra algoritmiska överherrar.

(Applause)

(Applåder)

The era of blind faith in big data must end.

Tiden när vi trodde blint på big data måste få ett slut.

Thank you very much.

Tack så mycket.

(Applause)

(Applåder)