نجدُ الخوارزميات في كل مكان. إنها تُصنّفُ وتفصل الفائزين عن الخاسرين. يحصل الفائزون على الوظيفة أو على أحد عروض بطاقات الائتمان الجيّدة. بينما لا يحصل الخاسرون حتى على مقابلة عمل أو يدفعون أكثر مقابل التأمين. يتمّ تقييمنا بصيغ سرّية لا نفهمها والتي لا يمكننا استئناف أحكامها في معظم الأحيان. مما يطرح السؤال: ماذا لو كانت الخوارزميات خاطئة؟

Algorithms are everywhere. They sort and separate the winners from the losers. The winners get the job or a good credit card offer. The losers don't even get an interview or they pay more for insurance. We're being scored with secret formulas that we don't understand that often don't have systems of appeal. That begs the question: What if the algorithms are wrong?

لبناء خوارزمية فأنتم تحتاجون لشيئين: تحتاجون لبيانات، أي ما حدث في الماضي، وتحتاجون تعريفًا للنجاح، أي الأمر الذي تبحثون عنه وتأملون غالبًا إيجاده. تدرّبون الخوارزمية بالبحث أو التحديد. أي تحدّد الخوارزمية ما هو متعلق بالنجاح. أي حالة تقود إلى النجاح؟

To build an algorithm you need two things: you need data, what happened in the past, and a definition of success, the thing you're looking for and often hoping for. You train an algorithm by looking, figuring out. The algorithm figures out what is associated with success. What situation leads to success?

في الواقع، يستخدمُ كلُ شخص الخوارزميات. لكن فقط هم لا يستطيعون صياغتها على هيئة شفرات مكتوبة. دعوني أعطيكم مثالاً. أستخدمُ الخوارزميات كل يوم لأصنع وجبة غذائية لأسرتي. فالبيانات التي أستخدمها هي محتويات مطبخي، ووقتي، وطموحي، وأقوم بتنظيم هذه البيانات. لا أعتبر هذه العبوّات الصغيرة من الرامن (حساء المعكرونة) طعامًا.

Actually, everyone uses algorithms. They just don't formalize them in written code. Let me give you an example. I use an algorithm every day to make a meal for my family. The data I use is the ingredients in my kitchen, the time I have, the ambition I have, and I curate that data. I don't count those little packages of ramen noodles as food.

(ضحك)

(Laughter)

تعريفي للنجاح هو: تعتبرُ الوجبة الغذائية ناجحة إذا تناول أطفالي الخضروات. سيختلف هذا إن كان ابني الصغير هو المسؤول. سيقول أن النجاح هو إذا تناول الكثير من شوكولاتة "نوتيلا". لكن يتوجب عليّ اختيار النجاح. أنا المسؤولة. لذا فرأيي مهمّ. هذه هي أول قاعدة للخوارزميات.

My definition of success is: a meal is successful if my kids eat vegetables. It's very different from if my youngest son were in charge. He'd say success is if he gets to eat lots of Nutella. But I get to choose success. I am in charge. My opinion matters. That's the first rule of algorithms.

الخوارزميات هي آراء موضوعة في شفرات. إنها مختلفة حقًا عما يعتقده معظم الناس. إنهم يعتقدون أن الخوارزميات موضوعية وصحيحة وعلمية. إنها خدعة تسويقية. وإنها أيضًا خدعة تسويقية لتخويفكم بهذه الخوارزميات، لجعلكم تثقون في الخوارزميات وتخافونها لأنكم تثقون في الرياضيات وتخافونها. الكثير من الأمور قد تسوء عندما نضع ثقة عمياء في البيانات الضخمة.

Algorithms are opinions embedded in code. It's really different from what you think most people think of algorithms. They think algorithms are objective and true and scientific. That's a marketing trick. It's also a marketing trick to intimidate you with algorithms, to make you trust and fear algorithms because you trust and fear mathematics. A lot can go wrong when we put blind faith in big data.

هذه هي (كيري سوريس)، إنها مديرة مدرسة ثانوية في (بروكلين). في عام 2011، أخبرتني بأنه كان يتمّ تصنيف معلميها بناءً على خوارزمية سرية معقدة سمّيت "نموذج القيمة المضافة". قلت لها: "حسنًا، اكتشفي ما هي الصيغة، وأريني إياها. وسأشرحها لكِ." قالت، "حسنًا، حاولتُ الحصول على الصيغة، ولكن أخبرني شخص في وزارة التربية والتعليم أنها عبارة عن رياضيات وأنني لن أفهمها."

This is Kiri Soares. She's a high school principal in Brooklyn. In 2011, she told me her teachers were being scored with a complex, secret algorithm called the "value-added model." I told her, "Well, figure out what the formula is, show it to me. I'm going to explain it to you." She said, "Well, I tried to get the formula, but my Department of Education contact told me it was math and I wouldn't understand it."

يزدادُ الأمرُ سوءًا. قدّمت صحيفة (نيويورك بوست) "طلب قانون حماية المعلومات" وحصلت على أسماء كل المعلمين وتقييماتهم وتم نشرها على سبيل الخزي للمعلمين. عندما حاولتُ الحصول على الصيَغ والشيفرة المصدرية عبر الوسائل نفسها، قيل لي أنني لا أستطيع. تمّ رفضي. واكتشفتُ لاحقًا بأنه لم يستطع أحد في مدينة (نيويورك) الوصول إلى تلك الصيغة. لم يفهمها أحد. ثُم اهتم بالموضوع شخص ذكي حقًا، يدعى (غاري روبنشتاين). وجد أن 665 معلمًا من بيانات صحفية (نيويورك بوست) تلك لديهم في الحقيقة تقييمان. ويمكن حدوث ذلك إن كانوا يدرّسون مادة الرياضيات للصفين السابع والثامن. قرّر تمثيلهم برسم بياني. تمثلُ كل نقطة معلمًا.

It gets worse. The New York Post filed a Freedom of Information Act request, got all the teachers' names and all their scores and they published them as an act of teacher-shaming. When I tried to get the formulas, the source code, through the same means, I was told I couldn't. I was denied. I later found out that nobody in New York City had access to that formula. No one understood it. Then someone really smart got involved, Gary Rubinstein. He found 665 teachers from that New York Post data that actually had two scores. That could happen if they were teaching seventh grade math and eighth grade math. He decided to plot them. Each dot represents a teacher.

(ضحك)

(Laughter)

ما هذا؟

What is that?

(ضحك)

(Laughter)

لم يكن ينبغي استخدام ذلك على الإطلاق للتقييم الفردي. إنه تقريبًا مُولّد أرقام عشوائية.

That should never have been used for individual assessment. It's almost a random number generator.

(تصفيق)

(Applause)

ولكنه ما حدث. هذه هي (سارة ويسوكي). تمّ طردها من العمل -بالإضافة إلى 205 معلم آخر- من قطاع مدارس العاصمة (واشنطن)، مع أن لديها توصيات عظيمة من مديرتها وأولياء أمور طلابها.

But it was. This is Sarah Wysocki. She got fired, along with 205 other teachers, from the Washington, DC school district, even though she had great recommendations from her principal and the parents of her kids.

أعرفُ ما يفكرُ فيه الكثير منكم يا رفاق، خاصةً علماء البيانات وخبراء الذكاء الاصطناعي هنا. تفكّرون: "حسنًا، لم أكن لأنشئ خوارزمية غير متجانسة كهذه". ولكن يمكنُ للخوارزميات أن تفشل وتسبّبَ آثارًا مدمّرة بشدّة حتى رغم النوايا حسنة. وبينما الطائرة التي صُممت بطريقة سيئة تتحطم على الأرض ويراها الجميع، إلا أن الخوارزمية المصمّمة بطريقة سيئة يمكنُ أن تبقى لوقت طويل تعيث فسادًا في صمت.

I know what a lot of you guys are thinking, especially the data scientists, the AI experts here. You're thinking, "Well, I would never make an algorithm that inconsistent." But algorithms can go wrong, even have deeply destructive effects with good intentions. And whereas an airplane that's designed badly crashes to the earth and everyone sees it, an algorithm designed badly can go on for a long time, silently wreaking havoc.

هذا هو (روجير إيلس).

This is Roger Ailes.

(ضحك)

(Laughter)

قام بتأسيس قناة (فوكس) الإخبارية عام 1996. اشتكت أكثر من 20 امرأة من التحرش الجنسي. قلن أن ذلك أثّر عليهن فلم يستطعن النجاح في قناة (فوكس) الإخبارية. تم طرده العام الماضي، لكن رأينا مؤخرًا بأن المشاكل ما زالت مستمرة. مما يطرحُ السؤال: ما الذي ينبغي على قناة (فوكس) الإخبارية عمله لتبدأ صفحة جديدة؟

He founded Fox News in 1996. More than 20 women complained about sexual harassment. They said they weren't allowed to succeed at Fox News. He was ousted last year, but we've seen recently that the problems have persisted. That begs the question: What should Fox News do to turn over another leaf?

ماذا لو استبدلوا عملية التوظيف لديهم بخوارزمية "التعلّم الآلي"؟ يبدو هذا جيدًا، أليس كذلك؟ فكّروا في الأمر. بالنسبة للبيانات، ماذا ستكون البيانات؟ ربما طلبات التوظيف في (فوكس) الإخبارية خلال 21 سنة الأخيرة. منطقي. ماذا عن تعريف النجاح؟ سيكون الاختيار المعقول هو، من هو الناجح في قناة (فوكس) الإخبارية؟ لنقل أنه شخص بقي هناك لمدة أربع سنوات وتم ترقيته مرة واحدة على الأقل. يبدو الأمر معقولًا. وبعد ذلك سيتم تدريب الخوارزمية. سيتم تدريبها للبحث عن الأشخاص لمعرفة ما الذي أدّى إلى النجاح، ما نوع طلبات التوظيف التي أدت تاريخيًا إلى النجاح بناءً على التعريف السابق. فكّروا الآن فيما سيحدث لو طبّقنا ذلك على المجموعة الحالية من طالبي التوظيف. ستَستبعِد الخوارزمية النساء لأنهن لا يشبهن الأشخاص الذين نجحوا في الماضي.

Well, what if they replaced their hiring process with a machine-learning algorithm? That sounds good, right? Think about it. The data, what would the data be? A reasonable choice would be the last 21 years of applications to Fox News. Reasonable. What about the definition of success? Reasonable choice would be, well, who is successful at Fox News? I guess someone who, say, stayed there for four years and was promoted at least once. Sounds reasonable. And then the algorithm would be trained. It would be trained to look for people to learn what led to success, what kind of applications historically led to success by that definition. Now think about what would happen if we applied that to a current pool of applicants. It would filter out women because they do not look like people who were successful in the past.

لا تحقق الخوارزميات العدالة إن طبّقتموها على نحو أعمى وبدون تفكير. لا تجعل الأمور عادلة. تعيدُ ممارساتنا الماضية، وأنماط تصرّفاتنا. وتدير الوضع الراهن آليًّا. سيكون ذلك عظيمًا لو كان لدينا عالم مثالي، ولكن ليس لدينا. وسأضيفُ أن معظم الشركات ليس لديها شكاوي قضائية محرجة، ولكن علماء البيانات في هذه الشركات يُطلب منهم تتبّع البيانات للتركيز على الدقة. فكّروا فيما يعنيه ذلك. لأنه لدى جميعنا نزعة تحيّز، فيمكن أن يقوموا بتقنين التمييز الجنسي أو أي نوع آخر من التعصب الأعمى.

Algorithms don't make things fair if you just blithely, blindly apply algorithms. They don't make things fair. They repeat our past practices, our patterns. They automate the status quo. That would be great if we had a perfect world, but we don't. And I'll add that most companies don't have embarrassing lawsuits, but the data scientists in those companies are told to follow the data, to focus on accuracy. Think about what that means. Because we all have bias, it means they could be codifying sexism or any other kind of bigotry.

إليكم تجربة فكرية، لأني أحبهم: إن افترضنا وجود مجتمع مفصول عنصريًا بالكامل، كل بلداته وأحياؤه مفصولة على أساس عنصري وحيث أننا نرسلُ الشرطة لأحياء الأقليّات فقط للبحث عن الجريمة، فإن بيانات الاعتقال ستكون منحازة جدًا. وعلاوة على ذلك، ماذا لو وجدنا علماء البيانات ودفعنا لهم للتنبؤ بمكان الجريمة التالية؟ سيقولون أحد أحياء الأقليات. أو للتنبؤ بالمجرم التالي؟ أيضًا من الأقليات. سيتباهى علماء البيانات كم أن نموذجهم سيكون رائعًا ودقيقًا، وسيكونون محقّين بالفعل.

Thought experiment, because I like them: an entirely segregated society -- racially segregated, all towns, all neighborhoods and where we send the police only to the minority neighborhoods to look for crime. The arrest data would be very biased. What if, on top of that, we found the data scientists and paid the data scientists to predict where the next crime would occur? Minority neighborhood. Or to predict who the next criminal would be? A minority. The data scientists would brag about how great and how accurate their model would be, and they'd be right.

الآن، ليست الحقيقة بذلك التطرف، ولكن لدينا تمييز وفصل شديد في عدة مدن وبلدات ولدينا الكثير من البراهين من بيانات رجال الشرطة المتحيزة، وبيانات نظام العدالة. ونستطيع في الواقع التنبؤ بمواقع ساخنة، وأماكن حيث ستحدث الجرائم. ونستطيع التنبؤ، في الواقع، بالجريمة الفردية، جرائم الأفراد. بحثت المنظمة الإخبارية (بروبليكا) مؤخرًا أحد تلك الخوارزميات، "خطر التعرض للانتكاس" كما يطلق عليهم، تم استخدامها في ولاية (فلوريدا) أثناء إعلان الحُكم من قبل القضاة. تم تصنيف (بيرنارد)، على اليسار، الرجل الأسود، 10/10. و(ديلان)، على اليمين، 3/10. 10 من 10، الخطر الأكبر، و3 من 10، الخطر المنخفض. تم القبض على كليهما لحيازتهما المخدرات. ولدى كلاهما سجلات، ولكن لدى (ديلان) جناية بعكس (بيرنارد). هذا يهم، لأنه إذا كانت درجتكم أعلى، فستمنحون على الأرجح أحكامًا قضائية أطول.

Now, reality isn't that drastic, but we do have severe segregations in many cities and towns, and we have plenty of evidence of biased policing and justice system data. And we actually do predict hotspots, places where crimes will occur. And we do predict, in fact, the individual criminality, the criminality of individuals. The news organization ProPublica recently looked into one of those "recidivism risk" algorithms, as they're called, being used in Florida during sentencing by judges. Bernard, on the left, the black man, was scored a 10 out of 10. Dylan, on the right, 3 out of 10. 10 out of 10, high risk. 3 out of 10, low risk. They were both brought in for drug possession. They both had records, but Dylan had a felony but Bernard didn't. This matters, because the higher score you are, the more likely you're being given a longer sentence.

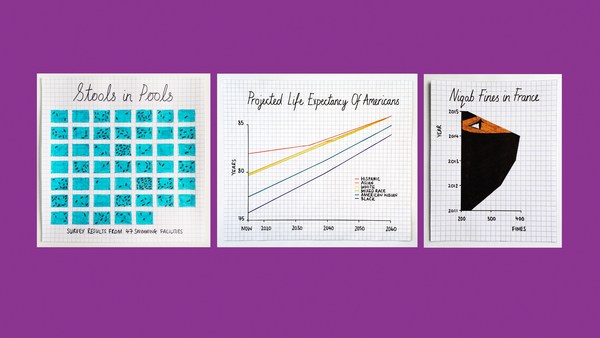

ما الذي يجري هنا؟ غسل البيانات. إنها عملية حيث يخفي التقنيون حقائق بشعة داخل خوارزميات الصندوق الأسود ويطلقون عليها موضوعية، أطلقوا عليها "الإستحقاقراطية". عندما تكون سرية، ومهمة، ومدمرة، قمتُ بصياغة مصطلح لهذه الخوارزميات: "أسلحة دمار العمليات الحسابية".

What's going on? Data laundering. It's a process by which technologists hide ugly truths inside black box algorithms and call them objective; call them meritocratic. When they're secret, important and destructive, I've coined a term for these algorithms: "weapons of math destruction."

(ضحك)

(Laughter)

(تصفيق)

(Applause)

إنها في كل مكان، وليست خطأ. هذه هي شركات خاصة تبني خوارزميات خاصة لأغراض خاصة. حتى تلك التي تحدثتُ حولها بشأن المعلمين ورجال الشرطة، تم بناء الخوارزميات من قبل شركات خاصة وتم بيعها إلى مؤســسات حكومية. يسمونها "التركيبة السرية الخاصة" -- ولهذا السبب لا يمكنهم الإفصاح عنها. إنها أيضًا سلطة خاصة. إنهم يستفيدون من الممارسة البارعة للسلطة الغامضة. قد تعتقدون الآن، ولأنّ كل هذه الامور خاصة وهناك منافسة، ربما سيعالجُ السوق الحر هذه المشكلة. لن يقوم بذلك. تُجبى كمية ضخمة من الأموال نتيجة عدم الإنصاف.

They're everywhere, and it's not a mistake. These are private companies building private algorithms for private ends. Even the ones I talked about for teachers and the public police, those were built by private companies and sold to the government institutions. They call it their "secret sauce" -- that's why they can't tell us about it. It's also private power. They are profiting for wielding the authority of the inscrutable. Now you might think, since all this stuff is private and there's competition, maybe the free market will solve this problem. It won't. There's a lot of money to be made in unfairness.

كذلك، لسنا عملاء اقتصاديون منطقيون. جميعنا منحازون. جميعنا عنصريون ومتعصبون بطرق نرغبُ بأننا لم نسلكها، بطرق حتى لا نعرفها. ورغم ذلك نعلمُ هذا، في كل الأحوال، لأن علماء الاجتماع قدّموا لنا ذلك باستمرار بهذه التجارب التي بنوها، حيثُ يرسلوا حزمة من طلبات الوظائف المطلوبة مؤهلين بالتساوي لكن لدى بعضهم أسماء تبدو لأشخاص بيض ولدى البعض أسماء تبدو لأشخاص سود ودائمًا النتائج مخيبة للآمال، دائمًا.

Also, we're not economic rational agents. We all are biased. We're all racist and bigoted in ways that we wish we weren't, in ways that we don't even know. We know this, though, in aggregate, because sociologists have consistently demonstrated this with these experiments they build, where they send a bunch of applications to jobs out, equally qualified but some have white-sounding names and some have black-sounding names, and it's always disappointing, the results -- always.

لذلك فنحن المتحيزون، ونحنُ من يضع تلك التحيزات داخل الخوارزميات باختيار ما هي البينات التي علينا جمعها، مثل ما اخترته لعدم التفكير بالشعيرية المجففة -- قررتُ بأنه ليس لها صلة بالموضوع. لكن وبالثقة بالبيانات التي هي في الواقع اختيار الممارسات الماضية واختيار تعريف النجاح، كيف يمكننا توقع ظهور الخوارزميات متكاملة؟ لا نستطيع. علينا التحقق منهم. علينا التحقق منهم من أجل الإنصاف.

So we are the ones that are biased, and we are injecting those biases into the algorithms by choosing what data to collect, like I chose not to think about ramen noodles -- I decided it was irrelevant. But by trusting the data that's actually picking up on past practices and by choosing the definition of success, how can we expect the algorithms to emerge unscathed? We can't. We have to check them. We have to check them for fairness.

الخبر السار هو، نستطيعُ التحقق منهم من أجل الإنصاف. يمكنُ فحص واستنطاق الخوارزميات، ويمكنهم قول الحقيقة كل الوقت. ويمكننا اصلاحهم. ويمكننا جعلهم أفضل. أطلقُ على هذه تدقيق الخوارزمية، وسأخبركم عنها.

The good news is, we can check them for fairness. Algorithms can be interrogated, and they will tell us the truth every time. And we can fix them. We can make them better. I call this an algorithmic audit, and I'll walk you through it.

أولاً، التحقق من نزاهة وتكامل البيانات. بالنسبة إلى خوارزمية خطر الانتكاس التي تحدثتُ عنها، ستعني التحقق من نزاهة البيانات بأنه علينا التوصل إلى تفاهم مع الواقع بأنه في أمريكا، يدخنُ الحشيشَ البيض والسود بنفس المعدل لكن يتمُ اعتقال السود على الأرجح أكثر بكثير -- أربع أو خمس مرات أكثر من البيض، اعتمادًا على المنطقة. كيف يبدو هذا التحيز في فئات الجرائم الأخرى، وكيف يمكننا حساب ذلك؟

First, data integrity check. For the recidivism risk algorithm I talked about, a data integrity check would mean we'd have to come to terms with the fact that in the US, whites and blacks smoke pot at the same rate but blacks are far more likely to be arrested -- four or five times more likely, depending on the area. What is that bias looking like in other crime categories, and how do we account for it?

ثانيًا، ينبغي علينا التفكير بتعريف النجاح، تدقيق ذلك. تذكروا، خوارزمية التوظيف، التي تحدثنا عنها. يبقى شخص ما في الوظيفة لمدة أربع سنوات ويتمُ ترقيته لمرة واحدة. حسنًا، هذا موظفُ ناجح، وإنه أيضًا موظف مدعوم من قبل التقاليد الموروثة. وذلك، يمكن أن يكون ذلك تحيزًا نحتاجُ لفصل هذين الأمرين. علينا النظر في تجربة أداء الأوركسترا العمياء كمثال. حيث يجري الأشخاص أداءهم من وراء جدار. ما أرغبُ أن أفكر فيه هنا أن من يستمع إلى هؤلاء قد قرروا ما هو المهم وما ليس مهمًا، ولم يتم ازعاجهم بأي شيء بهذا القرار. عندما بدأت تجربة أداء الأوكسترا العمياء، ارتفع عدد النساء في الأوكسترا بمقدار خمسة.

Second, we should think about the definition of success, audit that. Remember -- with the hiring algorithm? We talked about it. Someone who stays for four years and is promoted once? Well, that is a successful employee, but it's also an employee that is supported by their culture. That said, also it can be quite biased. We need to separate those two things. We should look to the blind orchestra audition as an example. That's where the people auditioning are behind a sheet. What I want to think about there is the people who are listening have decided what's important and they've decided what's not important, and they're not getting distracted by that. When the blind orchestra auditions started, the number of women in orchestras went up by a factor of five.

وبعد ذلك، علينا النظر في الدقة. وهذا هو حيث سيفشل نموذج القيمة المضافة بشأن المعلمين على الفور. لا يوجد خوارزمية مثالية، بطبيعة الحال، لذلك ينبغي علينا حساب الأخطاء في كل خوارزمية. كم مرة تتكرر هذه الأخطاء، ولمن يفشل هذا النموذج؟ وما هي تكلفة هذا الفشل؟

Next, we have to consider accuracy. This is where the value-added model for teachers would fail immediately. No algorithm is perfect, of course, so we have to consider the errors of every algorithm. How often are there errors, and for whom does this model fail? What is the cost of that failure?

وأخيرًا، علينا اعتبار الآثار طويلة الأجل للخوارزمية، ومجموعات التقييم التي تم إحداثها. يبدو ذلك نظرية مجردة، لكن تخيلوا لو أن مهندسو الفيسبوك أخذوا بعين الاعتبار ذلك قبل أن يقرروا أن يُظهروا لنا الأشياء التي ينشرها أصدقاؤنا فقط.

And finally, we have to consider the long-term effects of algorithms, the feedback loops that are engendering. That sounds abstract, but imagine if Facebook engineers had considered that before they decided to show us only things that our friends had posted.

عندي رسالتان أخريان، الأولى لعلماء البيانات الموجودن من حولنا. يا علماء البيانات: لا ينبغي علينا أن نقرر ما هي الحقيقة. علينا أن نترجم النقاشات الأخلاقية التي تحدثُ في المجتمع الأكبر. (تصفيق)

I have two more messages, one for the data scientists out there. Data scientists: we should not be the arbiters of truth. We should be translators of ethical discussions that happen in larger society. (Applause)

والبقية منكم،

And the rest of you,

من غير علماء البيانات: هذا ليس اختبار رياضيات. إنها معركة سياسية. نحتاجُ أن نطالبَ بالمساءلة لمن يضع الخوارزميات من الأسياد. (تصفيق)

the non-data scientists: this is not a math test. This is a political fight. We need to demand accountability for our algorithmic overlords. (Applause)

يجب أن ينتهي عصر الثقة العمياء في البيانات الضخمة.

The era of blind faith in big data must end.

شكرًا جزيلًا لكم.

Thank you very much.

(تصفيق)

(Applause)