I want you to imagine walking into a room, a control room with a bunch of people, a hundred people, hunched over a desk with little dials, and that that control room will shape the thoughts and feelings of a billion people. This might sound like science fiction, but this actually exists right now, today.

Vreau să vă imaginați că intrați într-o cameră, o cameră de control cu o grămadă de oameni o sută de oameni, aplecați peste un birou, cu butonașe, și că acea cameră de comandă va contura gândurile și emoțiile unui miliard de oameni. Poate vă sună SF, dar asta chiar există acum, azi.

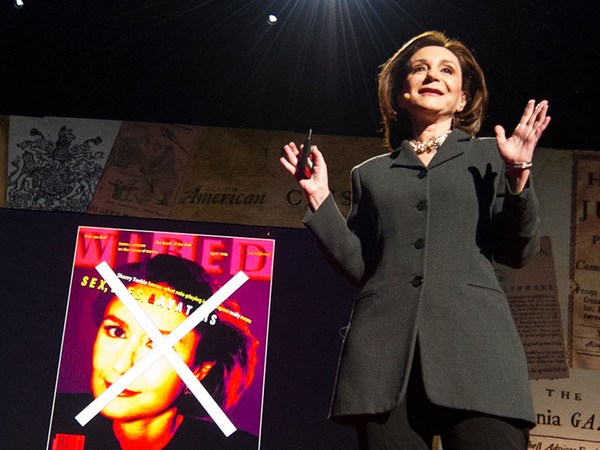

I know because I used to be in one of those control rooms. I was a design ethicist at Google, where I studied how do you ethically steer people's thoughts? Because what we don't talk about is how the handful of people working at a handful of technology companies through their choices will steer what a billion people are thinking today. Because when you pull out your phone and they design how this works or what's on the feed, it's scheduling little blocks of time in our minds. If you see a notification, it schedules you to have thoughts that maybe you didn't intend to have. If you swipe over that notification, it schedules you into spending a little bit of time getting sucked into something that maybe you didn't intend to get sucked into. When we talk about technology, we tend to talk about it as this blue sky opportunity. It could go any direction. And I want to get serious for a moment and tell you why it's going in a very specific direction. Because it's not evolving randomly. There's a hidden goal driving the direction of all of the technology we make, and that goal is the race for our attention. Because every news site, TED, elections, politicians, games, even meditation apps have to compete for one thing, which is our attention, and there's only so much of it. And the best way to get people's attention is to know how someone's mind works. And there's a whole bunch of persuasive techniques that I learned in college at a lab called the Persuasive Technology Lab to get people's attention.

Știu asta pentru că am fost și eu într-una din camerele de comandă. Am fost specialist în etica designului la Google, unde am studiat cum poți să ghidezi în mod etic gândurile oamenilor. Pentru că nu se vorbește despre cum o mână de oameni ce lucrează la câteva companii IT vor ghida, prin alegerilor lor, cum gândesc un miliard de oameni azi. Deoarece când scoateți telefonul — iar ei proiectează cum funcționează sau ce vă apare în feed, vă sunt alocate mici bucăți de timp în minte. Dacă vedeți o notificare, deja v-a programat să vă gândiți la ceva la care poate nu v-ați fi gândit. Dacă accesați o notificare, vă programează să petreceți un pic de timp absorbiți în ceva în care poate nu voiați să vă lăsați absorbit. Când vorbim despre tehnologie, tindem să vorbim de parcă ar fi o mare de oportunități. Poate duce în orice direcție. Vreau să fiu un moment serios și să vă spun de ce duce într-o anumită direcție. Pentru că nu evoluează aleatoriu. Există un scop ascuns ce determină direcția tuturor descoperirilor tehnice, iar scopul este cursa după atenție. Pentru că fiecare site nou: TED, alegeri, politicieni, jocuri, chiar și aplicații de meditație concurează pentru un singur lucru: atenția noastră, care este limitată. Iar cel mai simplu câștigi atenția oamenilor dacă știi cum le funcționează mintea. Există o mulțime de tehnici de convingere pe care le-am învățat la facultate în Laboratorul de tehnologie persuasivă prin care obții atenția oamenilor.

A simple example is YouTube. YouTube wants to maximize how much time you spend. And so what do they do? They autoplay the next video. And let's say that works really well. They're getting a little bit more of people's time. Well, if you're Netflix, you look at that and say, well, that's shrinking my market share, so I'm going to autoplay the next episode. But then if you're Facebook, you say, that's shrinking all of my market share, so now I have to autoplay all the videos in the newsfeed before waiting for you to click play. So the internet is not evolving at random. The reason it feels like it's sucking us in the way it is is because of this race for attention. We know where this is going. Technology is not neutral, and it becomes this race to the bottom of the brain stem of who can go lower to get it.

Un exemplu simplu e YouTube. YouTube vrea să maximizeze timpul petrecut pe site. Deci ce face? Dă auto-play următorului clip. Și să presupunem că merge bine. Câștigă un pic mai mult din timpul oamenilor. Păi, dacă ești Netflix, vezi asta și-ți zici: „Asta-mi ia din cota de piață, așa că dau și eu auto-play următorului episod.” Dar apoi, dacă ești Facebook, îți spui: „Asta-mi ia toată cota mea, așa că trebuie să dau auto-play clipurilor din newsfeed fără să aștept să dai play. Așadar, internetul nu evoluează aleatoriu. Simțim că ne absoarbe într-o astfel de măsură pentru că se află în cursă pentru atenție. Știm încotro ne îndreptăm. Tehnologia nu este neutră, și e o cursă să ajungi primul la baza trunchiului cerebral, cine poate coborî mai mult câștigă.

Let me give you an example of Snapchat. If you didn't know, Snapchat is the number one way that teenagers in the United States communicate. So if you're like me, and you use text messages to communicate, Snapchat is that for teenagers, and there's, like, a hundred million of them that use it. And they invented a feature called Snapstreaks, which shows the number of days in a row that two people have communicated with each other. In other words, what they just did is they gave two people something they don't want to lose. Because if you're a teenager, and you have 150 days in a row, you don't want that to go away. And so think of the little blocks of time that that schedules in kids' minds. This isn't theoretical: when kids go on vacation, it's been shown they give their passwords to up to five other friends to keep their Snapstreaks going, even when they can't do it. And they have, like, 30 of these things, and so they have to get through taking photos of just pictures or walls or ceilings just to get through their day. So it's not even like they're having real conversations. We have a temptation to think about this as, oh, they're just using Snapchat the way we used to gossip on the telephone. It's probably OK. Well, what this misses is that in the 1970s, when you were just gossiping on the telephone, there wasn't a hundred engineers on the other side of the screen who knew exactly how your psychology worked and orchestrated you into a double bind with each other.

Să vă dau exemplul Snapchat-ului. Dacă nu știți, Snapchat e principalul mijloc prin care comunică azi adolescenții din Statele Unite. Deci, dacă sunteți ca mine și comunicați prin SMS, Snapchat e SMS-ul adolescenților, și sunt vreo sută de milioane de utilizatori. Au inventat ceva numit Snapstreaks, ce arată câte zile în șir comunică doi oameni unul cu celălalt. Cu alte cuvinte, ce au făcut e să le dea oamenilor ceva ce nu vor să piardă. Pentru că dacă ești adolescent și ai vorbit 150 de zile la rând, nu vrei să pierzi asta. Gândiți-vă câte bucățele de timp sunt acaparate din mintea copiilor. Și nu e doar teoretic: când pleacă în vacanță, copiii își dau parolele prietenilor (până la cinci prieteni) ca să le continue Snapstreak-urile atunci când ei nu o pot face. Și au vreo 30 de Snapstreak-uri, așa că trebuie să primească și să trimită poze, cu pereți, cu tavane, doar ca să le treacă ziua. Deci nici măcar nu au conversații reale. Suntem tentați să ne gândim că, eh, folosesc și ei Snapchat așa cum la vârsta lor bârfeam la telefon, deci probabil e OK. Ei, problema e că în anii '70, când bârfeai doar la telefon, nu existau sute de ingineri de partea cealaltă a ecranului ce știau exact cum vă funcționează psihicul, trăgând sforile ca să vă lege de celălalt.

Now, if this is making you feel a little bit of outrage, notice that that thought just comes over you. Outrage is a really good way also of getting your attention, because we don't choose outrage. It happens to us. And if you're the Facebook newsfeed, whether you'd want to or not, you actually benefit when there's outrage. Because outrage doesn't just schedule a reaction in emotional time, space, for you. We want to share that outrage with other people. So we want to hit share and say, "Can you believe the thing that they said?" And so outrage works really well at getting attention, such that if Facebook had a choice between showing you the outrage feed and a calm newsfeed, they would want to show you the outrage feed, not because someone consciously chose that, but because that worked better at getting your attention. And the newsfeed control room is not accountable to us. It's only accountable to maximizing attention. It's also accountable, because of the business model of advertising, for anybody who can pay the most to actually walk into the control room and say, "That group over there, I want to schedule these thoughts into their minds." So you can target, you can precisely target a lie directly to the people who are most susceptible. And because this is profitable, it's only going to get worse.

Acum, dacă asta vă înfurie un pic, observați că gândul vă absoarbe. Și furia e un mod foarte bun de a vă capta atenția, pentru că nu alegi să fii furios. Ți se întâmplă. Și dacă ești newsfeed-ul Facebook, indiferent dacă vrei sau nu, ai de profitat de pe urma furiei. Pentru că furia nu se limitează la a aloca o reacție în timpul și spațiul tău emoțional. Vrei să împărtășești furia cu alții. Îți vine să dai share și să zici: „Poți să crezi ce-au zis?” Deci furia merge de minune să capteze atenția, și dacă Facebook ar avea de ales între a vă arăta un newsfeed de înfuriat și un newsfeed calm, ar dori să vi-l arate pe cel de înfuriat, nu pentru că cineva alege conștient asta, ci pentru că asta poate mai bine să vă capteze atenția. Iar camera de comandă pentru newsfeed nu răspunde în fața noastră. Răspunde doar de maximizarea atenției. Mai răspunde, din cauza modelului bazat pe publicitate, și în fața oricui plătește mai mult ca să intre în camera de comandă și să spună: „Grupul acela, vreau să bag gândurile astea în mințile lor.” Puiteți așadar ținti, puteți direcționa cu precizie o minciună direct spre oamenii care sunt cei mai susceptibili. Și pentru că asta e profitabil, o să fie și mai rău.

So I'm here today because the costs are so obvious. I don't know a more urgent problem than this, because this problem is underneath all other problems. It's not just taking away our agency to spend our attention and live the lives that we want, it's changing the way that we have our conversations, it's changing our democracy, and it's changing our ability to have the conversations and relationships we want with each other. And it affects everyone, because a billion people have one of these in their pocket.

Așa că sunt azi aici pentru că prețul plătit e evident. Nu știu să existe vreo problemă mai urgentă, pentru că asta e la baza tuturor celorlalte probleme. Nu doar că ne răpește alegerea de a ne distribui atenția și a ne trăi viața cum vrem, ci schimbă modul în care purtăm conversații, ne schimbă democrația, și schimbă abilitatea noastră de a avea conversațiile și relațiile pe care le dorim cu ceilalți. Și ne afectează pe toți, pentru că un miliard de oameni au câte o chestie de-asta în buzunar.

So how do we fix this? We need to make three radical changes to technology and to our society. The first is we need to acknowledge that we are persuadable. Once you start understanding that your mind can be scheduled into having little thoughts or little blocks of time that you didn't choose, wouldn't we want to use that understanding and protect against the way that that happens? I think we need to see ourselves fundamentally in a new way. It's almost like a new period of human history, like the Enlightenment, but almost a kind of self-aware Enlightenment, that we can be persuaded, and there might be something we want to protect. The second is we need new models and accountability systems so that as the world gets better and more and more persuasive over time -- because it's only going to get more persuasive -- that the people in those control rooms are accountable and transparent to what we want. The only form of ethical persuasion that exists is when the goals of the persuader are aligned with the goals of the persuadee. And that involves questioning big things, like the business model of advertising. Lastly, we need a design renaissance, because once you have this view of human nature, that you can steer the timelines of a billion people -- just imagine, there's people who have some desire about what they want to do and what they want to be thinking and what they want to be feeling and how they want to be informed, and we're all just tugged into these other directions. And you have a billion people just tugged into all these different directions. Well, imagine an entire design renaissance that tried to orchestrate the exact and most empowering time-well-spent way for those timelines to happen. And that would involve two things: one would be protecting against the timelines that we don't want to be experiencing, the thoughts that we wouldn't want to be happening, so that when that ding happens, not having the ding that sends us away; and the second would be empowering us to live out the timeline that we want.

Așadar cum reparăm asta? Trebuie să facem trei schimbări radicale în tehnologia și societatea noastră. Prima este să recunoaștem că putem fi convinși. Odată ce-ncepem să înțelegem că mintea poate fi programată să aibă gânduri sau bucăți de timp pe care nu noi le-am ales, nu-i așa că ne-am dori să folosim asta pentru a ne proteja de ce ni se întâmplă? Cred că avem nevoie să ne vedem într-un mod cu totul nou. E ca un fel de nouă eră a istoriei umane, ca și Iluminismul, ca o iluminare cu conștientizare de sine, să înțelegem că putem fi convinși și că sunt lucruri pe care vrem să le protejăm. A doua e că avem nevoie de noi modele și noi sisteme de responsabilitate astfel încât pe măsură ce lumea devine mai bună și mai persuasivă — pentru că va fi din ce în ce mai persuasivă, oamenii din acele camere de comandă să fie răspunzători și să respecte voința noastră. Unica formă de persuasiune etică este când scopul celui ce convinge coincide cu cel al celui convins. Și asta înseamnă o macroanaliză a modelului de afaceri bazat pe reclamă. În ultimul rând, e nevoie de Renașterea designului, deoarece, odată ce avem această perspectivă a naturii umane, cum că puteți direcționa viața unui miliard de oameni, imaginați-vă, există oameni care-și doresc ceva, știu ce vor să facă și ce vor să gândească și ce vor să simtă și cum vor să fie informați și toți suntem trași în alte direcții. Și există un miliard de oameni trași în aceste direcții. Ei, imaginați-vă o Renaștere în design ce încearcă să contureze cea mai puternică și precisă cale rapidă de a face ca toate acestea să se întâmple. Și asta ar implica două lucruri: unul ar fi să ne protejăm de direcțiile pe care nu vrem să le experimentăm, de gândurile pe care n-am vrea să le avem, ca atunci când apare notificarea, să nu fim complet acaparați, iar al doilea ar fi să ne simțim îndreptățiți să ne trăim viața cum vrem.

So let me give you a concrete example. Today, let's say your friend cancels dinner on you, and you are feeling a little bit lonely. And so what do you do in that moment? You open up Facebook. And in that moment, the designers in the control room want to schedule exactly one thing, which is to maximize how much time you spend on the screen. Now, instead, imagine if those designers created a different timeline that was the easiest way, using all of their data, to actually help you get out with the people that you care about? Just think, alleviating all loneliness in society, if that was the timeline that Facebook wanted to make possible for people. Or imagine a different conversation. Let's say you wanted to post something supercontroversial on Facebook, which is a really important thing to be able to do, to talk about controversial topics. And right now, when there's that big comment box, it's almost asking you, what key do you want to type? In other words, it's scheduling a little timeline of things you're going to continue to do on the screen. And imagine instead that there was another button there saying, what would be most time well spent for you? And you click "host a dinner." And right there underneath the item it said, "Who wants to RSVP for the dinner?" And so you'd still have a conversation about something controversial, but you'd be having it in the most empowering place on your timeline, which would be at home that night with a bunch of a friends over to talk about it. So imagine we're running, like, a find and replace on all of the timelines that are currently steering us towards more and more screen time persuasively and replacing all of those timelines with what do we want in our lives.

Să vă dau un exemplu concret. Azi, să zicem că prietenul anulează o cină cu tine, și tu te simți un pic singur. Ce faci atunci? Deschizi Facebook. Și în acel moment, designerii din camera de comandă vor să programeze un singur lucru: să maximizeze timpul pe care-l petreceți pe site. Acum, imaginați-vă cum ar fi ca acești designeri să creeze un alt timeline, care ar fi fost calea cea mai simplă, conform datelor de care dispun, să vă ajute să ieșiți cu oameni la care țineți? Gândiți-vă, ar ușura toată singurătatea din societate dacă asta ar fi ceea ce Facebook ar vrea să ofere oamenilor. Sau imaginați-vă altă conversație. Să zicem că vreți să postați ceva foarte controversat pe Facebook, și e foarte important să puteți face asta, să discutați subiecte controversate. Acum că există căsuța pentru comentarii, aproape că vă întreabă:„Ce vrei să scrii?” Cu alte cuvinte, te programează să continuați să faceți lucruri pe site. Imaginați-vă că ar exista în schimb un alt buton care ar zice: `„Cum v-ați petrece cel mai bine timpul?” Și voi alegeți: „să organizez o cină”. Și exact sub asta ar fi: „Cine vrea să confirme prezența?” Și tot ați avea o conversație pe un subiect controversat, dar de data asta în locul care vă dă vouă putere, și anume la voi acasă, seara, cu niște prieteni cu care discutați. Imaginați-vă că avem o funcție de „găsește și înlocuiește” în tot ce ne apare în timeline și ce ne direcționează spre a petrece tot mai mult timp online și dacă am înlocui asta cu ceea ce vrem să facem în viață.

It doesn't have to be this way. Instead of handicapping our attention, imagine if we used all of this data and all of this power and this new view of human nature to give us a superhuman ability to focus and a superhuman ability to put our attention to what we cared about and a superhuman ability to have the conversations that we need to have for democracy. The most complex challenges in the world require not just us to use our attention individually. They require us to use our attention and coordinate it together. Climate change is going to require that a lot of people are being able to coordinate their attention in the most empowering way together. And imagine creating a superhuman ability to do that.

Nu e musai să fie așa. În loc de a ne handicapa atenția, imaginați-vă că am folosi toate informațiile, puterea și noua viziune asupra naturii umane pentru a obține abilitatea supraomenească de a ne concentra, și abilitatea supraomenească de a ne îndrepta atenția spre ce vrem, și abilitatea supraomenească de a purta discuțiile de care avem nevoie în democrație. Cele mai complexe provocări ale omenirii necesită să folosim nu doar atenția individuală, ci atenția tuturor, coordonată. Modificările climatice necesită ca mulți oameni să își poată coordona atenția în modul cel mai eficient, împreună. Imaginați-vă că am crea abilitatea supraomenească de a o face.

Sometimes the world's most pressing and important problems are not these hypothetical future things that we could create in the future. Sometimes the most pressing problems are the ones that are right underneath our noses, the things that are already directing a billion people's thoughts. And maybe instead of getting excited about the new augmented reality and virtual reality and these cool things that could happen, which are going to be susceptible to the same race for attention, if we could fix the race for attention on the thing that's already in a billion people's pockets. Maybe instead of getting excited about the most exciting new cool fancy education apps, we could fix the way kids' minds are getting manipulated into sending empty messages back and forth.

Uneori cele mai stringente și importante probleme ale omenirii nu sunt chestii ipotetice din viitor pe care le-am putea crea în viitor. Uneori cele mai stringente probleme sunt cele care sunt fix sub nasul nostru, lucruri care deja direcționează gândurile a miliarde de oameni. Și poate că în loc să fim entuziasmați de noua realitate augmentată și realitate virtuală, și toate chestiile super ce s-ar putea întâmpla, care vor fi susceptibile și ele cursei pentru atenție, dacă am putea centra cursa pentru atenție pe chestia ce deja e în buzunarul unui miliard de oameni. Poate în loc să ne entuziasmăm despre cele mai mari și tari aplicații educaționale, am putea să reglăm cum mințile copiilor sunt manipulate să trimită mesaje fără conținut.

(Applause)

(Aplauze)

Maybe instead of worrying about hypothetical future runaway artificial intelligences that are maximizing for one goal, we could solve the runaway artificial intelligence that already exists right now, which are these newsfeeds maximizing for one thing. It's almost like instead of running away to colonize new planets, we could fix the one that we're already on.

În loc să ne îngrijorăm depre ipotetica inteligență artificială din viitor maximizată pentru un singur scop, am putea rezolva problema inteligenței artificiale ce există deja, și anume newsfeed-urile centrate pe un singur scop. E ca și cum, în loc să căutăm să colonizăm noi planete, am putea avea grijă de cea pe care trăim.

(Applause)

(Aplauze)

Solving this problem is critical infrastructure for solving every other problem. There's nothing in your life or in our collective problems that does not require our ability to put our attention where we care about. At the end of our lives, all we have is our attention and our time. What will be time well spent for ours?

Rezolvarea acestei probleme este infrastructura esențială pentru rezolvarea tuturor problemelor. Nu există nimic în viața personală ori în problemele colectivității care să nu necesite abilitatea de a ne concentra pe lucrurile la care ținem. La sfârșitul vieții, tot ce ne rămâne este atenția și timpul. Cum ne-am petrece constructiv timpul?

Thank you.

Mulțumesc.

(Applause)

(Aplauze)

Chris Anderson: Tristan, thank you. Hey, stay up here a sec. First of all, thank you. I know we asked you to do this talk on pretty short notice, and you've had quite a stressful week getting this thing together, so thank you. Some people listening might say, what you complain about is addiction, and all these people doing this stuff, for them it's actually interesting. All these design decisions have built user content that is fantastically interesting. The world's more interesting than it ever has been. What's wrong with that?

Chris Anderson: Tristan, mulțumesc. Mai rămâi un pic aici. În primul rând, mulțumim. Știu că ți-am cerut să faci prezentarea din scurt, și ai avut o săptămână stresantă pentru a pregăti asta, și-ți mulțumim. Poate unii din cei ce ascultă ar zice că tu de fapt te plângi de dependență, și că cei ce se lasă absorbiți sunt chiar interesați de subiecte. Toate deciziile de design au conturat un conținut fantastic de interesant. Lumea e mai interesantă decât oricând. Ce-o fi rău în asta?

Tristan Harris: I think it's really interesting. One way to see this is if you're just YouTube, for example, you want to always show the more interesting next video. You want to get better and better at suggesting that next video, but even if you could propose the perfect next video that everyone would want to watch, it would just be better and better at keeping you hooked on the screen. So what's missing in that equation is figuring out what our boundaries would be. You would want YouTube to know something about, say, falling asleep. The CEO of Netflix recently said, "our biggest competitors are Facebook, YouTube and sleep." And so what we need to recognize is that the human architecture is limited and that we have certain boundaries or dimensions of our lives that we want to be honored and respected, and technology could help do that.

Tristan Harris: Cred că-i foarte interesant. Ai putea să vezi asta dacă să zicem că ești YouTube, de exemplu, vrei să arăți mereu cel mai interesant video. Vrei să fii din ce în ce mai bun în a sugera următorul clip, dar chiar și dacă ai putea propune clipul perfect, pe care toți și-ar dori să-l vadă, tot ce-ar face ar fi să fie tot mai potrivit în a te ține captiv. Deci ce lipsește din ecuație este să stabilim care ar fi limitele. Ai vrea ca YouTube să știe câte ceva despre, să zicem, adormire. CEO-ul Netflix a spus de curând: „Marii noștri concurenți sunt Facebook, YouTube și somnul” Trebuie deci să recunoaștem că omul este limitat și că avem granițe și dimensiuni în viața noastră ce ar trebui onorate și respectate, iar tehnologia ar putea ajuta.

(Applause)

(Aplauze)

CA: I mean, could you make the case that part of the problem here is that we've got a naïve model of human nature? So much of this is justified in terms of human preference, where we've got these algorithms that do an amazing job of optimizing for human preference, but which preference? There's the preferences of things that we really care about when we think about them versus the preferences of what we just instinctively click on. If we could implant that more nuanced view of human nature in every design, would that be a step forward?

CA: Ai putea spune că o parte a problemei e că avem un model naiv al firii umane? Multe se justifică vorbind despre preferințele omenești, pe când avem acești algoritmi ce funcționează excelent pentru optimizarea preferințelor, dar care preferințe? Putem prefera lucrurile la care ținem cu adevărat, atunci când ne gândim, și nu preferințele lucrurilor pe care le accesăm din instinct. Dacă am putea trasa o imagine mai nuanțată a naturii umane în design, ar fi oare un pas înainte?

TH: Absolutely. I mean, I think right now it's as if all of our technology is basically only asking our lizard brain what's the best way to just impulsively get you to do the next tiniest thing with your time, instead of asking you in your life what we would be most time well spent for you? What would be the perfect timeline that might include something later, would be time well spent for you here at TED in your last day here?

TH: Absolut. Adică, cred că acum e ca și cum toată tehnologia întreabă creierul reptilian: cum pot mai simplu să te fac să acționezi impulsiv în următoarea bucățică din timpul tău? în loc să te întrebe pe tine, cum ți-ai petrece cel mai constructiv timpul? Ce ar fi optim pentru tine, ce ar putea include ceva de mai târziu? Ar fi constructiv pentru tine să-ți petreci ultima zi aici la TED?

CA: So if Facebook and Google and everyone said to us first up, "Hey, would you like us to optimize for your reflective brain or your lizard brain? You choose."

CA: Deci dacă Facebook, Google și toți ne-ar întreba întâi: „Hei, ai prefera să-ți optimizăm creierul reflectiv ori creierul reptilian? Tu alegi!”

TH: Right. That would be one way. Yes.

TH: Exact. Asta ar fi o cale. Da.

CA: You said persuadability, that's an interesting word to me because to me there's two different types of persuadability. There's the persuadability that we're trying right now of reason and thinking and making an argument, but I think you're almost talking about a different kind, a more visceral type of persuadability, of being persuaded without even knowing that you're thinking.

CA: Vorbeai de persuasibilitate, un cuvânt nou, interesant, pentru că pentru mine există două tipuri de persuasibilitate. E persuasibilitatea ce o experimentăm chiar acum, ce ține de rațiune și gândire și argumentare, dar cred că tu vorbești de un alt tip, un tip mai visceral, de a fi persuadat fără a-ți da seama că ți se întămplă.

TH: Exactly. The reason I care about this problem so much is I studied at a lab called the Persuasive Technology Lab at Stanford that taught [students how to recognize] exactly these techniques. There's conferences and workshops that teach people all these covert ways of getting people's attention and orchestrating people's lives. And it's because most people don't know that that exists that this conversation is so important.

TH: Exact. Îmi pasă atât de tare de problema asta pentru că am studiat în Laboratorul de tehnologie persuasivă la Stanford ce-i învăța pe cursanți să recunoască aceste tehnici. Există conferințe și workshopuri ce ne învață căile ascunse de a capta atenția oamenilor și de a le dirija viața. Și tocmai pentru că sunt mulți care nu știu asta, e atât de importantă această discuție.

CA: Tristan, you and I, we both know so many people from all these companies. There are actually many here in the room, and I don't know about you, but my experience of them is that there is no shortage of good intent. People want a better world. They are actually -- they really want it. And I don't think anything you're saying is that these are evil people. It's a system where there's these unintended consequences that have really got out of control --

CA: Tristan, și eu și tu știm mulți oameni din aceste companii. Mulți sunt chiar în această cameră, și nu știu de tine, dar din ce știu eu despre ei, nu le lipsesc intențiile bune. Oamenii își doresc o lume mai bună. Ei chiar - chiar și-o doresc. Și nu cred că tu vrei să spui că ei sunt oameni răi. E un sistem în care există consecințe nedorite care au scăpat de sub control

TH: Of this race for attention. It's the classic race to the bottom when you have to get attention, and it's so tense. The only way to get more is to go lower on the brain stem, to go lower into outrage, to go lower into emotion, to go lower into the lizard brain.

TH: Cursa pentru atenție. E cursa clasică până la bază, când trebuie să captezi atenția, e foarte intensă. Poți obține mai mult doar dacă mergi mai la bază, mai adânc în furie, mai adânc în emoție, mai adânc în creierul reptilian.

CA: Well, thank you so much for helping us all get a little bit wiser about this.

CA: Mulțumim mult că ne ajuți să aflăm mai multe despre asta.

Tristan Harris, thank you. TH: Thank you very much.

Tristan Harris, mulțumesc. TH: Mulțumesc mult.

(Applause)

(Aplauze)