I want you to imagine walking into a room, a control room with a bunch of people, a hundred people, hunched over a desk with little dials, and that that control room will shape the thoughts and feelings of a billion people. This might sound like science fiction, but this actually exists right now, today.

Imaginez entrer dans une salle, une salle de contrôle avec des personnes, une centaine de personnes autour d'un bureau avec des boutons et que cette salle de contrôle façonnera les pensées et émotions d'un milliard de personnes. Cela semble être de la science-fiction mais cela existe actuellement, aujourd'hui.

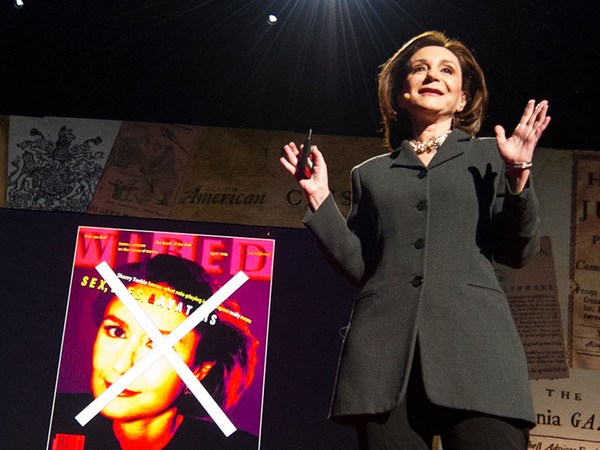

I know because I used to be in one of those control rooms. I was a design ethicist at Google, where I studied how do you ethically steer people's thoughts? Because what we don't talk about is how the handful of people working at a handful of technology companies through their choices will steer what a billion people are thinking today. Because when you pull out your phone and they design how this works or what's on the feed, it's scheduling little blocks of time in our minds. If you see a notification, it schedules you to have thoughts that maybe you didn't intend to have. If you swipe over that notification, it schedules you into spending a little bit of time getting sucked into something that maybe you didn't intend to get sucked into. When we talk about technology, we tend to talk about it as this blue sky opportunity. It could go any direction. And I want to get serious for a moment and tell you why it's going in a very specific direction. Because it's not evolving randomly. There's a hidden goal driving the direction of all of the technology we make, and that goal is the race for our attention. Because every news site, TED, elections, politicians, games, even meditation apps have to compete for one thing, which is our attention, and there's only so much of it. And the best way to get people's attention is to know how someone's mind works. And there's a whole bunch of persuasive techniques that I learned in college at a lab called the Persuasive Technology Lab to get people's attention.

Je le sais car j'étais dans une de ces salles de contrôle. J'étais déontologue en conception chez Google, où j'ai étudié comment orienter les pensées des gens de façon éthique. Nous ne parlons pas de comment les quelques personnes travaillant dans les quelques entreprises en technologie orienteront, à travers leurs choix, les pensées d'un milliard de personnes. Quand vous sortez votre téléphone et qu'ils conçoivent son fonctionnement et le fil d'actualités, cela organise de petits blocs de temps dans notre esprit. Si vous voyez une notification, cela vous programme des pensées que vous n'aviez peut-être pas prévues. Si vous cliquez sur cette notification, cela vous programme à passer un peu de temps à être aspiré par quelque chose que vous n'aviez pas prévu. En parlant de technologie, nous en parlons comme d'une opportunité ouverte pouvant aller n'importe où. Je vais être sérieux un instant et vous dire pourquoi cela va dans une direction spécifique. Cela n'évolue pas aléatoirement. Il y a un but caché donnant la direction de toutes les technologies créées et ce but est la course pour notre attention. Tout nouveau site -- TED, les élections, les politiques, les jeux, même les applis de méditation -- doivent se battre pour une chose : notre attention, et elle est limitée. La meilleure façon d'obtenir l'attention des gens est de connaître le fonctionnement de leur cerveau. Il y a des techniques de persuasion que j'ai apprises dans un labo, le Labo de la Technologie Persuasive, afin d'obtenir l'attention des gens.

A simple example is YouTube. YouTube wants to maximize how much time you spend. And so what do they do? They autoplay the next video. And let's say that works really well. They're getting a little bit more of people's time. Well, if you're Netflix, you look at that and say, well, that's shrinking my market share, so I'm going to autoplay the next episode. But then if you're Facebook, you say, that's shrinking all of my market share, so now I have to autoplay all the videos in the newsfeed before waiting for you to click play. So the internet is not evolving at random. The reason it feels like it's sucking us in the way it is is because of this race for attention. We know where this is going. Technology is not neutral, and it becomes this race to the bottom of the brain stem of who can go lower to get it.

Un exemple simple est YouTube. YouTube veut maximiser le temps que vous y passez. Que font-ils ? Ils lancent automatiquement la vidéo suivante. Disons que cela fonctionne très bien. Ils obtiennent un peu plus du temps des gens. Si vous êtes Netflix, vous voyez cela et pensez que cela réduit votre part de marché, alors vous lancez automatiquement l'épisode suivant. Mais si vous êtes Facebook, vous pensez que cela réduit votre part de marché, alors vous lancez automatiquement toutes les vidéos au lieu d'attendre que l'on clique. Internet n'évolue pas aléatoirement. La raison pour laquelle on a l'impression qu'il nous aspire ainsi est à cause de cette course à l'attention. Nous savons où cela va. La technologie n'est pas neutre et cela devient cette course à la base du tronc cérébral de qui s'abaissera le plus pour l'obtenir.

Let me give you an example of Snapchat. If you didn't know, Snapchat is the number one way that teenagers in the United States communicate. So if you're like me, and you use text messages to communicate, Snapchat is that for teenagers, and there's, like, a hundred million of them that use it. And they invented a feature called Snapstreaks, which shows the number of days in a row that two people have communicated with each other. In other words, what they just did is they gave two people something they don't want to lose. Because if you're a teenager, and you have 150 days in a row, you don't want that to go away. And so think of the little blocks of time that that schedules in kids' minds. This isn't theoretical: when kids go on vacation, it's been shown they give their passwords to up to five other friends to keep their Snapstreaks going, even when they can't do it. And they have, like, 30 of these things, and so they have to get through taking photos of just pictures or walls or ceilings just to get through their day. So it's not even like they're having real conversations. We have a temptation to think about this as, oh, they're just using Snapchat the way we used to gossip on the telephone. It's probably OK. Well, what this misses is that in the 1970s, when you were just gossiping on the telephone, there wasn't a hundred engineers on the other side of the screen who knew exactly how your psychology worked and orchestrated you into a double bind with each other.

Laissez-moi vous présenter un exemple de Snapchat. Si vous l'ignorez, Snapchat est le moyen de communication principal des adolescents aux Etats-Unis. Si vous êtes comme moi et utilisez les SMS pour communiquer, Snapchat est l'équivalent pour ados et un million d'entre eux l'utilisent. Ils ont inventé une fonctionnalité, Snapstreak, qui montre le nombre de jours d'affilée où deux personnes ont communiqué l'une avec l'autre. En d'autres mots, ce qu'ils ont fait c'est donner à deux personnes une chose à ne pas perdre. Si vous êtes un adolescent et avez 150 jours d'affilée, vous ne voulez pas les perdre. Pensez aux petits blocs de temps prévus dans l'esprit des enfants. Ce n'est pas théorique : en vacances, ils donnent leur mot de passe à des amis, jusqu'à cinq d'entre eux, pour préserver leurs Snapstreaks, même s'ils ne le peuvent pas. Et ils en ont une trentaine, ils doivent donc prendre des photos de photos ou de murs ou de plafonds pour passer la journée. Ils n'ont même pas de réelles conversations. Nous avons la tentation de dire qu'ils utilisent Snapchat comme nous utilisions le téléphone. C'est probablement normal. Ce que nous oublions c'est que dans les années 70, quand vous papotiez au téléphone, il n'y avait pas 100 ingénieurs de l'autre côté de l'écran connaissant exactement votre psychologie et orchestrant de vous confiner ensemble à une contrainte.

Now, if this is making you feel a little bit of outrage, notice that that thought just comes over you. Outrage is a really good way also of getting your attention, because we don't choose outrage. It happens to us. And if you're the Facebook newsfeed, whether you'd want to or not, you actually benefit when there's outrage. Because outrage doesn't just schedule a reaction in emotional time, space, for you. We want to share that outrage with other people. So we want to hit share and say, "Can you believe the thing that they said?" And so outrage works really well at getting attention, such that if Facebook had a choice between showing you the outrage feed and a calm newsfeed, they would want to show you the outrage feed, not because someone consciously chose that, but because that worked better at getting your attention. And the newsfeed control room is not accountable to us. It's only accountable to maximizing attention. It's also accountable, because of the business model of advertising, for anybody who can pay the most to actually walk into the control room and say, "That group over there, I want to schedule these thoughts into their minds." So you can target, you can precisely target a lie directly to the people who are most susceptible. And because this is profitable, it's only going to get worse.

Si cela vous scandalise un peu, remarquez que cette pensée vous envahit. L'indignation est une très bonne façon d'obtenir votre attention car on ne choisit pas de s'indigner. Cela nous arrive. Le fil d'actualités de Facebook, qu'il le veuille ou non, tire profit de l'indignation. Car l'indignation ne prévoit pas simplement une réaction à un moment et dans un espace émotionnels pour vous. Nous voulons partager cette indignation avec d'autres. Nous voulons partager et dire : « Tu crois à ce qu'ils ont dit ? » L'indignation fonctionne très bien pour attirer l'attention, si bien que si Facebook devait choisir entre un fil d'actualités scandaleuses et un fil d'actualités calmes, ils choisiraient les actualités scandaleuses non pas consciemment mais parce que cela attire plus votre attention. La salle de contrôle du fil d'actualités n'a pas de comptes à nous rendre. Elle doit simplement maximiser l'attention. Elle est aussi responsable, à cause du modèle de publicité, envers quiconque payant le plus et entrant dans la salle de contrôle en disant : « Ce groupe-là, je veux établir ces pensées dans leur esprit. » Vous pouvez cibler, vous pouvez cibler précisément un mensonge directement vers les gens les plus susceptibles. Puisque c'est rentable, cela ne va qu'empirer.

So I'm here today because the costs are so obvious. I don't know a more urgent problem than this, because this problem is underneath all other problems. It's not just taking away our agency to spend our attention and live the lives that we want, it's changing the way that we have our conversations, it's changing our democracy, and it's changing our ability to have the conversations and relationships we want with each other. And it affects everyone, because a billion people have one of these in their pocket.

Je suis ici aujourd'hui car les coûts sont évidents. Je ne connais aucun problème plus urgent car ce problème est sous-jacent à tous les autres problèmes. Non seulement il compromet nos efforts pour concentrer notre attention, vivre notre vie désirée, il change aussi la façon dont nous tenons nos conversations, il change notre démocratie et il change notre capacité à avoir ces conversations et ces relations que nous voulons avoir. Il affecte tout le monde car un milliard de personnes ont ceci dans leur poche.

So how do we fix this? We need to make three radical changes to technology and to our society. The first is we need to acknowledge that we are persuadable. Once you start understanding that your mind can be scheduled into having little thoughts or little blocks of time that you didn't choose, wouldn't we want to use that understanding and protect against the way that that happens? I think we need to see ourselves fundamentally in a new way. It's almost like a new period of human history, like the Enlightenment, but almost a kind of self-aware Enlightenment, that we can be persuaded, and there might be something we want to protect. The second is we need new models and accountability systems so that as the world gets better and more and more persuasive over time -- because it's only going to get more persuasive -- that the people in those control rooms are accountable and transparent to what we want. The only form of ethical persuasion that exists is when the goals of the persuader are aligned with the goals of the persuadee. And that involves questioning big things, like the business model of advertising. Lastly, we need a design renaissance, because once you have this view of human nature, that you can steer the timelines of a billion people -- just imagine, there's people who have some desire about what they want to do and what they want to be thinking and what they want to be feeling and how they want to be informed, and we're all just tugged into these other directions. And you have a billion people just tugged into all these different directions. Well, imagine an entire design renaissance that tried to orchestrate the exact and most empowering time-well-spent way for those timelines to happen. And that would involve two things: one would be protecting against the timelines that we don't want to be experiencing, the thoughts that we wouldn't want to be happening, so that when that ding happens, not having the ding that sends us away; and the second would be empowering us to live out the timeline that we want.

Comment arranger cela ? Nous devons effectuer trois changements radicaux en termes de technologie et de société. Premièrement, nous devons reconnaître que nous sommes influençables. Une fois que nous comprenons que l'on peut programmer des petites pensées ou des blocs de temps non désirés dans notre esprit, n'utiliserions-nous pas cette connaissance et ne nous protégerions-nous pas ? Nous devons avoir une vision fondamentalement nouvelle de nous-mêmes. Comme une nouvelle période de l'histoire, comme le Siècle des Lumières et aussi comme une prise de conscience de soi, nous sommes influençables et il y a peut-être quelque chose à protéger. Deuxièmement, il nous faut de nouveaux modèles et systèmes de responsabilisation pour que, alors que le monde s'améliore, devient de plus en plus persuasif -- il ne peut que devenir de plus en plus persuasif -- les gens dans ces salles de contrôle soient responsables, transparents quant à nos désirs. La seule forme de persuasion éthique qui existe c'est si les objectifs de celui qui persuade sont alignés avec ceux de celui qui est persuadé. Il faut remettre en question des choses comme le modèle commercial de la publicité. Finalement, il faut un renouvellement de la conception car une fois que vous avez cette vision de la nature humaine, vous pouvez contrôler les calendriers d'un milliard de personnes. Imaginez, il y a des gens qui ont des désirs quant à ce qu'ils veulent faire et ce qu'ils veulent penser et ce qu'ils veulent ressentir et comment ils veulent être informés et ils sont traînés dans d'autres directions. Un milliard de personnes sont traînées dans d'autres directions. Imaginez une renaissance de la conception qui essayait d'orchestrer la façon exacte et la plus stimulante de bien passer son temps. Cela impliquerait deux choses : nous protéger de ces calendriers selon lesquels nous ne voulons pas vivre, ces pensées que nous ne voulons pas avoir pour que lorsque la sonnerie retentit, cela ne nous accapare pas ; deuxièmement, nous pousser à vivre à notre propre rythme.

So let me give you a concrete example. Today, let's say your friend cancels dinner on you, and you are feeling a little bit lonely. And so what do you do in that moment? You open up Facebook. And in that moment, the designers in the control room want to schedule exactly one thing, which is to maximize how much time you spend on the screen. Now, instead, imagine if those designers created a different timeline that was the easiest way, using all of their data, to actually help you get out with the people that you care about? Just think, alleviating all loneliness in society, if that was the timeline that Facebook wanted to make possible for people. Or imagine a different conversation. Let's say you wanted to post something supercontroversial on Facebook, which is a really important thing to be able to do, to talk about controversial topics. And right now, when there's that big comment box, it's almost asking you, what key do you want to type? In other words, it's scheduling a little timeline of things you're going to continue to do on the screen. And imagine instead that there was another button there saying, what would be most time well spent for you? And you click "host a dinner." And right there underneath the item it said, "Who wants to RSVP for the dinner?" And so you'd still have a conversation about something controversial, but you'd be having it in the most empowering place on your timeline, which would be at home that night with a bunch of a friends over to talk about it. So imagine we're running, like, a find and replace on all of the timelines that are currently steering us towards more and more screen time persuasively and replacing all of those timelines with what do we want in our lives.

Voici un exemple concret. Aujourd'hui, votre ami annule votre dîner ensemble et vous vous sentez un peu seul. Que faites-vous ? Vous ouvrez Facebook. A ce moment-là, les concepteurs dans la salle de contrôle veulent une chose : maximiser le temps passé devant votre écran. Imaginez plutôt si ces concepteurs avaient un autre objectif : la façon la plus simple, grâce à toutes leurs données, de vous aider à sortir avec les gens que vous aimez. Pensez-y, alléger la solitude dans notre société, si c'était le programme que Facebook voulait permettre aux gens. Ou imaginez une autre conversation. Disons que vous vouliez poster quelque chose de controversé sur Facebook, il est très important de pouvoir faire cela, parler de sujets controversés. Actuellement, quand il y a cet espace commentaire, il vous incite presque à écrire. En d'autres mots, cela prévoit un petit programme de choses que vous allez continuer à faire sur l'écran. Imaginez plutôt qu'il y ait un autre bouton demandant : « Comment utiliser au mieux votre temps ? » « Organiser un dîner » Juste en dessous, cela dit : « Qui veut réserver pour le dîner ? » Vous auriez toujours une conversation sur un sujet controversé, mais vous l'auriez à l'endroit le plus stimulant : chez vous, ce soir-là, avec des amis, pour en discuter. Imaginez que nous faisions un « chercher et remplacer » sur tous les programmes qui nous traînent actuellement vers de plus en plus de temps devant l'écran et que nous remplacions ces programmes par ce que nous voulons faire de notre vie.

It doesn't have to be this way. Instead of handicapping our attention, imagine if we used all of this data and all of this power and this new view of human nature to give us a superhuman ability to focus and a superhuman ability to put our attention to what we cared about and a superhuman ability to have the conversations that we need to have for democracy. The most complex challenges in the world require not just us to use our attention individually. They require us to use our attention and coordinate it together. Climate change is going to require that a lot of people are being able to coordinate their attention in the most empowering way together. And imagine creating a superhuman ability to do that.

Cela n'a pas à être ainsi. Au lieu d'handicaper notre attention, imaginez si nous utilisions toutes ces données, tout ce pouvoir, cette nouvelle vision de l'Homme pour nous donner une capacité de concentration surhumaine, une capacité surhumaine à prêter attention à ce qui nous importe, une capacité surhumaine à avoir les conversations que nous devons avoir pour la démocratie. Les défis les plus complexes au monde ne nécessitent pas seulement notre attention individuelle. Ils nécessitent notre attention et une coordination collectives. Le changement climatique va nécessiter que beaucoup de gens puissent coordonner leur attention de la façon la plus stimulante, ensemble. Imaginez créer une capacité surhumaine pour faire cela.

Sometimes the world's most pressing and important problems are not these hypothetical future things that we could create in the future. Sometimes the most pressing problems are the ones that are right underneath our noses, the things that are already directing a billion people's thoughts. And maybe instead of getting excited about the new augmented reality and virtual reality and these cool things that could happen, which are going to be susceptible to the same race for attention, if we could fix the race for attention on the thing that's already in a billion people's pockets. Maybe instead of getting excited about the most exciting new cool fancy education apps, we could fix the way kids' minds are getting manipulated into sending empty messages back and forth.

Parfois, les problèmes les plus importants et urgents du monde ne sont pas ces choses hypothétiques que nous pourrions créer à l'avenir. Parfois, les problèmes les plus urgents sont ceux juste sous notre nez, les choses qui dirigent déjà les pensées d'un milliard de personnes. Peut-être qu'au lieu d'être enthousiastes pour la réalité augmentée et la réalité virtuelle et ces choses cool pouvant arriver qui vont être sujettes à la même course à l'attention, si nous pouvions orienter la course à l'attention ce qui est déjà dans les poches d'un milliard de personnes. Au lieu d'être enthousiastes pour les nouvelles applications éducatives excitantes, cool et sophistiquées, nous pourrions corriger comment les enfants sont manipulés et poussés à s'échanger des messages vides.

(Applause)

(Applaudissements)

Maybe instead of worrying about hypothetical future runaway artificial intelligences that are maximizing for one goal, we could solve the runaway artificial intelligence that already exists right now, which are these newsfeeds maximizing for one thing. It's almost like instead of running away to colonize new planets, we could fix the one that we're already on.

Au lieu de s'inquiéter d'hypothétiques et futures intelligences artificielles folles qui n'ont qu'un objectif, nous pourrions réparer l'intelligence artificielle folle qui existe actuellement et qui sont ces fils d'actualités qui n'ont qu'un objectif. C'est presque comme si au lieu d'aller coloniser d'autres planètes, nous pouvions réparer celle sur laquelle nous sommes.

(Applause)

(Applaudissements)

Solving this problem is critical infrastructure for solving every other problem. There's nothing in your life or in our collective problems that does not require our ability to put our attention where we care about. At the end of our lives, all we have is our attention and our time. What will be time well spent for ours?

Résoudre ce problème offrirait l'infrastructure essentielle à la résolution de tous les autres. Il n'y a rien dans notre vie ou nos problèmes collectifs ne nécessitant pas notre capacité à nous concentrer sur ce qui nous importe. A la fin de notre vie, il ne nous reste que notre attention et notre temps. Comment bien utiliser notre temps ?

Thank you.

Merci.

(Applause)

(Applaudissements)

Chris Anderson: Tristan, thank you. Hey, stay up here a sec. First of all, thank you. I know we asked you to do this talk on pretty short notice, and you've had quite a stressful week getting this thing together, so thank you. Some people listening might say, what you complain about is addiction, and all these people doing this stuff, for them it's actually interesting. All these design decisions have built user content that is fantastically interesting. The world's more interesting than it ever has been. What's wrong with that?

Chirs Anderson : Tristan, merci. Restez ici un instant. Tout d'abord, merci. Cette présentation a été demandée il y a peu de temps et votre semaine a été stressante, travaillant à cela, alors merci. Certains qui écoutent pourraient dire que vous vous plaignez d'addiction et que pour les gens faisant cela, c'est vraiment intéressant. Les décisions de conception ont créé un contenu utilisation incroyablement intéressant. Le monde est plus intéressant que jamais. Qu'y a-t-il de mal à cela ?

Tristan Harris: I think it's really interesting. One way to see this is if you're just YouTube, for example, you want to always show the more interesting next video. You want to get better and better at suggesting that next video, but even if you could propose the perfect next video that everyone would want to watch, it would just be better and better at keeping you hooked on the screen. So what's missing in that equation is figuring out what our boundaries would be. You would want YouTube to know something about, say, falling asleep. The CEO of Netflix recently said, "our biggest competitors are Facebook, YouTube and sleep." And so what we need to recognize is that the human architecture is limited and that we have certain boundaries or dimensions of our lives that we want to be honored and respected, and technology could help do that.

Tristan Harris : Je pense que c'est intéressant. Une façon de le voir est si vous êtes YouTube, par exemple, vous voulez toujours montrer la vidéo la plus intéressante. Vous voulez améliorer la suggestion de la prochaine vidéo, mais même si vous pouviez proposer la vidéo parfaite que tout le monde voudrait voir, vous n'améliorerez que votre capacité à garder les gens devant l'écran. Ce qu'il manque dans l'équation est de trouver où sont les limites. Il faudrait que YouTube connaisse la notion de sommeil. Le PDG de Netflix a dit récemment : « Nos compétiteurs sont Facebook, YouTube et le sommeil. » Nous devons reconnaître que l'architecture humaine est limitée et qu'il y a des limites ou des dimensions de notre vie que nous voulons voir honorées et respectées et la technologie pourrait aider.

(Applause)

(Applaudissements)

CA: I mean, could you make the case that part of the problem here is that we've got a naïve model of human nature? So much of this is justified in terms of human preference, where we've got these algorithms that do an amazing job of optimizing for human preference, but which preference? There's the preferences of things that we really care about when we think about them versus the preferences of what we just instinctively click on. If we could implant that more nuanced view of human nature in every design, would that be a step forward?

CA : Pourriez-vous dire qu'une part du problème est que nous avons un modèle naïf de la nature humaine ? Tant de choses sont justifiées par la préférence humaine, nous avons ces algorithmes faisant un super boulot, optimisant pour la préférence humaine, mais quelle préférence ? Il y a les préférences des choses qui nous importent quand nous y pensons versus celles de ce sur quoi nous avons instinctivement cliqué. Si nous pouvions implanter une vue plus nuancée de la nature humaine dans la conception, cela serait-il du progrès ?

TH: Absolutely. I mean, I think right now it's as if all of our technology is basically only asking our lizard brain what's the best way to just impulsively get you to do the next tiniest thing with your time, instead of asking you in your life what we would be most time well spent for you? What would be the perfect timeline that might include something later, would be time well spent for you here at TED in your last day here?

TH : Absolument. Actuellement, c'est comme si notre technologie demandait à notre cerveau reptilien comment, impulsivement, nous faire faire de notre temps la prochaine petite chose au lieu de demander comment vous utiliseriez au mieux votre temps. Quel serait le programme parfait pouvant inclure des prévisions, comment bien utiliser votre temps durant votre dernier jour à TED ?

CA: So if Facebook and Google and everyone said to us first up, "Hey, would you like us to optimize for your reflective brain or your lizard brain? You choose."

CA : Donc si Facebook et Google et tous les autres disaient : « Aimeriez-vous optimiser votre cerveau réflectif ou votre cerveau reptilien ? Choisissez. »

TH: Right. That would be one way. Yes.

TH : Ce serait une façon de faire, oui.

CA: You said persuadability, that's an interesting word to me because to me there's two different types of persuadability. There's the persuadability that we're trying right now of reason and thinking and making an argument, but I think you're almost talking about a different kind, a more visceral type of persuadability, of being persuaded without even knowing that you're thinking.

CA : Vous avez parlé d'influence, c'est un mot intéressant car, à mon avis, il y a deux types d'influence. Il y a celle que nous essayons, celle de la raison, la réflexion, l'argumentation, mais vous parlez presque d'une influence différente, plus viscérale, celle d'être convaincu sans savoir ce que l'on pense.

TH: Exactly. The reason I care about this problem so much is I studied at a lab called the Persuasive Technology Lab at Stanford that taught [students how to recognize] exactly these techniques. There's conferences and workshops that teach people all these covert ways of getting people's attention and orchestrating people's lives. And it's because most people don't know that that exists that this conversation is so important.

TH : Exactement. Ce problème me tient à cœur car j'ai étudié au labo de la Technologie Persuasive à Stanford qui enseigne ces techniques aux gens. Il y a des conférences, des ateliers qui enseignent ces façons dissimulées d'obtenir l'attention des gens et d'orchestrer leur vie. Le fait que la plupart des gens en ignorent l'existence rend cette conversation si importante.

CA: Tristan, you and I, we both know so many people from all these companies. There are actually many here in the room, and I don't know about you, but my experience of them is that there is no shortage of good intent. People want a better world. They are actually -- they really want it. And I don't think anything you're saying is that these are evil people. It's a system where there's these unintended consequences that have really got out of control --

CA : Tristan, vous et moi connaissons tant de monde dans ces entreprises. Il y en a plein dans la pièce et, je ne sais pas pour vous, mais mon expérience est qu'ils ne manquent pas de bonnes intentions. Les gens veulent un monde meilleur. Ils sont -- ils le veulent vraiment. Je ne crois pas que vous disiez que ces gens sont maléfiques. C'est un système où il y a des conséquences inattendues qui est hors de contrôle --

TH: Of this race for attention. It's the classic race to the bottom when you have to get attention, and it's so tense. The only way to get more is to go lower on the brain stem, to go lower into outrage, to go lower into emotion, to go lower into the lizard brain.

TH : La course à l'attention. La course classique vers les bas-fonds pour obtenir l'attention, c'est très tendu. Pour en obtenir plus, il faut descendre le tronc cérébral, descendre dans l'outrage, descendre dans l'émotion, descendre dans le cerveau lézard.

CA: Well, thank you so much for helping us all get a little bit wiser about this.

CA : Merci de nous avoir aidés à devenir plus éclairés à ce propos.

Tristan Harris, thank you. TH: Thank you very much.

Tristan Harris, merci. TH : Merci beaucoup.

(Applause)

(Applaudissements)