I want you to imagine walking into a room, a control room with a bunch of people, a hundred people, hunched over a desk with little dials, and that that control room will shape the thoughts and feelings of a billion people. This might sound like science fiction, but this actually exists right now, today.

Quiero que se imaginen entrando en una sala. Una sala de control con un montón de gente, cien personas encorvadas en un escritorio con pequeños diales... y que esa sala de control moldeará los pensamientos y sentimientos de un billón de personas. Esto podría sonar como ciencia ficción, pero esto realmente existe en la actualidad.

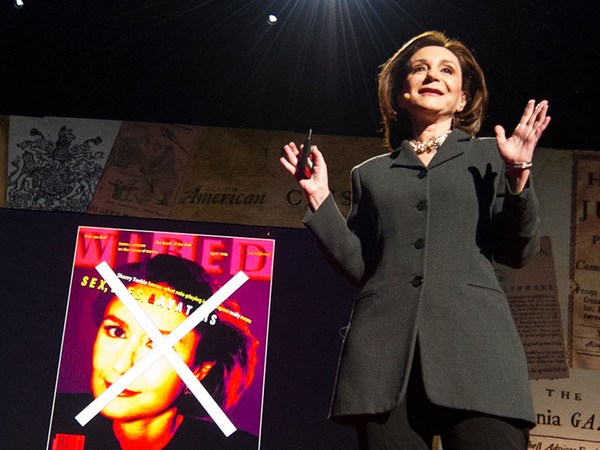

I know because I used to be in one of those control rooms. I was a design ethicist at Google, where I studied how do you ethically steer people's thoughts? Because what we don't talk about is how the handful of people working at a handful of technology companies through their choices will steer what a billion people are thinking today. Because when you pull out your phone and they design how this works or what's on the feed, it's scheduling little blocks of time in our minds. If you see a notification, it schedules you to have thoughts that maybe you didn't intend to have. If you swipe over that notification, it schedules you into spending a little bit of time getting sucked into something that maybe you didn't intend to get sucked into. When we talk about technology, we tend to talk about it as this blue sky opportunity. It could go any direction. And I want to get serious for a moment and tell you why it's going in a very specific direction. Because it's not evolving randomly. There's a hidden goal driving the direction of all of the technology we make, and that goal is the race for our attention. Because every news site, TED, elections, politicians, games, even meditation apps have to compete for one thing, which is our attention, and there's only so much of it. And the best way to get people's attention is to know how someone's mind works. And there's a whole bunch of persuasive techniques that I learned in college at a lab called the Persuasive Technology Lab to get people's attention.

Lo sé porque solía estar en una de esas salas de control. Yo era un diseñador ético en Google, donde estudié cómo se controlan los pensamientos de la gente de forma ética; debido a que, de lo que no hablamos, es de cómo el puñado de personas que trabajan en un puñado de empresas de tecnología, por medio de sus decisiones, controlarán lo que un billón de personas están pensando en la actualidad. Porque cuando sacan su teléfono, ellos diseñan cómo esto funciona o qué hay en las notificaciones y están programando pequeños bloques de tiempo en nuestras mentes. Si ven una notificación, esta los programa para que tengan pensamientos que quizás no tenían la intención de tener. Si presionan esa notificación, esta los programa para que pasen un poco de tiempo, al ser atrapados por algo, por lo que quizá no tenían la intención de dejarse atrapar. Cuando hablamos de tecnología, tendemos a hablar de ella, como esta enorme oportunidad, que podría ir en cualquier dirección. Y quiero hablar seriamente por un instante y decirles por qué va en una dirección muy específica, puesto no está evolucionando al azar. Hay un objetivo oculto dirigiendo la dirección de toda la tecnología que hacemos y ese objetivo es la carrera por nuestra atención. Porque cada sitio nuevo: TED, elecciones, políticos, juegos, incluso las aplicaciones de meditación, tienen que competir por una cosa, nuestra atención y ésta es limitada. La mejor manera de capturar la atención de las personas, es saber cómo funciona la mente de alguien. Hay una cantidad de técnicas de persuasión que aprendí en un laboratorio de la universidad llamado: 'Lab. de Tecnología Persuasiva,' para capturar la atención de la gente.

A simple example is YouTube. YouTube wants to maximize how much time you spend. And so what do they do? They autoplay the next video. And let's say that works really well. They're getting a little bit more of people's time. Well, if you're Netflix, you look at that and say, well, that's shrinking my market share, so I'm going to autoplay the next episode. But then if you're Facebook, you say, that's shrinking all of my market share, so now I have to autoplay all the videos in the newsfeed before waiting for you to click play. So the internet is not evolving at random. The reason it feels like it's sucking us in the way it is is because of this race for attention. We know where this is going. Technology is not neutral, and it becomes this race to the bottom of the brain stem of who can go lower to get it.

Un ejemplo sencillo es YouTube. YouTube quiere maximizar el tiempo que Uds. pasan allí. Entonces, ¿qué es lo que hacen? Reproducen el siguiente vídeo automáticamente y digamos que funciona muy bien. Están consiguiendo un poco más de tiempo de la gente. Bueno, si son Netflix, miran eso y dicen: "Eso está reduciendo mi cuota de mercado, así que voy a reproducir el siguiente episodio automáticamente." Pero si son Facebook, dicen: "eso está reduciendo toda mi cuota de mercado, así que ahora debo reproducir todos los vídeos del inicio automáticamente, antes de esperar a que hagan clic en reproducir." Por eso Internet no está evolucionando al azar. La razón por la que parece que nos atrapa en la manera que lo hace, se debe a esta carrera por la atención. Sabemos adónde va esto. La tecnología no es neutral. Y se convierte en esta carrera hacia el fondo del tronco encefálico; de quién puede ir más bajo para ganarla.

Let me give you an example of Snapchat. If you didn't know, Snapchat is the number one way that teenagers in the United States communicate. So if you're like me, and you use text messages to communicate, Snapchat is that for teenagers, and there's, like, a hundred million of them that use it. And they invented a feature called Snapstreaks, which shows the number of days in a row that two people have communicated with each other. In other words, what they just did is they gave two people something they don't want to lose. Because if you're a teenager, and you have 150 days in a row, you don't want that to go away. And so think of the little blocks of time that that schedules in kids' minds. This isn't theoretical: when kids go on vacation, it's been shown they give their passwords to up to five other friends to keep their Snapstreaks going, even when they can't do it. And they have, like, 30 of these things, and so they have to get through taking photos of just pictures or walls or ceilings just to get through their day. So it's not even like they're having real conversations. We have a temptation to think about this as, oh, they're just using Snapchat the way we used to gossip on the telephone. It's probably OK. Well, what this misses is that in the 1970s, when you were just gossiping on the telephone, there wasn't a hundred engineers on the other side of the screen who knew exactly how your psychology worked and orchestrated you into a double bind with each other.

Permítanme darles un ejemplo de Snapchat. Si no lo sabían, Snapchat es el medio número uno que los adolescentes de EE. EE. usan para comunicarse. Si son como yo y usan mensajes de texto para comunicarse, eso es Snapchat para los adolescentes y hay como cien millones de ellos que la usan. Ellos inventaron una función llamada Snapstreaks, la cual muestra el número de días seguidos que dos personas se han comunicado entre sí. En otras palabras, lo que acaban de hacer, es que le dieron a dos personas algo que no quieren perder. Ya que si son un(a) adolescente y tienen 150 días seguidos, no quieren que eso se esfume. Así que piensen en los pequeños bloques de tiempo, que eso programa en las mentes de los niños. Esto no es teórico: cuando los niños van de vacaciones, se ha demostrado que dan sus contraseñas a hasta cinco de sus amigos para mantener su Snapstreaks activo, incluso cuando no pueden hacerlo. Y tienen como 30 de estas cosas, así que, tienen que tomar fotos o simplemente imágenes de paredes o techos sólo para pasar su día. Ni siquiera es como si conversaran realmente. Tenemos la tentación de pensar en esto como: "Oh, sólo están usando Snapchat de la forma en que solíamos chismear en el teléfono. Probablemente esté bien." Pero lo que esto omite es que en la década de 1970, cuando estaban simplemente chismeando en el teléfono, no habían cien ingenieros al otro lado de la pantalla, que sabían exactamente cómo funcionaba su psicología y los orquestaban en un doble vínculo entre sí.

Now, if this is making you feel a little bit of outrage, notice that that thought just comes over you. Outrage is a really good way also of getting your attention, because we don't choose outrage. It happens to us. And if you're the Facebook newsfeed, whether you'd want to or not, you actually benefit when there's outrage. Because outrage doesn't just schedule a reaction in emotional time, space, for you. We want to share that outrage with other people. So we want to hit share and say, "Can you believe the thing that they said?" And so outrage works really well at getting attention, such that if Facebook had a choice between showing you the outrage feed and a calm newsfeed, they would want to show you the outrage feed, not because someone consciously chose that, but because that worked better at getting your attention. And the newsfeed control room is not accountable to us. It's only accountable to maximizing attention. It's also accountable, because of the business model of advertising, for anybody who can pay the most to actually walk into the control room and say, "That group over there, I want to schedule these thoughts into their minds." So you can target, you can precisely target a lie directly to the people who are most susceptible. And because this is profitable, it's only going to get worse.

Ahora, si esto les hace sentir un poco de indignación, noten que ese pensamiento simplemente les llega. La indignación también es una manera muy buena de capturar su atención, ya que no elegimos la indignación, es algo que nos sucede. Y si son la sección de novedades de Facebook, quiéranlo o no, de hecho se benefician cuando hay indignación, porque la indignación no sólo programa una reacción emocional en Uds. en el tiempo/espacio, sino que queremos compartir esa indignación con otros. Queremos dar clic en compartir y decir: "¿Pueden creer lo que dijeron?" Y así, la indignación funciona muy bien para capturar la atención, de modo que si Facebook tuviera la opción entre mostrarles publicaciones indignantes o tranquilas, ellos querrían mostrarles las indignantes, no porque alguien eligió conscientemente eso, sino porque eso funcionó mejor, para capturar su atención. Y... La sala de control de noticias no es responsable de nosotros. Sólo es responsable de maximizar la atención. También es responsable, debido al modelo de negocio de la publicidad, para cualquiera que pueda pagar más, entrar en la sala de control y decir: "Ese grupo allá, quiero programar estos pensamientos en sus mentes." Así que se puede elegir como blanco... se puede apuntar con precisión una mentira, directamente a las personas que son más susceptibles. Y debido a que esto es rentable, sólo va a empeorar.

So I'm here today because the costs are so obvious. I don't know a more urgent problem than this, because this problem is underneath all other problems. It's not just taking away our agency to spend our attention and live the lives that we want, it's changing the way that we have our conversations, it's changing our democracy, and it's changing our ability to have the conversations and relationships we want with each other. And it affects everyone, because a billion people have one of these in their pocket.

Así que hoy estoy aquí, porque los costos son muy evidentes. No conozco un problema más urgente que este, porque este problema está debajo de todos los demás problemas. No sólo se está llevando nuestra voluntad, de invertir nuestra atención y vivir las vidas que queremos; está cambiando la manera en que tenemos nuestras conversaciones, está cambiando nuestra democracia y está cambiando nuestra habilidad de tener conversaciones y las relaciones que queremos unos con otros. Y afecta a todos, porque un billón de personas tienen uno de estos en su bolsillo.

So how do we fix this? We need to make three radical changes to technology and to our society. The first is we need to acknowledge that we are persuadable. Once you start understanding that your mind can be scheduled into having little thoughts or little blocks of time that you didn't choose, wouldn't we want to use that understanding and protect against the way that that happens? I think we need to see ourselves fundamentally in a new way. It's almost like a new period of human history, like the Enlightenment, but almost a kind of self-aware Enlightenment, that we can be persuaded, and there might be something we want to protect. The second is we need new models and accountability systems so that as the world gets better and more and more persuasive over time -- because it's only going to get more persuasive -- that the people in those control rooms are accountable and transparent to what we want. The only form of ethical persuasion that exists is when the goals of the persuader are aligned with the goals of the persuadee. And that involves questioning big things, like the business model of advertising. Lastly, we need a design renaissance, because once you have this view of human nature, that you can steer the timelines of a billion people -- just imagine, there's people who have some desire about what they want to do and what they want to be thinking and what they want to be feeling and how they want to be informed, and we're all just tugged into these other directions. And you have a billion people just tugged into all these different directions. Well, imagine an entire design renaissance that tried to orchestrate the exact and most empowering time-well-spent way for those timelines to happen. And that would involve two things: one would be protecting against the timelines that we don't want to be experiencing, the thoughts that we wouldn't want to be happening, so that when that ding happens, not having the ding that sends us away; and the second would be empowering us to live out the timeline that we want.

Entonces, ¿cómo arreglamos esto? Necesitamos hacer tres cambios radicales en la tecnología y en nuestra sociedad. El primero es que debemos reconocer que somos persuasibles. Una vez que empiezan a entender, que su mente puede ser programada para que tenga pequeños pensamientos, o pequeños bloques de tiempo que no eligieron, ¿no querríamos usar esa comprensión y protegernos de la forma en que eso sucede? Pienso que necesitamos vernos fundamentalmente de una nueva forma. Es casi como un nuevo período de la historia humana, como la Ilustración; pero casi una especie de iluminación autoconsciente; que podemos ser persuadidos y podría haber algo que queramos proteger. El segundo es que necesitamos nuevos modelos y sistemas de responsabilidad, para que a medida que el mundo mejore y se vuelva más persuasivo con el tiempo, - porque sólo va a hacerse más y más persuasivo - que las personas en esas salas de control sean responsables y transparentes con lo que queremos. La única forma ética de persuasión que existe, es cuando los objetivos del persuasor están alineados con los objetivos del persuadido y eso implica cuestionar cosas grandes, como el modelo de negocio publicitario. Finalmente, necesitamos un renacimiento del diseño, porque una vez que se tiene esta visión de la naturaleza humana, de que se puede controlar las líneas de tiempo de un billón de personas, sólo imaginen, hay gente que tiene algún deseo de lo que quieren hacer, estar pensando y sintiendo y cómo quieren ser informados y simplemente todos somos halados en estas otras direcciones y hay un billón de personas arrastradas en todas estas diversas direcciones. Bueno, imaginen todo un Renacimiento de diseño que procurara orquestar la manera más exacta y poderosa de invertir el tiempo para que estas líneas de tiempo ocurrieran. Eso implicaría dos cosas: Una nos estaría protegiendo de las líneas de tiempo, que no queremos experimentar, los pensamientos que no queremos procesar, para no tener ese timbre, que cuando suena nos dispersa. Y la segunda nos permitiría vivir la línea de tiempo que queremos.

So let me give you a concrete example. Today, let's say your friend cancels dinner on you, and you are feeling a little bit lonely. And so what do you do in that moment? You open up Facebook. And in that moment, the designers in the control room want to schedule exactly one thing, which is to maximize how much time you spend on the screen. Now, instead, imagine if those designers created a different timeline that was the easiest way, using all of their data, to actually help you get out with the people that you care about? Just think, alleviating all loneliness in society, if that was the timeline that Facebook wanted to make possible for people. Or imagine a different conversation. Let's say you wanted to post something supercontroversial on Facebook, which is a really important thing to be able to do, to talk about controversial topics. And right now, when there's that big comment box, it's almost asking you, what key do you want to type? In other words, it's scheduling a little timeline of things you're going to continue to do on the screen. And imagine instead that there was another button there saying, what would be most time well spent for you? And you click "host a dinner." And right there underneath the item it said, "Who wants to RSVP for the dinner?" And so you'd still have a conversation about something controversial, but you'd be having it in the most empowering place on your timeline, which would be at home that night with a bunch of a friends over to talk about it. So imagine we're running, like, a find and replace on all of the timelines that are currently steering us towards more and more screen time persuasively and replacing all of those timelines with what do we want in our lives.

Permítanme darles un ejemplo concreto. Digamos que su amigo(a) les cancela la cena hoy y se están sintiendo un poco solos. Entonces, ¿qué hacen en ese momento? Abren Facebook... y en ese momento los diseñadores en la sala de control, quieren programar exactamente una cosa, lo cual es maximizar la cantidad de tiempo que pasan en la pantalla. Ahora, en lugar de eso imaginen si esos diseñadores crearan una línea de tiempo diferente que fuera la manera más fácil, - utilizando todos sus datos - para ayudarles realmente a salir, con las personas que les importan. Tan sólo imagínenlo, eso aliviaría toda la soledad en la sociedad, si ese fuera el cronograma que Facebook quisiera hacer posible para la gente. O imaginen una conversación diferente, donde digamos que quisieran publicar algo súper controvertido en Facebook, lo que es muy importante, - hablar de temas polémicos -. Y ahora mismo, cuando está esa gran caja de comentarios, casi preguntándoles: ¿Qué quieres escribir? En otras palabras, está programando una pequeña serie de cosas que van a seguir haciendo en la pantalla. E imaginen que en lugar de eso, hubiese otro botón allí diciendo: ¿Cuál sería la mejor forma de invertir tu tiempo? Y hacen clic en "organizar una cena" y justo debajo del artículo dijera: ¿Quién quiere confirmar la cena? Y aún así tendrían una conversación acerca de algo controvertido, pero la tendría en el lugar más inspirador en su línea de tiempo, la que sería en casa esa noche, con un montón de amigos para hablar de ello. Imaginen que estamos operando, como un "buscar/reemplazar" en todas las líneas de tiempo que actualmente nos manipulan persuasivamente hacia más y más tiempo en la pantalla y reemplazar todas esas líneas de tiempo, con lo que sí queremos en nuestras vidas.

It doesn't have to be this way. Instead of handicapping our attention, imagine if we used all of this data and all of this power and this new view of human nature to give us a superhuman ability to focus and a superhuman ability to put our attention to what we cared about and a superhuman ability to have the conversations that we need to have for democracy. The most complex challenges in the world require not just us to use our attention individually. They require us to use our attention and coordinate it together. Climate change is going to require that a lot of people are being able to coordinate their attention in the most empowering way together. And imagine creating a superhuman ability to do that.

No tiene por qué ser de esta manera. En lugar de perjudicar nuestra atención, imaginen si usáramos toda esta información y todo este poder y esta nueva visión de la naturaleza humana para darnos una habilidad sobrehumana de concentración y una habilidad sobrehumana de poner nuestra atención en lo que nos importa, y una habilidad sobrehumana de tener las conversaciones que necesitamos tener en la democracia. Los desafíos más complejos en el mundo, no sólo requieren de nosotros que usemos nuestra atención individualmente. Nos exigen que utilicemos nuestra atención y la coordinemos colectivamente. El cambio climático va a requerir que mucha gente, sea capaz de coordinar su atención en conjunto de la manera más poderosa. E imaginen crear una habilidad sobrehumana para hacer eso.

Sometimes the world's most pressing and important problems are not these hypothetical future things that we could create in the future. Sometimes the most pressing problems are the ones that are right underneath our noses, the things that are already directing a billion people's thoughts. And maybe instead of getting excited about the new augmented reality and virtual reality and these cool things that could happen, which are going to be susceptible to the same race for attention, if we could fix the race for attention on the thing that's already in a billion people's pockets. Maybe instead of getting excited about the most exciting new cool fancy education apps, we could fix the way kids' minds are getting manipulated into sending empty messages back and forth.

A veces los problemas más urgentes e importantes del mundo, no son estas cosas futuras e hipotéticas, que podríamos crear en el futuro. A veces los problemas más urgentes, son los que están justo ante nuestras narices; las cosas que ya están dirigiendo los pensamientos de un billón de personas. Y tal vez en lugar de entusiasmarnos con la nueva realidad aumentada y la realidad virtual y estas cosas geniales que podrían suceder, - las cuales van a ser susceptibles a la misma carrera por la atención - pudiéramos arreglar la carrera por la atención, respecto a lo que ya está en el bolsillo de un billón de personas. Tal vez en lugar de emocionarnos por las nuevas, emocionantes y más lujosas aplicaciones educativas, podríamos arreglar la manera en que las mentes de los niños son manipuladas, para que envíen mensajes vanos de un lado a otro.

(Applause)

(Aplausos)

Maybe instead of worrying about hypothetical future runaway artificial intelligences that are maximizing for one goal, we could solve the runaway artificial intelligence that already exists right now, which are these newsfeeds maximizing for one thing. It's almost like instead of running away to colonize new planets, we could fix the one that we're already on.

Quizá en lugar de preocuparnos por un futuro hipotético de inteligencias artificiales fugitivas, que se están maximizando para un objetivo, podríamos solucionar la inteligencia artificial fugitiva, que ya existe en este momento, las cuales son estas secciones de publicaciones que se maximizan para una cosa. Es casi como en lugar de huir a colonizar nuevos planetas, arreglaramos el planeta en el que ya estamos.

(Applause)

(Aplausos)

Solving this problem is critical infrastructure for solving every other problem. There's nothing in your life or in our collective problems that does not require our ability to put our attention where we care about. At the end of our lives, all we have is our attention and our time. What will be time well spent for ours?

Solucionar este problema supone tener una infraestructura crítica, para solucionar cualquier otro problema. No hay nada en sus vidas o en nuestros problemas colectivos, que no requiera de nuestra capacidad de enfocarnos en las cosas que nos importan. Al final de nuestras vidas, todo lo que tenemos es nuestra atención y nuestro tiempo. ¿Cuál sería la mejor manera de invertir nuestro tiempo?

Thank you.

Gracias.

(Applause)

(Aplausos) Gracias.

Chris Anderson: Tristan, thank you. Hey, stay up here a sec. First of all, thank you. I know we asked you to do this talk on pretty short notice, and you've had quite a stressful week getting this thing together, so thank you. Some people listening might say, what you complain about is addiction, and all these people doing this stuff, for them it's actually interesting. All these design decisions have built user content that is fantastically interesting. The world's more interesting than it ever has been. What's wrong with that?

Chris Anderson: Tristan, gracias. Quédate aquí un segundo. Primero que todo, gracias. Sé que te pedimos que hicieras esta charla con muy poca antelación y has tenido una semana bastante estresante; compilando esto, así que gracias. Algunas personas que escuchan esto, podrían decir: "Lo que discutes es la adicción y todas estas personas haciendo estas cosas," para ellos es muy interesante. Todas estas decisiones de diseño han construido contenido de usuario, que es increíblemente interesante. El mundo es más interesante que nunca. ¿Qué hay de malo en eso?

Tristan Harris: I think it's really interesting. One way to see this is if you're just YouTube, for example, you want to always show the more interesting next video. You want to get better and better at suggesting that next video, but even if you could propose the perfect next video that everyone would want to watch, it would just be better and better at keeping you hooked on the screen. So what's missing in that equation is figuring out what our boundaries would be. You would want YouTube to know something about, say, falling asleep. The CEO of Netflix recently said, "our biggest competitors are Facebook, YouTube and sleep." And so what we need to recognize is that the human architecture is limited and that we have certain boundaries or dimensions of our lives that we want to be honored and respected, and technology could help do that.

Tristan Harris: Creo que es muy interesante. Una forma de ver esto es si eres YouTube, por ejemplo, quieres mostrar siempre el siguiente vídeo más interesante, quieres mejorar en sugerir ese siguiente vídeo, pero incluso si pudieras proponer el siguiente vídeo perfecto, que todo el mundo querría ver, simplemente sería mejor y mejor en mantenerte enganchado a la pantalla. Entonces, lo que falta en esa ecuación es averiguar cuáles serían nuestros límites. Querrías que YouTube supiera algo sobre, por ejemplo, quedarte dormido. El CEO de Netflix hace poco dijo: "Nuestros mayores competidores son Facebook, YouTube y el sueño." Así que lo que necesitamos reconocer, es que la arquitectura humana es limitada y que tenemos ciertos límites o dimensiones de nuestras vidas, que queremos que sean honrados y respetados y la tecnología podría ayudar a hacer eso.

(Applause)

(Aplausos)

CA: I mean, could you make the case that part of the problem here is that we've got a naïve model of human nature? So much of this is justified in terms of human preference, where we've got these algorithms that do an amazing job of optimizing for human preference, but which preference? There's the preferences of things that we really care about when we think about them versus the preferences of what we just instinctively click on. If we could implant that more nuanced view of human nature in every design, would that be a step forward?

CA: Quiero decir, ¿podrías hacer el caso de que parte del problema aquí, es que tenemos un modelo ingenuo de la naturaleza humana? Mucho de esto se justifica en términos de preferencia humana, donde tenemos estos algoritmos, que hacen un trabajo increíble de optimización para la preferencia humana, pero ¿qué preferencia? Están las preferencias de las cosas que realmente nos importan, - cuando pensamos en ellas - versus las preferencias de lo que sólo hacemos clic instintivamente. Si pudiéramos implantar esa visión más matizada de la naturaleza humana en cada diseño, ¿sería eso un paso adelante?

TH: Absolutely. I mean, I think right now it's as if all of our technology is basically only asking our lizard brain what's the best way to just impulsively get you to do the next tiniest thing with your time, instead of asking you in your life what we would be most time well spent for you? What would be the perfect timeline that might include something later, would be time well spent for you here at TED in your last day here?

TH: Absolutamente. Creo que hoy día es como si básicamente toda nuestra tecnología, fuera sólo preguntarle a nuestro cerebro reptiliano: ¿Cuál es la mejor forma de lograr que hagas impulsivamente la siguiente cosa más pequeña con tu tiempo, en vez de preguntarte: ¿Cuál sería la mejor forma de invertir tu tiempo? ¿Cuál sería el cronograma perfecto que incluyera algo para después, o aquí en TED en tu último día?

CA: So if Facebook and Google and everyone said to us first up, "Hey, would you like us to optimize for your reflective brain or your lizard brain? You choose."

CA: Así que, si Facebook y Google y todo el mundo nos dijeran primero: "Oye, ¿quieres que optimicemos tu cerebro reflexivo o tu cerebro lagarto? Tú eliges."

TH: Right. That would be one way. Yes.

TH: Correcto. Eso sería una manera. Sí.

CA: You said persuadability, that's an interesting word to me because to me there's two different types of persuadability. There's the persuadability that we're trying right now of reason and thinking and making an argument, but I think you're almost talking about a different kind, a more visceral type of persuadability, of being persuaded without even knowing that you're thinking.

CA: Usaste la palabra "persuasibilidad," esa palabra me interesa, porque para mí hay dos clases diferentes de persuasión. Hay una persuasibilidad que estamos intentando ahora mismo: Razonar, pensar y argumentar. Pero creo que estás hablando de otra clase, un tipo de persuasión más visceral; de ser persuadido sin siquiera saber que estás pensando.

TH: Exactly. The reason I care about this problem so much is I studied at a lab called the Persuasive Technology Lab at Stanford that taught [students how to recognize] exactly these techniques. There's conferences and workshops that teach people all these covert ways of getting people's attention and orchestrating people's lives. And it's because most people don't know that that exists that this conversation is so important.

TH: Exacto. La razón por la que me preocupo tanto por este problema, es porque estudié en el Laboratorio de Tecnología Persuasiva en Stanford, el cual enseña a la gente exactamente estas técnicas. Hay conferencias y talleres que enseñan todas estas formas encubiertas, de capturar la atención de la gente y orquestar sus vidas. Y se debe a que la mayoría de la gente no sabe que eso existe, por eso esta conversación es tan importante.

CA: Tristan, you and I, we both know so many people from all these companies. There are actually many here in the room, and I don't know about you, but my experience of them is that there is no shortage of good intent. People want a better world. They are actually -- they really want it. And I don't think anything you're saying is that these are evil people. It's a system where there's these unintended consequences that have really got out of control --

CA: Tristan, tú y yo, ambos conocemos a muchas personas de todas estas compañías. De hecho, hay muchos de ellos aquí en la sala y no sé tú, pero mi experiencia con ellos no es que haya escasez de buena intención. La gente quiere un mundo mejor. De hechos, ellos realmente lo quieren. Y no creo que estés diciendo que sean personas malvadas. Es un sistema donde estas consecuencias no deseadas, se han salido de control... TH: por esta carrera por la atención, sí.

TH: Of this race for attention. It's the classic race to the bottom when you have to get attention, and it's so tense. The only way to get more is to go lower on the brain stem, to go lower into outrage, to go lower into emotion, to go lower into the lizard brain.

Es la carrera clásica hasta el final, cuando tienes que capturar la atención y es muy tensa. La única manera de obtener más es ir más bajo en el tronco encefálico, para ir más bajo en la indignación y las emociones, para ir más abajo en el cerebro reptiliano.

CA: Well, thank you so much for helping us all get a little bit wiser about this.

CA: Bueno, muchas gracias por ayudarnos a todos a ser un poco más sabios en esto.

Tristan Harris, thank you. TH: Thank you very much.

Tristan Harris, gracias. TH: Muchas gracias.

(Applause)

(Aplausos)