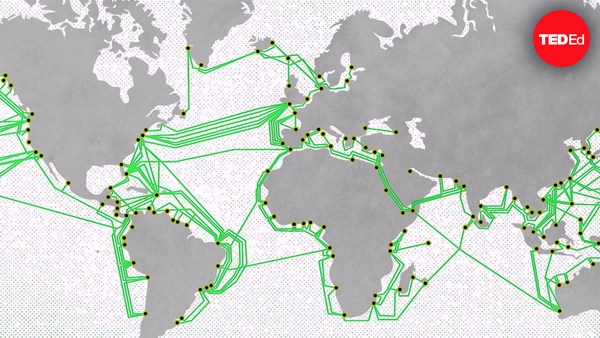

Big data is an elusive concept. It represents an amount of digital information, which is uncomfortable to store, transport, or analyze. Big data is so voluminous that it overwhelms the technologies of the day and challenges us to create the next generation of data storage tools and techniques. So, big data isn't new. In fact, physicists at CERN have been rangling with the challenge of their ever-expanding big data for decades. Fifty years ago, CERN's data could be stored in a single computer. OK, so it wasn't your usual computer, this was a mainframe computer that filled an entire building. To analyze the data, physicists from around the world traveled to CERN to connect to the enormous machine. In the 1970's, our ever-growing big data was distributed across different sets of computers, which mushroomed at CERN. Each set was joined together in dedicated, homegrown networks. But physicists collaborated without regard for the boundaries between sets, hence needed to access data on all of these. So, we bridged the independent networks together in our own CERNET. In the 1980's, islands of similar networks speaking different dialects sprung up all over Europe and the States, making remote access possible but torturous. To make it easy for our physicists across the world to access the ever-expanding big data stored at CERN without traveling, the networks needed to be talking with the same language. We adopted the fledgling internet working standard from the States, followed by the rest of Europe, and we established the principal link at CERN between Europe and the States in 1989, and the truly global internet took off! Physicists could easily then access the terabytes of big data remotely from around the world, generate results, and write papers in their home institutes. Then, they wanted to share their findings with all their colleagues. To make this information sharing easy, we created the web in the early 1990's. Physicists no longer needed to know where the information was stored in order to find it and access it on the web, an idea which caught on across the world and has transformed the way we communicate in our daily lives. During the early 2000's, the continued growth of our big data outstripped our capability to analyze it at CERN, despite having buildings full of computers. We had to start distributing the petabytes of data to our collaborating partners in order to employ local computing and storage at hundreds of different institutes. In order to orchestrate these interconnected resources with their diverse technologies, we developed a computing grid, enabling the seamless sharing of computing resources around the globe. This relies on trust relationships and mutual exchange. But this grid model could not be transferred out of our community so easily, where not everyone has resources to share nor could companies be expected to have the same level of trust. Instead, an alternative, more business-like approach for accessing on-demand resources has been flourishing recently, called cloud computing, which other communities are now exploiting to analyzing their big data. It might seem paradoxical for a place like CERN, a lab focused on the study of the unimaginably small building blocks of matter, to be the source of something as big as big data. But the way we study the fundamental particles, as well as the forces by which they interact, involves creating them fleetingly, colliding protons in our accelerators and capturing a trace of them as they zoom off near light speed. To see those traces, our detector, with 150 million sensors, acts like a really massive 3-D camera, taking a picture of each collision event - that's up to 14 millions times per second. That makes a lot of data. But if big data has been around for so long, why do we suddenly keep hearing about it now? Well, as the old metaphor explains, the whole is greater than the sum of its parts, and this is no longer just science that is exploiting this. The fact that we can derive more knowledge by joining related information together and spotting correlations can inform and enrich numerous aspects of everyday life, either in real time, such as traffic or financial conditions, in short-term evolutions, such as medical or meteorological, or in predictive situations, such as business, crime, or disease trends. Virtually every field is turning to gathering big data, with mobile sensor networks spanning the globe, cameras on the ground and in the air, archives storing information published on the web, and loggers capturing the activities of Internet citizens the world over. The challenge is on to invent new tools and techniques to mine these vast stores, to inform decision making, to improve medical diagnosis, and otherwise to answer needs and desires of tomorrow's society in ways that are unimagined today.

Dữ liệu lớn (Big Data) là một khái niệm khó nắm bắt. Nó đại diện cho một lượng lớn thông tin kĩ thuật số khó lưu trữ, di chuyển, hay phân tích. Dữ liệu lớn rất đồ sộ, nó lấn át các công nghệ ngày nay và thách thức chúng ta tạo ra thế hệ tiếp theo của công cụ và kỹ thuật lưu trữ dữ liệu. Dữ liệu lớn không phải là một khái niệm mới. Trong thực tế, các nhà vật lý học tại CERN đã tranh cãi với thách thức không ngừng mở rộng dữ liệu lớn trong nhiều thập kỷ. Năm mươi năm trước, dữ liệu của CERN đã có thể được lưu trữ trong một máy tính duy nhất. Vâng, nó không phải là máy tính thông thường của bạn, nó là một máy tính chính, mà diện tích lấp đầy cả một toà nhà. Để phân tích dữ liệu, các nhà vật lý học từ khắp nơi trên thế giới đến CERN để kết nối với cái máy khổng lồ này. Vào những năm 1970, dữ liệu lớn không ngừng phát triển của chúng ta được phân phối ra những bộ máy tính khác nhau, mọc lên như nấm tại CERN. Mỗi bộ gồm các máy tính được kết nối với nhau bằng mạng riêng chuyên dụng. Nhưng các nhà vật lý học cần phải hợp tác bất kể ranh giới giữa các bộ máy, và cần truy cập dữ liệu trên tất cả các bộ máy tính này. Do đó, chúng tôi tạo ra cầu nối nối các mạng độc lập lại với nhau tạo thành CERNET. Vào những năm 1980, rất nhiều những mạng tương tự sử dụng các ngôn ngữ địa phương khác nhau xuất hiện khắp châu Âu và Mỹ, hỗ trợ truy cập từ xa, nhưng còn nhiều khó khăn. Để giúp các nhà vật lý trên khắp thế giới dễ dàng truy cập dữ liệu lớn ngày càng mở rộng được lưu trữ tại CERN, mà không cần di chuyển, các mạng này cần phải nói cùng một ngôn ngữ với nhau. Chúng tôi thông qua các tiêu chuẩn hoạt động mạng Internet của Mỹ, và sau đó bởi châu Âu, và chúng tôi thành lập các liên kết chính tại CERN liên kết châu Âu và Mỹ vào năm 1989, và mạng Internet toàn cầu thực sự cất cánh từ đó! Các nhà vật lý sau đó có thể dễ dàng truy cập hàng terabyte dữ liệu lớn từ xa từ khắp nơi trên thế giới, nhờ đó, viết báo cáo ngay tại viện nhà. Sau đó, họ muốn chia sẻ các nghiên cứu với các đồng nghiệp. Để giúp việc chia sẻ thông tin được dễ dàng, chúng tôi tạo ra trang web vào đầu những năm 1990. Các nhà vật lý không còn cần phải biết thông tin được lưu trữ ở đâu để tìm và truy cập trên mạng, ý tưởng này lan rộng ra khắp thế giới và đã thay đổi cách chúng ta giao tiếp trong cuộc sống hàng ngày. Đầu những năm 2000, sự tăng trưởng liên tục của dữ liệu lớn vượt xa khả năng của chúng t để phân tích chúng tại CERN, mặc dù đã có các toà nhà đầy những máy tính. Chúng tôi phải bắt đầu phân phối lại hàng petabyte dữ liệu đến các đối tác hợp tác để sử dụng và lưu trữ trên máy tính nội bộ tại hàng trăm viện nghiên cứu. Để sắp xếp cho các nguồn lực này kết nối với nhau với các công nghệ đa dạng, chúng tôi phát triển một mạng lưới điện toán, tạo điều kiện để chia sẻ thông suốt các tài nguyên máy tính trên toàn cầu. Điều này dựa trên các mối quan hệ tin tưởng và trao đổi lẫn nhau. Nhưng mô hình mạng lưới này không thể được chuyển giao ra khỏi cộng đồng nghiên cứu một cách dễ dàng, nơi không phải ai cũng có nguồn tài nguyên để chia sẻ và các công ty cũng không cùng mức độ tin cậy như nhau. Thay vào đó, một phương pháp khác thay thế, chuyên nghiệp hơn để truy cập vào các nguồn tài nguyên theo yêu cầu đã được phát triển gần đây gọi là điện toán đám mây, mà các cộng đồng hiện nay đang khai thác để phân tích dữ liệu lớn. Nó giống như một nghịch lý khi một nơi như CERN, một phòng thí nghiệm tập trung vào nghiên cứu những khối vật chất nhỏ mà ta khó có thể tưởng tượng lại là nguồn gốc của một thứ to lớn như là dữ liệu lớn. Nhưng cách mà chúng tôi nghiên cứu hạt cơ bản cũng như các lực, và cách chúng tương tác, liên quan đến việc tạo ra chúng nhanh chóng, va chạm các proton trong máy gia tốc, và lưu giữ các dấu vết chúng để lại khi chúng phóng gần với tốc độ ánh sáng. Để thấy những dấu vết này, các máy nhận diện, với 150 triệu cảm ứng, hoạt động như một máy ảnh 3D cực lớn, chụp ảnh từng va chạm một - lên đến 14 triệu lần một giây. Nó tạo ra rất nhiều dữ liệu. Nhưng nếu dữ liệu lớn đã có mặt lâu như vậy, tại sao chúng ta đột nhiên cứ nghe nói về chúng gần đây? Vâng, như phép ẩn dụ cũ giải thích, toàn bộ là lớn hơn tổng của các bộ phận của nó, và không chỉ là khoa học mới khai thác điều này. Thưc tế là, chúng ta có thể lấy được nhiều kiến thức hơn bằng cách nối các thông tin liên quan với nhau và tìm điểm tương quan, có thể làm phong phú hơn nhiều khía cạnh của cuộc sống hàng ngày, trong thời gian thực, như giao thông hay điều kiện tài chính, trong diễn biến ngắn hạn như y tế hoặc khí tượng, hay để dự kiến các tình huống như xu hướng kinh doanh, tội phạm, hay bệnh dịch. Hầu như mọi lĩnh vực đang chuyển sang thu thập dữ liệu lớn, với mạng lưới cảm biến di động bao trùm toàn cầu, máy ảnh trên mặt đất, và trong không khí, lưu trữ dữ liệu đã được công bố trên mạng, và ghi chép lưu lại các hoạt động của các công dân mạng trên toàn thế giới. Thách thức là việc đầu tư vào các công cụ và kỹ thuật mới để khai thác nguồn tài nguyên khổng lồ để giúp cho việc ra quyết định, để cải thiện việc chẩn đoán y tế, còn nếu không thì để trả lời các nhu cầu vả mong muốn của xã hội ngày mai bằng cách mà hôm nay không hình dung ra được.