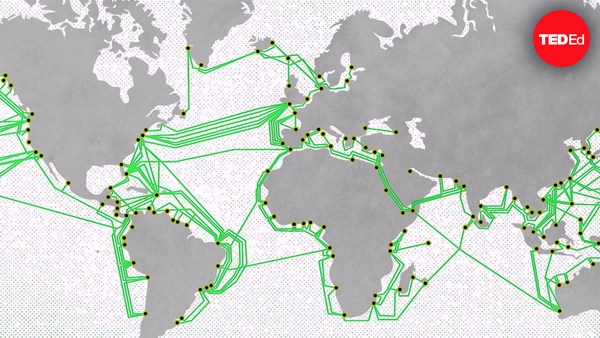

Big data is an elusive concept. It represents an amount of digital information, which is uncomfortable to store, transport, or analyze. Big data is so voluminous that it overwhelms the technologies of the day and challenges us to create the next generation of data storage tools and techniques. So, big data isn't new. In fact, physicists at CERN have been rangling with the challenge of their ever-expanding big data for decades. Fifty years ago, CERN's data could be stored in a single computer. OK, so it wasn't your usual computer, this was a mainframe computer that filled an entire building. To analyze the data, physicists from around the world traveled to CERN to connect to the enormous machine. In the 1970's, our ever-growing big data was distributed across different sets of computers, which mushroomed at CERN. Each set was joined together in dedicated, homegrown networks. But physicists collaborated without regard for the boundaries between sets, hence needed to access data on all of these. So, we bridged the independent networks together in our own CERNET. In the 1980's, islands of similar networks speaking different dialects sprung up all over Europe and the States, making remote access possible but torturous. To make it easy for our physicists across the world to access the ever-expanding big data stored at CERN without traveling, the networks needed to be talking with the same language. We adopted the fledgling internet working standard from the States, followed by the rest of Europe, and we established the principal link at CERN between Europe and the States in 1989, and the truly global internet took off! Physicists could easily then access the terabytes of big data remotely from around the world, generate results, and write papers in their home institutes. Then, they wanted to share their findings with all their colleagues. To make this information sharing easy, we created the web in the early 1990's. Physicists no longer needed to know where the information was stored in order to find it and access it on the web, an idea which caught on across the world and has transformed the way we communicate in our daily lives. During the early 2000's, the continued growth of our big data outstripped our capability to analyze it at CERN, despite having buildings full of computers. We had to start distributing the petabytes of data to our collaborating partners in order to employ local computing and storage at hundreds of different institutes. In order to orchestrate these interconnected resources with their diverse technologies, we developed a computing grid, enabling the seamless sharing of computing resources around the globe. This relies on trust relationships and mutual exchange. But this grid model could not be transferred out of our community so easily, where not everyone has resources to share nor could companies be expected to have the same level of trust. Instead, an alternative, more business-like approach for accessing on-demand resources has been flourishing recently, called cloud computing, which other communities are now exploiting to analyzing their big data. It might seem paradoxical for a place like CERN, a lab focused on the study of the unimaginably small building blocks of matter, to be the source of something as big as big data. But the way we study the fundamental particles, as well as the forces by which they interact, involves creating them fleetingly, colliding protons in our accelerators and capturing a trace of them as they zoom off near light speed. To see those traces, our detector, with 150 million sensors, acts like a really massive 3-D camera, taking a picture of each collision event - that's up to 14 millions times per second. That makes a lot of data. But if big data has been around for so long, why do we suddenly keep hearing about it now? Well, as the old metaphor explains, the whole is greater than the sum of its parts, and this is no longer just science that is exploiting this. The fact that we can derive more knowledge by joining related information together and spotting correlations can inform and enrich numerous aspects of everyday life, either in real time, such as traffic or financial conditions, in short-term evolutions, such as medical or meteorological, or in predictive situations, such as business, crime, or disease trends. Virtually every field is turning to gathering big data, with mobile sensor networks spanning the globe, cameras on the ground and in the air, archives storing information published on the web, and loggers capturing the activities of Internet citizens the world over. The challenge is on to invent new tools and techniques to mine these vast stores, to inform decision making, to improve medical diagnosis, and otherwise to answer needs and desires of tomorrow's society in ways that are unimagined today.

Большие данные — это сложное понятие. Это объём электронных данных, неудобный для хранения, передачи или анализа. Большие данные настолько объёмные, что для работы с ними недостаточно современных технологий, поэтому нам приходится разрабатывать новое поколение инструментов и способов для хранения данных. Большие данные появились давно. На самом деле, физики в ЦЕРН пытаются решить проблему растущего объёма больших данных десятилетиями. Пятьдесят лет назад все данные ЦЕРН помещались на один компьютер. Конечно, это был не просто компьютер, а большой суперкомпьютер, занимавший целое здание. Чтобы проанализировать данные, физики со всего мира приезжали в ЦЕРН и подключались к гигантской машине. В 1970-е постоянно растущий объём больших данных распределялся между несколькими группами компьютеров, созданных в ЦЕРН. Компьютеры в группах были соединены между собой как в специализированной домашней сети. Однако совместная работа физиков часто выходила за пределы таких групп и требовала доступа к данным на всех компьютерах. Было решено объединить независимые сети в общую сеть CERNET. В 1980-е по всей Европе и в США появилось множество сетей, использовавших разные протоколы. Удалённый доступ стал возможным, но всё ещё оставался затруднительным. Чтобы физикам со всего мира могли легко получать доступ к растущим большим данным, не приезжая в ЦЕРН, сети должны были общаться между собой на одном «языке». Был принят молодой рабочий стандарт для сети Интернет, появившийся в США и подхваченный Европой. Основное соединение между Европой и США было установлено в ЦЕРН в 1989-м году. С этого начался мировой Интернет. Физики со всего мира получили удалённый доступ к терабайтам больших данных, и теперь могли получать результаты и писать статьи, находясь в своих университетах. Затем учёные захотели делиться своими открытиями с коллегами. Чтобы помочь им в этом, в начале 90-х мы создали сеть. Физикам больше не нужно было знать, где храниться информация, чтобы найти и получить доступ к ней в сети. Эта идея распространилась по миру и преобразила наше повседневное общение. В начале 2000-х растущий объём больших данных превзошёл возможности ЦЕРН по их анализу, несмотря на целые ангары компьютеров в его распоряжении. Мы перешли к распределению петабайтов данных между нашими партнёрами, чтобы воспользоваться мощностью компьютеров в сотнях различных институтов. Чтобы взаимосвязанные, но разнообразные ресурсы могли работать слаженно, мы разработали вычислительную систему, которая позволяла беспрепятственно пользоваться вычислительными ресурсами по всему миру. Работа такой структуры опирается на доверие и взаимный обмен. Однако такую модель довольно сложно привить для использования в глобальной сети, где не каждый может предоставить такие ресурсы, и не все компании обладают должным уровнем доверия. Альтернативой стал более прагматичный и популярный в последнее время подход к решению проблемы доступа к ресурсам по запросу — облачные вычисления, которые теперь используются многими сообществами для анализа больших данных. Кажется парадоксальным, что ЦЕРН, лаборатория для исследования мельчайших частиц материи, могла породить что-то настолько массивное, как большие данные. Мы изучаем фундаментальные частицы и силы их взаимодействия путём их кратковременного воссоздания с помощью столкновения протонов в ускорителях и регистрации следов, оставляемых ими, когда они проносятся мимо со скоростью света. Чтобы увидеть такие следы наш детектор частиц, оборудованный 150 миллионами датчиков, работает как гигантская трёхмерная камера, регистрируя все столкновения — то есть около 14 миллионов раз в секунду. Это огромный объём данных. Но раз о больших данных известно так давно, почему вдруг все стали говорить о них сейчас? Как говорится, целое есть нечто большее, чем сумма его частей. Более того большими данными теперь оперирует не только наука. То, что мы теперь можем узнать больше, объединяя данные в одной области и выявляя взаимосвязи, может обогатить самые разные сферы жизни. Например, в режиме реального времени при анализе дорожно-транспортной или финансовой систем; при решении краткосрочных задач — в медицине и метеорологии; при прогнозировании — в бизнесе, криминалистике и эпидемиологии. Большие данные теперь применяются почти во всех областях. Для их сбора земной шар окутывают паутины мобильных датчиков; на земле и в воздухе размещены камеры; архивы хранят информацию, опубликованную в сети; программы регистрации фиксируют активность интернет-пользователей по всему миру. Перед нами снова стоит нелёгкая задача — нужны новые инструменты и методы для обработки данных в архивах, чтобы принимать взвешенные решения, улучшать качество медицинской диагностики; иными словами, найти такие способы удовлетворить нужды общества будущего, о которых мы не смеем даже помыслить сегодня.