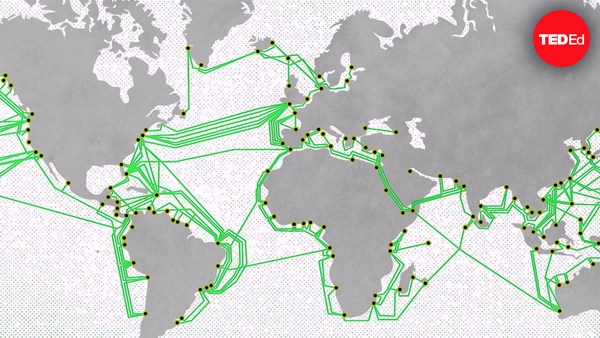

Big data is an elusive concept. It represents an amount of digital information, which is uncomfortable to store, transport, or analyze. Big data is so voluminous that it overwhelms the technologies of the day and challenges us to create the next generation of data storage tools and techniques. So, big data isn't new. In fact, physicists at CERN have been rangling with the challenge of their ever-expanding big data for decades. Fifty years ago, CERN's data could be stored in a single computer. OK, so it wasn't your usual computer, this was a mainframe computer that filled an entire building. To analyze the data, physicists from around the world traveled to CERN to connect to the enormous machine. In the 1970's, our ever-growing big data was distributed across different sets of computers, which mushroomed at CERN. Each set was joined together in dedicated, homegrown networks. But physicists collaborated without regard for the boundaries between sets, hence needed to access data on all of these. So, we bridged the independent networks together in our own CERNET. In the 1980's, islands of similar networks speaking different dialects sprung up all over Europe and the States, making remote access possible but torturous. To make it easy for our physicists across the world to access the ever-expanding big data stored at CERN without traveling, the networks needed to be talking with the same language. We adopted the fledgling internet working standard from the States, followed by the rest of Europe, and we established the principal link at CERN between Europe and the States in 1989, and the truly global internet took off! Physicists could easily then access the terabytes of big data remotely from around the world, generate results, and write papers in their home institutes. Then, they wanted to share their findings with all their colleagues. To make this information sharing easy, we created the web in the early 1990's. Physicists no longer needed to know where the information was stored in order to find it and access it on the web, an idea which caught on across the world and has transformed the way we communicate in our daily lives. During the early 2000's, the continued growth of our big data outstripped our capability to analyze it at CERN, despite having buildings full of computers. We had to start distributing the petabytes of data to our collaborating partners in order to employ local computing and storage at hundreds of different institutes. In order to orchestrate these interconnected resources with their diverse technologies, we developed a computing grid, enabling the seamless sharing of computing resources around the globe. This relies on trust relationships and mutual exchange. But this grid model could not be transferred out of our community so easily, where not everyone has resources to share nor could companies be expected to have the same level of trust. Instead, an alternative, more business-like approach for accessing on-demand resources has been flourishing recently, called cloud computing, which other communities are now exploiting to analyzing their big data. It might seem paradoxical for a place like CERN, a lab focused on the study of the unimaginably small building blocks of matter, to be the source of something as big as big data. But the way we study the fundamental particles, as well as the forces by which they interact, involves creating them fleetingly, colliding protons in our accelerators and capturing a trace of them as they zoom off near light speed. To see those traces, our detector, with 150 million sensors, acts like a really massive 3-D camera, taking a picture of each collision event - that's up to 14 millions times per second. That makes a lot of data. But if big data has been around for so long, why do we suddenly keep hearing about it now? Well, as the old metaphor explains, the whole is greater than the sum of its parts, and this is no longer just science that is exploiting this. The fact that we can derive more knowledge by joining related information together and spotting correlations can inform and enrich numerous aspects of everyday life, either in real time, such as traffic or financial conditions, in short-term evolutions, such as medical or meteorological, or in predictive situations, such as business, crime, or disease trends. Virtually every field is turning to gathering big data, with mobile sensor networks spanning the globe, cameras on the ground and in the air, archives storing information published on the web, and loggers capturing the activities of Internet citizens the world over. The challenge is on to invent new tools and techniques to mine these vast stores, to inform decision making, to improve medical diagnosis, and otherwise to answer needs and desires of tomorrow's society in ways that are unimagined today.

ビッグデータは とらえ所のない概念です 大量のデジタル情報のことを表しますが 保存したり 転送したり 分析することは困難です ビッグデータは大容量なので 現在の技術では扱い切れず 次世代のデータ保存ツールや技術を 創るという課題を突き付けてきます ビッグデータは新しいわけではありません 実際 CERNの物理学者は 数十年にも渡って 拡大を続けるビッグデータの挑戦に 立ち向かってきました 50年前 CERNのデータは 1台のコンピュータに保存可能でした 通常のコンピュータではなく 1つの建物を埋め尽くすほどの メインフレームという コンピュータを使っていました データを分析するために 世界中の物理学者がCERNにやって来て この巨大なマシンに接続していたのです 1970年代には 増殖を続けるビッグデータは CERNのあちこちにある 別々のコンピュータに 分散して保存されていました それぞれのコンピュータは 専用の自家製ネットワークで 接続されていました しかし物理学者は コンピュータ同士の 境界を越えて作業をしていたため しかし物理学者は コンピュータ同士の 境界を越えて作業をしていたため あらゆるコンピュータのデータに アクセスする必要がありました そこで私たちは 独立した ネットワークをまとめ CERNETという独自の ネットワークを構築したのです 1980年代には ヨーロッパやアメリカの至る所で 異なる方言を持つ 同様のネットワークが 増殖・拡大するようになり 遠隔アクセス自体は可能でしたが ひどく面倒でした 世界中の物理学者が CERNに保存された — 増殖を続けるビッグデータへのアクセスを 現地に行くこと無く 実現するためには あらゆるネットワークが 同じ言語を使う必要がありました 私たちは アメリカで標準となり ヨーロッパがそれに続いた 当時まだ未成熟なインターネットを採用し 1989年に CERNで 初めてヨーロッパと アメリカをつなぎました これが本当の意味での グローバルインターネットの始まりです それにより 物理学者は 何テラバイトものビッグデータに それにより 物理学者は 何テラバイトものビッグデータに 容易に遠隔アクセスできるようになり 結果を出したり — 出張無しで 研究所での論文執筆が 可能になりました 出張無しで 研究所での論文執筆が 可能になりました 新たな知見を 同僚と共有したいという ニーズが出てきました 新たな知見を 同僚と共有したいという ニーズが出てきました 情報共有を容易にするために 1990年代初頭にウェブを開発しました 物理学者は もう情報がどこに 保存されているのか 知る必要がなくなりました ウェブ上で情報を見つけ アクセスするために 世界中で話題となったアイデアは 日常生活におけるコミュニケーションを 一変させました 2000年代初頭にも ビッグデータは増殖を続けており CERNは建物一杯のコンピュータを 所有していたにも関わらず 解析能力を超えてしまい 何百もの施設でローカルに データを計算・保存させるため 何百もの施設でローカルに データを計算・保存させるため ペタバイト級のデータを パートナーのコンピュータに 分散させる必要が出てきました これらの相互接続されたリソースを 様々な技術を用いて 協調させるために グリッドコンピューティング技術を開発し 世界中の計算資源を シームレスに共有できるようにしました 信頼関係と相互交流に依存しますが このグリッドモデルでは コミュニティ外への データ転送は容易ではありませんでした 全員が共有できるだけのリソースを 持っていなかったり 企業に同レベルの信頼を置けるとは 限らないからです 最近では 必要に応じてリソースに アクセスするための代替案として クラウドコンピューティングという よりビジネスライクなアプローチが 盛んに用いられています これは今では 他のコミュニティーでも ビッグデータを分析するために 用いられています 逆説的ですが 想像もつかない程小さな素粒子の 逆説的ですが 想像もつかない程小さな素粒子の 研究に特化したCERNのような場が ビッグデータのような 大きなものの源となっているのです しかし 素粒子や その相互作用力を研究するには ほんの一瞬の間だけ素粒子を生成したり 加速器で陽子を衝突させたり 光速に近い速度まで加速する — 素粒子の軌道を観測したり しなければなりません 軌道を観測するために 1.5億個のセンサーが付いた検出器が 大規模3Dカメラのように振る舞い 1秒間に最大1400万回発生する 衝突のそれぞれを撮影するため 大量のデータが生成されます しかしビッグデータが これほど長く存在していたのなら 最近 突然その言葉をよく聞くように なったのはなぜでしょう? 昔からの比喩にあるように 集団は部分の総和より大きな力を発揮します これは科学に限ったことではありません 関連した情報をまとめたり 相関を見抜いたりすることで より多くの知識が得られ それが日常生活を様々な面で 豊かにしてくれるのです 渋滞や経済状況など リアルタイムのことであったり 医療や気象といった 短期間の変化であったり ビジネスや犯罪 病気の流行などを 予測するといった場面でも有効です 事実上全ての分野が ビッグデータを集めるようになってきています モバイルセンサーネットワークは 地球全体に広がり カメラが地上や空中に存在しており またウェブ上の情報はアーカイブに保存され 世界中のインターネット利用者の 活動記録は全てログに 記録されるようになっています 課題となるのは 新たなツールや技術を開発し 大量のデータから情報を集め 意思決定に役立てたり 医療診断を改善したり 今日では想像もできない — 未来の社会のニーズや要求に応えることです