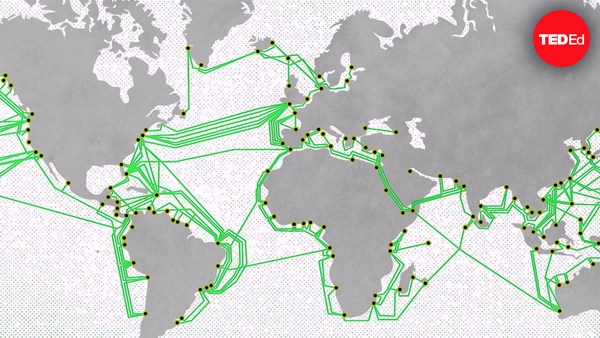

Big data is an elusive concept. It represents an amount of digital information, which is uncomfortable to store, transport, or analyze. Big data is so voluminous that it overwhelms the technologies of the day and challenges us to create the next generation of data storage tools and techniques. So, big data isn't new. In fact, physicists at CERN have been rangling with the challenge of their ever-expanding big data for decades. Fifty years ago, CERN's data could be stored in a single computer. OK, so it wasn't your usual computer, this was a mainframe computer that filled an entire building. To analyze the data, physicists from around the world traveled to CERN to connect to the enormous machine. In the 1970's, our ever-growing big data was distributed across different sets of computers, which mushroomed at CERN. Each set was joined together in dedicated, homegrown networks. But physicists collaborated without regard for the boundaries between sets, hence needed to access data on all of these. So, we bridged the independent networks together in our own CERNET. In the 1980's, islands of similar networks speaking different dialects sprung up all over Europe and the States, making remote access possible but torturous. To make it easy for our physicists across the world to access the ever-expanding big data stored at CERN without traveling, the networks needed to be talking with the same language. We adopted the fledgling internet working standard from the States, followed by the rest of Europe, and we established the principal link at CERN between Europe and the States in 1989, and the truly global internet took off! Physicists could easily then access the terabytes of big data remotely from around the world, generate results, and write papers in their home institutes. Then, they wanted to share their findings with all their colleagues. To make this information sharing easy, we created the web in the early 1990's. Physicists no longer needed to know where the information was stored in order to find it and access it on the web, an idea which caught on across the world and has transformed the way we communicate in our daily lives. During the early 2000's, the continued growth of our big data outstripped our capability to analyze it at CERN, despite having buildings full of computers. We had to start distributing the petabytes of data to our collaborating partners in order to employ local computing and storage at hundreds of different institutes. In order to orchestrate these interconnected resources with their diverse technologies, we developed a computing grid, enabling the seamless sharing of computing resources around the globe. This relies on trust relationships and mutual exchange. But this grid model could not be transferred out of our community so easily, where not everyone has resources to share nor could companies be expected to have the same level of trust. Instead, an alternative, more business-like approach for accessing on-demand resources has been flourishing recently, called cloud computing, which other communities are now exploiting to analyzing their big data. It might seem paradoxical for a place like CERN, a lab focused on the study of the unimaginably small building blocks of matter, to be the source of something as big as big data. But the way we study the fundamental particles, as well as the forces by which they interact, involves creating them fleetingly, colliding protons in our accelerators and capturing a trace of them as they zoom off near light speed. To see those traces, our detector, with 150 million sensors, acts like a really massive 3-D camera, taking a picture of each collision event - that's up to 14 millions times per second. That makes a lot of data. But if big data has been around for so long, why do we suddenly keep hearing about it now? Well, as the old metaphor explains, the whole is greater than the sum of its parts, and this is no longer just science that is exploiting this. The fact that we can derive more knowledge by joining related information together and spotting correlations can inform and enrich numerous aspects of everyday life, either in real time, such as traffic or financial conditions, in short-term evolutions, such as medical or meteorological, or in predictive situations, such as business, crime, or disease trends. Virtually every field is turning to gathering big data, with mobile sensor networks spanning the globe, cameras on the ground and in the air, archives storing information published on the web, and loggers capturing the activities of Internet citizens the world over. The challenge is on to invent new tools and techniques to mine these vast stores, to inform decision making, to improve medical diagnosis, and otherwise to answer needs and desires of tomorrow's society in ways that are unimagined today.

Big data adalah sebuah konsep yang sulit dipahami. Ia mewakili sejumlah informasi digital, yang kurang nyaman untuk di simpan, dipindahkan, atau dianalisis. Big data sangatlah luas hingga membanjiri dunia teknologi saat ini dan menantang kita untuk menciptakan peralatan dan teknik-teknik generasi lanjut dari penyimpanan data. Jadi, Big Data tidaklah baru. Pada nyatanya, fisikawan di CERN telah bergulat dengan tantangan big data mereka yang terus berkembang selama beberapa dekade. Lima puluh tahun lalu, data CERN dapat disimpan di dalam sebuah komputer. Oke, ini bukanlah komputer biasa, ini adalah komputer mainframe yang memenuhi seluruh gedung. Untuk menganalisa data, fisikawan dari seluruh dunia pergi menuju CERN untuk terhubung ke mesin yang besar tersebut. Pada tahun 1970-an, Big Data kami yang terus berkembang didistribusikan ke berbagai perangkat komputer berbeda yang berkembang di CERN. Setiap perangkat digabung di dalam jaringan-jaringan lokal khusus. Namun, fisikawan berkolaborasi tanpa mempertimbangkan batasan antar perangkat, sehingga memerlukan akses data ke seluruh perangkat ini. Jadi, kami hubungkan jaringan mandiri itu di CERNET kami sendiri. Di tahun 1980-an, pulau-pulau dengan jaringan yang serupa berbicara dialek yang berbeda bermunculan di seluruh Eropa dan Amerika Serikat, membuat akses jarak jauh memungkinkan tapi menyiksa. Untuk membuat fisikawan kami di seluruh dunia mudah mengakses big data yang terus berkembang yang disimpan di CERN tanpa perlu bepergian, jaringan perlu berbicara menggunakan bahasa yang sama. Kami mengadopsi standar kerja internet baru dari Amerika Serikat, diikuti oleh Eropa, dan kami mendirikan tautan utama di CERN antara Eropa dan Amerika Serikat di tahun 1989, dan internet yang benar-benar global lepas landas! Fisikawan dapat mudah mengakses terabyte dari big data dari seluruh dunia, menghasilkan sesuatu, dan menulis makalah di institusi asal mereka. Lalu, berbagi hasil penemuan dengan semua rekan mereka. Untuk membuatnya mudah, kami membuat web di awal tahun 1990-an. Fisikawan tidak lagi perlu untuk tahu di mana informasi disimpan untuk mencari dan mengaksesnya di web, sebuah ide yang jadi populer di seluruh dunia dan telah mengubah cara kita berkomunikasi di kehidupan kita sehari-hari. Di awal tahun 2000-an, perkembangan big data kami yang berlanjut melampaui kemampuan kami untuk menganalisanya di CERN, meskipun memiliki gedung-gedung penuh komputer. Kami harus mulai mendistribusikan petabyte data pada mitra kerja sama kami agar dapat menggunakan komputasi dan penyimpanan lokal di ratusan institusi berbeda. Untuk mengatur sumber yang saling berhubungan ini dengan teknologi mereka yang beragam, kami kembangkan jaringan komputasi, memungkinkan pembagian mulus sumber daya komputasi di seluruh dunia. Ini bergantung pada hubungan kepercayaan dan pertukaran timbal baik. Tapi model grid ini tidak dapat ditransfer keluar dari komunitas kami dengan mudah, dimana tidak semua orang punya sumber ataupun perusahaan yang bisa diharapkan memiliki tingkat kepercayaan yang sama. Sebaliknya, alternatif pendekatan bergaya bisnis untuk mengakses sumber sesuai permintaan sedang berkembang pesat akhir-akhir ini, yang bernama cloud computing, yang dieksploitasi komunitas lain untuk menganalisa big data mereka. Ini mungkin terlihat paradoksal untuk tempat seperti CERN, lab yang fokus pada studi bahan penyusun materi yang tak terbayang kecilnya, sebagai sumber dari sesuatu yang besar seperti big data. Tapi cara mempelajari partikel fundamental, serta kekuatan di mana mereka berinteraksi, melibatkan pembuatan cepat, dengan membenturkan proton dalam akselerator kami dan menangkap jejak mereka saat mereka melesat mendekati kecepatan cahaya. Untuk melihat jejak itu, detektor kami, dengan 150 juta sensor, berfungsi layaknya sebuah kamera 3-D sangat besar, mengambil gambar setiap peristiwa tabrakan - hingga 14 juta kali setiap detiknya. Itu menghasilkan data yang banyak. Tetapi jika big data sudah ada sejak lama, kenapa tiba-tiba kita terus mendengarnya sekarang? Yah, seperti metafora kuno, keseluruhan lebih besar daripada jumlah bagian-bagiannya, dan ini tidak lagi hanya sains yang mengeksploitasinya. Fakta kita mendapat pengetahuan lebih dengan menggabungkan informasi terkait dan menemukan korelasinya dapat menginformasi dan memperkaya aspek kehidupan sehari-hari, entah secara nyata, seperti kondisi lalu lintas atau finansial, dalam evolusi jangka pendek, seperti medis atau meteorologi, atau dalam situasi prediksi, seperti bisnis, kejahatan, atau tren penyakit. Hampir setiap bidang beralih untuk mengumpulkan big data, dengan sensor jaringan seluler menjangkau dunia, kamera di darat dan di udara, arsip simpanan informasi yang dipublikasikan di web, dan logger yang merekam aktivitas warga Internet di seluruh dunia. Tantangannya adalah menciptakan alat dan teknik baru untuk menambang simpanan yang luas ini, menginformasi pengambilan keputusan, memperbaiki diagnosis medis, juga untuk menjawab kebutuhan dan keinginan dari masyarakat masa depan dengan cara yang tidak terbayangkan hari ini.