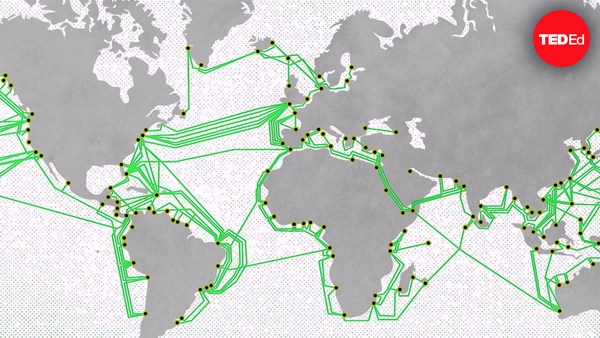

Big data is an elusive concept. It represents an amount of digital information, which is uncomfortable to store, transport, or analyze. Big data is so voluminous that it overwhelms the technologies of the day and challenges us to create the next generation of data storage tools and techniques. So, big data isn't new. In fact, physicists at CERN have been rangling with the challenge of their ever-expanding big data for decades. Fifty years ago, CERN's data could be stored in a single computer. OK, so it wasn't your usual computer, this was a mainframe computer that filled an entire building. To analyze the data, physicists from around the world traveled to CERN to connect to the enormous machine. In the 1970's, our ever-growing big data was distributed across different sets of computers, which mushroomed at CERN. Each set was joined together in dedicated, homegrown networks. But physicists collaborated without regard for the boundaries between sets, hence needed to access data on all of these. So, we bridged the independent networks together in our own CERNET. In the 1980's, islands of similar networks speaking different dialects sprung up all over Europe and the States, making remote access possible but torturous. To make it easy for our physicists across the world to access the ever-expanding big data stored at CERN without traveling, the networks needed to be talking with the same language. We adopted the fledgling internet working standard from the States, followed by the rest of Europe, and we established the principal link at CERN between Europe and the States in 1989, and the truly global internet took off! Physicists could easily then access the terabytes of big data remotely from around the world, generate results, and write papers in their home institutes. Then, they wanted to share their findings with all their colleagues. To make this information sharing easy, we created the web in the early 1990's. Physicists no longer needed to know where the information was stored in order to find it and access it on the web, an idea which caught on across the world and has transformed the way we communicate in our daily lives. During the early 2000's, the continued growth of our big data outstripped our capability to analyze it at CERN, despite having buildings full of computers. We had to start distributing the petabytes of data to our collaborating partners in order to employ local computing and storage at hundreds of different institutes. In order to orchestrate these interconnected resources with their diverse technologies, we developed a computing grid, enabling the seamless sharing of computing resources around the globe. This relies on trust relationships and mutual exchange. But this grid model could not be transferred out of our community so easily, where not everyone has resources to share nor could companies be expected to have the same level of trust. Instead, an alternative, more business-like approach for accessing on-demand resources has been flourishing recently, called cloud computing, which other communities are now exploiting to analyzing their big data. It might seem paradoxical for a place like CERN, a lab focused on the study of the unimaginably small building blocks of matter, to be the source of something as big as big data. But the way we study the fundamental particles, as well as the forces by which they interact, involves creating them fleetingly, colliding protons in our accelerators and capturing a trace of them as they zoom off near light speed. To see those traces, our detector, with 150 million sensors, acts like a really massive 3-D camera, taking a picture of each collision event - that's up to 14 millions times per second. That makes a lot of data. But if big data has been around for so long, why do we suddenly keep hearing about it now? Well, as the old metaphor explains, the whole is greater than the sum of its parts, and this is no longer just science that is exploiting this. The fact that we can derive more knowledge by joining related information together and spotting correlations can inform and enrich numerous aspects of everyday life, either in real time, such as traffic or financial conditions, in short-term evolutions, such as medical or meteorological, or in predictive situations, such as business, crime, or disease trends. Virtually every field is turning to gathering big data, with mobile sensor networks spanning the globe, cameras on the ground and in the air, archives storing information published on the web, and loggers capturing the activities of Internet citizens the world over. The challenge is on to invent new tools and techniques to mine these vast stores, to inform decision making, to improve medical diagnosis, and otherwise to answer needs and desires of tomorrow's society in ways that are unimagined today.

Le « Big Data » - les données massives - est une notion insaisissable, qui représente une quantité d'informations numériques, très difficile à stocker, de transporter, ou d'analyser. Le Big Data est si volumineux qu'il submerge les technologies d'aujourd'hui et nous pousse à créer la prochaine génération d'outils et de techniques de stockage de données. Le Big Data n'est pas nouveau. En effet, les physiciens du CERN bataillent avec le problème de leurs données massives en constante expansion depuis des décennies. Il y a cinquante ans, les données du CERN pouvaient être stockées dans un seul ordinateur. Certes, ce n'était pas un ordinateur habituel, il s'agissait d'un ordinateur central qui remplissait un bâtiment entier. Pour analyser les données, les physiciens du monde entier se rendaient au CERN pour se connecter à l'énorme machine. Dans les années 1970, nos données massives en croissance constante ont été réparties à travers différents ensembles d'ordinateurs, qui se sont multipliés au CERN. Chaque ensemble était relié dans les réseaux dédiés, faits sur place. Mais les physiciens collaboraient sans tenir compte des frontières entre les ensembles, et avaient donc besoin d'accéder aux données sur tous les ensembles. Alors, nous avons connecté les réseaux indépendants ensemble dans notre propre CERNET. Dans les années 1980, des îles de réseaux similaires parlant des dialectes différents ont surgi dans toute l'Europe et les États-Unis, rendant l'accès distant possible mais tortueux. Pour faciliter à nos physiciens du monde entier l'accès aux données massives sans cesse croissantes stockées au CERN sans se déplacer, les réseaux devaient parler la même langue. Nous avons adopté la norme de travail d'Internet naissante des États-Unis, suivis par le reste de l'Europe, et nous avons établi le lien principal du CERN entre l'Europe et les États-Unis en 1989, et le véritable internet mondial a décollé ! Les physiciens pouvaient alors facilement accéder aux téraoctets de données massives à distance de partout dans le monde, générer des résultats, et écrire des publications dans leurs établissements d'accueil. Puis, ils ont voulu partager leurs découvertes avec tous leurs collègues. Pour faciliter ce partage de l'information nous avons créé le web au début des années 1990. Les physiciens n'avaient plus besoin de savoir où l'information était stockée pour la trouver et y accéder sur le web, une idée qui a pris à travers le monde et a transformé la façon dont nous communiquons dans notre vie quotidienne. Dans le début des années 2000, la croissance continue de nos données massives a dépassé notre capacité à l'analyser au CERN, malgré les bâtiments pleins d'ordinateurs. Nous avons dû commencer à distribuer les pétaoctets de données à nos partenaires afin d'employer l'informatique et le stockage locaux dans des centaines d'instituts différents. Pour orchestrer ces ressources interconnectées avec leurs diverses technologies, nous avons élaboré une grille de calcul, permettant le partage sans soudure des ressources informatiques partout dans le monde. Elle repose sur des relations de confiance et d'échange mutuel. Mais ce modèle de grille n'a pas pu être transféré hors de notre communauté si facilement, où tout le monde ne dispose pas de ressources à partager ni d'entreprises dont on puisse attendre qu'elles aient le même niveau de confiance. Au lieu de cela, une approche alternative, plus proche du fonctionnement des affaires, pour accéder à des ressources à la demande s'est généralisé récemment, c'est ce qu'on appelle le « cloud computing », que les autres communautés exploitent désormais pour l'analyse de leurs données massives. Il peut sembler paradoxal pour un endroit comme le CERN, qu'un laboratoire centré sur l'étude des éléments constitutifs de la matière, incroyablement petits, soit à l'origine de quelque chose d'aussi gros que des données massives. Mais la façon dont nous étudions les particules fondamentales, ainsi que les forces par lesquelles elles interagissent, consiste à les créer fugitivement, en créant des collisions de protons dans nos accélérateurs et en capturant leur trace quand ils partent à une vitesse proche de la lumière. Pour voir ces traces, notre détecteur, avec 150 millions de capteurs, agit comme une caméra 3D vraiment massive, qui prend une photo de chaque collision - c'est jusqu'à 14 millions de fois par seconde. Ça fait beaucoup de données. Mais si les données massives existent depuis si longtemps, pourquoi soudain en entend-on parler tout le temps maintenant ? Eh bien, comme l'explique la métaphore ancienne, le tout est plus grand que la somme de ses parties, et ce n'est donc plus seulement la science qui les exploite. Le fait que nous pouvons tirer plus de connaissances en réunissant les informations connexes et en repérant des corrélations peut informer et enrichir les nombreux aspects de la vie quotidienne soit en temps réel, comme le trafic ou les conditions financières, dans les évolutions à court terme, telles que situations médicales ou météorologique, ou dans des situations prédictives, comme les tendances en affaires, le crime ou les maladies. Pratiquement tous les domaines se tournent vers la collecte de données massives, avec les réseaux de capteurs mobiles couvrant le globe, les caméras sur le terrain et dans les airs, les archives qui stockent les informations publiées sur le web, et les enregistreurs qui capturent les activités des citoyens de l'Internet partout dans le monde. Le défi consiste à inventer de nouveaux outils et techniques pour exploiter ces vastes stockages, d'informer le processus décisionnel, pour améliorer le diagnostic médical, et sinon pour répondre aux besoins et désirs de la société de demain de façons qui sont inimaginables aujourd'hui.