Up until now, our communication with machines has always been limited to conscious and direct forms. Whether it's something simple like turning on the lights with a switch, or even as complex as programming robotics, we have always had to give a command to a machine, or even a series of commands, in order for it to do something for us. Communication between people, on the other hand, is far more complex and a lot more interesting because we take into account so much more than what is explicitly expressed. We observe facial expressions, body language, and we can intuit feelings and emotions from our dialogue with one another. This actually forms a large part of our decision-making process. Our vision is to introduce this whole new realm of human interaction into human-computer interaction so that computers can understand not only what you direct it to do, but it can also respond to your facial expressions and emotional experiences. And what better way to do this than by interpreting the signals naturally produced by our brain, our center for control and experience.

Донедавна наше спілкування з машинами обмежувалось свідомими чи прямими формами спілкування. Будь це щось просте, як вмикання світла за допомогою вимикача, чи навіть щось складне на зразок програмування роботів - машині завжди потрібно давати команду, чи навіть серію команд, для того, щоб вона зробила щось для людини. З іншої сторони, спілкування між людьми є значно складнішим і цікавішим, оскільки враховується значно більше, аніж те, що висловлено в процесі спілкування. Ми помічаємо вирази обличчя, жести, вгадуємо почуття та емоції співрозмовника, розмовляючи з ним. Це в великій мірі визначає наш процес прийняття рішень. Нашою ціллю є перенести цілий пласт людського спілкування у сферу спілкування людини з комп'ютером, щоб машина могла розуміти не лише наші прямі вказівки, але й могла реагувати на наш вираз обличчя і емоційні переживання. І найкращим способом досягнення цього є інтерпретація сигналів нашого мозку - центру, що відповідає за контроль і відчуття.

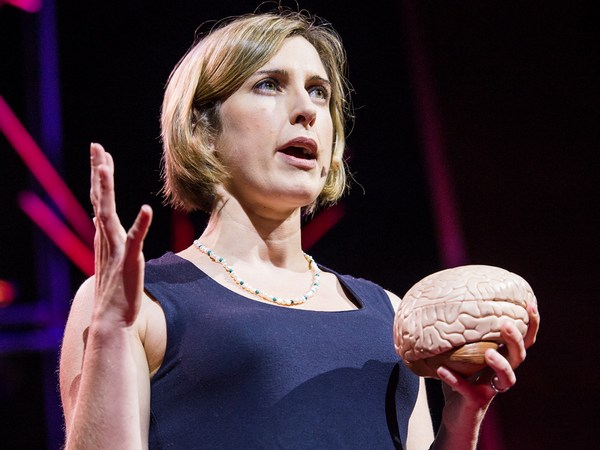

Well, it sounds like a pretty good idea, but this task, as Bruno mentioned, isn't an easy one for two main reasons: First, the detection algorithms. Our brain is made up of billions of active neurons, around 170,000 km of combined axon length. When these neurons interact, the chemical reaction emits an electrical impulse, which can be measured. The majority of our functional brain is distributed over the outer surface layer of the brain, and to increase the area that's available for mental capacity, the brain surface is highly folded. Now this cortical folding presents a significant challenge for interpreting surface electrical impulses. Each individual's cortex is folded differently, very much like a fingerprint. So even though a signal may come from the same functional part of the brain, by the time the structure has been folded, its physical location is very different between individuals, even identical twins. There is no longer any consistency in the surface signals.

Начебто, непогана ідея, проте ця задача, як зауважив у вступному слові Бруно, не є легкою з двох основних причин: Першою є алгоритм розпізнавання. Наш мозок складається з мільярдів активних нейронів, із загальною довжиною всіх аксонів приблизно 170 тисяч кілометрів. При взаємодії цих нейронів проходить хімічна реакція, що виділяє електричний імпульс, який можна виміряти. Більшість робочої частини мозку розташована вздовж зовнішньої поверхні кори мозку. І, для збільшення площі, здатної до проведення розумових операцій, поверхня мозку повна звивин. І саме ці звивини кори мозку є значною перепоною для інтерпретації поверхневих електронних імпульсів. Кора мозку кожної людини є індивідуальною, майже як відбиток пальця. Тому, навіть якщо сигнал поступає з тієї ж функціональної частини мозку, до того часу, як структура мозку вже склалась, її фізичне розташування буде дуже різним між людьми, навіть між однояйцевими близнюками. І серед поверхневих сигналів не буде жодного співвідношення.

Our breakthrough was to create an algorithm that unfolds the cortex, so that we can map the signals closer to its source, and therefore making it capable of working across a mass population. The second challenge is the actual device for observing brainwaves. EEG measurements typically involve a hairnet with an array of sensors, like the one that you can see here in the photo. A technician will put the electrodes onto the scalp using a conductive gel or paste and usually after a procedure of preparing the scalp by light abrasion. Now this is quite time consuming and isn't the most comfortable process. And on top of that, these systems actually cost in the tens of thousands of dollars.

Нашим відкриттям було створення алгоритму, котрий начебто "випрямляє" звивини мозку, і таким чином дозволяє точніше визначити джерело сигналу, що уможливлює його ширше застосування. Іншим завданням є, власне, створення пристрою спостереження за хвилями мозку. Зазвичай, при проведенні ЕЕГ довкола голови сплітають сенсорну сітку, схожу на ту, що ви бачите на цьому фото. Технічний працівник розміщує електроди на поверхні голови людини, використовуючи електропровідний гель, і перед тим очищує шкіру голови від мертвих клітин для покращення контакту з електродами. Це досить тривала і далеко не найприємніша процедура. І до того ж, така система обходиться в десятки тисяч доларів.

So with that, I'd like to invite onstage Evan Grant, who is one of last year's speakers, who's kindly agreed to help me to demonstrate what we've been able to develop.

Отже, зараз я хочу запросити на сцену Евана Гранта, який виступав тут минулого року, і який люб'язно погодився допомогти мені продемонструвати наші досягнення

(Applause)

(Аплодисменти)

So the device that you see is a 14-channel, high-fidelity EEG acquisition system. It doesn't require any scalp preparation, no conductive gel or paste. It only takes a few minutes to put on and for the signals to settle. It's also wireless, so it gives you the freedom to move around. And compared to the tens of thousands of dollars for a traditional EEG system, this headset only costs a few hundred dollars. Now on to the detection algorithms. So facial expressions -- as I mentioned before in emotional experiences -- are actually designed to work out of the box with some sensitivity adjustments available for personalization. But with the limited time we have available, I'd like to show you the cognitive suite, which is the ability for you to basically move virtual objects with your mind.

Отже, перед вами 14-канальна система високоточного прийому ЕЕГ. Вона не потребує ні підготовки шкіри голови, ні електропровідного гелю. Потрібно лише кілька хвилин щоб під'єднати її і зробити настройку сигналів. Цей пристрій також безпровідний, що дає свободу пересування. І в порівнянні з десятками тисяч доларів, що складають ціну традиційної ЕЕГ системи, наш пристрій коштує лише кілька сотень доларів. Перейдемо до алгоритмів розпізнавання. Отже, вирази обличчя. Говорячи про емоційні переживання, я вже казала, що вони можуть розпізнаватись майже відразу, провівши регуляцію чутливості на індивідуальні особливості. Але, враховуючи обмеження у часі, я хочу продемонструвати вам когнітивний пакет програм, який, фактично, дозволяє вам маніпулювати віртуальними об'єктами за допомогою думки.

Now, Evan is new to this system, so what we have to do first is create a new profile for him. He's obviously not Joanne -- so we'll "add user." Evan. Okay. So the first thing we need to do with the cognitive suite is to start with training a neutral signal. With neutral, there's nothing in particular that Evan needs to do. He just hangs out. He's relaxed. And the idea is to establish a baseline or normal state for his brain, because every brain is different. It takes eight seconds to do this, and now that that's done, we can choose a movement-based action. So Evan, choose something that you can visualize clearly in your mind.

Отже, Еван ще не працював з цією системою, тому для початку ми створюємо для нього новий профіль. "Джоанна" очевидно не підійде, тому ми додаємо нового користувача. Еван. Добре. Перше, що нам необхідно зробити в когнітивній програмі - це задати нейтральний сигнал. Для цього Евану нічого не потрібно робити. Просто розслабитись. Основною ціллю є встановити вихідні параметри нормального стану його мозку, оскільки кожен мозок є індивідуальним. Це займає вісім секунд. І після цього ми можемо вибрати рух, що виконуватиметься об’єктом. Отже, Еван, обери те, що ти можеш чітко уявити візуально.

Evan Grant: Let's do "pull."

Еван Грант: Хай це буде "притягування".

Tan Le: Okay, so let's choose "pull." So the idea here now is that Evan needs to imagine the object coming forward into the screen, and there's a progress bar that will scroll across the screen while he's doing that. The first time, nothing will happen, because the system has no idea how he thinks about "pull." But maintain that thought for the entire duration of the eight seconds. So: one, two, three, go. Okay. So once we accept this, the cube is live. So let's see if Evan can actually try and imagine pulling. Ah, good job! (Applause) That's really amazing.

Тан Лі: Добре, вибираємо "притягування". Отже, ідея в тому, що зараз Еван повинен уявити собі, як об’єкт наближається на екрані. Індикатор на екрані відображатиме степінь виконання операції. На перший раз нічого не станеться, оскільки система не знає як Еван уявляє "притягування". Утримуй цю думку протягом усіх восьми секунд. Отже: раз, два, три, поїхали! Добре. Отже, як тільки ми це підтвердимо, куб працюватиме в живому режимі. Тепер подивимось, чи Еван дійсно може уявити притягування. Прекрасно! (Аплодисменти) Просто дивовижно!

(Applause)

(Аплодисменти)

So we have a little bit of time available, so I'm going to ask Evan to do a really difficult task. And this one is difficult because it's all about being able to visualize something that doesn't exist in our physical world. This is "disappear." So what you want to do -- at least with movement-based actions, we do that all the time, so you can visualize it. But with "disappear," there's really no analogies -- so Evan, what you want to do here is to imagine the cube slowly fading out, okay. Same sort of drill. So: one, two, three, go. Okay. Let's try that. Oh, my goodness. He's just too good. Let's try that again.

У нас залишилось трохи часу, тому я попрошу Евана зробити дійсно важке завдання. Це завдання є важким, оскільки передбачає здатність візуалізувати те, чого не існує в фізичному світі. А саме - "зникнення". Справа в тому, що дії, основані на русі ми виконуємо постійно, а тому можемо їх візуалізувати. Проте "зникнення" не має таких аналогій. Отже, Еван, тобі потрібно уявити, як куб повільно зникає. Спочатку, такий же тренінг. Отже, раз, два, три - поїхали! Добре, давайте спробуємо. О, Боже! Як чудово у нього це виходить! Давайте спробуємо знову.

EG: Losing concentration.

ЕГ: Не можу зосередитись.

(Laughter)

(Сміх)

TL: But we can see that it actually works, even though you can only hold it for a little bit of time. As I said, it's a very difficult process to imagine this. And the great thing about it is that we've only given the software one instance of how he thinks about "disappear." As there is a machine learning algorithm in this --

ТЛ: Отже, ми бачимо, що ця річ дійсно працює, хоч нам і вдалось утримати її на дуже короткий час. Як я вже казала, уявити цей процес дуже важко. Варто згадати, що ми дали машині лише один приклад того, як він уявляє собі "зникнення". І, оскільки ми маємо справу з алгоритмом машинного навчання --

(Applause)

(Аплодисменти)

Thank you. Good job. Good job.

Дякую. Прекрасно. Молодець!

(Applause)

(Аплодисменти)

Thank you, Evan, you're a wonderful, wonderful example of the technology.

Дякую, Еван, ти прекрасно продемонстрував можливості цієї програми.

So, as you can see, before, there is a leveling system built into this software so that as Evan, or any user, becomes more familiar with the system, they can continue to add more and more detections, so that the system begins to differentiate between different distinct thoughts. And once you've trained up the detections, these thoughts can be assigned or mapped to any computing platform, application or device.

Отже, як ви вже бачили, ця програма побудована на системі співвідношень, котра дозволяє Евану, чи будь-якому іншому користувачеві, постійно працюючи із системою, додавати все більше і більше елементів розпізнавання, таким чином дозволяючи системі розпізнавати окремі думки. І як тільки етап розпізнавання буде завершено - ці думки можна буде відображати на будь-яких обчислювальних платформах, програмах чи пристроях.

So I'd like to show you a few examples, because there are many possible applications for this new interface. In games and virtual worlds, for example, your facial expressions can naturally and intuitively be used to control an avatar or virtual character. Obviously, you can experience the fantasy of magic and control the world with your mind. And also, colors, lighting, sound and effects can dynamically respond to your emotional state to heighten the experience that you're having, in real time. And moving on to some applications developed by developers and researchers around the world, with robots and simple machines, for example -- in this case, flying a toy helicopter simply by thinking "lift" with your mind.

Я продемонструю лише кілька прикладів, хоча потенціал застосування цього нового інтерфейсу є величезним. Для прикладу, у комп’ютерних іграх чи віртуальному світі ваш вираз обличчя можна природно та інтуїтивно застосовувати для керування аватаром чи віртуальним персонажем. Очевидно, ви можете застосовувати віртуальну магію і контролювати світ силою думки. Окрім цього, кольори, освітлення, звуки та інші ефекти можуть динамічно змінюватись в залежності від вашого емоційного стану для підсилення ваших відчуттів в реальному часі. Отож, перейдемо до деяких програм, створених розробниками та дослідниками зі всього світу, з використанням роботів і простих механізмів. Наприклад, в даному випадку, це іграшковий гелікоптер, котрий управляється за допомогою думки.

The technology can also be applied to real world applications -- in this example, a smart home. You know, from the user interface of the control system to opening curtains or closing curtains. And of course, also to the lighting -- turning them on or off. And finally, to real life-changing applications, such as being able to control an electric wheelchair. In this example, facial expressions are mapped to the movement commands.

Ця технологія також може застосовуватись у повсякденному житті - наприклад, в так званому "розумному домі". Через інтерфейс користувача системи управління можна відкрити чи закрити штори. І, звичайно, світло - його можна вмикати чи вимикати. І, нарешті, прикладні програми, що здатні змінити спосіб життя, наприклад, можливість керувати інвалідним кріслом. У даному випадку, вираз обличчя відповідає певній команді.

Man: Now blink right to go right. Now blink left to turn back left. Now smile to go straight.

Голос: Моргніть правим оком, щоб повернути вправо. Тепер, лівим, щоб повернути вліво. Тепер посміхніться, щоб їхати прямо.

TL: We really -- Thank you.

ТЛ: Ми лише... - Дякую.

(Applause)

(Аплодисменти)

We are really only scratching the surface of what is possible today, and with the community's input, and also with the involvement of developers and researchers from around the world, we hope that you can help us to shape where the technology goes from here. Thank you so much.

І ми лише зазирнули у світ справжніх можливостей цієї технології. І за участю спільноти, а також через залучення розробників та дослідників з усього світу, ви, надіємось, зможете допомогти у формуванні розвитку цієї технології. Дуже дякую.