Up until now, our communication with machines has always been limited to conscious and direct forms. Whether it's something simple like turning on the lights with a switch, or even as complex as programming robotics, we have always had to give a command to a machine, or even a series of commands, in order for it to do something for us. Communication between people, on the other hand, is far more complex and a lot more interesting because we take into account so much more than what is explicitly expressed. We observe facial expressions, body language, and we can intuit feelings and emotions from our dialogue with one another. This actually forms a large part of our decision-making process. Our vision is to introduce this whole new realm of human interaction into human-computer interaction so that computers can understand not only what you direct it to do, but it can also respond to your facial expressions and emotional experiences. And what better way to do this than by interpreting the signals naturally produced by our brain, our center for control and experience.

Şu ana kadar, makineler ile olan iletişimimiz hep kasıtlı ve direk yapılarla kısıtlandı. İster ışıkları açmak için kullandığımız anahtarlar gibi basit yapılar, isterse robotları programlamak gibi karmaşık yapılar olsun, makinelere bir şey yaptırabilmek için her zaman bir komut veya komutlar zinciri vermemiz gerekti. Diğer yandan, insanlar arasındaki iletişim, çok daha karmaşık ve ilginç çünkü bizler görünenin ifade edilenin haricinde çok daha fazlasını hesaba katıyoruz. Bir başkası ile yaptığımız konuşmada yüz mimiklerini, vücut dilini gözlemliyor, duyguları ve heyecanları sezinleyebiliyoruz. Aslında bu karar verme sürecimizin büyük bir kısmını oluşturuyor. Hedefimiz, insanlar arasındaki bu tamamen yeni etkileşim alanını insan-bilgisayar etkileşimine tanıtmak, böylece de, bilgisayarlar sadece onlara verdiğiniz komutları anlamayacaklar aynı zamanda sizin mimiklerinize ve duygusal deneyimlerinize de karşılık verebilecekler. Bunu yapmak için, doğal yollarla beynimiz tarafından üretilen bu sinyalleri tercüme etmekten daha iyi olan yöntem de kontrol ve deneyim için bulunan merkezimiz.

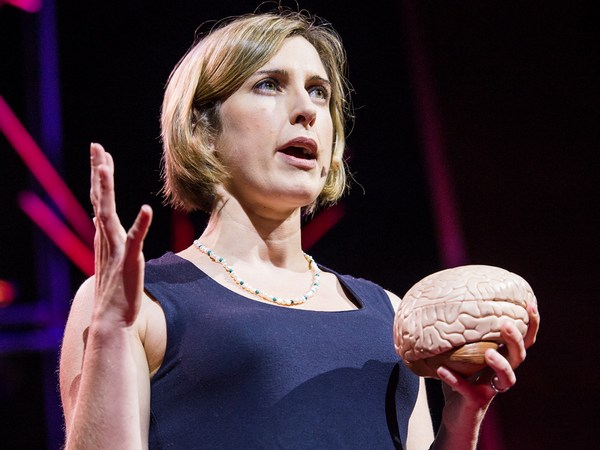

Well, it sounds like a pretty good idea, but this task, as Bruno mentioned, isn't an easy one for two main reasons: First, the detection algorithms. Our brain is made up of billions of active neurons, around 170,000 km of combined axon length. When these neurons interact, the chemical reaction emits an electrical impulse, which can be measured. The majority of our functional brain is distributed over the outer surface layer of the brain, and to increase the area that's available for mental capacity, the brain surface is highly folded. Now this cortical folding presents a significant challenge for interpreting surface electrical impulses. Each individual's cortex is folded differently, very much like a fingerprint. So even though a signal may come from the same functional part of the brain, by the time the structure has been folded, its physical location is very different between individuals, even identical twins. There is no longer any consistency in the surface signals.

Kulağa çok iyi bir fikir gibi geliyor, ama bu görev Bruno'nun da bahsettiği gibi iki sebepten ötürü çok kolay değil: İlki, algılama algoritması. Beynimiz milyarlarca aktif nörondan ibarettir, sinir hücrelerini uç uca eklediğinizde 170,000 km. oluyor. Bu nöronlar birbiri ile etkileşime geçtiğindeki kimyasal tepkime, gözlemlenebilir ölçüde elektriksel vurular ortaya çıkarıyor. Beyin fonksiyonlarımızın büyük bir bölümü beynimizin dış katmanından dağıtılmaktadır. Beynimizin yüzeyi, zeka kapasitemizi mümkün olabildiğince arttırmak için büyük ölçüde katlı bir yapıya sahiptir. Bu kortikal katlanma elektriksel vuruların yüzeyinin yorumlanması konusunda önemli bir sorun teşkil ediyor. Herbir kişinin korteksi farklı bir şekilde katlanmıştır, sanki parmak izlerimiz gibi. Yani, sinyaller beynin aynı kısmından geliyor olsalar bile, zamanla beynin yapısı katlandığından, bunun bireyler arasındaki fiziksel konumu çok farklı olabiliyor, hatta tek yumurta ikizlerinde bile. Yüzey sinyallerinde geriye hiçbir tutarlılık kalmıyor.

Our breakthrough was to create an algorithm that unfolds the cortex, so that we can map the signals closer to its source, and therefore making it capable of working across a mass population. The second challenge is the actual device for observing brainwaves. EEG measurements typically involve a hairnet with an array of sensors, like the one that you can see here in the photo. A technician will put the electrodes onto the scalp using a conductive gel or paste and usually after a procedure of preparing the scalp by light abrasion. Now this is quite time consuming and isn't the most comfortable process. And on top of that, these systems actually cost in the tens of thousands of dollars.

En büyük atılımımız korteksleri yeniden düz hale getirebilen bir algoritma yaratmamızdı, böylece sinyalleri kaynaklarına daha yakın bir şekilde görüntüleyebiliyoruz, bu da kalabalık bir toplumda çalışabilmemizi mümkün kılıyor. İkinci büyük zorluk da beyin dalgalarını ölçmek için kullanılan alet. EEG (beyin akım grafiği) ölçümleri genellikle sensörlü oklardan oluşan bir saç ağı içerir, bu resimde de gördüğünüz gibi. Bir teknisyen geçirgen bir jel veya tutkal yardımı ile elektrotları kafa derisine yerleştiriyor ve bu genellikle kafa derisinin aşınmaya karşı hazırlayan bir süreçten sonra yapılıyor. Bu süreçler çok zaman alıyor ve de uygulanması en rahat süreçler değiller. Daha da önemlisi, bu sistemler on binlerce dolara mal oluyor.

So with that, I'd like to invite onstage Evan Grant, who is one of last year's speakers, who's kindly agreed to help me to demonstrate what we've been able to develop.

Bununla birlikte, sahneye geçen senenin konuşmacılarından olan Evan Grant'i davet ediyorum, kendisi bu geliştirmekte olduğumuz aleti sizlere göstermem için bana yardımcı olmayı kabul etti.

(Applause)

(Alkışlar)

So the device that you see is a 14-channel, high-fidelity EEG acquisition system. It doesn't require any scalp preparation, no conductive gel or paste. It only takes a few minutes to put on and for the signals to settle. It's also wireless, so it gives you the freedom to move around. And compared to the tens of thousands of dollars for a traditional EEG system, this headset only costs a few hundred dollars. Now on to the detection algorithms. So facial expressions -- as I mentioned before in emotional experiences -- are actually designed to work out of the box with some sensitivity adjustments available for personalization. But with the limited time we have available, I'd like to show you the cognitive suite, which is the ability for you to basically move virtual objects with your mind.

Bu gördüğünüz alet 14 kanallı, yüksek ses duyarlılığı olan EEG elde etme sistemi. Kafa derisini hazırlamak için bir süreç gerektirmiyor, ya da geçirgen jel veya tutkal. Kafaya yerleştirmek ve sinyallari alabilmeye başlamak sadece birkaç dakikamızı alıyor. Aynı zamanda kablosuz, böylece size hareket etme özgürlüğü sunuyor. Ve de geleneksel EEG sistemlerinin on binlerce dolarlık maliyetini düşündüğünüzde, bu başlık sadece birkaç yüz dolara mal oluyor. Şimdi algılama algoritması. Yüz mimikleri -- daha önce duygusal deneyimlerde de bahsettiğim gibi -- şimdilik, bazı hassasiyet ayarlamaları ile kişiselliştirmeye müsait olacak şekilde çalışmaya uygun olarak dizayn edildi. Ama elimizdeki kısıtlı zamanda, sizlere, zihninizde sanal nesneleri hareket ettirme yeteneğiniz olan kasti düşünceleri göstermek istiyorum.

Now, Evan is new to this system, so what we have to do first is create a new profile for him. He's obviously not Joanne -- so we'll "add user." Evan. Okay. So the first thing we need to do with the cognitive suite is to start with training a neutral signal. With neutral, there's nothing in particular that Evan needs to do. He just hangs out. He's relaxed. And the idea is to establish a baseline or normal state for his brain, because every brain is different. It takes eight seconds to do this, and now that that's done, we can choose a movement-based action. So Evan, choose something that you can visualize clearly in your mind.

Şimdi, Evan bu sisteme yabancı olduğu için, yapmamız gereken ilk şey onun için bir profil yaratmak. Tabi ki Joanne değil -- "yeni kullanıcı" ekleyelim. Evan. Tamam. Bu kasti düşünceler ile yapmamız gereken ilk şey nötr bir sinyal ile çalışmaya başlamak. Nötr ile Evan'ın özellikle yapması gereken hiçbir şey yok. Sadece takılıyor, rahatlamış bir durumda. Bunu yapmamızın sebebi bir temel ya da beyninin normal durumunu belirlemek, çünkü her beyin farklıdır. Bunu yapmak sekiz saniye sürüyor. Bu yapıldığına göre, hareket-bazlı bir olay seçebiliriz. Evan aklında kolaylıkla canlandırabileceğin bir şey seç.

Evan Grant: Let's do "pull."

Evan Grant: "Çekmek" seçeneği.

Tan Le: Okay, so let's choose "pull." So the idea here now is that Evan needs to imagine the object coming forward into the screen, and there's a progress bar that will scroll across the screen while he's doing that. The first time, nothing will happen, because the system has no idea how he thinks about "pull." But maintain that thought for the entire duration of the eight seconds. So: one, two, three, go. Okay. So once we accept this, the cube is live. So let's see if Evan can actually try and imagine pulling. Ah, good job! (Applause) That's really amazing.

Tan Le: Tamam, o zaman küpü çekelim. Buradaki fikir şöyle; Evan'ın, objenin ekranın ön kısmına geldiğini hayal etmesi gerekiyor. Ve ekranda da bir gelişim çubuğu var, o bunu yaparken ekran boyunca ilerleyecek. İlk seferinde, hiçbir şey olmayacak, çünkü sistemin onun "çekme"yi nasıl düşündüğü konusunda bir fikri yok. Ama bu düşünceyi tüm sekiz saniye boyunca devam ettir. Şimdi, bir, iki, üç, başla. Tamam. Bunu kabul ettiğimizde, küp canlanacak. Şimdi bakalım, Evan gerçekten onu çektiğini hayal edebilmiş mi. Oh, bravo! (Alkışlar) Bu çok şaşırtıcıydı.

(Applause)

(Alkışlar)

So we have a little bit of time available, so I'm going to ask Evan to do a really difficult task. And this one is difficult because it's all about being able to visualize something that doesn't exist in our physical world. This is "disappear." So what you want to do -- at least with movement-based actions, we do that all the time, so you can visualize it. But with "disappear," there's really no analogies -- so Evan, what you want to do here is to imagine the cube slowly fading out, okay. Same sort of drill. So: one, two, three, go. Okay. Let's try that. Oh, my goodness. He's just too good. Let's try that again.

Çok fazla zamanımız yok, o yüzden Evan'dan gerçekten zor bir şey yapmasını isteyeceğim. Bu isteyeceğim gerçekten zor, çünkü fiziksel dünyada varolmayan bir şeyi canlandırmasını isteyeceğim. "Kaybolma". Yani istenen, en azından hareket bazlı olaylarda, bunu sürekli yapıyoruz, o yüzden canlandırabilirsin. Ama "kaybolma" ile hiçbir benzerlik yok. Şimdi Evan, burada yapman gereken küpün yavaşça kaybolduğunu hayal etmek. Az öncekinin benzeri. Bir, iki, üç, başla. Tamam, bunu dene şimdi. Aman Allahım, gerçekten çok iyi. Bunu bir daha deneyelim.

EG: Losing concentration.

EG: Konsantrasyonumu kaybediyorum.

(Laughter)

(Gülüşmeler)

TL: But we can see that it actually works, even though you can only hold it for a little bit of time. As I said, it's a very difficult process to imagine this. And the great thing about it is that we've only given the software one instance of how he thinks about "disappear." As there is a machine learning algorithm in this --

TL: Ama gerçekten işe yaradığını görüyoruz, hem de çok kısa bir süre kafasında tutmasına rağmen. Söylediğim gibi, bunu hayal etmek çok zor bir süreç. Bunun en güzel yanı da bu yazılıma sadece onun "kaybolma"yı nasıl düşündüğünü bir kez örnek olarak vermiş olmamız. Sanki burada algoritmayı öğrenen bir makine var.

(Applause)

(Alkışlar)

Thank you. Good job. Good job.

Teşekkürler. Çok iyi iş çıkardın.

(Applause)

(Alkışlar)

Thank you, Evan, you're a wonderful, wonderful example of the technology.

Teşekkürler Evan, teknolojiyi tanıtmak için mükemmel bir örnek oldun.

So, as you can see, before, there is a leveling system built into this software so that as Evan, or any user, becomes more familiar with the system, they can continue to add more and more detections, so that the system begins to differentiate between different distinct thoughts. And once you've trained up the detections, these thoughts can be assigned or mapped to any computing platform, application or device.

Fark etmiş olabileceğiniz gibi, bu yazılımda bir aşama sistemi mevcut, yani Evan veya bir başka kullanıcı sistem ile daha aşina olduğunda algılamalarını eklemeye devam edebilirler, böylece sistem farklı düşünceleri ayırt edebilmeye başlayabiliyor. Ve de bu algıları öğrettiğiniz zaman, bu düşünceler herhangi başka bir bilgisayar platformuna, uygulamasına ya da aletine devredilebilir veya eşlenebilir.

So I'd like to show you a few examples, because there are many possible applications for this new interface. In games and virtual worlds, for example, your facial expressions can naturally and intuitively be used to control an avatar or virtual character. Obviously, you can experience the fantasy of magic and control the world with your mind. And also, colors, lighting, sound and effects can dynamically respond to your emotional state to heighten the experience that you're having, in real time. And moving on to some applications developed by developers and researchers around the world, with robots and simple machines, for example -- in this case, flying a toy helicopter simply by thinking "lift" with your mind.

Sizlere birkaç örnek göstermek istiyorum, çünkü bu arayüz için mümkün olan birçok uygulama mevcut. Oyunlarda ve sanal dünyada, mesela, yüz mimikleriniz doğal olarak ve sezgisel olarak bir avatarı veya sanal bir karakteri kontrol etmek için kullanılabilir. Tabii ki, sihrin fantezisini tecrübe edebilir zihniniz ile dünyayı kontrol edebilirsiniz. Aynı zamanda, renkler, ışıklar, sesler ve efektler, o an yaşadığınız deneyimleri yükseltmek için duygusal durumunuza eş zamanlı olarak karşılık verebilirler. Ve de dünyadan bazı araştırmacı ve geliştiricilerin geliştirdikleri uygulamalar, robotlar ve basit makineler ile, örneğin -- bu örnekte, oyuncak bir helikopteri zihninizde havalandırdığınızı düşünerek uçurmak.

The technology can also be applied to real world applications -- in this example, a smart home. You know, from the user interface of the control system to opening curtains or closing curtains. And of course, also to the lighting -- turning them on or off. And finally, to real life-changing applications, such as being able to control an electric wheelchair. In this example, facial expressions are mapped to the movement commands.

Teknoloji aynı zamanda gerçek yaşama uygulamalarına da uygulanabilir-- bu örnekte, akıllı bir ev. Kontrol sisteminin kullanıcı arayüzünden perdeleri açmak ya da kapamak. Ve tabi ki ışıklar -- açmak ya da kapamak. Ve son olarak, gerçekten yaşam değiştirecek uygulamalar, örneğin elektrikli tekerlekli sandalyeyi kontrol etmek gibi. Bu örnekte, yüz mimikleri hareket komutları olarak kullanıldılar.

Man: Now blink right to go right. Now blink left to turn back left. Now smile to go straight.

Man: Sağa gitmek için sağ gözünü kırp. Sola dönmek için, sol gözünü kırp Düz gitmek için gülümse.

TL: We really -- Thank you.

TL: Gerçekten -- çok teşekkürler.

(Applause)

(Alkışlar)

We are really only scratching the surface of what is possible today, and with the community's input, and also with the involvement of developers and researchers from around the world, we hope that you can help us to shape where the technology goes from here. Thank you so much.

Şu an sadece mümkün olan şeylerin yüzeyini tırmalıyoruz. Toplumun katkısıyla, ve dünyanın her tarafından araştırmacıların ve geliştirmecilerin dahil olması ile, umarız teknolojinin buradan yola çıkarak gittiği yönü şekillendirmemize yardım edeceksiniz. Çok teşekkürler.