Up until now, our communication with machines has always been limited to conscious and direct forms. Whether it's something simple like turning on the lights with a switch, or even as complex as programming robotics, we have always had to give a command to a machine, or even a series of commands, in order for it to do something for us. Communication between people, on the other hand, is far more complex and a lot more interesting because we take into account so much more than what is explicitly expressed. We observe facial expressions, body language, and we can intuit feelings and emotions from our dialogue with one another. This actually forms a large part of our decision-making process. Our vision is to introduce this whole new realm of human interaction into human-computer interaction so that computers can understand not only what you direct it to do, but it can also respond to your facial expressions and emotional experiences. And what better way to do this than by interpreting the signals naturally produced by our brain, our center for control and experience.

Até agora, nossa comunicação com máquinas tem sido sempre limitada a formas conscientes e diretas. Seja algo simples como ligar as luzes no interruptor, ou complexo como programação robótica, tivemos sempre que dar um comando para uma máquina, ou mesmo uma série de comandos, para que ela faça algo por nós. Comunicação entre pessoas por outro lado, é ainda mais complexa e bem mais interessante, porque levamos em conta muito mais do que está explicitamente expresso. Observamos expressões faciais, linguagem corporal, e podemos intuir sentimentos e emoções de nosso diálogo com o outro. Na verdade isto forma grande parte de nosso processo decisório. Nossa visão é introduzir toda esta nova realidade da interação humana para a interação homem-máquina, para que os computadores possam entender não só o que você lhes ordena, mas também respondam a suas expressões faciais e experiências emocionais. E qual jeito melhor de fazê-lo do que interpretando os sinais naturalmente produzidos pelo nosso cérebro, nosso centro de controle e experiência.

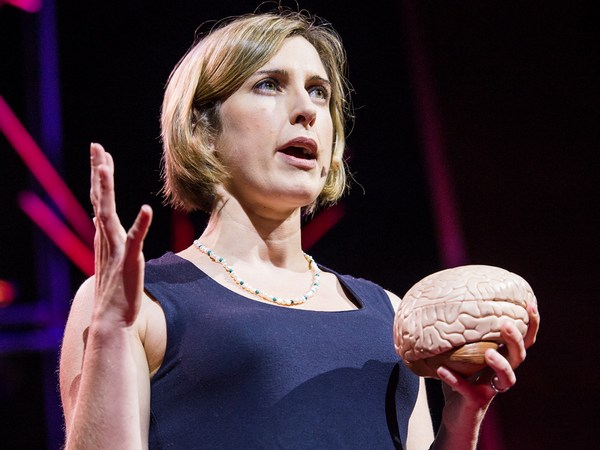

Well, it sounds like a pretty good idea, but this task, as Bruno mentioned, isn't an easy one for two main reasons: First, the detection algorithms. Our brain is made up of billions of active neurons, around 170,000 km of combined axon length. When these neurons interact, the chemical reaction emits an electrical impulse, which can be measured. The majority of our functional brain is distributed over the outer surface layer of the brain, and to increase the area that's available for mental capacity, the brain surface is highly folded. Now this cortical folding presents a significant challenge for interpreting surface electrical impulses. Each individual's cortex is folded differently, very much like a fingerprint. So even though a signal may come from the same functional part of the brain, by the time the structure has been folded, its physical location is very different between individuals, even identical twins. There is no longer any consistency in the surface signals.

Bom, parece ser uma ideia muito boa, mas a tarefa, como Bruno mencionou, não é fácil por dois motivos: Primeiro, os algoritmos de detecção. Nosso cérebro é feito de bilhões de neurônios ativos, cerca de 170.000 Km da extensão combinada dos axônios. Quando estes neurônios interagem, a reação química emite um impulso elétrico que pode ser medido. A maior parte de nosso cérebro funcional é distribuída pela superfície exterior do cérebro. E para aumentar a área disponível para a capacidade mental, a superfície cerebral é toda dobrada. E essas dobras do córtex apresentam um desafio significativo na interpretação dos impulsos elétricos da superfície. Todo córtex de um invíduo é dobrado diferentemente, quase como uma digital. Assim, mesmo que um sinal venha de uma mesma parte funcional do cérebro, na época que a estrutura se dobrou, sua localização física é bem diferente entre indivíduos, mesmo gêmeos idênticos. Não existe mais qualquer consistência nos sinais da superfície.

Our breakthrough was to create an algorithm that unfolds the cortex, so that we can map the signals closer to its source, and therefore making it capable of working across a mass population. The second challenge is the actual device for observing brainwaves. EEG measurements typically involve a hairnet with an array of sensors, like the one that you can see here in the photo. A technician will put the electrodes onto the scalp using a conductive gel or paste and usually after a procedure of preparing the scalp by light abrasion. Now this is quite time consuming and isn't the most comfortable process. And on top of that, these systems actually cost in the tens of thousands of dollars.

Nosso avanço foi criar um algoritmo que estenda o córtex, para que possamos mapear os sinais mais próximos de sua origem, e portanto possibilitar trabalhar toda uma população em massa. O segundo desafio é o dispositivo atual para observar ondas cerebrais. Medições de EEG tipicamente incluem uma rede com vários sensores, como essa que vocês podem ver na foto. Um técnico colocará os eletrodos sobre o couro cabeludo usando um gel ou pasta condutora e normalmente após uma preparação do couro cabeludo com um abrasivo leve. Hoje esse processo consome tempo e não é dos mais confortáveis. E acima de tudo, estes sistemas na verdade custam dezenas de milhares de dólares.

So with that, I'd like to invite onstage Evan Grant, who is one of last year's speakers, who's kindly agreed to help me to demonstrate what we've been able to develop.

Assim, gostaria de convidar ao palco Evan Grant, que foi um dos oradores no ano passado que gentilmente concordou em me ajudar a demonstrar o que conseguimos desenvolver.

(Applause)

(Aplausos)

So the device that you see is a 14-channel, high-fidelity EEG acquisition system. It doesn't require any scalp preparation, no conductive gel or paste. It only takes a few minutes to put on and for the signals to settle. It's also wireless, so it gives you the freedom to move around. And compared to the tens of thousands of dollars for a traditional EEG system, this headset only costs a few hundred dollars. Now on to the detection algorithms. So facial expressions -- as I mentioned before in emotional experiences -- are actually designed to work out of the box with some sensitivity adjustments available for personalization. But with the limited time we have available, I'd like to show you the cognitive suite, which is the ability for you to basically move virtual objects with your mind.

O dispositivo que vêem é um sistema de 14 canais, com alta-fidelidade para leitura de EEG. Não necessita nenhuma preparação para o couro cabeludo, nem gel ou pasta condutora. Leva apenas alguns minutos para colocá-lo e prepará-lo para os sinais. Também não usa fios, o que dá a liberdade de se movimentar. E comparado com as dezenas de milhares de dólares de um sistema tradicional de EEG, este aparelho custa somente algumas centenas de dólares. Agora sobre os algoritmos de detecção. As expressões faciais... como mencionei antes em experiências emocionais... na verdade foram projetadas para funcionar de imediato com alguns ajustes de sensibilidade disponíveis para personalização. Com o tempo limitado que temos, gostaria de mostrar a vocês o módulo cognitivo, que é a habilidade de você basicamente mover objetos virtuais com a mente.

Now, Evan is new to this system, so what we have to do first is create a new profile for him. He's obviously not Joanne -- so we'll "add user." Evan. Okay. So the first thing we need to do with the cognitive suite is to start with training a neutral signal. With neutral, there's nothing in particular that Evan needs to do. He just hangs out. He's relaxed. And the idea is to establish a baseline or normal state for his brain, because every brain is different. It takes eight seconds to do this, and now that that's done, we can choose a movement-based action. So Evan, choose something that you can visualize clearly in your mind.

Agora, Evan é novo para o sistema, então temos que primeiro criar um novo perfil para ele. Ele obviamente não é Joanne... então "Incluir usuário." Evan. Pronto. A primeira coisa que temos de fazer com o módulo cognitivo é iniciar com o treinamento de um sinal neutro. Para o neutro, não há nada de especial que o Evan precise fazer. Ele só aguarda. Relaxado. A ideia é estabelecer uma linha inicial ou um estado normal para seu cérebro, porque cada cérebro é diferente. Leva oito segundos para fazer. E agora que está feito, podemos escolher uma ação relacionada a movimento. Então Evan escolha algo que possa visualizar com clareza em sua mente.

Evan Grant: Let's do "pull."

Evan Grant: Vamos de "puxar".

Tan Le: Okay, so let's choose "pull." So the idea here now is that Evan needs to imagine the object coming forward into the screen, and there's a progress bar that will scroll across the screen while he's doing that. The first time, nothing will happen, because the system has no idea how he thinks about "pull." But maintain that thought for the entire duration of the eight seconds. So: one, two, three, go. Okay. So once we accept this, the cube is live. So let's see if Evan can actually try and imagine pulling. Ah, good job! (Applause) That's really amazing.

Tan Le: Certo, Vamos escolher "puxar". Agora a ideia aqui é que Evan precisa imaginar o objeto avançando na tela. Há uma barra de progresso que se preencherá enquanto ele faz isso. A primeira vez, nada irá acontecer, porque o sistema não tem ideia de como ele pensa "puxar". Mas mantenha esse pensamento pela duração de oito segundos. Assim: um, dois, três, vai. Certo. Uma vez que gravarmos isso, o cubo está vivo. Vamos ver se Evan pode mesmo tentar e imaginar puxando. Ah, bom trabalho! (Aplausos) Isso foi incrível.

(Applause)

(Aplausos)

So we have a little bit of time available, so I'm going to ask Evan to do a really difficult task. And this one is difficult because it's all about being able to visualize something that doesn't exist in our physical world. This is "disappear." So what you want to do -- at least with movement-based actions, we do that all the time, so you can visualize it. But with "disappear," there's really no analogies -- so Evan, what you want to do here is to imagine the cube slowly fading out, okay. Same sort of drill. So: one, two, three, go. Okay. Let's try that. Oh, my goodness. He's just too good. Let's try that again.

Temos mais um tempinho disponível, então pedirei ao Evan para fazer uma tarefa difícil de verdade. E é difícil porque é sobre visualizar algo que não existe em nosso mundo físico. Esta é "desaparecer". O que você tem... pelo menos com ações baseadas em movimento, que fazemos todo o tempo, você pode visualizar. Mas com "desaparecer", não existem analogias. Evan, o que você vai fazer aqui é imaginar o cubo lentamente desaparecendo. Algum tipo de ralo. Então: um, dois, três, vai. Certo. Vamos tentar assim. Nossa, Ele é muito bom. Vamos tentar de novo.

EG: Losing concentration.

EG: Perdendo concentração.

(Laughter)

(Risos)

TL: But we can see that it actually works, even though you can only hold it for a little bit of time. As I said, it's a very difficult process to imagine this. And the great thing about it is that we've only given the software one instance of how he thinks about "disappear." As there is a machine learning algorithm in this --

TL: Mas podemos ver que funciona mesmo, mesmo que você consiga por apenas pouco tempo. Como eu disse, é um processo difícil imaginar isso. E o melhor disso é que nós somente oferecemos ao software um único exemplo do que ele pensa sobre "desaparecer". Como há um algoritmo de aprendizado mecanizado nisto...

(Applause)

(Aplausos)

Thank you. Good job. Good job.

Obrigada. Bom trabalho, Bom trabalho.

(Applause)

(Aplausos)

Thank you, Evan, you're a wonderful, wonderful example of the technology.

Obrigada, Evan, você é um maravilhoso exemplo de tecnologia.

So, as you can see, before, there is a leveling system built into this software so that as Evan, or any user, becomes more familiar with the system, they can continue to add more and more detections, so that the system begins to differentiate between different distinct thoughts. And once you've trained up the detections, these thoughts can be assigned or mapped to any computing platform, application or device.

Como puderam ver, existe um sistema de aprimoramento interno neste sofware para que Evan, ou qualquer usuário torne-se mais familiar com o sistema, eles podem continuar a adicionar mais e mais detecções, para que o sistema comece a diferenciar entre diferentes e distintos pensamentos. E uma vez que você tenha treinado as detecções, estes pensamentos podem ser associados ou mapeados para qualquer plataforma computacional, aplicação ou dispositivo.

So I'd like to show you a few examples, because there are many possible applications for this new interface. In games and virtual worlds, for example, your facial expressions can naturally and intuitively be used to control an avatar or virtual character. Obviously, you can experience the fantasy of magic and control the world with your mind. And also, colors, lighting, sound and effects can dynamically respond to your emotional state to heighten the experience that you're having, in real time. And moving on to some applications developed by developers and researchers around the world, with robots and simple machines, for example -- in this case, flying a toy helicopter simply by thinking "lift" with your mind.

Gostaria de mostrar alguns poucos exemplos, porque existem muitas aplicações possíveis para esta nova interface. Nos jogos e mundos virtuais, por exemplo, suas expressões faciais podem naturalmente e intuitivamente ser usadas para controlar um avatar ou personagem virtual. Obviamente, você pode experimentar a magia de controlar o mundo com sua mente. E também, cores, luzes, som e efeitos, podem responder dinamicamente ao seu estado emocional e aprofundar a experiência que você está tendo, em tempo real. E indo para algumas outras aplicações feitas por desenvolvedores e pesquisadores ao redor do mundo, com robôs e máquinas simples, por exemplo... neste caso, voar com um helicóptero de brinquedo só pensando em decolar com sua mente.

The technology can also be applied to real world applications -- in this example, a smart home. You know, from the user interface of the control system to opening curtains or closing curtains. And of course, also to the lighting -- turning them on or off. And finally, to real life-changing applications, such as being able to control an electric wheelchair. In this example, facial expressions are mapped to the movement commands.

A tecnologia pode também ser utilizada em aplicações do mundo real... neste exemplo, uma casa inteligente. Sabe, a partir da interface de usuário do sistema de controle para abrir cortinas ou fechar cortinas. E é claro também as luzes... ligando-as ou desligando. E finalmente, aplicações que mudam a vida real como ser capaz de controlar uma cadeira de rodas elétrica. Neste exemplo, expressões faciais são mapeadas para comandos de movimentação.

Man: Now blink right to go right. Now blink left to turn back left. Now smile to go straight.

Homem: Pisque o olho direito para ir à direita. Agora o esquerdo para virar à esquerda. Agora sorria para ir em frente.

TL: We really -- Thank you.

TL: De verdade... Muito obrigada.

(Applause)

(Aplausos)

We are really only scratching the surface of what is possible today, and with the community's input, and also with the involvement of developers and researchers from around the world, we hope that you can help us to shape where the technology goes from here. Thank you so much.

Na verdade estamos apenas no começo do que é possível hoje. E com o auxílio da comunidade, e também com o envolvimento de desenvolvedores e pesquisadores de todo o mundo, esperamos que vocês possam nos ajudar a moldar onde a tecnologia vai daqui para a frente. Muito obrigada mesmo.