Up until now, our communication with machines has always been limited to conscious and direct forms. Whether it's something simple like turning on the lights with a switch, or even as complex as programming robotics, we have always had to give a command to a machine, or even a series of commands, in order for it to do something for us. Communication between people, on the other hand, is far more complex and a lot more interesting because we take into account so much more than what is explicitly expressed. We observe facial expressions, body language, and we can intuit feelings and emotions from our dialogue with one another. This actually forms a large part of our decision-making process. Our vision is to introduce this whole new realm of human interaction into human-computer interaction so that computers can understand not only what you direct it to do, but it can also respond to your facial expressions and emotional experiences. And what better way to do this than by interpreting the signals naturally produced by our brain, our center for control and experience.

Aż do teraz, nasza komunikacja z maszynami ograniczona była zawsze do świadomych i bezpośrednich postaci. Czy jest to coś prostego jak włączenie światła włącznikiem lub nawet coś tak skomplikowanego jak programowanie robotów, zawsze musimy dać polecenie maszynie, lub nawet serię poleceń, aby zrobiła ona coś dla nas. Z drugiej strony, komunikacja między ludźmi jest dalece bardziej złożona i dużo bardziej interesująca, ponieważ bierzemy pod uwagę o wiele więcej niż to co jest wyraźnie wyrażane. Obserwujemy mimikę twarzy, język ciała, i możemy wyczuć uczucia i emocje z dialogu pomiędzy sobą. Odgrywa to właściwie dużą rolę w procesie podejmowania naszych decyzji. Naszą wizją jest wprowadzenie tego całego nowego wymiaru ludzkiej interakcji w interakcję pomiędzy człowiekiem a komputerem, tak aby komputery mogły zrozumieć nie tylko to co każemy im zrobić, ale aby mogły też reagować na wasz wyraz twarzy oraz doświadczenia emocjonalne. A jaki jest lepszy sposób na zrobienie tego niż poprzez interpretowanie sygnałów naturalnie produkowanych przez nasze mózgi, nasz ośrodek odpowiadający za kontrolę i doświadczenie.

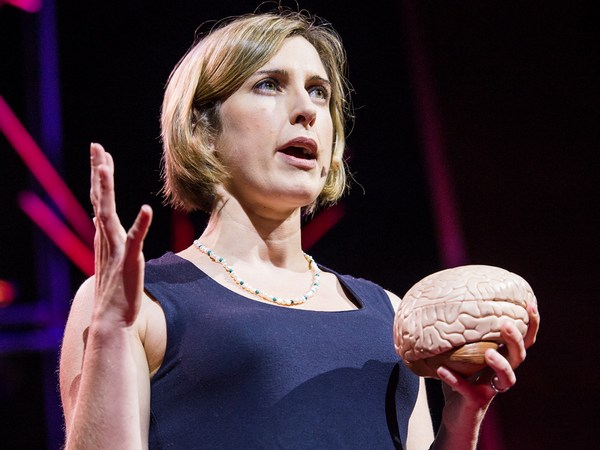

Well, it sounds like a pretty good idea, but this task, as Bruno mentioned, isn't an easy one for two main reasons: First, the detection algorithms. Our brain is made up of billions of active neurons, around 170,000 km of combined axon length. When these neurons interact, the chemical reaction emits an electrical impulse, which can be measured. The majority of our functional brain is distributed over the outer surface layer of the brain, and to increase the area that's available for mental capacity, the brain surface is highly folded. Now this cortical folding presents a significant challenge for interpreting surface electrical impulses. Each individual's cortex is folded differently, very much like a fingerprint. So even though a signal may come from the same functional part of the brain, by the time the structure has been folded, its physical location is very different between individuals, even identical twins. There is no longer any consistency in the surface signals.

Cóż, to brzmi jak całkiem dobry pomysł, jednak to zadanie, jak wspomniał Bruno, nie jest tak prostym z dwóch powodów: Pierwszy, algorytmy odpowiadające za wykrywanie. Nasz mózg zbudowany jest z miliardów aktywnych neuronów, około 170 000 km połączonych ze sobą aksonów. Kiedy te neurony oddziałują ze sobą, reakcje chemiczne emitują impuls elektryczny, który może być zmierzony. Większość naszej funkcjonalnej części mózgu rozmieszczona jest na powierzchni zewnętrznej warstwy mózgu. A aby zwiększyć obszar dostępny dla zdolności intelektualnych, powierzchnia mózgu jest wysoce pofałdowana. To korowe pofałdowanie stanowi znaczące wyzwanie dla interpretowania impulsów elektrycznych powierzchni. Kora każdej osoby jest pofałdowana inaczej, bardzo podobnie do odcisku palca. Więc pomimo tego, że sygnał może pochodzić z funkcjonalnie tej samej części mózgu, ale kiedy struktura zostanie pofałdowana, jej umiejscowienie jest inne u każdej osoby, nawet u bliźniąt jednojajowych. Nie ma już żadnej zgodności w sygnałach powierzchni.

Our breakthrough was to create an algorithm that unfolds the cortex, so that we can map the signals closer to its source, and therefore making it capable of working across a mass population. The second challenge is the actual device for observing brainwaves. EEG measurements typically involve a hairnet with an array of sensors, like the one that you can see here in the photo. A technician will put the electrodes onto the scalp using a conductive gel or paste and usually after a procedure of preparing the scalp by light abrasion. Now this is quite time consuming and isn't the most comfortable process. And on top of that, these systems actually cost in the tens of thousands of dollars.

Naszym przełomem było stworzenie algorytmu, który rozwija korę, tak abyśmy mogli odczytać współrzędne sygnału bliżej jego źródła, aby przez to umożliwić pracę na większości populacji. Drugim wyzwaniem jest samo urządzenie do zapisywania fal mózgowych. Pomiar EEG zazwyczaj wiąże się z użyciem siatki na włosy z szeregiem sensorów, takiej jak ta, którą możecie zobaczyć na tym zdjęciu. Technik założy elektrody na skórę głowy używając przewodzącego żelu lub pasty zazwyczaj po przygotowaniu skóry głowy przez jej lekkie otarcie. Jest to dość czasochłonny i nie najprzyjemniejszy proces. I na domiar tego, te systemy kosztują dziesiątki tysięcy dolarów.

So with that, I'd like to invite onstage Evan Grant, who is one of last year's speakers, who's kindly agreed to help me to demonstrate what we've been able to develop.

Chciałabym więc zaprosić na scenę Evana Granta, który jest jednym z zeszłorocznych mówców, który zgodził się życzliwie pomóc mi zademonstrować co udało nam się opracować.

(Applause)

(Oklaski)

So the device that you see is a 14-channel, high-fidelity EEG acquisition system. It doesn't require any scalp preparation, no conductive gel or paste. It only takes a few minutes to put on and for the signals to settle. It's also wireless, so it gives you the freedom to move around. And compared to the tens of thousands of dollars for a traditional EEG system, this headset only costs a few hundred dollars. Now on to the detection algorithms. So facial expressions -- as I mentioned before in emotional experiences -- are actually designed to work out of the box with some sensitivity adjustments available for personalization. But with the limited time we have available, I'd like to show you the cognitive suite, which is the ability for you to basically move virtual objects with your mind.

Urządzenie, które widzicie jest 14-kanałowym, wysoko czułym rejestrującym systemem EEG. Nie wymaga żadnego przygotowania skóry głowy, żadnego przewodzącego żelu czy pasty. Tylko kilka minut zajmuje założenie go i regulacja sygnałów. Jest również bezprzewodowy, daje więc wolność poruszania się. A w porównaniu do dziesiątek tysięcy dolarów za tradycyjny system EEG, ten zestaw kosztuje tylko kilkaset dolarów. A teraz o algorytmach wykrywających. Mimika twarzy -- jak wspomniałam wcześniej, w doświadczeniach emocjonalnych -- jest właściwie zaprojektowana do kreatywnej pracy z pewną regulacją czułości dostępną dla personalizacji. Ale przy ograniczonym czasie jaki mamy, chciałabym pokazać wam zestaw poznawczy, którym jest możliwość poruszania wirtualnym przedmiotem przy pomocy waszego umysłu.

Now, Evan is new to this system, so what we have to do first is create a new profile for him. He's obviously not Joanne -- so we'll "add user." Evan. Okay. So the first thing we need to do with the cognitive suite is to start with training a neutral signal. With neutral, there's nothing in particular that Evan needs to do. He just hangs out. He's relaxed. And the idea is to establish a baseline or normal state for his brain, because every brain is different. It takes eight seconds to do this, and now that that's done, we can choose a movement-based action. So Evan, choose something that you can visualize clearly in your mind.

Evan jest nowy dla tego systemu więc co musimy najpierw zrobić to stworzyć dla niego nowy profil. Nie jest oczywiście Joanne -- a więc klikniemy "dodaj użytkownika" Evan. OK. Pierwszą rzeczą jaką musimy zrobić z zestawem poznawczym to zacząć od treningu sygnału neutralnego. Z sygnałem neutralnym, nie ma nic szczególnego co Evan musi robić. Jest po prostu zrelaksowany. Chodzi o to aby ustanowić linię odniesienia normalnego stanu jego mózgu, ponieważ każdy mózg jest inny. Zajmuje to osiem sekund. Teraz, kiedy to już jest zrobione, możemy wybrać opartą na ruchu akcję. Więc, Evan, wybierz coś co możesz zwizualizować jasno w swoim umyśle.

Evan Grant: Let's do "pull."

Evan Grant: Zróbmy "przyciągnij".

Tan Le: Okay, so let's choose "pull." So the idea here now is that Evan needs to imagine the object coming forward into the screen, and there's a progress bar that will scroll across the screen while he's doing that. The first time, nothing will happen, because the system has no idea how he thinks about "pull." But maintain that thought for the entire duration of the eight seconds. So: one, two, three, go. Okay. So once we accept this, the cube is live. So let's see if Evan can actually try and imagine pulling. Ah, good job! (Applause) That's really amazing.

Tan Le: OK. Wybierzmy więc "przyciągnij". Chodzi więc o to, że Evan musi wyobrazić sobie obiekt przybliżający się w kierunku ekranu. Jest tutaj pasek postępu, który przewinie się poprzez ekran kiedy on będzie to robił. Za pierwszym razem, nic się nie stanie, ponieważ system nie ma pojęcia jak on myśli o "przyciągnij". Utrzymuj jednak tę myśl przez cały czas trwania ośmiu sekund. A więc: raz, dwa, trzy, start. OK. Kiedy więc zaakceptujemy to, kostka jest żywa. Zobaczmy więc, czy Evan jest w stanie spróbować wyobrazić sobie przyciąganie. Dobra robota! (Oklaski) To jest niesamowite.

(Applause)

(Oklaski)

So we have a little bit of time available, so I'm going to ask Evan to do a really difficult task. And this one is difficult because it's all about being able to visualize something that doesn't exist in our physical world. This is "disappear." So what you want to do -- at least with movement-based actions, we do that all the time, so you can visualize it. But with "disappear," there's really no analogies -- so Evan, what you want to do here is to imagine the cube slowly fading out, okay. Same sort of drill. So: one, two, three, go. Okay. Let's try that. Oh, my goodness. He's just too good. Let's try that again.

Zostało nam jeszcze trochę czasu, poproszę więc Evana o wykonanie naprawdę trudnego zadania. To jest trudne ponieważ chodzi tu o zdolność do zwizualizowania czegoś co nie istnieje w naszym rzeczywistym świecie. To jest "zniknij". Jeśli chodzi o oparte na ruchu akcje, robimy to cały czas, możemy więc sobie to wyobrazić. Ale ze "zniknij", nie ma tak naprawdę analogii. A więc Evan, to co chcesz tu zrobić to wyobrazić sobie, że kostka powoli gaśnie, OK. To samo: raz, dwa, trzy, start. Ok. Spróbujmy tego. O, mój boże. On jest po prostu za dobry. Spróbujmy jeszcze raz.

EG: Losing concentration.

EG: Tracę koncentrację.

(Laughter)

(Śmiech)

TL: But we can see that it actually works, even though you can only hold it for a little bit of time. As I said, it's a very difficult process to imagine this. And the great thing about it is that we've only given the software one instance of how he thinks about "disappear." As there is a machine learning algorithm in this --

TL: Widzimy więc, że to faktycznie działa, pomimo tego, że możesz to utrzymać przez krótki okres czasu. Tak jak powiedziałam, jest to bardzo trudny proces aby sobie to wyobrazić. Wspaniałe w tym jest to, że daliśmy programowi tylko jeden przykład tego jak on myśli o "zniknij". Wbudowany jest tu algorytm uczący się --

(Applause)

(Oklaski)

Thank you. Good job. Good job.

Dziękuję. Dobra robota. Dobra robota.

(Applause)

(Oklaski)

Thank you, Evan, you're a wonderful, wonderful example of the technology.

Dziękuję, Evan, jesteś cudownym, cudownym przykładem tej technologii.

So, as you can see, before, there is a leveling system built into this software so that as Evan, or any user, becomes more familiar with the system, they can continue to add more and more detections, so that the system begins to differentiate between different distinct thoughts. And once you've trained up the detections, these thoughts can be assigned or mapped to any computing platform, application or device.

Tak jak mogliście zobaczyć, wbudowany jest w ten program system poziomów tak aby, kiedy Evan lub inny użytkownik, staje się bardziej obeznany z tym systemem, mógł kontynuować dodawanie coraz więcej detektorów, tak aby system różnicował pomiędzy różnymi, odmiennymi myślami. Kiedy zaś wytrenujecie detektory, te myśli mogą zostać przyporządkowane lub zmapowane do jakiegokolwiek komputera, aplikacji czy urządzenia.

So I'd like to show you a few examples, because there are many possible applications for this new interface. In games and virtual worlds, for example, your facial expressions can naturally and intuitively be used to control an avatar or virtual character. Obviously, you can experience the fantasy of magic and control the world with your mind. And also, colors, lighting, sound and effects can dynamically respond to your emotional state to heighten the experience that you're having, in real time. And moving on to some applications developed by developers and researchers around the world, with robots and simple machines, for example -- in this case, flying a toy helicopter simply by thinking "lift" with your mind.

Chciałabym więc pokazać wam kilka przykładów, istnieje bowiem wiele możliwych aplikacji dla tego nowego interfejsu. W grach i świecie wirtualnym, na przykład, wasza mimika twarzy może naturalnie i intuicyjnie być wykorzystana do kontrolowania avatara lub postaci. Oczywiście, możecie doświadczyć fantazji magii i kontrolować świat za pomocą umysłu. Również, kolory, oświetlenie, dźwięki i efekty, mogą dynamicznie odzwierciedlać wasz stan emocjonalny aby spotęgować doświadczenie które przeżywacie, w rzeczywistości. Jeśli chodzi o aplikacje rozwinięte przez deweloperów i badaczy na całym świecie, z robotami i prostymi maszynami, na przykład tutaj, latanie zabawkowym helikopterem po prostu myśląc "podnieś".

The technology can also be applied to real world applications -- in this example, a smart home. You know, from the user interface of the control system to opening curtains or closing curtains. And of course, also to the lighting -- turning them on or off. And finally, to real life-changing applications, such as being able to control an electric wheelchair. In this example, facial expressions are mapped to the movement commands.

Technologia ta może również być zastosowana do rzeczywistych programów, w tym przypadku, inteligentny dom. Interfejs użytkownika systemu kontrolującego może rozsuwać zasłony albo je zasuwać. I oczywiście również oświetlenie, włączanie go lub wyłączanie. I w końcu do prawdziwie zmieniających życie programów takich jak możliwość kontrolowania elektrycznego wózka. W tym przypadku, mimika twarzy jest przyporządkowana do komend ruchu.

Man: Now blink right to go right. Now blink left to turn back left. Now smile to go straight.

Mężczyzna: Mrugnij prawym okiem aby skręcić w prawo. Teraz mrugnij lewym aby skręcić w lewo. A teraz uśmiechnij się aby pojechać do przodu.

TL: We really -- Thank you.

TL: Naprawdę. Dziękujemy.

(Applause)

(Oklaski)

We are really only scratching the surface of what is possible today, and with the community's input, and also with the involvement of developers and researchers from around the world, we hope that you can help us to shape where the technology goes from here. Thank you so much.

Dotykamy tylko powierzchni tego co jest dzisiaj dostępne. A z wkładem społeczności, jak również z zaangażowaniem deweloperów i badaczy z całego świata, mamy nadzieje, że pomożecie nam ukształtować to jak dalej rozwinie się ta technologia. Dziękuję bardzo.