Up until now, our communication with machines has always been limited to conscious and direct forms. Whether it's something simple like turning on the lights with a switch, or even as complex as programming robotics, we have always had to give a command to a machine, or even a series of commands, in order for it to do something for us. Communication between people, on the other hand, is far more complex and a lot more interesting because we take into account so much more than what is explicitly expressed. We observe facial expressions, body language, and we can intuit feelings and emotions from our dialogue with one another. This actually forms a large part of our decision-making process. Our vision is to introduce this whole new realm of human interaction into human-computer interaction so that computers can understand not only what you direct it to do, but it can also respond to your facial expressions and emotional experiences. And what better way to do this than by interpreting the signals naturally produced by our brain, our center for control and experience.

Tot vandaag is onze communicatie met machines altijd beperkt geweest tot bewuste en directe vormen. Of het nu iets eenvoudigs was, zoals het licht aansteken met een schakelaar, of iets ingewikkelds, zoals het programmeren van robots, we moesten altijd een opdracht geven aan een machine, of zelfs een reeks opdrachten, om haar iets voor ons te laten doen. Van de andere kant is communicatie tussen mensen veel ingewikkelder en interessanter, omdat we met zoveel meer rekening houden, dan wat expliciet uitgedrukt is. We observeren gezichtsuitdrukkingen, lichaamstaal, en we kunnen gevoelens en emoties afleiden uit onze dialogen met elkaar. Dit maakt eigenlijk een groot deel van ons beslissingsproces uit. Onze visie bestaat erin deze nieuwe wereld van menselijke interactie, te introduceren in de interactie tussen mens en computer, zodat een computer niet alleen kan verstaan waar je hem opdracht toe geeft, maar dat hij ook kan reageren op je gezichtsuitdrukkingen en emotionele ervaringen. Is er een betere manier om dit te doen dan door de signalen te interpreteren die voortgebracht worden door ons brein, ons centrum van controle en ervaringen?

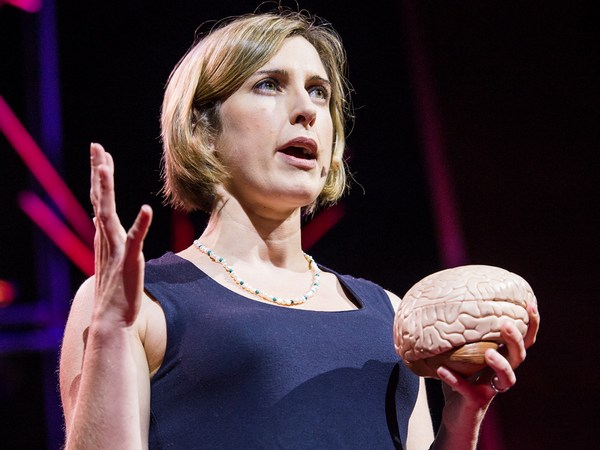

Well, it sounds like a pretty good idea, but this task, as Bruno mentioned, isn't an easy one for two main reasons: First, the detection algorithms. Our brain is made up of billions of active neurons, around 170,000 km of combined axon length. When these neurons interact, the chemical reaction emits an electrical impulse, which can be measured. The majority of our functional brain is distributed over the outer surface layer of the brain, and to increase the area that's available for mental capacity, the brain surface is highly folded. Now this cortical folding presents a significant challenge for interpreting surface electrical impulses. Each individual's cortex is folded differently, very much like a fingerprint. So even though a signal may come from the same functional part of the brain, by the time the structure has been folded, its physical location is very different between individuals, even identical twins. There is no longer any consistency in the surface signals.

Het idee klinkt misschien wel goed, maar deze opdracht, zoals Bruno al zei, is niet gemakkelijk, om twee hoofdredenen. Ten eerste, de detectiealgoritmes. Ons brein bestaat uit miljarden actieve neuronen, dat is ongeveer 170.000 kilometer aan zenuwbanen. Wanneer deze neuronen communiceren, produceert de chemische reactie een elektrische impuls, die gemeten kan worden. Het merendeel van ons werkende brein is verdeeld over de laag aan het buitenste oppervlak van ons brein. Om de beschikbare plaats voor mentale functies te vergroten, is het breinoppervlak sterk opgevouwen. Deze plooiing van de cortex is een belangrijke horde die genomen moet worden om elektrische impulsen aan de oppervlakte te interpreteren. De cortex van elk individu is op een andere manier geplooid, vergelijkbaar met een vingerafdruk. Dus, ook al komt het signaal van hetzelfde functionele deel van het brein, wanneer de structuur opgevouwen is, is de uiteindelijke fysieke locatie, zeer verschillend van persoon tot persoon, zelfs tussen identieke tweelingen. Er is geen enkel patroon meer in de oppervlaktesignalen.

Our breakthrough was to create an algorithm that unfolds the cortex, so that we can map the signals closer to its source, and therefore making it capable of working across a mass population. The second challenge is the actual device for observing brainwaves. EEG measurements typically involve a hairnet with an array of sensors, like the one that you can see here in the photo. A technician will put the electrodes onto the scalp using a conductive gel or paste and usually after a procedure of preparing the scalp by light abrasion. Now this is quite time consuming and isn't the most comfortable process. And on top of that, these systems actually cost in the tens of thousands of dollars.

Onze doorbraak was het uitzetten van een algoritme dat de cortex uitvouwt zodat we de signalen dichter bij hun bron in kaart kunnen brengen, en daardoor de procedure doen werken op een grote populatie. De tweede uitdaging is het eigenlijke apparaat om hersengolven te observeren. Voor EEG-metingen gebruikt men meestal een haarnet met een reeks sensoren, zoals je hier op de foto kunt zien. Een technicus zet dan de elektroden op de schedel met een geleidende gel of pasta en meestal nadat de schedel geprepareerd is door er wat haar af te scheren. Dit is een tijdrovend proces, en ook niet het meest comfortabele. Bovendien kosten deze systemen tienduizenden dollars.

So with that, I'd like to invite onstage Evan Grant, who is one of last year's speakers, who's kindly agreed to help me to demonstrate what we've been able to develop.

Hierbij wil ik graag Evan Grant, die hier vorig jaar gesproken heeft, op het podium uitnodigen. Hij heeft er vriendelijk in toegestemd mij te helpen demonstreren wat we hebben kunnen ontwikkelen.

(Applause)

(Applaus)

So the device that you see is a 14-channel, high-fidelity EEG acquisition system. It doesn't require any scalp preparation, no conductive gel or paste. It only takes a few minutes to put on and for the signals to settle. It's also wireless, so it gives you the freedom to move around. And compared to the tens of thousands of dollars for a traditional EEG system, this headset only costs a few hundred dollars. Now on to the detection algorithms. So facial expressions -- as I mentioned before in emotional experiences -- are actually designed to work out of the box with some sensitivity adjustments available for personalization. But with the limited time we have available, I'd like to show you the cognitive suite, which is the ability for you to basically move virtual objects with your mind.

Het apparraat dat je ziet, is een 14-kanaals, zeer betrouwbaar EEG-meetsysteem. Het vereist geen schedelpreparatie, en ook geen geleidende gel of pasta. Het kost slechts enkele minuten om op te zetten en om de signalen te laten normaliseren. Het is ook draadloos, dus je kunt er vrij mee rondlopen. Vergeleken met de tienduizenden dollars voor een traditioneel EEG-systeem, kost deze hoofdtelefoon slechts enkele honderden dollars. Laat ik het hebben over de detectiealgoritmen. Zoals ik al zei in het gedeelte over emotionele ervaringen, zijn gezichtsuitdrukkingen ontworpen om standaard te werken, met enkele gevoeligheidsaanpassingen, die je naar believen kunt instellen. Maar gezien de beperkte tijd, zou ik jullie graag de cognitieve suite tonen. Die geeft je de mogelijkheid om virtuele objecten te bewegen met je geest.

Now, Evan is new to this system, so what we have to do first is create a new profile for him. He's obviously not Joanne -- so we'll "add user." Evan. Okay. So the first thing we need to do with the cognitive suite is to start with training a neutral signal. With neutral, there's nothing in particular that Evan needs to do. He just hangs out. He's relaxed. And the idea is to establish a baseline or normal state for his brain, because every brain is different. It takes eight seconds to do this, and now that that's done, we can choose a movement-based action. So Evan, choose something that you can visualize clearly in your mind.

Omdat Evan nieuw is voor dit systeem moeten we eerst een nieuw profiel voor hem aanmaken. Hij is duidelijk niet Joanne, dus voegen we een gebruiker toe. Evan. OK. Het eerste wat we moeten doen met de cognitieve suite is een neutraal signaal aanleren. Wat betreft het neutrale signaal, moet Evan niets speciaals doen. Hij is met niets bezig. Hij is ontspannen. Het is de bedoeling een referentiestand, of normale status voor zijn brein op te stellen, omdat elk brein verschillend is. Het duurt acht seconden. Nu dit achter de rug is, kunnen we een bewegingsactie uitkiezen. Evan, kies iets dat je je duidelijk visueel kunt voorstellen.

Evan Grant: Let's do "pull."

Evan Grant: Laten we "trekken" doen.

Tan Le: Okay, so let's choose "pull." So the idea here now is that Evan needs to imagine the object coming forward into the screen, and there's a progress bar that will scroll across the screen while he's doing that. The first time, nothing will happen, because the system has no idea how he thinks about "pull." But maintain that thought for the entire duration of the eight seconds. So: one, two, three, go. Okay. So once we accept this, the cube is live. So let's see if Evan can actually try and imagine pulling. Ah, good job! (Applause) That's really amazing.

Tan Le: OK, ik kies dus "trekken". Het idee hierachter is dat Evan zich moet voorstellen dat het voorwerp vooruit het scherm ingaat. Er is een voortgangsbalkje dat langs het scherm zal scrollen terwijl hij dat doet. De eerste keer zal er niets gebeuren, omdat het systeem geen idee heeft hoe hij over "trekken" denkt. Hou die gedachte vast voor de volle acht seconden. Dus: één, twee, drie, start. OK. Zodra we dit accepteren, komt de kubus tot leven. Laten we eens zien of Evan kan trekken in zijn fantasie. Ha, bravo! (Applaus) Dat is echt geweldig.

(Applause)

(Applaus)

So we have a little bit of time available, so I'm going to ask Evan to do a really difficult task. And this one is difficult because it's all about being able to visualize something that doesn't exist in our physical world. This is "disappear." So what you want to do -- at least with movement-based actions, we do that all the time, so you can visualize it. But with "disappear," there's really no analogies -- so Evan, what you want to do here is to imagine the cube slowly fading out, okay. Same sort of drill. So: one, two, three, go. Okay. Let's try that. Oh, my goodness. He's just too good. Let's try that again.

We hebben nog wat tijd, dus ik ga Evan vragen om iets heel moeilijks te doen. Deze taak is moeilijk omdat men zich iets moet voorstellen dat niet bestaat in onze wereld. Het is "verdwijnen". Acties gebaseerd op beweging doen we de hele tijd dus kun je je ze visueel voorstellen. Maar er zijn geen analogieën met "verdwijnen". Dus, Evan, je kunt best proberen je voor te stellen dat de kubus langzaam vervaagt. OK? Zelfde drill: één, twee, drie, go. OK. Laten we dat proberen. Lieve help! Hij is echt te goed! Laten we nog eens proberen.

EG: Losing concentration.

EG: Ik verlies mijn concentratie.

(Laughter)

(Gelach)

TL: But we can see that it actually works, even though you can only hold it for a little bit of time. As I said, it's a very difficult process to imagine this. And the great thing about it is that we've only given the software one instance of how he thinks about "disappear." As there is a machine learning algorithm in this --

TL: We kunnen in elk geval zien dat het werkt, zelfs als je het enkel kan vasthouden voor een beperkte tijd. Zoals ik al zei, het is zeer moeilijk om je dit voor te stellen. Het geweldige voordeel hiervan is dat we de software maar één voorbeeld gegeven hebben van hoe Evan denkt over "verdwijnen". Omdat er een leeralgoritme voor de machine hierin --

(Applause)

(Applaus)

Thank you. Good job. Good job.

Dank u. Heel goed. Heel goed.

(Applause)

(Applaus)

Thank you, Evan, you're a wonderful, wonderful example of the technology.

Dank je, Evan, je bent een geweldig voorbeeld van de technologie.

So, as you can see, before, there is a leveling system built into this software so that as Evan, or any user, becomes more familiar with the system, they can continue to add more and more detections, so that the system begins to differentiate between different distinct thoughts. And once you've trained up the detections, these thoughts can be assigned or mapped to any computing platform, application or device.

Zoals je kon zien, is er een systeem met niveaus in deze software ingebouwd, zodat Evan, of iemand anders, meerdere detecties kunnen toevoegen, naarmate ze meer vertrouwd raken met het systeem zodat het systeem onderscheid kan beginnen maken tussen verschillende gedachten. Zodra je het detectiemechanisme getraind hebt, kunnen deze gedachten toegewezen worden aan elk willekeurig computerplatform, elke toepassing, of elk apparaat.

So I'd like to show you a few examples, because there are many possible applications for this new interface. In games and virtual worlds, for example, your facial expressions can naturally and intuitively be used to control an avatar or virtual character. Obviously, you can experience the fantasy of magic and control the world with your mind. And also, colors, lighting, sound and effects can dynamically respond to your emotional state to heighten the experience that you're having, in real time. And moving on to some applications developed by developers and researchers around the world, with robots and simple machines, for example -- in this case, flying a toy helicopter simply by thinking "lift" with your mind.

Ik zou dus enkele voorbeelden willen laten zien, omdat er vele mogelijke toepassingen zijn voor deze nieuwe interface. In spellen en virtuele werelden, bijvoorbeeld, kunnen je gezichtsuitdrukkingen natuurlijk en intuïtief gebruikt worden om een avatar of virtueel personage te controleren. Zo kun je natuurlijk de fantasie van de magie beleven en de wereld besturen met je geest. Verder kunnen kleur, belichting, geluid en effecten dynamisch beantwoorden aan je emoties, om de beleving intenser te maken. We gaan door met enkele toepassingen ontworpen door ontwerpers en onderzoekers over heel de wereld, met robots en simpele machines, zoals, bijvoorbeeld, een speelgoedhelikopter besturen, gewoon door "omhoog" te denken met je geest.

The technology can also be applied to real world applications -- in this example, a smart home. You know, from the user interface of the control system to opening curtains or closing curtains. And of course, also to the lighting -- turning them on or off. And finally, to real life-changing applications, such as being able to control an electric wheelchair. In this example, facial expressions are mapped to the movement commands.

Deze technologie kan ook toegepast worden in de echte wereld, zoals in dit voorbeeld van een intelligent huis. Zoals je kan zien kun je de gordijnen sluiten of openen vanaf de interface van het controlesysteem. En natuurlijk ook het licht: het aansteken, of uit. En tenslotte, voor echt levensveranderende toepassingen, zoals het besturen van een elektrische rolstoel. In dit voorbeeld zijn gezichtsuitdrukkingen toegewezen aan de bewegingscommando's.

Man: Now blink right to go right. Now blink left to turn back left. Now smile to go straight.

Man: Knipper nu met uw rechteroog om naar rechts te gaan. En nu met uw linkeroog om terug naar links te gaan. Glimlach nu om rechtdoor te gaan.

TL: We really -- Thank you.

We zien -- Dank u.

(Applause)

(Applaus)

We are really only scratching the surface of what is possible today, and with the community's input, and also with the involvement of developers and researchers from around the world, we hope that you can help us to shape where the technology goes from here. Thank you so much.

We zien echt nog enkel het topje van de ijsberg van wat vandaag mogelijk is. Door inspraak van de gemeenschap en door ontwikkelaars en onderzoekers van over de wereld erbij te betrekken, hopen we dat jullie ons kunnen helpen bepalen waar het heen moet met de technologie. Bedankt.