Up until now, our communication with machines has always been limited to conscious and direct forms. Whether it's something simple like turning on the lights with a switch, or even as complex as programming robotics, we have always had to give a command to a machine, or even a series of commands, in order for it to do something for us. Communication between people, on the other hand, is far more complex and a lot more interesting because we take into account so much more than what is explicitly expressed. We observe facial expressions, body language, and we can intuit feelings and emotions from our dialogue with one another. This actually forms a large part of our decision-making process. Our vision is to introduce this whole new realm of human interaction into human-computer interaction so that computers can understand not only what you direct it to do, but it can also respond to your facial expressions and emotional experiences. And what better way to do this than by interpreting the signals naturally produced by our brain, our center for control and experience.

Frem til nå, har vår kommunikasjon med maskiner alltid vært begrenset til bevisste og direkte former. Uansett om det det er noe så enkelt som å skru på lysene med en bryter, eller noe så komplisert som å programmere roboter, har vi alltid måtte gi maskinen en kommando, i noen tilfeller, flere kommandoer, for å få maskinen til å gjøre noe for oss. Kommunikasjon mellom mennesker derimot, er mer komplisert og mye mer interessant, fordi vi må ta hensyn til så mye mer enn det som blir sagt verbalt. Vi observerer ansiktsuttrykk og kroppsspråk, og vi kan merke følelser og humør fra samtalene vi har med hverandre. Disse inntrykkene danner faktisk en stor del av vår beslutningsprosess. Vårt mål er å introdusere dette nye området innenfor menneskelig samhandling inn i en menneske-maskin samhandling, slik at maskiner kan forstå ikke bare hva du styrer de til å gjøre, men at de også svarer til dine ansiktsuttrykk og følelsemessige opplevelser. Hvilken bedre måte finnes da, enn at maskinen tolker signaler som produseres naturlig av hjernen vår, senteret vårt for kontroll og erfaring.

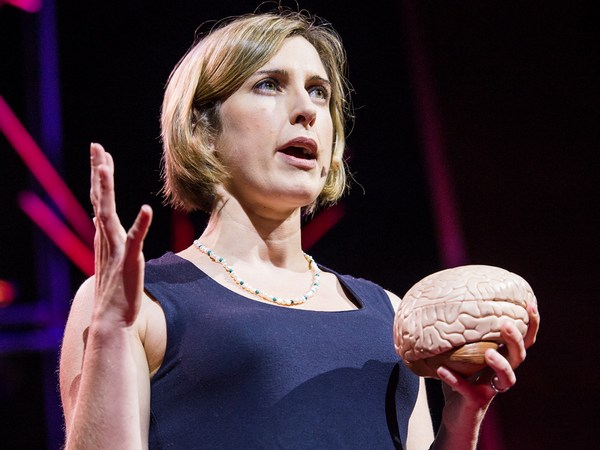

Well, it sounds like a pretty good idea, but this task, as Bruno mentioned, isn't an easy one for two main reasons: First, the detection algorithms. Our brain is made up of billions of active neurons, around 170,000 km of combined axon length. When these neurons interact, the chemical reaction emits an electrical impulse, which can be measured. The majority of our functional brain is distributed over the outer surface layer of the brain, and to increase the area that's available for mental capacity, the brain surface is highly folded. Now this cortical folding presents a significant challenge for interpreting surface electrical impulses. Each individual's cortex is folded differently, very much like a fingerprint. So even though a signal may come from the same functional part of the brain, by the time the structure has been folded, its physical location is very different between individuals, even identical twins. There is no longer any consistency in the surface signals.

Vel, det virker nok som en rimelig god idé, men denne oppgaven, som Bruno nevnte, er ikke så lett, på grunn av to årsaker: Først, deteksjonsalgoritmen: Hjernen vår er laget av milliarder av aktive nerveceller; ca. 170 000 km med aksoner. Når hjernens nerveceller kommuniserer, avgis det en elektrisk impuls, som følge av en kjemisk reaksjon, som kan måles. Mesteparten av vår funksjonelle hjerne er fordelt over den ytre overflaten av hjernen. For å øke overflaten, som er tilgjengelig for mental kapasitet, er hjernens overflate, i stor del, foldet. Denne foldingen skaper en vesentlig utfordring i tolkningen av elektriske overflate-impulser. Hver persons hjernebark er foldet forskjellig, ikke ulikt fingeravtrykk. Så selv om et signal kommer fra samme funksjonelle hjernedel hos et menneske, er det forskjell på hvordan hjernedelen har blitt foldet. Signalets fysiske plassering er veldig forskjelig fra person til person, til og med eneggede tvillinger. Det finnes altså ikke noen sammenheng i overflatesignalene.

Our breakthrough was to create an algorithm that unfolds the cortex, so that we can map the signals closer to its source, and therefore making it capable of working across a mass population. The second challenge is the actual device for observing brainwaves. EEG measurements typically involve a hairnet with an array of sensors, like the one that you can see here in the photo. A technician will put the electrodes onto the scalp using a conductive gel or paste and usually after a procedure of preparing the scalp by light abrasion. Now this is quite time consuming and isn't the most comfortable process. And on top of that, these systems actually cost in the tens of thousands of dollars.

Vårt gjennombrudd var å lage en algoritme som foldet ut hjernebarken, slik at vi kunne kartlegge signalene nærmere deres opprinnelige kilde, og derfor gjøre det mulig å jobbe med en stor befolkning. Den andre utfordringen er apparatet for observasjon av hjernebølger. Ofte involverer EEG-målinger et hårnett fullt av sensorer, slik som dere kan se på bildet. En tekniker setter elektrodene på hodebunnen ved hjelp av en ledende gelé eller krem, vanligvis etter en klargjøring av hodebunnen, ved rensing. Dette tar veldig lang tid og er ikke en veldig komfortabel prosess. Og på toppen av det, er disse systemene kostbare, opp til titusener av dollar.

So with that, I'd like to invite onstage Evan Grant, who is one of last year's speakers, who's kindly agreed to help me to demonstrate what we've been able to develop.

Med det vil jeg gjerne invitere Evan Grant til scenen, en av fjorårets foredragsholdere, som gikk med på å hjelpe til med demonstrasjonen av det vi har klart å utvikle.

(Applause)

(Applaus)

So the device that you see is a 14-channel, high-fidelity EEG acquisition system. It doesn't require any scalp preparation, no conductive gel or paste. It only takes a few minutes to put on and for the signals to settle. It's also wireless, so it gives you the freedom to move around. And compared to the tens of thousands of dollars for a traditional EEG system, this headset only costs a few hundred dollars. Now on to the detection algorithms. So facial expressions -- as I mentioned before in emotional experiences -- are actually designed to work out of the box with some sensitivity adjustments available for personalization. But with the limited time we have available, I'd like to show you the cognitive suite, which is the ability for you to basically move virtual objects with your mind.

Apparatet du ser er en 14-kanals, Hi-Fi EEG-ervervings system. Det trenger ingen klargjøring av hodebunnen, heller ingen ledende gelé eller krem. Det tar få minutter å sette på, og kalibrere signaler. Den er også trådløs, så du kan bevege deg fritt. Sammenlignet med titusener av dollar for et tradisjonelt EEG-system, koster dette headsettet bare noen hundre dollar. Nå til deteksjonsalgoritmene. Ansiktsuttrykk -- som jeg nevnte tidligere under følelsesmessige opplevelser -- er faktisk designet til å virke umiddelbart, og er med få justeringer av følsomhet tilgjengelig for personlig tilpassing. Men med begrenset tid vil jeg gjerne vise den kognitive pakken, som er muligheten din til å flytte virtuelle objekter med tankene dine.

Now, Evan is new to this system, so what we have to do first is create a new profile for him. He's obviously not Joanne -- so we'll "add user." Evan. Okay. So the first thing we need to do with the cognitive suite is to start with training a neutral signal. With neutral, there's nothing in particular that Evan needs to do. He just hangs out. He's relaxed. And the idea is to establish a baseline or normal state for his brain, because every brain is different. It takes eight seconds to do this, and now that that's done, we can choose a movement-based action. So Evan, choose something that you can visualize clearly in your mind.

Dette system er nytt for Evan, så det vi må gjøre først er å lage en profil til han. Han er tydeligvis ikke Joanne - så vi "legger til en bruker". Evan. Ok. Den første tingen vi trenger å gjøre med den kognitive pakken er å starte med treningen av et nøytralt signal. Med nøytral, menes det at det er ikke noe spesielt som Evan trenger å gjøre. Han tar det med ro. Han er avslappet. Og idéen er å etablere en basis eller normaltilstand for hjernen hans, fordi ingen hjerner er like. Det tar åtte sekunder å gjøre dette. Og nå som det er ferdig, kan vi velge en bevegelsesbasert handling. Evan, velg noe som du kan se klart i hodet ditt.

Evan Grant: Let's do "pull."

Evan Grant: La oss prøve "dra".

Tan Le: Okay, so let's choose "pull." So the idea here now is that Evan needs to imagine the object coming forward into the screen, and there's a progress bar that will scroll across the screen while he's doing that. The first time, nothing will happen, because the system has no idea how he thinks about "pull." But maintain that thought for the entire duration of the eight seconds. So: one, two, three, go. Okay. So once we accept this, the cube is live. So let's see if Evan can actually try and imagine pulling. Ah, good job! (Applause) That's really amazing.

Tan Le: Ok. La oss velge "dra." Tanken her nå er at Evan trenger å forestille seg objektet komme mot skjermen. En fremdriftsindikator vil vises på skjermen mens han gjør det. Første gangen vil ingenting skje, fordi systemet ikke vet at han tenker på "dra". Men hold tanken alle åtte sekundene. En, to, tre, kjør. Ok. Med en gang vi godtar dette, blir kuben levende. Så, la oss se om Evan faktisk kan prøve, og tenke, "dra," Bra jobba! (Applaus) Det er ganske utrolig.

(Applause)

(Applaus)

So we have a little bit of time available, so I'm going to ask Evan to do a really difficult task. And this one is difficult because it's all about being able to visualize something that doesn't exist in our physical world. This is "disappear." So what you want to do -- at least with movement-based actions, we do that all the time, so you can visualize it. But with "disappear," there's really no analogies -- so Evan, what you want to do here is to imagine the cube slowly fading out, okay. Same sort of drill. So: one, two, three, go. Okay. Let's try that. Oh, my goodness. He's just too good. Let's try that again.

Vi har litt mer tid igjen, så jeg kommer til å spørre Evan om å gjøre en vanskelig oppgave. Og denne er vanskelig fordi det hele handler om å klare å visualisere noe som ikke eksisterer i vår fysiske verden. Dette er "forsvinn." Det du vil, iallefall med bevegelsesbaserte handlinger, som vi gjør hele tiden, slik at du kan visualisere det. Med med "forsvinn," er det egentlig ingen analogier. Evan, det du må gjøre her er å forestille deg at kuben tones ut sakte. Samme som i stad. En, to, tre, kjør. Okey. La oss prøve. Herregud. Han er litt for flink. La oss prøve igjen.

EG: Losing concentration.

EG: Jeg mister konsentrasjonen.

(Laughter)

(Latter)

TL: But we can see that it actually works, even though you can only hold it for a little bit of time. As I said, it's a very difficult process to imagine this. And the great thing about it is that we've only given the software one instance of how he thinks about "disappear." As there is a machine learning algorithm in this --

TL: Men vi kan faktisk se at det virker, selv om du bare klarer å holde tanken en liten stund. Som jeg sa, det er en veldig vanskelig prosess å forestille seg dette. Og den beste tingen med dette er at vi kun ga programvaren et forsøk på hvordan han tenkte "forsvinn." Siden det er en læringsalgoritme i maskinen --

(Applause)

(Applaus)

Thank you. Good job. Good job.

Takk. Bra jobba. Bra jobba.

(Applause)

(Applaus)

Thank you, Evan, you're a wonderful, wonderful example of the technology.

Takk skal du ha, Evan. Du er et fantastisk, fantastisk eksempel på teknologien.

So, as you can see, before, there is a leveling system built into this software so that as Evan, or any user, becomes more familiar with the system, they can continue to add more and more detections, so that the system begins to differentiate between different distinct thoughts. And once you've trained up the detections, these thoughts can be assigned or mapped to any computing platform, application or device.

Som dere så i stad, er det et nivåsystem innebygd i programvaren slik at ettersom Evan, eller hvilken som helst bruker, blir kjent med systemet, kan de fortsette å legge til fler og fler deteksjoner, slik at system begynner å skille mellom ulike bestemte tanker. Og når du har trent opp deteksjonene, kan tankene tilordnes eller kartlegges til hvilken som helst platform, program eller enhet.

So I'd like to show you a few examples, because there are many possible applications for this new interface. In games and virtual worlds, for example, your facial expressions can naturally and intuitively be used to control an avatar or virtual character. Obviously, you can experience the fantasy of magic and control the world with your mind. And also, colors, lighting, sound and effects can dynamically respond to your emotional state to heighten the experience that you're having, in real time. And moving on to some applications developed by developers and researchers around the world, with robots and simple machines, for example -- in this case, flying a toy helicopter simply by thinking "lift" with your mind.

Jeg vil vise dere et par eksempler, fordi det er mange mulige bruksområder for dette nye grensesnittet. For eksempel, i spill og virtuelle verdener, kan dine ansiktsuttrykk naturlig og intuitivt bli brukt til å kontrollere en avatar eller en virtuell figur. Selvfølgelig kan du oppleve magi og kontrollere verden med tankene dine. Også farger, belysning, lyd og effekter, kan reagere dynamisk på bakgrunn av ditt humør for å øke opplevelsen du får, i sanntid. Videre til noen tilpassede programmer laget av utviklere og forskere omkring i verden, med roboter og enkle maskiner, for eksempel -- i dette tilfelle, å fly et lekehelikopter kun ved å tenke "løft" med hodet ditt.

The technology can also be applied to real world applications -- in this example, a smart home. You know, from the user interface of the control system to opening curtains or closing curtains. And of course, also to the lighting -- turning them on or off. And finally, to real life-changing applications, such as being able to control an electric wheelchair. In this example, facial expressions are mapped to the movement commands.

Teknologien kan også brukes i den virkelig verden -- i dette eksempelet, et smarthus. Fra menyen i kontrollsystemet, til å åpne gardiner, eller lukke dem. Og selvfølgelig også belysningen -- skru på, eller av. Og til slutt, til livsforvandlende bruksområder, som å klare å styre en elektrisk rullestol. I dette eksempelet, er ansiktsuttrykk koblet til bevegelseskommandoene.

Man: Now blink right to go right. Now blink left to turn back left. Now smile to go straight.

Mann: Blunk med høyre for å gå til høyre. Blunk med venstre for å snu tilbake. Smil for å gå rett frem.

TL: We really -- Thank you.

TL: Vi... -- Takk skal dere ha.

(Applause)

(Applaus)

We are really only scratching the surface of what is possible today, and with the community's input, and also with the involvement of developers and researchers from around the world, we hope that you can help us to shape where the technology goes from here. Thank you so much.

Vi skraper kun på overflaten av hva som er mulig i dag. Og med innspill fra fellesskapet, i tillegg til utviklerenes involvering, og forskerne omkring i verden, håper vi at du kan hjelpe oss å forme denne teknologien videre. Takk skal dere ha.