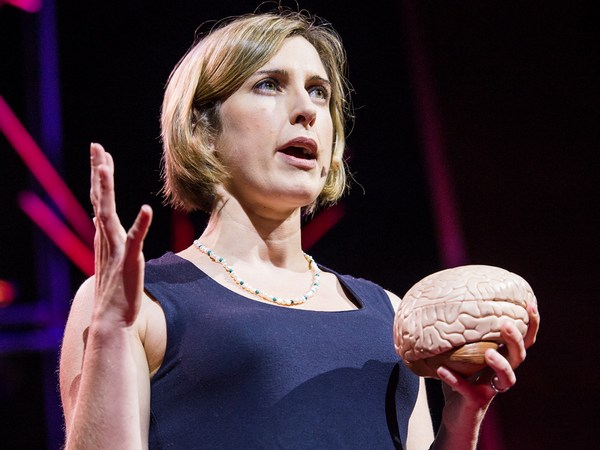

Up until now, our communication with machines has always been limited to conscious and direct forms. Whether it's something simple like turning on the lights with a switch, or even as complex as programming robotics, we have always had to give a command to a machine, or even a series of commands, in order for it to do something for us. Communication between people, on the other hand, is far more complex and a lot more interesting because we take into account so much more than what is explicitly expressed. We observe facial expressions, body language, and we can intuit feelings and emotions from our dialogue with one another. This actually forms a large part of our decision-making process. Our vision is to introduce this whole new realm of human interaction into human-computer interaction so that computers can understand not only what you direct it to do, but it can also respond to your facial expressions and emotional experiences. And what better way to do this than by interpreting the signals naturally produced by our brain, our center for control and experience.

Sampai sekarang, komunikasi kita dengan mesin selalu terbatas pada bentuk komunikasi langsung dan sadar. Baik sesuatu yang sederhana seperti menyalakan lampu dengan tombol maupun yang kompleks seperti pemrograman robot, kita selalu harus memberikan perintah atau bahkan serangkaian perintah kepada mesin agar mesin itu melakukan apa yang kita inginkan. Di sisi lain komunikasi antarmanusia jauh lebih kompleks dan menarik karena kita melibatkan jauh lebih banyak daripada yang terlihat secara eksplisit. Kita mengamati ekspresi wajah, bahasa tubuh, dan kita dapat merasakan emosi dan perasaan dari percakapan kita satu sama lain. Ini sebenarnya merupakan bagian yang besar dari proses pengambilan keputusan kita. Visi kami adalah memperkenalkan dunia baru dari interaksi manusia dengan interaksi komputer-manusia sehingga komputer dapat memahami tidak hanya apa yang Anda perintahkan, namun juga dapat menanggapi ekspresi wajah dan pengalaman emosi Anda. Dan cara terbaik untuk melakukan hal ini adalah dengan menafsirkan sinyal yang dihasilkan secara alami dari otak, pusat pengendalian dan pengalaman kita.

Well, it sounds like a pretty good idea, but this task, as Bruno mentioned, isn't an easy one for two main reasons: First, the detection algorithms. Our brain is made up of billions of active neurons, around 170,000 km of combined axon length. When these neurons interact, the chemical reaction emits an electrical impulse, which can be measured. The majority of our functional brain is distributed over the outer surface layer of the brain, and to increase the area that's available for mental capacity, the brain surface is highly folded. Now this cortical folding presents a significant challenge for interpreting surface electrical impulses. Each individual's cortex is folded differently, very much like a fingerprint. So even though a signal may come from the same functional part of the brain, by the time the structure has been folded, its physical location is very different between individuals, even identical twins. There is no longer any consistency in the surface signals.

Gagasan ini terdengar cukup bagus, namun seperti yang dikatakan Bruno, ini bukan hal mudah karena dua alasan utama: Pertama, algoritme pendeteksi. Otak kita terdiri dari miliaran sel syaraf aktif, dengan panjang akson sekitar 170.000 km. Saat sel syaraf ini saling berhubungan, reaksi kimianya mengeluarkan kejutan listrik yang dapat diukur. Kebanyakan dari otak kita yang berfungsi terdapat pada lapisan permukaan luar dari otak. Dan untuk memperluas daerah yang tersedia bagi kemampuan mental, permukaan otak memiliki banyak lipatan. Dan lipatan korteks ini memberikan tantangan besar dalam menafsirkan kejutan listrik di permukaannya. Lipatan korteks setiap orang sangat berbeda seperti sebuah sidik jari. Jadi walaupun sinyal berasal dari bagian otak yang sama pada saat struktur itu telah terlipat, lokasi fisiknya sangat berbeda bagi masing-masing orang, bahkan pada kembar siam. Sehingga tidak ada konsistensi bagi sinyal permukaan.

Our breakthrough was to create an algorithm that unfolds the cortex, so that we can map the signals closer to its source, and therefore making it capable of working across a mass population. The second challenge is the actual device for observing brainwaves. EEG measurements typically involve a hairnet with an array of sensors, like the one that you can see here in the photo. A technician will put the electrodes onto the scalp using a conductive gel or paste and usually after a procedure of preparing the scalp by light abrasion. Now this is quite time consuming and isn't the most comfortable process. And on top of that, these systems actually cost in the tens of thousands of dollars.

Terobosan kami adalah menciptakan algoritme yang membuka lipatan itu sehingga kami dapat memetakan sinyal lebih dekat pada sumbernya, sehingga memungkinkan alat ini dapat bekerja pada orang banyak. Tantangan kedua adalah perangkat untuk mengamati gelombang otak, pengukuran EEG biasanya berupa jaring rambut rumit dengan serangkaian sensor seperti yang terlihat pada foto ini. Seorang teknisi akan memasang elektroda pada kulit kepala menggunakan gel atau pasta konduktif dan biasanya kulit kepala itu harus digores terlebih dahulu. Proses ini cukup memakan waktu dan tidak begitu nyaman. Dan yang lebih penting lagi, harga sistem ini sebenarnya puluhan ribu dolar.

So with that, I'd like to invite onstage Evan Grant, who is one of last year's speakers, who's kindly agreed to help me to demonstrate what we've been able to develop.

Maka dengan itu, saya ingin mengundang ke atas panggung Evan Grant, salah satu pembicara pada konferensi tahun lalu, yang telah setuju untuk membantu saya mendemonstrasikan apa yang telah kami kembangkan.

(Applause)

(Tepuk tangan)

So the device that you see is a 14-channel, high-fidelity EEG acquisition system. It doesn't require any scalp preparation, no conductive gel or paste. It only takes a few minutes to put on and for the signals to settle. It's also wireless, so it gives you the freedom to move around. And compared to the tens of thousands of dollars for a traditional EEG system, this headset only costs a few hundred dollars. Now on to the detection algorithms. So facial expressions -- as I mentioned before in emotional experiences -- are actually designed to work out of the box with some sensitivity adjustments available for personalization. But with the limited time we have available, I'd like to show you the cognitive suite, which is the ability for you to basically move virtual objects with your mind.

Jadi perangkat yang Anda lihat adalah sistem penerimaan EEG 14 saluran berketepatan tinggi. Perangkat ini tidak memerlukan persiapan apa-apa tanpa gel atau pasta konduktif. Hanya perlu beberapa menit untuk memakai dan menstabilkan sinyalnya. Ini juga perangkat nirkabel, sehingga memberikan Anda kebebasan bergerak. Dan dibandingkan dengan puluhan ribu dolar dari harga sistem EEG tradisional, harga headset ini hanya beberapa ratus dolar. Lalu algoritme pendeteksinya. Jadi ekspresi wajah -- seperti yang saya telah sebutkan dalam pengalaman emosi -- sebenarnya dirancang untuk dapat langsung bekerja dengan tingkat kepekaan yang dapat disesuaikan. Namun karena waktu kami terbatas, saya ingin menunjukkan paket koqnitif, yaitu kemampuan Anda untuk menggerakkan objek virtual dengan pikiran.

Now, Evan is new to this system, so what we have to do first is create a new profile for him. He's obviously not Joanne -- so we'll "add user." Evan. Okay. So the first thing we need to do with the cognitive suite is to start with training a neutral signal. With neutral, there's nothing in particular that Evan needs to do. He just hangs out. He's relaxed. And the idea is to establish a baseline or normal state for his brain, because every brain is different. It takes eight seconds to do this, and now that that's done, we can choose a movement-based action. So Evan, choose something that you can visualize clearly in your mind.

Evan adalah orang baru bagi sistem ini, sehingga pertama-tama kita harus menciptakan profil baru baginya. Sudah pasti dia bukan Joanne -- sehingga "add user." Evan. Baiklah. Jadi hal pertama yang harus kita lakukan adalah dengan latihan sinyal yang netral. Sinyal yang netral, maksudnya tidak ada yang harus dilakukan Evan. Dia hanya perlu diam. Bersantai. Maksud dari ini adalah untuk membuat dasar atau kondisi normal dari otaknya, karena setiap otak berbeda. Diperlukan 8 detik untuk membuatnya. Dan sekarang sudah selesai, kita dapat memilih kegiatan bergerak. Jadi Evan memilih sesuatu yang dapat Anda bayangkan secara jelas dalam pikiran Anda.

Evan Grant: Let's do "pull."

Evan Grant: Mari kita, "tarik."

Tan Le: Okay, so let's choose "pull." So the idea here now is that Evan needs to imagine the object coming forward into the screen, and there's a progress bar that will scroll across the screen while he's doing that. The first time, nothing will happen, because the system has no idea how he thinks about "pull." But maintain that thought for the entire duration of the eight seconds. So: one, two, three, go. Okay. So once we accept this, the cube is live. So let's see if Evan can actually try and imagine pulling. Ah, good job! (Applause) That's really amazing.

Tan Le: Baiklah. Kita pilih "tarik." Jadi gagasannya adalah Evan harus membayangkan objek itu mendekat ke layar. Dan ada grafik yang akan bergerak di layar saat dia melakukannya. Pertama kali, tidak ada yang terjadi karena sistem ini tidak tahu bagaimana dia berpikir "tarik." Namun jika dia terus berpikir seperti tiu selama 8 detik. Lalu: satu, dua, tiga, tarik. Baiklah. Jadi saat sistem ini menerimanya, kubus ini menjadi hidup. Jadi mari kita saksikan Evan dapat mencoba membayangkan menariknya. Ah, bagus! (Tepuk tangan) Cukup mengagumkan.

(Applause)

(Tepuk tangan)

So we have a little bit of time available, so I'm going to ask Evan to do a really difficult task. And this one is difficult because it's all about being able to visualize something that doesn't exist in our physical world. This is "disappear." So what you want to do -- at least with movement-based actions, we do that all the time, so you can visualize it. But with "disappear," there's really no analogies -- so Evan, what you want to do here is to imagine the cube slowly fading out, okay. Same sort of drill. So: one, two, three, go. Okay. Let's try that. Oh, my goodness. He's just too good. Let's try that again.

Kami masih memiliki sedikit waktu jadi saya akan meminta Evan melakukan hal yang sulit. Dan ini sulit karena berhubungan tentang memvisualisasikan sesuatu yang tidak ada di dunia fisik. Inilah "menghilang." Jadi yang kita inginkan -- dalam kegiatan bergerak, Anda melakukannya setiap saat sehingga dapat memvisualisasikannya. Namun "menghilang," benar-benar tidak ada analoginya. Jadi Evan, yang akan Anda lakukan adalah membayangkan kubus itu perlahan-lahan menghilang. Mari berlatih. Jadi: satu, dua, tiga, mulai. Baiklah. Mari kita coba. Astaga. Dia sungguh hebat. Mari kita coba lagi.

EG: Losing concentration.

EG: Kehilangan konsentrasi.

(Laughter)

(Suara tawa)

TL: But we can see that it actually works, even though you can only hold it for a little bit of time. As I said, it's a very difficult process to imagine this. And the great thing about it is that we've only given the software one instance of how he thinks about "disappear." As there is a machine learning algorithm in this --

TL: Namun sebenarnya hal itu berhasil walaupun Anda hanya dapat menghilangkannya dalam waktu yang singkat. Seperti yang saya katakan, sulit untuk membayangkan hal ini. Dan hal yang hebat adalah piranti lunak ini hanya diberi satu kesempatan tentang bagaimana dia memikirkan "menghilang" Dan ada algoritme pembelajaran mesin dalam benda ini --

(Applause)

(Tepuk tangan)

Thank you. Good job. Good job.

Terima kasih. Bagus. Bagus.

(Applause)

(Tepuk tangan)

Thank you, Evan, you're a wonderful, wonderful example of the technology.

Terima kasih Evan. Anda adalah contoh luar biasa dari teknologi ini.

So, as you can see, before, there is a leveling system built into this software so that as Evan, or any user, becomes more familiar with the system, they can continue to add more and more detections, so that the system begins to differentiate between different distinct thoughts. And once you've trained up the detections, these thoughts can be assigned or mapped to any computing platform, application or device.

Jadi seperti yang Anda lihat ada sistem penyetaraan di dalam piranti lunak ini sehingga Evan, atau pengguna lainnya menjadi lebih akrab dengan sistem ini, mereka dapat terus menambah deteksinya, sehingga sistem ini mulai membedakan berbagai pikiran yang berbeda-beda. Setelah Anda terlatih dengan deteksinya, pemikiran itu dapat diberikan atau dipetakan ke dalam platform komputasi, aplikasi ataupun perangkat apapun.

So I'd like to show you a few examples, because there are many possible applications for this new interface. In games and virtual worlds, for example, your facial expressions can naturally and intuitively be used to control an avatar or virtual character. Obviously, you can experience the fantasy of magic and control the world with your mind. And also, colors, lighting, sound and effects can dynamically respond to your emotional state to heighten the experience that you're having, in real time. And moving on to some applications developed by developers and researchers around the world, with robots and simple machines, for example -- in this case, flying a toy helicopter simply by thinking "lift" with your mind.

Saya ingin menunjukkan beberapa contoh karena ada banyak kemungkinan penerapan dari antarmuka baru ini. Dalam permainan dan dunia virtual, sebagai contoh, ekspresi wajah Anda dapat digunakan secara alami dan intuitif untuk mengendalikan avatar atau karakter virtual. Anda dapat merasakan fantasi dari keajaiban dan mengendalikan dunia dengan pikiran Anda. Dan juga warna, pencahayaan, suara, dan efeknya dapat menanggapi kondisi emosional Anda untuk menguatkan pengalaman yang Anda rasakan, langsung. Lalu beralih ke aplikasi lain yang dikembangkan oleh para pengembang dan peneliti di seluruh dunia dengan robot dan mesin-mesin sederhana -- dalam hal ini, menerbangkan helikopter mainan hanya dengan memikirkan terbang.

The technology can also be applied to real world applications -- in this example, a smart home. You know, from the user interface of the control system to opening curtains or closing curtains. And of course, also to the lighting -- turning them on or off. And finally, to real life-changing applications, such as being able to control an electric wheelchair. In this example, facial expressions are mapped to the movement commands.

Teknologi ini juga dapat diterapkan pada dunia nyata -- sebagai contoh, rumah cerdas. Anda tahu, dari penggunaan antarmuka sistem pengendalian untuk membuka atau menutup tirai. Dan tentu saja untuk lampu -- menyalakan atau mematikannya. Dan akhirnya, untuk penerapan yang mengubah dunia seperti dapat mengendalikan kursi roda listrik. Dalam contoh ini, ekspresi wajah dipetakan pada perintah untuk bergerak.

Man: Now blink right to go right. Now blink left to turn back left. Now smile to go straight.

Pria: Kedipan mata kanan untuk ke kanan. Kedipan mata kiri untuk ke kiri. Tersenyum untuk lurus ke depan.

TL: We really -- Thank you.

TL: Kami benar-benar -- Terima kasih.

(Applause)

(Tepuk tangan)

We are really only scratching the surface of what is possible today, and with the community's input, and also with the involvement of developers and researchers from around the world, we hope that you can help us to shape where the technology goes from here. Thank you so much.

Kami benar-benar hanya ada pada permukaan akan apa yang mungkin. Dan dengan masukan dari masyarakat dan juga keterlibatan para pengembang dan peneliti dari seluruh dunia, kami harap Anda dapat membantu kami mengarahkan teknologi ini dari titik saat ini. Terima kasih banyak.