Up until now, our communication with machines has always been limited to conscious and direct forms. Whether it's something simple like turning on the lights with a switch, or even as complex as programming robotics, we have always had to give a command to a machine, or even a series of commands, in order for it to do something for us. Communication between people, on the other hand, is far more complex and a lot more interesting because we take into account so much more than what is explicitly expressed. We observe facial expressions, body language, and we can intuit feelings and emotions from our dialogue with one another. This actually forms a large part of our decision-making process. Our vision is to introduce this whole new realm of human interaction into human-computer interaction so that computers can understand not only what you direct it to do, but it can also respond to your facial expressions and emotional experiences. And what better way to do this than by interpreting the signals naturally produced by our brain, our center for control and experience.

עד כה, התקשורת שלנו עם מכונות הייתה תמיד מוגבלת לדרכים ישירות ומודעות. בין אם זה משהו פשוט כמו להדליק את האורות באמצעות המתג, ובין אם מדובר בתכנות רובוטים מורכב, תמיד היינו צריכים לתת פקודה למכונה, או אפילו שורה של פקודות, על מנת שזו תעשה משהו עבורינו. תקשורת בין אנשים מצד שני, הינה מורכבת הרבה יותר ומעניינת מאוד, מכיוון שאנו לוקחים בחשבון הרבה מעבר לביטוי המפורש של הדברים. אנו צופים בהבעות הפנים, שפת הגוף, ואנו יכול לפרש תחושות ורגשות מהדיאלוג שלנו עם האחר. זהו למעשה מרכיב משמעותי מתהליך קבלת ההחלטות שלנו. החזון שלנו הוא להכניס את העולם החדש של אינטראקציה אנושית לאינטראקציה שבין אדם למכונה. כך שמחשבים יוכלו להבין לא רק מה שאנו אומרים להם לעשות, אך הם גם יוכלו להגיב להבעות הפנים שלך ולהבעות הגוף. ואיזו דרך טובה יותר לעשות זאת מאשר לפענח את האותות המופקים באופן טבעי ע"י המוח שלנו, המרכז שלנו לשליטה וחוויה.

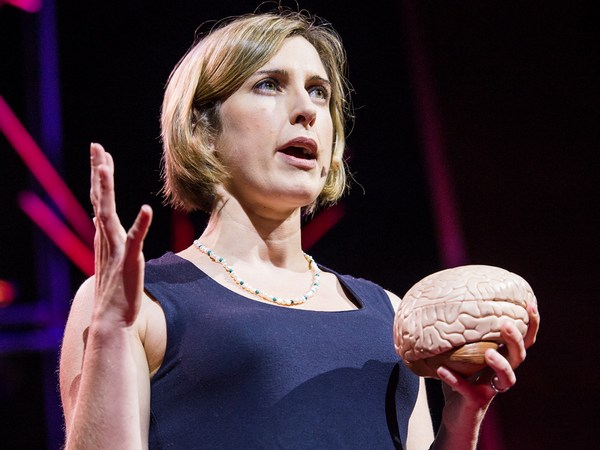

Well, it sounds like a pretty good idea, but this task, as Bruno mentioned, isn't an easy one for two main reasons: First, the detection algorithms. Our brain is made up of billions of active neurons, around 170,000 km of combined axon length. When these neurons interact, the chemical reaction emits an electrical impulse, which can be measured. The majority of our functional brain is distributed over the outer surface layer of the brain, and to increase the area that's available for mental capacity, the brain surface is highly folded. Now this cortical folding presents a significant challenge for interpreting surface electrical impulses. Each individual's cortex is folded differently, very much like a fingerprint. So even though a signal may come from the same functional part of the brain, by the time the structure has been folded, its physical location is very different between individuals, even identical twins. There is no longer any consistency in the surface signals.

ובכן, זה נשמע כמו רעיון טוב למדי, אך המשימה הזו, כמו שברונו ציין, לא קלה בשל שתי סיבות: הראשונה, אלגוריתם הזיהוי. המוח שלנו מורכב ממיליארדי נוירונים פעילים, בערך 170,000 ק"מ של אקסונים משולבים. כאשר נוצרת אינטראקציה בין הניורונים הללו, התגובה הכימית מפיצה פולס חשמלי אותו ניתן למדוד. רובו של המוח הפעיל שלנו נמצא באיזור משטח השכבה החיצונית של המוח שלנו. ועל מנת להגדיל את השטח הקיים ליכולות מנטליות, משטח המוח מקופל ביותר. כעת, הקיפול המוחי הזה מציג אתגר משמעותי בפיענוח פולסים חשמליים. הקליפה המוחית של כל אדם מקופלת באופן שונה, בדומה מאוד לטביעת אצבע. כך שלמרות שאות יכול להגיע מחלק דומה במוח הפעיל, בזמן שהמבנה התקפל, המיקום הפיזי שלו שונה מאוד בין אדם לאדם, אפילו בתאומים זהים. כבר אין אחידות באותות על פני השטח.

Our breakthrough was to create an algorithm that unfolds the cortex, so that we can map the signals closer to its source, and therefore making it capable of working across a mass population. The second challenge is the actual device for observing brainwaves. EEG measurements typically involve a hairnet with an array of sensors, like the one that you can see here in the photo. A technician will put the electrodes onto the scalp using a conductive gel or paste and usually after a procedure of preparing the scalp by light abrasion. Now this is quite time consuming and isn't the most comfortable process. And on top of that, these systems actually cost in the tens of thousands of dollars.

פריצת הדרך שלנו הייתה ביצירת אלגוריתם אשר פותח את קיפולי הקליפה המוחית, כך שאנו יכולים למפות את האותות קרוב יותר למקור שלהם, ובכך מאפשרים למערכת לעבוד עם אוכלוסיה גדולה. האתגר השני הוא המכשיר עצמו לצפייה בגלי המוח מדידות EEG בדרך כלל כוללות רשת שיער עם מערך של חיישנים, כמו זו שאתם יכולים לראות כאן בתמונה. טכנאי שם את האלקטרודות על הקרקפת באמצעות ג'ל מוליך או משחה ולרוב לאחר תהליך של הכנת הקרקפת ע"י שפשוף קל. כעת, זהו תהליך הצורך זמן מה וגם לא מאוד נוח. ובנוסף, מערכות אלו למעשה עולות עשרות אלפי דולרים.

So with that, I'd like to invite onstage Evan Grant, who is one of last year's speakers, who's kindly agreed to help me to demonstrate what we've been able to develop.

אז עם זה, הייתי מעוניינת להזמין לבמה את אוון גראנט, אחד מהדוברים של שנה שעברה. אשר הסכים באדיבותו לעזור לי להדגים את מה שהצלחנו לפתח.

(Applause)

(מחיאות כפיים)

So the device that you see is a 14-channel, high-fidelity EEG acquisition system. It doesn't require any scalp preparation, no conductive gel or paste. It only takes a few minutes to put on and for the signals to settle. It's also wireless, so it gives you the freedom to move around. And compared to the tens of thousands of dollars for a traditional EEG system, this headset only costs a few hundred dollars. Now on to the detection algorithms. So facial expressions -- as I mentioned before in emotional experiences -- are actually designed to work out of the box with some sensitivity adjustments available for personalization. But with the limited time we have available, I'd like to show you the cognitive suite, which is the ability for you to basically move virtual objects with your mind.

אז המכשיר שאתם רואים הוא בעל 14 ערוצים, ויכולת גבוהה לקליטת EEG. הוא אינו דורש הכנה מוקדמת של הקרקפת, וגם לא ג'ל כמוליך או משחה. לוקח דקות בודדות להלביש אותו ולהתחיל לקלוט את הגלים. הוא גם אלחוטי, כך שהוא מאפשר לך לנוע בחופשיות. ובהשוואה לעשרות האלפים של דולרים למערכת EEG מסורתית, התקן הראש הזה עולה כמה מאות דולרים בלבד. עכשיו נעבור לאלגוריתמים של הזיהוי. אז הבעות פנים - כמו שהסברתי מקודם בהבעות רגשיות -- למעשה מתוכננות לעבוד באופן טבעי עם כמה שינויים ברגישות הקיימים לצורך התאמה אישית. אך בשל הזמן הקצר העומד לרשותנו, הייתי רוצה להציג בפניכם את החבילה הקוגניטיבית, אשר מאפשרת לך להזיז חפצים וירטואלים בעזרת המחשבה.

Now, Evan is new to this system, so what we have to do first is create a new profile for him. He's obviously not Joanne -- so we'll "add user." Evan. Okay. So the first thing we need to do with the cognitive suite is to start with training a neutral signal. With neutral, there's nothing in particular that Evan needs to do. He just hangs out. He's relaxed. And the idea is to establish a baseline or normal state for his brain, because every brain is different. It takes eight seconds to do this, and now that that's done, we can choose a movement-based action. So Evan, choose something that you can visualize clearly in your mind.

כעת, אוון חדש במערכת, אז מה שאנו צריכים לעשות תחילה הוא ליצור פרופיל חדש עבורו. הוא בוודאי לא ג'ואן -- אז אנחנו "נוסיף משתמש". אוון. בסדר. אז הדבר הראשון שאנחנו צריכים לעשות עם החבילה הקוגניטיבית הוא להתחיל עם אימון של אות ניטרלי. עם ניטרלי, אין משהו מיוחד שאוון צריך לעשות. הוא רק עומד. הוא רגוע. והרעיון הוא להגדיר בסיס או מצב נורמלי למוח שלו. מכיוון שכל מוח הוא שונה. זה לוקח 8 שניות לביצוע הפעולה. ועכשיו שזה נגמר, אנו יכולים לבחור פעולה מבוססת תנועה. אז אוון תבחר משהו אותו אתה יכול לדמיין בבהירות במוחך.

Evan Grant: Let's do "pull."

אוון גרנט: בואי נבצע "משיכה".

Tan Le: Okay, so let's choose "pull." So the idea here now is that Evan needs to imagine the object coming forward into the screen, and there's a progress bar that will scroll across the screen while he's doing that. The first time, nothing will happen, because the system has no idea how he thinks about "pull." But maintain that thought for the entire duration of the eight seconds. So: one, two, three, go. Okay. So once we accept this, the cube is live. So let's see if Evan can actually try and imagine pulling. Ah, good job! (Applause) That's really amazing.

טאן לה: בסדר. אז בוא נבחר "משיכה". אז הרעיון כאן הוא שאוון צריך לדמיין את האובייקט מתקדם לתוך המסך. ויש מד התקדמות לאורכו של המסך בזמן שהוא עושה את זה. בפעם הראשונה, שום דבר לא יקרה, מכיוון והמערכת לא יודעת איך הוא חושב על "משיכה". אבל תשמור על המחשבה הזו למשך כל ה-8 שניות. אז: אחת, שתיים, שלוש וזהו. בסדר. אז ברגע שאנו מאשרים את זה, הקוביה חיה. אז בואו נראה האם אוון למעשה יכול לנסות ולדמיין משיכה. אה, עבודה טובה. (מחיאות כפיים) זה למעשה מדהים.

(Applause)

(מחיאות כפיים)

So we have a little bit of time available, so I'm going to ask Evan to do a really difficult task. And this one is difficult because it's all about being able to visualize something that doesn't exist in our physical world. This is "disappear." So what you want to do -- at least with movement-based actions, we do that all the time, so you can visualize it. But with "disappear," there's really no analogies -- so Evan, what you want to do here is to imagine the cube slowly fading out, okay. Same sort of drill. So: one, two, three, go. Okay. Let's try that. Oh, my goodness. He's just too good. Let's try that again.

אז יש לנו מעט זמן פנוי, לכן אבקש מאוון לבצע משימה קשה במיוחד. וזו קשה מכיוון שהיא כרוכה ביכולת לדמיין משהו שלא קיים בעולם הפיזי. זה "היעלמות". אז מה שאתה רוצה -- לפחות עם פעולות מבוססות תנועה, אנו עושים את זה כל הזמן, כך שאתה יכול לדמיין את זה. אבל עם "היעלמות", אין ממש אנלוגיות. אז אוון, מה שאתה רוצה לעשות כאן הוא לדמיין את הקוביה נעלמת בהדרגה, בסדר. אותו תהליך כמו מקודם. אז: אחת, שתיים, שלושה וזהו. בסדר. בוא ננסה את זה. הו, איזה יופי. הוא פשוט טוב מידי. בוא ננסה זאת שוב.

EG: Losing concentration.

אוון גרנט: מאבד ריכוז.

(Laughter)

(צחוק)

TL: But we can see that it actually works, even though you can only hold it for a little bit of time. As I said, it's a very difficult process to imagine this. And the great thing about it is that we've only given the software one instance of how he thinks about "disappear." As there is a machine learning algorithm in this --

טאן לה: אבל אנחנו יכולים לראות שזה ממש עובד. אפילו שאתה בקושי מחזיק את זה לזמן קצר מאוד. כמו שאמרתי, זהו תהליך קשה במיוחד לדמיין את זה. והדבר הגדול בנוגע לזה הוא נתנו לתוכנה רק מופע אחת של איך שהוא חושב על "היעלמות". כך שיש אלגוריתם מכונה ללימוד בתוך זה --

(Applause)

(מחיאות כפיים)

Thank you. Good job. Good job.

תודה לך. עבודה טובה. עבודה טובה.

(Applause)

(מחיאות כפיים)

Thank you, Evan, you're a wonderful, wonderful example of the technology.

תודה לך, אוון, אתה דוגמא נפלאה, נפלאה של הטכנולוגיה.

So, as you can see, before, there is a leveling system built into this software so that as Evan, or any user, becomes more familiar with the system, they can continue to add more and more detections, so that the system begins to differentiate between different distinct thoughts. And once you've trained up the detections, these thoughts can be assigned or mapped to any computing platform, application or device.

אז כמו שיכולתם לראות מקודם, יש מערכת איזון הבנויה בתוך התוכנה כך שבעת שאוון, או כל משתמש, מכירים את המערכת טוב יותר, הם יכולים להמשיך ולהוסיף עוד ועוד זיהוי, כך שהמערכת מתחילה להבחין בין מחשבות ייחודיות שונות וברגע שאתה מאמן את ההבחנות, המחשבות האלו יכולות להיות מוגדרות או ממופות לכל פלטפורמת מחשב, תוכנה או מכשיר.

So I'd like to show you a few examples, because there are many possible applications for this new interface. In games and virtual worlds, for example, your facial expressions can naturally and intuitively be used to control an avatar or virtual character. Obviously, you can experience the fantasy of magic and control the world with your mind. And also, colors, lighting, sound and effects can dynamically respond to your emotional state to heighten the experience that you're having, in real time. And moving on to some applications developed by developers and researchers around the world, with robots and simple machines, for example -- in this case, flying a toy helicopter simply by thinking "lift" with your mind.

אז הייתי רוצה להציג בפניכם מספר דוגמאות, מכיוון וישנם יישומים רבים אפשריים לממשק החדש הזה. במשחקים ועולמות מדומים, לדוגמא, הבעות הפנים שלכם יכולות באופן טבעי ואינטואיטיבי לשמש לשליטה בדמות או ביצור וירטואלי. אתם יכולים לחוות את הנפלאות של הקסם ולשלוט בעולם עם המוח שלכם. וגם, צבעים, אורות, צלילים ואפקטים, יכולים באופן דינאמי להגיב למצב הריגשי שלך להעצים את החוויה שלך, בזמן אמת. ונעבור למספר יישומים שפותחו ע"י מפתחים וחוקרים מרחבי העולם, בעזרת רובוטים ומכונות פשוטות, לדוגמא -- במקרה הזה, הטסת מסוק צעצוע פשוט באמצעות המחשבה של להרים אותו.

The technology can also be applied to real world applications -- in this example, a smart home. You know, from the user interface of the control system to opening curtains or closing curtains. And of course, also to the lighting -- turning them on or off. And finally, to real life-changing applications, such as being able to control an electric wheelchair. In this example, facial expressions are mapped to the movement commands.

הטכנולוגיה יכולה להיות מיושמת גם ליישומים בעולם האמיתי -- במקרה הזה, בית חכם. אתם יודעים, מממשק המשתמש של מערכת השליטה לפתיחת וילונות או סגירתם. ובוודאי שגם לאורות -- להדליק או לכבות אותם. ולבסוף, ליישומים אמיתיים משני-חיים כמו היכולת לשלוט בכיסא גלגלים חשמלי. במקרה הזה, הבעות הפנים ממופות לפקודות התנועה.

Man: Now blink right to go right. Now blink left to turn back left. Now smile to go straight.

אדם: "עכשיו מצמץ בעין ימין לזוז ימינה". "עכשיו מצמץ בעין שמאל לזוז שמאלה". "עכשיו חייך לזוז קדימה".

TL: We really -- Thank you.

טי אל: אנו באמת -- מודים לך.

(Applause)

(מחיאות כפיים)

We are really only scratching the surface of what is possible today, and with the community's input, and also with the involvement of developers and researchers from around the world, we hope that you can help us to shape where the technology goes from here. Thank you so much.

אנו באמת רק מגרדים את פני השטח של האפשרי כיום. ועם משובים מהקהילה, ועם המעורבות של מפתחים וחוקרים מרחבי העולם, אנו מקווים שאתם יכולים לעזור לנו לעצב את כיוונה של הטכנולוגיה מכאן. תודה רבה לכם.