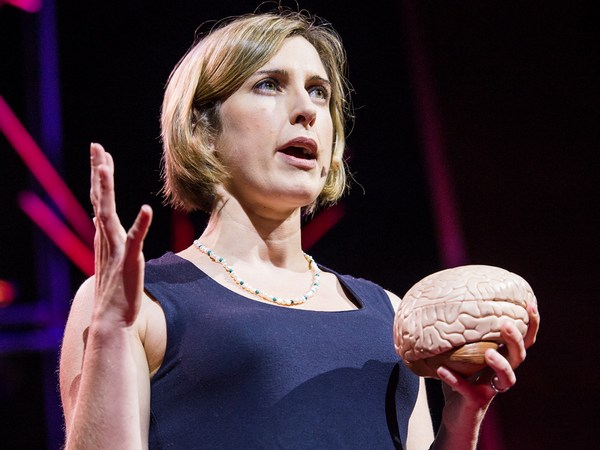

Up until now, our communication with machines has always been limited to conscious and direct forms. Whether it's something simple like turning on the lights with a switch, or even as complex as programming robotics, we have always had to give a command to a machine, or even a series of commands, in order for it to do something for us. Communication between people, on the other hand, is far more complex and a lot more interesting because we take into account so much more than what is explicitly expressed. We observe facial expressions, body language, and we can intuit feelings and emotions from our dialogue with one another. This actually forms a large part of our decision-making process. Our vision is to introduce this whole new realm of human interaction into human-computer interaction so that computers can understand not only what you direct it to do, but it can also respond to your facial expressions and emotional experiences. And what better way to do this than by interpreting the signals naturally produced by our brain, our center for control and experience.

Jusqu'à maintenant, notre communication avec les machines a toujours été limitée à des formes conscientes et directes. Que ce soit quelque chose de simple comme allumer les lumières avec un interrupteur, ou même aussi complexe que la programmation robotique, il nous a toujours fallu donner une commande à une machine, ou même une série de commandes, pour qu'elle fasse quelque chose pour nous. Par ailleurs,la communication entre les gens, est beaucoup plus complexe et beaucoup plus intéressante, parce que nous prenons en compte beaucoup plus que ce qui est exprimé explicitement. Nous observons les expressions faciales, le langage du corps, et nous pouvons deviner intuitivement des sentiments et des émotions en dialoguant avec l'autre. Cela constitue en fait une grande partie de notre processus décisionnel. Notre vision est d'introduire ce tout nouveau domaine d'interaction humaine dans l'interaction homme-machine, afin que l'ordinateur puisse comprendre non seulement ce que vous lui demandez de faire, mais il peut également réagir à vos expressions faciales et aux expériences émotionnelles. Et quelle meilleure façon de le faire que par l'interprétation des signaux que notre cerveau produit naturellement, notre centre de contrôle et d'expérience.

Well, it sounds like a pretty good idea, but this task, as Bruno mentioned, isn't an easy one for two main reasons: First, the detection algorithms. Our brain is made up of billions of active neurons, around 170,000 km of combined axon length. When these neurons interact, the chemical reaction emits an electrical impulse, which can be measured. The majority of our functional brain is distributed over the outer surface layer of the brain, and to increase the area that's available for mental capacity, the brain surface is highly folded. Now this cortical folding presents a significant challenge for interpreting surface electrical impulses. Each individual's cortex is folded differently, very much like a fingerprint. So even though a signal may come from the same functional part of the brain, by the time the structure has been folded, its physical location is very different between individuals, even identical twins. There is no longer any consistency in the surface signals.

Eh bien, cela semble une bonne idée, mais cette tâche, comme Bruno l'a mentionné, n'est pas facile pour deux raisons principales: Tout d'abord, les algorithmes de détection. Notre cerveau est composé de milliards de neurones actifs, environ 170 000 km de long en combinant les axones. Lorsque ces neurones interagissent, la réaction chimique émet une impulsion électrique qui peut être mesurée. La majorité de notre cerveau fonctionnel est répartie sur la couche superficielle externe du cerveau. Et pour augmenter la superficie disponible pour la capacité mentale, la surface du cerveau est très repliée. Et ce plissement cortical présente un défi de taille pour l'interprétation des impulsions électriques superficielles. Le cortex de chaque individu est replié différemment, un peu comme une empreinte digitale. Ainsi, même si un signal peut provenir de la même partie fonctionnelle du cerveau, au moment où la structure a été pliée, son emplacement physique est très différente d'un individu à l'autre, même chez de vrais jumeaux. Il n'y a plus de cohérence dans les signaux superficiels.

Our breakthrough was to create an algorithm that unfolds the cortex, so that we can map the signals closer to its source, and therefore making it capable of working across a mass population. The second challenge is the actual device for observing brainwaves. EEG measurements typically involve a hairnet with an array of sensors, like the one that you can see here in the photo. A technician will put the electrodes onto the scalp using a conductive gel or paste and usually after a procedure of preparing the scalp by light abrasion. Now this is quite time consuming and isn't the most comfortable process. And on top of that, these systems actually cost in the tens of thousands of dollars.

Notre découverte a consisté à créer un algorithme qui déplie le cortex, afin que nous puissions cartographier les signaux plus près de leur source, et donc de pouvoir travailler sur une population de masse. Le deuxième défi est le périphérique lui-même pour l'observation des ondes cérébrales. Des mesures EEG impliquent généralement une résille avec un réseau de capteurs, comme celui que vous pouvez voir ici sur la photo. Un technicien place les électrodes sur le cuir chevelu avec un gel conducteur ou de la pâte et le plus souvent après une procédure de préparation du cuir chevelu par abrasion légère. Et c'est assez chronophage, et n'est pas le procédé le plus confortable. Et pour couronner le tout, ces systèmes coûtent en fait des dizaines de milliers de dollars.

So with that, I'd like to invite onstage Evan Grant, who is one of last year's speakers, who's kindly agreed to help me to demonstrate what we've been able to develop.

Donc, avec cela, je tiens à inviter sur scène Evan Grant, qui est l'un des orateurs de l'an dernier, qui a gentiment accepté de m'aider à faire la démonstration de ce que nous avons été en mesure de développer.

(Applause)

(Applaudissements)

So the device that you see is a 14-channel, high-fidelity EEG acquisition system. It doesn't require any scalp preparation, no conductive gel or paste. It only takes a few minutes to put on and for the signals to settle. It's also wireless, so it gives you the freedom to move around. And compared to the tens of thousands of dollars for a traditional EEG system, this headset only costs a few hundred dollars. Now on to the detection algorithms. So facial expressions -- as I mentioned before in emotional experiences -- are actually designed to work out of the box with some sensitivity adjustments available for personalization. But with the limited time we have available, I'd like to show you the cognitive suite, which is the ability for you to basically move virtual objects with your mind.

Ainsi, le dispositif que vous voyez est un système d'acquisition encéphalographique à 14-canaux, haute-fidélité. Il ne nécessite aucune préparation du cuir chevelu, pas de gel ou de pâte conductrice. Cela ne prend que quelques minutes à mettre et pour que les signaux se réglent. Il est également sans fil, il vous donne la liberté de vous déplacer. Et par rapport aux dizaines de milliers de dollars pour un système traditionnel EEG, ce casque ne coûte que quelques centaines de dollars. Passons maintenant aux algorithmes de détection. Ainsi, les expressions du visage - comme je l'ai mentionné auparavant dans des expériences émotionnelles - sont en fait conçues pour fonctionner immédiatement avec quelques ajustements de sensibilité disponibles pour la personnalisation. Mais avec le temps limité dont nous disposons, je voudrais vous montrer la suite cognitive, qui est vous donne la possibilité de déplacer des objets virtuels essentiellement avec votre esprit.

Now, Evan is new to this system, so what we have to do first is create a new profile for him. He's obviously not Joanne -- so we'll "add user." Evan. Okay. So the first thing we need to do with the cognitive suite is to start with training a neutral signal. With neutral, there's nothing in particular that Evan needs to do. He just hangs out. He's relaxed. And the idea is to establish a baseline or normal state for his brain, because every brain is different. It takes eight seconds to do this, and now that that's done, we can choose a movement-based action. So Evan, choose something that you can visualize clearly in your mind.

Maintenant, Evan débute avec ce système, donc nous devons commencer par créer un nouveau profil pour lui. Il n'est évidemment pas Joanne - donc nous allons "Ajouter un utilisateur." Evan. Très bien. Donc la première chose que nous devons faire avec la suite cognitive est de commencer par la formation d'un signal neutre. Avec neutre, il n'y a rien de particulier qu'Evan ait à faire. Il se contente d'être là. Il est détendu. Et l'idée est d'établir une base de référence ou l'état normal de son cerveau, parce que chaque cerveau est différent. Cela prend huit secondes. Et maintenant que c'est fait, on peut choisir une action de mouvement. Donc, Evan choisissez quelque chose que vous pouvez visualiser clairement dans votre esprit.

Evan Grant: Let's do "pull."

Evan Grant: "Tirer".

Tan Le: Okay, so let's choose "pull." So the idea here now is that Evan needs to imagine the object coming forward into the screen, and there's a progress bar that will scroll across the screen while he's doing that. The first time, nothing will happen, because the system has no idea how he thinks about "pull." But maintain that thought for the entire duration of the eight seconds. So: one, two, three, go. Okay. So once we accept this, the cube is live. So let's see if Evan can actually try and imagine pulling. Ah, good job! (Applause) That's really amazing.

Tan Le: Très bien. Donc, nous choisissons "tirer". Donc, l'idée ici maintenant est que Evan doit imaginer l'objet qui vient vers lui dans l'écran. Et il y a une barre de progression qui défile à l'écran pendant qu'il le fait. La première fois, rien ne se passera, parce que le système n'a aucune idée de comment il pense à "tirer". Mais si on garde cette pensée sur toute la durée de huit secondes. Donc: un, deux, trois, partez. Okay. Donc, si nous acceptons cela, le cube est vivant. Donc, nous allons voir si Evan peut effectivement essayer d'imaginer qu'il le tire. Ah, bravo! (Applaudissements) C'est assez incroyable.

(Applause)

(Applaudissements)

So we have a little bit of time available, so I'm going to ask Evan to do a really difficult task. And this one is difficult because it's all about being able to visualize something that doesn't exist in our physical world. This is "disappear." So what you want to do -- at least with movement-based actions, we do that all the time, so you can visualize it. But with "disappear," there's really no analogies -- so Evan, what you want to do here is to imagine the cube slowly fading out, okay. Same sort of drill. So: one, two, three, go. Okay. Let's try that. Oh, my goodness. He's just too good. Let's try that again.

Nous avons donc un peu de temps, alors je vais demander à Evan d'accomplir une tâche vraiment difficile. Et elle est difficile car il s'agit d'être capable de visualiser quelque chose qui n'existe pas dans notre monde physique. Il s'agit de "disparaître". Donc ce que vous voulez - du moins avec des actions de mouvement, nous le faisons tout le temps, afin que vous puissiez le visualiser. Mais avec "disparaître", il n'y a vraiment pas d'analogie. Donc, Evan, ce que vous voulez faire ici c'est d'imaginer le cube qui s'efface lentement, d'accord. Même genre d'exercice. Donc: un, deux, trois, partez. Très bien. Essayons cela. Oh, mon Dieu. Il est vraiment trop bon. Essayons encore une fois.

EG: Losing concentration.

EG: Perte de concentration.

(Laughter)

(Rires)

TL: But we can see that it actually works, even though you can only hold it for a little bit of time. As I said, it's a very difficult process to imagine this. And the great thing about it is that we've only given the software one instance of how he thinks about "disappear." As there is a machine learning algorithm in this --

TL: Mais nous pouvons voir que cela fonctionne réellement, même si vous ne pouvez tenir pendant peu de temps. Comme je le disais, c'est un processus très difficile d'imaginer cela. Et ce qui est génial, c'est que nous avons seulement donné au logiciel un exemple de la façon dont il pense à "disparaître". Comme il y a un algorithme qui apprend mécaniquement dans ce --

(Applause)

(Applaudissements)

Thank you. Good job. Good job.

Merci. Bravo. Bravo.

(Applause)

(Applaudissements)

Thank you, Evan, you're a wonderful, wonderful example of the technology.

Merci, Evan, vous êtes un merveilleux, merveilleux exemple de technologie.

So, as you can see, before, there is a leveling system built into this software so that as Evan, or any user, becomes more familiar with the system, they can continue to add more and more detections, so that the system begins to differentiate between different distinct thoughts. And once you've trained up the detections, these thoughts can be assigned or mapped to any computing platform, application or device.

Donc comme vous avez pu le voir avant, il existe un système de mise à niveau intégré dans ce logiciel afin qu'Evan, ou tout autre utilisateur, se familiarise avec le système, il peut continuer à ajouter de plus en plus de détections, afin que le système commence à distinguer entre les différentes pensées distinctes. Et une fois que vous avez entraîné les détections, ces pensées peuvent être attribuées ou cartographiées pour toute plate-forme informatique, application ou un périphérique.

So I'd like to show you a few examples, because there are many possible applications for this new interface. In games and virtual worlds, for example, your facial expressions can naturally and intuitively be used to control an avatar or virtual character. Obviously, you can experience the fantasy of magic and control the world with your mind. And also, colors, lighting, sound and effects can dynamically respond to your emotional state to heighten the experience that you're having, in real time. And moving on to some applications developed by developers and researchers around the world, with robots and simple machines, for example -- in this case, flying a toy helicopter simply by thinking "lift" with your mind.

Donc, je voudrais vous montrer quelques exemples, parce qu'il y a beaucoup d'applications possibles pour cette nouvelle interface. Dans les jeux et les mondes virtuels, par exemple, vos expressions faciales peuvent naturellement et intuitivement être utilisées pour contrôler un avatar ou un personnage virtuel. Évidemment, vous pouvez découvrir le fantastique de la magie et contrôler le monde avec votre esprit. Et aussi, les couleurs, l'éclairage, le son et les effets, peuvent répondre dynamiquement à votre état émotionnel pour augmenter l'expérience que vous vivez, en temps réel. Et on passe à certaines applications mises au point par les développeurs et les chercheurs du monde entier, avec des robots et des machines simples, par exemple - Dans ce cas, le pilotage d'un hélicoptère jouet tout simplement en pensant "soulever" dans votre esprit.

The technology can also be applied to real world applications -- in this example, a smart home. You know, from the user interface of the control system to opening curtains or closing curtains. And of course, also to the lighting -- turning them on or off. And finally, to real life-changing applications, such as being able to control an electric wheelchair. In this example, facial expressions are mapped to the movement commands.

La technologie peut également être appliquée dans le monde réel - Dans cet exemple, une maison intelligente. Vous savez, de l'interface utilisateur du système de contrôle à l'ouverture des rideaux ou la fermeture des rideaux. Et bien sûr aussi pour l'éclairage - allumer ou éteindre. Et enfin, pour des applications qui changent vraiment la vie. comme être en mesure de contrôler un fauteuil roulant électrique. Dans cet exemple, les expressions faciales sont cartographiées par rapport à la commande de mouvement.

Man: Now blink right to go right. Now blink left to turn back left. Now smile to go straight.

Homme: Maintenant cligne à droite pour aller à droite. Maintenant cligne à gauche pour revenir en arrière gauche. Maintenant souris pour aller tout droit.

TL: We really -- Thank you.

TL: En fait, nous -- Je vous remercie.

(Applause)

(Applaudissements)

We are really only scratching the surface of what is possible today, and with the community's input, and also with the involvement of developers and researchers from around the world, we hope that you can help us to shape where the technology goes from here. Thank you so much.

En fait nous n'en sommes qu'à gratter la surface de ce qui est possible aujourd'hui. Et avec la participation de la communauté, et aussi avec la participation des développeurs et des chercheurs du monde entier, Nous espérons que vous pouvez nous aider à façonner les futures applications de cette technologie. Je vous remercie beaucoup.