Up until now, our communication with machines has always been limited to conscious and direct forms. Whether it's something simple like turning on the lights with a switch, or even as complex as programming robotics, we have always had to give a command to a machine, or even a series of commands, in order for it to do something for us. Communication between people, on the other hand, is far more complex and a lot more interesting because we take into account so much more than what is explicitly expressed. We observe facial expressions, body language, and we can intuit feelings and emotions from our dialogue with one another. This actually forms a large part of our decision-making process. Our vision is to introduce this whole new realm of human interaction into human-computer interaction so that computers can understand not only what you direct it to do, but it can also respond to your facial expressions and emotional experiences. And what better way to do this than by interpreting the signals naturally produced by our brain, our center for control and experience.

تاکنون ارتباط ما با ماشین ها همواره محدود به فرمی آگاهانه و مستقیم بوده. از کاری بسادگی روشن کردن یک لامپ با یک کلید، تا کاری به پیچیدگی برنامه نویسی روبات ها، ما همواره یک یا چند فرمان به ماشین می دیم تا برای ما کاری رو انجام بده. در سوی دیگه، ارتباط بین انسان ها پیچیدگی و جذابیت خیلی بیشتری داره چون ما بسیار بیشتر متوجه جزئیات هستیم. ما حالت های چهره و زبان رو زیر نظر می گیریم و می تونیم در گفتگو با دیگران درک آگاهانه ای از احساسات و هیجانات داشته باشیم. در واقع این بخش بزرگی از فرآیند تصمیم گیری ما رو شکل می ده. چشم انداز ما وارد کردن این حوزه نو برگرفته از تعامل انسان، در تعامل انسان با ماشینه تا کامپوترها فقط قادر به فهم آنچه مستقیما ً به آنها می گوییم نباشند بلکه بتونن به حالت های چهره و تجربه های احساسی شما هم واکنش نشون بدن. برای انجام این کار چه راهی بهتر از تفسیر سیگنال هایی که بطور طبیعی در مغز ما، مرکز کنترل و تجربه ما، تولید میشه.

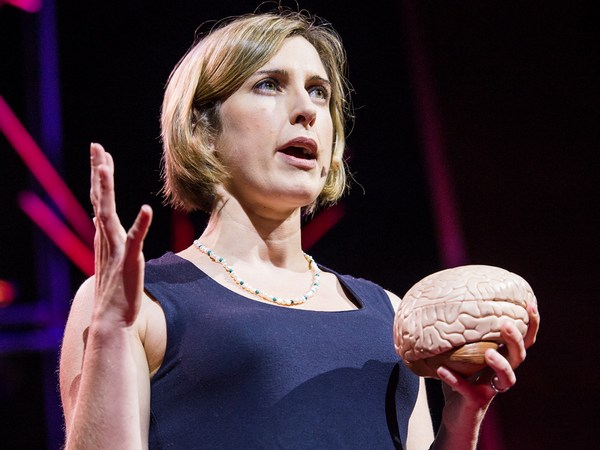

Well, it sounds like a pretty good idea, but this task, as Bruno mentioned, isn't an easy one for two main reasons: First, the detection algorithms. Our brain is made up of billions of active neurons, around 170,000 km of combined axon length. When these neurons interact, the chemical reaction emits an electrical impulse, which can be measured. The majority of our functional brain is distributed over the outer surface layer of the brain, and to increase the area that's available for mental capacity, the brain surface is highly folded. Now this cortical folding presents a significant challenge for interpreting surface electrical impulses. Each individual's cortex is folded differently, very much like a fingerprint. So even though a signal may come from the same functional part of the brain, by the time the structure has been folded, its physical location is very different between individuals, even identical twins. There is no longer any consistency in the surface signals.

خب، به نظر ایده خوبی میاد، اما همونطور که " برونو" هم گفت این کار به دو دلیل عمده چندان ساده نیست: اول، کشف الگوریتم ها. مغز ما از میلیاردها یاخته عصبی فعال با حدود 170,000 کیلومتر اکسون در هم تنیده ساخته شده. زمانی که این یاخته ها بر هم کنش دارن، واکنش شیمیایی یک تکانه الکتریکی منتشر می کنه که قابل اندازه گیری هست. بیشتر نواحی عملکردی مغز ما در قشر خارجی مغز توزیع شده و بخاطر افزایش ِ سطح قابل استفاده، در خدمت ِ توانمندی ذهن، سطح مغز بسیار پر چین شده. حالا این چین خوردگی غشائی یک چالش مهم برای تفسیر تکانه های الکتریکی سطحی بوجود آورده. قشر هر فرد خاص بصورت ِ متفاوتی چین خورده، بسیار شبیه به اثر انگشت. بنابراین هرچند یک سیگنال ممکنه که از یک بخش در حال کار مغز آمده باشه، چون این ساختار در طول زمان چین خورده، موقعیت فیزیکی آن در هر فردی بسیار متفاوت هست، حتی در دوقلوهای همسان. هیچ نوع همسانی در سیگنال های سطحی وجود نداره.

Our breakthrough was to create an algorithm that unfolds the cortex, so that we can map the signals closer to its source, and therefore making it capable of working across a mass population. The second challenge is the actual device for observing brainwaves. EEG measurements typically involve a hairnet with an array of sensors, like the one that you can see here in the photo. A technician will put the electrodes onto the scalp using a conductive gel or paste and usually after a procedure of preparing the scalp by light abrasion. Now this is quite time consuming and isn't the most comfortable process. And on top of that, these systems actually cost in the tens of thousands of dollars.

عزم ما برای ایجاد الگوریتمی بود که چین خوردگی قشر مغز رو باز کنه تا بتونیم سیگنال ها رو هرچه شبیه تر به منشاءِ اون ها ترسیم کنیم، و در نتیجه موفق به کار بر روی عموم افراد بشیم. چالش دوم دستگاهی برای مشاهده امواج مغزی است. اندازه گیری " ای.ای.جی" بطور نمونه، شبکه ای روی سر رو با آرایش منظمی از سنسورها بکار می گیره، شبیه اون که توی عکس می تونید ببینید. یک تکنسین ، الکترودها رو با استفاده از ژل یا خمیر رسانا و معمولا ً بعد از یک روش آماده سازی سر با مالش ملایم، بر روی سر قرار می ده. تا حالا کلی زمان صرف شده و چندان هم کار ساده ای نبوده و علاوه بر اون، این سیستم ها ده ها هزار دلار قیمت دارن.

So with that, I'd like to invite onstage Evan Grant, who is one of last year's speakers, who's kindly agreed to help me to demonstrate what we've been able to develop.

خب حالا می خوام " اوان گرَنت " رو به صحنه دعوت کنم، او از سخنرانان سال های گذشته و کسی است که با مهربانی پذیرفت به من کمک کنه تا آنچه رو که می تونیم توسعه بدیم رونشون بدیم.

(Applause)

(تشویق حاضرین)

So the device that you see is a 14-channel, high-fidelity EEG acquisition system. It doesn't require any scalp preparation, no conductive gel or paste. It only takes a few minutes to put on and for the signals to settle. It's also wireless, so it gives you the freedom to move around. And compared to the tens of thousands of dollars for a traditional EEG system, this headset only costs a few hundred dollars. Now on to the detection algorithms. So facial expressions -- as I mentioned before in emotional experiences -- are actually designed to work out of the box with some sensitivity adjustments available for personalization. But with the limited time we have available, I'd like to show you the cognitive suite, which is the ability for you to basically move virtual objects with your mind.

خب این دستگاهی که شما می بینید یک سیستم دریافت بسیار دقیق ِ چهارده کاناله " ای.ای.جی " هست. نیازی به آماده سازی ِ سر نداره، ژل یا خمیر رسانا نیاز نیست. فقط چند دقیقه برای بکار انداختن و برقراری ِ سیگنال ها لازمه. همچنین بیسیم هست، بنابراین آزادی عمل به شما می ده و در مقایسه با ده ها هزار دلار برای سیستم های " ای.ای.جی" مرسوم، این هدست فقط چند صد دلار قیمت داره. حالا در مورد الگوریتم های ردیابی. حالت های چهره، همونطور که در تجربه های احساسی گفتم، دستگاه طوری طراحی شده که در بیرون، با ابزارهای تنظیم حساس که امکان تنظیم برای هر فرد رو داره، عمل کنه. هرچند زمان محدودی داریم، می خوام به شما مجموعه حساسی رو نشون بدم که این امکان رو به شما می ده که کلا ً اشیاءِ مجازی زو با ذهنتون حرکت بدید.

Now, Evan is new to this system, so what we have to do first is create a new profile for him. He's obviously not Joanne -- so we'll "add user." Evan. Okay. So the first thing we need to do with the cognitive suite is to start with training a neutral signal. With neutral, there's nothing in particular that Evan needs to do. He just hangs out. He's relaxed. And the idea is to establish a baseline or normal state for his brain, because every brain is different. It takes eight seconds to do this, and now that that's done, we can choose a movement-based action. So Evan, choose something that you can visualize clearly in your mind.

حالا، " اوان " برای این سیستم، جدید هست پس کاری که اول انجام می دیم درست کردن یک شناسه جدید برای اونه. اون قطعا ً "جوانا" نیست-- خب "اضافه کردن کاربر" "اوان" و کلید تأیید. خب اولین کاری که لازمه با مجموعه دریافت کننده انجام بدیم شروع آموزش ِ یک سیگنال خنثی است. برای حالت خنثی لازم نیست "اوان" کار خاصی انجام بده. کافیه راحت و منفعل باشه مقصود اینه که سیگنال پایه و یا حالت ِعادی مغز اون بر قرار بشه چون این برای هر مغز متفاوت هست. انجام این کار هشت ثانیه زمان می بره، و حالا انجام شد. ما می تونیم یک عمل ِحرکتی رو انتخاب کنیم. خب "اوان" یک چیزی رو که می تونی بطور شفاف در ذهنت مجسم کنی انتخاب کن.

Evan Grant: Let's do "pull."

اوان گرنت : " کشیدن "

Tan Le: Okay, so let's choose "pull." So the idea here now is that Evan needs to imagine the object coming forward into the screen, and there's a progress bar that will scroll across the screen while he's doing that. The first time, nothing will happen, because the system has no idea how he thinks about "pull." But maintain that thought for the entire duration of the eight seconds. So: one, two, three, go. Okay. So once we accept this, the cube is live. So let's see if Evan can actually try and imagine pulling. Ah, good job! (Applause) That's really amazing.

خب پس "کشیدن" رو انتخاب می کنیم. منظور ما در اینجا اینه که "اوان" باید جلو آمدن ِ اون شئ در تصویر رو تصور کنه. این نشانگر ستونی در صفحه در زمان انجام بالا و پایین می ره. در ابتدا هیچ اتفاقی نمی افتاد چون سیستم هیچ انگاره ای برای اینکه او چطور به "کشیدن" فکر می کنه، نداشت ولی در خلال اون هشت ثانیه این فکر رو ثبت کرد. خب. یک، دو، سه، شروع... خوبه... وقتی این رو تأیید می کنیم مکعب بطور زنده نمایش داده می شه. خب بذارید ببینیم "اوان" می تونه سعی کنه و "کشیدن" رو تصور کنه. اوه، کارت عالی بود! (تشویق حاضرین) خیلی جالبه...

(Applause)

(تشویق حاضرین)

So we have a little bit of time available, so I'm going to ask Evan to do a really difficult task. And this one is difficult because it's all about being able to visualize something that doesn't exist in our physical world. This is "disappear." So what you want to do -- at least with movement-based actions, we do that all the time, so you can visualize it. But with "disappear," there's really no analogies -- so Evan, what you want to do here is to imagine the cube slowly fading out, okay. Same sort of drill. So: one, two, three, go. Okay. Let's try that. Oh, my goodness. He's just too good. Let's try that again.

خب ما خیلی کم وقت داریم و من از "اوان" یک کار واقعا ً مشکل رو می خوام که انجام بده. این کار مشکله چون در رابطه با توانایی ِ تصور کردن چیزی هست که در دنیای فیزیکی ِ ما وجود نداره. این کار "ناپدید کردن" هست. خب چی می خواید... یک عمل ِحرکتی ما اون کار رو چون همیشه انجام می دیم می تونیم تصورش کنیم ولی با "ناپدید کردن" واقعا ً قابل مقایسه نیست. خب "اوان" کاری که باید بکنی اینه که تصور کنی مکعب به آرامی در حال ناپدید شدن هست. خب همون کارهای مشابه و یک، دو، سه، شروع... خب بذارید ببینیم... اوه، عالیه... کارش عالیه... بذارید دوباره سعی کنه.

EG: Losing concentration.

(اوان:) تمرکزم بهم می خوره

(Laughter)

(خنده حاضرین)

TL: But we can see that it actually works, even though you can only hold it for a little bit of time. As I said, it's a very difficult process to imagine this. And the great thing about it is that we've only given the software one instance of how he thinks about "disappear." As there is a machine learning algorithm in this --

ولی ما می تونیم ببینیم که واقعا ً کار می کنه هرچند مدت کمی اون رو نگه داری. همونطور که گفتم تصور کردن این، یک فرآیند بسیار سخته. نکته اصلی در اینجا اینه که ما یک بار چگونگی فکر کردن دربارۀ "ناپدید شدن" رو به نرم افزار دادیم چون در اینجا یک ماشین یادگیرندۀ الگوریتم...

(Applause)

(تشویق حضار)

Thank you. Good job. Good job.

ممنون. عالیه، کارت عالی بود.

(Applause)

(تشویق حضار)

Thank you, Evan, you're a wonderful, wonderful example of the technology.

ممنون " اوان" . تو موفق شدی. مثال موفقی از این تکنولوژی.

So, as you can see, before, there is a leveling system built into this software so that as Evan, or any user, becomes more familiar with the system, they can continue to add more and more detections, so that the system begins to differentiate between different distinct thoughts. And once you've trained up the detections, these thoughts can be assigned or mapped to any computing platform, application or device.

بنابراین چنانچه دیدید یک سیستم سنجش در این نرم افزار وجود داره که چنانچه " اوان" یا هر کاربر دیگه ای برای آشناتر شدن با این سیستم، می تونن افزودن دریافت عملکردها رو ادامه بدن و سیستم شروع به تفکیک بین افکاری که بطور واضح متفاوت هستن، می کنه. زمانی که شما این ردیابی سیگنال ها رو آموزش دادید، این افکار می تونن به هر مجموعۀ محاسباتی، نرم افزار یا دستگاه، نمایه سازی و یا اختصاص داده شوند.

So I'd like to show you a few examples, because there are many possible applications for this new interface. In games and virtual worlds, for example, your facial expressions can naturally and intuitively be used to control an avatar or virtual character. Obviously, you can experience the fantasy of magic and control the world with your mind. And also, colors, lighting, sound and effects can dynamically respond to your emotional state to heighten the experience that you're having, in real time. And moving on to some applications developed by developers and researchers around the world, with robots and simple machines, for example -- in this case, flying a toy helicopter simply by thinking "lift" with your mind.

خب می خوام به شما چند مثال رو نشون بدم، چون برنامه های عملی بسیاری برای این رابط وجود داره. برای مثال در دنیای مجازی و بازی ها، حالت های چهرۀ شما بصورت ِ طبیعی و مستقیم می تونه شخصیت مجازی یا چهرۀ مجازی شما رو کنترل کنه. مسلما ً شما می تونید فضای خیالی جادو رو تجربه کنید و جهان رو با ذهنتون کنترل کنید. همینطور رنگ ها، نورها، صداها و عوامل طبیعی می تونن بصورت پویا به حالت احساسی شما پاسخ بدن تا تجربه شما در لحظۀ حال رو ارتقاء ببخشن. در ادامۀ کار، تجهیزات ِ توسعه یافته توسط توسعه دهندگان و محققان سراسر دنیا با روبات ها و ماشین های ساده، به عنوان مثال برای این حوزه، پرواز اسباب بازی ِ هلیکوپتر با فکر کردن به "بالا رفتن" در ذهنتون.

The technology can also be applied to real world applications -- in this example, a smart home. You know, from the user interface of the control system to opening curtains or closing curtains. And of course, also to the lighting -- turning them on or off. And finally, to real life-changing applications, such as being able to control an electric wheelchair. In this example, facial expressions are mapped to the movement commands.

این تکنولوژی همچنین در وسایل ِ جهان واقعی می تونه کاربردی باشه، برای مثال ِ این حوزه، یک خانه هوشمند. از رابط ِ کاربر سیستم کنترل به باز کردن یا بستن پرده ها، همینطور روشن یا خاموش کردن نورها در نهایت، تجهیزات واقعی تغییردهندۀ زندگی همچون توانایی کنترل یک ویلچیر الکتریکی که در این نمونه حالت های چهره برای دستورات ِ حرکتی طرح ریزی میشن.

Man: Now blink right to go right. Now blink left to turn back left. Now smile to go straight.

(شخص :) حالا یک چشمک راست برای رفتن به راست. حالا یک چشمک چپ برای رفتن به چپ. حالا لبخند برای مستقیم رفتن.

TL: We really -- Thank you.

TL: ما واقعا ً-- متشکرم.

(Applause)

(تشویق حضار)

We are really only scratching the surface of what is possible today, and with the community's input, and also with the involvement of developers and researchers from around the world, we hope that you can help us to shape where the technology goes from here. Thank you so much.

ما در واقع فقط روی این مسأله رو باز کردیم که چه کازهایی امروز ممکنه. با ورود انجمن ها، همچنین مشارکت توسعه دهندگان و محققان سراسر دنیا، ما امیدواریم که در جهت پیشبرد این تکنولوژی از این نقطه به جایی که خواهد رفت، ما رو یاری کنید. از شما بسیار متشکرم.