Up until now, our communication with machines has always been limited to conscious and direct forms. Whether it's something simple like turning on the lights with a switch, or even as complex as programming robotics, we have always had to give a command to a machine, or even a series of commands, in order for it to do something for us. Communication between people, on the other hand, is far more complex and a lot more interesting because we take into account so much more than what is explicitly expressed. We observe facial expressions, body language, and we can intuit feelings and emotions from our dialogue with one another. This actually forms a large part of our decision-making process. Our vision is to introduce this whole new realm of human interaction into human-computer interaction so that computers can understand not only what you direct it to do, but it can also respond to your facial expressions and emotional experiences. And what better way to do this than by interpreting the signals naturally produced by our brain, our center for control and experience.

Hasta ahora, la comunicación con las máquinas ha estado limitada a formas conscientes y directas. Ya sea algo simple como un interruptor de luz o complejos como la programación robótica. Siempre hemos tenido que ingresar comandos mediante uno o varios pasos para que una computadora ejecutara alguna tarea. Por otro lado, la comunicación humana es mucho más compleja y más interesante porque tiene en cuenta mucho más de lo expresado explícitamente. Mediante las expresiones y el lenguaje del cuerpo podemos intuir emociones que son parte de nuestro diálogo. Esto juega un importante rol en nuestra manera de tomar decisiones. Hoy nuestro objetivo es introducir este nuevo campo de interacción humana en la interacción entre el hombre y las computadoras para que éstas puedan comprender no sólo los comandos que les ordenamos sino que también puedan responder a nuestras expresiones faciales y nuestras emociones. Y ¿qué mejor manera de lograr esto que mediante la interpretación de señales emitidas naturalmente por el cerebro? Que es nuestro centro de control.

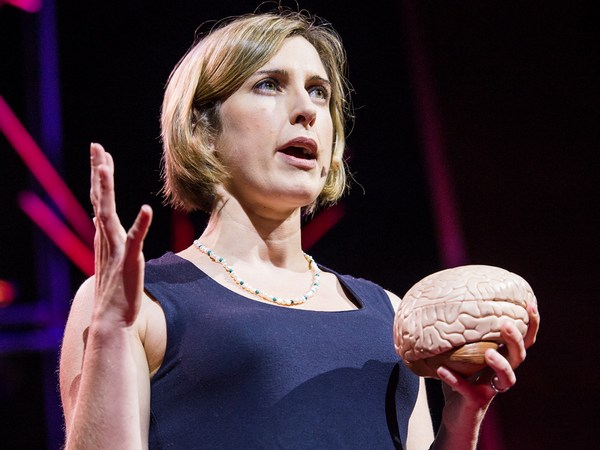

Well, it sounds like a pretty good idea, but this task, as Bruno mentioned, isn't an easy one for two main reasons: First, the detection algorithms. Our brain is made up of billions of active neurons, around 170,000 km of combined axon length. When these neurons interact, the chemical reaction emits an electrical impulse, which can be measured. The majority of our functional brain is distributed over the outer surface layer of the brain, and to increase the area that's available for mental capacity, the brain surface is highly folded. Now this cortical folding presents a significant challenge for interpreting surface electrical impulses. Each individual's cortex is folded differently, very much like a fingerprint. So even though a signal may come from the same functional part of the brain, by the time the structure has been folded, its physical location is very different between individuals, even identical twins. There is no longer any consistency in the surface signals.

Bien, parece una buena idea pero, como bien dijo Bruno, no es tarea fácil, por dos razones principales: primero, los algoritmos de detección. El cerebro esta conformado por miles de millones de neuronas activas cuyos axones, combinados, alcanzan una longitud de 170.000 km. Cuando las neuronas interactúan la reacción química emite un impulso eléctrico el cual puede medirse. La mayor parte de nuestro cerebro funcional se encuentra distribuido en la capa externa del cerebro. Y para lograr mayor superficie con capacidad mental la superficie cerebral está densamente plegada. Bien, los pliegues de esta corteza presentan un desafío no menor para interpretar impulsos eléctricos superficiales. La corteza de cada individuo está plegada de manera diferente, a la manera de huellas digitales. Por eso, si bien una señal puede provenir de la misma parte funcional del cerebro, la particular estructura de los pliegues hace que la posición física de esta señal varíe de individuo a individuo incluso entre hermanos gemelos. Ya no existe coherencia en la señales superficiales.

Our breakthrough was to create an algorithm that unfolds the cortex, so that we can map the signals closer to its source, and therefore making it capable of working across a mass population. The second challenge is the actual device for observing brainwaves. EEG measurements typically involve a hairnet with an array of sensors, like the one that you can see here in the photo. A technician will put the electrodes onto the scalp using a conductive gel or paste and usually after a procedure of preparing the scalp by light abrasion. Now this is quite time consuming and isn't the most comfortable process. And on top of that, these systems actually cost in the tens of thousands of dollars.

Nuestro descubrimiento fue la creación de un algoritmo que despliega la corteza de tal manera que las señales pueden localizarse cerca de su origen para poder aplicarse a la población en general. El segundo desafío reside en el dispositivo para observar ondas cerebrales. La electroencefalografía requiere de una red de sensores alrededor de la cabeza como la que se ve en esta foto. Un técnico coloca los electrodos sobre el cuero cabelludo mediante un gel conductor o pasta habiendo antes preparado el cuero cabelludo con abrasivos suaves. Pero esto lleva bastante tiempo y no es un método muy agradable. Y, además, estos sistemas cuestan decenas de miles de dólares.

So with that, I'd like to invite onstage Evan Grant, who is one of last year's speakers, who's kindly agreed to help me to demonstrate what we've been able to develop.

Por eso, quiero invitar a la tarima a Evan Grant, quien fuera conferencista el año pasado, y que muy amablemente ha aceptado ayudarme a demostrar ésto que desarrollamos.

(Applause)

(Aplauso)

So the device that you see is a 14-channel, high-fidelity EEG acquisition system. It doesn't require any scalp preparation, no conductive gel or paste. It only takes a few minutes to put on and for the signals to settle. It's also wireless, so it gives you the freedom to move around. And compared to the tens of thousands of dollars for a traditional EEG system, this headset only costs a few hundred dollars. Now on to the detection algorithms. So facial expressions -- as I mentioned before in emotional experiences -- are actually designed to work out of the box with some sensitivity adjustments available for personalization. But with the limited time we have available, I'd like to show you the cognitive suite, which is the ability for you to basically move virtual objects with your mind.

Este disposivo es un aparato de electroencefalografía de 14 canales y alta fidelidad. No requiere de preparación del cuero cabelludo ni geles ni pastas. Se coloca en unos pocos minutos y se espera a que aparezcan las señales. También es inalámbrico por lo que permite que nos movamos. Y en comparación con las decenas de miles de dólares de los sistemas de electroencefalografía tradicionales este casco sólo cuesta unos pocos cientos de dólares. Ahora, los algoritmos de detección. Las expresiones faciales, como lo mencioné antes mediante emociones, están diseñadas para funcionar fuera de la caja con algunos ajustes sensoriales disponibles para personalización. Pero como no tenemos mucho tiempo les quiero mostrar el conjunto cognitivo que es, básicamente, la capacidad de mover objetos virtuales con la mente.

Now, Evan is new to this system, so what we have to do first is create a new profile for him. He's obviously not Joanne -- so we'll "add user." Evan. Okay. So the first thing we need to do with the cognitive suite is to start with training a neutral signal. With neutral, there's nothing in particular that Evan needs to do. He just hangs out. He's relaxed. And the idea is to establish a baseline or normal state for his brain, because every brain is different. It takes eight seconds to do this, and now that that's done, we can choose a movement-based action. So Evan, choose something that you can visualize clearly in your mind.

Bien, esta es la primera vez para Evan, así que lo primero que tenemos que hacer es crear un nuevo perfil para él. Obviamente no es Joanne, por lo que selecciono "agregar usuario". Evan. Bien. Así que lo primero que tenemos que hacer con el conjunto cognitivo es ejercitar una señal neutral. De esta manera, no hay nada en particular que Evan tenga que hacer. Sólo relajarse. Y la idea es establecer un punto de partida o estado normal de su cerebro, porque cada cerebro es diferente. Esto lleva ocho segundos. Ya está listo, podemos seleccionar una acción, un movimiento. Evan, debes elegir algo que puedas visualizar claramente en tu mente.

Evan Grant: Let's do "pull."

Evan Grant: de acuerdo, "atraer".

Tan Le: Okay, so let's choose "pull." So the idea here now is that Evan needs to imagine the object coming forward into the screen, and there's a progress bar that will scroll across the screen while he's doing that. The first time, nothing will happen, because the system has no idea how he thinks about "pull." But maintain that thought for the entire duration of the eight seconds. So: one, two, three, go. Okay. So once we accept this, the cube is live. So let's see if Evan can actually try and imagine pulling. Ah, good job! (Applause) That's really amazing.

Tan Le: Bien. Elijo entonces "atraer". Así que la idea aquí es que Evan debe imaginar que el objeto se mueve hacia nosotros dentro de la pantalla. Una barra en la pantalla indica el progreso mientras él se concentra. La primera vez, nada va a suceder, porque el sistema no tiene idea de como él imagina "atraer". Pero intenta mantener esa idea durante los ocho segundos. Uno, dos, tres, cuatro, vamos. Bien. Al seleccionar "aceptar" el cubo se mueve. Veamos si Evan puede imaginar "atraer". Ah, ¡muy bien! (Aplauso) ¡Sorprendente!

(Applause)

(Aplauso)

So we have a little bit of time available, so I'm going to ask Evan to do a really difficult task. And this one is difficult because it's all about being able to visualize something that doesn't exist in our physical world. This is "disappear." So what you want to do -- at least with movement-based actions, we do that all the time, so you can visualize it. But with "disappear," there's really no analogies -- so Evan, what you want to do here is to imagine the cube slowly fading out, okay. Same sort of drill. So: one, two, three, go. Okay. Let's try that. Oh, my goodness. He's just too good. Let's try that again.

Aún tenemos un poquito de tiempo así que le voy a pedir a Evan que realice una tarea realmente complicada. Y digo complicada porque se trata de visualizar algo que no existe en el mundo físico. Esto es "desaparecer". Las acciones de movimiento son muy comunes, y es fácil visualizarlas. Pero para "desaparecer" no existen analogías. Así que, Evan, lo que tienes que hacer es imaginar el cubo esfumándose lentamente. Tal cual como antes. Uno, dos, tres, vamos. Bien, intentemos eso. ¡Oh, cielos! ¡Qué bien lo hace! Intentemos otra vez.

EG: Losing concentration.

EG: Estoy perdiendo la concentración.

(Laughter)

(Risas)

TL: But we can see that it actually works, even though you can only hold it for a little bit of time. As I said, it's a very difficult process to imagine this. And the great thing about it is that we've only given the software one instance of how he thinks about "disappear." As there is a machine learning algorithm in this --

TL: Pero vemos que funciona aunque sólo puedas mantenerlo por un tiempo corto. Como decía, imaginar ésto es un proceso complicado. Y lo grandioso de esto es que sólo le indicamos al sistema una única vez cómo Evan piensa en "desaparecer". Ya que la máquina tiene un algoritmo de aprendizaje...---

(Applause)

(Aplauso)

Thank you. Good job. Good job.

Muchas gracias. Muy bien, buen trabajo.

(Applause)

(Aplauso)

Thank you, Evan, you're a wonderful, wonderful example of the technology.

Muchas gracias, Evan, eres un maravilloso ejemplo de la tecnología.

So, as you can see, before, there is a leveling system built into this software so that as Evan, or any user, becomes more familiar with the system, they can continue to add more and more detections, so that the system begins to differentiate between different distinct thoughts. And once you've trained up the detections, these thoughts can be assigned or mapped to any computing platform, application or device.

Así que como pueden ver hay un progreso por niveles incorporado a este software por lo que mientras Evan, u otro usuario, se familiariza con el sistema, puede agregar más y más detecciones que permiten al sistema diferenciar entre distintos pensamientos. Y una vez que se han entrenado las detecciones estos pensamientos pueden ser asignados o a cualquier sistema operativo, aplicación o dispositivo.

So I'd like to show you a few examples, because there are many possible applications for this new interface. In games and virtual worlds, for example, your facial expressions can naturally and intuitively be used to control an avatar or virtual character. Obviously, you can experience the fantasy of magic and control the world with your mind. And also, colors, lighting, sound and effects can dynamically respond to your emotional state to heighten the experience that you're having, in real time. And moving on to some applications developed by developers and researchers around the world, with robots and simple machines, for example -- in this case, flying a toy helicopter simply by thinking "lift" with your mind.

Así que quisiera mostarles algunos ejemplos de las muchas aplicaciones para esta nueva interfaz. En juegos y el mundo virtual, por ejemplo, nuestras expresiones faciales pueden ser utilizadas intuitivamente para controlar un avatar o personaje virtual. Podemos experimentar la fantasía de la magia y controlar el mundo con nuestra mente. Y también los colores, las luces, los sonidos y efectos pueden responder a nuestras emociones de manera dinámica para resaltar nuestras experiencias en tiempo real. Quiero mostrarles algunas aplicaciones desarrolladas por ingenieros en todo el mundo, con robots y máquinas simples como que un helicóptero de juguete pueda volar con sólo pensar en "elevación".

The technology can also be applied to real world applications -- in this example, a smart home. You know, from the user interface of the control system to opening curtains or closing curtains. And of course, also to the lighting -- turning them on or off. And finally, to real life-changing applications, such as being able to control an electric wheelchair. In this example, facial expressions are mapped to the movement commands.

Pero esta tecnología también puede aplicarse a escenarios de la vida real. En este ejemplo, una casa inteligente. Desde de para correr cortinas y luego cerrarlas. Y, por supuesto, para la iluminación: encender las luces o apagarlas. Y finalmente, aplicaciones para calidad de vida como controlar una silla de ruedas. En este ejemplo las expresiones faciales controlan los movimientos.

Man: Now blink right to go right. Now blink left to turn back left. Now smile to go straight.

Voz: Guiña el ojo derecho para girar a la derecha. Ahora el izquierdo para girar a la izquierda. Ahora sonríe para avanzar.

TL: We really -- Thank you.

TL: Estamos... muchas gracias.

(Applause)

(Aplauso)

We are really only scratching the surface of what is possible today, and with the community's input, and also with the involvement of developers and researchers from around the world, we hope that you can help us to shape where the technology goes from here. Thank you so much.

Estamos apenas comenzando a explorar las posibilidades. Y con la contribución de la sociedad y el aporte de los ingenieros e investigadores de todo el mundo esperamos poder darle forma al nuevo rumbo de la tecnología. Muchas gracias.