Indtil nu har vores kommunikation med maskiner altid været begrænset til bevidste og direkte former. Ligegyldigt om det er noget simpelt, som at tænde lyset med en kontakt, eller noget så komplekst som at programmere robotter har vi altid måttet give kommandoer til en maskine, eller en serie af kommandoer, for at få den til at udføre noget for os. Kommunikationen mellem mennesker er derimod langt mere kompleks og langt mere interessant, fordi vi skal tage hensyn til langt mere end hvad der eksplicit udtrykkes. We observerer ansigtsudtryk, kropssprog, og vi kender intuitivt til sindsstemninger og følelser igennem vores dialog med hinanden. Dette former faktisk en stor del af vores beslutningsprocesser. Vores vision er at indføre en helt ny dimension af menneskelig interaktion, i menneske/computer interaktion, således at computeren kan forstå, ikke alene det, man beder den om, men så den også kan reagere på dine ansigtsudtryk og følelsesmæssige oplevelser. Og hvilken bedre måde at gøre dette på, end ved at fortolke de signaler, der naturligt skabes i vores hjerne, vores center for styring og oplevelse.

Up until now, our communication with machines has always been limited to conscious and direct forms. Whether it's something simple like turning on the lights with a switch, or even as complex as programming robotics, we have always had to give a command to a machine, or even a series of commands, in order for it to do something for us. Communication between people, on the other hand, is far more complex and a lot more interesting because we take into account so much more than what is explicitly expressed. We observe facial expressions, body language, and we can intuit feelings and emotions from our dialogue with one another. This actually forms a large part of our decision-making process. Our vision is to introduce this whole new realm of human interaction into human-computer interaction so that computers can understand not only what you direct it to do, but it can also respond to your facial expressions and emotional experiences. And what better way to do this than by interpreting the signals naturally produced by our brain, our center for control and experience.

Nuvel, det lyder som en rigtig god idé, men opgaven, som Bruno nævnte det, er ikke nem. Hovedsagligt af to årsager: For det første, kortlægningen af algoritmer. Vores hjerne består af milliarder af aktive neuroner, omkring 170.000 km hvis man lægger længden af aksoner sammen. Når disse neuroner interagerer, udskiller de kemiske reaktioner en elektrisk impuls der kan måles. Hovedparten af vores funktionelle hjerne er fordelt over hjernens ydre overfladelag. For at gøre overfladen - der rummer den mentale kapacitet - større, er hjernens overflade fuld af foldninger. Denne kortikale foldning stiller os overfor udfordringen; at kortlægge overfladens elektriske impulser. Ethvert menneskes cortex er foldet forskelligt, meget lig fingeraftryk. Så selvom et signal kan komme fra samme funktionscenter i hjernen, kan dets fysiske placering, når hjernestrukturen er endeligt foldet sammen, være meget forskellig fra person til person, selv hos enæggede tvillinger. Der er ikke længere sammenhæng mellem overfladesignalerne.

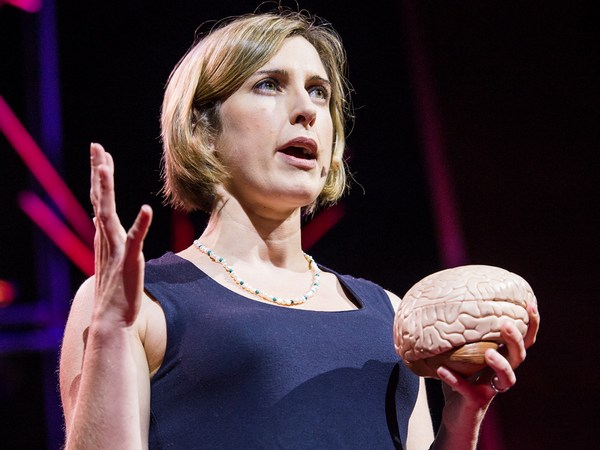

Well, it sounds like a pretty good idea, but this task, as Bruno mentioned, isn't an easy one for two main reasons: First, the detection algorithms. Our brain is made up of billions of active neurons, around 170,000 km of combined axon length. When these neurons interact, the chemical reaction emits an electrical impulse, which can be measured. The majority of our functional brain is distributed over the outer surface layer of the brain, and to increase the area that's available for mental capacity, the brain surface is highly folded. Now this cortical folding presents a significant challenge for interpreting surface electrical impulses. Each individual's cortex is folded differently, very much like a fingerprint. So even though a signal may come from the same functional part of the brain, by the time the structure has been folded, its physical location is very different between individuals, even identical twins. There is no longer any consistency in the surface signals.

Vores gennembrud var at lave en algoritme, der folder cortex ud så vi kan kortlægge signalerne tættere på deres udgangspunkt, og dermed gøre algoritmen anvendelig på den brede befolkning. Den anden udfordring er det apparat, der skal måle hjernebølgerne. EEG-målinger indebærer typisk et hårnet med en lang række sensorer, ligesom det, I kan se her på billedet. En tekniker sætter elektroderne fast på hovedbunden ved hjælp af en elektrisk ledende gel eller pasta, og som regel efter at have gjort hovedbunden klar ved at lave lette hudafskrabninger. Dette er en tidskrævende proces og den er ikke specielt behagelig. Derudover koster disse systemer adskillige tusinde dollars.

Our breakthrough was to create an algorithm that unfolds the cortex, so that we can map the signals closer to its source, and therefore making it capable of working across a mass population. The second challenge is the actual device for observing brainwaves. EEG measurements typically involve a hairnet with an array of sensors, like the one that you can see here in the photo. A technician will put the electrodes onto the scalp using a conductive gel or paste and usually after a procedure of preparing the scalp by light abrasion. Now this is quite time consuming and isn't the most comfortable process. And on top of that, these systems actually cost in the tens of thousands of dollars.

Hermed vil jeg gerne invitere Evan Grant, som er én af sidste års talere, op på scenen. Han har sagt ja til at hjælpe mig med at demonstrere det, vi har været i stand til at udvikle.

So with that, I'd like to invite onstage Evan Grant, who is one of last year's speakers, who's kindly agreed to help me to demonstrate what we've been able to develop.

(Bifald)

(Applause)

Enheden, I ser her er et 14-kanals, high-fidelity EEG målings-system. Det kræver ingen klargøring af hovedbunden, ingen ledende gel eller pasta. Det tager kun et par minutter at tage på og for signalerne til at stabilisere sig. Det er også trådløst, så det giver én frihed til at bevæge sig. Og sammenlignet med de titusindvis af dollars som traditionelle EEG-systemer koster, koster dette headset kun et par hundrede dollars. Og nu til detekteringsalgoritmerne. Ansigtsudtryk - som jeg nævnte før - i følelsesmæssige oplevelser - kan aflæses med det samme med nogle få følsomhedsindstillinger til individuel tilpasning. Men med den begrænsede tid vi har til rådighed her, vil jeg nøjes med at vise jer den kognitive afdeling, hvilket er evnen, der gør dig istand til grundlæggende set, at flytte virtuelle objekter ved tankens kraft.

So the device that you see is a 14-channel, high-fidelity EEG acquisition system. It doesn't require any scalp preparation, no conductive gel or paste. It only takes a few minutes to put on and for the signals to settle. It's also wireless, so it gives you the freedom to move around. And compared to the tens of thousands of dollars for a traditional EEG system, this headset only costs a few hundred dollars. Now on to the detection algorithms. So facial expressions -- as I mentioned before in emotional experiences -- are actually designed to work out of the box with some sensitivity adjustments available for personalization. But with the limited time we have available, I'd like to show you the cognitive suite, which is the ability for you to basically move virtual objects with your mind.

Evan er ny i dette system, så først er vi nødt til at lave en ny profil til ham. Han er tydeligvis ikke Joanne - så vi trykker "tilføj bruger." Evan. Ok. Det første vi skal gøre i den kognitive afdeling er at optræne et neutralt signal. Ved et neutralt signal, er der ikke noget særligt som Evan skal foretage sig. Han hænger bare ud. Han er afslappet. Og idéen er at bestemme et grundniveau eller en normaltilstand for hans hjerne, for alle hjerner er forskellige. Det tager 8 sekunder at gøre dette. Og nu da det er gjort, kan vi vælge en bevægelses-handling. Så Evan; vælg noget, som du kan visualisere klart indeni hovedet.

Now, Evan is new to this system, so what we have to do first is create a new profile for him. He's obviously not Joanne -- so we'll "add user." Evan. Okay. So the first thing we need to do with the cognitive suite is to start with training a neutral signal. With neutral, there's nothing in particular that Evan needs to do. He just hangs out. He's relaxed. And the idea is to establish a baseline or normal state for his brain, because every brain is different. It takes eight seconds to do this, and now that that's done, we can choose a movement-based action. So Evan, choose something that you can visualize clearly in your mind.

Evan Grant: Lad os prøve "træk."

Evan Grant: Let's do "pull."

Tan Le: Okay. Lad os vælge "træk." Idéen er nu at Evan skal forestille sig objektet bevæge sig fremad ind mod skærmen. Og der er en "progress bar", som vil rulle på tværs af skærmen mens han gør det. Første gang, vil der ikke ske noget, fordi systemet ikke ved hvordan han tænker på at trække. Men hold fast i tanken i hele de 8 sekunders varighed. Så: en, to, tre, start. Okay. Når vi så godkender dette, kommer kassen til live. Lad os se om Evan rent faktisk kan prøve at forestille sig at trække. Ah, godt arbejde! (Bifald) Det er ret fantastisk.

Tan Le: Okay, so let's choose "pull." So the idea here now is that Evan needs to imagine the object coming forward into the screen, and there's a progress bar that will scroll across the screen while he's doing that. The first time, nothing will happen, because the system has no idea how he thinks about "pull." But maintain that thought for the entire duration of the eight seconds. So: one, two, three, go. Okay. So once we accept this, the cube is live. So let's see if Evan can actually try and imagine pulling. Ah, good job! (Applause) That's really amazing.

(Bifald)

(Applause)

Vi har lidt tid tilbage så nu vil jeg bede Evan om at udføre en meget svær opgave. Og denne er ret svær fordi den handler om at kunne visualisere noget som ikke eksisterer i den fysiske verden. Dette er "at forsvinde." Så det du skal gøre her -- i det mindste med bevægelses-baserede handlinger, det foretager vi os hele tiden, så det kan man visualisere. Men "at forsvinde", der har vi ikke rigtig nogen analogier. Så Evan, det du skal gøre her er at forestille dig at kassen langsomt fader ud, okay? Samme rille. Så: en, to tre, kør! Okay, lad os prøve det. Du godeste! Han er alt for god. Lad os prøve igen.

So we have a little bit of time available, so I'm going to ask Evan to do a really difficult task. And this one is difficult because it's all about being able to visualize something that doesn't exist in our physical world. This is "disappear." So what you want to do -- at least with movement-based actions, we do that all the time, so you can visualize it. But with "disappear," there's really no analogies -- so Evan, what you want to do here is to imagine the cube slowly fading out, okay. Same sort of drill. So: one, two, three, go. Okay. Let's try that. Oh, my goodness. He's just too good. Let's try that again.

Evan: Jeg mister koncentrationen.

EG: Losing concentration.

(Latter)

(Laughter)

Tan Le: Men vi kan se at det faktisk virker, selvom du kun kan holde den i kort tid. Som jeg sagde, det er en svær opgave at forestille sig dette. Og det fantastiske ved det er, at vi kun har givet programmet én måling af hvordan han tænker på "at forsvinde." Eftersom der er en maskinel læringsalgoritme i dette -

TL: But we can see that it actually works, even though you can only hold it for a little bit of time. As I said, it's a very difficult process to imagine this. And the great thing about it is that we've only given the software one instance of how he thinks about "disappear." As there is a machine learning algorithm in this --

(Bifald)

(Applause)

Tak. Godt arbejde. Godt arbejde.

Thank you. Good job. Good job.

(Bifald)

(Applause)

Tak Evan, du er et skønt, skønt eksempel for teknologien.

Thank you, Evan, you're a wonderful, wonderful example of the technology.

Som I kunne se før er der et udjævningssystem bygget ind i dette program. Så efterhånden som Evan eller andre brugere, bliver mere og mere fortrolige med systemet, kan de fortsætte med at tilføje flere og flere målinger, så systemet bliver i stand til at skelne imellem tydeligt forskellige tanker. Og når man så har optrænet de forskellige detektioner, kan disse tanker så anvises eller kortlægges til hvilken som helst computerbaseret platform, applikation eller enhed.

So, as you can see, before, there is a leveling system built into this software so that as Evan, or any user, becomes more familiar with the system, they can continue to add more and more detections, so that the system begins to differentiate between different distinct thoughts. And once you've trained up the detections, these thoughts can be assigned or mapped to any computing platform, application or device.

Så jeg vil gerne vise jer et par eksempler, for der er mange mulige anvendelsesmuligheder for dette nye interface. I spil og virtuelle verdener, for eksempel, kan dine ansigtsudtryk naturligt og intuitivt bruges til at styre et avatar eller en virtuel karakter. Naturligvis kan man også opleve fantasien om magi og kontrollere verden med sin hjerne. Og også farver, lys, lyd og effekter, kan dynamisk tilsvare dine følelser for at højne din oplevelse i "real time." Og nu videre til anvendelsesmuligheder udviklet af udviklere og forskere verden over, med robotter og simple maskiner, for eksempel - i dette tilfælde, at styre en legetøjshelikopter blot ved at tænke "let".

So I'd like to show you a few examples, because there are many possible applications for this new interface. In games and virtual worlds, for example, your facial expressions can naturally and intuitively be used to control an avatar or virtual character. Obviously, you can experience the fantasy of magic and control the world with your mind. And also, colors, lighting, sound and effects can dynamically respond to your emotional state to heighten the experience that you're having, in real time. And moving on to some applications developed by developers and researchers around the world, with robots and simple machines, for example -- in this case, flying a toy helicopter simply by thinking "lift" with your mind.

Teknologien kan også anvendes i dagligdags applikationer - her et intelligent hjem. Fra kontrolsystemets brugerinterface kan man trække gardiner fra eller lukke dem til. Og selvfølgelig til styring af belysning - at tænde eller slukke. Og til sidst, livsomstyrtende anvendelser, såsom at styre en elektrisk rullestol. I dette eksempel kobles ansigtsudtryk til bevægelseskommandoerne.

The technology can also be applied to real world applications -- in this example, a smart home. You know, from the user interface of the control system to opening curtains or closing curtains. And of course, also to the lighting -- turning them on or off. And finally, to real life-changing applications, such as being able to control an electric wheelchair. In this example, facial expressions are mapped to the movement commands.

Mand: Blink med højre øje for at dreje til højre. Blink nu med venstre øje for at dreje tilbage til venstre. Smil for at køre ligeud.

Man: Now blink right to go right. Now blink left to turn back left. Now smile to go straight.

Tan Le: Vi - Tak skal I have.

TL: We really -- Thank you.

(Bifald)

(Applause)

Vi skraber blot overfladen af, hvad der er muligt i dag. Og med inputs fra forskningsfællesskaber, og inddragelsen af udviklere og forksere fra hele Verden, håber vi, at I kan hjælpe os med at påvirke hvor teknologien skal bevæge sig hen herfra. Mange tak skal I have.

We are really only scratching the surface of what is possible today, and with the community's input, and also with the involvement of developers and researchers from around the world, we hope that you can help us to shape where the technology goes from here. Thank you so much.