Let me tell you a story. It goes back 200 million years. It's a story of the neocortex, which means "new rind." So in these early mammals, because only mammals have a neocortex, rodent-like creatures. It was the size of a postage stamp and just as thin, and was a thin covering around their walnut-sized brain, but it was capable of a new type of thinking. Rather than the fixed behaviors that non-mammalian animals have, it could invent new behaviors. So a mouse is escaping a predator, its path is blocked, it'll try to invent a new solution. That may work, it may not, but if it does, it will remember that and have a new behavior, and that can actually spread virally through the rest of the community. Another mouse watching this could say, "Hey, that was pretty clever, going around that rock," and it could adopt a new behavior as well.

Opowiem wam historię, która ma miejsce 200 milionów lat temu. To opowieść o neokorteksie, co znaczy "kora nowa". U wczesnych ssaków, bo tylko one mają korę nową, u stworzeń podobnych do szczurów, miała rozmiar i grubość znaczka pocztowego i pokrywała ich mózgi wielkości orzecha włoskiego. Ale była zdolna do nowego sposobu myślenia. Zamiast podążać za gotowymi wzorcami jak u zwierząt niższych, mogła tworzyć nowe wzorce. Mysz ucieka przed drapieżnikiem, droga jest zablokowana, więc próbuje znaleźć nowe rozwiązanie. Może zadziałać lub nie. Jeśli się uda, zostanie zapamiętane jako nowy wzór zachowania, który rozprzestrzeni się jak wirus w reszcie społeczności. Inna mysz, patrząc na to, mogłaby powiedzieć - "Jakie to sprytne ominąć ten kamień" i sama przyjęłaby nowy wzór zachowania.

Non-mammalian animals couldn't do any of those things. They had fixed behaviors. Now they could learn a new behavior but not in the course of one lifetime. In the course of maybe a thousand lifetimes, it could evolve a new fixed behavior. That was perfectly okay 200 million years ago. The environment changed very slowly. It could take 10,000 years for there to be a significant environmental change, and during that period of time it would evolve a new behavior.

Żadne zwierzęta poza ssakami tego nie potrafią. Mają ustalone zachowania. Mogą się nauczyć nowego zachowania, ale nie w ciągu jednego pokolenia. Być może w ciągu tysięcy pokoleń może wyewoluować u nich nowe ustalone zachowanie. 200 mln lat temu to zupełnie wystarczało. Środowisko zmieniało się powoli. Mogło to trwać 10 tysięcy lat, by w środowisku nastąpiła znacząca zmiana i w tym czasie mógł powstać nowy wzór zachowania.

Now that went along fine, but then something happened. Sixty-five million years ago, there was a sudden, violent change to the environment. We call it the Cretaceous extinction event. That's when the dinosaurs went extinct, that's when 75 percent of the animal and plant species went extinct, and that's when mammals overtook their ecological niche, and to anthropomorphize, biological evolution said, "Hmm, this neocortex is pretty good stuff," and it began to grow it. And mammals got bigger, their brains got bigger at an even faster pace, and the neocortex got bigger even faster than that and developed these distinctive ridges and folds basically to increase its surface area. If you took the human neocortex and stretched it out, it's about the size of a table napkin, and it's still a thin structure. It's about the thickness of a table napkin. But it has so many convolutions and ridges it's now 80 percent of our brain, and that's where we do our thinking, and it's the great sublimator. We still have that old brain that provides our basic drives and motivations, but I may have a drive for conquest, and that'll be sublimated by the neocortex into writing a poem or inventing an app or giving a TED Talk, and it's really the neocortex that's where the action is.

Szło to sprawnie do pewnego momentu. 65 milionów lat temu zaszła gwałtowna zmiana w środowisku. Było to wymieranie kredowe. Wtedy wyginęły dinozaury i wymarło 75% gatunków zwierząt i roślin. Wtedy ssaki przejęły tę niszę ekologiczną. Antropomorfizując, ewolucja stwierdziła - "Neokorteks to niezła rzecz" i zaczęła go ulepszać. Ssaki stały się większe, ich mózgi powiększały się szybciej, a kora nowa jeszcze szybciej, tworząc typowe dla siebie fałdy, by zwiększyć swoją powierzchnię. Gdyby rozprostować ludzką korę nową, miałaby rozmiar serwetki i byłaby tak samo cienka. Natomiast ma tak wiele zwojów i fałd, że obecnie stanowi 80% naszego mózgu. Tam właśnie odbywa się proces myślenia i przekształcanie instynktów w coś wyższego. Wciąż mamy starą część mózgu, która odpowiada za podstawowe instynkty, lecz mój instynkt podboju może być przesublimowany przez korę nową w napisanie wiersza, wynalezienie aplikacji lub wystąpienie na TED. Wszystko odbywa się w korze nowej. 50 lat temu napisałem artykuł

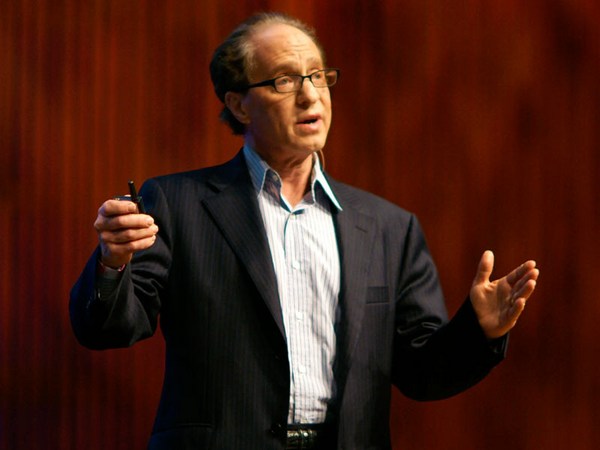

Fifty years ago, I wrote a paper describing how I thought the brain worked, and I described it as a series of modules. Each module could do things with a pattern. It could learn a pattern. It could remember a pattern. It could implement a pattern. And these modules were organized in hierarchies, and we created that hierarchy with our own thinking. And there was actually very little to go on 50 years ago. It led me to meet President Johnson. I've been thinking about this for 50 years, and a year and a half ago I came out with the book "How To Create A Mind," which has the same thesis, but now there's a plethora of evidence. The amount of data we're getting about the brain from neuroscience is doubling every year. Spatial resolution of brainscanning of all types is doubling every year. We can now see inside a living brain and see individual interneural connections connecting in real time, firing in real time. We can see your brain create your thoughts. We can see your thoughts create your brain, which is really key to how it works.

na temat mojego postrzegania pracy mózgu. Opisałem ją jako szereg modułów, każdy moduł działa według wzorców, może nauczyć się wzorca, zapamiętać go i wdrożyć. Moduły są ułożone w hierarchii, którą tworzymy własnymi myślami. Niewiele się działo w tym temacie 50 lat temu. W rezultacie spotkałem się z prezydentem Johnsonem. Myślałem o tym przez 50 lat i półtora roku temu opublikowałem książkę "How to create a mind". Zawiera tę samą tezę, lecz tym razem jest poparta masą dowodów. Ilość danych naukowych dotyczących mózgu dzięki neurologii podwaja się co roku. Rozdzielczość skanów mózgu podwaja się co roku. Można teraz zajrzeć w żywy mózg i zobaczyć poszczególne połączenia neuronów i ich działanie w czasie rzeczywistym. Można zobaczyć, jak mózg tworzy myśli i jak myśli tworzą mózg, co jest kluczem do jego działania.

So let me describe briefly how it works. I've actually counted these modules. We have about 300 million of them, and we create them in these hierarchies. I'll give you a simple example. I've got a bunch of modules that can recognize the crossbar to a capital A, and that's all they care about. A beautiful song can play, a pretty girl could walk by, they don't care, but they see a crossbar to a capital A, they get very excited and they say "crossbar," and they put out a high probability on their output axon. That goes to the next level, and these layers are organized in conceptual levels. Each is more abstract than the next one, so the next one might say "capital A." That goes up to a higher level that might say "Apple." Information flows down also. If the apple recognizer has seen A-P-P-L, it'll think to itself, "Hmm, I think an E is probably likely," and it'll send a signal down to all the E recognizers saying, "Be on the lookout for an E, I think one might be coming." The E recognizers will lower their threshold and they see some sloppy thing, could be an E. Ordinarily you wouldn't think so, but we're expecting an E, it's good enough, and yeah, I've seen an E, and then apple says, "Yeah, I've seen an Apple."

Wyjaśnię pokrótce jak to działa. Policzyłem te moduły, jest ich około 300 milionów i są ułożone hierarchicznie. Podam prosty przykład. Mam zestaw modułów, który umie rozpoznać poprzeczną linię dużej litery A, tylko tym się zajmują. Może grać piosenka, przechodzić piękna dziewczyna, nie zwrócą uwagi, ale gdy zobaczą linię poprzeczną litery A, zareagują i stwierdzą: "linia poprzeczna" i wygenerują wysoki potencjał na aksonach wyjściowych. Prowadzi to na kolejny poziom, gdzie warstwy ułożone są w poziomy pojęciowe. Każdy jest coraz bardziej abstrakcyjny, więc kolejny może powie "duże A". Jeszcze wyższy może powie "Apple". Informacja idzie też w dół. Jeśli struktura rozpoznająca widzi A-P-P-L, może odgadnąć literę E, i wysłać sygnał do struktur na dole, aby wypatrywały litery E. Obniżą one swój próg, aby łatwiej rozpoznać E. Zwykle tak nie robią, ale oczekują E, więc widzą E i tworzą "Apple".

Go up another five levels, and you're now at a pretty high level of this hierarchy, and stretch down into the different senses, and you may have a module that sees a certain fabric, hears a certain voice quality, smells a certain perfume, and will say, "My wife has entered the room."

Idźmy wyżej o pięć poziomów i będziemy dość wysoko w tej hierarchii, na poziomie obejmującym różne zmysły. Moduły mogą rozpoznawać określoną tkaninę, słyszeć cechę głosu, czuć określone perfumy. Może powiedzą: "Moja żona weszła do pokoju".

Go up another 10 levels, and now you're at a very high level. You're probably in the frontal cortex, and you'll have modules that say, "That was ironic. That's funny. She's pretty."

Wznieśmy się o kolejne 10 poziomów i będziemy już bardzo wysoko, możliwe że w korze czołowej, gdzie są moduły mówiące: "To była ironia. To zabawne. Ona jest ładna".

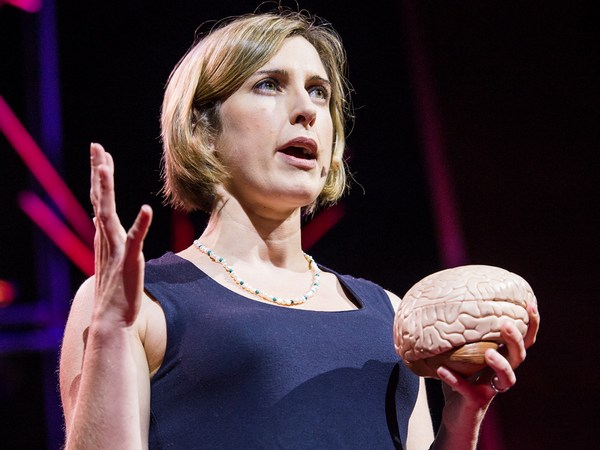

You might think that those are more sophisticated, but actually what's more complicated is the hierarchy beneath them. There was a 16-year-old girl, she had brain surgery, and she was conscious because the surgeons wanted to talk to her. You can do that because there's no pain receptors in the brain. And whenever they stimulated particular, very small points on her neocortex, shown here in red, she would laugh. So at first they thought they were triggering some kind of laugh reflex, but no, they quickly realized they had found the points in her neocortex that detect humor, and she just found everything hilarious whenever they stimulated these points. "You guys are so funny just standing around," was the typical comment, and they weren't funny, not while doing surgery.

Mogą wydać się bardziej wyrafinowane, ale bardziej złożona jest też hierarchia pod nimi. Pewna 16-latka miała operację mózgu. Była przytomna, bo chirurdzy chcieli z nią rozmawiać. To możliwe, bo w mózgu nie ma receptorów bólu. Za każdym razem, gdy pobudzali określone punkty jej kory nowej, zaznaczone tu na czerwono, śmiała się. Najpierw myśleli, że wyzwalają jakiś odruch śmiechu, ale szybko zrozumieli, że odkryli punkty wykrywające humor. Gdy pobudzano ten obszar, wszystko wydawało jej się prześmieszne. Jej typowy komentarz to: "Ale jesteście śmieszni wszyscy wokoło". A oni nie byli śmieszni, nie podczas zabiegu.

So how are we doing today? Well, computers are actually beginning to master human language with techniques that are similar to the neocortex. I actually described the algorithm, which is similar to something called a hierarchical hidden Markov model, something I've worked on since the '90s. "Jeopardy" is a very broad natural language game, and Watson got a higher score than the best two players combined. It got this query correct: "A long, tiresome speech delivered by a frothy pie topping," and it quickly responded, "What is a meringue harangue?" And Jennings and the other guy didn't get that. It's a pretty sophisticated example of computers actually understanding human language, and it actually got its knowledge by reading Wikipedia and several other encyclopedias.

Jak wygląda to dzisiaj? Komputery opanowują ludzki język dzięki metodom podobnym w działaniu do kory nowej. Opisałem algorytm podobny do tak zwanego hierarchicznego ukrytego modelu Markowa. Pracuję nad nim od lat 90. "Jeopardy!" to naturalna gra językowa i Watson osiągnął wyższy wynik niż dwóch najlepszych graczy razem. Poradził sobie z tym zadaniem: "Długa, nużąca przemowa wygłoszona przez piankową polewę ciasta" i odpowiedział: "Czym jest bezowa tyrada?" Jennings i ten drugi nie chwycili tego. To wyszukany przykład tego, jak komputer rozumie ludzki język. Cała jego wiedza pochodzi z czytania Wikipedii i innych encyklopedii.

Five to 10 years from now, search engines will actually be based on not just looking for combinations of words and links but actually understanding, reading for understanding the billions of pages on the web and in books. So you'll be walking along, and Google will pop up and say, "You know, Mary, you expressed concern to me a month ago that your glutathione supplement wasn't getting past the blood-brain barrier. Well, new research just came out 13 seconds ago that shows a whole new approach to that and a new way to take glutathione. Let me summarize it for you."

Za 5 lub 10 lat wyszukiwarki nie będą oparte tylko na szukaniu kombinacji słów i linków, lecz na czytaniu ze zrozumieniem miliardów stron w sieci i książkach. Będziesz na spacerze, Google poda ci wiadomość: "Mary, martwiłaś się niedawno, że twój suplement glutationu nie pokonuje bariery krew-mózg. Nowe badania, które ukazały się 13 sekund temu pokazują nowe sposoby przyswajania glutationu. "Pozwól, że ci to streszczę". Za 20 lat będziemy mieć nanoboty,

Twenty years from now, we'll have nanobots, because another exponential trend is the shrinking of technology. They'll go into our brain through the capillaries and basically connect our neocortex to a synthetic neocortex in the cloud providing an extension of our neocortex. Now today, I mean, you have a computer in your phone, but if you need 10,000 computers for a few seconds to do a complex search, you can access that for a second or two in the cloud. In the 2030s, if you need some extra neocortex, you'll be able to connect to that in the cloud directly from your brain. So I'm walking along and I say, "Oh, there's Chris Anderson. He's coming my way. I'd better think of something clever to say. I've got three seconds. My 300 million modules in my neocortex isn't going to cut it. I need a billion more." I'll be able to access that in the cloud. And our thinking, then, will be a hybrid of biological and non-biological thinking, but the non-biological portion is subject to my law of accelerating returns. It will grow exponentially. And remember what happens the last time we expanded our neocortex? That was two million years ago when we became humanoids and developed these large foreheads. Other primates have a slanted brow. They don't have the frontal cortex. But the frontal cortex is not really qualitatively different. It's a quantitative expansion of neocortex, but that additional quantity of thinking was the enabling factor for us to take a qualitative leap and invent language and art and science and technology and TED conferences. No other species has done that.

bo kolejny trend to miniaturyzacja technologii. Wejdą do naszego mózgu przez naczynia włosowate i połączą nasz neokorteks z syntetycznym neokorteksem w chmurze, powiększając nasz neokorteks. Dzisiaj mamy komputer w telefonie, ale jeśli potrzebujesz 10 000 komputerów tylko na chwilę do złożonego wyszukiwania, masz do nich dostęp w chmurze. Po 2030 jeśli będziesz potrzebać dodatkowy neokorteks, możesz połączyć się z nim wprost ze swojego mózgu. Więc idę sobie i mówię: "To Chris Anderson. Idzie w moją stronę. Co by tu bystrego powiedzieć?". Mam trzy sekundy. 300 milionów modułów w moim neokorteksie nic nie wymyśli. Potrzebuję miliard więcej. Połączę się z chmurą. Nasze myśli będą hybrydą biologicznego i niebiologicznego myślenia. Część niebiologiczna, zgodnie z moim prawem przyspieszonych zwrotów, będzie rosła wykładniczo. Co się stało, kiedy ostatnio nasz neokorteks powiększył się? To było 2 miliony lat temu, wtedy staliśmy się humanoidami i rozwinęliśmy duże czoła. Inne naczelne mają wydatne wały nadoczodołowe. Nie mają płata czołowego. Sam płat czołowy nie stanowi jakościowej różnicy. To poszerzenie kory nowej. Za to ta dodatkowa ilość myślenia pozwoliła nam na skok jakościowy i powstanie języka, sztuki, nauki, technologii i konferencji TED. Żaden inny gatunek tego nie osiągnął.

And so, over the next few decades, we're going to do it again. We're going to again expand our neocortex, only this time we won't be limited by a fixed architecture of enclosure. It'll be expanded without limit. That additional quantity will again be the enabling factor for another qualitative leap in culture and technology.

W ciągu kolejnych dziesięcioleci znów to zrobimy. Znowu powiększymy korę nową, ale tym razem nie będziemy ograniczeni przestrzenią fizyczną. Poszerzymy ją bezgranicznie. Dodatkowa ilość pozwoli na jakościowy skok w rozwoju kultury i technologii.

Thank you very much.

Dziękuję bardzo.

(Applause)

(Brawa)