Let me tell you a story. It goes back 200 million years. It's a story of the neocortex, which means "new rind." So in these early mammals, because only mammals have a neocortex, rodent-like creatures. It was the size of a postage stamp and just as thin, and was a thin covering around their walnut-sized brain, but it was capable of a new type of thinking. Rather than the fixed behaviors that non-mammalian animals have, it could invent new behaviors. So a mouse is escaping a predator, its path is blocked, it'll try to invent a new solution. That may work, it may not, but if it does, it will remember that and have a new behavior, and that can actually spread virally through the rest of the community. Another mouse watching this could say, "Hey, that was pretty clever, going around that rock," and it could adopt a new behavior as well.

Lasciatemi raccontare una storia. Risale a 200 milioni di anni fa. È la storia della neocorteccia che in latino significa letteralmente "nuova corteccia". Nei primi mammiferi, poiché solo i mammiferi hanno una neocorteccia, creature simili ai roditori, era della misura di un francobollo ed ugualmente sottile, era semplicemente uno strato sottile che ricopriva un cervello grande come una noce, eppure li rendeva capaci di un nuovo tipo di pensiero. Oltre ai comportamenti invariabili, che hanno gli animali non mammiferi, permetteva di inventare nuovi comportamenti: un topo sta scappando da un predatore, ha la strada bloccata, prova ad inventare una nuova soluzione, che potrebbe funzionare oppure no, ma se funziona, lo ricorderà e avrà acquisito un nuovo comportamento che potrà diffondersi come un virus nel resto della comunità. Un altro topo potrebbe guardarlo e dire "Ehi, ma che cosa intelligente fare il giro di quella roccia." e potrebbe adottare anche lui un nuovo comportamento.

Non-mammalian animals couldn't do any of those things. They had fixed behaviors. Now they could learn a new behavior but not in the course of one lifetime. In the course of maybe a thousand lifetimes, it could evolve a new fixed behavior. That was perfectly okay 200 million years ago. The environment changed very slowly. It could take 10,000 years for there to be a significant environmental change, and during that period of time it would evolve a new behavior.

Animali non mammiferi non potevano fare niente di tutto questo. Avevano comportamenti fissi. A dire il vero, potevano imparare un nuovo comportamento, ma non nel corso di un'unica vita. Forse nel corso di migliaia di vite poteva persino evolversi un nuovo comportamento. Questo andava benissimo 200 milioni di anni fa. L'ambiente cambiava molto lentamente potevano volerci 10 000 di anni prima che si verificasse un cambiamento ambientale e durante questo lasso di tempo potevano sviluppare un nuovo comportamento.

Now that went along fine, but then something happened. Sixty-five million years ago, there was a sudden, violent change to the environment. We call it the Cretaceous extinction event. That's when the dinosaurs went extinct, that's when 75 percent of the animal and plant species went extinct, and that's when mammals overtook their ecological niche, and to anthropomorphize, biological evolution said, "Hmm, this neocortex is pretty good stuff," and it began to grow it. And mammals got bigger, their brains got bigger at an even faster pace, and the neocortex got bigger even faster than that and developed these distinctive ridges and folds basically to increase its surface area. If you took the human neocortex and stretched it out, it's about the size of a table napkin, and it's still a thin structure. It's about the thickness of a table napkin. But it has so many convolutions and ridges it's now 80 percent of our brain, and that's where we do our thinking, and it's the great sublimator. We still have that old brain that provides our basic drives and motivations, but I may have a drive for conquest, and that'll be sublimated by the neocortex into writing a poem or inventing an app or giving a TED Talk, and it's really the neocortex that's where the action is.

Fino ad ora questo aveva funzionato, ma poi qualcosa è successo. Sessantacinque milioni di anni fa, ci fu un improvviso e violento cambiamento nell'ambiente. Si chiama estinzione di massa del Cretaceo. Fu quando si estinsero i dinosauri, cioè quando il 75 per cento delle specie animali e delle piante si estinsero, ed è quando i mammiferi superarono la loro nicchia ecologica per antropomorfizzare, l'evoluzione biologica disse, "Questa neurocorteccia è roba piuttosto buona" e cominciò a farla crescere. Così i mammiferi sono diventati più grandi, il loro cervello è cresciuto persino ad una velocità superiore e la neurocorteccia è cresciuta ad una velocità anche superiore e ha sviluppato queste peculiari creste ed ondulazioni fondamentalmente per aumentarne la superficie. Se prendete la neurocorteccia umana e la stendete ha più o meno la misura di un tovagliolo ed è ancora una struttura sottile. Ha all'incirca lo spessore di un tovagliolo. Ha talmente tante convoluzioni e creste da occupare l'80 per cento del nostro cervello, ed è proprio dove nascono i nostri pensieri ed è un grande sublimatore. Abbiamo ancora il vecchio cervelllo che ci fornisce gli impulsi e le motivazioni di base, però io potrei avere un impulso di conquista e questo verrebbe sublimato dalla neurocorteccia a scrivere un poema o inventare una app oppure a tenere un discorso a TED ed è effettivamente nella neurocorteccia che si svolge l'azione.

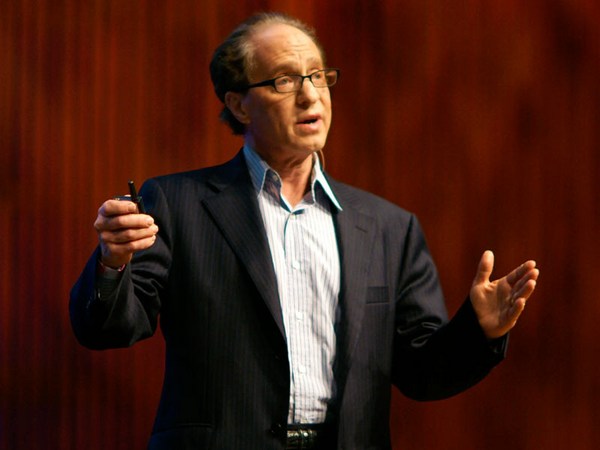

Fifty years ago, I wrote a paper describing how I thought the brain worked, and I described it as a series of modules. Each module could do things with a pattern. It could learn a pattern. It could remember a pattern. It could implement a pattern. And these modules were organized in hierarchies, and we created that hierarchy with our own thinking. And there was actually very little to go on 50 years ago. It led me to meet President Johnson. I've been thinking about this for 50 years, and a year and a half ago I came out with the book "How To Create A Mind," which has the same thesis, but now there's a plethora of evidence. The amount of data we're getting about the brain from neuroscience is doubling every year. Spatial resolution of brainscanning of all types is doubling every year. We can now see inside a living brain and see individual interneural connections connecting in real time, firing in real time. We can see your brain create your thoughts. We can see your thoughts create your brain, which is really key to how it works.

Cinquant'anni fa ho scritto un saggio che descriveva come pensavo che il cervello funzionasse e l'ho descritto come una serie di moduli. Ogni modulo può compiere compiti secondo uno schema. Può imparare uno schema. Può ricordare uno schema. Può implementare uno schema. Questi moduli sono organizzati secondo una gerarchia e noi creiamo questa gerarchia con i nostri stessi pensieri. C'era davvero poco con cui procedere cinquant'anni fa. Mi ha portato a conoscere il Presidente Johnson. Dopo averci pensato per quasi cinquant'anni un anno e mezzo fa ho pubblicato il libro "Come creare una Mente" che conteneva le stesse tesi ma adesso ci sono tantissime prove. La quantità di dati che stiamo ricevendo sul cervello dalla neuroscienza raddoppia ogni anno. La risoluzione spaziale di tutti i tipi di scansione cerebrale raddoppia ogni anno. Adesso possiamo vedere all'interno di un cervello vivo e vedere le connessioni interneurali che si connettono in tempo reale, che si attivano in tempo reale. Possiamo vedere il cervello mentre crea i pensieri. Possiamo vedere i pensieri creare il cervello che in effetti è la chiave per capire come funziona.

So let me describe briefly how it works. I've actually counted these modules. We have about 300 million of them, and we create them in these hierarchies. I'll give you a simple example. I've got a bunch of modules that can recognize the crossbar to a capital A, and that's all they care about. A beautiful song can play, a pretty girl could walk by, they don't care, but they see a crossbar to a capital A, they get very excited and they say "crossbar," and they put out a high probability on their output axon. That goes to the next level, and these layers are organized in conceptual levels. Each is more abstract than the next one, so the next one might say "capital A." That goes up to a higher level that might say "Apple." Information flows down also. If the apple recognizer has seen A-P-P-L, it'll think to itself, "Hmm, I think an E is probably likely," and it'll send a signal down to all the E recognizers saying, "Be on the lookout for an E, I think one might be coming." The E recognizers will lower their threshold and they see some sloppy thing, could be an E. Ordinarily you wouldn't think so, but we're expecting an E, it's good enough, and yeah, I've seen an E, and then apple says, "Yeah, I've seen an Apple."

Fatemi descrivere brevemente come funziona. Ho davvero contato questi moduli. Ne abbiamo all'incirca trecento milioni e li creiamo in queste gerarchie. Vi farò un semplice esempio. Ho una manciata di moduli che possono riconoscere l'asta trasversale della maiuscola A ed è tutto quello di cui si occupano. Può suonare una bella musica, può passare una bella ragazza, a loro non importa, quando vedono l'asta trasversale della A maiuscola si eccitano un sacco e dicono "asta trasversale" e con molta probabilità lascerebbero uscire il loro assone d'uscita. Così si passa al livello successivo, questi strati sono organizzati in livelli concettuali. Ognuno è più astratto del successivo così il successivo potrebbe dire "A maiuscola". Quindi si arriva ad un livello superiore che potrebbe dire "Apple". Le informazioni scorrono anche verso il basso. Se il riconoscitore della mela ha visto A-P-P-L penserà tra sé e sé "Credo che probabilmente arriverà una E" e invierà un segnale a tutti i riconoscitori di E dicendo "fate attenzione alla E credo che ne arriverà una". I riconoscitori della E abbasseranno le loro barriere e vedranno qualcosa che potrebbe essere una E. Normalmente non sarebbe così ma stiamo aspettando una E, va abbastanza bene, e sì, ho visto una E e quindi "apple" dirà "sì, ho visto una mela".

Go up another five levels, and you're now at a pretty high level of this hierarchy, and stretch down into the different senses, and you may have a module that sees a certain fabric, hears a certain voice quality, smells a certain perfume, and will say, "My wife has entered the room."

Risaliamo altri cinque livelli, adesso siete pittosto in alto in questa gerarchia, e si allungherà verso i vari sensi e potreste avere un modulo che vede una certa stoffa, che sente una certo timbro di voce, sente un certo profumo, e dirà, "Mia moglie è appena entrata nella stanza".

Go up another 10 levels, and now you're at a very high level. You're probably in the frontal cortex, and you'll have modules that say, "That was ironic. That's funny. She's pretty."

Risalite un'altra decina di livelli e adesso sarete al livello più alto. Probabilmente vi troverete nella corteccia frontale e avrete dei moduli che dicono, "Questo era ironico. Questo è divertente. Lei è carina."

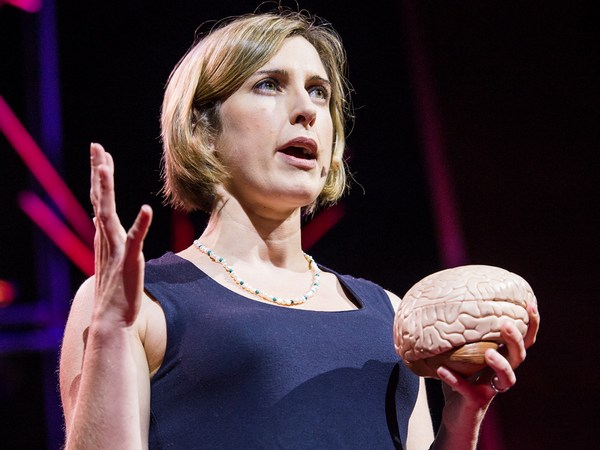

You might think that those are more sophisticated, but actually what's more complicated is the hierarchy beneath them. There was a 16-year-old girl, she had brain surgery, and she was conscious because the surgeons wanted to talk to her. You can do that because there's no pain receptors in the brain. And whenever they stimulated particular, very small points on her neocortex, shown here in red, she would laugh. So at first they thought they were triggering some kind of laugh reflex, but no, they quickly realized they had found the points in her neocortex that detect humor, and she just found everything hilarious whenever they stimulated these points. "You guys are so funny just standing around," was the typical comment, and they weren't funny, not while doing surgery.

Potreste pensare che sia più sofisticato, ma in realtà quello che è più complicato è la gerarchia che ci sta sotto. Una ragazza di 16 anni, mentre subiva un intervento chirurgico al cervello era cosciente, perché i chirurghi volevano parlare con lei. Si può fare, perché non ci sono ricettori del dolore nel cervello. Ogni volta che stimolavano una particolare piccolissima porzione della neurocorteccia illustrata qui in rosso, lei rideva. Inizialmente pensavano di aver scatenato un qualche riflesso della risata, ma poi si sono resi conto che avevano trovato il punto in cui la sua neurocorteccia individuava l'umorismo, così che a lei veniva da ridere ogni volta che loro stimolavano questo punto. "Siete così buffi lì in piedi tutti intorno", era il tipico commento, ma loro non erano divertenti, non mentre operavano.

So how are we doing today? Well, computers are actually beginning to master human language with techniques that are similar to the neocortex. I actually described the algorithm, which is similar to something called a hierarchical hidden Markov model, something I've worked on since the '90s. "Jeopardy" is a very broad natural language game, and Watson got a higher score than the best two players combined. It got this query correct: "A long, tiresome speech delivered by a frothy pie topping," and it quickly responded, "What is a meringue harangue?" And Jennings and the other guy didn't get that. It's a pretty sophisticated example of computers actually understanding human language, and it actually got its knowledge by reading Wikipedia and several other encyclopedias.

Cosa facciamo qui oggi? A dire il vero i computer stanno iniziando a padroneggiare tecniche del linguaggio umano simili a quelle della neurocorteccia. A dire il vero ho descritto l'algoritmo che assomiglia a qualcosa chiamato modello gerarchico di Markov nascosto, una cosa sulla quale ho lavorato sin dagli anni '90. "Jeopardy" è un gioco molto diffuso sul linguaggio naturale e Watson ha un punteggio più alto degli altri due giocatori messi insieme. Ha risposto correttamente a questa domanda: "Un discorso lungo e noioso consegnato su una torta con una decorazione spumosa". e lui ha velocemente risposto: "Cos'è un'arringa meringa?" Mentre Jennings e gli altri ragazzi non ci sono arrivati. È un esempio piuttosto sofisticato di computer che effettivamente capiscono il linguaggio umano e che raggiungono questa conoscenza leggendo Wikipedia e diverse altre enciclopedie.

Five to 10 years from now, search engines will actually be based on not just looking for combinations of words and links but actually understanding, reading for understanding the billions of pages on the web and in books. So you'll be walking along, and Google will pop up and say, "You know, Mary, you expressed concern to me a month ago that your glutathione supplement wasn't getting past the blood-brain barrier. Well, new research just came out 13 seconds ago that shows a whole new approach to that and a new way to take glutathione. Let me summarize it for you."

Fra cinque o dieci anni da adesso i motori di ricerca saranno basati non solo sulla ricerca di combinazioni di parole e collegamenti, ma sulla reale comprensione, sulla comprensione che deriva dalla lettura di miliardi di pagine sul web e sui libri Un giorno passeggiando Google si attiverà all'improvviso dicendo "Sai Mary, un mese fa eri preoccupata che il tuo integratore di glutatione non andasse oltre la barriera emato-cefalica. Esattamente tredici secondi fa una nuova ricerca ha scoperto un nuovissimo approccio e un nuovo modo di prendere il glutatione. Lascia che te ne faccia un riassunto."

Twenty years from now, we'll have nanobots, because another exponential trend is the shrinking of technology. They'll go into our brain through the capillaries and basically connect our neocortex to a synthetic neocortex in the cloud providing an extension of our neocortex. Now today, I mean, you have a computer in your phone, but if you need 10,000 computers for a few seconds to do a complex search, you can access that for a second or two in the cloud. In the 2030s, if you need some extra neocortex, you'll be able to connect to that in the cloud directly from your brain. So I'm walking along and I say, "Oh, there's Chris Anderson. He's coming my way. I'd better think of something clever to say. I've got three seconds. My 300 million modules in my neocortex isn't going to cut it. I need a billion more." I'll be able to access that in the cloud. And our thinking, then, will be a hybrid of biological and non-biological thinking, but the non-biological portion is subject to my law of accelerating returns. It will grow exponentially. And remember what happens the last time we expanded our neocortex? That was two million years ago when we became humanoids and developed these large foreheads. Other primates have a slanted brow. They don't have the frontal cortex. But the frontal cortex is not really qualitatively different. It's a quantitative expansion of neocortex, but that additional quantity of thinking was the enabling factor for us to take a qualitative leap and invent language and art and science and technology and TED conferences. No other species has done that.

Fra vent'anni avremo i nanobot, perché un'altro trend esponenziale è il rimpicciolimento della tecnologia. Entreranno nel nostro cervello attraverso i capillari e in pratica collegheranno la nostra neurocorteccia ad una neurocorteccia nel cloud che fungerà da estensione alla nostra neurocorteccia. Mi spiego: oggi avete un computer nel vostro cellulare, ma se avete bisogno di 10 000 computer per pochi secondi per effettuare una ricerca complessa, potete effettuarla per qualche secondo nel cloud. Nel 2030 se avrete bisogno di un po' di neurocorteccia in più, sarete in grado di collegarvi a quella del cloud, direttamente dal vostro cervello. Immaginate: sto camminando ed esclamo "C'è Chris Anderson. Mi sta venendo incontro. Farò meglio a pensare a qualcosa di intelligente da dire. Ho tre secondi. I 300 milioni di moduli della mia neurocorteccia non riescono a trovare nulla. Ho bisogno di un miliardo di moduli in più". Sarò in grado di averli a disposizione nel cloud. Così i nostri pensieri saranno un ibrido fra pensiero biologico e non-biologico e la parte non-biologica sarà soggetta alla mia legge sul ritorno accelerato. Crescerà in modo esponenziale. Ricordate cos'è successo l'ultima volta che la nostra neurocorteccia è aumentata? È successo due milioni di anni fa, quando siamo diventati umanoidi e abbiamo sviluppato questa fronte ampia. Gli altri primati hanno una fronte inclinata. Non hanno la corteccia frontale. La corteccia frontale non è differente dal punto di vista qualitativo. È un'espansione della neurocorteccia, ma questa quantità aggiuntiva di pensiero è stato il fattore che ci ha permesso di fare il salto qualitativo e di inventare il linguaggio, l'arte, la scienza, la tecnologia e le conferenze TED. Nessun altra specie l'ha fatto.

And so, over the next few decades, we're going to do it again. We're going to again expand our neocortex, only this time we won't be limited by a fixed architecture of enclosure. It'll be expanded without limit. That additional quantity will again be the enabling factor for another qualitative leap in culture and technology.

Quindi nella prossima decina di anni lo faremo nuovamente. Espanderemo nuovamente la nostra neurocorteccia, solo che questa volta non sarà limitato da una struttura chiusa. Si potrà espandere senza limiti. La quantità aggiuntiva sarà di nuovo il fattore che permetterà un altro salto qualitativo nella cultura e nella tecnologia.

Thank you very much.

Grazie tante.

(Applause)

(Applausi)