Let me tell you a story. It goes back 200 million years. It's a story of the neocortex, which means "new rind." So in these early mammals, because only mammals have a neocortex, rodent-like creatures. It was the size of a postage stamp and just as thin, and was a thin covering around their walnut-sized brain, but it was capable of a new type of thinking. Rather than the fixed behaviors that non-mammalian animals have, it could invent new behaviors. So a mouse is escaping a predator, its path is blocked, it'll try to invent a new solution. That may work, it may not, but if it does, it will remember that and have a new behavior, and that can actually spread virally through the rest of the community. Another mouse watching this could say, "Hey, that was pretty clever, going around that rock," and it could adopt a new behavior as well.

Laissez-moi vous raconter une histoire, qui se passe il y a 200 millions d'années. C'est l'histoire du néocortex. Ce qui signifie « nouvelle écorce ». Chez les mammifères primitifs, car seuls les mammifères ont un néocortex, des créatures proches des rongeurs, il était de la taille et de l'épaisseur d'un timbre poste et formait une fine pellicule autour de leur cerveau pas plus gros qu'une noix, mais il était capable d'une nouvelle façon de réfléchir. Plutôt que les comportements prédéfinis des animaux autres que les mammifères, il pouvait inventer de nouveaux comportements. Par exemple, une souris fuit un prédateur, sa voie est bloquée, elle va essayer d'inventer une nouvelle solution. Ça peut marcher ou pas, mais si c'est le cas, elle s'en souviendra et adoptera un nouveau comportement, qui pourra alors se propager tel un virus au reste de la communauté. Une autre souris en l'observant pourrait se dire, « Contourner cette pierre, c'était assez futé. » et pourrait adopter un nouveau comportement elle aussi.

Non-mammalian animals couldn't do any of those things. They had fixed behaviors. Now they could learn a new behavior but not in the course of one lifetime. In the course of maybe a thousand lifetimes, it could evolve a new fixed behavior. That was perfectly okay 200 million years ago. The environment changed very slowly. It could take 10,000 years for there to be a significant environmental change, and during that period of time it would evolve a new behavior.

Les animaux autres que les mammifères ne pouvaient pas faire ce genre de choses. Ils avaient des comportements prédéfinis. Ils pourraient en apprendre un nouveau, mais leur vie est trop courte pour ça. Au cours d'un millier de vies, il pourrait développer un nouveau comportement prédéfini. Ça fonctionnait bien il y a 200 millions d'années, l'environnement changeait très lentement. Ça pouvait prendre 10 000 ans pour qu'un important changement environnemental ait lieu, pendant ce temps-là, l'animal aurait évolué vers un nouveau comportement. Ça fonctionnait bien,

Now that went along fine, but then something happened. Sixty-five million years ago, there was a sudden, violent change to the environment. We call it the Cretaceous extinction event. That's when the dinosaurs went extinct, that's when 75 percent of the animal and plant species went extinct, and that's when mammals overtook their ecological niche, and to anthropomorphize, biological evolution said, "Hmm, this neocortex is pretty good stuff," and it began to grow it. And mammals got bigger, their brains got bigger at an even faster pace, and the neocortex got bigger even faster than that and developed these distinctive ridges and folds basically to increase its surface area. If you took the human neocortex and stretched it out, it's about the size of a table napkin, and it's still a thin structure. It's about the thickness of a table napkin. But it has so many convolutions and ridges it's now 80 percent of our brain, and that's where we do our thinking, and it's the great sublimator. We still have that old brain that provides our basic drives and motivations, but I may have a drive for conquest, and that'll be sublimated by the neocortex into writing a poem or inventing an app or giving a TED Talk, and it's really the neocortex that's where the action is.

mais alors quelque chose arriva. Il y a 65 millions d'années, il y eut un changement soudain et violent de l'environnement. On l'appelle l'extinction du Crétacé-Tertiaire. C'est à ce moment que les dinosaures ont disparu, où 75% des espèces d'animaux et de plantes ont disparu et c'est aussi là que les mammifères ont dépassé leur niche écologique, et si j'anthropomorphise, l'évolution biologique se dit alors : « Le néocortex, c'est assez chouette. » et commença alors à le faire grossir. Alors les mammifères ont grandi leurs cerveaux ont grossi à un rythme encore plus rapide, et le néocortex a grossi encore plus vite et a développé ces stries et ces plis qui lui sont propres pour étendre sa surface essentiellement. Si vous preniez un néocortex humain et l'étiriez au maximum, il est environ de la taille d'une serviette de table tout en restant fin. Environ de l'épaisseur d'une serviette de table. Mais il a tant de circonvolutions et de stries qu'il représente à présent 80% de notre cerveau, et c'est dans cette partie que nous réfléchissons, c'est le grand transcendeur. On a toujours notre vieux cerveau qui nous fournit nos pulsions et nos motivations primitifs, mais si j'ai une volonté de conquête, cette dernière va être exprimée par le néocortex dans la rédaction d'un poème ou l'invention d'une application ou encore dans la réalisation d'un TED Talk, et c'est vraiment là, dans le néocortex, que l'action se passe.

Fifty years ago, I wrote a paper describing how I thought the brain worked, and I described it as a series of modules. Each module could do things with a pattern. It could learn a pattern. It could remember a pattern. It could implement a pattern. And these modules were organized in hierarchies, and we created that hierarchy with our own thinking. And there was actually very little to go on 50 years ago. It led me to meet President Johnson. I've been thinking about this for 50 years, and a year and a half ago I came out with the book "How To Create A Mind," which has the same thesis, but now there's a plethora of evidence. The amount of data we're getting about the brain from neuroscience is doubling every year. Spatial resolution of brainscanning of all types is doubling every year. We can now see inside a living brain and see individual interneural connections connecting in real time, firing in real time. We can see your brain create your thoughts. We can see your thoughts create your brain, which is really key to how it works.

Il y a 50 ans, j'ai écrit un article décrivant comment je pensais que le cerveau fonctionnait, et je le décrivais comme une série de modules. Chaque module pouvait faire des choses selon un modèle, et aussi apprendre un modèle, s'en rappeler, et l'implémenter. Et ces modules s'organisaient selon une hiérarchie, nous créions cette hiérarchie avec notre réflexion. on n'en savait peu là-dessus il y a 50 ans. Ça m'a conduit à rencontrer le président Johnson. J'y ai réfléchi depuis 50 ans, et il y a un an et demi je publiais le livre "How to Create a Mind" (<i>Comment créer un esprit</i>) qui soutient la même théorie, mais à l'heure actuelle il y a pléthore de preuves. La quantité de données concernant le cerveau qui nous vient des neurosiences double chaque année. La résolution du scanner cérébral double elle aussi chaque année. Nous pouvons observer l'intérieur d'un cerveau vivant et ainsi voir ses connections neurologiques se faire et s'activer en temps réel. Nous pouvons voir votre cerveau créer vos pensées. Nous pouvons voir vos pensées créer votre cerveau, ce qui est essentiel pour expliquer son fonctionnement.

So let me describe briefly how it works. I've actually counted these modules. We have about 300 million of them, and we create them in these hierarchies. I'll give you a simple example. I've got a bunch of modules that can recognize the crossbar to a capital A, and that's all they care about. A beautiful song can play, a pretty girl could walk by, they don't care, but they see a crossbar to a capital A, they get very excited and they say "crossbar," and they put out a high probability on their output axon. That goes to the next level, and these layers are organized in conceptual levels. Each is more abstract than the next one, so the next one might say "capital A." That goes up to a higher level that might say "Apple." Information flows down also. If the apple recognizer has seen A-P-P-L, it'll think to itself, "Hmm, I think an E is probably likely," and it'll send a signal down to all the E recognizers saying, "Be on the lookout for an E, I think one might be coming." The E recognizers will lower their threshold and they see some sloppy thing, could be an E. Ordinarily you wouldn't think so, but we're expecting an E, it's good enough, and yeah, I've seen an E, and then apple says, "Yeah, I've seen an Apple."

Laissez-moi vous le décrire simplement. J'ai en réalité compté ces modules. Nous en avons environ 300 millions, et nous les créons en hiérarchies. Je vais vous donner un exemple simple. J'ai un ensemble de modules qui reconnaisse la barre horizontale de la lettre A, et c'est tout ce dont ils s'occupent. On peut diffuser une jolie chanson, une jolie fille peut passer devant vous, ils n'en ont rien à faire, mais s'ils rencontrent la barre de la A ils deviennent alors très actifs et disent 'barre', et placent alors une importante probabilité sur leur axone de sortie. On passe au niveau suivant, et ces couches sont organisées en différents niveaux conceptuels, chacun plus abstrait que le suivant. Le suivant pourrait alors dire "A", le message va au niveau supérieur qui pourrait dire "Apple" (<i>pomme</i>) L'information va aussi dans le sens inverse. Si le détecteur d'APPLE voit A-P-P-L, il va alors se dire : « Je pense que la prochaine lettre sera probablement un E » et enverra alors signal aux détecteurs de E, leur disant : « soyez prêts à trouver un E, je pense qu'il y en a un qui arrive. » Les détecteurs de E vont alors baisser leur seuil et même si le symbole est approximatif, le prendront pour un E. « D'ordinaire ce n'est pas le cas, mais ici on attend un E, donc c'est bon. Oui, je vois un E. », ensuite le détecteur d'APPLE dit : « Oui, j'ai bien vu APPLE ».

Go up another five levels, and you're now at a pretty high level of this hierarchy, and stretch down into the different senses, and you may have a module that sees a certain fabric, hears a certain voice quality, smells a certain perfume, and will say, "My wife has entered the room."

L'information monte encore de cinq niveaux, et là on est assez haut dans la hiérarchie, et tiraillé entre les différents sens. Vous avez un module qui reconnaît un tissu est réceptif à une voix, sent un parfum, et va alors dire : « ma femme est entrée dans la pièce ».

Go up another 10 levels, and now you're at a very high level. You're probably in the frontal cortex, and you'll have modules that say, "That was ironic. That's funny. She's pretty."

Dix niveaux plus hauts, et là vous êtes à un très haut niveau. probablement dans le cortex frontal, et vous aurez des modules qui disent : « C'était ironique. C'est drôle. Elle est jolie. »

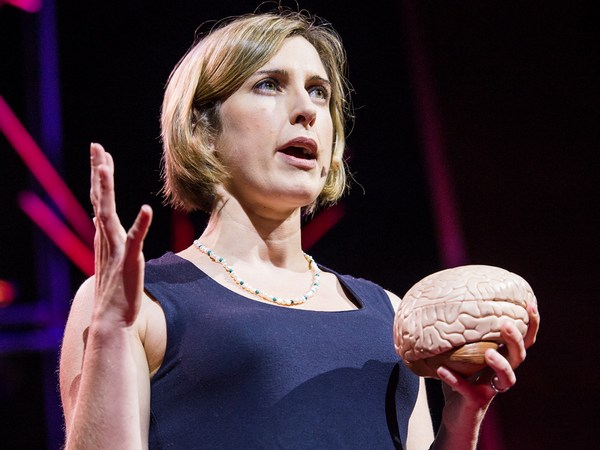

You might think that those are more sophisticated, but actually what's more complicated is the hierarchy beneath them. There was a 16-year-old girl, she had brain surgery, and she was conscious because the surgeons wanted to talk to her. You can do that because there's no pain receptors in the brain. And whenever they stimulated particular, very small points on her neocortex, shown here in red, she would laugh. So at first they thought they were triggering some kind of laugh reflex, but no, they quickly realized they had found the points in her neocortex that detect humor, and she just found everything hilarious whenever they stimulated these points. "You guys are so funny just standing around," was the typical comment, and they weren't funny, not while doing surgery.

Vous pourriez penser que c'est plus sophistiqué, mais en fait, le plus compliqué, c'est la hiérarchie sous-jacente. Une jeune fille de 16 ans qui était opérée du cerveau, elle restait consciente car le chirurgien voulait maintenir le dialogue avec elle. C'est possible car il n'y a pas de récepteur de douleur dans le cerveau. Et lorsqu'ils stimulaient des points très particuliers dans son néocortex, représentés ici en rouge, elle se mettait à rire. Au début, ils pensaient qu'ils déclenchaient un réflexe du rire, mais ils ont vite découvert qu'ils avaient trouvé le point de son néocortex qui détecte l'humour, et elle trouvait alors absolument tout hilarant dès qu'ils stimulaient ces points. Elle répétait : « Vous êtes tellement drôles tous debout autour de moi » alors qu'ils n'étaient pas drôles, du moins pas pendant l'opération.

So how are we doing today? Well, computers are actually beginning to master human language with techniques that are similar to the neocortex. I actually described the algorithm, which is similar to something called a hierarchical hidden Markov model, something I've worked on since the '90s. "Jeopardy" is a very broad natural language game, and Watson got a higher score than the best two players combined. It got this query correct: "A long, tiresome speech delivered by a frothy pie topping," and it quickly responded, "What is a meringue harangue?" And Jennings and the other guy didn't get that. It's a pretty sophisticated example of computers actually understanding human language, and it actually got its knowledge by reading Wikipedia and several other encyclopedias.

Alors, où en sommes-nous ajourd'hui ? Eh bien, les ordinateurs commencent à maîtriser les langues grâce à des techniques similaires à celles du néocortex. J'ai décrit l'algorithme, qui est similaire à un système appelé modèle hiérarchique de Markov caché, ce sur quoi je travaille depuis les années 90. <i>Jeopardy</i> est un jeu télévisé portant sur le langage, et <i>Watson</i> a obtenu un score plus important que les deux autres réunis. Il a répondu correctement à cette question : « Un long et ennuyeux discours énoncé par un mousseux nappage de tarte », et il répondit rapidement : « Comment nomme-t-on une diatribe de meringue ? » Jennings et l'autre joueur n'ont pas compris. C'est un exemple précis de la façon dont les ordinateurs comprennent le langage humain, et ils l'apprennent en fait en lisant Wikipedia et de plusieurs autres encyclopédies.

Five to 10 years from now, search engines will actually be based on not just looking for combinations of words and links but actually understanding, reading for understanding the billions of pages on the web and in books. So you'll be walking along, and Google will pop up and say, "You know, Mary, you expressed concern to me a month ago that your glutathione supplement wasn't getting past the blood-brain barrier. Well, new research just came out 13 seconds ago that shows a whole new approach to that and a new way to take glutathione. Let me summarize it for you."

D'ici 5 à 10 ans, les moteurs de recherche se baseront non seulement sur les combinaisons de mots et de liens, mais bien sur leur compréhension. D'où la lecture de milliards de pages sur internet comme dans des livres. Donc vous vous baladerez et alors Google s'affichera et vous dira : « Mary, il y a un mois vous m'avez exprimé votre préoccupation concernant votre complément en glutathion qui ne passait pas la barrière hématoméningée. Eh bien une nouvelle recherche vient d'être publiée il y a 13 secondes décrivant une toute nouvelle approche, une nouvelle façon d'assimiler le gluthation. Lassez-moi vous en faire un résumé."

Twenty years from now, we'll have nanobots, because another exponential trend is the shrinking of technology. They'll go into our brain through the capillaries and basically connect our neocortex to a synthetic neocortex in the cloud providing an extension of our neocortex. Now today, I mean, you have a computer in your phone, but if you need 10,000 computers for a few seconds to do a complex search, you can access that for a second or two in the cloud. In the 2030s, if you need some extra neocortex, you'll be able to connect to that in the cloud directly from your brain. So I'm walking along and I say, "Oh, there's Chris Anderson. He's coming my way. I'd better think of something clever to say. I've got three seconds. My 300 million modules in my neocortex isn't going to cut it. I need a billion more." I'll be able to access that in the cloud. And our thinking, then, will be a hybrid of biological and non-biological thinking, but the non-biological portion is subject to my law of accelerating returns. It will grow exponentially. And remember what happens the last time we expanded our neocortex? That was two million years ago when we became humanoids and developed these large foreheads. Other primates have a slanted brow. They don't have the frontal cortex. But the frontal cortex is not really qualitatively different. It's a quantitative expansion of neocortex, but that additional quantity of thinking was the enabling factor for us to take a qualitative leap and invent language and art and science and technology and TED conferences. No other species has done that.

D'ici 20 ans, nous aurons des nano-robots, car une des nouvelles tendances à forte évolution est la miniaturisation de la technologie. Ils entreront dans notre cerveau à travers nos vaisseaux capillaires et connecteront simplement notre néocortex à un néocortex synthétique dans le cloud, nous en fournissant ainsi une extension. A l'heure actuelle, vous avez un ordinateur dans votre téléphone, mais si vous avez besoin de 10 000 ordinateurs pour quelques secondes pour faire une recherche complexe, vous pouvez y avoir accès dans le cloud. Dans les années 2030, si vous avez besoin d'une extension de néocortex, vous pourrez vous y connecter via le cloud directement depuis votre cerveau. Imaginons que je me balade et je me dis, « Oh, je vais croiser Chris Anderson, il vient vers moi. Il faut que je trouve quelque chose d'intelligent à dire... J'ai trois secondes pour ça. Les 300 millions de modules de mon néocortex ne seront pas suffisants. J'en ai besoin d'un milliard de plus. » Je serai alors capable d'y accéder via le cloud. Alors nous disposerons d'un système de pensée hybride fonctionnant sur des composants biologiques et non biologiques, mais la partie non-biologique est sujette à ma loi du retour accéléré. Elle va grandir de manière exponentielle. Souvenez-vous alors ce qu'il s'est passé il y a deux millions d'années la dernière fois que nous avons agrandi notre néocortex, lorsque nous sommes devenus des humanoïdes et reçu ce grand front. Les autres primates ont des sourcils inclinés. Ils n'ont pas de cortex frontal. Mais le cortex frontal n'est pas vraiment différent qualitativement parlant. C'est une expansion en taille du néocortex, mais cette quantité additionnelle de capacité de réflexion nous a permis alors de prendre une longueur d'avance et de créer le langage ainsi que l'art et la technologie et les conférences TED. Aucune autre espèce n'a fait ça.

And so, over the next few decades, we're going to do it again. We're going to again expand our neocortex, only this time we won't be limited by a fixed architecture of enclosure. It'll be expanded without limit. That additional quantity will again be the enabling factor for another qualitative leap in culture and technology.

Par conséquent, au cours des prochaines décénnies, nous allons répéter ça. Nous allons à nouveau agrandir notre néocortex, seulement cette fois, nous ne serons pas limités à un contenu fixe. Il pourra grossir sans limite. Cette quantité additionnelle sera à nouveau le facteur nous permettant un gigantesque progrès dans les domaines de la culture et de la technologie.

Thank you very much.

Merci beaucoup.

(Applause)

(Applaudissements)