Our emotions influence every aspect of our lives, from our health and how we learn, to how we do business and make decisions, big ones and small. Our emotions also influence how we connect with one another. We've evolved to live in a world like this, but instead, we're living more and more of our lives like this -- this is the text message from my daughter last night -- in a world that's devoid of emotion. So I'm on a mission to change that. I want to bring emotions back into our digital experiences.

Nossos sentimentos influenciam todos os aspectos de nossas vidas, desde nossa saúde e aprendizado até como fazemos negócios e decisões, grandes ou pequenas. Nossos sentimentos também influenciam como nos conectamos. Nós evoluímos para viver num mundo como esse, mas em vez disso, cada vez mais vivemos nossas vidas assim; esta mensagem da minha filha ontem à noite; em um mundo desprovido de sentimentos. Eu estou numa missão para mudar isso. Quero recolocar os sentimentos em nossas vidas digitais.

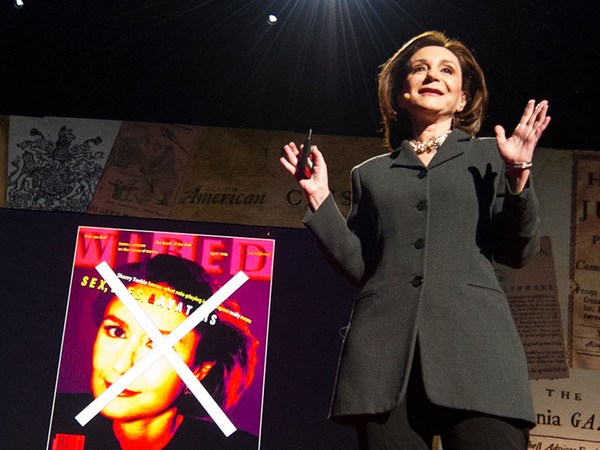

I started on this path 15 years ago. I was a computer scientist in Egypt, and I had just gotten accepted to a Ph.D. program at Cambridge University. So I did something quite unusual for a young newlywed Muslim Egyptian wife: With the support of my husband, who had to stay in Egypt, I packed my bags and I moved to England. At Cambridge, thousands of miles away from home, I realized I was spending more hours with my laptop than I did with any other human. Yet despite this intimacy, my laptop had absolutely no idea how I was feeling. It had no idea if I was happy, having a bad day, or stressed, confused, and so that got frustrating. Even worse, as I communicated online with my family back home, I felt that all my emotions disappeared in cyberspace. I was homesick, I was lonely, and on some days I was actually crying, but all I had to communicate these emotions was this. (Laughter) Today's technology has lots of I.Q., but no E.Q.; lots of cognitive intelligence, but no emotional intelligence. So that got me thinking, what if our technology could sense our emotions? What if our devices could sense how we felt and reacted accordingly, just the way an emotionally intelligent friend would? Those questions led me and my team to create technologies that can read and respond to our emotions, and our starting point was the human face.

Eu comecei essa jornada há 15 anos. Eu era cientista da computação no Egito, e tinha acabado de ser aceita em um Ph.D. na Universidade de Cambridge. Então fiz algo bem inusitado para uma jovem esposa egípcia muçulmana recém-casada: (Risos) Com o apoio de meu marido, que teve que ficar no Egito, eu arrumei minhas malas e me mudei para a Inglaterra. Em Cambridge, milhares de quilômetros longe de casa, eu percebi que passava mais tempo com meu laptop do que com qualquer outro ser humano. E apesar desta intimidade, meu laptop não tinha a menor ideia de como eu me sentia. Não tinha ideia se eu estava feliz, se num dia ruim, estressada, confusa, e isso acabou ficando frustrante. Pior ainda, enquanto eu me comunicava online com a minha família em casa, eu sentia que todos os meus sentimentos desapareciam no cyberespaço. Eu sentia saudades, estava sozinha, e alguns até mesmo chorava, mas tudo que eu tinha para expressar esses sentimentos era isto. (Risos) A tecnologia atual tem muito QI, mas nenhum QE; muita inteligência cognitiva, mas nenhuma inteligência emocional. E isso me fez pensar, e se nossa tecnologia pudesse perceber nossos sentimentos? E se nossos dispositivos pudessem perceber como nos sentimos e reagissem de acordo, como um amigo emocionalmente inteligente faria? Essas questões fizeram com que eu e minha equipe criássemos tecnologias que pudessem ler e reagir aos nossos sentimentos, e nosso ponto de partida foi o rosto humano.

So our human face happens to be one of the most powerful channels that we all use to communicate social and emotional states, everything from enjoyment, surprise, empathy and curiosity. In emotion science, we call each facial muscle movement an action unit. So for example, action unit 12, it's not a Hollywood blockbuster, it is actually a lip corner pull, which is the main component of a smile. Try it everybody. Let's get some smiles going on. Another example is action unit 4. It's the brow furrow. It's when you draw your eyebrows together and you create all these textures and wrinkles. We don't like them, but it's a strong indicator of a negative emotion. So we have about 45 of these action units, and they combine to express hundreds of emotions.

Nosso rosto humano é um dos canais mais poderosos que todos nós usamos para comunicar estados sociais e emocionais, tudo desde alegria, surpresa, empatia e curiosidade. Na ciência dos sentimentos, nós chamamos cada movimento muscular facial de unidade de ação. Por exemplo, unidade de ação 12, não é um filme de Holywood, é sim uma fisgada no canto dos lábios, que é o principal componente de um sorriso. Tentem vocês. Vamos mostrar alguns sorrisos. Outro exemplo é a unidade de ação 4. Que é a testa franzida. É quando você junta as sobrancelhas e cria todas estas texturas e dobras. Não gostamos disso, mas é um forte indicador de um sentimento negativo. Temos cerca de 45 dessas unidades de ação, e elas se combinam para expressar centenas de sentimentos.

Teaching a computer to read these facial emotions is hard, because these action units, they can be fast, they're subtle, and they combine in many different ways. So take, for example, the smile and the smirk. They look somewhat similar, but they mean very different things. (Laughter) So the smile is positive, a smirk is often negative. Sometimes a smirk can make you become famous. But seriously, it's important for a computer to be able to tell the difference between the two expressions.

Ensinar um computador a ler essas emoções faciais é difícil, porque essas unidades de ação podem ser rápidas, elas são sutis, e se combinam de várias maneiras diferentes. Então peguem, por exemplo, o sorriso genuíno e o malicioso. Eles se parecem de certa maneira, mas querem dizer coisas bem diferentes. (Risos) O sorriso genuíno é positivo, o malicioso normalmente é negativo. Às vezes um sorriso malicioso pode torná-lo famoso. Mas falando sério, é importante que um computador consiga diferenciar essas duas expressões.

So how do we do that? We give our algorithms tens of thousands of examples of people we know to be smiling, from different ethnicities, ages, genders, and we do the same for smirks. And then, using deep learning, the algorithm looks for all these textures and wrinkles and shape changes on our face, and basically learns that all smiles have common characteristics, all smirks have subtly different characteristics. And the next time it sees a new face, it essentially learns that this face has the same characteristics of a smile, and it says, "Aha, I recognize this. This is a smile expression."

Então, como fazemos? Nós damos ao nosso algoritmo dezenas de milhares de exemplos de pessoas que sabemos que estão sorrindo, de diferentes etnias, idades e gêneros, e fazemos o mesmo para sorrisos maliciosos. E assim, usando aprendizagem profunda, o algoritmo busca todas essas texturas e dobras e mudanças de forma em nosso rosto e aprende que todos os sorrisos genuínos têm características em comum, todos os sorrisos maliciosos têm características sutilmente diferentes. E da próxima vez que ele vir um novo rosto, ele aprende que esse rosto tem as mesmas características de um sorriso genuíno, Ele pensa: "Aha, este eu reconheço. É uma expressão de sorriso genuíno."

So the best way to demonstrate how this technology works is to try a live demo, so I need a volunteer, preferably somebody with a face. (Laughter) Cloe's going to be our volunteer today.

E a melhor maneira de mostrar que essa tecnologia funciona é fazer uma demonstração ao vivo, então vou precisar de um voluntário, de preferência alguém com um rosto. (Risos) A Cloe vai ser nossa voluntária hoje.

So over the past five years, we've moved from being a research project at MIT to a company, where my team has worked really hard to make this technology work, as we like to say, in the wild. And we've also shrunk it so that the core emotion engine works on any mobile device with a camera, like this iPad. So let's give this a try.

Durante os últimos cinco anos, nós passamos de um projeto de pesquisa no MIT para uma empresa, na qual minha equipe trabalhou duro para fazer essa tecnologia funcionar, como gostamos de dizer, no meio selvagem. E nós também a minimizamos para que o mecanismo central de sentimentos funcione em qualquer dispositivo móvel, como este iPad. Então vamos testar.

As you can see, the algorithm has essentially found Cloe's face, so it's this white bounding box, and it's tracking the main feature points on her face, so her eyebrows, her eyes, her mouth and her nose. The question is, can it recognize her expression? So we're going to test the machine. So first of all, give me your poker face. Yep, awesome. (Laughter) And then as she smiles, this is a genuine smile, it's great. So you can see the green bar go up as she smiles. Now that was a big smile. Can you try a subtle smile to see if the computer can recognize? It does recognize subtle smiles as well. We've worked really hard to make that happen. And then eyebrow raised, indicator of surprise. Brow furrow, which is an indicator of confusion. Frown. Yes, perfect. So these are all the different action units. There's many more of them. This is just a slimmed-down demo. But we call each reading an emotion data point, and then they can fire together to portray different emotions. So on the right side of the demo -- look like you're happy. So that's joy. Joy fires up. And then give me a disgust face. Try to remember what it was like when Zayn left One Direction. (Laughter) Yeah, wrinkle your nose. Awesome. And the valence is actually quite negative, so you must have been a big fan. So valence is how positive or negative an experience is, and engagement is how expressive she is as well. So imagine if Cloe had access to this real-time emotion stream, and she could share it with anybody she wanted to. Thank you. (Applause)

Como podem ver, o algoritmo essencialmente encontrou o rosto da Cloe, é essa caixa branca delimitadora, e está acompanhando os pontos característicos em seu rosto, as sobrancelhas, olhos, boca, e nariz. A questão é: será que consegue reconhecer sua expressão? Vamos testar a máquina. Primeiro, faça uma cara de blefe. Isso, ótimo! (Risos) E à medida que ela sorri, esse sorriso é genuíno, muito bom. Podemos ver a barra verde aumentar enquanto ela sorri. Foi um grande sorriso. Pode tentar um sorriso sutil para ver se o computador reconhece? Também reconhece sorrisos sutis. Trabalhamos muito que isso acontecesse. As sobrancelhas levantadas, o que indica surpresa. Testa franzida, o que indica confusão. Cara fechada. Isso, perfeito. Essas são as diferentes unidades de ação. Há muitas outras. Esta é só uma curta demonstração. Mas cada leitura é chamada de ponto de dados de sentimento, e eles podem ser ativados ao mesmo tempo para retratar diferentes sentimentos. Do lado direito da demonstração... Parece que você está feliz. Isto é alegria. A alegria acende. E faça uma cara de nojo. Tente se lembrar como foi quando Zayn saiu do One Direction. (Risos) Isso, torça o nariz. Ótimo. E a valência é bastante negativa, você deve ser uma grande fã. Valência é quão positiva ou negativa é uma sensação, e engajamento indica a expressividade também. Imaginem se a Cloe tivesse acesso a esse fluxo de sentimentos em tempo real, e pudesse compartilhar com quem ela quisesse. Obrigada. (Aplausos)

So, so far, we have amassed 12 billion of these emotion data points. It's the largest emotion database in the world. We've collected it from 2.9 million face videos, people who have agreed to share their emotions with us, and from 75 countries around the world. It's growing every day. It blows my mind away that we can now quantify something as personal as our emotions, and we can do it at this scale.

Até agora já acumulamos 12 bilhões de pontos de dados de sentimentos. É o maior banco de dados de sentimentos do mundo. Nós os conseguimos de 2,9 milhões de vídeos de rostos, pessoas que aceitaram compartilhar seus sentimentos conosco, e de 75 países por todo o mundo. Está crescendo a cada dia. Me deixa sem palavras que agora podemos quantificar algo tão pessoal como nossos sentimentos, e podemos fazê-lo nessa escala.

So what have we learned to date? Gender. Our data confirms something that you might suspect. Women are more expressive than men. Not only do they smile more, their smiles last longer, and we can now really quantify what it is that men and women respond to differently. Let's do culture: So in the United States, women are 40 percent more expressive than men, but curiously, we don't see any difference in the U.K. between men and women. (Laughter) Age: People who are 50 years and older are 25 percent more emotive than younger people. Women in their 20s smile a lot more than men the same age, perhaps a necessity for dating. But perhaps what surprised us the most about this data is that we happen to be expressive all the time, even when we are sitting in front of our devices alone, and it's not just when we're watching cat videos on Facebook. We are expressive when we're emailing, texting, shopping online, or even doing our taxes.

E o que já aprendemos? Gênero. Nossos dados confirmam uma coisa que talvez vocês suspeitem. Mulheres são mais expressivas que homens. Elas não só sorriem mais, seus sorrisos duram mais, e agora conseguimos quantificar o que faz com que homens e mulheres reajam de maneira diferente. Vamos falar de cultura: nos Estados Unidos, as mulheres são 40% mais expressivas que os homens, mas curiosamente não vemos nenhuma diferença no Reino Unido entre homens e mulheres. (Risos) Idade: pessoas com 50 anos ou mais são 25% mais emotivas do que os mais jovens. Mulheres na casa dos 20 sorriem muito mais do que homens com a mesma idade, talvez uma necessidade para namorar. Mas talvez o que mais nos surpreendeu nesses dados é que somos expressivos o tempo todo, mesmo quando estamos sozinhos com nossos dispositivos, e não é só quando estamos assistindo vídeos de gatos no Facebook. Somos expressivos quando escrevemos e-mails, mensagens, fazemos compras, ou até mesmo declarando os impostos.

Where is this data used today? In understanding how we engage with media, so understanding virality and voting behavior; and also empowering or emotion-enabling technology, and I want to share some examples that are especially close to my heart. Emotion-enabled wearable glasses can help individuals who are visually impaired read the faces of others, and it can help individuals on the autism spectrum interpret emotion, something that they really struggle with. In education, imagine if your learning apps sense that you're confused and slow down, or that you're bored, so it's sped up, just like a great teacher would in a classroom. What if your wristwatch tracked your mood, or your car sensed that you're tired, or perhaps your fridge knows that you're stressed, so it auto-locks to prevent you from binge eating. (Laughter) I would like that, yeah. What if, when I was in Cambridge, I had access to my real-time emotion stream, and I could share that with my family back home in a very natural way, just like I would've if we were all in the same room together?

Onde esses dados são usados hoje? Para entender como interagimos com a mídia, entender viralidade e comportamento de votação; e também capacitar e incluir sentimentos na tecnologia, e eu gostaria de mostrar alguns dos meus exemplos preferidos. Óculos que conseguem ler sentimentos podem ajudar pessoas com deficiência visual a ler os rostos dos outros e pode ajudar pessoas no espectro do autismo a interpretar sentimentos, algo com que têm muita dificuldade. Na educação, imagine se seus aplicativos de ensino perceberem que você está confuso e desacelerarem, ou que você está entediado e acelerarem, assim como faria um bom professor em sala de aula. E se seu relógio de pulso acompanhasse seu humor ou seu carro percebesse que você está cansado, ou talvez sua geladeira saiba que você está estressada, e se tranca sozinha para que você não coma demais. (Risos) Eu gostaria disso, sim. E se, quando eu estava em Cambridge, eu tivesse acesso ao meu fluxo de sentimentos em tempo real, e pudesse compartilhá-lo com a minha família em casa de maneira natural,

I think five years down the line,

assim como eu faria se estivéssemos todos juntos na sala?

all our devices are going to have an emotion chip, and we won't remember what it was like when we couldn't just frown at our device and our device would say, "Hmm, you didn't like that, did you?" Our biggest challenge is that there are so many applications of this technology, my team and I realize that we can't build them all ourselves, so we've made this technology available so that other developers can get building and get creative. We recognize that there are potential risks and potential for abuse, but personally, having spent many years doing this, I believe that the benefits to humanity from having emotionally intelligent technology far outweigh the potential for misuse. And I invite you all to be part of the conversation. The more people who know about this technology, the more we can all have a voice in how it's being used. So as more and more of our lives become digital, we are fighting a losing battle trying to curb our usage of devices in order to reclaim our emotions. So what I'm trying to do instead is to bring emotions into our technology and make our technologies more responsive. So I want those devices that have separated us to bring us back together. And by humanizing technology, we have this golden opportunity to reimagine how we connect with machines, and therefore, how we, as human beings, connect with one another.

Acredito que daqui a cinco anos, todos os nossos dispositivos vão ter um chip de sentimentos, e nem vamos nos lembrar como era quando não adiantava fazer cara feia para o dispositivo e ele diria: "Hm, você não gostou disso, né?" Nosso maior desafio é que há tantas aplicações para essa tecnologia, que minha equipe percebeu que não podemos satisfazê-las sozinhos, então nós disponibilizamos essa tecnologia a outros desenvolvedores para que construam e usem a criatividade. Nós reconhecemos que há potenciais riscos e potencial para abuso, mas pessoalmente, após muitos anos fazendo isso, acredito que os benefícios à humanidade de ter tecnologia emocionalmente inteligente superam de longe o potencial de abuso. E eu os convido todos a participarem da conversa. Quanto mais pessoas conhecerem essa tecnologia, mais peso terá nossa opinião sobre como usá-la. E à medida que nossas vidas vão se digitalizando, nós lutamos uma batalha perdida tentando frear nosso uso de dispositivos para reivindicar nossos sentimentos. Então o que estou tentando fazer é colocar sentimentos na tecnologia e tornar nossa tecnologia mais responsiva. Eu quero que esses dispositivos que nos separaram juntem-nos novamente. E humanizando a tecnologia, nós temos essa oportunidade de ouro de reimaginar nossa conexão com as máquinas, e assim, como nós, seres humanos, nos conectamos uns com os outros.

Thank you.

Obrigada.

(Applause)

(Aplausos)