Our emotions influence every aspect of our lives, from our health and how we learn, to how we do business and make decisions, big ones and small. Our emotions also influence how we connect with one another. We've evolved to live in a world like this, but instead, we're living more and more of our lives like this -- this is the text message from my daughter last night -- in a world that's devoid of emotion. So I'm on a mission to change that. I want to bring emotions back into our digital experiences.

Onze emoties beïnvloeden alle aspecten van ons leven, van onze gezondheid en hoe we leren, tot hoe we zakendoen en beslissingen nemen, grote en kleine. Onze emoties hebben ook invloed op hoe we met elkaar omgaan. We zijn geëvolueerd om te leven in een wereld die er zo uitziet, maar in plaats daarvan leven we ons leven steeds vaker zo -- dit is het berichtje dat mijn dochter gisteravond stuurde -- in een wereld zonder emotie. Mijn missie is om dat te veranderen. Ik wil emoties terugbrengen in onze digitale ervaringen.

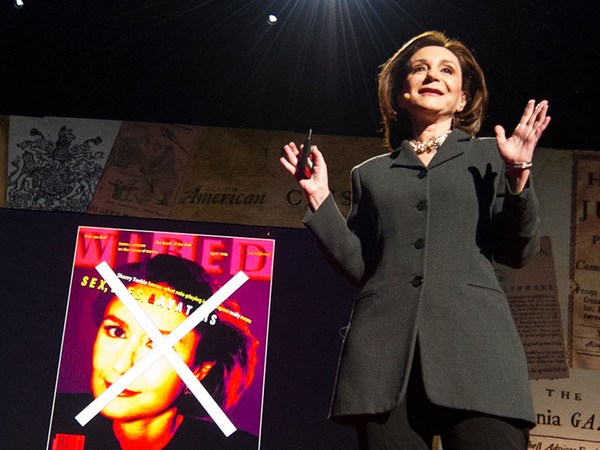

I started on this path 15 years ago. I was a computer scientist in Egypt, and I had just gotten accepted to a Ph.D. program at Cambridge University. So I did something quite unusual for a young newlywed Muslim Egyptian wife: With the support of my husband, who had to stay in Egypt, I packed my bags and I moved to England. At Cambridge, thousands of miles away from home, I realized I was spending more hours with my laptop than I did with any other human. Yet despite this intimacy, my laptop had absolutely no idea how I was feeling. It had no idea if I was happy, having a bad day, or stressed, confused, and so that got frustrating. Even worse, as I communicated online with my family back home, I felt that all my emotions disappeared in cyberspace. I was homesick, I was lonely, and on some days I was actually crying, but all I had to communicate these emotions was this. (Laughter) Today's technology has lots of I.Q., but no E.Q.; lots of cognitive intelligence, but no emotional intelligence. So that got me thinking, what if our technology could sense our emotions? What if our devices could sense how we felt and reacted accordingly, just the way an emotionally intelligent friend would? Those questions led me and my team to create technologies that can read and respond to our emotions, and our starting point was the human face.

15 jaar geleden ben ik hiermee begonnen. Ik was computerwetenschapper in Egypte, en ik was net toegelaten tot een PhD-programma in Cambridge. Ik deed iets behoorlijk ongewoons voor een jonge, pasgetrouwde Egyptische moslima. (Gelach) Met de steun van mijn man, die in Egypte moest blijven, pakte ik mijn koffers en verhuisde ik naar Engeland. Daar in Cambridge, duizenden kilometers van huis, besefte ik dat ik meer uren met mijn laptop doorbracht dan met andere mensen. Ondanks deze vertrouwdheid had mijn laptop geen flauw idee hoe ik me voelde. Hij wist totaal niet of ik blij was, een slechte dag had, gestrest of verward was, en dat werd frustrerend. Erger nog, bij het online communiceren met mijn familie thuis had ik het gevoel dat al mijn emoties verdwenen in de cyberspace. Ik had heimwee, ik was eenzaam, op sommige dagen zat ik echt te huilen, maar het enige wat ik had om deze emoties over te brengen was dit. (Gelach) De technologie van vandaag heeft veel IQ, maar geen EQ: veel cognitieve intelligentie, maar geen emotionele intelligentie. Dat zette me aan het denken. Wat als onze technologie onze emoties kon waarnemen? Wat als onze apparaten konden aanvoelen hoe we ons voelden en daarop reageerden, zoals emotioneel intelligente vrienden dat ook zouden doen? Die vragen zetten mij en mijn team ertoe aan technologieën te maken die onze emoties kunnen lezen en erop reageren en ons uitgangspunt was het menselijk gezicht.

So our human face happens to be one of the most powerful channels that we all use to communicate social and emotional states, everything from enjoyment, surprise, empathy and curiosity. In emotion science, we call each facial muscle movement an action unit. So for example, action unit 12, it's not a Hollywood blockbuster, it is actually a lip corner pull, which is the main component of a smile. Try it everybody. Let's get some smiles going on. Another example is action unit 4. It's the brow furrow. It's when you draw your eyebrows together and you create all these textures and wrinkles. We don't like them, but it's a strong indicator of a negative emotion. So we have about 45 of these action units, and they combine to express hundreds of emotions.

Het menselijk gezicht is een van de sterkste kanalen waarmee we onze sociale en emotionele toestand overbrengen. Alles van vreugde tot verrassing, empathie en nieuwsgierigheid. In de emotiewetenschap noemen we elke beweging van de gelaatsspieren een actie-eenheid. Actie-eenheid 12 bijvoorbeeld, dat is geen blockbuster uit Hollywood, maar het optrekken van de mondhoeken, het hoofdonderdeel van een glimlach. Laten we dat allemaal even proberen. Een ander voorbeeld is actie-eenheid 4, de wenkbrauwfrons: als je je wenkbrauwen tegen elkaar duwt en allemaal rimpels maakt. We vinden ze niet leuk, maar ze zijn een goed signaal voor een negatieve emotie. We hebben ongeveer 45 van die actie-eenheden en samen drukken ze honderden emoties uit.

Teaching a computer to read these facial emotions is hard, because these action units, they can be fast, they're subtle, and they combine in many different ways. So take, for example, the smile and the smirk. They look somewhat similar, but they mean very different things. (Laughter) So the smile is positive, a smirk is often negative. Sometimes a smirk can make you become famous. But seriously, it's important for a computer to be able to tell the difference between the two expressions.

Het is moeilijk om een computer te leren om deze gelaatsuitdrukkingen te lezen, want deze actie-eenheden kunnen snel zijn, ze zijn subtiel, en ze komen voor in allerlei combinaties. Neem bijvoorbeeld een glimlach en een minachtende blik. Ze lijken een beetje op elkaar, maar ze betekenen iets heel anders. (Gelach) De een is positief, de ander vaak negatief. Soms kun je er beroemd door worden. Maar het is belangrijk dat een computer het verschil kan zien tussen de twee gelaatsexpressies.

So how do we do that? We give our algorithms tens of thousands of examples of people we know to be smiling, from different ethnicities, ages, genders, and we do the same for smirks. And then, using deep learning, the algorithm looks for all these textures and wrinkles and shape changes on our face, and basically learns that all smiles have common characteristics, all smirks have subtly different characteristics. And the next time it sees a new face, it essentially learns that this face has the same characteristics of a smile, and it says, "Aha, I recognize this. This is a smile expression."

Hoe doen we dat? We geven onze algoritmen tienduizenden voorbeelden van mensen waarvan we weten dat ze glimlachen, van verschillende etniciteiten, leeftijden, geslachten, en dan doen we hetzelfde voor de andere uitdrukking. Door middel van deep learning zoekt het algoritme naar alle structuren en rimpels en vormveranderingen in ons gezicht. Zo leert het dat alle glimlachen gemeenschappelijke eigenschappen hebben die subtiel verschillen van minachtende uitdrukkingen. De volgende keer dat het een nieuw gezicht ziet leert het dat dit gezicht ook de eigenschappen van een glimlach heeft en zegt het: "Aha, dit herken ik. Deze uitdrukking is een glimlach."

So the best way to demonstrate how this technology works is to try a live demo, so I need a volunteer, preferably somebody with a face. (Laughter) Cloe's going to be our volunteer today.

De beste manier om te laten zien hoe deze technologie werkt is een live-demonstratie, dus ik heb een vrijwilliger nodig, liefst iemand met een gezicht. (Gelach) Cloe is vandaag onze vrijwilliger.

So over the past five years, we've moved from being a research project at MIT to a company, where my team has worked really hard to make this technology work, as we like to say, in the wild. And we've also shrunk it so that the core emotion engine works on any mobile device with a camera, like this iPad. So let's give this a try.

In de afgelopen vijf jaar zijn we van een onderzoeksproject bij MIT overgegaan in een bedrijf, waar mijn team keihard heeft gewerkt om deze technologie te laten werken, zoals wij dat zeggen, in het wild. We hebben hem ook kleiner gemaakt zodat de emotiemachine werkt op elk mobiel apparaat met een camera, zoals deze iPad. Laten we het eens proberen.

As you can see, the algorithm has essentially found Cloe's face, so it's this white bounding box, and it's tracking the main feature points on her face, so her eyebrows, her eyes, her mouth and her nose. The question is, can it recognize her expression? So we're going to test the machine. So first of all, give me your poker face. Yep, awesome. (Laughter) And then as she smiles, this is a genuine smile, it's great. So you can see the green bar go up as she smiles. Now that was a big smile. Can you try a subtle smile to see if the computer can recognize? It does recognize subtle smiles as well. We've worked really hard to make that happen. And then eyebrow raised, indicator of surprise. Brow furrow, which is an indicator of confusion. Frown. Yes, perfect. So these are all the different action units. There's many more of them. This is just a slimmed-down demo. But we call each reading an emotion data point, and then they can fire together to portray different emotions. So on the right side of the demo -- look like you're happy. So that's joy. Joy fires up. And then give me a disgust face. Try to remember what it was like when Zayn left One Direction. (Laughter) Yeah, wrinkle your nose. Awesome. And the valence is actually quite negative, so you must have been a big fan. So valence is how positive or negative an experience is, and engagement is how expressive she is as well. So imagine if Cloe had access to this real-time emotion stream, and she could share it with anybody she wanted to. Thank you. (Applause)

Zoals je ziet heeft het algoritme Cloe's gezicht gevonden, dat is die witte rechthoek, en het volgt de belangrijkste punten van haar gezicht, dus de wenkbrauwen, ogen, mond en neus. De vraag is: kan het haar uitdrukking herkennen? We gaan de machine testen. Laat eerst eens je pokerface zien. Ja, goed zo. (Gelach) En terwijl ze glimlacht, dit is een oprechte glimlach, zie je de groene balken omhooggaan. Dat was een brede glimlach. Kun je proberen of de computer ook een subtiele glimlach herkent? De subtiele glimlach herkent hij ook. Daar hebben we hard aan gewerkt. En dan je wenkbrauwen omhoog, een teken van verrassing. Wenkbrauwen fronsen, een teken van verwarring. Boos kijken. Ja, perfect. Dit zijn verschillende actie-eenheden. Er zijn er nog veel meer. Dit is maar een beperkte demo. We noemen elke meting een emotiegegevenspunt, en in combinatie kunnen ze verschillende emoties weergeven. Aan de rechterkant van de demo -- trek eens een vrolijk gezicht. Dat is vreugde. Vreugde gaat aan. Laat nu eens afkeer zien. Denk aan hoe je je voelde toen Zayn wegging bij One Direction. (Gelach) Ja, maak rimpels bij je neus. Goed zo. De valentie is behoorlijk negatief, dus je was vast een groot fan. Valentie is hoe positief of negatief een ervaring is, en betrokkenheid is hoe expressief ze is. Stel je voor dat Cloe toegang had tot deze rechtstreekse emotiestream en ze die kon delen met we ze maar wilde. Dankjewel. (Applaus)

So, so far, we have amassed 12 billion of these emotion data points. It's the largest emotion database in the world. We've collected it from 2.9 million face videos, people who have agreed to share their emotions with us, and from 75 countries around the world. It's growing every day. It blows my mind away that we can now quantify something as personal as our emotions, and we can do it at this scale.

Tot nu toe hebben we 12 miljard van deze emotiegegevens vergaard. Het is de grootste emotiedatabase ter wereld. We hebben hem verzameld uit 2,9 miljoen filmpjes van gezichten, mensen die hun emoties met ons hebben willen delen, uit 75 landen over de hele wereld. Hij groeit elke dag. Ik sta ervan versteld dat we iets persoonlijks als emoties nu kunnen kwantificeren en dat we het op deze schaal kunnen doen.

So what have we learned to date? Gender. Our data confirms something that you might suspect. Women are more expressive than men. Not only do they smile more, their smiles last longer, and we can now really quantify what it is that men and women respond to differently. Let's do culture: So in the United States, women are 40 percent more expressive than men, but curiously, we don't see any difference in the U.K. between men and women. (Laughter) Age: People who are 50 years and older are 25 percent more emotive than younger people. Women in their 20s smile a lot more than men the same age, perhaps a necessity for dating. But perhaps what surprised us the most about this data is that we happen to be expressive all the time, even when we are sitting in front of our devices alone, and it's not just when we're watching cat videos on Facebook. We are expressive when we're emailing, texting, shopping online, or even doing our taxes.

Wat hebben we tot nu toe geleerd? Geslacht: onze data bevestigen iets dat je misschien al vermoedde. Vrouwen zijn expressiever dan mannen. Ze glimlachen niet alleen meer, maar ook langduriger, en we kunnen nu echt vaststellen wat het precies is waarop mannen en vrouwen anders reageren. Nu cultuur: in de Verenigde Staten zijn vrouwen 40 procent expressiever dan mannen, maar vreemd genoeg zien we in het VK geen verschil tussen mannen en vrouwen. (Gelach) Leeftijd: mensen van 50 jaar en ouder tonen 25 procent meer emotie dan jongere mensen. Vrouwen in de twintig glimlachen veel meer dan mannen van dezelfde leeftijd, misschien moet dat wel tijdens dates. Maar wat ons misschien het meest heeft verrast is dat we altijd expressief zijn, zelfs als we alleen achter een apparaat zitten, en niet alleen als we kattenfilmpjes kijken op Facebook. We zijn expressief als we emailen, sms'en, online winkelen en zelfs als we onze belastingaangifte doen.

Where is this data used today? In understanding how we engage with media, so understanding virality and voting behavior; and also empowering or emotion-enabling technology, and I want to share some examples that are especially close to my heart. Emotion-enabled wearable glasses can help individuals who are visually impaired read the faces of others, and it can help individuals on the autism spectrum interpret emotion, something that they really struggle with. In education, imagine if your learning apps sense that you're confused and slow down, or that you're bored, so it's sped up, just like a great teacher would in a classroom. What if your wristwatch tracked your mood, or your car sensed that you're tired, or perhaps your fridge knows that you're stressed, so it auto-locks to prevent you from binge eating. (Laughter) I would like that, yeah. What if, when I was in Cambridge, I had access to my real-time emotion stream, and I could share that with my family back home in a very natural way, just like I would've if we were all in the same room together?

Waar worden deze data momenteel gebruikt? Bij het begrijpen van hoe we met media omgaan, het begrijpen van viraliteit en stemgedrag, en ook voor technologie die emoties toegankelijker maakt. Ik wil een paar voorbeelden delen die me bijzonder nauw aan het hart liggen. Brillen met emotietechnologie kunnen mensen met een visuele handicap helpen om de gezichten van anderen te lezen, en mensen binnen het autismespectrum helpen om emoties te interpreteren, iets waar ze echt moeite mee hebben. In het onderwijs: stel je voor dat je studeer-apps aanvoelen wat je niet begrijpt en het tempo verlagen, of dat je je verveelt, en dus sneller gaan, net als een goede leraar op school. Wat als je horloge je stemming bijhield of je auto kon merken dat je moe was, of je koelkast het wist als je gestrest was, en automatisch op slot ging zodat je niet te veel kon eten. (Gelach) Dat zou ik wel willen, ja. Wat als ik in Cambridge toegang had gehad tot mijn emotiestream en die had kunnen delen met mijn familie thuis op een heel natuurlijke manier,

I think five years down the line,

alsof we samen in één kamer zaten?

all our devices are going to have an emotion chip, and we won't remember what it was like when we couldn't just frown at our device and our device would say, "Hmm, you didn't like that, did you?" Our biggest challenge is that there are so many applications of this technology, my team and I realize that we can't build them all ourselves, so we've made this technology available so that other developers can get building and get creative. We recognize that there are potential risks and potential for abuse, but personally, having spent many years doing this, I believe that the benefits to humanity from having emotionally intelligent technology far outweigh the potential for misuse. And I invite you all to be part of the conversation. The more people who know about this technology, the more we can all have a voice in how it's being used. So as more and more of our lives become digital, we are fighting a losing battle trying to curb our usage of devices in order to reclaim our emotions. So what I'm trying to do instead is to bring emotions into our technology and make our technologies more responsive. So I want those devices that have separated us to bring us back together. And by humanizing technology, we have this golden opportunity to reimagine how we connect with machines, and therefore, how we, as human beings, connect with one another.

Ik denk dat over vijf jaar al onze apparaten een emotie-chip zullen hebben en we niet meer weten hoe het was om naar je apparaat te fronsen zonder dat het terugzei: "Hmm, dat vond je blijkbaar niet leuk." De grootste uitdaging van deze technologie is dat er zoveel toepassingen zijn, dat mijn team en ik ze niet allemaal zelf kunnen bouwen. Daarom hebben we de technologie beschikbaar gemaakt zodat andere ontwikkelaars er creatief mee aan de slag kunnen. We zien in dat er potentiële risico's zijn en de mogelijkheid dat er misbruik van wordt gemaakt, maar nu ik hier vele jaren mee bezig ben geweest geloof ik persoonlijk dat de voordelen voor de mensheid van emotioneel intelligente technologie veel zwaarder wegen dan het mogelijke misbruik. Ik nodig jullie allemaal uit deel te nemen aan het gesprek. Hoe meer mensen van deze technologie afweten, hoe meer we allemaal inspraak hebben in hoe het wordt gebruikt. Nu ons leven steeds digitaler wordt, voeren we een hopeloze strijd als we ons gebruik van apparaten proberen te beperken om zo onze emoties terug te winnen. In plaats daarvan probeer ik emoties in onze technologie op te nemen en onze technologieën beter te laten reageren. Ik wil dat de apparaten die ons hebben gescheiden ons weer bij elkaar brengen. Door technologie te vermenselijken hebben we een gouden kans om opnieuw te bedenken hoe we met onze machines omgaan en daarmee ook hoe wij, als mensen, omgaan met elkaar.

Thank you.

Dankjewel.

(Applause)

(Applaus)