Our emotions influence every aspect of our lives, from our health and how we learn, to how we do business and make decisions, big ones and small. Our emotions also influence how we connect with one another. We've evolved to live in a world like this, but instead, we're living more and more of our lives like this -- this is the text message from my daughter last night -- in a world that's devoid of emotion. So I'm on a mission to change that. I want to bring emotions back into our digital experiences.

Nos émotions influencent tous les aspects de notre vie, de notre santé et notre façon d'apprendre à la manière dont nous faisons des affaires, et prenons des décisions, petites ou grandes. Elles influencent aussi la manière dont nous interagissons ensemble. Nous avons évolué pour vivre dans un monde qui ressemble à ça, mais nous vivons nos vies de plus en plus plutôt comme ceci -- c'est le message que ma fille m'a envoyé hier soir -- dans un monde dépourvu d'émotion. Ma mission est de changer tout ça. Je veux ramener l'expression de nos émotions dans nos expériences numériques.

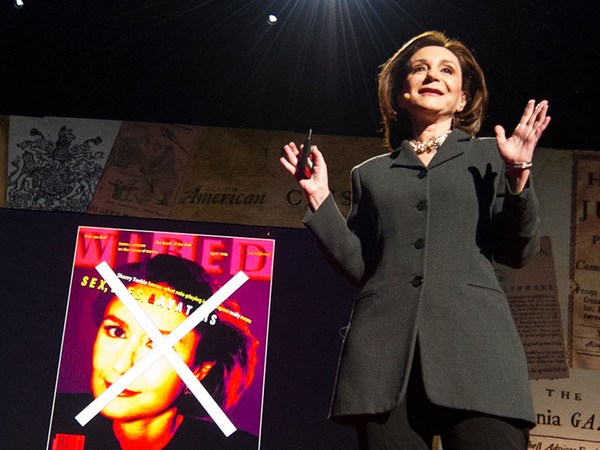

I started on this path 15 years ago. I was a computer scientist in Egypt, and I had just gotten accepted to a Ph.D. program at Cambridge University. So I did something quite unusual for a young newlywed Muslim Egyptian wife: With the support of my husband, who had to stay in Egypt, I packed my bags and I moved to England. At Cambridge, thousands of miles away from home, I realized I was spending more hours with my laptop than I did with any other human. Yet despite this intimacy, my laptop had absolutely no idea how I was feeling. It had no idea if I was happy, having a bad day, or stressed, confused, and so that got frustrating. Even worse, as I communicated online with my family back home, I felt that all my emotions disappeared in cyberspace. I was homesick, I was lonely, and on some days I was actually crying, but all I had to communicate these emotions was this. (Laughter) Today's technology has lots of I.Q., but no E.Q.; lots of cognitive intelligence, but no emotional intelligence. So that got me thinking, what if our technology could sense our emotions? What if our devices could sense how we felt and reacted accordingly, just the way an emotionally intelligent friend would? Those questions led me and my team to create technologies that can read and respond to our emotions, and our starting point was the human face.

J'ai commencé de travailler dans cette direction il y a 15 ans. J'étais informaticienne en Égypte, et venais juste d'être acceptée dans un programme de thèse à Cambridge. Alors j'ai fait quelque chose d'assez inhabituel pour une jeune musulmane égyptienne et tout juste mariée : avec le soutien de mon mari qui devait rester en Égypte, j'ai fait mes bagages et suis partie pour l'Angleterre. A Cambridge, à des milliers de kilomètres de chez moi, j'ai réalisé que je passais plus d'heures sur mon ordinateur qu'avec n'importe quel humain. Pourtant, malgré cette intimité, il n'avait absolument aucune idée de ce que je ressentais. Il ne savait pas si j'étais heureuse, si j'avais eu une mauvaise journée, si j'étais stressée ou confuse et ça devenait vraiment frustrant. Le pire, c'était que lorsque je communiquais en ligne avec ma famille à la maison, j'avais l'impression que toutes mes émotions disparaissaient dans cet espace virtuel. J'avais le mal du pays, je me sentais seule et me mettais même à pleurer certains jours. Mais tout ce que j'avais pour partager ces émotions, c'était ça. (Rires) La technologie moderne a beaucoup de Q.I. mais aucun Q.E.: c'est-à-dire beaucoup d'intelligence cognitive mais pas émotionnelle. Je me suis alors demandée ce que ça changerait si notre technologie pouvait percevoir nos émotions ? Que se passerait-il si nos appareils pouvaient les percevoir et réagir en fonction, exactement comme un ami le ferait ? Ces questions nous ont menés, mon équipe et moi à développer des technologies qui peuvent lire et réagir à nos émotions, à partir du visage humain.

So our human face happens to be one of the most powerful channels that we all use to communicate social and emotional states, everything from enjoyment, surprise, empathy and curiosity. In emotion science, we call each facial muscle movement an action unit. So for example, action unit 12, it's not a Hollywood blockbuster, it is actually a lip corner pull, which is the main component of a smile. Try it everybody. Let's get some smiles going on. Another example is action unit 4. It's the brow furrow. It's when you draw your eyebrows together and you create all these textures and wrinkles. We don't like them, but it's a strong indicator of a negative emotion. So we have about 45 of these action units, and they combine to express hundreds of emotions.

Il se trouve que le visage est un des moyens d'expression les plus puissants que nous utilisons pour communiquer notre état social ou émotionnel, tout de la joie, la surprise, la compassion à la curiosité. En science des émotions, chacun des mouvements du visage est appelé action. Par exemple, action numéro 12 n'est pas le nom du dernier succès hollywoodien, mais l'action de tirer le coin des lèvres, autrement dit de sourire. Essayez ! Faisons tous nos plus beaux sourires ! Autre exemple, action numéro 4, le froncement de sourcils. C'est lorsque vous plissez les sourcils ensemble et créez toutes ces rides et textures. On ne les aime pas mais c'est un très bon indicateur d'émotion négative. Nous avons environ 45 de ces actions que nous combinons pour exprimer des centaines d'émotions.

Teaching a computer to read these facial emotions is hard, because these action units, they can be fast, they're subtle, and they combine in many different ways. So take, for example, the smile and the smirk. They look somewhat similar, but they mean very different things. (Laughter) So the smile is positive, a smirk is often negative. Sometimes a smirk can make you become famous. But seriously, it's important for a computer to be able to tell the difference between the two expressions.

Enseigner à un ordinateur comment reconnaître ces expressions faciales est difficile parce qu'elles peuvent être rapides, sont subtiles, et peuvent former beaucoup de combinaisons différentes. Prenez par exemple, un sourire normal ou un sourire narquois. Ils sont en soi assez similaires, mais ont une signification bien différente. (Rires) Le sourire normal est positif, le sourire narquois souvent négatif. Un sourire narquois peut même vous rendre célèbre parfois ! Mais plus sérieusement, il est très important que l'ordinateur puisse différencier ces deux expressions.

So how do we do that? We give our algorithms tens of thousands of examples of people we know to be smiling, from different ethnicities, ages, genders, and we do the same for smirks. And then, using deep learning, the algorithm looks for all these textures and wrinkles and shape changes on our face, and basically learns that all smiles have common characteristics, all smirks have subtly different characteristics. And the next time it sees a new face, it essentially learns that this face has the same characteristics of a smile, and it says, "Aha, I recognize this. This is a smile expression."

Alors comment y arrive-t-on ? On donne à nos algorithmes des dizaines de milliers d'exemples spécifiques de personnes en train de sourire, d'origines, âge, sexe différents et on fait la même chose pour des sourires narquois. Ensuite par un processus d'apprentissage, l'algorithme assimile toutes ces textures, ces rides et mouvements de notre visage, apprend les caractéristiques générales d'un sourire, et en associe de plus spécifiques aux sourires narquois. Ainsi au prochain visage qu'il voit, l'algorithme peut essentiellement reconnaître les caractéristiques d'un sourire et dire : « ha ! je reconnais cette expression, c'est un sourire. »

So the best way to demonstrate how this technology works is to try a live demo, so I need a volunteer, preferably somebody with a face. (Laughter) Cloe's going to be our volunteer today.

Le meilleur moyen d'illustrer comment cette technologie fonctionne est une démonstration en direct alors j'aurais besoin d'un volontaire, de préférence quelqu'un avec un visage. (Rires) Cloe sera notre volontaire aujourd'hui.

So over the past five years, we've moved from being a research project at MIT to a company, where my team has worked really hard to make this technology work, as we like to say, in the wild. And we've also shrunk it so that the core emotion engine works on any mobile device with a camera, like this iPad. So let's give this a try.

Au cours des 5 dernières années, notre groupe de recherche au MIT est devenu une entreprise, dans laquelle mon équipe a travaillé dur pour que cette technologie marche, dans la vie de tous les jours, comme on dit. Nous l'avons aussi optimisée pour qu'elle fonctionne sur n'importe quel appareil pourvu d'une caméra, comme cet iPad. Mais essayons plutôt.

As you can see, the algorithm has essentially found Cloe's face, so it's this white bounding box, and it's tracking the main feature points on her face, so her eyebrows, her eyes, her mouth and her nose. The question is, can it recognize her expression? So we're going to test the machine. So first of all, give me your poker face. Yep, awesome. (Laughter) And then as she smiles, this is a genuine smile, it's great. So you can see the green bar go up as she smiles. Now that was a big smile. Can you try a subtle smile to see if the computer can recognize? It does recognize subtle smiles as well. We've worked really hard to make that happen. And then eyebrow raised, indicator of surprise. Brow furrow, which is an indicator of confusion. Frown. Yes, perfect. So these are all the different action units. There's many more of them. This is just a slimmed-down demo. But we call each reading an emotion data point, and then they can fire together to portray different emotions. So on the right side of the demo -- look like you're happy. So that's joy. Joy fires up. And then give me a disgust face. Try to remember what it was like when Zayn left One Direction. (Laughter) Yeah, wrinkle your nose. Awesome. And the valence is actually quite negative, so you must have been a big fan. So valence is how positive or negative an experience is, and engagement is how expressive she is as well. So imagine if Cloe had access to this real-time emotion stream, and she could share it with anybody she wanted to. Thank you. (Applause)

Comme vous le voyez, l'algorithme trouve essentiellement le visage de Cloe dans cette zone encadrée blanche, et décèle les mouvements des points principaux tels que ses sourcils, ses yeux, sa bouche et son nez. La question est alors de savoir s'il peut reconnaître ses expressions. Essayons donc de le tester. Tout d'abord, montrez moi un visage impassible. Oui, parfait ! (Rires) Et maintenant un sourire franc, en voilà un beau, parfait. Vous voyez, l'indicateur vert monte quand elle sourit. C'était un beau sourire ça. Pouvez-vous faire un sourire plus subtil pour voir ? Oui, le programme le reconnaît aussi. On a travaillé dur pour que ça marche. Là, les sourcils relevés déclenchent l'indicateur de surprise. Le sillon des sourcils, lui, est l'indicateur de confusion. Froncez les sourcils. Oui, parfait. Tout ça vous montre différentes actions, il y en a beaucoup d'autres. C'est juste une démonstration épurée. Chaque action reconnue est une point de donnée émotionnelle et l'ensemble de ces données peut décrire différentes émotions. Sur la droite ici regardez comme vous êtes heureuse. L'indicateur de joie se déclenche. Maintenant exprimez le dégoût. Souvenez-vous du départ de Zayn de One Direction. (Rires) Voilà, le nez se ride. Super. La capacité est en fait assez négative, vous deviez vraiment être fan ! Cette jauge montre si l'expérience est positive ou négative, la jauge d'engagement montre le niveau d'expression. Imaginez que Cloe ait accès direct à ce flux d'émotions en temps réel, elle pourrait alors le partager avec qui elle voudrait. Merci. (Applaudissements)

So, so far, we have amassed 12 billion of these emotion data points. It's the largest emotion database in the world. We've collected it from 2.9 million face videos, people who have agreed to share their emotions with us, and from 75 countries around the world. It's growing every day. It blows my mind away that we can now quantify something as personal as our emotions, and we can do it at this scale.

Jusqu'à présent nous avons accumulé 12 milliards de ces données émotionnelles. C'est la plus grande base de données de ce type au monde, construite à partir de 2,9 millions de vidéos de visages de personnes qui acceptent de partager leurs émotions avec nous et provenant de 75 pays différents. Et ça continue tous les jours. Ça me fascine totalement que l'on puisse à présent quantifier quelque chose d'aussi personnel que nos émotions, et qu'on le fasse à cette échelle.

So what have we learned to date? Gender. Our data confirms something that you might suspect. Women are more expressive than men. Not only do they smile more, their smiles last longer, and we can now really quantify what it is that men and women respond to differently. Let's do culture: So in the United States, women are 40 percent more expressive than men, but curiously, we don't see any difference in the U.K. between men and women. (Laughter) Age: People who are 50 years and older are 25 percent more emotive than younger people. Women in their 20s smile a lot more than men the same age, perhaps a necessity for dating. But perhaps what surprised us the most about this data is that we happen to be expressive all the time, even when we are sitting in front of our devices alone, and it's not just when we're watching cat videos on Facebook. We are expressive when we're emailing, texting, shopping online, or even doing our taxes.

Qu'a-t-on appris de tout ça jusqu'à présent ? En ce qui concerne le genre : nos données confirment ce dont vous vous doutiez probablement, les femmes sont plus expressives que les hommes. Non seulement elles sourient plus, mais aussi plus longtemps, et on peut maintenant vraiment quantifier ce à quoi les hommes et les femmes réagissent différemment. Pour l'influence culturelle : aux États-Unis si les femmes sont 40% plus expressives que les hommes, curieusement, on ne voit aucune différence à ce niveau-là au Royaume Uni. (Rires) Pour l'âge : les personnes de 50 ans et plus sont 25% plus émotives que les personnes plus jeunes. Les femmes dans leur vingtaine sourient beaucoup plus que les hommes du même âge, peut-être par nécessité pour faire des rencontres. Mais ce qui nous a surpris le plus dans toutes ces données, c'est que nous sommes en fait constamment expressifs, mais lorsque nous sommes assis tout seuls en face de nos écrans, et pas seulement à regarder des vidéos de chats sur Facebook. Nous sommes expressifs quand on écrit un mail, un texto, quand on achète en ligne et même quand on paie nos impôts.

Where is this data used today? In understanding how we engage with media, so understanding virality and voting behavior; and also empowering or emotion-enabling technology, and I want to share some examples that are especially close to my heart. Emotion-enabled wearable glasses can help individuals who are visually impaired read the faces of others, and it can help individuals on the autism spectrum interpret emotion, something that they really struggle with. In education, imagine if your learning apps sense that you're confused and slow down, or that you're bored, so it's sped up, just like a great teacher would in a classroom. What if your wristwatch tracked your mood, or your car sensed that you're tired, or perhaps your fridge knows that you're stressed, so it auto-locks to prevent you from binge eating. (Laughter) I would like that, yeah. What if, when I was in Cambridge, I had access to my real-time emotion stream, and I could share that with my family back home in a very natural way, just like I would've if we were all in the same room together?

Pour quoi utilise-t-on ces données aujourd'hui ? Ça va de comprendre comment nous interagissons avec les médias, les phénomènes viraux, les dynamiques de vote, à doter nos technologies de capacités émotionnelles, et j'aimerais partager avec vous quelques exemples qui me tiennent à cœur. Des lunettes à lecture émotionnelle peuvent aider les malvoyants à décrypter les expressions sur le visage des autres, et peuvent aider les personnes atteintes d'autisme à interpréter les émotions, ce qu'elles ont beaucoup de mal à faire. Pour l'éducation, imaginez que les applications d'apprentissage perçoivent votre confusion et ralentissent, qu'elles perçoivent votre ennui et accélèrent tout comme un bon enseignant le ferait dans la salle de classe. Imaginez que votre montre puisse déceler votre humeur, ou que votre voiture puisse percevoir votre fatigue, ou peut-être que votre frigo puisse sentir que vous êtes stressé et se verrouiller pour empêcher toute frénésie alimentaire. (Rires) J'apprécierais ça, oui. Que se serait-il passé si à Cambridge j'avais eu accès à ces données émotionnelles pour les partager tout naturellement avec ma famille à la maison comme si nous avions tous été dans la même pièce ?

I think five years down the line, all our devices are going to have an emotion chip, and we won't remember what it was like when we couldn't just frown at our device and our device would say, "Hmm, you didn't like that, did you?" Our biggest challenge is that there are so many applications of this technology, my team and I realize that we can't build them all ourselves, so we've made this technology available so that other developers can get building and get creative. We recognize that there are potential risks and potential for abuse, but personally, having spent many years doing this, I believe that the benefits to humanity from having emotionally intelligent technology far outweigh the potential for misuse. And I invite you all to be part of the conversation. The more people who know about this technology, the more we can all have a voice in how it's being used. So as more and more of our lives become digital, we are fighting a losing battle trying to curb our usage of devices in order to reclaim our emotions. So what I'm trying to do instead is to bring emotions into our technology and make our technologies more responsive. So I want those devices that have separated us to bring us back together. And by humanizing technology, we have this golden opportunity to reimagine how we connect with machines, and therefore, how we, as human beings, connect with one another.

Je pense que d'ici cinq ans, tous nos appareils auront une puce émotionnelle, et on ne se souviendra même plus du temps où, quand on fronçait les sourcils devant l'un d'eux, il ne nous retournait pas un, « hmm, ça ne t'a pas plu, hein ? » Notre plus grand défit est qu'il existe tellement d'applications à cette technologie. Mon équipe et moi nous rendons bien compte que nous ne pouvons pas tout faire nous-même et avons donc rendu cette technologie publique pour que d'autres puissent la développer et être créatifs. Nous sommes conscients des risques potentiels et des possibilités d'abus, mais personnellement, après avoir passé des années à faire ça, je pense que les bénéfices que l'humanité peut recevoir d'une technologie émotionnellement intelligente dépassent de loin les risques potentiels de mauvais usage. Je vous invite tous à prendre part à la discussion. Plus de gens seront au courant de cette technologie, mieux on pourra en définir ensemble les termes d'usage. Alors que de plus en plus de notre vie passe au digital, nous nous lançons dans une lutte perdue d'avance pour restreindre notre usage d'appareils et reconquérir nos émotions. Ce que j'essaie de faire au contraire est d'amener nos émotions dans notre technologie et la rendre ainsi plus réactive. Je veux que ces appareils qui nous séparaient les uns des autres, finalement nous rapprochent. En rendant notre technologie plus humaine, nous avons également l'opportunité de revoir la façon dont nous interagissons avec les machines, et par là-même la façon dont nous, humains, interagissons ensemble.

Thank you.

Merci.

(Applause)

(Applaudissements)