I've been intrigued by this question of whether we could evolve or develop a sixth sense -- a sense that would give us seamless access and easy access to meta-information or information that may exist somewhere that may be relevant to help us make the right decision about whatever it is that we're coming across. And some of you may argue, "Well, don't today's cell phones do that already?" But I would say no. When you meet someone here at TED -- and this is the top networking place, of course, of the year -- you don't shake somebody's hand and then say, "Can you hold on for a moment while I take out my phone and Google you?" Or when you go to the supermarket and you're standing there in that huge aisle of different types of toilet papers, you don't take out your cell phone, and open a browser, and go to a website to try to decide which of these different toilet papers is the most ecologically responsible purchase to make.

Jeg har blitt pirret av spørsmålet om vi kunne klare å utvikle eller lage en sjette sans -- en sans som ville gi oss sømløs tilgang og lett tilgang til meta-informasjon eller informasjon som kan finnes et sted som kan ha relevans for oss til å ta den rette avgjørelsen om hva det enn er vi kommer over. Noen av dere hevder kanskje, vel, gjør ikke dagens mobiler dette allerede? Men jeg ville si nei. Når du møter noen her på TED -- og dette er selvfølgelig den beste nettverksarenaen i året -- håndhilser du ikke bare på noen og sier, "Kan du vente et lite øyeblikk mens jeg tar fram telefonen og googler deg?". Eller når du går på butikken og du står der mellom de digre hyllene med forskjellige typer toalettpapir, tar du ikke ut mobilen din og åpner en nettleser, og går til en nettside for å finne ut hvilken av disse forskjellige toalettrullene som er det mest økologisk ansvarlige kjøpet?

So we don't really have easy access to all this relevant information that can just help us make optimal decisions about what to do next and what actions to take. And so my research group at the Media Lab has been developing a series of inventions to give us access to this information in a sort of easy way, without requiring that the user changes any of their behavior. And I'm here to unveil our latest effort, and most successful effort so far, which is still very much a work in process. I'm actually wearing the device right now and we've sort of cobbled it together with components that are off the shelf -- and that, by the way, only cost 350 dollars at this point in time.

Så vi har egentlig ikke enkel tilgang til all denne informasjonen, som kan hjelpe oss til å ta optimale beslutninger om hva vi skal gjøre videre og hvilke valg som skal tas. Min forskningsgruppe ved Media Lab har utviklet en serie oppfinnelser for å gi oss tilgang til denne informasjonen på en slags enkel måte, uten at brukeren behøver å endre noe av sin adferd. Og jeg er her for å avdekke vårt siste bidrag, og mest vellykkede innsats så langt, som fremdeles et arbeid under utvikling. Jeg har faktisk på meg enheten nå og vi har på en måte koblet den sammen med komponenter som er hyllevare -- og som forresten bare koster 350 dollar akkurat nå.

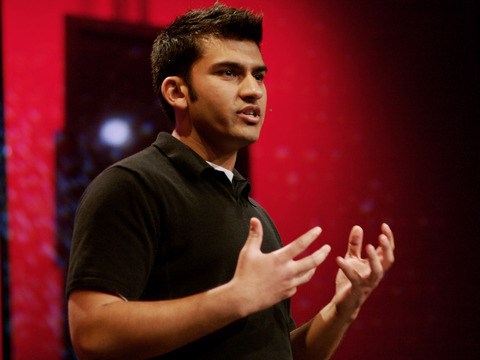

I'm wearing a camera, just a simple web cam, a portable, battery-powered projection system with a little mirror. These components communicate to my cell phone in my pocket which acts as the communication and computation device. And in the video here we see my student Pranav Mistry, who's really the genius who's been implementing and designing this whole system. And we see how this system lets him walk up to any surface and start using his hands to interact with the information that is projected in front of him. The system tracks the four significant fingers. In this case, he's wearing simple marker caps that you may recognize. But if you want a more stylish version, you could also paint your nails in different colors.

Jeg har på meg et kamera, bare et enkelt webkamera, et bærbart, batteri-drevet prosjektør-system med et lite speil. Disse kompoentene kommuniserer med mobilen i lommen min som fungerer som en kommunikasjons- og regneenhet. I videoen her ser vi min student Pranav Mistry, som faktisk er geniet som har implementert og designet hele systemet. Vi ser hvordan dette systemet lar ham gå frem til en vilkårlig overflate og bruke hendene til å samhandle med informasjonen som er projisert foran ham. Systemet følger de fire vesentlige fingrene. I dette tilfelle har han på enkle markører, som dere kanskje kjenner igjen. Men hvis du vil ha en stiligere versjon kan du også lakke neglene dine i forskjellige farger.

And the camera basically tracks these four fingers and recognizes any gestures that he's making so he can just go to, for example, a map of Long Beach, zoom in and out, etc. The system also recognizes iconic gestures such as the "take a picture" gesture, and then takes a picture of whatever is in front of you. And when he then walks back to the Media Lab, he can just go up to any wall and project all the pictures that he's taken, sort through them and organize them, and re-size them, etc., again using all natural gestures.

Kameraet følger disse fire fingrene og kjenner igjen hvilken som helst bevegelse han gjør slik at han kan gå til, for eksempel, et kart over Long Beach, zoome inn og ut, osv. Systemet kjenner også igjen figurative håndtegn slik som "ta et bilde" tegnet, så tar den et bilde av det som måtte være foran deg. Og når han så går tilbake til Media Lab, kan han gå mot hvilken som helst vegg og projisere alle bildene han har tatt, bla igjennom dem og organisere dem, endre størrelsen, osv., igjen ved å bruke naturlig gestikulering.

So, some of you most likely were here two years ago and saw the demo by Jeff Han, or some of you may think, "Well, doesn't this look like the Microsoft Surface Table?" And yes, you also interact using natural gestures, both hands, etc. But the difference here is that you can use any surface, you can walk up to any surface, including your hand, if nothing else is available, and interact with this projected data. The device is completely portable, and can be --

Noen av dere var sannsynligvis her for to år siden og så demonstrasjonen ved Jeff Han eller så tenker noen av dere kanskje "Ser ikke dette ut som Microsoft Surface Table?". Og ja, her samhandler du også med naturlige gester, begge hender, osv. Men forskjellen her er at du kan bruke en hvilken som helst overflate, gå frem til hvilken som helst overflate, inkludert din egen hånd om ingenting annet er tilgjengelig og samhandle med det som er projisert. Enheten er fullstending bærbar,

(Applause)

og kan bli ...

(Applause ends)

(Applause)

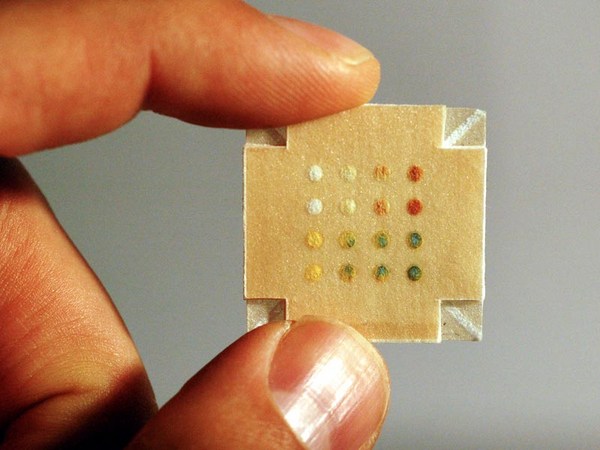

So, one important difference is that it's totally mobile. Another even more important difference is that in mass production, this would not cost more tomorrow than today's cell phones and would actually not sort of be a bigger packaging -- could look a lot more stylish than this version that I'm wearing around my neck. But other than letting some of you live out your fantasy of looking as cool as Tom Cruise in "Minority Report," the reason why we're really excited about this device is that it really can act as one of these sixth-sense devices that gives you relevant information about whatever is in front of you. So we see Pranav here going into the supermarket and he's shopping for some paper towels. And, as he picks up a product, the system can recognize the product that he's picking up, using either image recognition or marker technology, and give him the green light or an orange light. He can ask for additional information. So this particular choice here is a particularly good choice, given his personal criteria. Some of you may want the toilet paper with the most bleach in it rather than the most ecologically responsible choice.

Så en viktig forskjell er at den er fullstendig mobil. En annen kanskje viktigere forskjell er at i masseproduksjon vil ikke enheten koste mer i morgen enn dagens mobiltelefoner og vil faktisk ikke behøve å være en større kropp -- kan se mye stiligere ut enn den versjonen som jeg har rundt halsen. Men bortsett fra å la noen av dere leve ut deres drømmer om å se like kul ut som Tom Cruise i "Minority Report", er grunnen til at vi er så begistret for denne enheten det faktum at den kan fungere som en av disse "sjette sans"-enhetene som gir deg relevant informasjon om hva som helst du måtte ha foran deg. Her ser vi Pranav gå inn i supermarkedet for å handle tørkeruller. Og, når han tar opp et produkt som systemet kan gjenkjenne produktet som han plukker opp, ved å bruke bildegjenkjenning eller markør-teknologi, kan han få grønt lys eller et oransje lys. Kan han be om tilleggsinformasjon. Så dette bestemte valget her er et særs godt valg, gitt hans personlige kriterier. Noen av dere vil kanskje ha dopapir med mest mulig blekemiddel istedenfor det mest miljøansvarlige valget.

(Laughter)

(Latter)

If he picks up a book in the bookstore, he can get an Amazon rating -- it gets projected right on the cover of the book. This is Juan's book, our previous speaker, which gets a great rating, by the way, at Amazon. And so, Pranav turns the page of the book and can then see additional information about the book -- reader comments, maybe sort of information by his favorite critic, etc. If he turns to a particular page, he finds an annotation by maybe an expert or a friend of ours that gives him a little bit of additional information about whatever is on that particular page. Reading the newspaper -- it never has to be outdated.

Hvis han tar opp en bok i bokhandelen, kan han få en Amazon vurderingen -- den blir projisert rett på bokens forside. Dette er boken til Juan, vår forrige taler, som forresten får en kjempebra vurdering på Amazon. Og så blar Pranav om til neste side i boken og få se enda mer informasjon om boken -- leserkommentarer, kanskje informasjon fra hans favoritt-bokanmelder, osv. Hvis han blar til en bestemt side finner han merknader fra eksempelvis en ekspert som gir han litt ekstra informasjon om hva som finnes på den bestemte siden. Lesing av avisen -- det dør vel aldri ut.

(Laughter)

(Latter)

You can get video annotations of the events that you're reading about. You can get the latest sports scores, etc. This is a more controversial one.

Du kan få videokommentarer om hendelsen du leser om. Du kan få de siste sportsresultatene osv. Denne er mer kontroversiell.

(Laughter)

(Latter)

As you interact with someone at TED, maybe you can see a word cloud of the tags, the words that are associated with that person in their blog and personal web pages. In this case, the student is interested in cameras, etc. On your way to the airport, if you pick up your boarding pass, it can tell you that your flight is delayed, that the gate has changed, etc. And, if you need to know what the current time is, it's as simple as drawing a watch --

I det du samhandler med noen på TED, ser du kanskje en sky av nøkkelord, ordene som forbindes med denne personen i bloggen deres og på personlige nettsider. I dette tilfellet er studenten interessert i kameraer, osv. På veien til flyplassen, plukker du opp et ombordstigningskort som kan fortelle deg om om flyet er forsinket, endring av utgang, osv. Og hvis du lurer på hva klokken er tegner du bare en klokke --

(Laughter)

(Latter)

(Applause)

(Applaus)

on your arm.

på armen din.

So that's where we're at so far in developing this sixth sense that would give us seamless access to all this relevant information about the things that we may come across. My student Pranav, who's really, like I said, the genius behind this.

Så det er der vi er så langt i utviklingen av denne sjette sansen som vile gitt oss sømløs tilgang til all denne informasjonen om tingene vi måtte komme over. Min student Pranav, som egentlig er geniet bak dette.

(Applause and cheering)

(Applaus)

(Applause ends)

He does deserve a lot of applause, because I don't think he's slept much in the last three months, actually. And his girlfriend is probably not very happy about him either. But it's not perfect yet, it's very much a work in progress. And who knows, maybe in another 10 years we'll be here with the ultimate sixth sense brain implant.

Han fortjener masse applaus fordi jeg faktisk ikke tror han har sovet noe særlig de tre siste månedene. Og kjæresten hans er vel ikke kjempeblid for dette heller. Men det er ikke perfekt ennå, og bærer preg av å være under utvikling. Og hvem vet, kanskje om 10 år sitter vi her med det perfekte "sjette sans"-hjerneimplantatet.

Thank you.

Takk skal dere ha.

(Applause)

(Applaus)