Dies ist ein Gedankenexperiment. Angenommen, Sie fahren in naher Zukunft in Ihrem selbstfahrenden Auto auf der Autobahn und sind von allen Seiten von anderen Fahrzeugen umgeben. Plötzlich fällt vom LKW vor Ihnen ein großer, schwerer Gegenstand. Ihr Auto kann einen Zusammenstoß nicht vermeiden, also muss es entscheiden: darauf zufahren und das Objekt rammen, nach links in einen SUV ausweichen, oder nach rechts in ein Motorrad? Sollte es Ihre Sicherheit priorisieren, indem es Letzteres anfährt, die Gefahr für andere minimieren, indem es nicht ausweicht, selbst wenn dies einen Zusammenstoß, und damit Ihren Tod bedeuten könnte, oder den Mittelweg wählen, indem es den SUV trifft, der die Insassen besser schützt? Was sollte das selbstfahrende Auto tun? Wenn wir das eingezwängte Auto selbst im manuellen Modus fahren, würde es, egal wie wir reagierten, als genau dies verstanden werden: eine Reaktion, keine bewusste Entscheidung. Es wäre eine instinktive Panikreaktion, ohne Voraussicht oder Böswilligkeit. Aber würde das Auto so programmiert, dass es dasselbe Manöver ausführt, wenn es merkt, dass bestimmte Bedingungen erfüllt sind, dann sähe dies eher nach vorsätzlicher Tötung aus. Bleiben wir fair: Selbstfahrende Autos sollen die Anzahl der Unfälle und Verkehrstoten drastisch reduzieren, indem menschliches Versagen beim Fahren verhindert wird. Es könnte auch viele weitere Vorteile geben: Weniger Stau, weniger schädliche Abgase und weniger unproduktive, stressige Fahrzeit. Aber Unfälle können und werden passieren, und wenn es so ist, wird ihr Ausgang vielleicht Monate oder Jahre im Voraus bestimmt werden, und zwar von Programmierern oder Entscheidungsträgern, die schwierige Entscheidungen werden treffen müssen. Man mag versucht sein grundsätzliche Entscheidungsprinzipien, wie Schadensminimierung, zu formulieren, doch selbst dies kann zu moralisch fragwürdigen Entscheidungen führen. Sagen wir mal, wir hätten die gleiche Ausgangssituation, aber jetzt ist links eine Rollerfahrerin mit Helm und rechts fährt jemand ohne Helm. Wen soll das Roboterauto rammen? Nimmt man die Fahrerin mit Helm, da sie eher überleben wird, bestraft man dann nicht verantwortungsbewusste Fahrer? Nimmt man den Fahrer ohne Helm, da er verantwortungslos handelt, dann stellt man sich über das ursprüngliche Schadensminimierungsprinzip und das Roboterauto übt Selbstjustiz. Die ethischen Erwägungen werden hier komplizierter. In beiden Szenarien fungiert das zugrundeliegende Konstrukt quasi als algorithmische Zielvorrichtung. Anders gesagt, favorisiert oder diskriminiert es systematisch bestimmte Objekte, die gerammt werden sollten. Und die Besitzer der Zielfahrzeuge werden die negativen Konsequenzen dieses Algorithmus tragen, und zwar ohne eigenes Verschulden. Unsere neuen Technologien bringen viele neuartige ethische Dilemmata mit sich. Hättest du etwa die Wahl zwischen einem Auto, das bei einem Unfall stets so viele Leben wie möglich retten würde, und einem Auto, das definitiv dich retten würde, welches würdest du kaufen? Was passiert, wenn Autos anfangen, ihre Insassen und die Details aus deren Leben zu analysieren und zu integrieren? Ist eine zufällige Entscheidung besser, als eine vorgegebene mit dem Ziel der Schadensminimierung? Und wer sollte all diese Entscheidungen überhaupt treffen? Programmierer? Unternehmen? Regierungen? Unsere Gedankenexperimente werden zwar nicht unbedingt Realität, aber darum geht es nicht. Sie sollen unsere Moralvorstellungen ausloten und hinterfragen, wie wissenschaftliche Experimente über die physische Welt. Wenn wir diese moralischen Haarnadelkurven jetzt entdecken, können wir die unbekannten Straßen der Technologieethik bewältigen, was uns ermöglicht, souverän und gewissenhaft in eine schöne neue Zukunft zu fahren.

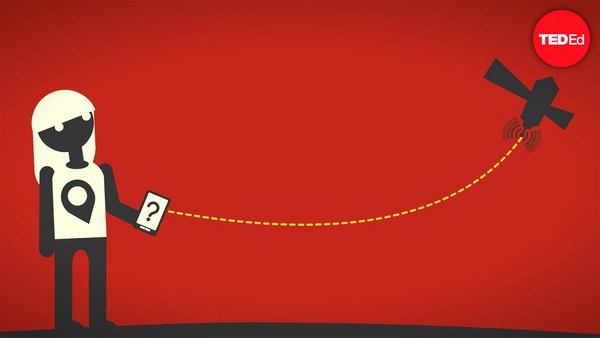

This is a thought experiment. Let's say at some point in the not so distant future, you're barreling down the highway in your self-driving car, and you find yourself boxed in on all sides by other cars. Suddenly, a large, heavy object falls off the truck in front of you. Your car can't stop in time to avoid the collision, so it needs to make a decision: go straight and hit the object, swerve left into an SUV, or swerve right into a motorcycle. Should it prioritize your safety by hitting the motorcycle, minimize danger to others by not swerving, even if it means hitting the large object and sacrificing your life, or take the middle ground by hitting the SUV, which has a high passenger safety rating? So what should the self-driving car do? If we were driving that boxed in car in manual mode, whichever way we'd react would be understood as just that, a reaction, not a deliberate decision. It would be an instinctual panicked move with no forethought or malice. But if a programmer were to instruct the car to make the same move, given conditions it may sense in the future, well, that looks more like premeditated homicide. Now, to be fair, self-driving cars are predicted to dramatically reduce traffic accidents and fatalities by removing human error from the driving equation. Plus, there may be all sorts of other benefits: eased road congestion, decreased harmful emissions, and minimized unproductive and stressful driving time. But accidents can and will still happen, and when they do, their outcomes may be determined months or years in advance by programmers or policy makers. And they'll have some difficult decisions to make. It's tempting to offer up general decision-making principles, like minimize harm, but even that quickly leads to morally murky decisions. For example, let's say we have the same initial set up, but now there's a motorcyclist wearing a helmet to your left and another one without a helmet to your right. Which one should your robot car crash into? If you say the biker with the helmet because she's more likely to survive, then aren't you penalizing the responsible motorist? If, instead, you save the biker without the helmet because he's acting irresponsibly, then you've gone way beyond the initial design principle about minimizing harm, and the robot car is now meting out street justice. The ethical considerations get more complicated here. In both of our scenarios, the underlying design is functioning as a targeting algorithm of sorts. In other words, it's systematically favoring or discriminating against a certain type of object to crash into. And the owners of the target vehicles will suffer the negative consequences of this algorithm through no fault of their own. Our new technologies are opening up many other novel ethical dilemmas. For instance, if you had to choose between a car that would always save as many lives as possible in an accident, or one that would save you at any cost, which would you buy? What happens if the cars start analyzing and factoring in the passengers of the cars and the particulars of their lives? Could it be the case that a random decision is still better than a predetermined one designed to minimize harm? And who should be making all of these decisions anyhow? Programmers? Companies? Governments? Reality may not play out exactly like our thought experiments, but that's not the point. They're designed to isolate and stress test our intuitions on ethics, just like science experiments do for the physical world. Spotting these moral hairpin turns now will help us maneuver the unfamiliar road of technology ethics, and allow us to cruise confidently and conscientiously into our brave new future.