If you ask people about what part of psychology do they think is hard, and you say, "Well, what about thinking and emotions?" Most people will say, "Emotions are terribly hard. They're incredibly complex. They can't -- I have no idea of how they work. But thinking is really very straightforward: it's just sort of some kind of logical reasoning, or something. But that's not the hard part."

Se você perguntar às pessoas sobre que parte da psicologia elas consideram difícil, e você disser, bem, que tal raciocínio e emoções, a maioria das pessoas vai dizer, "Emoções são terrivelmente difíceis. Elas são incrivelmente complexas, elas não -- eu não tenho idéia de como funcionam. Mas o raciocínio é mesmo muito simples. É apenas um tipo de racionalização lógica ou algo assim. Mas essa não é a parte difícil."

So here's a list of problems that come up. One nice problem is, what do we do about health? The other day, I was reading something, and the person said probably the largest single cause of disease is handshaking in the West. And there was a little study about people who don't handshake, and comparing them with ones who do handshake. And I haven't the foggiest idea of where you find the ones that don't handshake, because they must be hiding. And the people who avoid that have 30 percent less infectious disease or something. Or maybe it was 31 and a quarter percent. So if you really want to solve the problem of epidemics and so forth, let's start with that. And since I got that idea, I've had to shake hundreds of hands. And I think the only way to avoid it is to have some horrible visible disease, and then you don't have to explain.

Mas aqui está uma lista de problemas que aparecem. Um belo problema é: o que fazer sobre a saúde? Outro dia eu estava lendo algo, e a pessoa dizia provavelmente a principal causa individual de doenças no ocidente é o aperto de mão. E havia um pequeno estudo sobre pessoas que não dão aperto de mão, e comparava elas com as que dão, e eu não tenho a mínima idéia de onde você encontra pessoas que recusam o aperto de mão, porque elas devem se esconder. E as pessoas que o evitam têm 30% menos doenças infecciosas, ou perto disso. Ou talvez era 31,25%. Então se você realmente quer resolver o problema de epidemias e etc. comecemos com isso. E uma vez que tive esta idéia, Eu tive de apertar centenas de mãos. E eu acho que o único modo de evitar isso é ter alguma doença visível horrível, e então você não tem de dar explicações.

Education: how do we improve education? Well, the single best way is to get them to understand that what they're being told is a whole lot of nonsense. And then, of course, you have to do something about how to moderate that, so that anybody can -- so they'll listen to you. Pollution, energy shortage, environmental diversity, poverty. How do we make stable societies? Longevity. Okay, there're lots of problems to worry about.

Educação: como melhoramos a educação? Bem, a melhor forma é fazê-los endender que o que eles estão aprendendo é um monte de coisas sem sentido. E então, é claro, você tem de fazer algo para moderar isso, para que todos possam dar ouvidos a você. Poluição, escassez de energia, diversidade ambiental, pobreza -- como criamos sociedades estáveis? Longevidade. OK, existem muitos problemas com que se preocupar.

Anyway, the question I think people should talk about -- and it's absolutely taboo -- is, how many people should there be? And I think it should be about 100 million or maybe 500 million. And then notice that a great many of these problems disappear. If you had 100 million people properly spread out, then if there's some garbage, you throw it away, preferably where you can't see it, and it will rot. Or you throw it into the ocean and some fish will benefit from it. The problem is, how many people should there be? And it's a sort of choice we have to make.

De qualquer modo, a questão sobre a qual acho que deveria se falar -- e é um tabu absoluto -- é, quantas pessoas deveriam existir? E eu acho que deveria ser entre 100 milhões ou talvez 500 milhões. E então veja que muitos destes problemas desapareceriam. Se você tivesse 100 milhões de pessoas devidamente espalhadas, então, se existe algum lixo, você joga fora, preferivelmente onde você não pode ver, e vai apodrecer. Ou você joga ele no oceano e algum peixe vai se beneficiar dele. O problema é, quantas pessoas deveriam existir? E é uma escolha que temos de fazer.

Most people are about 60 inches high or more, and there's these cube laws. So if you make them this big, by using nanotechnology, I suppose -- (Laughter) -- then you could have a thousand times as many. That would solve the problem, but I don't see anybody doing any research on making people smaller. Now, it's nice to reduce the population, but a lot of people want to have children. And there's one solution that's probably only a few years off. You know you have 46 chromosomes. If you're lucky, you've got 23 from each parent. Sometimes you get an extra one or drop one out, but -- so you can skip the grandparent and great-grandparent stage and go right to the great-great-grandparent. And you have 46 people and you give them a scanner, or whatever you need, and they look at their chromosomes and each of them says which one he likes best, or she -- no reason to have just two sexes any more, even. So each child has 46 parents, and I suppose you could let each group of 46 parents have 15 children. Wouldn't that be enough? And then the children would get plenty of support, and nurturing, and mentoring, and the world population would decline very rapidly and everybody would be totally happy.

A maioria das pessoas tem em torno de 1m80 ou mais, e existe uma perda cúbica. Então se você os fizesse deste tamanho -- usando nanotecnologia, suponho -- (risos) -- então você poderia ter mil vezes mais. Isto resolveria o problema, mas não vejo ninguém fazendo qualquer pesquisa sobre como tornar as pessoas menores. É legal reduzir a população, mas muitas pessoas querem ter filhos. E existe uma solução que provavelmente está a alguns anos de existir. Vocês sabem que têm 46 cromossomos. Se tiveram sorte, ganharam 23 de cada um dos pais; às vezes você ganha um extra ou perde um, mas -- então você pode pular o estágio do avô e bisavô e ir direto ao tataravô. E você tem 46 pessoas e você dá a eles um scanner, ou o que quer que precisem, e elas analisam seus cromossomos, e cada uma diz qual gosta mais, ou ela -- não há razão para haver só dois sexos mesmo mais. Então cada filho tem 46 pais, e imagino que se poderia deixar cada grupo de 46 pais ter 15 filhos -- não seria suficiente? E então os filhos teriam muito apoio, e sustento e orientação e então a população mundial cairia muito rapidamente e todos seriam totalmente felizes.

Timesharing is a little further off in the future. And there's this great novel that Arthur Clarke wrote twice, called "Against the Fall of Night" and "The City and the Stars." They're both wonderful and largely the same, except that computers happened in between. And Arthur was looking at this old book, and he said, "Well, that was wrong. The future must have some computers." So in the second version of it, there are 100 billion or 1,000 billion people on Earth, but they're all stored on hard disks or floppies, or whatever they have in the future. And you let a few million of them out at a time. A person comes out, they live for a thousand years doing whatever they do, and then, when it's time to go back for a billion years -- or a million, I forget, the numbers don't matter -- but there really aren't very many people on Earth at a time. And you get to think about yourself and your memories, and before you go back into suspension, you edit your memories and you change your personality and so forth. The plot of the book is that there's not enough diversity, so that the people who designed the city make sure that every now and then an entirely new person is created. And in the novel, a particular one named Alvin is created. And he says, maybe this isn't the best way, and wrecks the whole system.

Partilha de tempo está um pouco mais longe no futuro. E existe um ótimo romance que Arthur Clarke escreveu duas vezes, chamado "Against the Fall of Night" e "A Cidade e as Estrelas" eles são ambos maravilhosos e praticamente iguais exceto que computadores aconteceram no meio tempo. E Arthur estava olhando para este velho livro, e disse, isso está errado. O futuro tem de ter alguns computadores. Então na segunda versão dele, existem 100 bilhões, ou 1 trilhão de pessoas na Terra, mas elas estão todas armazenadas em discos rígidos ou disquetes, ou o que quer que exista no futuro. E só a alguns milhões é permitido sair cada vez. Uma pessoa sai, vive por mil anos fazendo o que quiser, e então, quando é hora de voltar por um bilhão de anos -- ou um milhão, já esqueci, os números não importam -- mas não existe mesmo muita gente na terra de uma vez. E você pensa então sobre si e suas memórias, e antes de voltar à suspensão você edita suas memórias e muda sua personalidade e etc. A trama do livro é que não existe suficiente diversidade, então as pessoas que desenharam a cidade fazem com que de tempos em tempos uma pessoa inteiramente nova é criada. E neste romance, um indivíduo particular chamado Alvin é criado. E ele diz, talvez esta não é a melhor forma, e destrói o sistema inteiro.

I don't think the solutions that I proposed are good enough or smart enough. I think the big problem is that we're not smart enough to understand which of the problems we're facing are good enough. Therefore, we have to build super intelligent machines like HAL. As you remember, at some point in the book for "2001," HAL realizes that the universe is too big, and grand, and profound for those really stupid astronauts. If you contrast HAL's behavior with the triviality of the people on the spaceship, you can see what's written between the lines. Well, what are we going to do about that? We could get smarter. I think that we're pretty smart, as compared to chimpanzees, but we're not smart enough to deal with the colossal problems that we face, either in abstract mathematics or in figuring out economies, or balancing the world around. So one thing we can do is live longer. And nobody knows how hard that is, but we'll probably find out in a few years. You see, there's two forks in the road. We know that people live twice as long as chimpanzees almost, and nobody lives more than 120 years, for reasons that aren't very well understood. But lots of people now live to 90 or 100, unless they shake hands too much or something like that. And so maybe if we lived 200 years, we could accumulate enough skills and knowledge to solve some problems. So that's one way of going about it. And as I said, we don't know how hard that is. It might be -- after all, most other mammals live half as long as the chimpanzee, so we're sort of three and a half or four times, have four times the longevity of most mammals. And in the case of the primates, we have almost the same genes. We only differ from chimpanzees, in the present state of knowledge, which is absolute hogwash, maybe by just a few hundred genes.

Não acho que as soluções que eu propus são boas o suficiente ou inteligentes o suficiente. Acho que o grande problema é que não somos inteligentes o suficiente para entender quais dos problemas que temos são bons o suficiente. Portanto, temos de construir máquinas superinteligentes como o HAL. Vocês devem lembrar, a certa altura do livro 2001, HAL percebe que o universo é muito grande e profundo para esses astronautas tão estúpidos. Se você contrastar o comportamento de HAL com a trivialidade das pessoas na espaçonave, você pode ver o que está escrito nas entrelinhas. Bem, o que vamos fazer sobre isso? Podemos ficar mais inteligentes. Acho que já somos bem inteligentes, comparados com chimpanzés, mas não somos inteligentes o suficiente para lidar com os problemas colossais que enfrentamos, seja na matemática abstrata ou em entender economia ou manter o equilíbrio do mundo. Então uma coisa que podemos fazer é viver mais. E ninguém sabe quão difícil isso será, mas vamos provavelmente descobrir em poucos anos. Sabe, existem duas encruzilhadas na estrada. Sabemos que as pessoas vivem o dobro dos chimpanzés, quase, e ninguém vive mais de 120 anos, por razões ainda não bem compreendidas. Mas muitas pessoas vivem até 90 ou 100, exceto se apertarem muitas mãos ou algo assim. Então talvez se vivêssemos 200 anos, poderíamos acumular habilidade suficiente e conhecimento para resolver alguns problemas. Esta é uma das formas de analisar isto. Como eu disse, não sabemos quão difícil é. Pode ser -- afinal, a maioria dos outros mamíferos vivem a metade dos chimpanzés, então estamos três e meia ou quatro vezes -- quatro vezes a longevidade da maioria dos animais. E no caso dos primatas, temos praticamente os mesmos genes. Nossa diferença para chimpanzés no estado atual da ciência -- que é lixo absoluto -- talvez algumas centenas de genes.

What I think is that the gene counters don't know what they're doing yet. And whatever you do, don't read anything about genetics that's published within your lifetime, or something. (Laughter) The stuff has a very short half-life, same with brain science. And so it might be that if we just fix four or five genes, we can live 200 years. Or it might be that it's just 30 or 40, and I doubt that it's several hundred. So this is something that people will be discussing and lots of ethicists -- you know, an ethicist is somebody who sees something wrong with whatever you have in mind. (Laughter) And it's very hard to find an ethicist who considers any change worth making, because he says, what about the consequences? And, of course, we're not responsible for the consequences of what we're doing now, are we? Like all this complaint about clones. And yet two random people will mate and have this child, and both of them have some pretty rotten genes, and the child is likely to come out to be average. Which, by chimpanzee standards, is very good indeed.

Eu acho realmente que os contadores de genes não sabem o que estão fazendo ainda. E o que quer que você faça, não leia nada sobre genética que for publicado enquanto você viver, ou quase isso. (Risos) Essas coisas têm vida muito curta, assim como ciência cerebral. Então pode ser que se nós só consertarmos quatro ou cinco genes, podemos viver 200 anos. Ou pode ser que sejam só 30 ou 40, e duvido que sejam várias centenas. Portanto isto é algo que as pessoas vão discutir e muitos eticistas -- sabem, um eticista é alguém que vê algo errado com o que quer que você tenha em mente. (Risos) E é muito difícil de encontrar um eticista que considere qualquer mudança válida de fazer, porque ele diz, e quanto às consequências? E é claro, não somos responsáveis pelas consequências do que estamos fazendo agora, somos? Como todo este barulho sobre clones. Ainda assim duas pessoas aleatórias que têm um filho, e ambas têm alguns genes bem estragados, e o filho é provável que seja mediano. O que para os padrões de um chimpanzé é muito bom.

If we do have longevity, then we'll have to face the population growth problem anyway. Because if people live 200 or 1,000 years, then we can't let them have a child more than about once every 200 or 1,000 years. And so there won't be any workforce. And one of the things Laurie Garrett pointed out, and others have, is that a society that doesn't have people of working age is in real trouble. And things are going to get worse, because there's nobody to educate the children or to feed the old. And when I'm talking about a long lifetime, of course, I don't want somebody who's 200 years old to be like our image of what a 200-year-old is -- which is dead, actually.

Se tivermos longevidade, então teremos de encarar o crescimento populacional de qualquer modo. Porque se as pessoas viverem 200 ou 1000 anos, então não podemos deixar que tenham um filho mais que uma vez a cada 200 ou 1000 anos. Então não haverá mais trabalhadores. E uma das coisas que Laurie Garrett mencionou, e outros, é que uma sociedade que não tem pessoas em idade de trabalhar tem um sério problema. E as coisas vão piorar, porque não existirá ninguém para educar as crianças ou alimentar os idosos. E quando falo sobre uma vida longa, é claro, não quero que alguém com 200 anos seja como nossa imagem do que é alguém assim velho agora -- morto, na verdade.

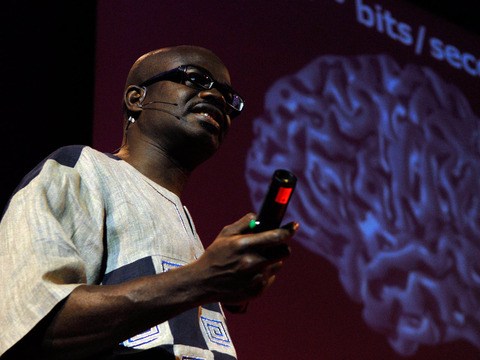

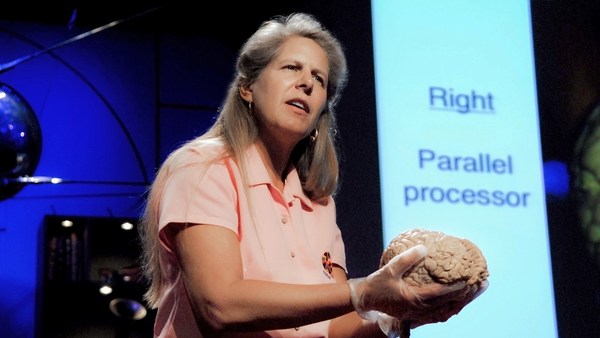

You know, there's about 400 different parts of the brain which seem to have different functions. Nobody knows how most of them work in detail, but we do know that there're lots of different things in there. And they don't always work together. I like Freud's theory that most of them are cancelling each other out. And so if you think of yourself as a sort of city with a hundred resources, then, when you're afraid, for example, you may discard your long-range goals, but you may think deeply and focus on exactly how to achieve that particular goal. You throw everything else away. You become a monomaniac -- all you care about is not stepping out on that platform. And when you're hungry, food becomes more attractive, and so forth. So I see emotions as highly evolved subsets of your capability. Emotion is not something added to thought. An emotional state is what you get when you remove 100 or 200 of your normally available resources.

Sabem, existem quase 400 diferentes partes do cérebro que parecem ter diferentes funções. Ninguém sabe como a maioria delas trabalha em detalhes, mas sabemos que existem muitas coisas diferentes lá. E elas nem sempre trabalham juntas. Gosto da teoria de Freud de que a maioria delas estão se cancelando mutuamente. Então se você pensar em si como uma cidade com cem recursos, então, quando está preocupado, por exemplo, pode descartar suas metas de longo prazo, mas pode pensar profundamente e focar em exatamente como atingir uma meta particular. Você joga todo o resto fora. Você se torna monomaníaco -- tudo com que se preocupa é não pular fora da plataforma. E quando você está com fome, a comida fica mais atraente, e etc. Portanto vejo emoções como altamente evoluídos subconjuntos de sua capacidade. Emoção não é algo acrescentado ao pensamento. Um estado emocional é o que você obtém quando remove 100 ou 200 dos seus recursos normalmente disponíveis.

So thinking of emotions as the opposite of -- as something less than thinking is immensely productive. And I hope, in the next few years, to show that this will lead to smart machines. And I guess I better skip all the rest of this, which are some details on how we might make those smart machines and -- (Laughter) -- and the main idea is in fact that the core of a really smart machine is one that recognizes that a certain kind of problem is facing you. This is a problem of such and such a type, and therefore there's a certain way or ways of thinking that are good for that problem. So I think the future, main problem of psychology is to classify types of predicaments, types of situations, types of obstacles and also to classify available and possible ways to think and pair them up. So you see, it's almost like a Pavlovian -- we lost the first hundred years of psychology by really trivial theories, where you say, how do people learn how to react to a situation? What I'm saying is, after we go through a lot of levels, including designing a huge, messy system with thousands of ports, we'll end up again with the central problem of psychology. Saying, not what are the situations, but what are the kinds of problems and what are the kinds of strategies, how do you learn them, how do you connect them up, how does a really creative person invent a new way of thinking out of the available resources and so forth.

Então pensar sobre emoções como o oposto de algo menos que pensar é imensamente produtivo. E espero, nos próximos anos, mostrar que isto vai levar a máquinas inteligentes. E acho que é melhor pular o resto disso, que são alguns detalhes sobre como podemos fazer estas máquinas inteligentes e -- (Risos) -- e a principal idéia é na verdade que o centro de uma máquina realmente inteligente é uma que reconhece que você está encarando certo tipo de problema. que é um problema de tal-e-tal tipo, e portanto existe um certo modo ou modos de pensar que são bons para esse problema. Portanto acho que no futuro o maior problema da psicologia será classificar tipos de prognósticos, tipos de situações, tipos de obstáculos e também classificar os modos de pensar disponíveis e possíveis e combiná-los. Podemos ver que é quase como um Pavloviano -- perdemos os primeiros cem anos de psicologia com teorias realmente triviais onde se diz, como as pessoas aprendem a reagir a uma situação? O que quero dizer é, depois de passar por muitos níveis, incluindo desenhar um enorme e caótico sistema com milhares de partes, vamos terminar novamente com o problema central da psicologia. Dizendo, não quais são as situações, mas quais são os tipos de problemas e quais são os tipos de estratégias, como as aprendemos, como as conectamos, como uma pessoa realmente criativa inventa um novo modo de pensar sobre os recursos disponíveis e etc.

So, I think in the next 20 years, if we can get rid of all of the traditional approaches to artificial intelligence, like neural nets and genetic algorithms and rule-based systems, and just turn our sights a little bit higher to say, can we make a system that can use all those things for the right kind of problem? Some problems are good for neural nets; we know that others, neural nets are hopeless on them. Genetic algorithms are great for certain things; I suspect I know what they're bad at, and I won't tell you. (Laughter)

Portanto penso que nos próximos 20 anos, Se pudermos nos livrar de todas as abordagens tradicionais à inteligência artificial, como redes neurais e algoritmos genéticos e sistemas especialistas, e apenas elevar a perspectiva um pouco para dizer, podemos fazer um sistema que possa usar todas estas coisas para o tipo certo de problema? Alguns problemas são bons para redes neurais, sabemos que para outros, redes neurais são inúteis. Algoritmos genéticos são ótimos para certas coisas; Suspeito que sei para que eles são ruins e não vou lhes dizer. (Risos)

Thank you. (Applause)

Obrigado. (Aplausos)