If you ask people about what part of psychology do they think is hard, and you say, "Well, what about thinking and emotions?" Most people will say, "Emotions are terribly hard. They're incredibly complex. They can't -- I have no idea of how they work. But thinking is really very straightforward: it's just sort of some kind of logical reasoning, or something. But that's not the hard part."

Si vous demandez aux gens ce qu'ils trouvent difficile dans la psychologie, et vous dites, eh bien, par exemple la pensée et les émotions, la plupart des gens diront: «Les émotions c'est très dur. Elles sont incroyablement complexes, elles ne peuvent pas - je n'ai aucune idée de comment elles fonctionnent. Mais la pensée c'est vraiment très simple: c'est juste une sorte de raisonnement logique ou quelque chose comme ça. Mais ce n'est pas la partie difficile. "

So here's a list of problems that come up. One nice problem is, what do we do about health? The other day, I was reading something, and the person said probably the largest single cause of disease is handshaking in the West. And there was a little study about people who don't handshake, and comparing them with ones who do handshake. And I haven't the foggiest idea of where you find the ones that don't handshake, because they must be hiding. And the people who avoid that have 30 percent less infectious disease or something. Or maybe it was 31 and a quarter percent. So if you really want to solve the problem of epidemics and so forth, let's start with that. And since I got that idea, I've had to shake hundreds of hands. And I think the only way to avoid it is to have some horrible visible disease, and then you don't have to explain.

Donc, voici une liste des problèmes qui ressortent. Un bon problème est: que faisons-nous sur la santé? L'autre jour, je lisais quelque chose, et l'auteur disait que probablement la plus importante cause de maladie est la poignée de main en occident. Et il y avait une petite d'étude sur les personnes qui ne se serrent pas la main, et qui les comparait avec ceux qui se serraient la main, et je n'ai pas la moindre idée d'où vous trouvez celles qui ne le font pas parce qu'ils doivent se cacher. Et les gens qui évitent ça ont quelque chose comme 30 % en moins de maladies infectieuses. Ou peut-être était-ce 31 % et un quart. Donc, si vous voulez vraiment résoudre le problème des épidémies et ainsi de suite, commençons par cela. Et depuis que j'ai eu cette idée, j'ai dû serrer des centaines de mains. Et je pense que la seule façon de l'éviter est d'avoir une horrible maladie visible, et ensuite vous n'avez pas à expliquer.

Education: how do we improve education? Well, the single best way is to get them to understand that what they're being told is a whole lot of nonsense. And then, of course, you have to do something about how to moderate that, so that anybody can -- so they'll listen to you. Pollution, energy shortage, environmental diversity, poverty. How do we make stable societies? Longevity. Okay, there're lots of problems to worry about.

L'éducation: comment pouvons-nous améliorer l'éducation? Eh bien, la meilleure façon simple est de leur faire comprendre que ce qu'on leur dit, c'est un tas de bêtises. Et puis, bien sûr, vous devez faire quelque chose pour modérerça, pour que n'importe qui puisse vous écouter. La pollution, la pénurie d'énergie, la diversité de l'environnement, la pauvreté - comment faire une société stable? La longévité. Bon, il y a beaucoup de problèmes à craindre.

Anyway, the question I think people should talk about -- and it's absolutely taboo -- is, how many people should there be? And I think it should be about 100 million or maybe 500 million. And then notice that a great many of these problems disappear. If you had 100 million people properly spread out, then if there's some garbage, you throw it away, preferably where you can't see it, and it will rot. Or you throw it into the ocean and some fish will benefit from it. The problem is, how many people should there be? And it's a sort of choice we have to make.

Quoi qu'il en soit, la question dont je pense que les gens devraient parler - et c'est absolument tabou - c'est, combien de personnes devrait-il y avoir? Et je pense que ça devrait être environ 100 millions ou peut-être 500 millions. Et alors notez qu'un grand nombre de ces problèmes disparaissent. Si vous aviez 100 millions de personnes bien réparties, ensuite, s'il y a des ordures, vous les jetez, de préférence là où vous ne pouvez pas les voir, et où elles vont pourrir. Ou alors vous les jetez dans l'océan et des poissons en bénéficieront. Le problème est, combien de personnes faut-il être? Et c'est une sorte de choix que nous avons à faire.

Most people are about 60 inches high or more, and there's these cube laws. So if you make them this big, by using nanotechnology, I suppose -- (Laughter) -- then you could have a thousand times as many. That would solve the problem, but I don't see anybody doing any research on making people smaller. Now, it's nice to reduce the population, but a lot of people want to have children. And there's one solution that's probably only a few years off. You know you have 46 chromosomes. If you're lucky, you've got 23 from each parent. Sometimes you get an extra one or drop one out, but -- so you can skip the grandparent and great-grandparent stage and go right to the great-great-grandparent. And you have 46 people and you give them a scanner, or whatever you need, and they look at their chromosomes and each of them says which one he likes best, or she -- no reason to have just two sexes any more, even. So each child has 46 parents, and I suppose you could let each group of 46 parents have 15 children. Wouldn't that be enough? And then the children would get plenty of support, and nurturing, and mentoring, and the world population would decline very rapidly and everybody would be totally happy.

La plupart des gens font environ 1,55 mètre de haut ou plus, et il y a une perte cube. Donc, si vous les faites grands comme ça - en utilisant la nanotechnologie, je suppose - (Rires) - Alors vous pourriez enavoir mille fois plus. Cela réglerait le problème, mais je ne vois personne faire des recherches sur comment rendre les personnes plus petites. Maintenant, il est bon de réduire la population, mais beaucoup de gens veulent avoir des enfants. Et il y a une solution qui apparaitra probablement dans quelques années. Vous savez que vous avez 46 chromosomes. Si vous êtes chanceux, vous en avez obtenu 23 de chaque parent, parfois vous obtenez un de plus ou un de moins, mais - donc vous pouvez sauter l'étape des grands-parents et arrière grands-parents et aller droit aux arrière-arrière-grands-parents. Et vous avez 46 personnes et vous leur faites passer un scanner, ou ce dont vous avez besoin, et ils regardent leurs chromosomes et chacun d'eux dit celui qu'il aime le mieux, ou elle - plus aucune raison d'avoir seulement deux sexes en fait. Donc, chaque enfant dispose de 46 parents, et je suppose que vous pourriez laisser chaque groupe de 46 parents avoir 15 enfants - ne serait-ce pas suffisant? Et puis les enfants recevraient beaucoup de soutien et de soin et de tutorat et la population mondiale déclinerait très rapidement et tout le monde serait tout à fait heureux.

Timesharing is a little further off in the future. And there's this great novel that Arthur Clarke wrote twice, called "Against the Fall of Night" and "The City and the Stars." They're both wonderful and largely the same, except that computers happened in between. And Arthur was looking at this old book, and he said, "Well, that was wrong. The future must have some computers." So in the second version of it, there are 100 billion or 1,000 billion people on Earth, but they're all stored on hard disks or floppies, or whatever they have in the future. And you let a few million of them out at a time. A person comes out, they live for a thousand years doing whatever they do, and then, when it's time to go back for a billion years -- or a million, I forget, the numbers don't matter -- but there really aren't very many people on Earth at a time. And you get to think about yourself and your memories, and before you go back into suspension, you edit your memories and you change your personality and so forth. The plot of the book is that there's not enough diversity, so that the people who designed the city make sure that every now and then an entirely new person is created. And in the novel, a particular one named Alvin is created. And he says, maybe this isn't the best way, and wrecks the whole system.

La multipropriété est un peu plus loin dans l'avenir. Et il y a ce grand roman qu'Arthur Clarke a écrit deux fois, appelé Contre la Tombée de la Nuit et La Ville et les Etoiles. Les deux sont merveilleux et largement identiques sauf que les ordinateurs sont apparus entre les deux. Et Arthur regardait ce vieux livre, et il a dit ce qui n'allait pas. L'avenir doit avoir des ordinateurs. Donc, dans la deuxième version du livre, il y a 100 milliards ou 1.000 milliards de personnes sur Terre, mais ils sont tous stockés sur des disques durs ou des disquettes, ou ce qu'ils ont dans l'avenir. Et vous laissez quelques millions d'entre eux sortir à la fois. Une personne sort, elle vit un millier d'années fait ce qu'elle fait, et puis, quand il est temps de revenir pour un milliard d'années - ou un million, je ne sais plus, les chiffres n'ont pas d'importance - mais il y a vraiment très peu de gens sur la terre à la fois. Et vous vous mettez à réfléchir sur vous-même et vos souvenirs, et avant de retourner en suspension, vous modifier vos souvenirs et vous modifiez votre personnalité et ainsi de suite. L'intrigue du livre est qu'il n'y a pas assez de diversité, et donc les gens qui ont conçu la ville se sont assurés que de temps à autre une personne entièrement nouvelle est créée. Et dans le roman, un individu nommé Alvin est créé. Et il dit: c'est peut-être pas la meilleure façon, et des épaves de l'ensemble du système.

I don't think the solutions that I proposed are good enough or smart enough. I think the big problem is that we're not smart enough to understand which of the problems we're facing are good enough. Therefore, we have to build super intelligent machines like HAL. As you remember, at some point in the book for "2001," HAL realizes that the universe is too big, and grand, and profound for those really stupid astronauts. If you contrast HAL's behavior with the triviality of the people on the spaceship, you can see what's written between the lines. Well, what are we going to do about that? We could get smarter. I think that we're pretty smart, as compared to chimpanzees, but we're not smart enough to deal with the colossal problems that we face, either in abstract mathematics or in figuring out economies, or balancing the world around. So one thing we can do is live longer. And nobody knows how hard that is, but we'll probably find out in a few years. You see, there's two forks in the road. We know that people live twice as long as chimpanzees almost, and nobody lives more than 120 years, for reasons that aren't very well understood. But lots of people now live to 90 or 100, unless they shake hands too much or something like that. And so maybe if we lived 200 years, we could accumulate enough skills and knowledge to solve some problems. So that's one way of going about it. And as I said, we don't know how hard that is. It might be -- after all, most other mammals live half as long as the chimpanzee, so we're sort of three and a half or four times, have four times the longevity of most mammals. And in the case of the primates, we have almost the same genes. We only differ from chimpanzees, in the present state of knowledge, which is absolute hogwash, maybe by just a few hundred genes.

Je ne pense pas que les solutions que j'ai proposées soient assez bonnes ou assez intelligentes. Je pense que le gros problème est que nous ne sommes pas assez intelligents pour comprendre quels sont les problèmes assez bons parmis ceux auxquels nous sommes confrontés. Par conséquent, nous devons construire des machines super intelligentes comme HAL. Comme vous le savez, à un moment donné dans le livre pour l'année 2001, HAL se rend compte que l'univers est trop grand et grandiose et profond pour ces astronautes vraiment stupide. Si vous comparez le comportement de HAL avec la trivialité de la population sur le vaisseau spatial, vous pouvez voir ce qui est écrit entre les lignes. Eh bien, qu'allons-nous faire à ce sujet? Nous pourrions devenir plus intelligent. Je pense que nous sommes assez intelligents, comparativement à des chimpanzés, mais nous ne sommes pas assez intelligents pour faire face aux énormes problèmes auxquels nous sommes confrontés, que ce soit en mathématiques abstraites ou pour comprendre les économies ou l'équilibre du monde qui nous entoure. Donc, une chose que nous pouvons faire, c'est vivre plus longtemps. Et personne ne sait combien c'est difficile, mais nous allons probablement le découvrir dans quelques années. Vous voyez, il y a deux embranchements de la route. Nous savons que les gens vivent deux fois plus longtemps que les chimpanzés, ou presque, et personne ne vit plus de 120 ans, pour des raisons qu'on ne comprend pas très bien. Mais beaucoup de gens vivent maintenant à 90 ou 100, à moins qu'ils ne se serrent la main trop souvent ou quelque chose comme ça. Et alors peut-être si nous vivions 200 ans, nous pourrions accumuler suffisamment de compétences et de connaissances pour résoudre certains problèmes. Donc, c'est une façon de s'y prendre. Et comme je l'ai dit, nous ne savons pas combien c'est difficile. Ce serait peut-être - Après tout, la plupart des autres mammifères vivent moitié moins long que le chimpanzé, Nous avons donc trois fois et demi ou quatre fois - disont quatre fois la longévité de la plupart des mammifères. Et dans le cas des primates, nous avons presque les mêmes gènes. Nous ne différons des chimpanzés dans l'état actuel des connaissances - ce qui est une foutaise absolue - peut-être par quelques centaines de gènes.

What I think is that the gene counters don't know what they're doing yet. And whatever you do, don't read anything about genetics that's published within your lifetime, or something. (Laughter) The stuff has a very short half-life, same with brain science. And so it might be that if we just fix four or five genes, we can live 200 years. Or it might be that it's just 30 or 40, and I doubt that it's several hundred. So this is something that people will be discussing and lots of ethicists -- you know, an ethicist is somebody who sees something wrong with whatever you have in mind. (Laughter) And it's very hard to find an ethicist who considers any change worth making, because he says, what about the consequences? And, of course, we're not responsible for the consequences of what we're doing now, are we? Like all this complaint about clones. And yet two random people will mate and have this child, and both of them have some pretty rotten genes, and the child is likely to come out to be average. Which, by chimpanzee standards, is very good indeed.

Ce que je pense, c'est que les compteurs de gène ne savent pas ce qu'ils font pour le moment. Et quoi que vous fassiez, ne lisez rien sur la génétique qu'on publiera de votre vivant. (Rires) C'est un sujet qui a une demi-vie très courte, pareil pour la science du cerveau. Et donc peut-être que si nous réparons quatre ou cinq gènes, nous pouvons vivre 200 ans. Ou il se pourrait que ce soit juste 30 ou 40, et je doute que ce soit plusieurs centaines. Donc, c'est quelque chose dont les gens vont débattre et beaucoup de spécialistes de l'éthique - vous savez, un éthicien est quelqu'un qui voit quelque chose de mal avec ce que vous avez à l'esprit. (Rires) Et il est très difficile de trouver un éthicien qui considère qu'un changement quelconque vaille la peine, parce que, dit-il, qu'en est-il des conséquences? Et bien sûr, nous ne sommes pas responsables des conséquences de ce que nous faisons maintenant, n'est-ce pas? Comme toutes ces plaintes au sujet des clones. Et pourtant, deux personnes au hasard s'accoupleront et feront cet enfant, et tous les deux ont des gènes assez pourris, et l'enfant est susceptible de n'être que moyen. Et selon les normes chimpanzé, c'est vraiment très bien.

If we do have longevity, then we'll have to face the population growth problem anyway. Because if people live 200 or 1,000 years, then we can't let them have a child more than about once every 200 or 1,000 years. And so there won't be any workforce. And one of the things Laurie Garrett pointed out, and others have, is that a society that doesn't have people of working age is in real trouble. And things are going to get worse, because there's nobody to educate the children or to feed the old. And when I'm talking about a long lifetime, of course, I don't want somebody who's 200 years old to be like our image of what a 200-year-old is -- which is dead, actually.

Si nous avons la longévité, alors nous aurons à faire face à la croissance de la population de toute façon. Parce que si les gens vivent 200 ou 1000 ans, nous ne pouvons leur laisser faire un enfant q'environ une fois tous les 200 ou 1.000 ans. Et il n'y aura pas de main-d'œuvre. Et une des choses que Laurie Garrett et d'autres ont souligné, est qu'une société qui ne possède pas de gens en âge de travailler est en réelle difficulté. Et les choses vont s'aggraver, car il n'y a personne pour éduquer les enfants ou pour nourrir les personnes âgées. Et quand je parle d'une longue durée de vie, bien sûr, je ne veux pas que quelqu'un qui a 200 ans ressemble à l'image de quelqu'un de 200 ans - c'est-à-dire mort, en fait.

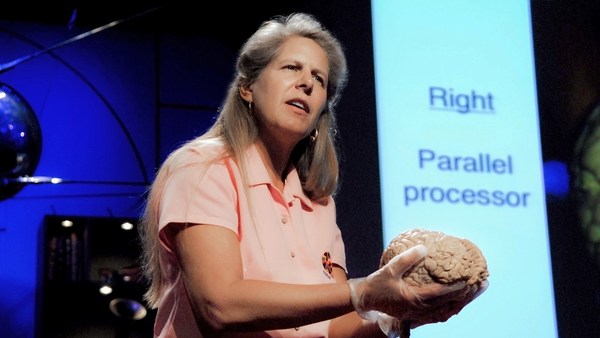

You know, there's about 400 different parts of the brain which seem to have different functions. Nobody knows how most of them work in detail, but we do know that there're lots of different things in there. And they don't always work together. I like Freud's theory that most of them are cancelling each other out. And so if you think of yourself as a sort of city with a hundred resources, then, when you're afraid, for example, you may discard your long-range goals, but you may think deeply and focus on exactly how to achieve that particular goal. You throw everything else away. You become a monomaniac -- all you care about is not stepping out on that platform. And when you're hungry, food becomes more attractive, and so forth. So I see emotions as highly evolved subsets of your capability. Emotion is not something added to thought. An emotional state is what you get when you remove 100 or 200 of your normally available resources.

Vous savez, il y a environ 400 différentes parties du cerveau qui semblent avoir des fonctions différentes. Personne ne sait comment la plupart d'entre elles travaillent dans le détail, mais nous savons qu'il y a beaucoup de différentes choses là-dedans. Et elles ne travaillent pas toujours ensemble. J'aime la théorie de Freud que la plupart d'entre elles s'annulent mutuellement. Et si vous pensez que vous-même êtes comme une sorte de ville avec une centaine de ressources, puis, quand vous avez peur, par exemple, vous pouvez laisser tomber vos objectifs à long terme, mais vous pouvez penser profondément et vous concentrer sur comment atteindre cet objectif particulier exactement . Vous laissez tomber tout le reste de suite. Vous devenez monomaniaque - Tout ce qui vous intéresse est de ne pas descendre de ce quai. Et quand vous avez faim, la nourriture devient plus attrayante, et ainsi de suite. Je vois donc les émotions comme des sous-ensembles très évolués de vos capacités. L'émotion n'est pas quelque chose en plus de la pensée. Un état émotionnel est ce que vous obtenez lorsque vous supprimez 100 ou 200 de vos ressources normalement disponibles.

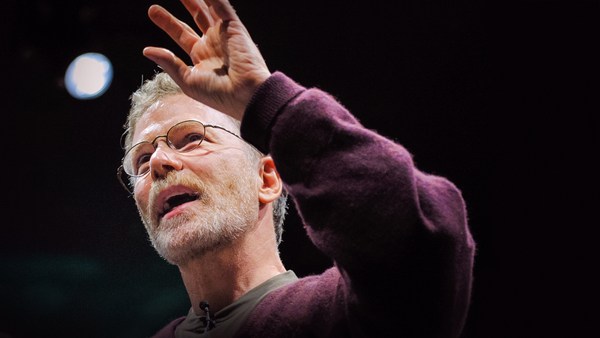

So thinking of emotions as the opposite of -- as something less than thinking is immensely productive. And I hope, in the next few years, to show that this will lead to smart machines. And I guess I better skip all the rest of this, which are some details on how we might make those smart machines and -- (Laughter) -- and the main idea is in fact that the core of a really smart machine is one that recognizes that a certain kind of problem is facing you. This is a problem of such and such a type, and therefore there's a certain way or ways of thinking that are good for that problem. So I think the future, main problem of psychology is to classify types of predicaments, types of situations, types of obstacles and also to classify available and possible ways to think and pair them up. So you see, it's almost like a Pavlovian -- we lost the first hundred years of psychology by really trivial theories, where you say, how do people learn how to react to a situation? What I'm saying is, after we go through a lot of levels, including designing a huge, messy system with thousands of ports, we'll end up again with the central problem of psychology. Saying, not what are the situations, but what are the kinds of problems and what are the kinds of strategies, how do you learn them, how do you connect them up, how does a really creative person invent a new way of thinking out of the available resources and so forth.

Ainsi penser que les émotions sont le contraire de quelque chose inférieur à la pensée est extrêmement productive. Et j'espère, dans les années qui viennent, montrer que cela conduira à des machines intelligentes. Et je suppose que je ferais mieux de sauter tout le reste, ce sont des détails sur la façon dont nous pourrions rendre ces machines «intelligentes» et - (Rires) - et l'idée principale est en fait que le noyau d'une machine vraiment intelligente est celle qui reconnaît qu'un certain type de problème se pose à vous. Il s'agit d'un problème de tel ou tel type, et donc il y a une certaine façon ou plusieurs certaines façons de penser qui sont bonnes pour ce problème. Je pense donc que le problème principal à venir de la psychologie est de classer les types de situations difficiles, les types de situations, les types d'obstacles et aussi de classer les moyens disponibles et possibles de penser et de les apparier. Donc, vous voyez, c'est presque comme un réflexe pavlovien - nous avons perdu les cent premières années de la psychologie avec des théories vraiment triviales où vous dites, comment les gens apprennent à réagir à une situation? Ce que je dis c'est, qu'une fois ce niveau passé, y compris la conception d'un immense système désordonné avec des milliers de pièces, nous finirons à nouveau avec le problème central de la psychologie. En disant, non pas ce que sont les situations, mais quels sont les types de problèmes et quels sont les types de stratégies, comment les apprendre, comment les connecter, comment une personne très créative invente une nouvelle façon de penser à partir des ressources disponibles et ainsi de suite.

So, I think in the next 20 years, if we can get rid of all of the traditional approaches to artificial intelligence, like neural nets and genetic algorithms and rule-based systems, and just turn our sights a little bit higher to say, can we make a system that can use all those things for the right kind of problem? Some problems are good for neural nets; we know that others, neural nets are hopeless on them. Genetic algorithms are great for certain things; I suspect I know what they're bad at, and I won't tell you. (Laughter)

Je pense donc que dans les 20 prochaines années, si nous pouvons nous débarrasser de toutes les approches traditionnelles de l'intelligence artificielle, comme les réseaux neuronaux et algorithmes génétiques et les systèmes à base de règles, et qu'on se contente de viser un peu plus haut pour dire, pouvons-nous faire un système qui puisse utiliser toutes ces choses pour le bon type de problème? Certains problèmes sont bons pour les réseaux neuronaux; Nous savons que d'autres, des réseaux neuronaux ne leur servent à rien. Les algorithmes génétiques sont super pour certaines choses; Je pense savoir dans quels cas ils sont mauvais à et je ne vous le dirai pas. (Rires)

Thank you. (Applause)

Merci. (Applaudissements)