Wenn man Menschen fragt, welcher Teil der Psychologie schwer sei, und man sagt, gut, was ist mit Gedanken und Emotionen, die meisten Menschen werden sagen, "Emotionen sind sehr schwer. Sie sind unglaublich komplex, - Ich habe keine Idee wie sie funktionieren. Aber Denken ist wirklich sehr geradlinig: Es ist einfach nur eine Art logische Überlegung oder soetwas. Aber das ist nicht der schwere Teil."

If you ask people about what part of psychology do they think is hard, and you say, "Well, what about thinking and emotions?" Most people will say, "Emotions are terribly hard. They're incredibly complex. They can't -- I have no idea of how they work. But thinking is really very straightforward: it's just sort of some kind of logical reasoning, or something. But that's not the hard part."

Hier ist eine Liste von Problemen die auftauchen. Ein nettes Problem ist: Was tun wir für unsere Gesundheit? An einem anderen Tag las ich etwas, und die Person sagte die wahrscheinlich größte Einzelursache für Krankheiten im Westen ist Händeschütteln. Und da gab es eine kleine Studie über Menschen die keine Hände schütteln, verglichen mit denen die Händeschütteln, und ich habe nicht die leiseste Ahnung wo sie die finden die keine Hände schütteln, denn die müssen sich verstecken. Und die Menschen die das vermeiden haben 30 Prozent weniger ansteckende Krankheiten oder so ähnlich. Oder vielleicht war es 31 und ein Viertel Prozent. Also wenn Sie wirklich das Problem von Epidemien und so weiter lösen wollen, lasst uns damit anfangen. Und seitdem ich die Idee hatte, musste ich Hunderte von Händen schütteln. Und ich denke der einzige Weg es zu vermeiden ist eine schreckliche erkennbare Krankheit zu haben, und dann müssen Sie sich nicht erklären.

So here's a list of problems that come up. One nice problem is, what do we do about health? The other day, I was reading something, and the person said probably the largest single cause of disease is handshaking in the West. And there was a little study about people who don't handshake, and comparing them with ones who do handshake. And I haven't the foggiest idea of where you find the ones that don't handshake, because they must be hiding. And the people who avoid that have 30 percent less infectious disease or something. Or maybe it was 31 and a quarter percent. So if you really want to solve the problem of epidemics and so forth, let's start with that. And since I got that idea, I've had to shake hundreds of hands. And I think the only way to avoid it is to have some horrible visible disease, and then you don't have to explain.

Bildung: Wie verbessern wir die Bildung? Naja, der einzige gute Weg ist sie dazu zu bringen nachzuvollziehen dass das, was ihnen erzählt wird, eine große Menge Unsinn ist. Und dann, natürlich, müssen Sie etwas tun, wie Sie das transportieren, so damit Ihnen jeder mehr oder weniger zuhört. Umweltverschmutzung, Energieknappheit, ökologische Vielfalt, Armut - Wie schaffen wir stabile Gesellschaften? Langlebigkeit. Okay, es gibt zahlreiche Probleme um sich Gedanken zu machen.

Education: how do we improve education? Well, the single best way is to get them to understand that what they're being told is a whole lot of nonsense. And then, of course, you have to do something about how to moderate that, so that anybody can -- so they'll listen to you. Pollution, energy shortage, environmental diversity, poverty. How do we make stable societies? Longevity. Okay, there're lots of problems to worry about.

Jedenfalls,ich denke, die Frage über die Menschen reden sollten - und es ist absolut tabu - ist: Wieviele Menschen sollte es geben? Und ich denke es sollten um die 100 Millionen oder vielleicht 500 Millionen sein. Und dann bemerkt man, dass ein Großteil dieser Probleme verschwindet. Wenn Sie 100 Millionen Menschen haben, gleichmäßig verteilt, dann, falls es etwas Müll gibt, schmeißen Sie es weg, vorzugsweise wo Sie es nicht sehen können, und es wird verrotten. Oder Sie werfen es in den Ozean und einige Fische werden davon profitieren. Das Problem lautet: wieviele Menschen sollte es geben? Und es ist eine Art Wahl die wir treffen müssen.

Anyway, the question I think people should talk about -- and it's absolutely taboo -- is, how many people should there be? And I think it should be about 100 million or maybe 500 million. And then notice that a great many of these problems disappear. If you had 100 million people properly spread out, then if there's some garbage, you throw it away, preferably where you can't see it, and it will rot. Or you throw it into the ocean and some fish will benefit from it. The problem is, how many people should there be? And it's a sort of choice we have to make.

Die meisten Menschen sind ungefähr 150 cm groß oder größer, und da gibt es kubischen Verlust. Also wenn Sie sie so groß machen - mit Verwendung von z.B. Nanotechnology - (Gelächter) - dann könnten Sie tausendmal so viele haben. Das würde das Problem lösen, aber ich sehe niemanden, der irgendeine Forschung betreibt, um Menschen kleiner zu machen. Nun ist es nett, die Bevölkerung zu reduzieren, aber viele Menschen wollen Kinder haben. Und es gibt eine Lösung, von der wir wahrscheinlich nur noch ein paar Jahre entfernt sind. Sie wissen, Sie haben 46 Chromosomen. Wenn Sie Glück haben, haben Sie 23 von jedem Elternteil; manchmal bekommen Sie eins extra oder verlieren eins aber - also können Sie das Großeltern und Urgroßeltern Stadium überspringen und direkt zu den Ururgroßeltern gehen. Das sind 46 Leute und Sie geben ihnen einen Scanner, oder was immer sie brauchen, und sie schauen auf ihre Chromosomen und jeder bestimmt, welches er am meisten mag, oder sie - egal welches Geschlecht. Also hat jedes Kind 46 Eltern, und ich nehme an Sie können jede Gruppe der 46 Eltern 15 Kinder haben lassen - Wäre das nicht genug? Und dann würden die Kinder jede Menge an Unterstützung und Pflege und Betreuung bekommen und die Weltbevölkerung würde sehr schnell sinken und jeder wäre total glücklich.

Most people are about 60 inches high or more, and there's these cube laws. So if you make them this big, by using nanotechnology, I suppose -- (Laughter) -- then you could have a thousand times as many. That would solve the problem, but I don't see anybody doing any research on making people smaller. Now, it's nice to reduce the population, but a lot of people want to have children. And there's one solution that's probably only a few years off. You know you have 46 chromosomes. If you're lucky, you've got 23 from each parent. Sometimes you get an extra one or drop one out, but -- so you can skip the grandparent and great-grandparent stage and go right to the great-great-grandparent. And you have 46 people and you give them a scanner, or whatever you need, and they look at their chromosomes and each of them says which one he likes best, or she -- no reason to have just two sexes any more, even. So each child has 46 parents, and I suppose you could let each group of 46 parents have 15 children. Wouldn't that be enough? And then the children would get plenty of support, and nurturing, and mentoring, and the world population would decline very rapidly and everybody would be totally happy.

Timesharing ist ein wenig weiter weg in der Zukunft. Und es gibt diesen großartige Roman den Arthur Clarke zweimal schrieb, genannt Diesseits der Dämmerung und Die sieben Sonnen. SIe sind beide wundervoll und größtenteils identisch, außer das inzwischen Computer entwickelt wurden. Und Arthur schaute auf das alte Buch, und er sagte, gut, das war falsch. Die Zukunft muss einige Computer haben. Also in der zweiten Version davon, gibt es 100 Milliarden, oder 1,000 Millarden Menschen auf der Erde, aber sie sind alle auf Festplatten oder Disketten gespeichert, oder was immer sie in der Zukunft haben. Und man lässt ein paar Millionen davon zur selben Zeit raus. Eine Person kommt raus, sie leben für eintausend Jahre tun was immer sie tun, und dann, wenn es Zeit ist zurück zu gehen für eine Milliarde Jahre - oder eine Million, ich vergaß, die Zahlen spielen keine Rolle - aber es gibt wirklich nur sehr wenig Menschen auf der Erde zur selben Zeit. Und man beginnt nachzudenken über sich selbst und seine Erinnerungen, und bevor man zurück in die Versenkung geht verändert man seine Erinnerung und man verändert seine Persönlichkeit und so weiter. Die Handlung des Buches ist das es nicht genug Vielfalt gibt, also müssen die Menschen die die Stadt entworfen haben sicherstellen, dass hin und wieder eine komplett neue Person erzeugt wird. Und im Roman, eine bestimmte namens Alvin wird erzeugt. Und er sagt, vielleicht ist das nicht der beste Weg, und zerstört das ganze System.

Timesharing is a little further off in the future. And there's this great novel that Arthur Clarke wrote twice, called "Against the Fall of Night" and "The City and the Stars." They're both wonderful and largely the same, except that computers happened in between. And Arthur was looking at this old book, and he said, "Well, that was wrong. The future must have some computers." So in the second version of it, there are 100 billion or 1,000 billion people on Earth, but they're all stored on hard disks or floppies, or whatever they have in the future. And you let a few million of them out at a time. A person comes out, they live for a thousand years doing whatever they do, and then, when it's time to go back for a billion years -- or a million, I forget, the numbers don't matter -- but there really aren't very many people on Earth at a time. And you get to think about yourself and your memories, and before you go back into suspension, you edit your memories and you change your personality and so forth. The plot of the book is that there's not enough diversity, so that the people who designed the city make sure that every now and then an entirely new person is created. And in the novel, a particular one named Alvin is created. And he says, maybe this isn't the best way, and wrecks the whole system.

Ich denke nicht, dass die Lösungen die ich vorschlug gut genug oder intelligent genug sind. Ich denke das große Problem ist, das wir nicht schlau genug sind zu verstehen welche der Probleme denen wir begegnen gut genug sind. Deshalb müssen wir super intelligente Maschinen wie HAL bauen. Erinnern Sie sich an einem Punkt des Buches "2001", wo HAL realisiert, dass das Universum zu groß und prachtvoll und tiefgründig für diese wirklich dummen Astronauten ist. Falls man HAL's Verhalten mit der Trivialität der Menschen auf dem Raumschiff vergleicht, kann man erkennen, was zwischen den Zeilen geschrieben steht. Nun, was werden wir dagegen tun? Wir können schlauer werden. Ich glaube, dass wir ziemlich schlau sind, verglichen mit Schimpansen, aber wir sind nicht schlau genug, um die kolossalen Problem zu lösen, die vor uns stehen, weder mit abstrakter Mathematik oder mit Wirtschaft, oder die Welt in Gleichgewicht zu halten. Nun eine Sache die wir tun können is,t länger leben. Und niemand weiß, wie schwer das ist, aber wir werden es vermutlich in ein paar Jahren herausfinden. Man sieht, es gibt zwei Gabelungen auf dem Weg. Wir wissen das Menschen doppelt so lange wie Schimpansen leben, beinahe, und niemand lebt länger als 120 Jahre, aus Gründen die man noch nicht versteht. Aber viele Menschen leben zurzeit bis 90 oder 100, außer sie schütteln zu viele Hände oder sowas ähnliches. Wenn wir aber 200 Jahre leben würden, könnten wir genug Fähigkeiten und Wissen sammeln um manche Probleme zu lösen. Das wäre also ein Weg, den man einschlagen könnte. Und wie ich sagte, wir wissen nicht wie schwer es ist. Die meisten anderen Säugetieren leben halb so lang wie die Schimpansen, also leben wir dreieinhalb oder viermal länger, als die meisten Säugetiere. Und im Fall der Primaten, haben wir fast die selben Gene. Wir unterscheiden uns von Schimpansen, im momentaten Zustand unseres Wissens - welcher absoluter Quatsch ist - vielleicht in lediglich ein paar hundert Genen.

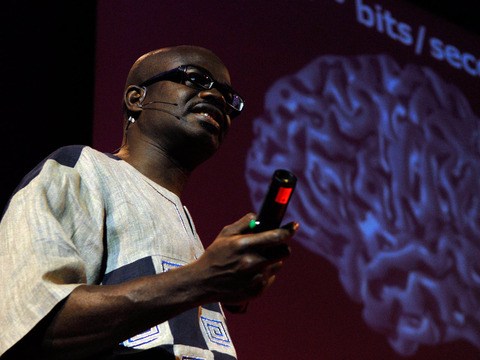

I don't think the solutions that I proposed are good enough or smart enough. I think the big problem is that we're not smart enough to understand which of the problems we're facing are good enough. Therefore, we have to build super intelligent machines like HAL. As you remember, at some point in the book for "2001," HAL realizes that the universe is too big, and grand, and profound for those really stupid astronauts. If you contrast HAL's behavior with the triviality of the people on the spaceship, you can see what's written between the lines. Well, what are we going to do about that? We could get smarter. I think that we're pretty smart, as compared to chimpanzees, but we're not smart enough to deal with the colossal problems that we face, either in abstract mathematics or in figuring out economies, or balancing the world around. So one thing we can do is live longer. And nobody knows how hard that is, but we'll probably find out in a few years. You see, there's two forks in the road. We know that people live twice as long as chimpanzees almost, and nobody lives more than 120 years, for reasons that aren't very well understood. But lots of people now live to 90 or 100, unless they shake hands too much or something like that. And so maybe if we lived 200 years, we could accumulate enough skills and knowledge to solve some problems. So that's one way of going about it. And as I said, we don't know how hard that is. It might be -- after all, most other mammals live half as long as the chimpanzee, so we're sort of three and a half or four times, have four times the longevity of most mammals. And in the case of the primates, we have almost the same genes. We only differ from chimpanzees, in the present state of knowledge, which is absolute hogwash, maybe by just a few hundred genes.

Was ich denke ist, dass die Genzähler nicht wissen was sie bisher tun. Und was immer Sie tun, lesen Sie nichts über Genetik was zu Ihrer Lebenszeit veröffentlicht wurde. (Gelächter) Das Zeug hat eine sehr kurze Halbwertszeit, dasselbe gilt für die Gehirnforschung. Es könnte sein, dass wenn wir vier oder fünf Gene reparieren, wir 200 Jahre leben können. Oder es könnte sein, dass es nur 30 oder 40 sind, und ich bezweifel, dass es mehrere Hundert sind. Nun das ist etwas, das Menschen diskutieren werden und viel Ethik - Sie wissen, ein Ethiker ist jemand der ein Problem sieht, egal welche Gedanken Sie haben. (Gelächter) Und es ist sehr schwer einen Ethiker zu finden, der irgendeine Veränderung von Wert erwägt, denn er sagt, was ist mit den Konsequenzen? Und natürlich, wir sind nicht verantwortlich für die Konsequenzen für das was wir gerade tun, oderr? Wie diese ganzen Bedenken ums Klonen. Und dennoch werden sich zwei zufällige Leute paaren und ein Kind bekommen, und beide haben einige ziemlich miese Gene, und es ist wahrscheinlich, dass das Kind durchschnittlich wird. Was bei Schimpansenmaßstäben tatsächlich sehr gut ist.

What I think is that the gene counters don't know what they're doing yet. And whatever you do, don't read anything about genetics that's published within your lifetime, or something. (Laughter) The stuff has a very short half-life, same with brain science. And so it might be that if we just fix four or five genes, we can live 200 years. Or it might be that it's just 30 or 40, and I doubt that it's several hundred. So this is something that people will be discussing and lots of ethicists -- you know, an ethicist is somebody who sees something wrong with whatever you have in mind. (Laughter) And it's very hard to find an ethicist who considers any change worth making, because he says, what about the consequences? And, of course, we're not responsible for the consequences of what we're doing now, are we? Like all this complaint about clones. And yet two random people will mate and have this child, and both of them have some pretty rotten genes, and the child is likely to come out to be average. Which, by chimpanzee standards, is very good indeed.

Wenn wir Langlebigkeit erreichen, dann müssen wir dem Bevölkerungswachstums- problem ohnehin begegnen. Denn wenn Menschen 200 oder 1,000 Jahre leben, dann können wir sie nicht öfter als einmal alle 200 oder 1,000 Jahre ein Kind bekommen lassen. Und somit wären keine Arbeitskräftet vorhanden. Und eine der Sachen die Laurie Garrett und andere aufgezeigt haben, ist, dass eine Gesellschaft die keine Menschen im Arbeitsfähigen Alter hat, in echten Schwierigkeiten ist. Und die Dinge werden schlimmer, denn es gibt niemanden der die Kinder erzieht oder die Alten ernährt. Undn wenn ich über eine lange Lebensspanne rede, natürlich, meine ich nicht jemanden der mit 200 Jahren so alt aussieht, wie wir ihn uns vorstellen - er wäre natürlich tot.

If we do have longevity, then we'll have to face the population growth problem anyway. Because if people live 200 or 1,000 years, then we can't let them have a child more than about once every 200 or 1,000 years. And so there won't be any workforce. And one of the things Laurie Garrett pointed out, and others have, is that a society that doesn't have people of working age is in real trouble. And things are going to get worse, because there's nobody to educate the children or to feed the old. And when I'm talking about a long lifetime, of course, I don't want somebody who's 200 years old to be like our image of what a 200-year-old is -- which is dead, actually.

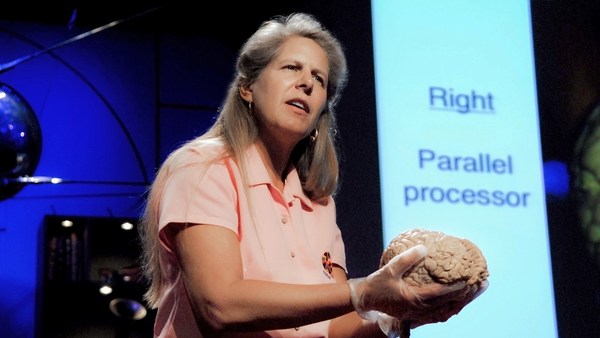

Sie wissen, es gibt ungefähr 400 verschieden Teile des Gehirns welche dem Anschein nach verschiedene Funktionen haben. Niemand weiß wie die meisten davon im Detail arbeiten, aber wir wissen, dass es dort eine Menge von verschiedenen Dingen gibt. Und sie arbeiten nicht immer miteinander. Ich mag Freud's Theorie dass die meisten davon sich gegenseitig aufheben. Und nun wenn Sie sich selbst als eine Art Stadt denken mit hunderten Ressourcen, dann wenn sie z.B. Angst haben werden Sie vermutlich längerfristige Ziele vernachlässigen, aber Sie werden vermutlich stärker nachdenken und sich darauf konzentrieren, wie Sie ein Teilziel erreichen können. Sie räumen alles andere aus dem Weg.. Sie werden ein Monomane - alles, um das Sie sich kümmern, ist, nicht über die Plattform hinauszugehen. Und wenn Sie hungrig sind, wird Nahrung attraktiver werden, und so weiter. Also ich sehe Gefühle als eine hochentwickelte Untergruppe ihrer Fähigkeiten. Emotion ist nicht etwas, dass dem Denken hinzugefügt wird. Ein emotionaler Zustand ist etwas, das man bekommt, wenn man 100 oder 200 der Ihnen normal verfügbaren Ressourcen entfernt.

You know, there's about 400 different parts of the brain which seem to have different functions. Nobody knows how most of them work in detail, but we do know that there're lots of different things in there. And they don't always work together. I like Freud's theory that most of them are cancelling each other out. And so if you think of yourself as a sort of city with a hundred resources, then, when you're afraid, for example, you may discard your long-range goals, but you may think deeply and focus on exactly how to achieve that particular goal. You throw everything else away. You become a monomaniac -- all you care about is not stepping out on that platform. And when you're hungry, food becomes more attractive, and so forth. So I see emotions as highly evolved subsets of your capability. Emotion is not something added to thought. An emotional state is what you get when you remove 100 or 200 of your normally available resources.

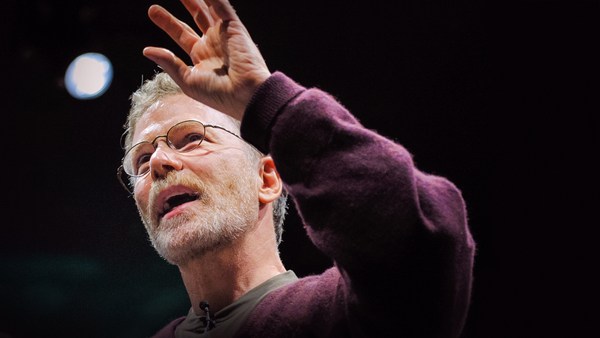

Nun an Gefühle denken als Gegenteil von ... als etwas weniger als Denken ist immens produktiv. Und ich hoffe, innerhalb der nächsten Jahre, zu zeigen dass das zu intelligenten Maschinen führen wird. Und ich denke ich überspringe besser den ganzen Rest davon, was ein paar Details sind darüber wie wir diese intelligenten Maschinen machen könnten und - (Gelächter) - und die Grundidee ist eigentlich die, dass der Kern einer wirklichen intelligenten Maschine einer ist der erkennen kann, dass man einer bestimmten Art von Problem gegenübersteht. Das ist ein Problem von dem und dem Typ, und deshalb gibt es einen bestimmten Weg oder Wege zu denken, der Gut für dieses Problem ist. Also ich denke das Hauptproblem der Zukunft der Psychologie ist es Typen von Zwickmühlen, Typen von Situationen, Typen von Hindernissen zu klassifizieren und weiter verfügbare und mögliche Wege des Denkens zu klassifizieren und diese zu verbinden. Also Sie sehen, es ist nahezu wie ein pawloscher Reiz- wir haben die ersten hundert Jahre der Psychologie verloren mit wirklichen trivialen Theorien, welche behaupten, wie Menschen lernen, wie sie auf eine Situation reagieren? Was ich sage ist, nachem wir verschiedene Ebenen marschiert sind, bzw. sie kreiert haben, ein großes chaotisches System mit tausenden Teilen, werden wir wieder beim Kernproblem der Psychologie landen. Erklären, nicht was die Situationen sind, sondern was die Arten der Probleme sind und welcher Art die Strategien sind, und wie wir sie lernen, wie man sie verbindet, wie tut eine wirkliche kreative Person eine neue Art des Denkens erfinden aus den verfügbaren Ressourcen und so weiter.

So thinking of emotions as the opposite of -- as something less than thinking is immensely productive. And I hope, in the next few years, to show that this will lead to smart machines. And I guess I better skip all the rest of this, which are some details on how we might make those smart machines and -- (Laughter) -- and the main idea is in fact that the core of a really smart machine is one that recognizes that a certain kind of problem is facing you. This is a problem of such and such a type, and therefore there's a certain way or ways of thinking that are good for that problem. So I think the future, main problem of psychology is to classify types of predicaments, types of situations, types of obstacles and also to classify available and possible ways to think and pair them up. So you see, it's almost like a Pavlovian -- we lost the first hundred years of psychology by really trivial theories, where you say, how do people learn how to react to a situation? What I'm saying is, after we go through a lot of levels, including designing a huge, messy system with thousands of ports, we'll end up again with the central problem of psychology. Saying, not what are the situations, but what are the kinds of problems and what are the kinds of strategies, how do you learn them, how do you connect them up, how does a really creative person invent a new way of thinking out of the available resources and so forth.

Also ich denke in den nächsten 20 Jahren, falls wir die traditionellen Annäherungen an künstliche Intelligenz loswerden können, wie neurale Netze und genetische Algorithmen und regelbasierten Systemen, und sozusagen unseren Blick einfach ein wenig höher richten, können wir ein System herstellen das all diese Dinge verwenden kann für die richtige Art von Problem? Manche Probleme sind gut für neurale Netze, wir kennen andere für die neurale Netze hoffnungslos sind. Genetische Algorithmen sind gut für bestimmte Sachen; ich vermute ich weiß für was sie schlecht sind und ich werde es ihnen nicht erzählen. (Gelächter)

So, I think in the next 20 years, if we can get rid of all of the traditional approaches to artificial intelligence, like neural nets and genetic algorithms and rule-based systems, and just turn our sights a little bit higher to say, can we make a system that can use all those things for the right kind of problem? Some problems are good for neural nets; we know that others, neural nets are hopeless on them. Genetic algorithms are great for certain things; I suspect I know what they're bad at, and I won't tell you. (Laughter)

Dankeschön. (Applaus)

Thank you. (Applause)