Competition. It's a fundamental part of human nature. I was a professional poker player for 10 years, so I've very much seen all the good, bad and ugly ways it can manifest. When it's done right, it can drive us to incredible feats in sports and innovation, like when car companies compete over who can build the safest cars or the most efficient solar panels. Those are all examples of healthy competition, because even though individual companies might come and go, in the long run, the game between them creates win-win outcomes where everyone benefits in the end.

La competizione è una parte fondamentale della natura umana. Sono stata una giocatrice di poker professionista per 10 anni, quindi ho visto bene tutti i buoni, brutti e cattivi modi in cui può manifestarsi. Se fatta bene, può portarci a compiere incredibili imprese nello sport e nell'innovazione, come quando le case automobilistiche competono per costruire le auto più sicure o i pannelli solari più efficienti. Questi sono tutti esempi di competizione sana, perché anche se le singole aziende possono andare e venire, a lungo termine, il gioco tra di loro crea risultati vantaggiosi, in cui alla fine tutti ci guadagnano.

But sometimes competition is not so great and can create lose-lose outcomes where everyone's worse off than before. Take these AI beauty filters, for example. As you can see, they're a very impressive technology. They can salvage almost any picture. They can even make Angelina and Margot more beautiful. So they're very handy, especially for influencers who, now, at the click of a button, can transform into the most beautiful Hollywood versions of themselves. But handy doesn't always mean healthy. And I've personally noticed how quickly these things can train you to hate your natural face. And there's growing evidence that they're creating issues like body dysmorphia, especially in young people.

Ma a volte la competizione non va così bene e può portare a risultati negativi in cui tutti stanno peggio di prima. Prendiamo questi filtri di bellezza basati sull’IA, per esempio. Come potete vedere, sono una tecnologia davvero impressionante. Possono recuperare quasi tutte le immagini. Possono persino rendere più belle Angelina e Margot. Quindi sono molto utili, soprattutto per gli influencer che ora con un clic possono trasformarsi nelle migliori versioni hollywoodiane di sé stessi. Ma utile non significa sempre sano. Ho notato personalmente quanto velocemente queste cose possano indurti a odiare il tuo viso naturale. E ci sono prove crescenti che stiano creando problemi come il dismorfismo corporeo, specialmente nei giovani.

Nonetheless, these things are now endemic to social media because the nature of the game demands it. The platforms are incentivized to provide them because hotter pictures means more hijacked limbic systems, which means more scrolling and thus more ad revenue. And users are incentivized to use them because hotter pictures get you more followers.

Tuttavia, queste cose sono ormai endemiche nei social media perché la natura del gioco lo richiede. Le piattaforme sono incentivate a fornirle perché immagini più fighe significano dirottare più sistemi limbici, il che equivale a fare più scrolling e quindi a più entrate. E gli utenti sono incentivati a usarle perché le foto più fighe fanno guadagnare più follower.

But this is a trap, because once you start using these things, it's really hard to go back. Plus, you don't even get a competitive advantage from them anymore because everyone else is already using them too. So influencers are stuck using these things with all the downsides and very little upside. A lose-lose game.

Ma questa è una trappola, perché una volta che inizi a usare queste cose, è davvero difficile tornare indietro. Inoltre, non ne ottieni nemmeno più un vantaggio competitivo, perché anche tutti gli altri le stanno già utilizzando. Quindi gli influencer sono costretti a usarle con tutti gli aspetti negativi e pochissimi vantaggi. Una partita dove tutti perdono.

A similar kind of trap is playing out in our news media right now, but with much worse consequences. You'd think since the internet came along that the increased competition between news outlets would create a sort of positive spiral, like a race to the top of nuanced, impartial, accurate journalism. Instead, we're seeing a race to the bottom of clickbait and polarization, where even respectable papers are increasingly leaning into these kind of low-brow partisan tactics. Again, this is due to crappy incentives.

Una trappola simile ora si sta diffondendo nei nostri mezzi di informazione ma con conseguenze ben peggiori. Sarebbe lecito pensare che, con l’avvento di internet, la crescente concorrenza tra le testate giornalistiche creasse una sorta di spirale positiva, una corsa al vertice di un giornalismo ricco di sfumature, imparziale e accurato. Stiamo invece vedendo una corsa al ribasso con clickbait e polarizzazione in cui anche giornali rispettabili si stanno sempre più orientando verso questo tipo di tattiche faziose di bassa lega. Ancora una volta, ciò è dovuto a incentivi scadenti.

Today, we no longer just read our news. We interact with it by sharing and commenting. And headlines that trigger emotions like fear or anger are far more likely to go viral than neutral or positive ones. So in many ways, news editors are in a similar kind of trap as the influencers, where, the more their competitors lean into clickbaity tactics, the more they have to as well. Otherwise, their stories just get lost in the noise. But this is terrible for everybody, because now the media get less trust from the public, but also it becomes harder and harder for anyone to discern truth from fiction, which is a really big problem for democracy.

Oggi non leggiamo più solo le nostre notizie. Interagiamo con esse condividendo e commentando. E i titoli che scatenano emozioni come paura o rabbia hanno molte più probabilità di diventare virali di quelli neutri o positivi. Quindi, per molti versi, chi redige le notizie si trova in una trappola simile a quella degli influencer: più i loro concorrenti si appoggiano alle tattiche del clickbait, più sono costretti a farlo anche loro. Altrimenti le loro storie si perdono nel rumore. Ma questo è terribile per tutti, perché ora i media ottengono meno fiducia dal pubblico, ma anche perché è sempre più difficile distinguere la verità dalla finzione, il che è davvero un grosso problema per la democrazia.

Now, this process of competition gone wrong is actually the driving force behind so many of our biggest issues. Plastic pollution, deforestation, antibiotic overuse in farming, arms races, greenhouse gas emissions. These are all a result of crappy incentives, of poorly designed games that push their players -- be them people, companies or governments -- into taking strategies and tactics that defer costs and harms to the future. And what's so ridiculous is that most of the time, these guys don't even want to be doing this. You know, it's not like packaging companies want to fill the oceans with plastic or farmers want to worsen antibiotic resistance. But they’re all stuck in the same dilemma of: "If I don't use this tactic, I’ll get outcompeted by all the others who do. So I have to do it, too.”

Questo processo di concorrenza andato male è in realtà l’elemento trainante di molti dei nostri maggiori problemi. Inquinamento da plastica, deforestazione, uso eccessivo di antibiotici in agricoltura, corsa agli armamenti, emissioni di gas serra. Sono tutti il risultato di incentivi scadenti, di giochi mal progettati che spingono i giocatori, siano essi persone, aziende o governi, a adottare strategie e tattiche che rinviano costi e danni al futuro. E quel che è ridicolo è che la maggior parte delle volte non vogliono nemmeno farlo. Non è che le aziende di imballaggi vogliono riempire gli oceani di plastica o gli agricoltori vogliono peggiorare la resistenza agli antibiotici. Ma sono tutti bloccati nello stesso dilemma: «Se non uso questa tattica, verrò battuto da tutti gli altri che lo fanno. Quindi devo farlo anch'io».

This is the mechanism we need to fix as a civilization. And I know what you're probably all thinking, "So it's capitalism." No, it's not capitalism. Which, yes, can cause problems, but it can also solve them and has been fantastic in general. It's something much deeper. It's a force of misaligned incentives of game theory itself.

Questo è il meccanismo che dobbiamo correggere come civiltà. E so cosa probabilmente state pensando: «Questo è capitalismo». No, non è capitalismo. Che sì, può causare problemi, ma può anche risolverli ed è stato fantastico in generale. È qualcosa di molto più profondo. È una forza di incentivi disallineati della stessa teoria dei giochi.

So a few years ago, I retired from poker, in part because I wanted to understand this mechanism better. Because it takes many different forms, and it goes by many different names. These are just some of those names. You can see they're a little bit abstract and clunky, right? They don't exactly roll off the tongue. And given how insidious and connected all of these problems are, it helps to have a more visceral way of recognizing them.

Così, qualche anno fa, mi sono ritirata dal poker, in parte perché volevo capire meglio questo meccanismo. Perché assume molte forme diverse e ha molti nomi diversi. Questi sono solo alcuni di quei nomi. Riuscite a vedere che sono un po’ astratti e goffi, vero? Non sono proprio semplici da dire. E visto quanto insidiosi e connessi siano tutti questi problemi, è utile avere un modo più viscerale di riconoscerli.

So this is probably the only time you're going to hear about the Bible at this conference. But I want to tell you a quick story from it, because allegedly, back in the Canaanite days, there was a cult who wanted money and power so badly, they were willing to sacrifice their literal children for it. And they did this by burning them alive in an effigy of a God that they believed would then reward them for this ultimate sacrifice. And the name of this god was Moloch. Bit of a bummer, as stories go. But you can see why it's an apt metaphor, because sometimes we get so lost in winning the game right in front of us, we lose sight of the bigger picture and sacrifice too much in our pursuit of victory. So just like these guys were sacrificing their children for power, those influencers are sacrificing their happiness for likes. Those news editors are sacrificing their integrity for clicks, and polluters are sacrificing the biosphere for profit.

Questa è probabilmente l’unica volta che sentirete parlare della Bibbia a questa conferenza. Ma voglio raccontarvi una breve storia, perché presumibilmente, ai tempi dei Cananei, c’era una setta che desiderava così tanto denaro e potere che era disposta a sacrificare i propri figli per averli. E lo fecero bruciandoli vivi in nome di un Dio che, secondo loro, li avrebbe ricompensati per questo sacrificio supremo. E il nome di questo dio era Moloch. Un po’ deludente come storia. Ma potete capire perché è una metafora appropriata: a volte ci concentriamo così tanto nel voler vincere la partita davanti a noi che perdiamo di vista il quadro generale e sacrifichiamo troppo cercando la vittoria. Quindi, proprio come questi uomini sacrificavano i loro figli per il potere, quegli influencer stanno sacrificando la loro felicità per i like. Quei redattori di notizie stanno sacrificando la loro integrità per i clic e chi inquina sta sacrificando la biosfera per il profitto.

In all these examples, the short-term incentives of the games themselves are pushing, they're tempting their players to sacrifice more and more of their future, trapping them in a death spiral where they all lose in the end. That's Moloch's trap. The mechanism of unhealthy competition. And the same is now happening in the AI industry.

In tutti questi esempi, gli stessi incentivi a breve termine dei giochi fanno pressione: invitano i giocatori a sacrificare sempre più il loro futuro, intrappolandoli in una spirale mortale in cui alla fine perderanno tutti. Questa è la trappola di Moloch. Il meccanismo della concorrenza malsana. E lo stesso sta accadendo ora nel settore dell’intelligenza artificiale.

We're all aware of the race that's heating up between companies right now over who can score the most compute, who can get the biggest funding round or get the top talent. Well, as more and more companies enter this race, the greater the pressure for everyone to go as fast as possible and sacrifice other important stuff like safety testing. This has all the hallmarks of a Moloch trap. Because, like, imagine you're a CEO who, you know, in your heart of hearts, believes that your team is the best to be able to safely build extremely powerful AI. Well, if you go too slowly, then you run the risk of other, much less cautious teams getting there first and deploying their systems before you can. So that in turn pushes you to be more reckless yourself. And given how many different experts and researchers, both within these companies but also completely independent ones, have been warning us about the extreme risks of rushed AI, this approach is absolutely mad. Plus, almost all AI companies are beholden to satisfying their investors, a short-term incentive which, over time, will inevitably start to conflict with any benevolent mission.

Conosciamo tutti la corsa che si sta accendendo ora tra le aziende a chi ha più risorse di calcolo, a chi ottiene il round di finanziamento più alto o ha i migliori talenti. Bene, man mano che sempre più aziende partecipano a questa gara, maggiore è la pressione affinché tutti vadano il più velocemente possibile e sacrifichino altre cose importanti, come i test di sicurezza. Questa ha tutte le caratteristiche di una trappola Moloch. Perché immaginate per esempio di essere un amministratore delegato che, nel profondo del suo cuore, crede che il suo team sia il migliore a creare in sicurezza un’IA estremamente potente. Ebbene, se procedete troppo lentamente, correte il rischio che altri team, molto meno cauti, arrivino per primi e distribuiscano i loro sistemi prima di voi. Questo, a sua volta, vi spinge a essere più imprudenti. E visto che molti esperti e ricercatori, sia all'interno di queste aziende che in modo completamente indipendente, ci hanno messo in guardia sui rischi enormi di un’IA creata con troppa fretta, questo approccio è assolutamente folle. Inoltre, quasi tutte le società che si occupano di intelligenza artificiale sono tenute a soddisfare i propri investitori, un incentivo a breve termine che, col tempo, inizierà inevitabilmente a entrare in conflitto con qualsiasi intenzione benevola.

And this wouldn't be a big deal if this was really just toasters we're talking about here. But AI, and especially AGI, is set to be a bigger paradigm shift than the agricultural or industrial revolutions. A moment in time so pivotal, it's deserving of reverence and reflection, not something to be reduced to a corporate rat race of who can score the most daily active users. I'm not saying I know what the right trade-off between acceleration and safety is, but I do know that we'll never find out what that right trade-off is if we let Moloch dictate it for us.

Non sarebbe un grosso problema se stessimo parlando solo di tostapane. Ma l’intelligenza artificiale, e in particolare l’AGI, è destinata a rappresentare un cambiamento più ampio della rivoluzione agricola o industriale. Un momento storico così cruciale, che merita riverenza e riflessione, non qualcosa da ridurre a una folle corsa aziendale su chi riesce ad avere il maggior numero di utenti attivi al giorno. Non sto dicendo di sapere quale sia il giusto compromesso tra accelerazione e sicurezza, ma so che non scopriremo mai quale sia il giusto compromesso se lasciamo che sia Moloch a dettarcelo.

So what can we do? Well, the good news is we have managed to coordinate to escape some of Moloch's traps before. We managed to save the ozone layer from CFCs with the help of the Montreal Protocol. We managed to reduce the number of nuclear weapons on Earth by 80 percent, with the help of the Strategic Arms Reduction Treaty in 1991. So smart regulation may certainly help with AI too, but ultimately, it's the players within the game who have the most influence on it. So we need AI leaders to show us that they're not only aware of the risks their technologies pose, but also the destructive nature of the incentives that they're currently beholden to. As their technological capabilities reach towards the power of gods, they're going to need the godlike wisdom to know how to wield them.

Quindi cosa possiamo fare? Bene, la buona notizia è che siamo già riusciti a coordinarci per sfuggire ad alcune trappole di Moloch. Siamo riusciti a salvare lo strato di ozono dai CFC con l'aiuto del Protocollo di Montreal. Siamo riusciti a ridurre il numero di armi nucleari sulla terra dell′80%, con l’aiuto del Trattato di Riduzione delle Armi Strategiche nel 1991. Quindi una regolamentazione intelligente può sicuramente aiutare anche con l’IA, ma alla fine sono i giocatori all’interno del gioco ad avere la maggiore influenza su di esso. Abbiamo bisogno che i leader dell’IA ci dimostrino che non solo sono consapevoli dei rischi che le loro tecnologie comportano, ma anche della natura distruttiva degli incentivi a cui sono attualmente legati. Man mano che le loro capacità tecnologiche raggiungono il potere degli dei, avranno bisogno della saggezza divina per sapere come usarle.

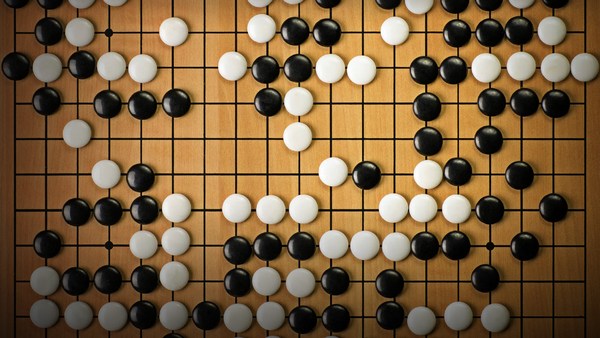

So it doesn't fill me with encouragement when I see a CEO of a very major company saying something like, "I want people to know we made our competitor dance." That is not the type of mindset we need here. We need leaders who are willing to flip Moloch's playbook, who are willing to sacrifice their own individual chance of winning for the good of the whole. Now, fortunately, the three leading labs are showing some signs of doing this. Anthropic recently announced their responsible scaling policy, which pledges to only increase capabilities once certain security criteria have been met. OpenAI have recently pledged to dedicate 20 percent of their compute purely to alignment research. And DeepMind have shown a decade-long focus of science ahead of commerce, like their development of AlphaFold, which they gave away to the science community for free. These are all steps in the right direction, but they are still nowhere close to being enough. I mean, most of these are currently just words, they're not even proven actions.

Quindi non mi conforta tanto vedere l’amministratore delegato di un’azienda molto importante dire: «Voglio che la gente sappia che abbiamo bruciato sul tempo la concorrenza». Non è questo il tipo di mentalità di cui abbiamo bisogno. Abbiamo bisogno di leader disposti a ribaltare le regole di Moloch, disposti a sacrificare le proprie possibilità individuali di vittoria per il bene di tutti. Fortunatamente, i tre laboratori principali stanno mostrando alcuni segnali in tal senso. Anthropic ha recentemente annunciato una politica di scalabilità responsabile, che si impegna ad aumentare le sue capacità solo dopo aver soddisfatto determinati criteri di sicurezza. OpenAI si è recentemente impegnata a dedicare il 20% delle proprie capacità di calcolo soltanto per la ricerca sull’allineamento. Inoltre, DeepMind si concentra da un decennio sulla scienza più che sul commercio con lo sviluppo di AlphaFold, che ha messo a disposizione gratuitamente per la comunità scientifica. Sono tutti passi nella giusta direzione, ma non sono ancora lontanamente sufficienti. Al momento queste sono per la maggior parte parole, non sono azioni dimostrate.

So we need a clear way to turn the AI race into a definitive race to the top.

Quindi dobbiamo trovare un modo chiaro per trasformare la corsa all’IA

Perhaps companies can start competing over who can be within these metrics, over who can develop the best security criteria. A race of who can dedicate the most compute to alignment. Now that would truly flip the middle finger to Moloch.

in una finale verso la vetta. Forse le aziende possono iniziare a competere su chi rientra in questi parametri e su chi saprà sviluppare i migliori criteri di sicurezza. Una corsa a chi sarà in grado di dedicare più risorse di calcolo all’allineamento. Una cosa del genere mostrerebbe davvero il dito medio a Moloch.

Competition can be an amazing tool, provided we wield it wisely. And we're going to need to do that because the stakes we are playing for are astronomical. If we get AI, and especially AGI, wrong, it could lead to unimaginable catastrophe. But if we get it right, it could be our path out of many of these Moloch traps that I've mentioned today. And as things get crazier over the coming years, which they're probably going to, it's going to be more important than ever that we remember that it is the real enemy here, Moloch. Not any individual CEO or company, and certainly not one another.

La concorrenza può essere uno strumento straordinario, a patto di usarla con saggezza. E avremo bisogno di farlo perché la posta in gioco è astronomica. Se sbagliamo l’IA, e soprattutto l’AGI, potremmo provocare una catastrofe inimmaginabile. Ma se lo facciamo bene, potrebbe essere la nostra via d’uscita da molte di queste trappole Moloch di cui ho parlato oggi. E man mano che le cose peggioreranno nei prossimi anni, cosa che probabilmente accadrà, sarà più importante che mai ricordare che è lui il vero nemico, Moloch. Non un amministratore delegato o un’azienda, e certamente non noi stessi.

So don't hate the players, change the game.

Quindi non odiate i giocatori, cambiate il gioco.

(Applause)

(Applausi)