Competition. It's a fundamental part of human nature. I was a professional poker player for 10 years, so I've very much seen all the good, bad and ugly ways it can manifest. When it's done right, it can drive us to incredible feats in sports and innovation, like when car companies compete over who can build the safest cars or the most efficient solar panels. Those are all examples of healthy competition, because even though individual companies might come and go, in the long run, the game between them creates win-win outcomes where everyone benefits in the end.

La competición es una parte fundamental de la naturaleza humana. He sido jugadora profesional de póquer durante 10 años, así que he visto todas las formas buenas, y malas en las que puede manifestarse. Cuando se hace bien, puede llevarnos a hazañas increíbles en el ámbito del deporte y la innovación, como cuando las empresas automovilísticas compiten por quién puede fabricar los coches más seguros o los paneles solares más eficientes. Todos estos son ejemplos de competencia sana, porque, si bien las empresas individuales pueden ir y venir, a la larga, el juego entre ellas crea resultados los que todos salen ganando y, al final, todos se benefician.

But sometimes competition is not so great and can create lose-lose outcomes where everyone's worse off than before. Take these AI beauty filters, for example. As you can see, they're a very impressive technology. They can salvage almost any picture. They can even make Angelina and Margot more beautiful. So they're very handy, especially for influencers who, now, at the click of a button, can transform into the most beautiful Hollywood versions of themselves. But handy doesn't always mean healthy. And I've personally noticed how quickly these things can train you to hate your natural face. And there's growing evidence that they're creating issues like body dysmorphia, especially in young people.

Pero a veces la competencia no es tan genial y puede generar resultados en los que todos pierden, en los que todos están peor que antes. Tomemos, por ejemplo, estos filtros de belleza de IA. Como puedes ver, son una tecnología muy impresionante. Pueden salvar casi cualquier imagen. Pueden incluso embellecer a Angelina y Margot. Por eso son muy útiles, especialmente para las personas influyentes que, con solo hacer clic en un botón, pueden transformarse en las versiones más hermosas de Hollywood de sí mismas. Pero práctico no siempre significa saludable. Y personalmente me he dado cuenta de lo rápido que estas cosas pueden hacer que odies tu rostro natural. Y cada vez hay más pruebas de que están creando problemas como la dismorfia corporal, especialmente en los jóvenes.

Nonetheless, these things are now endemic to social media because the nature of the game demands it. The platforms are incentivized to provide them because hotter pictures means more hijacked limbic systems, which means more scrolling and thus more ad revenue. And users are incentivized to use them because hotter pictures get you more followers.

Sin embargo, estas cosas ahora son endémicas en las redes sociales porque la naturaleza del juego así lo exige. Se incentiva a las plataformas a ofrecerlas, ya que imágenes más atractivas implican más sistemas límbicos secuestrados, más scrolling y, por ende, más ingresos por publicidad. Además, se incentiva a los usuarios a utilizarlas porque imágenes más atractivas generan más seguidores.

But this is a trap, because once you start using these things, it's really hard to go back. Plus, you don't even get a competitive advantage from them anymore because everyone else is already using them too. So influencers are stuck using these things with all the downsides and very little upside. A lose-lose game.

Pero esto es una trampa, porque una vez que empiezas a usar estas cosas, es muy difícil volver atrás. Además, ya ni siquiera obtienes una ventaja competitiva porque todos los demás ya los están usando. Por lo tanto, las personas influyentes se limitan a usar estas cosas con todas las desventajas y muy pocas ventajas. Un juego en el que todos pierden.

A similar kind of trap is playing out in our news media right now, but with much worse consequences. You'd think since the internet came along that the increased competition between news outlets would create a sort of positive spiral, like a race to the top of nuanced, impartial, accurate journalism. Instead, we're seeing a race to the bottom of clickbait and polarization, where even respectable papers are increasingly leaning into these kind of low-brow partisan tactics. Again, this is due to crappy incentives.

Un tipo de trampa similar se está produciendo en nuestros medios de comunicación ahora mismo, pero con consecuencias mucho peores. Con la llegada de Internet, se podría pensar que el aumento de la competencia entre los medios de comunicación crearía una especie de espiral positiva, como una carrera hacia la cima del periodismo matizado, imparcial y preciso. En lugar de eso, asistimos a una carrera hacia abajo de noticias capciosas y polarización, en la que incluso los periódicos más respetables recurren a este tipo de tácticas vulgares y parciales comúnmente asociadas con la política partidista Una vez más, esto se debe a los pésimos incentivos.

Today, we no longer just read our news. We interact with it by sharing and commenting. And headlines that trigger emotions like fear or anger are far more likely to go viral than neutral or positive ones. So in many ways, news editors are in a similar kind of trap as the influencers, where, the more their competitors lean into clickbaity tactics, the more they have to as well. Otherwise, their stories just get lost in the noise. But this is terrible for everybody, because now the media get less trust from the public, but also it becomes harder and harder for anyone to discern truth from fiction, which is a really big problem for democracy.

Hoy, ya no nos limitamos a leer nuestras noticias. Interactuamos con ellas compartiéndolo y comentándolo. Y los titulares que provocan emociones como el miedo o la ira tienen muchas más probabilidades de hacerse virales que los neutrales o positivos. En muchos sentidos, los editores de noticias caen en una trampa similar a la de las personas influyentes, que, cuanto más se inclinan sus competidores por las tácticas de noticas capciosas más tienen que hacerlo ellos también. De lo contrario, sus historias simplemente se pierden en el ruido. Pero esto es terrible para todos, porque el público ahora confía menos en los medios de comunicación pero también se hace cada vez más difícil para cualquiera distinguir la verdad de la ficción, lo cual es un gran problema para la democracia.

Now, this process of competition gone wrong is actually the driving force behind so many of our biggest issues. Plastic pollution, deforestation, antibiotic overuse in farming, arms races, greenhouse gas emissions. These are all a result of crappy incentives, of poorly designed games that push their players -- be them people, companies or governments -- into taking strategies and tactics that defer costs and harms to the future. And what's so ridiculous is that most of the time, these guys don't even want to be doing this. You know, it's not like packaging companies want to fill the oceans with plastic or farmers want to worsen antibiotic resistance. But they’re all stuck in the same dilemma of: "If I don't use this tactic, I’ll get outcompeted by all the others who do. So I have to do it, too.”

Ahora bien, este proceso de competencia que ha fracasado es en realidad la fuerza impulsora de muchos de nuestros problemas más importantes. La contaminación plástica, la deforestación, el uso excesivo de antibióticos en la ganadería, las carreras de armamentos y las emisiones de gases de efecto invernadero. Todo esto es el resultado de unos pésimos incentivos, de juegos mal diseñados que obligan a sus jugadores, sean personas, empresas o gobiernos, a adoptar estrategias y tácticas que aplacen los costos y los daños para el futuro. Y lo más ridículo es que la mayoría de las veces, estos tipos ni siquiera quieren hacer esto. No es que las empresas de envasado quieran llenar los océanos de plástico o que los ganaderos quieran empeorar la resistencia a los antibióticos. Pero todas están atrapadas en el mismo dilema: «Si no uso esta táctica, me superarán los demás que sí la usen. Así que yo también tengo que hacerlo».

This is the mechanism we need to fix as a civilization. And I know what you're probably all thinking, "So it's capitalism." No, it's not capitalism. Which, yes, can cause problems, but it can also solve them and has been fantastic in general. It's something much deeper. It's a force of misaligned incentives of game theory itself.

Este es el mecanismo que necesitamos arreglar como civilización. Y sé que todos estarán pensando: «Así es el capitalismo». No, no es el capitalismo. Lo cual, sí, puede causar problemas, pero también puede solucionarlos y, en general, ha sido fantástico. Es algo mucho más profundo. Es una fuerza de incentivos desalineados de la propia teoría de juegos.

So a few years ago, I retired from poker, in part because I wanted to understand this mechanism better. Because it takes many different forms, and it goes by many different names. These are just some of those names. You can see they're a little bit abstract and clunky, right? They don't exactly roll off the tongue. And given how insidious and connected all of these problems are, it helps to have a more visceral way of recognizing them.

Hace unos años me retiré del póquer, en parte porque quería entender mejor este mecanismo. Porque adopta muchas formas diferentes y tiene muchos nombres diferentes. [juegos de suma negativa, trampas multipolares, equilibrio de Nash inadecuado, etc.] Puedes ver que son un poco abstractos y torpes, ¿verdad? No salen exactamente de la lengua. Y dado lo insidiosos y conectados que están todos estos problemas, ayuda tener una forma más visceral de reconocerlos.

So this is probably the only time you're going to hear about the Bible at this conference. But I want to tell you a quick story from it, because allegedly, back in the Canaanite days, there was a cult who wanted money and power so badly, they were willing to sacrifice their literal children for it. And they did this by burning them alive in an effigy of a God that they believed would then reward them for this ultimate sacrifice. And the name of this god was Moloch. Bit of a bummer, as stories go. But you can see why it's an apt metaphor, because sometimes we get so lost in winning the game right in front of us, we lose sight of the bigger picture and sacrifice too much in our pursuit of victory. So just like these guys were sacrificing their children for power, those influencers are sacrificing their happiness for likes. Those news editors are sacrificing their integrity for clicks, and polluters are sacrificing the biosphere for profit.

Así que probablemente esta sea la única vez que oirás hablar de la Biblia en esta conferencia. Pero quiero contarles una breve historia basada en ella, porque supuestamente, en los días cananeos, había una secta que deseaba tanto el dinero y el poder que estaban dispuestos a sacrificar literalmente a sus hijos por ello. Y lo hicieron quemándolos vivos en una efigie de un dios que, según ellos, les recompensaría por este sacrificio supremo. Y el nombre de este dios era Moloch. Un poco molesto, según cuentan las historias. Pero ya ves por qué es una metáfora acertada, porque a veces nos perdemos tanto en ganar la partida que tenemos delante, que perdemos de vista el panorama general y sacrificamos demasiado en nuestra búsqueda de la victoria. Así como estos tipos sacrificaban a sus hijos por el poder, esos influencers están sacrificando su felicidad por los “me gusta”. Esos editores de noticias están sacrificando su integridad por los clics, y los que contaminan están sacrificando la biosfera para obtener ganancias.

In all these examples, the short-term incentives of the games themselves are pushing, they're tempting their players to sacrifice more and more of their future, trapping them in a death spiral where they all lose in the end. That's Moloch's trap. The mechanism of unhealthy competition. And the same is now happening in the AI industry.

En todos estos ejemplos, los incentivos a corto plazo que ofrecen los propios juegos son cada vez más fuertes, ya que están tentando a los jugadores a sacrificar cada vez más su futuro, atrapándolos en una espiral mortal en la que al final todos pierden. Esa es “la trampa de Moloch”. El mecanismo de una competencia malsana. Y lo mismo está ocurriendo ahora en la industria de la IA.

We're all aware of the race that's heating up between companies right now over who can score the most compute, who can get the biggest funding round or get the top talent. Well, as more and more companies enter this race, the greater the pressure for everyone to go as fast as possible and sacrifice other important stuff like safety testing. This has all the hallmarks of a Moloch trap. Because, like, imagine you're a CEO who, you know, in your heart of hearts, believes that your team is the best to be able to safely build extremely powerful AI. Well, if you go too slowly, then you run the risk of other, much less cautious teams getting there first and deploying their systems before you can. So that in turn pushes you to be more reckless yourself. And given how many different experts and researchers, both within these companies but also completely independent ones, have been warning us about the extreme risks of rushed AI, this approach is absolutely mad. Plus, almost all AI companies are beholden to satisfying their investors, a short-term incentive which, over time, will inevitably start to conflict with any benevolent mission.

Sabemos que se está intensificando la carrera entre empresas para obtener la mayor puntuación en cómputo, la mayor ronda de financiación o los mejores talentos. Pues bien, conforme más y más empresas participan en esta carrera, mayor es la presión para que todos vayan lo más rápido posible y sacrifiquen otras cosas importantes, como las pruebas de seguridad. Tiene todas las características de una trampa Moloch. Porque, por ejemplo, imagina que eres un director ejecutivo que, cree en el fondo de su corazón que su equipo es el mejor para poder crear de forma segura una IA extremadamente poderosa. Bueno, si vas demasiado despacio, corres el riesgo de que otros equipos, mucho menos cautelosos lleguen primero y desplieguen sus sistemas antes que tú. Eso, a su vez, te empuja a ser más imprudente. Y como muchos expertos e investigadores diferentes, tanto de estas empresas como de otras completamente independientes, nos han estado advirtiendo sobre los riesgos extremos de una IA precipitada, este enfoque es absolutamente descabellado. Además, casi todas las empresas de inteligencia artificial tienen la obligación de satisfacer a sus inversores, un incentivo a corto plazo que, con el tiempo, inevitablemente empezará a entrar en conflicto con cualquier misión benévola.

And this wouldn't be a big deal if this was really just toasters we're talking about here. But AI, and especially AGI, is set to be a bigger paradigm shift than the agricultural or industrial revolutions. A moment in time so pivotal, it's deserving of reverence and reflection, not something to be reduced to a corporate rat race of who can score the most daily active users. I'm not saying I know what the right trade-off between acceleration and safety is, but I do know that we'll never find out what that right trade-off is if we let Moloch dictate it for us.

Y esto no sería gran cosa si realmente se tratara de tostadoras de las que estamos hablando aquí. Sin embargo, la IA, y especialmente la IAG, está llamada a suponer un cambio de paradigma mayor que las revoluciones agrícola o industrial. Se trata de un momento tan crucial que merece reverencia y reflexión, y no algo que pueda reducirse a una carrera empresarial para determinar quién es el mayor número de usuarios activos diarios. No digo que sepa cuál es el equilibrio correcto entre aceleración y seguridad, pero sí sé que nunca descubriremos cuál es ese equilibrio correcto si dejamos que Moloch nos lo dicte.

So what can we do? Well, the good news is we have managed to coordinate to escape some of Moloch's traps before. We managed to save the ozone layer from CFCs with the help of the Montreal Protocol. We managed to reduce the number of nuclear weapons on Earth by 80 percent, with the help of the Strategic Arms Reduction Treaty in 1991. So smart regulation may certainly help with AI too, but ultimately, it's the players within the game who have the most influence on it. So we need AI leaders to show us that they're not only aware of the risks their technologies pose, but also the destructive nature of the incentives that they're currently beholden to. As their technological capabilities reach towards the power of gods, they're going to need the godlike wisdom to know how to wield them.

Entonces, ¿qué podemos hacer? Bueno, la buena noticia es que ya hemos conseguido coordinarnos para escapar de algunas de las trampas de Moloch. Hemos conseguido salvar la capa de ozono de los CFC con la ayuda del Protocolo de Montreal. Conseguimos reducir el número de armas nucleares en la Tierra en un 80 %, con la ayuda del Tratado de Reducción de Armas Estratégicas de 1991. Por lo tanto, una regulación inteligente también puede ayudar a la IA, pero, en última instancia, son los jugadores del juego los que tienen más influencia en ella. Por eso necesitamos que los líderes de la IA nos demuestren que no solo son conscientes de los riesgos que representan sus tecnologías, sino también de la naturaleza destructiva de los incentivos a los que se enfrentan actualmente. A medida que sus capacidades tecnológicas alcancen el poder de los dioses, van a necesitar una sabiduría divina para saber cómo utilizarlas.

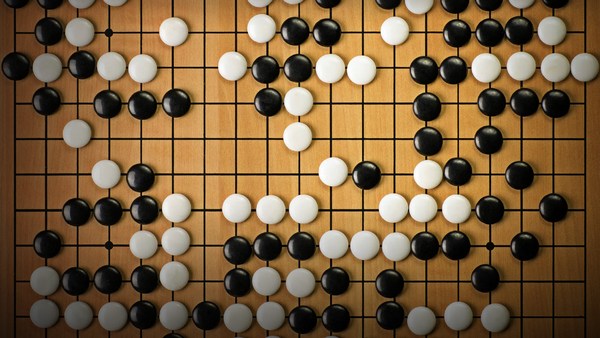

So it doesn't fill me with encouragement when I see a CEO of a very major company saying something like, "I want people to know we made our competitor dance." That is not the type of mindset we need here. We need leaders who are willing to flip Moloch's playbook, who are willing to sacrifice their own individual chance of winning for the good of the whole. Now, fortunately, the three leading labs are showing some signs of doing this. Anthropic recently announced their responsible scaling policy, which pledges to only increase capabilities once certain security criteria have been met. OpenAI have recently pledged to dedicate 20 percent of their compute purely to alignment research. And DeepMind have shown a decade-long focus of science ahead of commerce, like their development of AlphaFold, which they gave away to the science community for free. These are all steps in the right direction, but they are still nowhere close to being enough. I mean, most of these are currently just words, they're not even proven actions.

Por eso no me llena de ánimo ver a un director ejecutivo de una compañía muy importante decir algo como: “Quiero que se sepa que hicimos bailar a nuestro competidor”. Ese no es el tipo de mentalidad que necesitamos aquí. Necesitamos líderes dispuestos a cambiar el manual de estrategias de Moloch, que estén dispuestos a sacrificar sus propias posibilidades individuales de ganar por el bien de todos. Afortunadamente, los tres principales laboratorios están dando señales de que lo están haciendo. Anthropic anunció recientemente su política de escalado responsable, en la que se compromete a aumentar las capacidades solo una vez que se hayan cumplido ciertos criterios de seguridad. OpenAI se ha comprometido recientemente a dedicar el 20 % de su cómputo exclusivamente a la investigación de alineación. Además, DeepMind ha demostrado que, durante una década, se ha centrado en la ciencia antes que en el comercio, como el desarrollo de AlphaFold, que ha regalado a la comunidad científica de forma gratuita. Todos estos pasos van en la dirección correcta, pero todavía están lejos de ser suficientes. Quiero decir, la mayoría de estas son solo palabras, ni siquiera son acciones comprobadas.

So we need a clear way to turn the AI race into a definitive race to the top.

Necesitamos una forma clara de convertir

Perhaps companies can start competing over who can be within these metrics, over who can develop the best security criteria. A race of who can dedicate the most compute to alignment. Now that would truly flip the middle finger to Moloch.

la carrera de la IA en una carrera definitiva hacia la cima. Quizás las empresas puedan empezar a competir por quién puede cumplir estos parámetros, por quién puede desarrollar los mejores criterios de seguridad. Una carrera en la que se decide quién puede dedicar la mayor cantidad de cómputo a la alineación. Eso sí que le daría la vuelta al dedo medio a Moloch.

Competition can be an amazing tool, provided we wield it wisely. And we're going to need to do that because the stakes we are playing for are astronomical. If we get AI, and especially AGI, wrong, it could lead to unimaginable catastrophe. But if we get it right, it could be our path out of many of these Moloch traps that I've mentioned today. And as things get crazier over the coming years, which they're probably going to, it's going to be more important than ever that we remember that it is the real enemy here, Moloch. Not any individual CEO or company, and certainly not one another.

La competencia puede ser una herramienta increíble, siempre que la usemos con prudencia. Y tendremos que hacerlo porque lo que está en juego es astronómico. Si nos equivocamos en la IA, y especialmente en la IAG, esto podría llevar a una catástrofe inimaginable. Pero si lo hacemos bien, podría ser nuestra forma de salir de muchas de estas trampas de Moloch que he mencionado hoy. Y conforme las cosas se pongan más complicadas en los próximos años, cosa que probablemente ocurrirá, va a ser más importante que nunca que recordemos que el verdadero enemigo aquí es Moloch. Ni un CEO solo o una empresa, y ciertamente no entre sí.

So don't hate the players, change the game.

Así que no odies a los jugadores, cambia las reglas del juego.

(Applause)

(Aplausos)