I got my first computer when I was a teenager growing up in Accra, and it was a really cool device. You could play games with it. You could program it in BASIC. And I was fascinated. So I went into the library to figure out how did this thing work. I read about how the CPU is constantly shuffling data back and forth between the memory, the RAM and the ALU, the arithmetic and logic unit. And I thought to myself, this CPU really has to work like crazy just to keep all this data moving through the system.

קיבלתי את המחשב הראשון שלי כשהייתי נער מתבגר באקרה, וזה היה מכשיר מאוד מגניב יכולת לשחק איתו משחקים, יכולת לתכנת אותו ב"בייסיק". והייתי מרותק. אז הלכתי לספריה להבין איך הדבר הזה עובד. קראתי על איך המעבד מתמרן מידע הלוך ושוב כל הזמן בין הדיסק, הזיכרון וה ALU, יחידת העיבוד המתמטית. וחשבתי לעצמי, המעבד הזה צריך לעבוד כמו משוגע רק בשביל לשמור על כל המידע הזה זורם במערכת.

But nobody was really worried about this. When computers were first introduced, they were said to be a million times faster than neurons. People were really excited. They thought they would soon outstrip the capacity of the brain. This is a quote, actually, from Alan Turing: "In 30 years, it will be as easy to ask a computer a question as to ask a person." This was in 1946. And now, in 2007, it's still not true. And so, the question is, why aren't we really seeing this kind of power in computers that we see in the brain?

אבל אף אחד לא היה מודאג מזה. כשהמחשבים הוצגו לראשונה, נאמר שהם מהירים פי מיליון מניורונים. אנשים ממש התרגשו, הם חשבו שהם במהרה יתעלו על היכולת של המוח. זהו ציטוט, למען האמת, של אלן טיורינג: "בעוד 30 שנה, יהיה קל לשאול את המחשב שאלה כמו שקל לשאול אדם. זה היה ב-1946. והיום ב-2007, זה עדיין לא נכון. השאלה היא, למה אנחנו לא רואים במחשבים את אותה העוצמה שאנחנו רואים במוח?

What people didn't realize, and I'm just beginning to realize right now, is that we pay a huge price for the speed that we claim is a big advantage of these computers. Let's take a look at some numbers. This is Blue Gene, the fastest computer in the world. It's got 120,000 processors; they can basically process 10 quadrillion bits of information per second. That's 10 to the sixteenth. And they consume one and a half megawatts of power. So that would be really great, if you could add that to the production capacity in Tanzania. It would really boost the economy. Just to go back to the States, if you translate the amount of power or electricity this computer uses to the amount of households in the States, you get 1,200 households in the U.S. That's how much power this computer uses.

מה שאנשים לא הבינו, ואני מתחיל להבין עכשיו, זה שאנחנו משלמים מכיר כבד בשביל המהירות, שאנחנו טוענים שהיא היתרון הגדול של המחשבים. בואו נסתכל על כמה מספרים. זהו בלו ג'ין (Blue Gene), המחשב המהיר בעולם. יש לו 120,000 מעבדים. הם יכולים בעיקרון לעבד 10 קואדריליון ביטים של מידע בשניה. זה 10 בחזקת 16. והם מכלים חצי מגה וואט של כוח. אז זה היה ממש נפלא אם יכולנו להוסיף את זה ליכולת הייצור של טנזניה. זה היה ממש מקפיץ את הכלכלה. אם נחזור לארה"ב, אם נתרגם את כמות הכוח או החשמל בהם המחשב הזה משתמש לכמות בתי אב בארה"ב, נקבל 1,200 בתי אב, זו כמות הכוח שהמחשב הזה צורך.

Now, let's compare this with the brain. This is a picture of, actually Rory Sayres' girlfriend's brain. Rory is a graduate student at Stanford. He studies the brain using MRI, and he claims that this is the most beautiful brain that he has ever scanned. (Laughter) So that's true love, right there. Now, how much computation does the brain do? I estimate 10 to the 16 bits per second, which is actually about very similar to what Blue Gene does. So that's the question. The question is, how much -- they are doing a similar amount of processing, similar amount of data -- the question is how much energy or electricity does the brain use? And it's actually as much as your laptop computer: it's just 10 watts. So what we are doing right now with computers with the energy consumed by 1,200 houses, the brain is doing with the energy consumed by your laptop.

עכשיו, בואו נשווה את זה למוח. זו תמונה למעשה, של המוח של החברה של רורי סיירס. רורי הוא סטודנט לתואר מתקדם בסטנפורד. הוא חוקר את המוח באמצעות MRI, והוא טוען שזה המוח הכי יפה שהוא אי פעם סרק. (צחוק) אז זו אהבת אמת. עכשיו, כמה חישובים המוח עושה? אני מעריך ש-10 בחזקת 16 ביט לשניה שזה בעצם מאוד דומה למה שבלו ג'ין עושה אז זו השאלה. השאלה היא כמה -- הם מבצעים כמות חישובים זהה, כמות מידע זהה -- השאלה היא בכמה אנרגיה או חשמל משתמש המוח? ולמען האמת, היא כמו של המחשב הנייד שלכם. היא רק 10 וואט. אז מה שאנחנו עושים עכשיו עם מחשבים, עם אנרגיה זהה לזו של 1,200 בתים, המוח עושה בעזרת האנרגיה של המחשב הנייד שלכם.

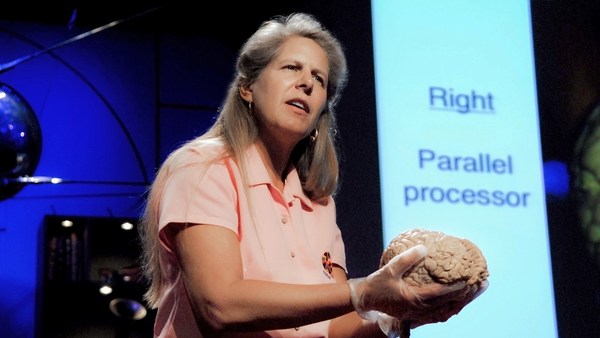

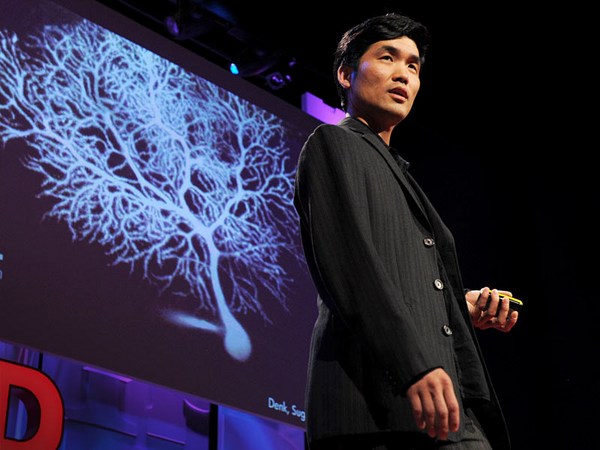

So the question is, how is the brain able to achieve this kind of efficiency? And let me just summarize. So the bottom line: the brain processes information using 100,000 times less energy than we do right now with this computer technology that we have. How is the brain able to do this? Let's just take a look about how the brain works, and then I'll compare that with how computers work. So, this clip is from the PBS series, "The Secret Life of the Brain." It shows you these cells that process information. They are called neurons. They send little pulses of electricity down their processes to each other, and where they contact each other, those little pulses of electricity can jump from one neuron to the other. That process is called a synapse. You've got this huge network of cells interacting with each other -- about 100 million of them, sending about 10 quadrillion of these pulses around every second. And that's basically what's going on in your brain right now as you're watching this.

אז השאלה היא, איך המוח מצליח להגיע ליעילות כזו? ותנו לי רק לסכם. אז השורה האחרונה היא: המוח מעבד אינפורמציה בעזרת 100,000 פעמים פחות אנרגיה מאשר טכנולוגית המחשבים שאנחנו משתמשים בה כרגע איך המוח מסוגל לעשות זאת? בואו נסתכל על איך שהמוח עובד, ואז אני אשווה זאת עם איך שמחשבים עובדים. אז הקליפ הזה הוא מרשת PBS, "החיים הסודיים של המוח" הוא מראה לכם את התאים האלה שמעבדים אינפורמציה הם נקראים נוירונים. הם שולחים פעימות קטנות של חשמל חיבורים אחד לשני, ובחיבור ביניהם, הפעימות הקטנות האלה של חשמל יכולות לקפוץ מנוירון אחד לשני. חיבור זה נקרא סינפסה. יש לכם רשת ענקית של תאים המתקשרים אחד עם השני, בערך 100 מיליון, שולחים בערך 10 קוואדריליון פעימות בכל שניה. וזה בעיקרון מה שקורה במוח שלכם ברגע זה כשאתם צופים בזה.

How does that compare with the way computers work? In the computer, you have all the data going through the central processing unit, and any piece of data basically has to go through that bottleneck, whereas in the brain, what you have is these neurons, and the data just really flows through a network of connections among the neurons. There's no bottleneck here. It's really a network in the literal sense of the word. The net is doing the work in the brain. If you just look at these two pictures, these kind of words pop into your mind. This is serial and it's rigid -- it's like cars on a freeway, everything has to happen in lockstep -- whereas this is parallel and it's fluid. Information processing is very dynamic and adaptive.

איך זה משתווה לדרך בה מחשבים עובדים? במחשב יש לכם את כל המידע עוברים דרך המעבד המרכזי, וכל פיסת מידע בעיקרון צריכה לעבור דרך צוואר הבקבוק הזה. ואילו במוח, מה שיש הם הניורונים האלו והמידע בעצם זורם דרך רשת של קישורים בין הניורונים, אין צוואר בקבוק. זו באמת "עבודת רשת" (network) במלוא מובן המילה. הרשת עושה את העבודה. אם רק תסתכלו על שתי התמונות האלו, אלו המילים שקופצות לראש. זה טורי ונוקשה. כמו מכוניות בכביש מהיר -- הכל צריך לקרות בסדר נוקשה. לעומת זאת זה מקבילי וזורם. עיבוד מידע הוא מאוד דינמי וגמיש.

So I'm not the first to figure this out. This is a quote from Brian Eno: "the problem with computers is that there is not enough Africa in them." (Laughter) Brian actually said this in 1995. And nobody was listening then, but now people are beginning to listen because there's a pressing, technological problem that we face. And I'll just take you through that a little bit in the next few slides.

אז אני לא הראשון שהבין זאת. זהו ציטוט של בריאן אנו: "הבעיה עם מחשבים היא שאין בהם מספיק אפריקה." (צחוק) האמת שבריאן אמר את זה ב- 1995. ואף אחד לא הקשיב אז, אבל עכשיו אנשים מתחילים להקשיב בגלל שיש מולנו בעיה טכנולוגית לוחצת, ואני רק אסביר לכם את זה קצת בשקופיות הבאות.

This is -- it's actually really this remarkable convergence between the devices that we use to compute in computers, and the devices that our brains use to compute. The devices that computers use are what's called a transistor. This electrode here, called the gate, controls the flow of current from the source to the drain -- these two electrodes. And that current, electrical current, is carried by electrons, just like in your house and so on. And what you have here is, when you actually turn on the gate, you get an increase in the amount of current, and you get a steady flow of current. And when you turn off the gate, there's no current flowing through the device. Your computer uses this presence of current to represent a one, and the absence of current to represent a zero.

זה -- זה בעצם שילוב מדהים בין הכלי שאנחנו משתמשים בו לחשב במחשבים, לבין הכלי שהמוח שלנו משתמש בו לחשב. הכלי שהמחשבים משתמשים בו נקרא טרנזיסטור. האלקטרודה הזאת, נקראת שער, שולטת בזרם החשמלי מהמקור לשפך, שתי האלקטרודות האלה. והזרם הזה, זרם חשמלי, נישא על ידי אלקטרונים, בדיוק כמו אצלכם בבית. ומה שיש לכם פה, כשאתם פותחים את השער, אתם מקבלים עליה בכמות הזרם, ואתם מקבלים זרם קבוע. וכשאתם סוגרים את השער, אין כלל זרם במכשיר. המחשב שלכם משתמש בנוכחות הזרם כדי לייצג אחד, ואת היעדר הזרם כדי לייצג אפס.

Now, what's happening is that as transistors are getting smaller and smaller and smaller, they no longer behave like this. In fact, they are starting to behave like the device that neurons use to compute, which is called an ion channel. And this is a little protein molecule. I mean, neurons have thousands of these. And it sits in the membrane of the cell and it's got a pore in it. And these are individual potassium ions that are flowing through that pore. Now, this pore can open and close. But, when it's open, because these ions have to line up and flow through, one at a time, you get a kind of sporadic, not steady -- it's a sporadic flow of current. And even when you close the pore -- which neurons can do, they can open and close these pores to generate electrical activity -- even when it's closed, because these ions are so small, they can actually sneak through, a few can sneak through at a time. So, what you have is that when the pore is open, you get some current sometimes. These are your ones, but you've got a few zeros thrown in. And when it's closed, you have a zero, but you have a few ones thrown in.

עכשיו, מה שקורה זה שככל שהטרנזיסטורים קטנים וקטנים, הם כבר לא מתנהגים ככה. בעצם, הם מתחילים להתנהג כמו הכלים בהם הנוירונים משתמשים כדי לחשב, שנקראים תעלות יונים. וזו מולקולת חלבון קטנה. אני מתכוון, לנוירונים יש כאלה באלפים. וזה יושב בממברנה של התא ויש בו נקבובית. ואלו יוני אשלגן בודדים, שזורמים דרך הנקבובית. עכשיו, הנקבובית הזו יכולה להיסגר ולהיפתח. אבל, כשהיא פתוחה, בגלל שהיונים האלו צריכים להסתדר בשורה ולזרום אחד אחד, אתם מקבלים אי סדר, חוסר יציבות - זרימת חשמל לא סדירה. וגם כשאתם סוגרים את הנקבובית -- מה שהנוירונים יכולים לעשות, הם יכולים לסגור ולפתוח את הנקבוביות האלה כדי לייצר פעילות חשמלית -- גם כשזה סגור, בגלל שהיונים האלו כל כך קטנים, הם יכולים להתגנב פנימה, כמה יכולים להתגנב פנימה כל פעם. אז כשהנקבובית פתוחה, אתם מקבלים קצת זרם מדי פעם. אלה האחדים שלכם, אבל אתם מקבלים כמה אפסים בכל זאת. וכשזה סגור, אתם מקבלים אפס, אבל אתם מקבלים קצת אחדים, אוקי.

Now, this is starting to happen in transistors. And the reason why that's happening is that, right now, in 2007 -- the technology that we are using -- a transistor is big enough that several electrons can flow through the channel simultaneously, side by side. In fact, there's about 12 electrons can all be flowing this way. And that means that a transistor corresponds to about 12 ion channels in parallel. Now, in a few years time, by 2015, we will shrink transistors so much. This is what Intel does to keep adding more cores onto the chip. Or your memory sticks that you have now can carry one gigabyte of stuff on them -- before, it was 256. Transistors are getting smaller to allow this to happen, and technology has really benefitted from that.

עכשיו, זה מתחיל לקרות בטרנזיסטורים. והסיבה שהדבר הזה קורה, היא שעכשיו בשנת 2007, הטכנולוגיה בה אנחנו משתמשים, הטרנזיסטור גדול מספיק שכמה אלקטרונים יכולים לזרום דרך התעלה בו זמנית, אחד לצד השני. למעשה, יש בערך 12 אלקטרונים שיכולים לזרום בכיוון זה. וזה אומר שהטרנזיסטור מתאים לבערך 12 ערוצי יונים במקביל. עכשיו, בעוד כמה שנים, עד 2015, אנחנו נכווץ את הטרנזיסטורים כל כך. זה מה שאינטל עושה כדי להמשיך להוסיף ליבות על השבב, או כרטיסי הזיכרון שיש לכם עכשיו שיכולים לאחסן ג'יגה בייט אחד של נתונים עליהם -- לפני שזה היה 256. טרנסיזטורים נעשים קטנים יותר, ומאפשרים לזה לקרות, והטכנולוגיה ממש הרוויחה מזה.

But what's happening now is that in 2015, the transistor is going to become so small, that it corresponds to only one electron at a time can flow through that channel, and that corresponds to a single ion channel. And you start having the same kind of traffic jams that you have in the ion channel. The current will turn on and off at random, even when it's supposed to be on. And that means your computer is going to get its ones and zeros mixed up, and that's going to crash your machine.

אבל מה שקורה עכשיו זה שעד 2015, הטרנזיסטורים עומדים להיות כל כך קטנים, שהם יתאימו לאלקטרון אחד בלבד בכל זמן שזורם דרך התעלה, וזה מתאים לתעלת יונים אחת. ואתם מתחילים לקבל את אותם פקקי תנועה שיש לכם בתעלות היונים, הזרם ידלק ויכבה רנדומלית אפילו כשהוא אמור להיות דולק. וזה אומר שהמחשב שלכם הולך לקבל בלבול של אחדים ואפסים, וזה הולך לגרום למכונה שלכם לקרוס.

So, we are at the stage where we don't really know how to compute with these kinds of devices. And the only kind of thing -- the only thing we know right now that can compute with these kinds of devices are the brain.

אז, אנחנו בשלב בו אנחנו לא באמת יודעים לחשב עם כלים מסוג כזה. והסוג היחיד, הדבר שאנחנו מכירים כרגע, שיודע לחשב בעזרת כלים כאלה, הוא המוח.

OK, so a computer picks a specific item of data from memory, it sends it into the processor or the ALU, and then it puts the result back into memory. That's the red path that's highlighted. The way brains work, I told you all, you have got all these neurons. And the way they represent information is they break up that data into little pieces that are represented by pulses and different neurons. So you have all these pieces of data distributed throughout the network. And then the way that you process that data to get a result is that you translate this pattern of activity into a new pattern of activity, just by it flowing through the network. So you set up these connections such that the input pattern just flows and generates the output pattern.

אוקי, אז מחשב שולך פיסת מידע מסויימת מהזיכרון, הוא שולח את זה למעבד או ל ALU, ואז הוא מכניס את התוצאות חזרה לזיכרון. זה הנתיב האדום המודגש. הדרך בה מוחות פועלים, יש לכם את כל הניורונים האלה. והדרך בה הם מייצגים מידע הוא שהם מפרקים את המידע לחתיכות קטנות שמיוצגות על ידי פולסים וניורונים שונים. אז יש לכם את כל פיסות המידע הזה מפוזרות בכל ברשת. ואז הדרך שאתם מעבדים מידע כדי לקבל תוצאה היא שאתם מתרגמים את התבנית הזו של פעילות לתבנית חדשה של פעילות, רק על ידי כך שהיא זורמת ברשת. אז אתם מייצרים את הקשרים האלה, כך שהמידע הניכנס רק זורם ויוצר את תבנית היציאה.

What you see here is that there's these redundant connections. So if this piece of data or this piece of the data gets clobbered, it doesn't show up over here, these two pieces can activate the missing part with these redundant connections. So even when you go to these crappy devices where sometimes you want a one and you get a zero, and it doesn't show up, there's redundancy in the network that can actually recover the missing information. It makes the brain inherently robust. What you have here is a system where you store data locally. And it's brittle, because each of these steps has to be flawless, otherwise you lose that data, whereas in the brain, you have a system that stores data in a distributed way, and it's robust.

מה שאתם רואים כאן זה שיש את הקשרים העודפים. כך שאם פיסת מידע זו או פיסת מידע זו נעלמת היא לא מופיעה כאן, שתי פיסות אלה יכולות לשחזר את החלק החסר בעזרת הקשרים העודפים. אז גם אם אתם הולכים לכלים הדפוקים האלה בהם אתם לפעמים רוצים אחד ומקבלים אפס, יש עודפים במערכת שיכולים לשחזר את המידע החסר. זה עושה את המוח חסין מטבעו. מה שיש לכם פה היא מערכת בה אתם מאחסנים מידע מקומי. והיא שברירית, כי כל אחד מהשלבים צריך להיות מושלם, אחרת אתם מאבדים את המידע. לעומת זאת במוח, יש לכם מערכת שמאכסנת מידע בצורה מפוזרת, והיא חסינה.

What I want to basically talk about is my dream, which is to build a computer that works like the brain. This is something that we've been working on for the last couple of years. And I'm going to show you a system that we designed to model the retina, which is a piece of brain that lines the inside of your eyeball. We didn't do this by actually writing code, like you do in a computer. In fact, the processing that happens in that little piece of brain is very similar to the kind of processing that computers do when they stream video over the Internet. They want to compress the information -- they just want to send the changes, what's new in the image, and so on -- and that is how your eyeball is able to squeeze all that information down to your optic nerve, to send to the rest of the brain.

מה שאני רוצה בעצם לדבר עליו הוא החלום שלי, שהוא לבנות מחשב שעובד כמו המוח. זה משהו שאנחנו עובדים עליו במשך השנתיים האחרונות. ואני עומד להראות לכם מערכת שתיכננו למדל את הרשתית, שהיא חלק מהמוח שמכסה את פנים גלגל העין. לא עשינו זאת בעזרת כתיבת קוד, כמו שאתם עושים במחשב. למעשה, התהליך שמתרחש בחלק המוח הקטן הזה מאוד דומה לסוג החישובים שעושים מחשבים כשהם שולחים וידאו דרך האינטרנט. הם רוצים לכווץ את המידע -- הם רק רוצים לשלוח את השינויים המתחדשים בתמונה וכך הלאה -- וככה גלגל העין שלכם מסוגל לכווץ את כל האינפורמציה הזאת אל עצב הראייה, כדי לשלוח אותה אל שאר המוח.

Instead of doing this in software, or doing those kinds of algorithms, we went and talked to neurobiologists who have actually reverse engineered that piece of brain that's called the retina. And they figured out all the different cells, and they figured out the network, and we just took that network and we used it as the blueprint for the design of a silicon chip. So now the neurons are represented by little nodes or circuits on the chip, and the connections among the neurons are represented, actually modeled by transistors. And these transistors are behaving essentially just like ion channels behave in the brain. It will give you the same kind of robust architecture that I described.

במקום לעשות זאת בעזרת תוכנה, או לעשות את הסוגים האלה של אלגוריתמים, הלכנו ודיברנו עם נוירו-ביולוגים שבעצם ביצעו הנדסה הפוכה לחלק הזה של המוח שנקרא רשתית. והפ פיענחו את כל התאים השונים, והם פיענחו את הרשת, ואנחנו פשוט לקחנו את הרשת הזאת והשתמשנו בה כתשתית לעיצוב של שבב סיליקון. אז עכשיו הנוירונים מיוצגים על ידי צמתים או מעגלים על השבב, והקישורים בין הנוירונים בעצם ממודלים על ידי טרנזיסטורים והטרנזיסטורים האלה מתנהגים בעצם בדיוק כמו שתעלות היונים מתנהגות במוח. זה יתן לכם בדיוק את אותו סוג של ארכיטקטורה חסינה שתיארתי.

Here is actually what our artificial eye looks like. The retina chip that we designed sits behind this lens here. And the chip -- I'm going to show you a video that the silicon retina put out of its output when it was looking at Kareem Zaghloul, who's the student who designed this chip. Let me explain what you're going to see, OK, because it's putting out different kinds of information, it's not as straightforward as a camera. The retina chip extracts four different kinds of information. It extracts regions with dark contrast, which will show up on the video as red. And it extracts regions with white or light contrast, which will show up on the video as green.

כך למעשה נראית העין המלאכותית שלנו. שבב הרשתית שעיצבנו יושב מאחורי העדשה הזו פה. והשבב -- אני עומד להראות לכם וידאו שרשתית הסיליקון הוציאה בפלט כשהיא הסתכלה על קארים זאגול, שהוא הסטודנט שעיצב את השבב הזה. תנו לי להסביר מה אתם עובדים לראות, אוקי. כי זה מוציא סוגים שונים של מידע, זה לא ישיר כמו מצלמה. שבב רשתית מחלץ ארבע סוגים של מידע. הוא מחלץ אזורים עם ניגודיות כהה, שיופיעו על הוידאו באדום. והוא מחלץ אזורים לבנים או בעלי ניגודיות בהירה, שיופיעו בוידאו בירוק.

This is Kareem's dark eyes and that's the white background that you see here. And then it also extracts movement. When Kareem moves his head to the right, you will see this blue activity there; it represents regions where the contrast is increasing in the image, that's where it's going from dark to light. And you also see this yellow activity, which represents regions where contrast is decreasing; it's going from light to dark. And these four types of information -- your optic nerve has about a million fibers in it, and 900,000 of those fibers send these four types of information. So we are really duplicating the kind of signals that you have on the optic nerve.

אלו הן העיניים הכהות של קארים וזה הרקע הלבן שאתם רואים כאן. ואז הוא גם מחלץ תנועה. כשקארים מזיז את ראשו לימין, אתם תראו את הפעילות הכחולה פה, זה מייצג אזורים בהם הניגודיות גדלה בתמונה, זה היכן שזה משתנה מכהה לבהיר. ואתם גם רואים את הפעילות הצהובה הזאת, שמייצגת אזורים בהם הניגודיות קטנה, זה משתנה מבהיר לכהה. וארבעה סוגי מידע אלה -- בעצב הראייה שלכם יש בערך מיליון סיבים, ו-900,000 מתוך הסיבים האלה שולחים את ארבע הסוגים האלה של אינפורמציה. אז אנחנו למעשה משכפלים את האותות שיש לכם בעצב הראיה.

What you notice here is that these snapshots taken from the output of the retina chip are very sparse, right? It doesn't light up green everywhere in the background, only on the edges, and then in the hair, and so on. And this is the same thing you see when people compress video to send: they want to make it very sparse, because that file is smaller. And this is what the retina is doing, and it's doing it just with the circuitry, and how this network of neurons that are interacting in there, which we've captured on the chip.

מה שאתם שמים אליו לב כאן הוא שהתמונות שנלקחו מהפלט של שבב הרשתית הן מאוד דלילות. זה לא צבוע בירוק בכל מקום ברקע, אלא רק בקצוות, וכך הלאה. וזה אותו הדבר שאתם רואים כשאנשים מכווצים וידאו לשליחה: הם רוצים לעשות אות זה מאוד דליל, כיוון שהקובץ הזה קטן יותר. וזה מה שהרשתית עושה, והיא עושה זאת רק באמצעות המעגלים, ואיך שהרשת הזאת של ניורונים שמתקשרים שם בפנים, שאנחנו תפסנו על השבב.

But the point that I want to make -- I'll show you up here. So this image here is going to look like these ones, but here I'll show you that we can reconstruct the image, so, you know, you can almost recognize Kareem in that top part there. And so, here you go. Yes, so that's the idea. When you stand still, you just see the light and dark contrasts. But when it's moving back and forth, the retina picks up these changes. And that's why, you know, when you're sitting here and something happens in your background, you merely move your eyes to it. There are these cells that detect change and you move your attention to it. So those are very important for catching somebody who's trying to sneak up on you.

אבל הנקודה שאני רוצה להעביר, אני אראה לכם כאן למעלה. אז התמונה הזו כאן עומדת להיראות כמו אלה, אבל כאן אני אראה לכם שאנחנו יכולים להרכיב מחדש את התמונה, אז, אתם יודעים, אתם כמעט יכולים לזהות את קארים בחלק העליון הזה שם. הנה. כן, אז זה הרעיון. כשאתם לא זזים, אתם רק רואים את הניגודיות הכהה והבהירה. אבל כשאתם זזים הלוך ושוב, הרשתית קולטת את השינויים האלה. וזו הסיבה, אתם יודעים, כשאתם יושבים כאן ומשהו קורה ברקע שלכם, אתם רק מזיזים את העיניים אליו. יש את התאים האלה שמזהים שינויים ואתם מסיטים את תשומת הלב שלכם לזה. אז אלו מאוד חשובים בשביל לתפוס מישהו שמנסה להתגנב מאחוריכם.

Let me just end by saying that this is what happens when you put Africa in a piano, OK. This is a steel drum here that has been modified, and that's what happens when you put Africa in a piano. And what I would like us to do is put Africa in the computer, and come up with a new kind of computer that will generate thought, imagination, be creative and things like that. Thank you. (Applause)

תנו לי רק לסיים ולהגיד לכם שזה מה שקורה כשאתה מכניס את אפריקה לפסנתר, אוקי. זהו תוף ברזל כאן שעבר שינוי, וזה מה שקורה כשאתה מכניס את אפריקה לפסנתר. ומה שאני הייתי רוצה שנעשה, זה להכניס את אפריקה למחשב, ולהמציא סוג חדש של מחשב שייצר מחשבות, דמיון, יצירתיות ודברים כאלה. תודה. (מחיאות כפיים)

Chris Anderson: Question for you, Kwabena. Do you put together in your mind the work you're doing, the future of Africa, this conference -- what connections can we make, if any, between them?

כריס אנדרסון: שאלה אלייך, קוואבנה. האם אתה מחבר בדמיונך את העבודה שאתה עושה, העתיד של אפריקה, הכנס הזה -- איזה קישורים אנחנו יכולים לעשות, אם בכלל, ביניהם?

Kwabena Boahen: Yes, like I said at the beginning, I got my first computer when I was a teenager, growing up in Accra. And I had this gut reaction that this was the wrong way to do it. It was very brute force; it was very inelegant. I don't think that I would've had that reaction, if I'd grown up reading all this science fiction, hearing about RD2D2, whatever it was called, and just -- you know, buying into this hype about computers. I was coming at it from a different perspective, where I was bringing that different perspective to bear on the problem. And I think a lot of people in Africa have this different perspective, and I think that's going to impact technology. And that's going to impact how it's going to evolve. And I think you're going to be able to see, use that infusion, to come up with new things, because you're coming from a different perspective. I think we can contribute. We can dream like everybody else.

קוואבנה בואהן: כן. כמו שאמרתי בהתחלה. קיבלתי את המחשב הראשון שלי כשהייתי נער מתבגר באקרה. והייתה לי תחושת בטן שזו לא הדרך הנכונה לעשות זאת. זה היה מאוד כוחני, זה היה מאוד לא אלגנטי. אני לא חושב שהיתה לי התגובה הזאת, אם הייתי גדל בקריאת כל המדע הבדיוני הזה, שומע על RD2D2, איך שלא קראו לזה, ורק -- אתה יודע, נשאב לתוך ההגזמה הזאת על מחשבים. אני הסתכלתי על זה מפרספקטיבה אחרת, והבאתי את הפרספקטיבה האחרת הזאת להתבוננות על הבעיה. ואני חושב שלהרבה אנשים באפריקה יש את הפרספקטיבה האחרת הזאת, ואני חושב שזה הולך להשפיע על הטכנולוגיה. וזה הולך להשפיע על צורת ההתפתחות שלה. ואני חושב שאתם תוכלו לראות, להשתמש בהיתוך הזה, כדי להמציא דברים חדשים, כי אתם מגיעים מפרספקטיבה אחרת. אני חושב שאנחנו יכולים לתרום, אנחנו יכולים לחלום כמו כל אחד אחר.

CA: Thanks Kwabena, that was really interesting. Thank you.

כריס אנדרסון: תודה קוואבנה, זה היה מאוד מעניין. תודה לך.

(Applause)

(מחיאות כפיים)