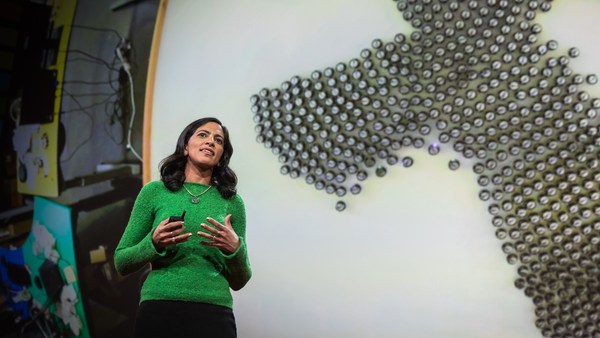

There was a day, about 10 years ago, when I asked a friend to hold a baby dinosaur robot upside down. It was this toy called a Pleo that I had ordered, and I was really excited about it because I've always loved robots. And this one has really cool technical features. It had motors and touch sensors and it had an infrared camera. And one of the things it had was a tilt sensor, so it knew what direction it was facing. And when you held it upside down, it would start to cry. And I thought this was super cool, so I was showing it off to my friend, and I said, "Oh, hold it up by the tail. See what it does." So we're watching the theatrics of this robot struggle and cry out. And after a few seconds, it starts to bother me a little, and I said, "OK, that's enough now. Let's put him back down." And then I pet the robot to make it stop crying.

Det var en dag, för ungefär 10 år sedan, som jag bad en vän att hålla en robot i form av en dinosauriebebis upp och ned. Det var en leksak som kallas Pleo som jag hade beställt, och jag var väldigt glad över det eftersom jag alltid älskat robotar. Just denna har väldigt coola tekniska egenskaper. Den hade motorer och rörelsesensorer och den hade en infraröd kamera. En av funktionerna den hade var en lutningssensor, så den visste i vilken riktning den var vänd. När du höll den upp och ned, så började den gråta. Jag tyckte det var jättehäftigt, så jag visade upp den för min vän, och jag sade "Håll upp den i svansen. Se vad den gör." Så vi håller på att observera robotens agerande, kämpande och gråtande. Efter en stund, så börjar det besvära mig lite, och jag sade "OK, nu räcker det. Vi sätter ned honom igen." Sedan klappade jag roboten för att få den att sluta gråta.

And that was kind of a weird experience for me. For one thing, I wasn't the most maternal person at the time. Although since then I've become a mother, nine months ago, and I've learned that babies also squirm when you hold them upside down.

Det var en konstig erfarenhet för mig. För det första var jag inte en särskilt moderlig person vid det tillfället. Men sedan jag blev mamma för nio månader sedan, har jag lärt mig att bebisar också gråter när man håller dem upp och ned.

(Laughter)

(Skratt)

But my response to this robot was also interesting because I knew exactly how this machine worked, and yet I still felt compelled to be kind to it. And that observation sparked a curiosity that I've spent the past decade pursuing. Why did I comfort this robot? And one of the things I discovered was that my treatment of this machine was more than just an awkward moment in my living room, that in a world where we're increasingly integrating robots into our lives, an instinct like that might actually have consequences, because the first thing that I discovered is that it's not just me.

Min respons till den här roboten var intressant, eftersom jag visste exakt hur den här maskinen fungerade, och ändå kände jag att jag behövde vara snäll mot den. Den observationen väckte en nyfikenhet som jag har ägnat mig åt under det senaste årtiondet. Varför tröstade jag roboten? En av sakerna jag upptäckte var att min behandling av den här maskinen var mer än bara ett besvärligt ögonblick i mitt vardagsrum, att i en värld där vi mer och mer integrerar robotar i våra liv, kan en sådan instinkt faktiskt ha konsekvenser, eftersom det första jag märkte var att det inte bara är jag.

In 2007, the Washington Post reported that the United States military was testing this robot that defused land mines. And the way it worked was it was shaped like a stick insect and it would walk around a minefield on its legs, and every time it stepped on a mine, one of the legs would blow up, and it would continue on the other legs to blow up more mines. And the colonel who was in charge of this testing exercise ends up calling it off, because, he says, it's too inhumane to watch this damaged robot drag itself along the minefield. Now, what would cause a hardened military officer and someone like myself to have this response to robots?

2007 rapporterade Washington Post att USA:s militär höll på att testa en robot som desarmerade landminor. Den fungerade så att den var formad som en vandrande pinne och den gick runt på ett minfält på sina ben, och varje gång den trampade på en mina, så sprängdes ett ben sönder, och sen fortsatte den på de andra benen och sprängde fler minor. Översten som ledde det här testet avbröt till slut övningen, eftersom han menade att det var för inhumant att se den skadade roboten släpa sig fram över minfältet. Vad skulle kunna göra att en tuff militär officer och någon som jag själv har en sådan respons till robotar?

Well, of course, we're primed by science fiction and pop culture to really want to personify these things, but it goes a little bit deeper than that. It turns out that we're biologically hardwired to project intent and life onto any movement in our physical space that seems autonomous to us. So people will treat all sorts of robots like they're alive. These bomb-disposal units get names. They get medals of honor. They've had funerals for them with gun salutes. And research shows that we do this even with very simple household robots, like the Roomba vacuum cleaner.

Vi är såklart påverkade av science fiction och populärkultur att vilja personifiera de här sakerna, men det går lite djupare än så. Vi är tydligen biologiskt programmerade till att projicera vilja och liv på all rörelse i vår fysiska omgivning som för oss verkar vara självständig. Så människor kommer att behandla alla slags robotar som levande varelser. Minröjarrobotarna får egna namn. De får hedersmedaljer. De har haft begravningar för dem med kanonsalut. Forskning visar att vi även gör detta med enkla hushållsrobotar, som Roomba-dammsugaren.

(Laughter)

(Skratt)

It's just a disc that roams around your floor to clean it, but just the fact it's moving around on its own will cause people to name the Roomba and feel bad for the Roomba when it gets stuck under the couch.

Det är bara en disk som åker runt på ditt golv och rengör det, men det faktum att den åker omkring på egen hand gör så att folk döper sin Roomba och tycker synd om den när den fastnar under soffan.

(Laughter)

(Skratt)

And we can design robots specifically to evoke this response, using eyes and faces or movements that people automatically, subconsciously associate with states of mind. And there's an entire body of research called human-robot interaction that really shows how well this works. So for example, researchers at Stanford University found out that it makes people really uncomfortable when you ask them to touch a robot's private parts.

Vi kan designa robotar för att framkalla den här reaktionen, genom att använda ögon och ansikten eller rörelser som folk automatiskt, undermedvetet associerar med känslor. Det finns ett helt forskningsområde kallat människa-robotinteraktion som visar hur väl det här fungerar. Till exempel har forskare vid Stanfords universitet upptäckt att det gör folk väldigt obekväma om du ber dem att ta på en robots intima delar.

(Laughter)

(Skratt)

So from this, but from many other studies, we know, we know that people respond to the cues given to them by these lifelike machines, even if they know that they're not real.

Från denna, men även många andra studier, vet vi att människor reagerar på dessa signaler från dessa naturtrogna maskiner, fastän de vet att de inte är verkliga.

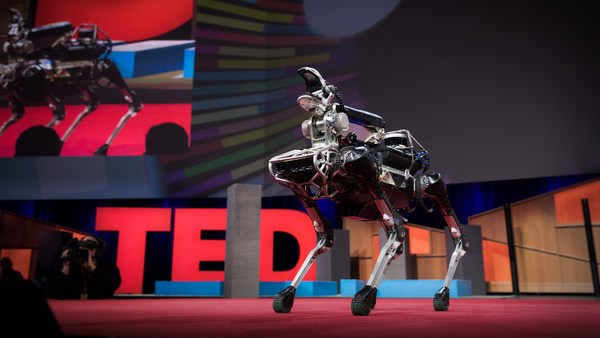

Now, we're headed towards a world where robots are everywhere. Robotic technology is moving out from behind factory walls. It's entering workplaces, households. And as these machines that can sense and make autonomous decisions and learn enter into these shared spaces, I think that maybe the best analogy we have for this is our relationship with animals. Thousands of years ago, we started to domesticate animals, and we trained them for work and weaponry and companionship. And throughout history, we've treated some animals like tools or like products, and other animals, we've treated with kindness and we've given a place in society as our companions. I think it's plausible we might start to integrate robots in similar ways.

Nu är vi på väg mot en värld där robotar finns överallt. Robotteknik träder ut genom fabriksväggarna. Den kommer in på arbetsplatser, i hushåll. I och med att dessa maskiner som kan läsa av, ta egna beslut och lära sig saker träder in i dessa gemensamma utrymmen, tror jag att den bästa analogin vi har för detta är vår relation till djur. För tusentals år sedan började vi tämja djur, vi tränade dem för arbete, beväpning och sällskap. Genom historien har vi behandlat vissa djur som verktyg eller produkter, och andra djur har vi behandlat med vänlighet och vi har gett dem en plats i samhället som våra kamrater. Jag tror det är sannolikt att vi kommer börja integrera robotar på liknande sätt.

And sure, animals are alive. Robots are not. And I can tell you, from working with roboticists, that we're pretty far away from developing robots that can feel anything. But we feel for them, and that matters, because if we're trying to integrate robots into these shared spaces, we need to understand that people will treat them differently than other devices, and that in some cases, for example, the case of a soldier who becomes emotionally attached to the robot that they work with, that can be anything from inefficient to dangerous. But in other cases, it can actually be useful to foster this emotional connection to robots. We're already seeing some great use cases, for example, robots working with autistic children to engage them in ways that we haven't seen previously, or robots working with teachers to engage kids in learning with new results. And it's not just for kids. Early studies show that robots can help doctors and patients in health care settings.

Och visst, djur är levande. Robotar är det inte. Och jag kan säga, efter att ha jobbat med robottekniker, att vi är ganska långt från att utveckla robotar som har känslor. Men vi känner med dem, och det spelar roll, för om vi försöker integrera robotar i våra gemensamma rum, behöver vi förstå att folk kommer att behandla dem annorlunda än andra maskiner, och att i vissa fall, till exempel i fallet med en soldat som blir känslomässigt fäst till den robot hen arbetar med, kan det bli allt från ineffektivt till farligt. I andra fall kan det faktiskt vara användbart att vårda den känslomässiga anknytningen till robotar. Vi ser redan några viktiga användningsområden, exempelvis robotar som arbetar med autistiska barn för att engagera dem på sätt vi inte har sett tidigare, eller robotar som jobbar med lärare och uppmuntrar barns lärande med nya resultat. Det är inte bara för barn. Tidigare studier visar att robotar kan hjälpa läkare och patienter i sjukvårdssituationer.

This is the PARO baby seal robot. It's used in nursing homes and with dementia patients. It's been around for a while. And I remember, years ago, being at a party and telling someone about this robot, and her response was, "Oh my gosh. That's horrible. I can't believe we're giving people robots instead of human care." And this is a really common response, and I think it's absolutely correct, because that would be terrible. But in this case, it's not what this robot replaces. What this robot replaces is animal therapy in contexts where we can't use real animals but we can use robots, because people will consistently treat them more like an animal than a device.

Detta är PARO, en sälbebisrobot. Den används på vårdhem och med demenspatienter. Den har funnits ganska länge. Jag minns, för flera år sedan, när jag var på en fest och berättade för någon om den här roboten, och hennes svar var, "Herregud. Vad hemskt. Det är otroligt att vi ger folk robotar istället för mänsklig vård." Detta är ett väldigt vanligt svar, och jag tycker att det stämmer, för det vore ju hemskt. Men nu är det inte det som roboten ersätter. Det som roboten ersätter är djurterapi i sammanhang där vi inte kan använda riktiga djur, men kan använda robotar, eftersom folk alltid kommer att behandla dem mer som djur än en maskin.

Acknowledging this emotional connection to robots can also help us anticipate challenges as these devices move into more intimate areas of people's lives. For example, is it OK if your child's teddy bear robot records private conversations? Is it OK if your sex robot has compelling in-app purchases?

Att erkänna det känslomässiga bandet till robotar kan även hjälpa oss att förutse problem när dessa apparater flyttar in i mer intima delar av folks liv. Är det till exempel OK att ditt barns gosedjursrobot spelar in privata samtal? Är det OK att din sexrobot har lockande köp inuti appen?

(Laughter)

(Skratt)

Because robots plus capitalism equals questions around consumer protection and privacy.

För robotar plus kapitalism är lika med frågor kring konsumentskydd och integritet.

And those aren't the only reasons that our behavior around these machines could matter. A few years after that first initial experience I had with this baby dinosaur robot, I did a workshop with my friend Hannes Gassert. And we took five of these baby dinosaur robots and we gave them to five teams of people. And we had them name them and play with them and interact with them for about an hour. And then we unveiled a hammer and a hatchet and we told them to torture and kill the robots.

Och det är inte de enda skälen till att vårt beteende kring dessa maskiner kan spela roll. Några år efter den där första erfarenheten jag hade med den här dinosauriebebisroboten gjorde jag en workshop med min vän Hannes Gassert. Vi tog fem av dessa dinosauriebebisrobotar och gav dem till fem grupper av människor. Vi fick dem att namnge dem och leka med dem och interagera med dem i ungefär en timme. Sen tog vi fram en hammare och en yxa och vi bad dem att tortera och döda robotarna.

(Laughter)

(Skratt)

And this turned out to be a little more dramatic than we expected it to be, because none of the participants would even so much as strike these baby dinosaur robots, so we had to improvise a little, and at some point, we said, "OK, you can save your team's robot if you destroy another team's robot."

Det visade sig bli lite mer dramatiskt än vi förväntat oss, eftersom ingen av deltagarna ens ville slå till bebisdinosaurierobotarna, så vi fick improvisera lite, och vid ett tillfälle sade vi, "OK, ni kan rädda ert lags robot om ni förstör ett annat lags robot."

(Laughter)

(Skratt)

And even that didn't work. They couldn't do it. So finally, we said, "We're going to destroy all of the robots unless someone takes a hatchet to one of them." And this guy stood up, and he took the hatchet, and the whole room winced as he brought the hatchet down on the robot's neck, and there was this half-joking, half-serious moment of silence in the room for this fallen robot.

Inte ens det fungerade. De kunde inte göra det. Så till slut sade vi, "Vi kommer att förstöra alla robotarna om inte någon använder yxan på en av dem." Och en kille ställde sig upp, tog yxan, och hela rummet ryckte till när han slog ned yxan på robotens nacke, och det uppstod ett halvt skämtsamt, halvt allvarligt ögonblick av tystnad i rummet för den fallna roboten.

(Laughter)

(Skratt)

So that was a really interesting experience. Now, it wasn't a controlled study, obviously, but it did lead to some later research that I did at MIT with Palash Nandy and Cynthia Breazeal, where we had people come into the lab and smash these HEXBUGs that move around in a really lifelike way, like insects. So instead of choosing something cute that people are drawn to, we chose something more basic, and what we found was that high-empathy people would hesitate more to hit the HEXBUGS.

Så det var en väldigt intressant upplevelse. Det var ju såklart inte en kontrollerad studie, men det ledde till senare forskning som jag gjorde på MIT med Palash Nandy och Cynthia Breazeal, där folk fick komma till labbet och krossa dessa HEXBUGS som rör sig på ett väldigt naturtroget sätt, som insekter. Istället för att välja något gulligt som människor dras till, valde vi något mer simpelt, och vi upptäckte att personer med hög empati tvekade mer inför att krossa våra HEXBUGS.

Now this is just a little study, but it's part of a larger body of research that is starting to indicate that there may be a connection between people's tendencies for empathy and their behavior around robots. But my question for the coming era of human-robot interaction is not: "Do we empathize with robots?" It's: "Can robots change people's empathy?" Is there reason to, for example, prevent your child from kicking a robotic dog, not just out of respect for property, but because the child might be more likely to kick a real dog?

Det här är bara en liten studie, men det är en del av ett större forskningsområde som börjar visa på att det kan finnas en koppling mellan folks tendenser för empati och hur de beter sig med robotar. Men min fråga för den kommande eran av människa-robotinteraktion är inte: "Empatiserar vi med robotar?" Utan: "Kan robotar ändra människors empati?" Finns det exempelvis en mening med att hindra ditt barn från att sparka en robothund, inte bara av respekt för egendom, men för att barnet kan vara mer benäget att sparka en riktig hund?

And again, it's not just kids. This is the violent video games question, but it's on a completely new level because of this visceral physicality that we respond more intensely to than to images on a screen. When we behave violently towards robots, specifically robots that are designed to mimic life, is that a healthy outlet for violent behavior or is that training our cruelty muscles? We don't know ... But the answer to this question has the potential to impact human behavior, it has the potential to impact social norms, it has the potential to inspire rules around what we can and can't do with certain robots, similar to our animal cruelty laws. Because even if robots can't feel, our behavior towards them might matter for us. And regardless of whether we end up changing our rules, robots might be able to help us come to a new understanding of ourselves.

Igen, det handlar inte bara om barn. Det är den våldsamma datorspelsfrågan, men på en helt ny nivå på grund av den här fysiska dimensionen som vi reagerar mer intensivt på än bilder på en skärm. När vi beter oss våldsamt mot robotar, speciellt robotar som är designade att likna en levande varelse, är det ett hälsosamt utlopp för våldsamt beteende eller är det en träning av våra grymhetsmuskler? Vi vet inte... Men svaret på denna fråga har potential att påverka mänskligt beteende, det har potential att påverka sociala normer, det har potential att ge upphov till regler om vad vi får och inte får göra med vissa robotar, liknande våra lagar om djurplågeri. Även om robotar inte kan känna, kan vårt beteende gentemot dem spela en roll för oss. Oavsett om vi i slutändan ändrar våra regler eller inte, så kan robotar hjälpa oss att få en ny förståelse för oss själva.

Most of what I've learned over the past 10 years has not been about technology at all. It's been about human psychology and empathy and how we relate to others. Because when a child is kind to a Roomba, when a soldier tries to save a robot on the battlefield, or when a group of people refuses to harm a robotic baby dinosaur, those robots aren't just motors and gears and algorithms. They're reflections of our own humanity.

Det mesta av det jag lärt mig de senaste 10 åren har inte alls handlat om teknologi. Det har handlat om mänsklig psykologi, empati och hur vi relaterar till andra. När ett barn är snällt mot en Roomba, när en soldat försöker att rädda en robot på slagfältet, eller när en grupp människor vägrar att skada en dinosauriebebisrobot, så är robotarna inte bara motorer och kugghjul och algoritmer. De är reflektioner av vår egen humanitet.

Thank you.

Tack.

(Applause)

(Applåder)