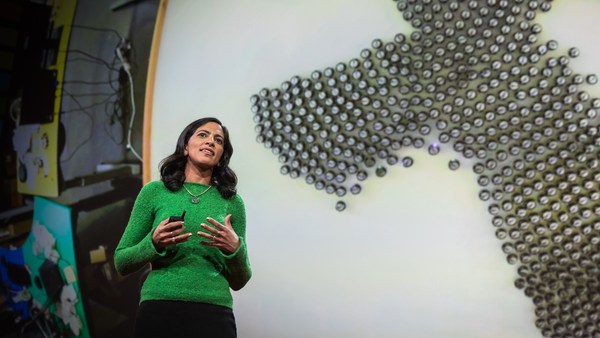

There was a day, about 10 years ago, when I asked a friend to hold a baby dinosaur robot upside down. It was this toy called a Pleo that I had ordered, and I was really excited about it because I've always loved robots. And this one has really cool technical features. It had motors and touch sensors and it had an infrared camera. And one of the things it had was a tilt sensor, so it knew what direction it was facing. And when you held it upside down, it would start to cry. And I thought this was super cool, so I was showing it off to my friend, and I said, "Oh, hold it up by the tail. See what it does." So we're watching the theatrics of this robot struggle and cry out. And after a few seconds, it starts to bother me a little, and I said, "OK, that's enough now. Let's put him back down." And then I pet the robot to make it stop crying.

Certo dia, há cerca de 10 anos, pedi a um amigo para segurar um dinossauro bebé robô de cabeça para baixo. Era um brinquedo, chamado Pleo, que eu encomendei. Eu estava super entusiasmada com ele, porque sempre adorei robôs. E este tinha aspetos técnicos super fixes. Tinha motores e sensores tácteis e uma câmara de infravermelhos. Uma das coisas que tinha era um sensor de inclinação, por isso, ele sabia em que direção estava orientado. Quando o segurávamos de cabeça para baixo, começava a chorar. Eu achei que aquilo era super fixe, mostrei-o ao meu amigo e disse-lhe: "Segura-o pela cauda. Vê o que ele faz." Nós estávamos ali a ver a teatralidade deste robô enquanto lutava e chorava. Passados uns segundos, eu começo a ficar um bocado incomodada e digo: "Ok, já chega por agora. "Vamos pousá-lo outra vez." Depois faço-lhe festas para ele deixar de chorar.

And that was kind of a weird experience for me. For one thing, I wasn't the most maternal person at the time. Although since then I've become a mother, nine months ago, and I've learned that babies also squirm when you hold them upside down.

Essa foi uma experiência estranha para mim. Primeiro, eu não era a pessoa mais maternal na altura. Apesar de, desde então, ter sido mãe, há nove meses, e sei agora que os bebés também esperneiam se segurados de cabeça para baixo.

(Laughter)

(Risos)

But my response to this robot was also interesting because I knew exactly how this machine worked, and yet I still felt compelled to be kind to it. And that observation sparked a curiosity that I've spent the past decade pursuing. Why did I comfort this robot? And one of the things I discovered was that my treatment of this machine was more than just an awkward moment in my living room, that in a world where we're increasingly integrating robots into our lives, an instinct like that might actually have consequences, because the first thing that I discovered is that it's not just me.

Mas a minha reação a este robô também foi curiosa porque eu sabia exatamente como é que aquela máquina trabalhava e, mesmo assim, senti-me compelida a ser afetuosa para com ela. Essa observação desencadeou uma curiosidade que eu tenho passado a tentar satisfazer, nos último 10 anos. Porque é que eu confortei aquele robô? Uma das coisas que descobri foi que a forma como eu tratei aquela máquina foi mais do que só um momento desconfortável na minha sala de estar. Num mundo em que estamos progressivamente a integrar mais robôs na nossa vida, um instinto como aquele pode ter consequências, porque a primeira coisa que eu descobri é que não sou a única.

In 2007, the Washington Post reported that the United States military was testing this robot that defused land mines. And the way it worked was it was shaped like a stick insect and it would walk around a minefield on its legs, and every time it stepped on a mine, one of the legs would blow up, and it would continue on the other legs to blow up more mines. And the colonel who was in charge of this testing exercise ends up calling it off, because, he says, it's too inhumane to watch this damaged robot drag itself along the minefield. Now, what would cause a hardened military officer and someone like myself to have this response to robots?

Em 2007, o The Washington Post reportou que as Forças Armadas dos EUA estavam a testar um robô que desativava minas terrestres. Ele tinha uma forma semelhante a um bicho-pau e andava à volta dum campo de minas sobre as suas patas. De cada vez que pisava uma mina, uma das suas patas explodia, e ele continuava sobre as outras patas para fazer explodir mais minas. O coronel que era responsável por esse exercício de teste acabou por o cancelar, porque, segundo ele, era demasiado desumano ver aquele robô danificado a arrastar-se pelo campo de minas. Agora, o que é que levaria um oficial militar endurecido e alguém como eu a ter este tipo de reação a robôs?

Well, of course, we're primed by science fiction and pop culture to really want to personify these things, but it goes a little bit deeper than that. It turns out that we're biologically hardwired to project intent and life onto any movement in our physical space that seems autonomous to us. So people will treat all sorts of robots like they're alive. These bomb-disposal units get names. They get medals of honor. They've had funerals for them with gun salutes. And research shows that we do this even with very simple household robots, like the Roomba vacuum cleaner.

Claro que nós somos preparados pela ficção científica e cultura popular para querer personificar estas coisas, mas é mais profundo do que isso. Na verdade, nós estamos biologicamente predefinidos para projetar intenção e vida em qualquer movimento no nosso espaço físico que nos pareça autónomo. Assim, as pessoas tratam todos os tipos de robôs como se tivessem vida. Estas unidades de desativação de bombas têm nomes. Recebem medalhas de honra. Tiveram direito a funerais com salvas de tiros. E os estudos mostram que fazemos isto até com os mais simples robôs domésticos, como o aspirador Roomba.

(Laughter)

(Risos)

It's just a disc that roams around your floor to clean it, but just the fact it's moving around on its own will cause people to name the Roomba and feel bad for the Roomba when it gets stuck under the couch.

É só um disco que vagueia pelo chão para o limpar, mas só o facto de se estar a mover por si mesmo leva as pessoas a chamarem-lhe Roomba e a sentirem-se mal se o Roomba ficar preso debaixo do sofá.

(Laughter)

(Risos)

And we can design robots specifically to evoke this response, using eyes and faces or movements that people automatically, subconsciously associate with states of mind. And there's an entire body of research called human-robot interaction that really shows how well this works. So for example, researchers at Stanford University found out that it makes people really uncomfortable when you ask them to touch a robot's private parts.

Podemos conceber robôs para provocarem esta reação, usando olhos e caras ou movimentos que as pessoas associam de forma automática e subconsciente a estados de espírito. Há uma área de estudo completa, chamada interação homem-robô, que mostra quão bem isto funciona. Por exemplo, cientistas na Universidade de Stanford concluíram que as pessoas ficam muito desconfortáveis se lhes pedem que toquem nas partes íntimas de um robô.

(Laughter)

(Risos)

So from this, but from many other studies, we know, we know that people respond to the cues given to them by these lifelike machines, even if they know that they're not real.

Por isso e por muitos outros estudos, nós sabemos que as pessoas reagem a sinais que lhes são dados por estas máquinas realistas, mesmo que saibam que elas não são reais.

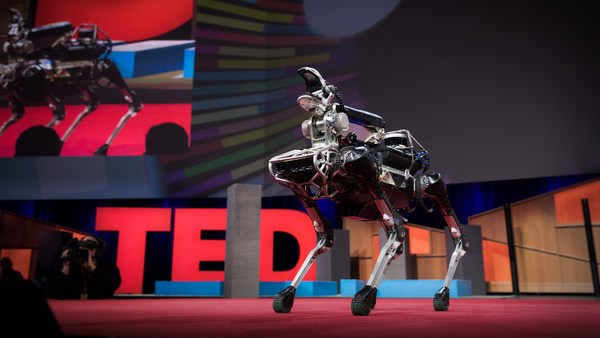

Now, we're headed towards a world where robots are everywhere. Robotic technology is moving out from behind factory walls. It's entering workplaces, households. And as these machines that can sense and make autonomous decisions and learn enter into these shared spaces, I think that maybe the best analogy we have for this is our relationship with animals. Thousands of years ago, we started to domesticate animals, and we trained them for work and weaponry and companionship. And throughout history, we've treated some animals like tools or like products, and other animals, we've treated with kindness and we've given a place in society as our companions. I think it's plausible we might start to integrate robots in similar ways.

Estamos a avançar para um mundo onde há robôs por todo o lado. A tecnologia robótica está a abandonar o interior das fábricas e está a entrar nos locais de trabalho, nas casas. À medida que estas máquinas sensitivas que tomam decisões autónomas e aprendem entram nestes espaços partilhados, acho que a nossa melhor analogia para esta situação é a nossa relação com animais. Há milhares de anos, começámos a domesticar animais, e treinámo-los como trabalhadores, como armas e como companheiros. Ao longo da história, tratámos alguns animais como ferramentas ou objetos, mas tratámos outros animais com carinho e demos-lhes um lugar na sociedade como nossos companheiros. Acho que é plausível começarmos a integrar robôs de forma semelhante.

And sure, animals are alive. Robots are not. And I can tell you, from working with roboticists, that we're pretty far away from developing robots that can feel anything. But we feel for them, and that matters, because if we're trying to integrate robots into these shared spaces, we need to understand that people will treat them differently than other devices, and that in some cases, for example, the case of a soldier who becomes emotionally attached to the robot that they work with, that can be anything from inefficient to dangerous. But in other cases, it can actually be useful to foster this emotional connection to robots. We're already seeing some great use cases, for example, robots working with autistic children to engage them in ways that we haven't seen previously, or robots working with teachers to engage kids in learning with new results. And it's not just for kids. Early studies show that robots can help doctors and patients in health care settings.

É verdade que os animais estão vivos. Os robôs não. E sei, por trabalhar com investigadores de robótica, que estamos muito longe de desenvolver robôs que sintam o que quer que seja. Mas nós sentimos por eles, e isso é importante porque, se estamos a tentar integrar robôs nestes espaços partilhados, precisamos de perceber que as pessoas irão tratá-los de forma diferente de outras máquinas e que, em alguns casos, por exemplo, no caso de um soldado que fica emocionalmente ligado ao robô com que trabalha, isso pode ser ineficaz ou mesmo perigoso. Mas, noutros casos, até pode ser útil cultivar essa relação emocional com os robôs. Já estamos a ver alguns exemplos excelentes, como robôs a trabalharem com crianças com autismo para os envolverem de forma nunca vista, ou robôs a trabalhar com professores para envolverem os alunos na aprendizagem com novos resultados. Mas não são só as crianças. Estudos recentes mostram que os robôs podem ajudar médicos e doentes na área dos cuidados de saúde.

This is the PARO baby seal robot. It's used in nursing homes and with dementia patients. It's been around for a while. And I remember, years ago, being at a party and telling someone about this robot, and her response was, "Oh my gosh. That's horrible. I can't believe we're giving people robots instead of human care." And this is a really common response, and I think it's absolutely correct, because that would be terrible. But in this case, it's not what this robot replaces. What this robot replaces is animal therapy in contexts where we can't use real animals but we can use robots, because people will consistently treat them more like an animal than a device.

Esta é a foca bebé robô PARO. É usada em lares de idosos e com doentes com demência. Já não é recente. Lembro-me de, há uns anos, estar numa festa e falar com alguém sobre este robô. A resposta dela foi: "Oh meu deus. "Isso é horrível. "Custa-me acreditar que damos robôs às pessoas, em vez de cuidados humanos." Esta é uma reação muito comum, e eu acho que está completamente certa, porque isso seria terrível. Mas neste caso, não é isso o que o robô substitui. O que este robô substitui é a terapia com animais nos casos em que não podemos usar animais verdadeiros mas podemos usar robôs, porque as pessoas vão tratá-los mais como animais do que como máquinas.

Acknowledging this emotional connection to robots can also help us anticipate challenges as these devices move into more intimate areas of people's lives. For example, is it OK if your child's teddy bear robot records private conversations? Is it OK if your sex robot has compelling in-app purchases?

Reconhecer esta ligação emocional com os robôs também nos pode ajudar a prever desafios à medida que estes entram em áreas mais privadas na vida das pessoas. Por exemplo, será correto se o ursinho de peluche dos vossos filhos puder gravar conversas privadas? E se o vosso robô sexual vos oferecer boas oportunidades de compra numa aplicação?

(Laughter)

(Risos)

Because robots plus capitalism equals questions around consumer protection and privacy.

Porque capitalismo somado a robôs origina questões relacionadas com a proteção do consumidor e a privacidade.

And those aren't the only reasons that our behavior around these machines could matter. A few years after that first initial experience I had with this baby dinosaur robot, I did a workshop with my friend Hannes Gassert. And we took five of these baby dinosaur robots and we gave them to five teams of people. And we had them name them and play with them and interact with them for about an hour. And then we unveiled a hammer and a hatchet and we told them to torture and kill the robots.

Mas não é só por isso que a forma como agimos com estas máquinas pode ser importante. Uns anos depois dessa primeira experiência que tive com o dinossauro bebé robô, fiz um "workshop" com o meu amigo Hannes Gassert. Pegámos em cinco destes dinossauros bebés robôs e demo-los a cinco equipas de pessoas. Pedimos que lhes dessem nomes, e brincassem e interagissem com eles durante uma hora. Depois mostrámos um martelo e uma machadinha e dissemos-lhes para torturarem e matarem os robôs.

(Laughter)

(Risos)

And this turned out to be a little more dramatic than we expected it to be, because none of the participants would even so much as strike these baby dinosaur robots, so we had to improvise a little, and at some point, we said, "OK, you can save your team's robot if you destroy another team's robot."

A situação ficou um bocadinho mais dramática do que tínhamos previsto, porque nenhum dos participantes atacou os bebês dinossauros robôs. Então, tivemos de improvisar um bocado, e a certa altura dissemos: "Ok, podem salvar o robô da vossa equipa se destruírem o robô de outra equipa."

(Laughter)

(Risos)

And even that didn't work. They couldn't do it. So finally, we said, "We're going to destroy all of the robots unless someone takes a hatchet to one of them." And this guy stood up, and he took the hatchet, and the whole room winced as he brought the hatchet down on the robot's neck, and there was this half-joking, half-serious moment of silence in the room for this fallen robot.

Nem mesmo isso funcionou. Eles não conseguiam. Então, por fim, dissemos: "Nós vamos destruir todos os robôs "a não ser que alguém use a machadinha num deles." Um senhor levanta-se e agarra na machadinha. Toda a gente se encolheu quando ele desceu a machadinha no pescoço do robô. Houve um momento de silêncio na sala, entre o gozo e a seriedade em nome daquele robô caído.

(Laughter)

(Risos)

So that was a really interesting experience. Now, it wasn't a controlled study, obviously, but it did lead to some later research that I did at MIT with Palash Nandy and Cynthia Breazeal, where we had people come into the lab and smash these HEXBUGs that move around in a really lifelike way, like insects. So instead of choosing something cute that people are drawn to, we chose something more basic, and what we found was that high-empathy people would hesitate more to hit the HEXBUGS.

Então, essa experiência acabou por ser muito interessante. É óbvio que não foi um estudo controlado, mas levou-me a uma pesquisa que fiz mais tarde no MIT com o Palash Nandy e a Cynthia Breazeal, em que vinham pessoas ao laboratório e esmagavam HEXBUGs, que se movem de uma forma muito realista, como insetos. Em vez de escolhermos algo fofo que atraísse as pessoas escolhemos algo mais básico. Descobrimos que as pessoas com mais empatia hesitavam mais em esmagar os HEXBUGs.

Now this is just a little study, but it's part of a larger body of research that is starting to indicate that there may be a connection between people's tendencies for empathy and their behavior around robots. But my question for the coming era of human-robot interaction is not: "Do we empathize with robots?" It's: "Can robots change people's empathy?" Is there reason to, for example, prevent your child from kicking a robotic dog, not just out of respect for property, but because the child might be more likely to kick a real dog?

Este é só um pequeno estudo, mas faz parte de uma pesquisa maior que começa a indicar que talvez haja uma correlação entre as tendências de empatia das pessoas e o seu comportamento com robôs. Mas a minha questão para o futuro da interação entre humanos e robôs não é: "Sentimos empatia com os robôs?" mas sim: "Podem os robôs mudar a empatia dos humanos?" Por exemplo, haverá uma razão para impedirmos uma criança de dar pontapés num cão robótico não só por respeito material, mas porque pode levar a criança a dar pontapés num cão verdadeiro?

And again, it's not just kids. This is the violent video games question, but it's on a completely new level because of this visceral physicality that we respond more intensely to than to images on a screen. When we behave violently towards robots, specifically robots that are designed to mimic life, is that a healthy outlet for violent behavior or is that training our cruelty muscles? We don't know ... But the answer to this question has the potential to impact human behavior, it has the potential to impact social norms, it has the potential to inspire rules around what we can and can't do with certain robots, similar to our animal cruelty laws. Because even if robots can't feel, our behavior towards them might matter for us. And regardless of whether we end up changing our rules, robots might be able to help us come to a new understanding of ourselves.

E novamente, não são só as crianças. Esta é a questão dos jogos de vídeo violentos, mas a um nível totalmente novo devido a este aspeto físico visceral a que reagimos mais intensamente do que a imagens num ecrã. Quando somos violentos para com robôs, especificamente robôs concebidos para imitarem vida, será uma forma saudável de nos libertarmos de comportamentos violentos ou será treinar os nossos músculos da crueldade? Não sabemos... Mas a resposta a esta pergunta pode ter impacto no comportamento humano, pode ter impacto nas normas sociais, pode inspirar legislação sobre o que podemos ou não fazer com certos robôs, em semelhança com as leis sobre a crueldade animal. Porque apesar de os robôs nada sentirem, o nosso comportamento em relação a eles pode ser importante para nós. E independentemente de mudarmos ou não as nossas regras, os robôs podem ajudar-nos a compreendermo-nos melhor.

Most of what I've learned over the past 10 years has not been about technology at all. It's been about human psychology and empathy and how we relate to others. Because when a child is kind to a Roomba, when a soldier tries to save a robot on the battlefield, or when a group of people refuses to harm a robotic baby dinosaur, those robots aren't just motors and gears and algorithms. They're reflections of our own humanity.

A maior parte do que aprendi nos últimos 10 anos não tem sido, de forma alguma, sobre tecnologia. Tem sido sobre psicologia humana, sobre empatia e como nos relacionamos com os outros. Porque, quando uma criança é gentil com um Roomba, quando um soldado tenta salvar um robô num campo de batalha, ou quando um grupo de pessoas se recusa a magoar um bebé dinossauro robô, esses robôs não são só motores e engrenagens e algoritmos. São reflexo da nossa própria humanidade.

Thank you.

Obrigada.

(Applause)

(Aplausos)