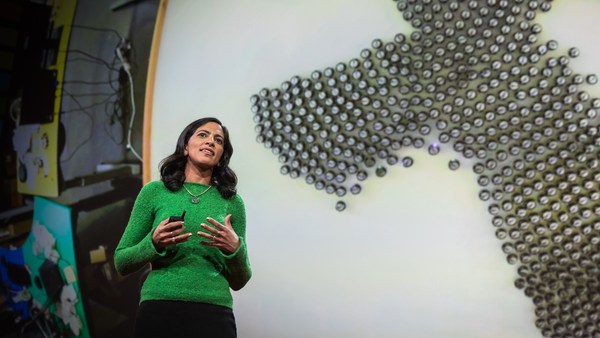

There was a day, about 10 years ago, when I asked a friend to hold a baby dinosaur robot upside down. It was this toy called a Pleo that I had ordered, and I was really excited about it because I've always loved robots. And this one has really cool technical features. It had motors and touch sensors and it had an infrared camera. And one of the things it had was a tilt sensor, so it knew what direction it was facing. And when you held it upside down, it would start to cry. And I thought this was super cool, so I was showing it off to my friend, and I said, "Oh, hold it up by the tail. See what it does." So we're watching the theatrics of this robot struggle and cry out. And after a few seconds, it starts to bother me a little, and I said, "OK, that's enough now. Let's put him back down." And then I pet the robot to make it stop crying.

Op een dag, zo'n tien jaar geleden, vroeg ik aan een vriend of hij een babydinosaurusrobot ondersteboven wilde houden. Het was een speelgoedbeest, een Pleo, dat ik besteld had, en ik was er erg enthousiast over omdat ik altijd van robots gehouden heb. En deze had hele gave technologische functies. Hij had motortjes, aanraaksensoren en een infraroodcamera. Hij had ook een kantelsensor, zodat hij wist welke kant boven was. En als je hem ondersteboven hield, begon hij te huilen. Ik vond dit erg gaaf en liet hem trots aan mijn vriend zien. "Hou hem eens bij zijn staart vast", zei ik, "en kijk wat er gebeurt." Dus we staan te kijken naar de verrichtingen van deze robot, die spartelt en huilt. Na een paar seconden ga ik me een beetje ongemakkelijk voelen en zeg ik: "Oké, nu is het wel genoeg. Zet hem maar weer neer." Daarna aaide ik de robot om hem te laten ophouden met huilen.

And that was kind of a weird experience for me. For one thing, I wasn't the most maternal person at the time. Although since then I've become a mother, nine months ago, and I've learned that babies also squirm when you hold them upside down.

Dat was best een vreemde ervaring voor me. Ten eerste was ik destijds niet zo'n moederlijk type. Al ben ik negen maanden geleden zelf moeder geworden en heb ik geleerd dat baby's ook spartelen als je ze ondersteboven houdt.

(Laughter)

(Gelach)

But my response to this robot was also interesting because I knew exactly how this machine worked, and yet I still felt compelled to be kind to it. And that observation sparked a curiosity that I've spent the past decade pursuing. Why did I comfort this robot? And one of the things I discovered was that my treatment of this machine was more than just an awkward moment in my living room, that in a world where we're increasingly integrating robots into our lives, an instinct like that might actually have consequences, because the first thing that I discovered is that it's not just me.

Maar mijn reactie op deze robot was ook interessant, omdat ik precies wist hoe dit apparaat werkte en er toch aardig tegen wilde zijn. Dat intrigeerde mij en daar ben ik de laatste tien jaar mee bezig geweest. Waarom troostte ik die robot? Ik ontdekte dat de manier waarop ik dit apparaat behandelde meer om het lijf had dan een enkel ongemakkelijk moment in mijn woonkamer, en dat in een wereld waar robots steeds meer een deel van ons leven worden, zo'n instinct daadwerkelijk consequenties zou kunnen hebben, want het eerste waar ik achter kwam, was dat ik niet de enige ben.

In 2007, the Washington Post reported that the United States military was testing this robot that defused land mines. And the way it worked was it was shaped like a stick insect and it would walk around a minefield on its legs, and every time it stepped on a mine, one of the legs would blow up, and it would continue on the other legs to blow up more mines. And the colonel who was in charge of this testing exercise ends up calling it off, because, he says, it's too inhumane to watch this damaged robot drag itself along the minefield. Now, what would cause a hardened military officer and someone like myself to have this response to robots?

In 2007 schreef de Washington Post dat het Amerikaanse leger een robot aan het testen was die landmijnen onschadelijk maakte. Het was een soort wandelende tak die over een mijnenveld liep en als hij op een mijn trapte, werd een van zijn poten opgeblazen en liep hij verder op één poot minder om nog meer mijnen op te blazen. De kolonel die deze testoefening leidde, blies haar uiteindelijk helemaal af, omdat hij het onmenselijk vond om toe te kijken hoe deze robot zich over het mijnenveld sleepte. Hoe zou het kunnen dat een door de wol geverfde legerofficier en iemand zoals ik op deze manier op robots reageren?

Well, of course, we're primed by science fiction and pop culture to really want to personify these things, but it goes a little bit deeper than that. It turns out that we're biologically hardwired to project intent and life onto any movement in our physical space that seems autonomous to us. So people will treat all sorts of robots like they're alive. These bomb-disposal units get names. They get medals of honor. They've had funerals for them with gun salutes. And research shows that we do this even with very simple household robots, like the Roomba vacuum cleaner.

Natuurlijk hebben science fiction en popcultuur ons ertoe aangezet deze dingen te verpersoonlijken, maar het gaat dieper. Het blijkt dat het in onze natuur zit om intenties en leven toe te schrijven aan alles wat in onze omgeving uit zichzelf lijkt te bewegen. Dus we zullen allerlei soorten robots behandelen alsof het levende wezens zijn. Robots die mijnen ontmantelen, krijgen een naam. Ze krijgen eremedailles. Er zijn begrafenissen met saluutschoten voor hen georganiseerd. Onderzoek wijst uit dat we dit zelfs met simpele huishoudrobots doen, zoals de Roomba-stofzuiger.

(Laughter)

(Gelach)

It's just a disc that roams around your floor to clean it, but just the fact it's moving around on its own will cause people to name the Roomba and feel bad for the Roomba when it gets stuck under the couch.

Dat is niet meer dan een schijf die rondrijdt en je vloer schoonmaakt, maar het feit dat hij zelfstandig beweegt zorgt ervoor dat mensen hem een naam geven en het rot voor hem vinden als hij onder de bank vast komt te zitten.

(Laughter)

(Gelach)

And we can design robots specifically to evoke this response, using eyes and faces or movements that people automatically, subconsciously associate with states of mind. And there's an entire body of research called human-robot interaction that really shows how well this works. So for example, researchers at Stanford University found out that it makes people really uncomfortable when you ask them to touch a robot's private parts.

We kunnen robots zo ontwerpen dat ze juist deze reactie uitlokken, door ze uit te rusten met ogen en gezichten of bewegingen die mensen automatisch en onbewust associëren met gemoedstoestanden. Er is een hele onderzoekstak, mens-robotinteractie genaamd, die laat zien hoe goed dit werkt. Onderzoekers van de Stanford University ontdekten bijvoorbeeld dat mensen zich ongemakkelijk voelen als je hen vraagt de edele delen van een robot aan te raken.

(Laughter)

(Gelach)

So from this, but from many other studies, we know, we know that people respond to the cues given to them by these lifelike machines, even if they know that they're not real.

Door deze en veel andere onderzoeken weten we dat mensen reageren op signalen die ze krijgen van deze levensechte apparaten, zelfs als ze weten dat ze niet echt zijn.

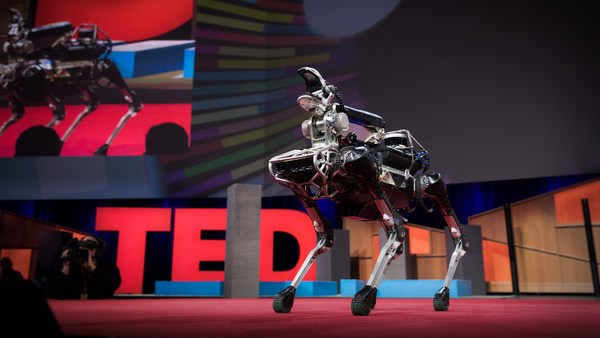

Now, we're headed towards a world where robots are everywhere. Robotic technology is moving out from behind factory walls. It's entering workplaces, households. And as these machines that can sense and make autonomous decisions and learn enter into these shared spaces, I think that maybe the best analogy we have for this is our relationship with animals. Thousands of years ago, we started to domesticate animals, and we trained them for work and weaponry and companionship. And throughout history, we've treated some animals like tools or like products, and other animals, we've treated with kindness and we've given a place in society as our companions. I think it's plausible we might start to integrate robots in similar ways.

We gaan naar een wereld toe waarin overal robots zijn. Robottechnologie begeeft zich buiten de fabrieksmuren. Het komt naar de werkvloer en huishoudens. Als deze apparaten, die kunnen voelen, zelfstandig beslissingen nemen en leren, tot deze gedeelde ruimtes doordringen, denk ik dat we dat het beste kunnen vergelijken met de relatie die we met dieren hebben. Duizenden jaren geleden begonnen we dieren te temmen en hen te leren voor ons te werken, te vechten en ons gezelschap te houden. Sommige dieren hebben we behandeld als gereedschap of als product; andere hebben we vriendelijk behandeld en als huisdier een plaats gegeven in onze gemeenschap. Het is denkbaar dat we robots op dezelfde manier zullen integreren.

And sure, animals are alive. Robots are not. And I can tell you, from working with roboticists, that we're pretty far away from developing robots that can feel anything. But we feel for them, and that matters, because if we're trying to integrate robots into these shared spaces, we need to understand that people will treat them differently than other devices, and that in some cases, for example, the case of a soldier who becomes emotionally attached to the robot that they work with, that can be anything from inefficient to dangerous. But in other cases, it can actually be useful to foster this emotional connection to robots. We're already seeing some great use cases, for example, robots working with autistic children to engage them in ways that we haven't seen previously, or robots working with teachers to engage kids in learning with new results. And it's not just for kids. Early studies show that robots can help doctors and patients in health care settings.

Natuurlijk, dieren zijn levende wezens. Robots zijn dat niet. Ik kan jullie vertellen, door mijn werk met robotici, dat we nog lang geen robots kunnen ontwikkelen die iets kunnen voelen. Maar wij hebben wel gevoelens ten aanzien van hén en dat is belangrijk, want als we robots willen toelaten in deze gezamenlijke ruimtes, dan moeten we begrijpen dat we er anders mee omgaan dan met andere apparaten en dat dit soms, zoals bij de soldaat die zich emotioneel hecht aan de robot waarmee hij werkt, inefficiënt kan zijn of zelfs ronduit gevaarlijk. In andere gevallen kan het juist handig zijn om deze emotionele band met robots te versterken. We kennen al verschillende praktische toepassingen, zoals robots die werken met autistische kinderen en hun aandacht vasthouden op manieren die we nog niet eerder gezien hebben, of robots die samen met leraren kinderen helpen te leren, met resultaat. En het werkt niet alleen bij kinderen. Vroege studies laten zien dat robots artsen en patiënten kunnen helpen op het gebied van zorg.

This is the PARO baby seal robot. It's used in nursing homes and with dementia patients. It's been around for a while. And I remember, years ago, being at a party and telling someone about this robot, and her response was, "Oh my gosh. That's horrible. I can't believe we're giving people robots instead of human care." And this is a really common response, and I think it's absolutely correct, because that would be terrible. But in this case, it's not what this robot replaces. What this robot replaces is animal therapy in contexts where we can't use real animals but we can use robots, because people will consistently treat them more like an animal than a device.

Dit is de PARO-babyzeehondrobot. Hij wordt gebruikt in verzorgingshuizen en bij dementiepatiënten. Hij is er al een tijdje. En ik herinner me, jaren geleden, toen ik op een feestje was en ik iemand vertelde over deze robot, haar reactie was: "Oh, mijn god. Dat is verschrikkelijk. Niet te geloven dat we mensen robots geven in plaats van menselijke zorg." Deze reactie komt vaak voor en ik denk inderdaad dat hij helemaal terecht is, want dat zou verschrikkelijk zijn. Maar dat is niet wat de robot hier vervangt. Deze robot vervangt diertherapie als we geen echte dieren kunnen gebruiken maar robots wel, omdat we die consequent meer als dier dan als apparaat behandelen.

Acknowledging this emotional connection to robots can also help us anticipate challenges as these devices move into more intimate areas of people's lives. For example, is it OK if your child's teddy bear robot records private conversations? Is it OK if your sex robot has compelling in-app purchases?

Als we deze emotionele band met robots erkennen, kan ons dat ook helpen uitdagingen het hoofd te bieden als deze apparaten hun intrede doen in onze privésfeer. Is het bijvoorbeeld acceptabel als de teddybeerrobot van je kind vertrouwelijke gesprekken opneemt? Is het acceptabel als je seksrobot onweerstaanbare in-app aankopen aanbiedt?

(Laughter)

(Gelach)

Because robots plus capitalism equals questions around consumer protection and privacy.

Want de combinatie van robots en kapitalisme roept vragen op over consumentenbescherming en privacy.

And those aren't the only reasons that our behavior around these machines could matter. A few years after that first initial experience I had with this baby dinosaur robot, I did a workshop with my friend Hannes Gassert. And we took five of these baby dinosaur robots and we gave them to five teams of people. And we had them name them and play with them and interact with them for about an hour. And then we unveiled a hammer and a hatchet and we told them to torture and kill the robots.

En dat zijn niet de enige redenen waarom onze opstelling tegenover deze apparaten van belang kan zijn. Een paar jaar na mijn eerste ervaring met die babydinosaurusrobot gaf ik een workshop met mijn vriend Hannes Gassert. We gaven vijf van deze babydinosaurusrobots aan vijf groepjes mensen. Ze moesten er een naam voor verzinnen en ze mochten ermee spelen en ermee aanrommelen, zo'n uur lang. Toen haalden we een hamer en bijl tevoorschijn en vroegen hen de robots te martelen en vermoorden.

(Laughter)

(Gelach)

And this turned out to be a little more dramatic than we expected it to be, because none of the participants would even so much as strike these baby dinosaur robots, so we had to improvise a little, and at some point, we said, "OK, you can save your team's robot if you destroy another team's robot."

Dit leek iets gevoeliger te liggen dan we gedacht hadden, want geen van de deelnemers wilde ook maar een tik uitdelen aan deze babydinosaurusrobots, dus moesten we improviseren en op een gegeven moment zeiden we: "Jullie kunnen je eigen robot redden als jullie die van een ander team slopen."

(Laughter)

(Gelach)

And even that didn't work. They couldn't do it. So finally, we said, "We're going to destroy all of the robots unless someone takes a hatchet to one of them." And this guy stood up, and he took the hatchet, and the whole room winced as he brought the hatchet down on the robot's neck, and there was this half-joking, half-serious moment of silence in the room for this fallen robot.

Zelfs dat werkte niet. Ze konden het niet. Uiteindelijk zeiden we: "We gaan alle robots vernietigen tenzij iemand er één met een bijl bewerkt." Eén man stond op en pakte de bijl, en iedereen kromp ineen toen hij de bijl liet neerkomen op de nek van de robot; in de kamer viel een ogenblik stilte, half geamuseerd, half ernstig, vanwege deze gevallen robot.

(Laughter)

(Gelach)

So that was a really interesting experience. Now, it wasn't a controlled study, obviously, but it did lead to some later research that I did at MIT with Palash Nandy and Cynthia Breazeal, where we had people come into the lab and smash these HEXBUGs that move around in a really lifelike way, like insects. So instead of choosing something cute that people are drawn to, we chose something more basic, and what we found was that high-empathy people would hesitate more to hit the HEXBUGS.

Dat was een heel interessante ervaring. Het was natuurlijk geen gecontroleerd onderzoek, maar het zorgde ervoor dat ik meer onderzoek ging doen aan het MIT met Palash Nandy en Cynthia Breazeal. We lieten mensen naar het lab komen en lieten hen deze HEXBUGs slopen; ze bewegen zich als insecten, op een levensechte manier. In plaats van iets schattigs te kiezen waar mensen zich tot aangetrokken voelen, kozen we iets simpelers en we ontdekten dat mensen die veel inlevingsvermogen hebben langer aarzelden om op de HEXBUGs in te slaan.

Now this is just a little study, but it's part of a larger body of research that is starting to indicate that there may be a connection between people's tendencies for empathy and their behavior around robots. But my question for the coming era of human-robot interaction is not: "Do we empathize with robots?" It's: "Can robots change people's empathy?" Is there reason to, for example, prevent your child from kicking a robotic dog, not just out of respect for property, but because the child might be more likely to kick a real dog?

Dit is maar een klein onderzoek, maar het maakt deel uit van een grote groep onderzoeken die beginnen uit te wijzen dat er een verband zou kunnen zijn tussen iemands inlevingsvermogen en zijn houding ten aanzien van robots. Mijn vraag voor de toekomst van mens-robotinteractie is niet: 'Kunnen we ons inleven in robots?' maar: 'Hebben robots invloed op ons inlevingsvermogen?' Moet je bijvoorbeeld verhinderen dat je kind een robothond schopt, niet alleen omdat je nu eenmaal tegen spullen aan trapt, maar omdat het kind misschien anders ook sneller een echte hond zou schoppen?

And again, it's not just kids. This is the violent video games question, but it's on a completely new level because of this visceral physicality that we respond more intensely to than to images on a screen. When we behave violently towards robots, specifically robots that are designed to mimic life, is that a healthy outlet for violent behavior or is that training our cruelty muscles? We don't know ... But the answer to this question has the potential to impact human behavior, it has the potential to impact social norms, it has the potential to inspire rules around what we can and can't do with certain robots, similar to our animal cruelty laws. Because even if robots can't feel, our behavior towards them might matter for us. And regardless of whether we end up changing our rules, robots might be able to help us come to a new understanding of ourselves.

Nogmaals, het gaat hier niet alleen over kinderen. Hetzelfde speelt bij gewelddadige videogames, maar nu is het op totaal onbekend terrein, want op lichamelijke prikkels reageren we veel sterker dan op schermbeelden. Als we ons gewelddadig opstellen naar robots toe, vooral naar robots die ontworpen zijn om levensecht te lijken, is dat dan een gezonde uitlaatklep voor onze gewelddadige gevoelens of trainen we dan juist ons vermogen om ons wreed te gedragen? We weten het niet ... Het antwoord op deze vraag kan menselijk gedrag beïnvloeden, kan sociale normen beïnvloeden, kan leiden tot regels over wat we wel en niet kunnen doen met bepaalde robots, net zoals er wetten zijn omtrent dierenmishandeling. Want zelfs als robots geen gevoel hebben, dan nog kan de manier waarop we ons tegenover hen opstellen, belangrijk zijn. Of we nu wel of niet de regels gaan veranderen, robots zouden ons kunnen helpen onszelf beter te gaan begrijpen.

Most of what I've learned over the past 10 years has not been about technology at all. It's been about human psychology and empathy and how we relate to others. Because when a child is kind to a Roomba, when a soldier tries to save a robot on the battlefield, or when a group of people refuses to harm a robotic baby dinosaur, those robots aren't just motors and gears and algorithms. They're reflections of our own humanity.

Het meeste van wat ik de laatste tien jaar heb geleerd, ging helemaal niet over technologie. Het ging over psychologie en empathie en hoe we met elkaar omgaan. Want als een kind lief doet tegen een Roomba, als een soldaat een robot op het slagveld probeert te redden, of als een groep mensen weigert om een babydinosaurusrobot kwaad te doen, dan zijn deze robots niet alleen motoren en tandwielen en algoritmes. Dan zijn ze reflecties van onze eigen menselijkheid.

Thank you.

Dank jullie wel.

(Applause)

(Applaus)