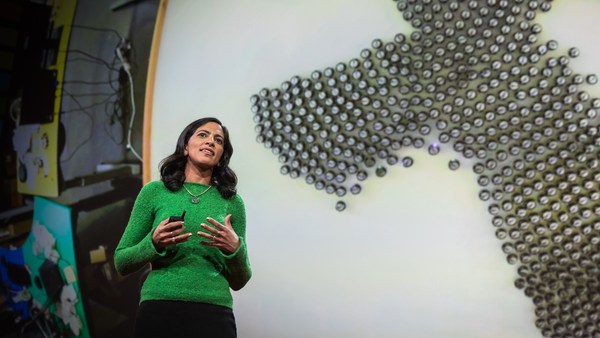

There was a day, about 10 years ago, when I asked a friend to hold a baby dinosaur robot upside down. It was this toy called a Pleo that I had ordered, and I was really excited about it because I've always loved robots. And this one has really cool technical features. It had motors and touch sensors and it had an infrared camera. And one of the things it had was a tilt sensor, so it knew what direction it was facing. And when you held it upside down, it would start to cry. And I thought this was super cool, so I was showing it off to my friend, and I said, "Oh, hold it up by the tail. See what it does." So we're watching the theatrics of this robot struggle and cry out. And after a few seconds, it starts to bother me a little, and I said, "OK, that's enough now. Let's put him back down." And then I pet the robot to make it stop crying.

10年くらい前のことですが 赤ちゃん恐竜ロボットを 逆さに持ってみてと友達に言ったんです 「プレオ」というオモチャを手に入れ はしゃいでいました ロボットは昔から 大好きでしたので このロボットには いろいろすごい機能があり モーターや 接触センサーや 赤外線カメラなんかに加え 傾斜センサーが入っていて 体の向きが 分かるようになっていました そして逆さにしてやると 泣き出すんです これはすごいと感心し 友達にも見せてやろうと思ったわけです 「ちょっと これの尻尾を持ってみて どうなるか」 そして このロボットが もがき泣く姿を見ていましたが 少しして なんか嫌な気がしてきて 「ねえ もういいでしょう 下に置いてあげて」と言い ロボットが泣き止むように 撫でてやりました

And that was kind of a weird experience for me. For one thing, I wasn't the most maternal person at the time. Although since then I've become a mother, nine months ago, and I've learned that babies also squirm when you hold them upside down.

私にとって 奇妙な体験でした 当時の私は そんなに母性的な 人間ではありませんでしたから でも9ヶ月前に 私も母親になって 逆さに持つと 赤ん坊も もがきまわるのが分かりました

(Laughter)

(笑)

But my response to this robot was also interesting because I knew exactly how this machine worked, and yet I still felt compelled to be kind to it. And that observation sparked a curiosity that I've spent the past decade pursuing. Why did I comfort this robot? And one of the things I discovered was that my treatment of this machine was more than just an awkward moment in my living room, that in a world where we're increasingly integrating robots into our lives, an instinct like that might actually have consequences, because the first thing that I discovered is that it's not just me.

このロボットに対する 自分の反応が興味深かったのは その機械的な仕組みは 理解していたのに 優しくしてあげなきゃと 感じたからです その時の観察が この10年追い続けてきた 好奇心に火を付けたのです なぜ自分はこのロボットを いたわったのか? ひとつ分かったのは このロボットへの対応というのは うちの居間で起きた 気まずい瞬間にとどまるものではなく 生活の中にロボットがますます 組み込まれつつある世の中で このような感覚は 様々な結果を もたらしうるということでした 私だけじゃないことが 分かったんです

In 2007, the Washington Post reported that the United States military was testing this robot that defused land mines. And the way it worked was it was shaped like a stick insect and it would walk around a minefield on its legs, and every time it stepped on a mine, one of the legs would blow up, and it would continue on the other legs to blow up more mines. And the colonel who was in charge of this testing exercise ends up calling it off, because, he says, it's too inhumane to watch this damaged robot drag itself along the minefield. Now, what would cause a hardened military officer and someone like myself to have this response to robots?

2007年にワシントンポスト紙が 米軍の実験している 地雷処理ロボットについて報じました それはナナフシみたいな 姿をしていて 脚を使って地雷原を歩き回り 地雷を踏むごとに 脚の1つが吹き飛ばされますが 歩き続けて地雷を爆発させていく というものでした 責任者だった大佐は 実験を中止させました 傷ついたロボットが地雷原を 這い回るのを見ているのは非人間的だからと 筋金入りの軍人や 私みたいな人間に そういう反応をさせたものは 何だったのか?

Well, of course, we're primed by science fiction and pop culture to really want to personify these things, but it goes a little bit deeper than that. It turns out that we're biologically hardwired to project intent and life onto any movement in our physical space that seems autonomous to us. So people will treat all sorts of robots like they're alive. These bomb-disposal units get names. They get medals of honor. They've had funerals for them with gun salutes. And research shows that we do this even with very simple household robots, like the Roomba vacuum cleaner.

SFや大衆文化によって こういったものを擬人化することに 馴れているというのもありますが これはもっと根が深いもので 生物学的に私達は 自律的に動くものに対し 意思や生命を見ようと するようにできているんです 人がロボットを生き物のように 扱うのはそのためです こういう爆発物処理ロボットに 名前が付けられ 勲章が授与され 礼砲付きの葬礼が 行われたりします 相手が単純な家庭用ロボットでも 人はそう反応することが分かっています 掃除ロボットの ルンバでさえも

(Laughter)

(笑)

It's just a disc that roams around your floor to clean it, but just the fact it's moving around on its own will cause people to name the Roomba and feel bad for the Roomba when it gets stuck under the couch.

ただの円盤形をしていて 床の上を動き回って掃除をしますが 自分で動き回る というところが 持ち主に名前を付けさせたり ソファの下に引っかかっているのを 可愛そうと思わせたりするんです

(Laughter)

(笑)

And we can design robots specifically to evoke this response, using eyes and faces or movements that people automatically, subconsciously associate with states of mind. And there's an entire body of research called human-robot interaction that really shows how well this works. So for example, researchers at Stanford University found out that it makes people really uncomfortable when you ask them to touch a robot's private parts.

そういう反応を引き起こすべく ロボットをデザインすることもできます 目や顔を付けたり 人が無意識に 感情と結び付けるような 動作をさせることによって そういった現象について研究する 「ヒューマン-ロボット・インタラクション」 という分野もあります たとえばスタンフォード大の研究者が 発見したことですが ロボットであっても 陰部に触れるよう言われると 人はすごく気まずく 感じるんです

(Laughter)

(笑)

So from this, but from many other studies, we know, we know that people respond to the cues given to them by these lifelike machines, even if they know that they're not real.

多くの研究から こういう生き物のように 見えるロボットが出す合図に対し 人間は作り物だと 知りながら 反応することが 分かっています

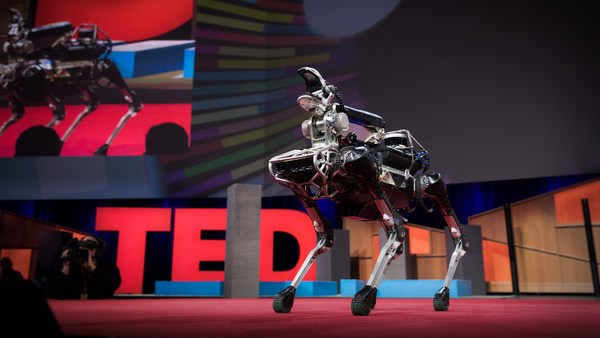

Now, we're headed towards a world where robots are everywhere. Robotic technology is moving out from behind factory walls. It's entering workplaces, households. And as these machines that can sense and make autonomous decisions and learn enter into these shared spaces, I think that maybe the best analogy we have for this is our relationship with animals. Thousands of years ago, we started to domesticate animals, and we trained them for work and weaponry and companionship. And throughout history, we've treated some animals like tools or like products, and other animals, we've treated with kindness and we've given a place in society as our companions. I think it's plausible we might start to integrate robots in similar ways.

私達はロボットが至るところに いるような世界へと向かっています ロボット技術は もはや工場の中だけのものではなく オフィスや家庭へと 進出しています そういった場所へと 入ってくる 知覚し 自律的に決断し 学ぶことのできる機械に対して 最善のアナロジーとなるのは 動物との関係かもしれません 数千年前に人類は 動物を家畜化するようになり 労働や戦争のため また遊び相手として 飼い慣らしてきました 歴史を通して ある動物は道具や商品として扱われ ある動物は 思いやりをもって扱われ 社会の中で 人間の仲間としての 位置を与えられました ロボットもまた同じように取り込まれて いくというのは ありそうなことです

And sure, animals are alive. Robots are not. And I can tell you, from working with roboticists, that we're pretty far away from developing robots that can feel anything. But we feel for them, and that matters, because if we're trying to integrate robots into these shared spaces, we need to understand that people will treat them differently than other devices, and that in some cases, for example, the case of a soldier who becomes emotionally attached to the robot that they work with, that can be anything from inefficient to dangerous. But in other cases, it can actually be useful to foster this emotional connection to robots. We're already seeing some great use cases, for example, robots working with autistic children to engage them in ways that we haven't seen previously, or robots working with teachers to engage kids in learning with new results. And it's not just for kids. Early studies show that robots can help doctors and patients in health care settings.

もちろん動物は生きており ロボットは生きてはいません ロボット研究者と一緒に 働いている経験から言えますが 感情を持つロボットができるのは 随分先の話です でも人間はロボットに同情し そこが重要なんです ロボットを社会に 取り込んでいくのであれば 人はロボットに対し 他の機械とは違った扱いをすることを 理解しておく必要があります たとえば兵士が 一緒に働くロボットに 愛着を抱く場合などには 非効率さや危険をもたらす 可能性もあります でも他の場合には ロボットへの感情的な繋がりを 育むことが 有用であり得ます すでに素晴らしい実例が 知られています たとえば自閉症の子供が ロボット相手に これまで見られなかった 反応を見せるとか 教師がロボットを使い 子供の学習で 新たな結果が得られているとか またこれは 子供に限った話ではなく 医療現場でロボットが 医師や患者の助けに なり得ることが示されています

This is the PARO baby seal robot. It's used in nursing homes and with dementia patients. It's been around for a while. And I remember, years ago, being at a party and telling someone about this robot, and her response was, "Oh my gosh. That's horrible. I can't believe we're giving people robots instead of human care." And this is a really common response, and I think it's absolutely correct, because that would be terrible. But in this case, it's not what this robot replaces. What this robot replaces is animal therapy in contexts where we can't use real animals but we can use robots, because people will consistently treat them more like an animal than a device.

これは「パロ」という 赤ちゃんアザラシのロボットで 養護施設や認知症患者のケアに 使われていて 結構前からあるものです よく覚えていますが 何年も前にパーティーで このロボットの話をしたところ 相手がこう言ったんです 「それひどくないですか 人間じゃなくロボットに 世話をさせるなんて信じられない」 これは ごく一般的な反応で まったくもって 正しいと思います もしそうなら 酷い話ですから でもこの場合 人間がロボットに 置き換わるわけではありません 置き換わるのは 動物介在療法で 本物の動物が 使えない場合に ロボットを使うんです 人はロボットを機械よりは 動物のように扱いますから

Acknowledging this emotional connection to robots can also help us anticipate challenges as these devices move into more intimate areas of people's lives. For example, is it OK if your child's teddy bear robot records private conversations? Is it OK if your sex robot has compelling in-app purchases?

このロボットに対する感情的な 繋がりが分かっていれば ロボットがより身近な存在に なったときに起きる問題も 予期できるように なるでしょう たとえば子供の テディベアロボットが 私的な会話を録音するのは 良いのかとか セックスロボットがApp内課金を促すのを 認めて良いのかとか

(Laughter)

(笑)

Because robots plus capitalism equals questions around consumer protection and privacy.

ロボットと資本主義の 組み合わせには 消費者保護やプライバシーの問題が からんできますから

And those aren't the only reasons that our behavior around these machines could matter. A few years after that first initial experience I had with this baby dinosaur robot, I did a workshop with my friend Hannes Gassert. And we took five of these baby dinosaur robots and we gave them to five teams of people. And we had them name them and play with them and interact with them for about an hour. And then we unveiled a hammer and a hatchet and we told them to torture and kill the robots.

でも機械に対する人間の振る舞いが 問題になりうるのは そういう理由ばかり ではありません あの赤ちゃん恐竜ロボットでの 最初の経験から数年後に 私は友人のハネス・ガッサートと ワークショップを開きました 赤ちゃん恐竜ロボットを 5体用意し それぞれ5つのグループに渡し 名前を付けて 1時間くらい それで遊んでもらいました それからハンマーと 斧を出して ロボットを痛め付けて 殺すように言いました

(Laughter)

(笑)

And this turned out to be a little more dramatic than we expected it to be, because none of the participants would even so much as strike these baby dinosaur robots, so we had to improvise a little, and at some point, we said, "OK, you can save your team's robot if you destroy another team's robot."

これは予期していたよりも 少しばかりショックを与えたようで 参加者の誰も 赤ちゃん恐竜ロボットを 叩こうとさえしません それでもっと後押ししなければ ならなくなって 言いました 「他のチームのロボットを壊せば 自分のチームのロボットは壊さなくていいです」

(Laughter)

(笑)

And even that didn't work. They couldn't do it. So finally, we said, "We're going to destroy all of the robots unless someone takes a hatchet to one of them." And this guy stood up, and he took the hatchet, and the whole room winced as he brought the hatchet down on the robot's neck, and there was this half-joking, half-serious moment of silence in the room for this fallen robot.

それでもうまくいかず みんな手をこまねいています 最後には こう言いました 「誰かが斧を手に取って どれか1つに振り下ろさないなら ロボットをみんな壊します」 それで1人が立ち上がって 斧を手にし ロボットの首に 斧を振り下ろすと 部屋にいたみんなが ギクッとしました そして半分冗談 半分真剣な しばしの沈黙が 倒れたロボットに 捧げられました

(Laughter)

(笑)

So that was a really interesting experience. Now, it wasn't a controlled study, obviously, but it did lead to some later research that I did at MIT with Palash Nandy and Cynthia Breazeal, where we had people come into the lab and smash these HEXBUGs that move around in a really lifelike way, like insects. So instead of choosing something cute that people are drawn to, we chose something more basic, and what we found was that high-empathy people would hesitate more to hit the HEXBUGS.

すごく面白い経験でした これは対照試験では ありませんでしたが 後に私がパラッシュ・ナンディーと シンシア・ブリジールと一緒に MITで行った研究に 繋がりました 実験室に来てもらった人たちに この昆虫みたいな 生き物のように動き回る HEXBUGを潰してもらいました 可愛くて惹かれる ようなものではなく もっと簡素なロボットを 使ったんですが 共感力の強い人ほど HEXBUGを潰すことに ためらいを感じることが 分かりました

Now this is just a little study, but it's part of a larger body of research that is starting to indicate that there may be a connection between people's tendencies for empathy and their behavior around robots. But my question for the coming era of human-robot interaction is not: "Do we empathize with robots?" It's: "Can robots change people's empathy?" Is there reason to, for example, prevent your child from kicking a robotic dog, not just out of respect for property, but because the child might be more likely to kick a real dog?

これはちっぽけな研究ですが ずっと大きな研究領域の一部で 人の共感傾向とロボットに対する 振る舞いの間には 繋がりがあることが 示されつつあります 来るべき人とロボット共生の 時代への疑問は 「人はロボットに共感するのか?」 ではなく 「ロボットは人の共感性を変えられるのか?」 ということです たとえばロボット犬を 蹴らないよう 子供をしつけることに 効果はあるのか— 物を大事にする という点だけでなく 本物の犬を蹴るような人間に ならないようにするために

And again, it's not just kids. This is the violent video games question, but it's on a completely new level because of this visceral physicality that we respond more intensely to than to images on a screen. When we behave violently towards robots, specifically robots that are designed to mimic life, is that a healthy outlet for violent behavior or is that training our cruelty muscles? We don't know ... But the answer to this question has the potential to impact human behavior, it has the potential to impact social norms, it has the potential to inspire rules around what we can and can't do with certain robots, similar to our animal cruelty laws. Because even if robots can't feel, our behavior towards them might matter for us. And regardless of whether we end up changing our rules, robots might be able to help us come to a new understanding of ourselves.

これも子供に限ったこと ではありません 暴力的ゲームの問題と同じに聞こえますが まったく別次元の話で 画面上のイメージよりも 形あるものに対して 私たちはより強く 反応するからです 特に生き物に似せてデザインされた ロボットに対して 暴力的に振る舞うのは 暴力性に対する 健全なはけ口になるのか それとも暴力性を 強めることになるのか? 分かりません でもこの問いへの答えは 人間の行動や社会規範に 影響する可能性があり ロボットに対して何ができ 何ができないかという ルールに繋がる 可能性があります ちょうど動物虐待防止法のように— ロボットは何も感じないとしても ロボットに対する振る舞いは 私たち自身に影響するかもしれないんです そして法律を変えることに なるかどうかにかかわらず ロボットは人間についての 新たな理解をもたらすかもしれません

Most of what I've learned over the past 10 years has not been about technology at all. It's been about human psychology and empathy and how we relate to others. Because when a child is kind to a Roomba, when a soldier tries to save a robot on the battlefield, or when a group of people refuses to harm a robotic baby dinosaur, those robots aren't just motors and gears and algorithms. They're reflections of our own humanity.

この10年で私の 学んできたことの多くは テクノロジーに 関することではなく 人間の心理 共感 他人との関わり方についてです 子供がルンバに対して 優しく接するとき 兵士が戦場でロボットを 救おうとするとき 人々が赤ちゃん恐竜ロボットを 傷つけることを拒むとき ロボットはモーターと歯車と プログラムだけのものではありません 私達自身の人間性の 反映なのです

Thank you.

ありがとうございました

(Applause)

(拍手)