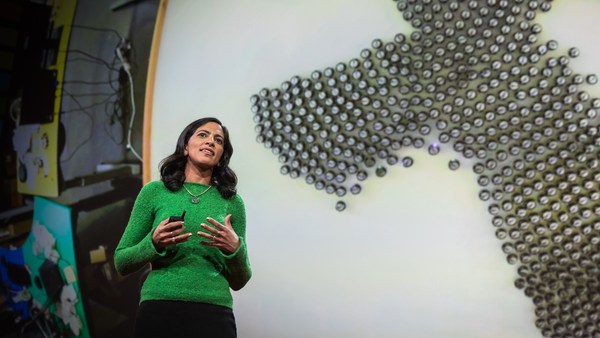

There was a day, about 10 years ago, when I asked a friend to hold a baby dinosaur robot upside down. It was this toy called a Pleo that I had ordered, and I was really excited about it because I've always loved robots. And this one has really cool technical features. It had motors and touch sensors and it had an infrared camera. And one of the things it had was a tilt sensor, so it knew what direction it was facing. And when you held it upside down, it would start to cry. And I thought this was super cool, so I was showing it off to my friend, and I said, "Oh, hold it up by the tail. See what it does." So we're watching the theatrics of this robot struggle and cry out. And after a few seconds, it starts to bother me a little, and I said, "OK, that's enough now. Let's put him back down." And then I pet the robot to make it stop crying.

יום אחד, לפני עשר שנים בערך, ביקשתי מחבר להחזיק רובוט של דינוזאור תינוק הפוך. זה היה צעצוע בשם פליאו שהזמנתי, והייתי נרגשת מאוד כי תמיד אהבתי רובוטים. ולרובוט הזה היו תכונות ממש מגניבות. היו לו מנועים וחיישני נגיעה ומצלמת אינפרא-אדום. והיה לו גם חיישן הטייה, כך שהוא ידע באיזה כיוון מחזיקים אותו ביחס לאדמה. וכשהחזיקו אותו הפוך, הוא היה מתחיל לבכות. אני חשבתי שזה ממש מגניב, אז הראיתי את זה לחבר שלי, ואמרתי, "תחזיק אותו מהזנב ותראה מה הוא עושה." אז עמדנו וצפינו ברובוט שהתחיל להיאבק ולבכות. ואחרי כמה שניות, זה התחיל להציק לי קצת, ואמרתי, "בסדר, זה מספיק. בוא נניח אותו." ואז ליטפתי את הרובוט כדי שיפסיק לבכות.

And that was kind of a weird experience for me. For one thing, I wasn't the most maternal person at the time. Although since then I've become a mother, nine months ago, and I've learned that babies also squirm when you hold them upside down.

זו הייתה חוויה די משונה בשבילי. מצד אחד, לא הייתי מאוד אימהית בזמנו. למרות שמאז הפכתי לאם, לפני תשעה חודשים, ולמדתי שגם תינוקות מתחילים לבכות כשמחזיקים אותם הפוך.

(Laughter)

(צחוק)

But my response to this robot was also interesting because I knew exactly how this machine worked, and yet I still felt compelled to be kind to it. And that observation sparked a curiosity that I've spent the past decade pursuing. Why did I comfort this robot? And one of the things I discovered was that my treatment of this machine was more than just an awkward moment in my living room, that in a world where we're increasingly integrating robots into our lives, an instinct like that might actually have consequences, because the first thing that I discovered is that it's not just me.

אבל התגובה שלי לרובוט הזה הייתה מעניינת כי ידעתי בדיוק כיצד המכונה הזאת עובדת, ובכל זאת הרגשתי צורך להיות נחמדה אליה. ההבחנה הזו הציתה בי סקרנות שהובילה את המחקר שלי בעשור האחרון. למה ליטפתי וניחמתי את הרובוט? ואחד הדברים שגיליתי, היה שהיחס שלי למכונה הזו היה יותר מרגע מביך בסלון שלי. שבעולם שבו יותר ויותר רובוטים משתלבים בחיינו, לאינסטינקט כזה יכולות להיות השלכות. כי הדבר הראשון שגיליתי היה שאני לא היחידה.

In 2007, the Washington Post reported that the United States military was testing this robot that defused land mines. And the way it worked was it was shaped like a stick insect and it would walk around a minefield on its legs, and every time it stepped on a mine, one of the legs would blow up, and it would continue on the other legs to blow up more mines. And the colonel who was in charge of this testing exercise ends up calling it off, because, he says, it's too inhumane to watch this damaged robot drag itself along the minefield. Now, what would cause a hardened military officer and someone like myself to have this response to robots?

בשנת 2007, העיתון וושינגטון פוסט דיווח שצבא ארה"ב ערך ניסויים עם רובוט לנטרול מוקשים. זה היה רובוט בצורת חרק מקלוני שהיה אמור ללכת בשדות מוקשים, ובכל פעם שדרך על מוקש, אחת מרגליו היתה מתפוצצת, והוא היה ממשיך ללכת על הרגליים שנותרו לו ולפוצץ מוקשים נוספים. הקולונל שהיה אחראי לבדיקת הרובוט עצר את הבדיקה בשלב מסויים, כיוון שלטענתו זה היה אכזרי מדי לצפות ברובוט הפגוע ממשיך לגרור את עצמו על הרגליים שנותרו לו בשדה המוקשים. עכשיו, מה יכול לגרום לקצין צבא קשוח ולאישה כמוני להגיב באופן כזה לרובוטים?

Well, of course, we're primed by science fiction and pop culture to really want to personify these things, but it goes a little bit deeper than that. It turns out that we're biologically hardwired to project intent and life onto any movement in our physical space that seems autonomous to us. So people will treat all sorts of robots like they're alive. These bomb-disposal units get names. They get medals of honor. They've had funerals for them with gun salutes. And research shows that we do this even with very simple household robots, like the Roomba vacuum cleaner.

ובכן, כמובן, המדע הבדיוני ותרבות הפופ השפיעו עלינו וגרמו לנו להשליך רגשות ותכונות אנושיות על החפצים האלו, אבל זה טיפה יותר עמוק מזה. מסתבר שאנחנו מתוכנתים ביולוגית להניח את קיומם של כוונות וחיים עבור כל דבר שנע במרחב ונראה אוטונומי. כך שאנשים יתייחסו לכל מני רובוטים כאילו הם חיים. הרובוטים לפירוק מוקשים מקבלים שמות. הם מקבלים מדליות. ערכו להם הלוויות צבאיות מכובדות. והמחקר מראה שאנחנו עושים את זה אפילו עם רובוטים ביתיים פשוטים, כמו הרובוט שואב האבק.

(Laughter)

(צחוק)

It's just a disc that roams around your floor to clean it, but just the fact it's moving around on its own will cause people to name the Roomba and feel bad for the Roomba when it gets stuck under the couch.

זה בסה"כ משהו עגול שמסתובב על הרצפה ומנקה אותה, אבל עצם העובדה שהוא נע בכוחות עצמו תגרום לאנשים לתת לו שם ולהרגיש רע עבורו כשהוא נתקע מתחת לספה.

(Laughter)

(צחוק)

And we can design robots specifically to evoke this response, using eyes and faces or movements that people automatically, subconsciously associate with states of mind. And there's an entire body of research called human-robot interaction that really shows how well this works. So for example, researchers at Stanford University found out that it makes people really uncomfortable when you ask them to touch a robot's private parts.

ואנחנו יכולים לתכנן רובוטים במיוחד כדי לעורר את התגובה הזו, בעזרת עיניים ופנים או תנועה כך שאנשים ייחסו להם תכונות ורגשות באופן אוטומטי, תת מודע. ויש תחום מחקר שלם, שנקרא יחסי אדם-רובוט שמראה עד כמה טוב זה עובד. לדוגמה, חוקרים באוניברסיטת סטנפורד גילו שאנשים מרגישים לא בנוח כשמבקשים מהם לגעת באיברים המוצנעים של הרובוט.

(Laughter)

(צחוק)

So from this, but from many other studies, we know, we know that people respond to the cues given to them by these lifelike machines, even if they know that they're not real.

מהמחקר הזה, וממחקרים רבים נוספים, אנחנו יודעים שאנשים מגיבים לסימנים שנותנות המכונות דמויות-החיים הללו אפילו כשהם יודעים שזה לא אמיתי.

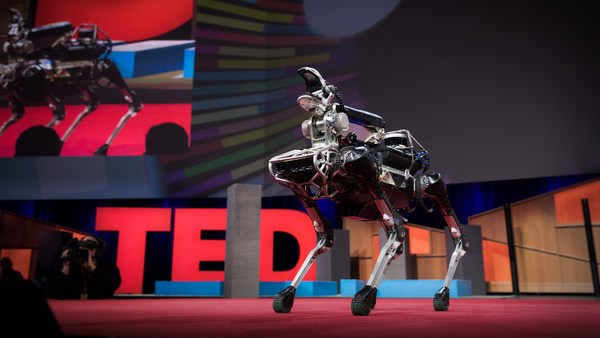

Now, we're headed towards a world where robots are everywhere. Robotic technology is moving out from behind factory walls. It's entering workplaces, households. And as these machines that can sense and make autonomous decisions and learn enter into these shared spaces, I think that maybe the best analogy we have for this is our relationship with animals. Thousands of years ago, we started to domesticate animals, and we trained them for work and weaponry and companionship. And throughout history, we've treated some animals like tools or like products, and other animals, we've treated with kindness and we've given a place in society as our companions. I think it's plausible we might start to integrate robots in similar ways.

עכשיו, אנחנו צועדים לעבר עולם שבו הרובוטים נמצאים בכל מקום. הטכנולוגיה הרובוטית יוצאת מגבולות המפעלים והתעשייה. היא נכנסת למקומות עבודה ולבתים פרטיים. וכשהמכונות האלו, שיכולות לחוש ולקבל החלטות וללמוד נכנסות לחללים המשותפים הללו, אני חושבת שהאנלוגיה הטובה ביותר שיש לנו עבור זה היא היחס שלנו לבעלי החיים. לפני אלפי שנים, התחלנו לביית חיות, ואימנו אותם לעבודה, למלחמה וללוויה. לאורך ההיסטוריה, התייחסנו לחיות מסויימות כאל כלים או מוצרים, ולחיות אחרות התייחסנו בחמלה ונתנו להן מקום בחברה כבני הלוויה שלנו. נראה לי הגיוני שנתחיל לשלב רובוטים באופן דומה.

And sure, animals are alive. Robots are not. And I can tell you, from working with roboticists, that we're pretty far away from developing robots that can feel anything. But we feel for them, and that matters, because if we're trying to integrate robots into these shared spaces, we need to understand that people will treat them differently than other devices, and that in some cases, for example, the case of a soldier who becomes emotionally attached to the robot that they work with, that can be anything from inefficient to dangerous. But in other cases, it can actually be useful to foster this emotional connection to robots. We're already seeing some great use cases, for example, robots working with autistic children to engage them in ways that we haven't seen previously, or robots working with teachers to engage kids in learning with new results. And it's not just for kids. Early studies show that robots can help doctors and patients in health care settings.

וכמובן, בעלי חיים הם חיים. רובוטים אינם חיים. ואני יכולה לספר לכן, מעבודתי בתחום הרובוטיקה, שאנחנו רחוקים מאוד מהיכולת לפתח רובוטים בעלי רגשות. אבל אנחנו מזדהים איתם, וזה חשוב, כי אם אנחנו מנסים להכניס רובוטים לחללים המשותפים הללו, אנחנו צריכים להבין שאנשים יתייחסו אליהם אחרת מאשר למכשירים אחרים, ושבמקרים מסויימים, לדוגמה, במקרה של חייל שנקשר רגשית לרובוט שעבד איתו, זה יכול להיות לא יעיל ואף מסוכן. אבל במקרים אחרים, זה יכול להיות שימושי לחזק את הקשר הרגשי לרובוטים. אנחנו כבר רואים מקרים כאלו. לדוגמה, רובוטים שעובדים עם ילדים אוטיסטים ומצליחים להגיע אליהם באופנים חדשים, או רובוטים שעובדים עם מורים לאתגר תלמידים שמראים תוצאות חדשות. וזה לא רק עבור ילדים. מחקרים ראשוניים מראים שרובוטים יכולים לעזור לרופאים ולמטופלים לנהל טוב יותר את הטיפול הרפואי.

This is the PARO baby seal robot. It's used in nursing homes and with dementia patients. It's been around for a while. And I remember, years ago, being at a party and telling someone about this robot, and her response was, "Oh my gosh. That's horrible. I can't believe we're giving people robots instead of human care." And this is a really common response, and I think it's absolutely correct, because that would be terrible. But in this case, it's not what this robot replaces. What this robot replaces is animal therapy in contexts where we can't use real animals but we can use robots, because people will consistently treat them more like an animal than a device.

זה רובוט בצורת כלב-ים תינוק של חברת PARO משתמשים בו בבתי אבות ובאופן כללי עבור חולי דמנציה. הוא נמצא בשימוש כבר זמן מה. ואני זוכרת שלפני שנים, הייתי במסיבה וסיפרתי למישהי על הרובוט הזה. והתגובה שלה היתה, "אלוהים אדירים. זה איום ונורא. אני לא מאמינה שאנחנו נותנים לאנשים רובוטים במקום טיפול אנושי." זו תגובה נפוצה, ואני חושבת שהיא נכונה לחלוטין, כי זה באמת יהיה נורא. אבל במקרה הזה, הרובוט לא מחליף את הטיפול האנושי. הרובוט הזה מחליף תרפיה ע"י טיפול בבע"ח במקרים בהם אי אפשר לתת למטופל לטפל בבעלי חיים אמיתיים אבל אפשר להשתמש ברובוטים, כי אנשים מתייחסים אליהם כמו אל בעלי חיים ולא כמו אל מכשירים.

Acknowledging this emotional connection to robots can also help us anticipate challenges as these devices move into more intimate areas of people's lives. For example, is it OK if your child's teddy bear robot records private conversations? Is it OK if your sex robot has compelling in-app purchases?

אם נכיר בקשר הרגשי הזה עם הרובוטים נהיה מסוגלים לצפות את האתגרים שנכונים לנו כשהמכשירים הללו יכנסו לתחומים אישיים יותר בחיינו. לדוגמא, האם זה בסדר שהרובוט-צעצוע של הילד שלכם יקליט שיחות אישיות? האם זה בסדר שרובוט-הסקס שלכם יציע אפשרויות רכישה?

(Laughter)

(צחוק)

Because robots plus capitalism equals questions around consumer protection and privacy.

כי אם משלבים רובוטים וקפיטליזם מקבלים סוגיות של פרטיות והגנה על הצרכן.

And those aren't the only reasons that our behavior around these machines could matter. A few years after that first initial experience I had with this baby dinosaur robot, I did a workshop with my friend Hannes Gassert. And we took five of these baby dinosaur robots and we gave them to five teams of people. And we had them name them and play with them and interact with them for about an hour. And then we unveiled a hammer and a hatchet and we told them to torture and kill the robots.

ואלו אינן הסיבות היחידות בגללן ההתנהגות שלנו כלפי המכונות האלו משנה. כמה שנים לאחר ההתנסות הראשונית שלי עם הרובוט בצורת דינוזאור תינוק העברתי סדנא עם חברי הנס גאזרט ולקחנו חמישה רובוטים כאלו ונתנו אותם לחמש קבוצות של אנשים. וביקשנו מהם לתת להם שמות ולשחק איתם ולתקשר איתם במשך כשעה. ואז חשפנו בפניהם פטיש וגרזן וביקשנו מהם לענות ולהרוג את הרובוטים.

(Laughter)

(צחוק)

And this turned out to be a little more dramatic than we expected it to be, because none of the participants would even so much as strike these baby dinosaur robots, so we had to improvise a little, and at some point, we said, "OK, you can save your team's robot if you destroy another team's robot."

וזה הפך להיות יותר דרמטי מכפי שציפינו שזה יהיה, כי אף אחד מהמשתתפים לא היה מוכן אפילו להכות את הרובוט דינוזאור-תינוק, אז אילתרנו קצת, ובשלב מסויים אמרנו, "בסדר, תוכלו להציל את הרובוט של הקבוצה שלכם אם תשמידו את הרובוט של הקבוצה השנייה."

(Laughter)

(צחוק)

And even that didn't work. They couldn't do it. So finally, we said, "We're going to destroy all of the robots unless someone takes a hatchet to one of them." And this guy stood up, and he took the hatchet, and the whole room winced as he brought the hatchet down on the robot's neck, and there was this half-joking, half-serious moment of silence in the room for this fallen robot.

ואפילו אז לא הצלחנו. הם לא היו מסוגלים לעשות את זה. אז לבסוף אמרנו, "אנחנו הולכים להרוס את כל הרובוטים אלא אם כן מישהו מכן יכה באחד מהם בגרזן." ובחור אחד נעמד, ולקח את הגרזן, וכל החדר נרתע כשהוא הכה בגרזן על צוואר הרובוט, והיתה דקת דומייה, חצי-בצחוק חצי-רצינית לזכרו של הרובוט.

(Laughter)

(צחוק)

So that was a really interesting experience. Now, it wasn't a controlled study, obviously, but it did lead to some later research that I did at MIT with Palash Nandy and Cynthia Breazeal, where we had people come into the lab and smash these HEXBUGs that move around in a really lifelike way, like insects. So instead of choosing something cute that people are drawn to, we chose something more basic, and what we found was that high-empathy people would hesitate more to hit the HEXBUGS.

זו הייתה חוויה מאוד מעניינת. ברור שזה לא היה ניסוי מבוקר, אבל הוא הוביל למחקר נוסף שערכתי ב-MIT עם פלש ננדי וסינתיה בריזיל, שבו הכנסנו אנשים למעבדה וביקשנו מהם לרמוס רובוטי HEXBUG שהתרוצצו על הרצפה ממש כמו חרקים אמתיים. במקום לבחור משהו חמוד שאנשים נמשכים אליו, בחרנו משהו יותר בסיסי וגילינו שאנשים מאוד אמפתיים היססו יותר לפגוע ב-HEXBUG.

Now this is just a little study, but it's part of a larger body of research that is starting to indicate that there may be a connection between people's tendencies for empathy and their behavior around robots. But my question for the coming era of human-robot interaction is not: "Do we empathize with robots?" It's: "Can robots change people's empathy?" Is there reason to, for example, prevent your child from kicking a robotic dog, not just out of respect for property, but because the child might be more likely to kick a real dog?

זה רק מחקר אחד קטן, אבל הוא חלק מגוף ידע הולך וגדל שמצביע על קשר אפשרי בין היכולת של אנשים לגלות אמפתיה להתנהגות שלהם כלפי רובוטים. אבל השאלה שלי, עבור העידן המתקרב של אינטראקציה בין רובוטים לבני אדם אינה: "האם אנו מרגישים אמפתיה כלפי רובוטים?" אלא: "האם רובוטים יכולים לשנות את היכולת של אנשים לחוש אמפתיה?" האם יש סיבה, לדוגמא, למנוע מילד לבעוט בכלב רובוטי, לא כדי ללמד אותו כבוד לרכוש, אלא כיוון שהוא עלול לבעוט בעתיד בכלבים אמתיים?

And again, it's not just kids. This is the violent video games question, but it's on a completely new level because of this visceral physicality that we respond more intensely to than to images on a screen. When we behave violently towards robots, specifically robots that are designed to mimic life, is that a healthy outlet for violent behavior or is that training our cruelty muscles? We don't know ... But the answer to this question has the potential to impact human behavior, it has the potential to impact social norms, it has the potential to inspire rules around what we can and can't do with certain robots, similar to our animal cruelty laws. Because even if robots can't feel, our behavior towards them might matter for us. And regardless of whether we end up changing our rules, robots might be able to help us come to a new understanding of ourselves.

ושוב, לא מדובר רק בילדים. זו אותה שאלה שעולה לגבי משחקי וידאו אלימים, אבל ברמה אחרת לגמרי כי אנחנו מגיבים בעוצמה גבוהה הרבה יותר לעצמים פיזיים מאשר לתמונות על מסך. כשאנחנו אלימים כלפי רובוטים, במיוחד רובוטים שעוצבו כך שהם מחקים חיים, האם זאת דרך בריאה לשחרר יצרים אלימים או אימון של שריר האכזריות שלנו? אנחנו לא יודעים... אבל לתשובה על השאלה הזו יש את היכולת להשפיע על ההתנהגות האנושית, יש לה את היכולת להשפיע על הנורמות החברתיות, יש לה את היכולת לעצב חוקים לגבי מה מותר ואסור לעשות עם רובוטים מסוג מסויים, בדומה לחוקי צער בעלי חיים. כיוון שאפילו אם רובוטים אינם מרגישים דבר, ההתנהגות שלנו כלפיהם עלולה לשנות אותנו. ובין אם בסופו של דבר נשנה את החוקים או לא הרובוטים יכולים לעזור לנו להבין את עצמנו טוב יותר.

Most of what I've learned over the past 10 years has not been about technology at all. It's been about human psychology and empathy and how we relate to others. Because when a child is kind to a Roomba, when a soldier tries to save a robot on the battlefield, or when a group of people refuses to harm a robotic baby dinosaur, those robots aren't just motors and gears and algorithms. They're reflections of our own humanity.

לרוב מה שלמדתי בעשר השנים האחרונות לא היה כל קשר לטכנולוגיה. למדתי על הפסיכולוגיה האנושית על אמפתיה ועל איך שאנחנו מתייחסים האחד לשני. כי כשילד מגלה חמלה כלפי רובוט שואב-אבק, כשחייל מנסה להציל רובוט בשדה הקרב, או כשקבוצת אנשים מסרבת לפגוע בדינוזאור-תינוק רובוטי, הרובוטים האלו אינם רק מנוע וגלגלי שיניים ואלגוריתמים. הם השתקפויות של האנושיות שלנו.

Thank you.

תודה.

(Applause)

(מחיאות כפיים)