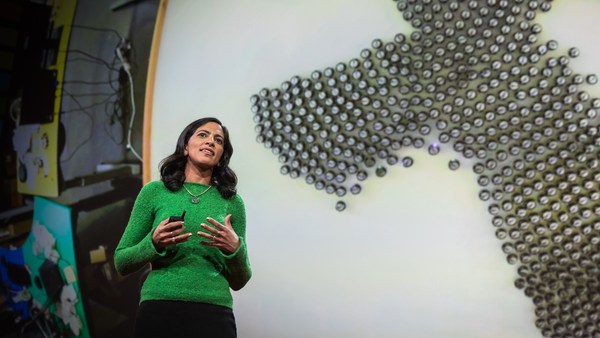

There was a day, about 10 years ago, when I asked a friend to hold a baby dinosaur robot upside down. It was this toy called a Pleo that I had ordered, and I was really excited about it because I've always loved robots. And this one has really cool technical features. It had motors and touch sensors and it had an infrared camera. And one of the things it had was a tilt sensor, so it knew what direction it was facing. And when you held it upside down, it would start to cry. And I thought this was super cool, so I was showing it off to my friend, and I said, "Oh, hold it up by the tail. See what it does." So we're watching the theatrics of this robot struggle and cry out. And after a few seconds, it starts to bother me a little, and I said, "OK, that's enough now. Let's put him back down." And then I pet the robot to make it stop crying.

Un jour, il y a environ 10 ans, j'ai demandé à un ami de tenir à l'envers un robot en forme de petit dinosaure. J'avais commandé ce jouet qui répond au nom de Pleo. J'étais vraiment ravie car j'ai toujours aimé les robots. Celui-ci avait des caractéristiques vraiment cool. Il avait des moteurs, des capteurs haptiques et une caméra infrarouge. Il avait aussi un capteur d'inclinaison qui lui permettait de savoir dans quelle direction il était. Si on le tenait la tête en bas, il se mettait à pleurer. Je trouvais ça super et donc j'étais fière de le montrer à mon ami. Je lui ai proposé de le tenir par la queue pour voir sa réaction. On observe les gesticulations du robot qui se débat et pleure, mais après quelques secondes, ça a commencé à me perturber un peu. Alors j'ai décrété que c'était assez et que nous devrions le remettre à l'endroit. J'ai alors caressé le robot jusqu'à ce qu'il arrête de pleurer.

And that was kind of a weird experience for me. For one thing, I wasn't the most maternal person at the time. Although since then I've become a mother, nine months ago, and I've learned that babies also squirm when you hold them upside down.

Ce fut une expérience troublante pour moi. D'abord, je n'étais pas particulièrement maternelle à l'époque. Je suis devenue une maman il y a neuf mois, et j'ai appris que les enfants aussi sont contrariés si on les tient la tête en bas.

(Laughter)

(Rires)

But my response to this robot was also interesting because I knew exactly how this machine worked, and yet I still felt compelled to be kind to it. And that observation sparked a curiosity that I've spent the past decade pursuing. Why did I comfort this robot? And one of the things I discovered was that my treatment of this machine was more than just an awkward moment in my living room, that in a world where we're increasingly integrating robots into our lives, an instinct like that might actually have consequences, because the first thing that I discovered is that it's not just me.

Mais ma réaction vis-à-vis du robot est intéressante car, en dépit du fait que je savais exactement comment la machine fonctionnait, j'ai quand-même ressenti le besoin de lui montrer de l'affection. Cette observation a piqué ma curiosité et cela fait une dizaine d'années que je m'y intéresse. Pourquoi ai-je consolé ce robot ? Une des choses que j'ai découvertes est que ma réaction avec cette machine est davantage qu'un moment bizarre dans mon salon et que dans un monde où nous intégrons de plus en plus les robots dans nos vies, un tel instinct peut avoir des conséquences concrètes, car la première chose que j'ai découverte, c'est que je ne suis pas la seule.

In 2007, the Washington Post reported that the United States military was testing this robot that defused land mines. And the way it worked was it was shaped like a stick insect and it would walk around a minefield on its legs, and every time it stepped on a mine, one of the legs would blow up, and it would continue on the other legs to blow up more mines. And the colonel who was in charge of this testing exercise ends up calling it off, because, he says, it's too inhumane to watch this damaged robot drag itself along the minefield. Now, what would cause a hardened military officer and someone like myself to have this response to robots?

En 2007, le Washington Post a publié un reportage sur l'armée américaine qui faisait des essais avec un robot détonateur de mines antipersonnel. Le robot avait la forme d'un phasme. Il marchait dans les champs de mines et chaque fois qu'une de ses pattes en touchait une, elle explosait. Le robot continuait de chercher d'autres mines sur ses pattes restantes. Le colonel responsable de cet essai a fini par arrêter le programme, car, selon lui, c'était trop inhumain d'observer le robot endommagé se traîner dans les champs de mines. Qu'est-ce qui peut bien susciter chez un militaire endurci et quelqu'un comme moi une telle réaction vis-à-vis des robots ?

Well, of course, we're primed by science fiction and pop culture to really want to personify these things, but it goes a little bit deeper than that. It turns out that we're biologically hardwired to project intent and life onto any movement in our physical space that seems autonomous to us. So people will treat all sorts of robots like they're alive. These bomb-disposal units get names. They get medals of honor. They've had funerals for them with gun salutes. And research shows that we do this even with very simple household robots, like the Roomba vacuum cleaner.

Il est vrai que nous sommes poussés par la science-fiction et la culture pop à concevoir de l'anthropomorphisme pour ces objets. Mais c'est un peu plus compliqué que ça. En fait, nous sommes biologiquement conçus pour projeter intention et vie dans toutes les choses animées dans notre espace physique qui paraissent autonomes. Dès lors, on traite toutes sortes de robots comme s'ils étaient vivants. On donne des noms aux engins de déminage et on leur remettait des médailles. Ils ont même eu des funérailles avec salve d'honneur. Les recherches éclairent le fait que nous agissons ainsi avec nos robots ménagers comme l'aspirateur Roomba.

(Laughter)

(Rires)

It's just a disc that roams around your floor to clean it, but just the fact it's moving around on its own will cause people to name the Roomba and feel bad for the Roomba when it gets stuck under the couch.

C'est un simple disque qui déambule sur le sol pour le nettoyer, mais le seul fait de se mouvoir autours de nous incite les gens à lui donner un nom et à ressentir de la peine pour le Roomba quand celui-ci est coincé.

(Laughter)

(Rires)

And we can design robots specifically to evoke this response, using eyes and faces or movements that people automatically, subconsciously associate with states of mind. And there's an entire body of research called human-robot interaction that really shows how well this works. So for example, researchers at Stanford University found out that it makes people really uncomfortable when you ask them to touch a robot's private parts.

On peut concevoir des robots précisément pour susciter cette réaction, en utilisant des yeux et un visage ou des mouvements que les gens vont automatiquement associer inconsciemment à des états d'esprit. Il y a un champ de recherche entier, l'interaction humains - robots, qui explique ces mécanismes. Par exemple, des chercheurs de l'Université de Stanford ont découvert que ça met les gens très mal à l'aise quand on leur demande de toucher les parties intimes d'un robot.

(Laughter)

(Rires)

So from this, but from many other studies, we know, we know that people respond to the cues given to them by these lifelike machines, even if they know that they're not real.

De ces réactions, et d'autres recherches, nous savons que les gens réagissent à des indices qui leur sont tendus par ces engins mimant la vie, même quand ils savent que ces engins ne sont pas vivants.

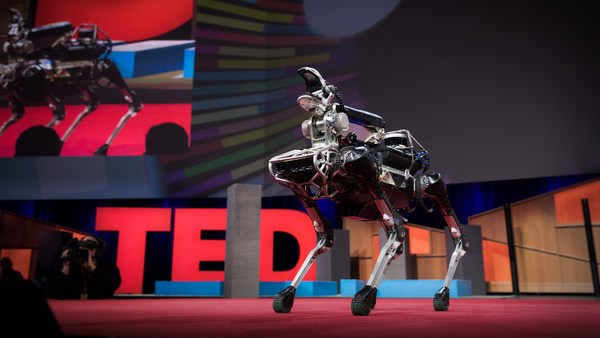

Now, we're headed towards a world where robots are everywhere. Robotic technology is moving out from behind factory walls. It's entering workplaces, households. And as these machines that can sense and make autonomous decisions and learn enter into these shared spaces, I think that maybe the best analogy we have for this is our relationship with animals. Thousands of years ago, we started to domesticate animals, and we trained them for work and weaponry and companionship. And throughout history, we've treated some animals like tools or like products, and other animals, we've treated with kindness and we've given a place in society as our companions. I think it's plausible we might start to integrate robots in similar ways.

Notre avenir sera rempli de robots. La technologie robotique est en train de sortir des usines. Elle intègre le lieu de travail, le domicile. Alors que ces machines autonomes qui peuvent sentir, prendre des décisions et apprendre, intègrent notre environnement de vie, je pense que la meilleure analogie à disposition est notre relation avec les animaux. Il y a des milliers d'années, on a domestiqué les animaux et on les a entraînés au travail, à la guerre et à devenir nos compagnons. Durant l'histoire, on a traité certaines bêtes comme des outils ou des marchandises et on a traité d'autres animaux avec affection, on leur a donné une place dans la société en tant que compagnons. Je pense plausible que nous commencions à intégrer les robots de la même manière.

And sure, animals are alive. Robots are not. And I can tell you, from working with roboticists, that we're pretty far away from developing robots that can feel anything. But we feel for them, and that matters, because if we're trying to integrate robots into these shared spaces, we need to understand that people will treat them differently than other devices, and that in some cases, for example, the case of a soldier who becomes emotionally attached to the robot that they work with, that can be anything from inefficient to dangerous. But in other cases, it can actually be useful to foster this emotional connection to robots. We're already seeing some great use cases, for example, robots working with autistic children to engage them in ways that we haven't seen previously, or robots working with teachers to engage kids in learning with new results. And it's not just for kids. Early studies show that robots can help doctors and patients in health care settings.

Certes, les animaux sont vivants. Les robots ne le sont pas. Et mon expérience avec des ingénieurs en robotique me permet d'affirmer qu'on est loin de concevoir des robots qui ressentent quoi que ce soit. Mais nous éprouvons des sentiments à leur égard et c'est crucial. Car si nous tentons d'intégrer des robots dans nos espaces de vie, il faut comprendre qu'on ne va pas les traiter comme d'autres objets et que dans certains cas, par exemple, celui du soldat qui s'est attaché affectivement au robot avec lequel il travaille, ça peut devenir improductif, voire dangereux. Dans d'autres cas toutefois, ça peut être utile de nourrir une connexion émotionnelle avec un robot. Il y a des usages fabuleux, comme par exemple les robots qui travaillent avec des enfants autistes. Ils créent un lien avec eux jamais constaté auparavant. Il y a aussi des robots aux côtés des enseignants pour pousser, avec succès, les enfants à apprendre. Il n'y a pas que les enfants. Des études montrent que les robots peuvent assister médecins et infirmières dans le milieu des soins de la santé.

This is the PARO baby seal robot. It's used in nursing homes and with dementia patients. It's been around for a while. And I remember, years ago, being at a party and telling someone about this robot, and her response was, "Oh my gosh. That's horrible. I can't believe we're giving people robots instead of human care." And this is a really common response, and I think it's absolutely correct, because that would be terrible. But in this case, it's not what this robot replaces. What this robot replaces is animal therapy in contexts where we can't use real animals but we can use robots, because people will consistently treat them more like an animal than a device.

PARO est un robot bébé phoque. Il est utilisé dans des maisons pour patients atteints de démence. Ça fait déjà un certain temps. Je me souviens d'une soirée, il y a des années, où j'avais parlé de ce robot à quelqu'un. Et cette personne avait réagi ainsi : « Oh mon dieu ! C'est horrible. Je ne peux pas croire qu'on donne aux gens des robots à la place d'attention. » C'était une réaction habituelle et qui est correcte, je pense, car en effet, ce serait terrible. Dans ce cas, le robot ne remplace pas l'homme. C'est de la thérapie animale dans un contexte où on ne peut pas utiliser des animaux. Mais on peut utiliser des robots car les gens vont les traiter davantage comme un animal que comme un robot.

Acknowledging this emotional connection to robots can also help us anticipate challenges as these devices move into more intimate areas of people's lives. For example, is it OK if your child's teddy bear robot records private conversations? Is it OK if your sex robot has compelling in-app purchases?

Reconnaître cette connexion émotionnelle aux robots peut aussi nous aider à anticiper les défis liés au fait que ces engins intègrent les espaces intimes de nos vies. Par exemple, serait-il acceptable que le robot nounours de votre enfant enregistre des conversations privées ? Serait-il tolérable que votre robot sexuel ait une fonction d'achat attractive ?

(Laughter)

(Rires)

Because robots plus capitalism equals questions around consumer protection and privacy.

Car robots plus capitalisme égalent les questions sur la protection du consommateur et la vie privée.

And those aren't the only reasons that our behavior around these machines could matter. A few years after that first initial experience I had with this baby dinosaur robot, I did a workshop with my friend Hannes Gassert. And we took five of these baby dinosaur robots and we gave them to five teams of people. And we had them name them and play with them and interact with them for about an hour. And then we unveiled a hammer and a hatchet and we told them to torture and kill the robots.

Ce ne sont pas les seules raisons pour lesquelles nos comportements avec ces engins sont importants. Quelques années après ma première expérience avec le robot bébé dinosaure, j'ai organisé un atelier avec mon ami Hannes Gassert. On a pris cinq robots bébés dinosaures que l'on a remis à cinq équipes. Elles devaient leur donner un nom, jouer avec et interagir avec eux pendant une heure environ. Ensuite, on leur a remis un marteau et une hache et on leur a demandé de torturer et tuer les robots.

(Laughter)

(Rires)

And this turned out to be a little more dramatic than we expected it to be, because none of the participants would even so much as strike these baby dinosaur robots, so we had to improvise a little, and at some point, we said, "OK, you can save your team's robot if you destroy another team's robot."

La situation est devenue beaucoup plus tendue que ce que nous avions pensé car aucun participant n'a voulu faire de mal aux robots bébés dinosaures. Du coup, on a dû improviser et leur dire ceci : « D'accord. Vous pouvez sauver votre robot si vous détruisez celui des autres. »

(Laughter)

(Rires)

And even that didn't work. They couldn't do it. So finally, we said, "We're going to destroy all of the robots unless someone takes a hatchet to one of them." And this guy stood up, and he took the hatchet, and the whole room winced as he brought the hatchet down on the robot's neck, and there was this half-joking, half-serious moment of silence in the room for this fallen robot.

Même ça, ça n'a pas marché. Ils n'y arrivaient pas. Alors on leur a dit : « On va détruire tous les robots si personne n'en casse un à la hache. » Alors, un type s'est levé et a pris la hache. Toute l'assemblée a grimacé quand il l'a abattue sur le cou du robot. Un silence s'est installé dans la salle, mi-sérieux, mi-plaisanterie, pour le robot tombé.

(Laughter)

(Rires)

So that was a really interesting experience. Now, it wasn't a controlled study, obviously, but it did lead to some later research that I did at MIT with Palash Nandy and Cynthia Breazeal, where we had people come into the lab and smash these HEXBUGs that move around in a really lifelike way, like insects. So instead of choosing something cute that people are drawn to, we chose something more basic, and what we found was that high-empathy people would hesitate more to hit the HEXBUGS.

C'était une expérience vraiment intéressante. Ce n'était pas une expérience contrôlée mais elle a mené à des recherches ultérieures au MIT que j'ai conduites avec Palash Nandy et Cynthia Breazeal. Nous invitions des gens dans le labo pour écraser ces HEXBUGs qui se meuvent très réalistement, comme des insectes. Au lieu de choisir des objets mignons qui attirent les gens, on a choisi quelque chose de plus basique. Nous avons découvert que les gens avec une grande empathie hésitaient davantage à frapper les HEXBUGs.

Now this is just a little study, but it's part of a larger body of research that is starting to indicate that there may be a connection between people's tendencies for empathy and their behavior around robots. But my question for the coming era of human-robot interaction is not: "Do we empathize with robots?" It's: "Can robots change people's empathy?" Is there reason to, for example, prevent your child from kicking a robotic dog, not just out of respect for property, but because the child might be more likely to kick a real dog?

C'est une petite étude qui fait partie d'un grand champ de recherches qui semble indiquer qu'il pourrait y avoir un lien entre les tendances pour l'empathie des gens et leur comportement avec des robots. Ma question cruciale pour l'ère prochaine d'interactions hommes - robots n'est pas : « Ressentons-nous de l'empathie pour les robots ? » C'est : « Les robots peuvent-ils changer l'empathie des gens ? » Y a-t-il une bonne raison pour, par exemple, empêcher votre enfant de frapper un robot-chien, non pas pour le respect des biens, mais parce que ça pourrait le rendre plus susceptible de frapper un vrai chien ?

And again, it's not just kids. This is the violent video games question, but it's on a completely new level because of this visceral physicality that we respond more intensely to than to images on a screen. When we behave violently towards robots, specifically robots that are designed to mimic life, is that a healthy outlet for violent behavior or is that training our cruelty muscles? We don't know ... But the answer to this question has the potential to impact human behavior, it has the potential to impact social norms, it has the potential to inspire rules around what we can and can't do with certain robots, similar to our animal cruelty laws. Because even if robots can't feel, our behavior towards them might matter for us. And regardless of whether we end up changing our rules, robots might be able to help us come to a new understanding of ourselves.

À nouveau, il n'y a pas que les enfants. C'est le débat des jeux vidéo violents, mais à un tout autre niveau, à cause de cette réaction physique et viscérale plus intense que celle ressentie face à des images sur écran. Si nous agissons avec violence vis-à-vis des robots, des robots conçus pour imiter la vie, est-ce un exutoire sain des comportements violents ou bien est-ce en train de nourrir notre cruauté ? On ne sait pas. Toutefois la réponse peut influencer les comportements humains, elle peut influencer les normes sociales, elle peut inspirer des règles sur ce qu'on peut et ne peut pas faire avec certains robots, à l'instar des lois contre la cruauté envers les animaux. Même si les robots ne ressentent pas, notre comportement à leur égard est important pour nous-mêmes. Que nous changions ou pas nos réglementations, les robots pourraient nous offrir une compréhension nouvelle de nous-mêmes.

Most of what I've learned over the past 10 years has not been about technology at all. It's been about human psychology and empathy and how we relate to others. Because when a child is kind to a Roomba, when a soldier tries to save a robot on the battlefield, or when a group of people refuses to harm a robotic baby dinosaur, those robots aren't just motors and gears and algorithms. They're reflections of our own humanity.

Tout ce que j'ai appris ces dix dernières années, ne concerne pas la technologie. Il s'agit de la psychologie de l'homme, de l'empathie et de la façon dont nous nous lions avec autrui. Car quand un enfant est gentil avec Roomba, qu'un soldat tente de sauver un robot sur le champ de bataille ou qu'un groupe de personnes refuse d'abîmer un robot bébé dinosaure, ces robots ne sont plus que des moteurs, des engrenages et des algorithmes. Ils deviennent le reflet de notre propre humanité.

Thank you.

Merci.

(Applause)

(Applaudissements)