An einem Tag vor etwa zehn Jahren ließ ich einen Freund einen Baby-Dino-Roboter kopfüber halten. Es war ein Spielzeug namens Pleo, das ich mir bestellt hatte. Ich freute mich sehr darauf, denn ich liebe Roboter. Dieser hatte echt coole technische Features. Er hatte Motoren, Tastsensoren und eine Infrarotkamera und dann besaß er einen Neigungssensor. Er kannte also seine Ausrichtung im Raum. Wenn man ihn kopfüber hielt, würde er anfangen zu heulen. Das fand ich supercool und zeigte ich ihn daher einer Freundin, ich sagte: "Hey, heb ihn am Schwanz hoch. Schau was er macht." Wir schauten uns also das Agieren des Roboters an, wie er leidet und heult. Nach ein paar Sekunden fing es an mich ein wenig zu stören, und ich sagte: "Okay, das reicht. Lassen wir ihn wieder runter." Dann streichelte ich den Roboter, damit er zu heulen aufhörte. Das war eine etwas seltsame Erfahrung für mich. Ich war nämlich zu dieser Zeit nicht besonders mütterlich. Wobei ich vor 9 Monaten Mutter geworden bin, und jetzt weiß, dass kopfüber gehaltene Babies sich auch wehren. (Gelächter) Aber meine Reaktion auf den Roboter war auch interessant, da ich genau wusste, wie diese Maschine funktioniert, und dennoch fühlte ich mich veranlasst, lieb zu ihr zu sein. Diese Erkenntnis entfachte eine Neugier, der ich die letzten Jahre nachgegangen bin. Warum tröstete ich diesen Roboter? Eine Erkenntnis war, dass mein Umgang mit dieser Maschine mehr als nur ein verlegener Moment in meinem Wohnzimmer war und dass in einer Welt, in die wir immer mehr Roboter integrieren, ein solcher Instinkt Konsequenzen haben könnte. Denn meine erste Entdeckung war, dass das nicht nur mich betrifft.

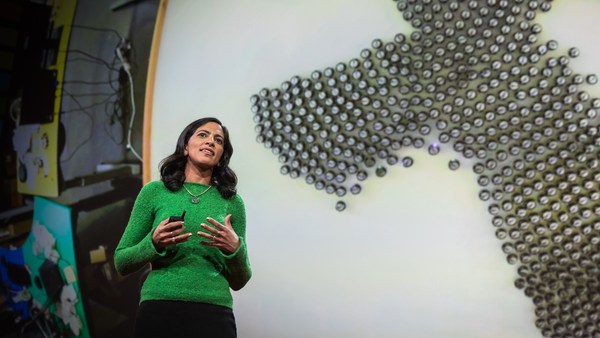

There was a day, about 10 years ago, when I asked a friend to hold a baby dinosaur robot upside down. It was this toy called a Pleo that I had ordered, and I was really excited about it because I've always loved robots. And this one has really cool technical features. It had motors and touch sensors and it had an infrared camera. And one of the things it had was a tilt sensor, so it knew what direction it was facing. And when you held it upside down, it would start to cry. And I thought this was super cool, so I was showing it off to my friend, and I said, "Oh, hold it up by the tail. See what it does." So we're watching the theatrics of this robot struggle and cry out. And after a few seconds, it starts to bother me a little, and I said, "OK, that's enough now. Let's put him back down." And then I pet the robot to make it stop crying. And that was kind of a weird experience for me. For one thing, I wasn't the most maternal person at the time. Although since then I've become a mother, nine months ago, and I've learned that babies also squirm when you hold them upside down. (Laughter) But my response to this robot was also interesting because I knew exactly how this machine worked, and yet I still felt compelled to be kind to it. And that observation sparked a curiosity that I've spent the past decade pursuing. Why did I comfort this robot? And one of the things I discovered was that my treatment of this machine was more than just an awkward moment in my living room, that in a world where we're increasingly integrating robots into our lives, an instinct like that might actually have consequences, because the first thing that I discovered is that it's not just me.

Im Jahr 2007 meldete The Washington Post, dass das US-amerikanische Militär einen Roboter testete, der Landminen entschärfen sollte. Gebaut wie eine Stabheuschrecke, funktionierte er so, dass er in einem Minenfeld auf seinen Beinen herumlief und jedes Mal, wenn er auf eine Mine trat und ein Bein explodierte, lief er auf den übrigen Beinen weiter, um mehr Minen zu finden. Der zuständige Oberst dieses Tests beschloss ihn abzublasen, weil es zu unmenschlich wäre, den beschädigten Roboter zu beobachten wie er sich über das Feld schleppt. Was veranlasst einen abgehärteten Militäroffizier und jemanden wie mich, so auf einen Roboter zu reagieren?

In 2007, the Washington Post reported that the United States military was testing this robot that defused land mines. And the way it worked was it was shaped like a stick insect and it would walk around a minefield on its legs, and every time it stepped on a mine, one of the legs would blow up, and it would continue on the other legs to blow up more mines. And the colonel who was in charge of this testing exercise ends up calling it off, because, he says, it's too inhumane to watch this damaged robot drag itself along the minefield. Now, what would cause a hardened military officer and someone like myself to have this response to robots?

Natürlich sind wir durch Science-Fiction und Popkultur geprägt und möchten diese Dinge vermenschlichen, aber es ist etwas tiefgehender als das. Wir sind nämlich genetisch programmiert Absicht und Leben auf jede selbstständige Bewegung unserer Umgebung zu projizieren. Deswegen behandeln Menschen alle Arten von Robotern wie Lebewesen. Diese Bombenentschärfungsroboter erhalten Namen. Sie erhalten Ehrenmedaillen. Sie hatten Beerdigungen mit Salutschüssen. Studien zeigen, dass wir das sogar mit einfachen Hausrobotern machen, wie dem Roomba-Staubsauger.

Well, of course, we're primed by science fiction and pop culture to really want to personify these things, but it goes a little bit deeper than that. It turns out that we're biologically hardwired to project intent and life onto any movement in our physical space that seems autonomous to us. So people will treat all sorts of robots like they're alive. These bomb-disposal units get names. They get medals of honor. They've had funerals for them with gun salutes. And research shows that we do this even with very simple household robots, like the Roomba vacuum cleaner.

(Gelächter)

(Laughter)

Das ist nur eine fahrende Scheibe, die unseren Boden säubert, aber allein, dass sie sich frei bewegt, veranlasst Leute, ihr einen Namen zu geben und Mitleid zu empfinden, wenn sie unter dem Sofa feststeckt.

It's just a disc that roams around your floor to clean it, but just the fact it's moving around on its own will cause people to name the Roomba and feel bad for the Roomba when it gets stuck under the couch.

(Gelächter)

(Laughter)

Wir können Roboter entwickeln, um genau diese Reaktionen herbeizurufen durch Integrierung von Augen, Gesichtern und Bewegungen, die automatisch unterbewusst als Gemütszustand verstanden werden. Es gibt ein ganzes Forschungsgebiet, genannt Mensch-Roboter-Interaktion,

And we can design robots specifically to evoke this response, using eyes and faces or movements that people automatically, subconsciously associate with states of mind.

das zeigt, wie gut das funktioniert. So fanden Forscher an der Stanford-Universität heraus, dass es für Probanden unangenehm ist, den Intimbereich eines Roboters berühren zu müssen.

And there's an entire body of research called human-robot interaction that really shows how well this works. So for example, researchers at Stanford University found out that it makes people really uncomfortable when you ask them to touch a robot's private parts.

(Gelächter)

(Laughter)

Von dieser und vielen anderen Studien wissen wir, dass Menschen auf die Signale dieser lebendig erscheinenden Maschinen reagieren, auch im Wissen, dass sie nicht echt sind.

So from this, but from many other studies, we know, we know that people respond to the cues given to them by these lifelike machines, even if they know that they're not real.

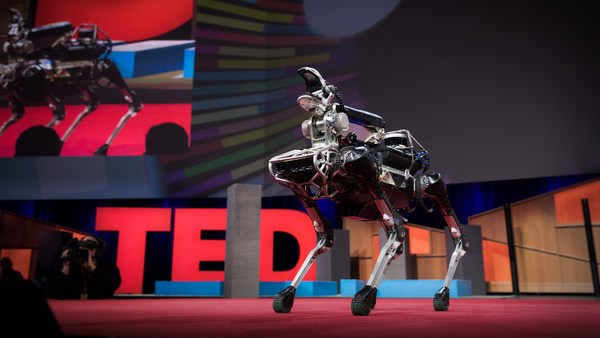

Nun rücken wir näher an eine Welt, wo Roboter überall sind. Robotertechnik verlässt die Fabrikhallen und kommt im Arbeitsalltag und unseren Haushalten an. Da diese Maschinen, die fühlen können, selbständig Entscheidungen treffen und lernen können, nun in diese gemeinsamen Räume eintreten, ist die beste Analogie dafür vielleicht unsere Beziehung mit Haustieren. Vor Tausenden von Jahren begannen wir Haustiere zu halten, wir trainierten sie als Arbeiter, Waffen oder Begleiter. Wir behandelten manche Tiere wie Werkzeug oder Ware, während wir andere liebevoll behandelten und sie als Begleiter in unserer Gesellschaft aufnahmen. Es ist möglich, dass wir anfangen, Roboter gleichermaßen zu integrieren. Natürlich, Tiere sind lebendig, Roboter sind es nicht. Durch die Zusammenarbeit mit Roboteringenieuren weiß ich, dass wir noch weit davon entfernt sind, empfindungsfähige Roboter zu bauen. Aber wir empfinden etwas für sie und das zählt, denn wenn wir versuchen, Roboter in unseren Alltag zu integrieren, müssen wir verstehen, dass wir sie anders als normale Geräte behandeln werden, und dass in manchen Fällen, wie beim Soldaten, der sich emotional an seinen Roboterkollegen bindet, das ineffizient bis gefährlich sein kann. Andererseits kann es auch nützlich sein, diese emotionale Verbindung zu Robotern zu fördern. Wir kennen schon einige tolle Anwendungen, beispielsweise Roboter für autistische Kinder, die sie auf eine noch nie gesehene Art und Weise beschäftigen, oder Roboter, die mit Lehrern arbeiten, um Kinder beim Lernen zu unterstützen. Das gilt nicht nur für Kinder. Erste Studien zeigen, Roboter können im Gesundheitswesen für Ärzte und Patienten nützlich sein.

Now, we're headed towards a world where robots are everywhere. Robotic technology is moving out from behind factory walls. It's entering workplaces, households. And as these machines that can sense and make autonomous decisions and learn enter into these shared spaces, I think that maybe the best analogy we have for this is our relationship with animals. Thousands of years ago, we started to domesticate animals, and we trained them for work and weaponry and companionship. And throughout history, we've treated some animals like tools or like products, and other animals, we've treated with kindness and we've given a place in society as our companions. I think it's plausible we might start to integrate robots in similar ways. And sure, animals are alive. Robots are not. And I can tell you, from working with roboticists, that we're pretty far away from developing robots that can feel anything. But we feel for them, and that matters, because if we're trying to integrate robots into these shared spaces, we need to understand that people will treat them differently than other devices, and that in some cases, for example, the case of a soldier who becomes emotionally attached to the robot that they work with, that can be anything from inefficient to dangerous. But in other cases, it can actually be useful to foster this emotional connection to robots. We're already seeing some great use cases, for example, robots working with autistic children to engage them in ways that we haven't seen previously, or robots working with teachers to engage kids in learning with new results. And it's not just for kids. Early studies show that robots can help doctors and patients in health care settings.

Das ist der Baby-Robben-Roboter PARO. Er wird in Pflegeheimen und bei dementen Patienten verwendet. Es gibt ihn schon länger. Vor ein paar Jahren auf einer Party sprach ich mit jemandem über diesen Roboter und ihre Reaktion war: "Meine Güte. Das ist ja entsetzlich. Kaum zu glauben, dass wir Leuten Roboter statt Menschen als Pfleger geben." Das ist eine ziemlich häufige Reaktion, und meiner Ansicht nach ist sie komplett richtig, denn das wäre schrecklich. Aber der Roboter ersetzt hier etwas anderes. Er ersetzt die Tier-Therapie in Situationen, wo wir keine echten Tiere verwenden können, aber Roboter eben schon, da Menschen sie konsequent eher wie ein Tier als ein Gerät behandeln. Diese emotionale Bindung zu Robotern anzuerkennen, kann uns helfen, Probleme vorauszuahnen, da diese Maschinen Teil des persönlichen Lebens werden. Ist es zum Beispiel okay, wenn der Teddybär Ihres Kindes private Gespräche aufzeichnet? Ist es okay, wenn ihr Sexroboter verlockende in-App-Angebote hat?

This is the PARO baby seal robot. It's used in nursing homes and with dementia patients. It's been around for a while. And I remember, years ago, being at a party and telling someone about this robot, and her response was, "Oh my gosh. That's horrible. I can't believe we're giving people robots instead of human care." And this is a really common response, and I think it's absolutely correct, because that would be terrible. But in this case, it's not what this robot replaces. What this robot replaces is animal therapy in contexts where we can't use real animals but we can use robots, because people will consistently treat them more like an animal than a device. Acknowledging this emotional connection to robots can also help us anticipate challenges as these devices move into more intimate areas of people's lives. For example, is it OK if your child's teddy bear robot records private conversations? Is it OK if your sex robot has compelling in-app purchases?

(Gelächter)

(Laughter)

Denn Roboter plus Kapitalismus bedingt Fragen über Privatsphäre und Verbraucherschutz.

Because robots plus capitalism equals questions around consumer protection and privacy.

Nicht nur deswegen ist unser Umgang mit diesen Maschinen bedeutend. Ein paar Jahre nach diesem ersten Erlebnis mit dem Baby-Dino-Roboter, hielt ich ein Seminar mit meinem Freund Hannes Gassert. Dort nahmen wir 5 dieser Baby-Dino-Roboter und gaben sie an fünf Gruppen. Wir ließen sie ihnen Namen geben und für eine Stunde mit ihnen spielen und interagieren. Dann enthüllten wir einen Hammer und ein Beil und riefen sie auf die Roboter zu quälen und zu töten.

And those aren't the only reasons that our behavior around these machines could matter. A few years after that first initial experience I had with this baby dinosaur robot, I did a workshop with my friend Hannes Gassert. And we took five of these baby dinosaur robots and we gave them to five teams of people. And we had them name them and play with them and interact with them for about an hour. And then we unveiled a hammer and a hatchet and we told them to torture and kill the robots.

(Gelächter)

(Laughter)

Das erwies sich als dramatischer als erwartet, da keiner der Teilnehmer es über das Herz brachte ihren Babydino zu schlagen. Also improvisierten wir und schlugen vor: "Okay, ihr könnt euren Roboter retten, wenn ihr den eines anderen Teams zerstört."

And this turned out to be a little more dramatic than we expected it to be, because none of the participants would even so much as strike these baby dinosaur robots, so we had to improvise a little, and at some point, we said, "OK, you can save your team's robot if you destroy another team's robot."

(Gelächter)

(Laughter)

Auch das brachte keiner übers Herz. Als letztes drohten wir: "Wir zerstören alle eure Roboter, es sei denn jemand schlägt mit dem Beil auf einen." Dieser eine Kerl stand auf, nahm das Beil und der ganze Raum zuckte zusammen als er das Beil auf das Genick des Roboters hämmerte. Es entstand diese halb scherzhafte, halb ernste Stille im Raum wegen des kaputten Roboters.

And even that didn't work. They couldn't do it. So finally, we said, "We're going to destroy all of the robots unless someone takes a hatchet to one of them." And this guy stood up, and he took the hatchet, and the whole room winced as he brought the hatchet down on the robot's neck, and there was this half-joking, half-serious moment of silence in the room for this fallen robot.

(Gelächter)

(Laughter)

Das war ein echt interessantes Erlebnis. Natürlich war das keine kontrollierte Studie, aber es führte zu weiterer Forschung, die ich am MIT zusammen mit Palash Nandy und Cynthia Breazal durchführte. Dort luden wir Leute in unser Labor ein, um diese HEXBUGs zu zerschlagen, die sich wie lebende Insekten bewegen. Anstatt etwas Niedliches zu wählen, was sympathisch wirkt, nahmen wir etwas Einfacheres. So fanden wir heraus, dass empathischere Menschen eher zögern, den HEXBUG zu schlagen.

So that was a really interesting experience. Now, it wasn't a controlled study, obviously, but it did lead to some later research that I did at MIT with Palash Nandy and Cynthia Breazeal, where we had people come into the lab and smash these HEXBUGs that move around in a really lifelike way, like insects. So instead of choosing something cute that people are drawn to, we chose something more basic, and what we found was that high-empathy people would hesitate more to hit the HEXBUGS.

Das ist nur eine kleine Studie, die aber Teil einer größeren Forschungsarbeit ist. Diese deutet immer mehr darauf hin, dass es eine Verbindung gibt zwischen den empathischen Tendenzen der Probanden und ihren Verhalten gegenüber Robotern. Aber meine Frage für die kommende Ära der Mensch-Roboter-Interaktion ist nicht: "Fühlen wir mit Robotern mit?", sondern: "Können Roboter menschliches Mitgefühl verändern?" Gibt es Gründe, zum Beispiel, ihr Kind vom Treten eines Robohundes abzuhalten, nicht nur aus purem Respekt vor Eigentum, sondern weil ihr Kind dann eher einen echten Hund treten würde?

Now this is just a little study, but it's part of a larger body of research that is starting to indicate that there may be a connection between people's tendencies for empathy and their behavior around robots. But my question for the coming era of human-robot interaction is not: "Do we empathize with robots?" It's: "Can robots change people's empathy?" Is there reason to, for example, prevent your child from kicking a robotic dog, not just out of respect for property, but because the child might be more likely to kick a real dog?

Nochmal, es geht nicht nur um Kinder. Es erinnert an die Frage über Gewalt in Videospielen, nur auf einem ganz neuem Level. Denn auf diese instinktiven Körperkontakte reagieren wir intensiver als auf Bilder am Bildschirm. Wenn wir Roboter gewaltsam behandeln, besonders lebensähnliche Roboter, ist das eine gesunde Art, Gewalt auszuleben, oder Training für unsere grausame Seite? Das wissen wir nicht ... Aber die Antwort auf diese Frage könnte menschliche Verhaltensmuster verändern. Sie hat das Potential, soziale Normen zu beeinflussen, und Regeln anzuregen, was wir tun und nicht tun dürfen mit bestimmen Robotern, analog zu den Gesetzen zur Tierquälerei. Denn auch wenn Roboter nichts fühlen, unser Verhalten ihnen gegenüber kann für uns wichtig sein. Egal ob wir unsere Regeln ändern, Roboter könnten uns helfen uns selbst besser zu verstehen.

And again, it's not just kids. This is the violent video games question, but it's on a completely new level because of this visceral physicality that we respond more intensely to than to images on a screen. When we behave violently towards robots, specifically robots that are designed to mimic life, is that a healthy outlet for violent behavior or is that training our cruelty muscles? We don't know ... But the answer to this question has the potential to impact human behavior, it has the potential to impact social norms, it has the potential to inspire rules around what we can and can't do with certain robots, similar to our animal cruelty laws. Because even if robots can't feel, our behavior towards them might matter for us. And regardless of whether we end up changing our rules, robots might be able to help us come to a new understanding of ourselves.

In den letzten 10 Jahren habe ich eher wenig über Technologie gelernt, sondern vor allem über Psychologie, Empathie und gegenseitigen Umgang. Wenn ein Kind nämlich nett zum Roomba ist, wenn ein Soldat versucht, einen Roboter im Schlachtfeld zu retten, oder wenn eine Gruppe ablehnt, einem mechanischen Babydino zu schaden, dann sind diese Roboter nicht nur Motoren, Gewinde und Algorithmen. Sie sind Spiegelungen unserer eigenen Menschlichkeit.

Most of what I've learned over the past 10 years has not been about technology at all. It's been about human psychology and empathy and how we relate to others. Because when a child is kind to a Roomba, when a soldier tries to save a robot on the battlefield, or when a group of people refuses to harm a robotic baby dinosaur, those robots aren't just motors and gears and algorithms. They're reflections of our own humanity.

Danke schön.

Thank you.

(Applaus)

(Applause)